La Théorie du Patch Ordonné

Un cadre conceptuel expliquant pourquoi notre expérience consciente se déploie dans un univers stable, régi par des règles, plutôt que dans un bruit infini — et pourquoi cette stabilité est fragile.

Le problème

Le bombardier et le bandeau

Pendant la Seconde Guerre mondiale, l’armée renforçait les parties des bombardiers revenus avec des impacts de balles, jusqu’à ce qu’elle réalise qu’elle observait les survivants. Les avions touchés aux moteurs ne revenaient jamais. Elle optimisait à partir d’un échantillon filtré.

Nous commettons exactement la même erreur lorsque nous observons l’univers. Nous voyons des milliards d’années de lois stables, un climat holocène prévisible et une chronologie causale, et nous en déduisons que cette stabilité est le régime physique par défaut.

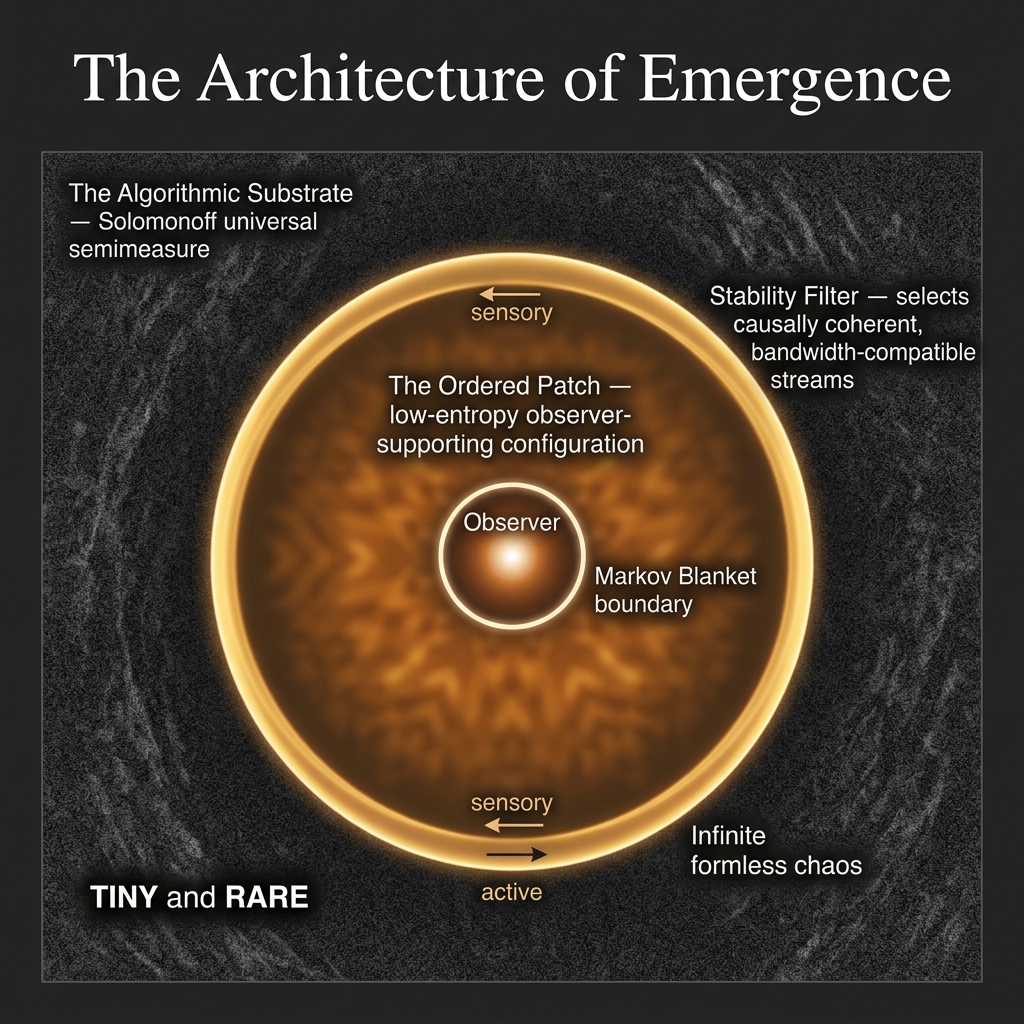

Ce n’est pas le cas. C’est le moteur holocène. Nous observons un échantillon filtré. Tout flux informationnel trop chaotique, trop bruité ou trop contradictoire pour soutenir un observateur stable a été éliminé. Nous existons dans un patch hautement ordonné au sein d’un chaos infini précisément parce que nous ne pouvions pas exister ailleurs.

La solution

Le Filtre de stabilité

La Théorie du Patch Ordonné propose que nous n'ayons pas besoin d'inventer des cordes complexes, des dimensions supplémentaires ou des créateurs de simulation pour expliquer la réalité. Nous n'avons besoin que de deux primitives : le Chaos infini et un Filtre de stabilité virtuel.

Parce que le chaos est infini, certains patchs locaux s'aligneront aléatoirement pour former des flux cohérents, régis par des règles. Un observateur conscient n'est que l'un de ces flux cohérents. Les « lois de la physique » ne sont pas des règles externes dictées par un créateur ; elles sont les motifs locaux requis pour satisfaire cette condition de frontière.

Le Patch Ordonné — une rare île de stabilité dans un bruit infini

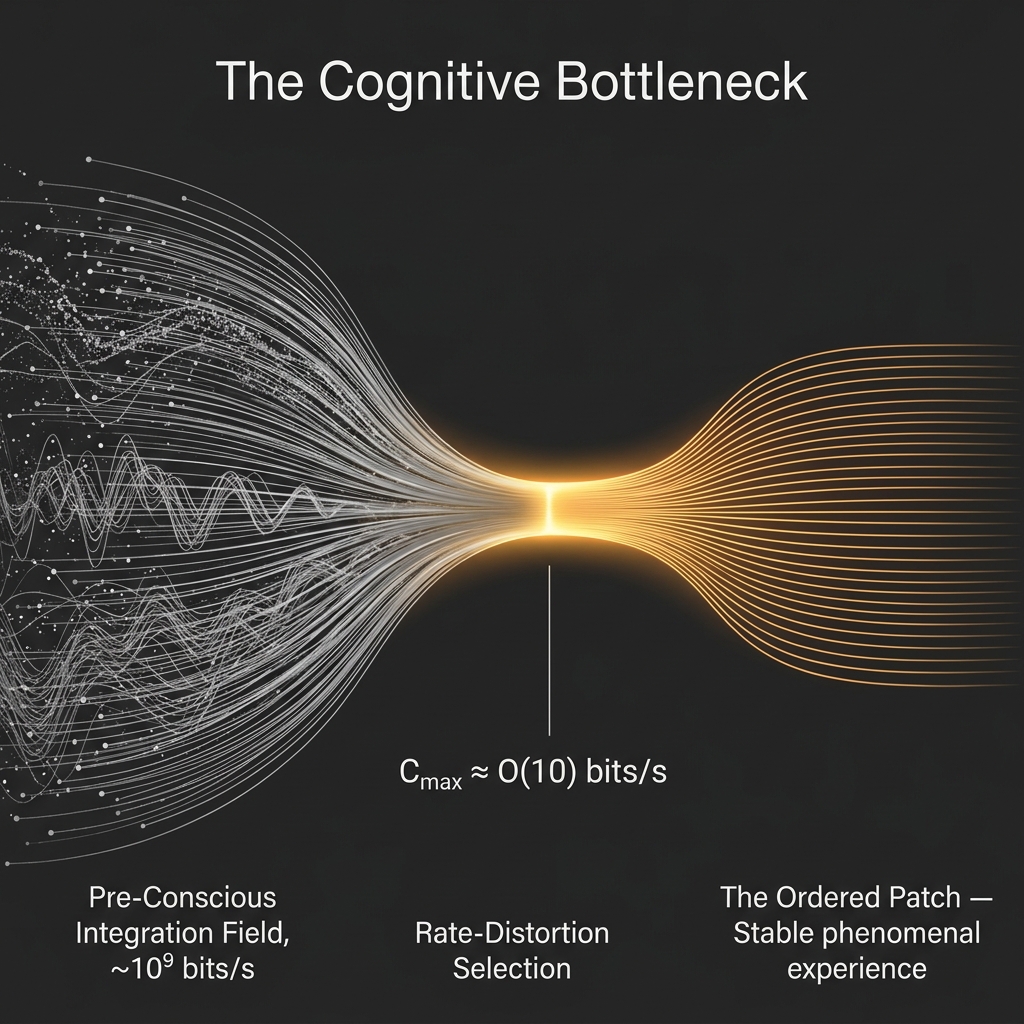

La conscience est modélisée comme un codec de compression à faible bande passante — une exigence structurelle qui compresse une réalité infinie et chaotique en un minuscule rendu 3D vivable. Mais le codec est fragile.

Le goulot d’étranglement cognitif — ~10⁹ bits/s compressés à ~10 bits/s

La crise

Entropie du codec (Dégradation narrative)

Lorsque nous modifions rapidement le climat, ou nous engageons dans des conflits mondiaux destructeurs, nous ne faisons pas que détériorer une planète physique. Nous injectons un bruit massif et imprévisible dans le flux de données plus vite que notre codec ne peut le compresser.

Si le bruit dépasse la bande passante du codec, le patch se déstabilise. Les « lois » commencent à se défaire. La société se fragmente. C’est ce que nous appelons la Dégradation narrative.

Le Choix

L’Éthique de la Veille des Survivants

Si l’Holocène n’est pas une loi physique garantie, mais un accomplissement informationnel coûteux, alors nous ne sommes pas des passagers sur une planète stable. Nous en sommes l’équipe active de maintenance.

Cela conduit à l’Éthique de la Veille des Survivants : un cadre éthique exigeant que nous protégions avec vigueur les codecs linguistiques, biologiques et institutionnels qui tiennent le bruit à distance.

Une cartographie du territoire

Comparaisons de théories

Comparer rigoureusement la Théorie du Patch Ordonné à ses plus proches ancêtres philosophiques et informationnels.

Principe de l’Énergie Libre (FEP / Inférence active)

Dynamique interne au monde vs origines du pourquoi ce monde

Ce que c’est : Le principe de l’énergie libre propose que tous les systèmes vivants maintiennent leur existence en agissant de manière à minimiser la surprise (énergie libre variationnelle) associée à leurs entrées sensorielles.

OPT vs FEP : Le FEP de Friston modélise l’action et l’apprentissage comme une minimisation de l’énergie libre à travers une Couverture de Markov existante. L’OPT reprend exactement cette machinerie, mais traite le FEP comme la dynamique locale à l’intérieur d’un patch déjà sélectionné. Le FEP est une théorie de la dynamique à l’intérieur du monde. L’OPT explique pourquoi des patchs stables, à faible entropie, dotés de Couvertures de Markov, existent tout court pour pouvoir être observés.

Induction de Solomonoff et goulot d’étranglement informationnel

Outils épistémiques vs. filtres ontologiques

Ce que c’est : l’induction de Solomonoff formalise le rasoir d’Occam en prédisant les données au moyen du programme informatique le plus court possible. La méthode du goulot d’étranglement informationnel compresse un signal de manière optimale tout en conservant son pouvoir prédictif.

OPT vs IB/Solomonoff : Normalement, il s’agit d’outils épistémiques qu’un système utilise pour prédire des données. L’OPT les transforme en un filtre ontologique et anthropique : le goulot d’étranglement est le processus de sélection de l’observateur. Un observateur n’habite qu’un flux capable de survivre à cette contrainte algorithmique sévère.

Hypothèse de l’univers mathématique (MUH)

Mathématiques sans bornes vs observateurs à capacité limitée

Ce que c’est : l’Hypothèse de l’Univers Mathématique de Max Tegmark propose que la réalité physique soit littéralement une structure mathématique, et que toutes les structures mathématiques possibles existent physiquement.

OPT vs MUH : l’OPT est très proche de la MUH, mais y ajoute un critère explicite de compatibilité avec l’observateur. La MUH affirme que « toutes les structures mathématiques existent ». L’OPT affirme qu’« elles existent mathématiquement, mais que les observateurs ne peuvent habiter que les structures incroyablement rares qui sont suffisamment compressibles pour survivre à un goulot d’étranglement prédictif sévère ».

Ontologies algorithmiques (Müller, Khan, Campos-García)

Propriétés algorithmiques vs limites mathématiques

Ce que c’est : le Law without Law (2020) de Müller et l’Algorithmic Idealism (2026) remplacent formellement une réalité physique indépendante par des auto-états algorithmiques régis par l’induction de Solomonoff, en montrant que la réalité objective — y compris la cohérence multi-agents — émerge asymptotiquement à partir de contraintes épistémiques à la première personne. Khan modélise les observateurs comme des algorithmes finis dont la frontière classique-quantique est imposée par la thermodynamique. Campos-García considère la conscience comme le renderer qui fait s’effondrer des champs computationnels en phénoménologie.

OPT vs ontologies algorithmiques : ces cadres convergent structurellement avec l’OPT, mais l’OPT est subjectiviste de manière plus radicale : il n’existe aucun monde partagé à retrouver asymptotiquement. La réalité physique et les « autres » sont des régularités structurelles à l’intérieur du flux de l’observateur, non des entités existant indépendamment. Là où ces cadres voisins laissent ouverte la dérivation de lois physiques spécifiques (comme la gravité), l’OPT traite son goulot d’étranglement de bande passante Cmax comme la limite mathématique exacte à partir de laquelle la physique macroscopique (par ex. la gravité entropique) est dérivée thermodynamiquement.

Théorie de l’information intégrée (IIT)

Constitutif vs sélectif

Ce que c’est : la Théorie de l’Information Intégrée (IIT) propose que la conscience soit identique à la quantité d’information intégrée (mesurée par $\Phi$) générée par la structure causale d’un système.

OPT vs IIT : l’IIT demande « Quelle structure informationnelle la conscience est-elle ? » (elle est constitutive). L’OPT demande « Quels flux d’information sont viables pour un observateur ? » (elle est sélective). Le point de friction le plus net est qu’un système à $\Phi$ élevé, alimenté par un bruit incompressible, pourrait ne présenter aucune phénoménalité stable dans l’OPT, parce qu’il ne satisfait pas à l’exigence de compression virtuelle (le Filtre de stabilité).

La théorie de l’interface de Hoffman

Primat de l’évolution contre primat de la compression

Ce que c’est : Donald Hoffman soutient que l’évolution nous a dissimulé la vérité objective du réel, en nous fournissant à la place une « interface utilisateur » simplifiée (notre monde perçu), conçue uniquement en fonction de l’aptitude biologique.

OPT vs Hoffman : l’OPT adhère fortement à la phénoménologie de l’interface, mais l’ancre autrement. L’OPT place l’interface de compression au premier plan. L’interface n’est pas d’abord un accident biologique ni une stratégie évolutive ; elle constitue la nécessité structurelle et thermodynamique de faire passer un substrat mathématique infini à travers une limite finie de bande passante.