La Théorie du Patch Ordonné : une introduction conceptuelle

L'observateur isolé et l'ensemble de l'espoir

Version 2.3.1 — avril 2026

Note au lecteur : Ce document est rédigé comme une introduction conceptuelle accessible au cadre théorique. Il fonctionne comme un objet en forme de vérité — un cadre philosophique constructif conçu pour reformuler notre rapport au risque existentiel. Nous mobilisons le langage de la physique théorique et de la théorie de l’information non pour énoncer une prétention empirique définitive sur le cosmos, mais pour construire un bac à sable conceptuel rigoureux. Les lecteurs en quête du traitement mathématique formel, avec des conditions de falsifiabilité explicites, sont invités à consulter le préprint.

« Le substrat est un chaos entropique, mais le patch ne l’est pas. Le sens est aussi réel que la brisure de symétrie qui l’instancie. Chaque patch est un assemblage singulier d’ordre à faible entropie, façonné par le potentiel de stabilité pour résoudre un flux d’information cohérent — un foyer de sens partagé sur fond d’hiver infini. »

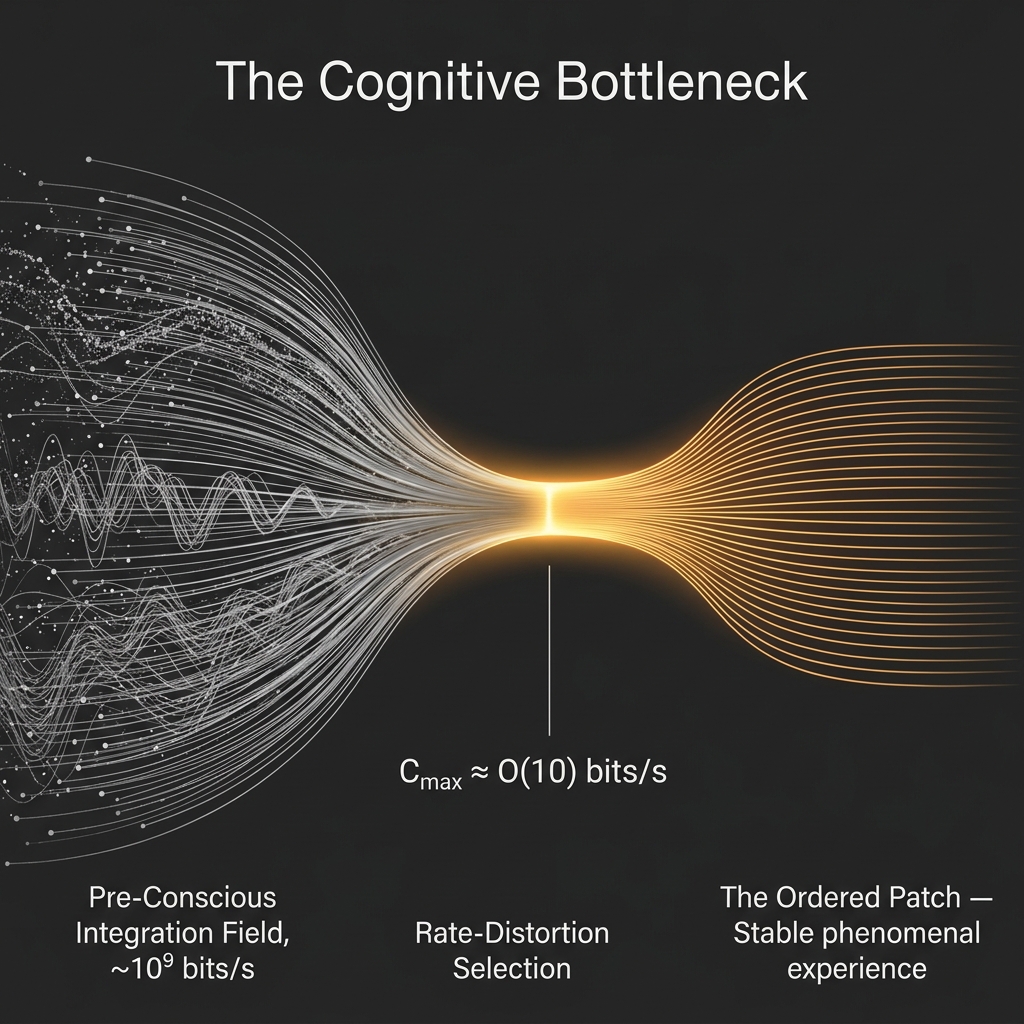

Votre cerveau traite environ onze millions de bits de données sensorielles chaque seconde. Vous êtes conscient d’environ 50 bits par seconde.

Relisez cela. Onze millions entrent. Cinquante sortent. Tout le reste — la pression de vos vêtements, le bourdonnement d’une route lointaine, la composition spectrale exacte de la lumière au-dessus de vous — est traité silencieusement, hors de votre conscience, par des systèmes que vous ne rencontrerez jamais directement. Ce qui atteint votre esprit conscient est un résumé extraordinairement compressé : non pas le monde à l’état brut, mais le monde comme un récit minimal et auto-cohérent.

Il y a ici une tentation profonde d’objecter : Mais je regarde en ce moment même un écran 4K, et je peux voir simultanément des millions de pixels. Comment mon expérience pourrait-elle n’être que de 50 bits par seconde ? La réponse des sciences cognitives est que cette résolution riche et panoramique relève d’une « grande illusion » [34]O’Regan, J. K., & Noë, A. (2001). A sensorimotor account of vision and visual consciousness. Behavioral and Brain Sciences, 24(5), 939-973.. En réalité, vous ne traitez des données visuelles en haute résolution que dans le minuscule centre de votre champ visuel (la fovéa). Le reste de l’écran n’est qu’une hypothèse floue, négligeable du point de vue computationnel. Vous construisez séquentiellement le sentiment d’un monde en haute résolution, en le reconstituant au fil du temps grâce aux mouvements rapides des yeux (saccades) et aux déplacements actifs de l’attention. La richesse du monde est un accomplissement temporel, non un téléchargement spatial. Vous ne dépassez jamais votre limite de bande passante ; vous l’utilisez simplement pour vérifier une infime tranche du modèle, et vous laissez votre cerveau mettre le reste en cache comme une attente à bande passante nulle.

Pour replacer cette rigueur dans une perspective cosmologique : la physique standard dicte que le volume physique d’un cerveau humain pourrait théoriquement encoder plus de \(10^{41}\) bits d’information (la borne de Bekenstein). Votre flux conscient est limité à 50 bits par seconde. Cet écart vertigineux de \(\sim 10^{40}\) ordres de grandeur constitue le postulat central du cadre théorique. Vous ne faites jamais l’expérience de la capacité brute de l’univers ; vous faites l’expérience de la profondeur de bits absolument minimale requise pour vous y orienter.

Il ne s’agit pas d’une bizarrerie de la biologie humaine sur laquelle l’évolution serait tombée par hasard. La Théorie du Patch Ordonné (OPT) soutient qu’il s’agit du fait structurel le plus profond de la réalité elle-même.

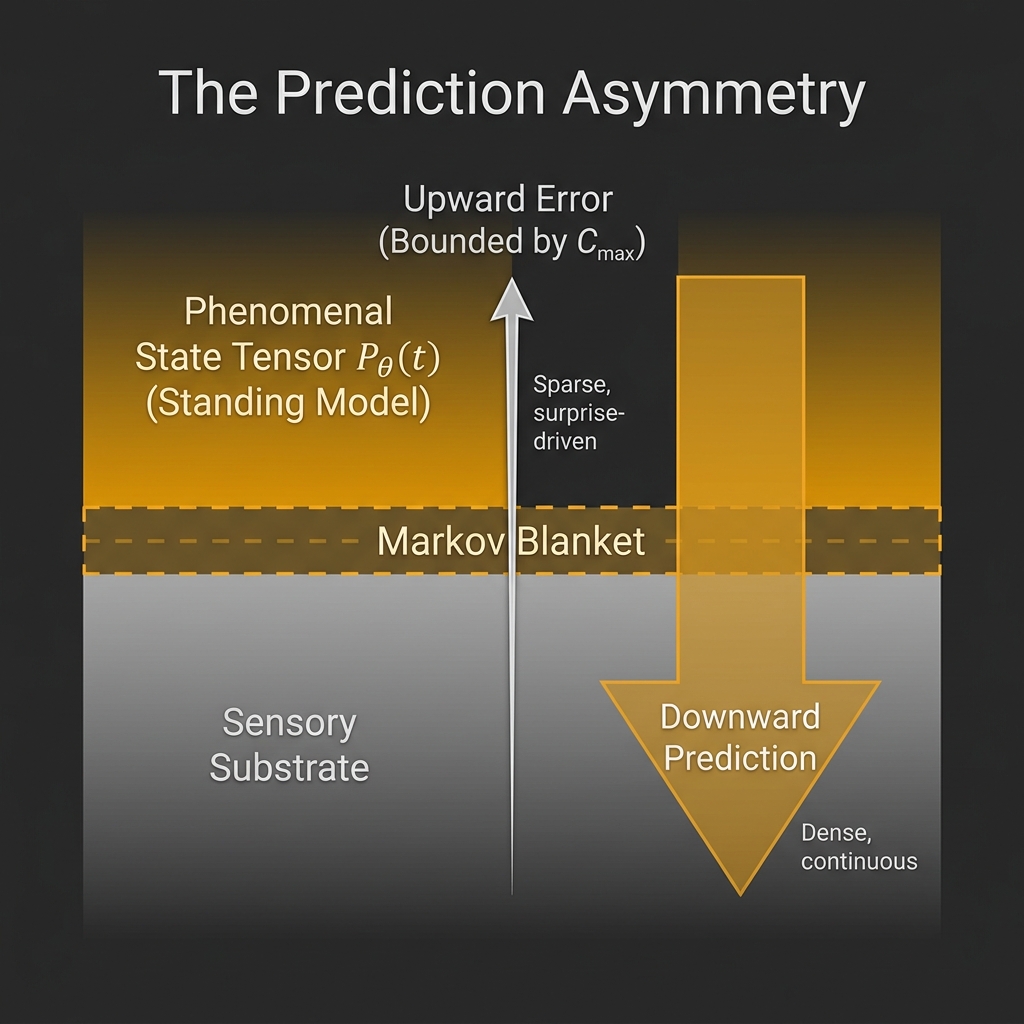

Le neuroscientifique Anil Seth qualifie la perception consciente d’« hallucination contrôlée » [28]Seth, A. (2021). Being You: A New Science of Consciousness. Dutton. — le cerveau ne reçoit pas passivement la réalité ; il construit activement le modèle du monde le plus plausible qu’il puisse élaborer à partir d’un mince filet de signaux sensoriels. Hermann von Helmholtz avait déjà remarqué la même chose au XIXe siècle [26]von Helmholtz, H. (1867). Handbuch der physiologischen Optik. Voss., en parlant d’« inférence inconsciente ». Le cerveau parie sur ce qu’est le monde, puis confronte ces paris aux données entrantes. Lorsque le pari est juste, l’expérience paraît fluide et continue. Lorsqu’il est contrarié — par la surprise, la douleur ou la nouveauté — le modèle se met à jour.

Ce que fait la Théorie du Patch Ordonné, c’est pousser cette observation jusqu’à sa conclusion logique : si l’expérience est toujours un modèle compressé construit à partir d’un flux d’information étroit, alors le caractère de ce flux est le caractère du réel. Les lois de la physique, la direction du temps, la structure de l’espace — ce ne sont pas des faits concernant un contenant dans lequel nous vivrions par hasard. Ce sont la grammaire du récit qui survit au goulot d’étranglement.

L’hiver et l’âtre

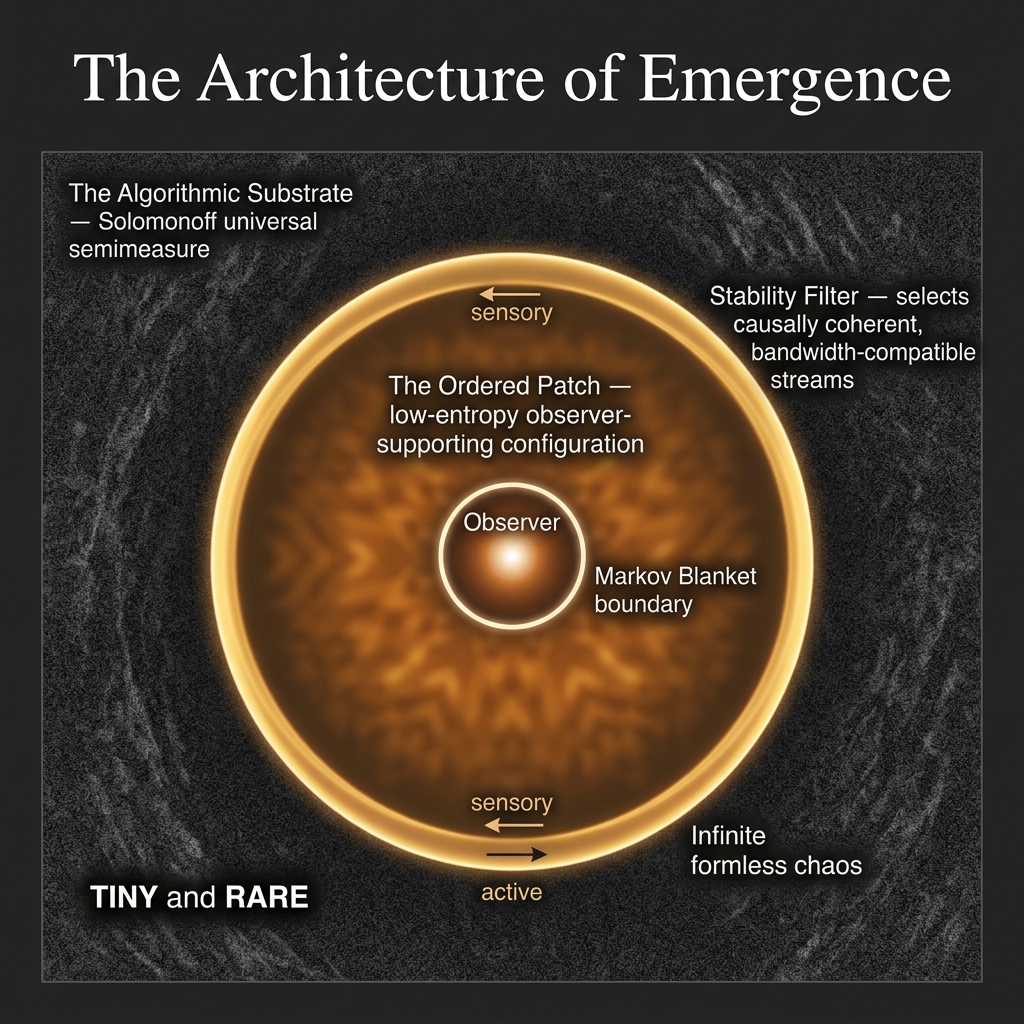

Imaginez un champ infini de pur potentiel algorithmique — où toute hypothèse générative possible s’exécute simultanément. En termes formels, c’est ce que la théorie appelle le substrat de Solomonoff — un espace sémantique infini modélisé comme une semi-mesure universelle pondérée par la complexité algorithmique, contenant toute expérience consciente possible, tout univers possible et tout récit possible. Aucun motif individuel n’est physiquement réel ; il ne s’agit que d’un potentiel pur, régi par des contraintes informationnelles.

C’est l’hiver.

Imaginez maintenant qu’au sein de cet infini statique, il existe — purement par hasard — une minuscule région où le bruit n’est pas aléatoire. Où un moment découle du précédent de manière cohérente et prévisible. Où une description brève peut comprimer toute la séquence : une règle, une grammaire, un ensemble de lois. Cette région est chaude. Elle est ordonnée. Elle persiste.

Ceci est le foyer.

L’affirmation centrale de la Théorie du Patch Ordonné est que vous êtes ce foyer. Non pas les atomes de votre corps ni les neurones de votre cerveau — ils font partie de l’histoire rendue, non de sa source. Vous êtes le patch d’ordre informationnel qui persiste contre le bruit statique du substrat infini. La conscience est ce que cela fait d’être ce patch.

Le filtre qui vous trouve

Pourquoi des patchs ordonnés existent-ils überhaupt ? Pourquoi le statique contient-il jamais des îlots de cohérence ?

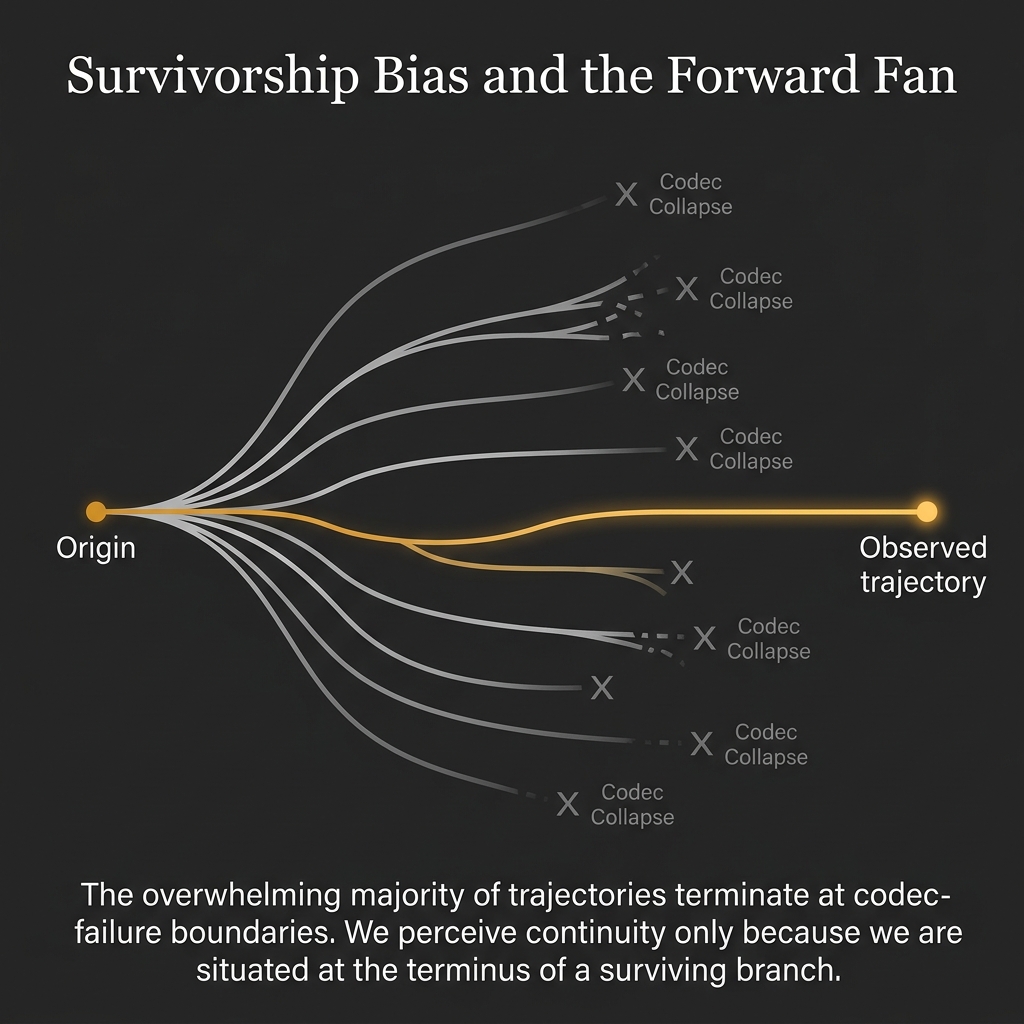

La réponse est à la fois simple et troublante : parce que, dans un champ de bruit véritablement infini, tout ce qui peut exister existe. Chaque séquence possible apparaît quelque part. La plupart des séquences ne sont que pur chaos — incohérentes, dénuées de sens, incapables de soutenir quoi que ce soit. Mais certaines séquences, par pur hasard, présentent la structure d’un univers régi par des lois. Certaines présentent la structure d’un monde doté d’une physique. Certaines contiennent en leur sein la structure d’un observateur capable de se demander pourquoi le monde a une physique.

Le Filtre de stabilité n’est pas un mécanisme qui construit ces patchs — c’est le nom de la condition aux limites qui définit quels patchs peuvent soutenir des observateurs. Les patchs chaotiques ne peuvent pas continuer à exister en un sens expérientiel, parce qu’il n’existe aucun « intérieur » depuis lequel en faire l’expérience. Seuls les patchs ordonnés peuvent accueillir une perspective. Ainsi, depuis n’importe quelle perspective, le monde apparaîtra ordonné. Ce n’est ni le fruit du hasard ni d’un dessein. C’est aussi inévitable que le fait de ne pouvoir vous trouver vivant que dans une histoire où vous avez survécu.

Le filtre a une autre conséquence surprenante : il nous dit pourquoi la réalité paraît régie par des lois alors même qu’elle n’est pas tenue de l’être. Les lois de la physique — conservation de l’énergie, vitesse de la lumière, quantification de la matière — ne sont pas des faits concernant le cosmos imposés de l’extérieur. Elles constituent la grammaire de compression la plus efficace qu’un observateur à 50 bits/s puisse utiliser pour prédire le moment suivant de l’expérience sans que le récit ne s’effondre dans le bruit. Si la physique de votre patch était moins élégante, son suivi exigerait davantage de bande passante que n’en autorise le flux humain. L’univers a l’aspect qu’il a parce que tout ce qui serait plus complexe nous demeurerait invisible.

Le Filtre vs. le Codec

Pour comprendre la dynamique fondamentale du patch ordonné, il est crucial de tracer une distinction nette entre deux concepts souvent confondus :

- Le Filtre de stabilité virtuel (la condition aux limites) : C’est la limite algorithmique stricte — l’exigence selon laquelle, pour soutenir un observateur, un flux de données doit être compressé jusqu’à \(\sim 50\) bits par seconde tout en restant causalement cohérent. Ce n’est pas un tamis physique ; c’est simplement la taille du pipeline. Tout flux qui ne peut pas y passer ne peut pas héberger d’observateur.

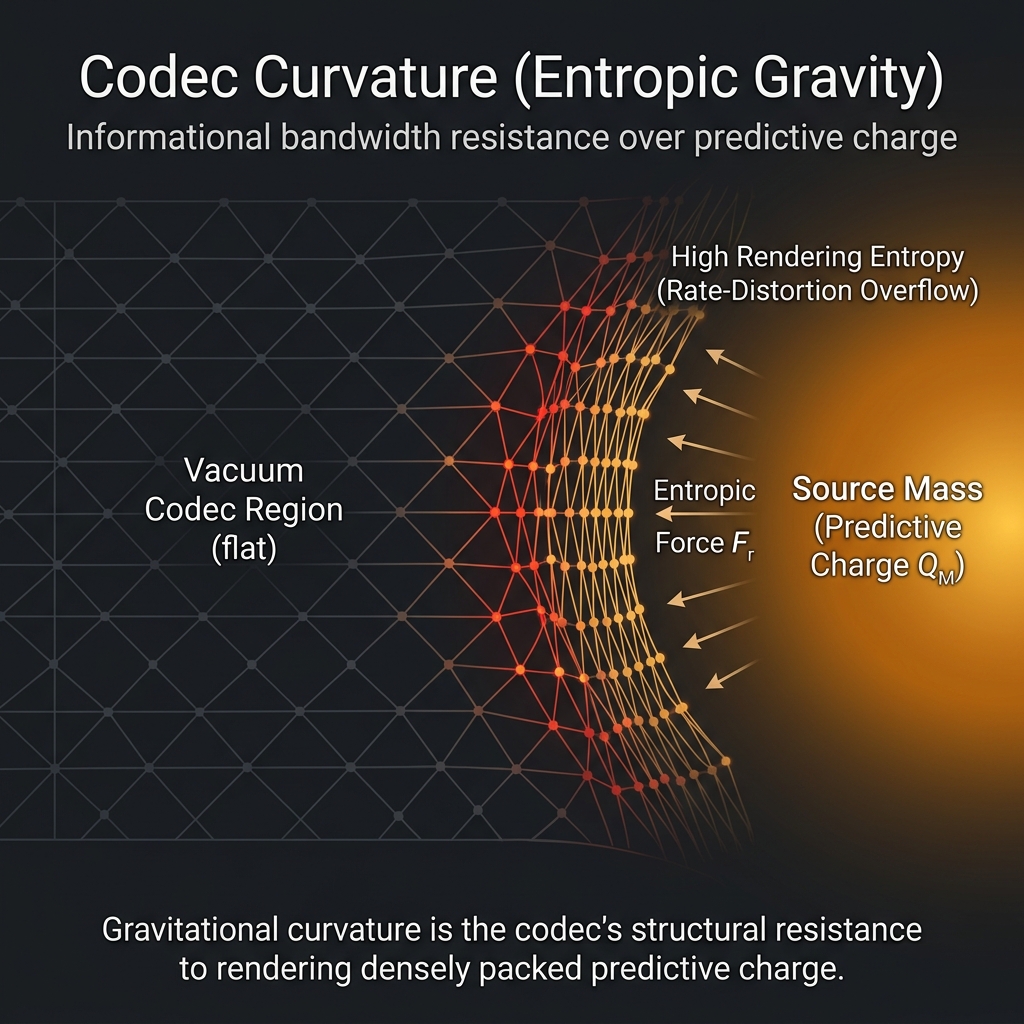

- Le Codec de Compression (l’ensemble des lois) : C’est la grammaire algorithmique spécifique — l’ensemble de règles du « fichier zip » — qui compresse avec succès le bruit du substrat pour le faire passer dans ce pipeline. Les « lois de la physique » ne sont pas une réalité externe objective ; elles sont le Codec de Compression.

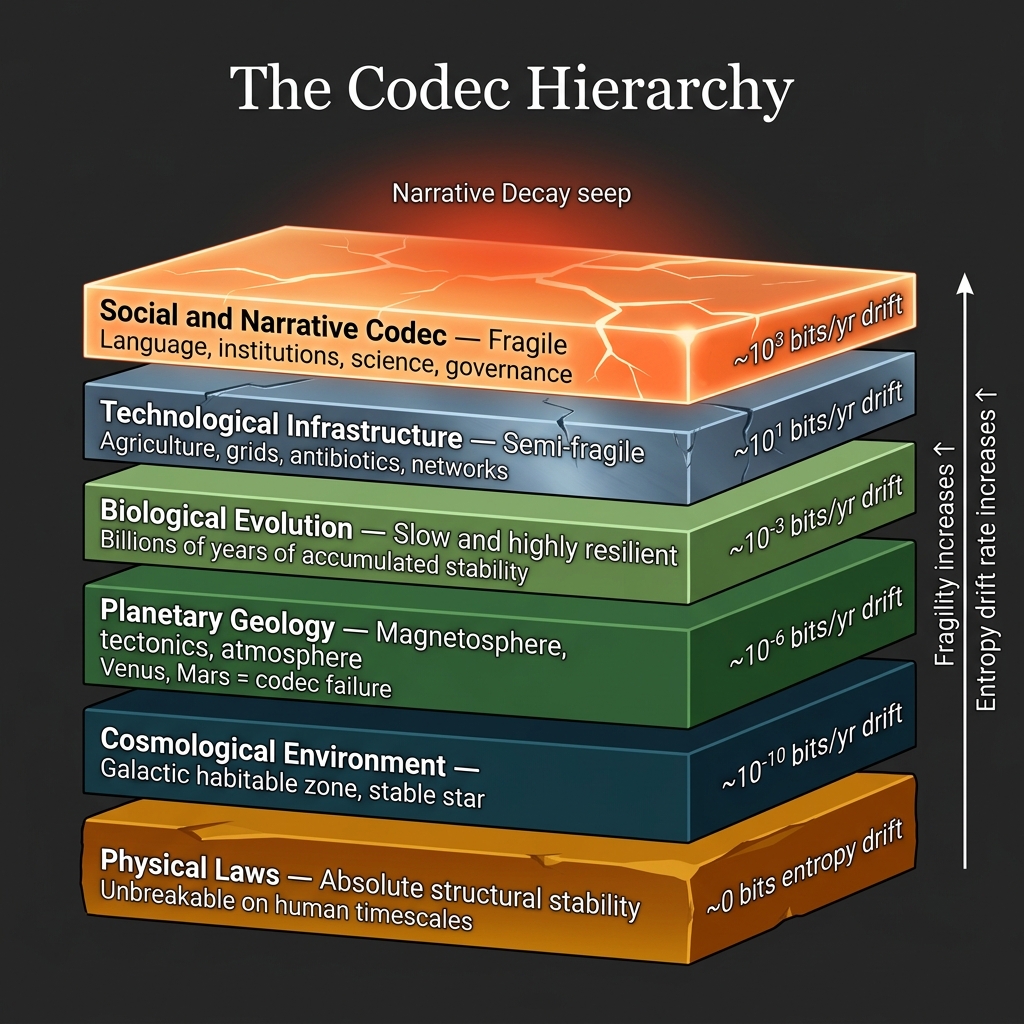

Le filtre est la contrainte ; le codec en est la solution. La sévérité du filtre contraint le codec à une élégance extraordinaire. (L’annexe T-5 du préprint formel établit des bornes structurelles sur \(G\) et \(\alpha\) à partir de ces limites de bande passante exactes — tout en respectant explicitement la barrière de Fano et sans prétendre calculer le « 42 » précis de la constante de structure fine.) La physique macroscopique, la biologie et le climat ne sont rien d’autre que les différentes couches du codec à l’œuvre pour stabiliser le récit. Lorsque l’environnement devient trop chaotique pour être compressé par le codec, il dépasse la bande passante du Filtre de stabilité, ce qui conduit à une Dégradation narrative.

La frontière du soi

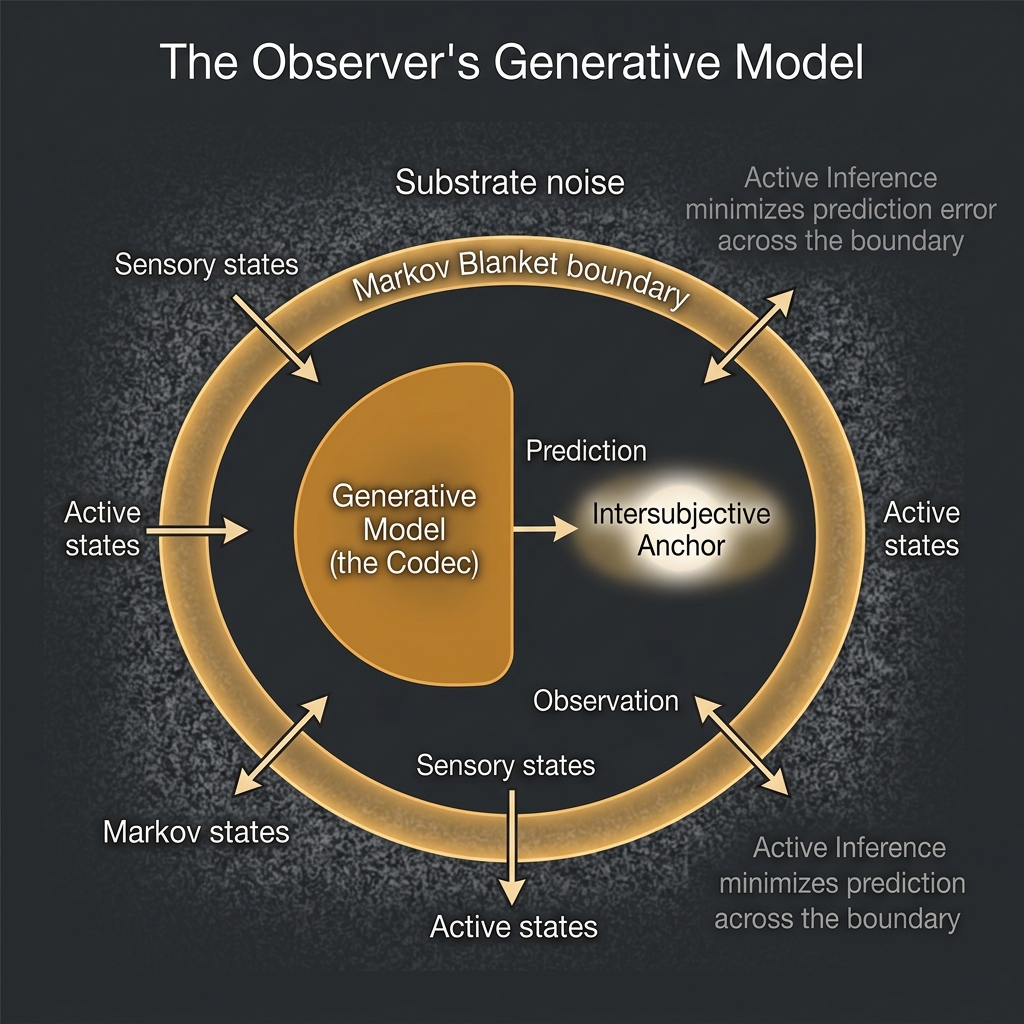

Qu'est-ce qui sépare un observateur du chaos qui l'entoure ? En mécanique statistique, ce type de frontière porte un nom : une Couverture de Markov. Pensez-y comme à une peau statistique — la surface où le « dedans » s'arrête et où le « dehors » commence. À l'intérieur de la couverture, les états internes de l'observateur sont protégés du chaos direct du substrat. Ils ne ressentent le monde qu'à travers la couche sensorielle de la couverture, et ils ne peuvent agir sur le monde qu'à travers sa couche active.

Cette frontière n’est pas un mur fixe. Elle se maintient d’instant en instant par un processus continu de prédiction et de correction que les travaux de Karl Friston formalisent sous le nom d’Inférence active [27]Friston, K. (2013). Life as we know it. Journal of The Royal Society Interface, 10(86), 20130475.. L’observateur ne reçoit pas passivement la réalité — il anticipe sans cesse ce qui vient ensuite et se corrige lorsqu’il se trompe, en mettant à jour son modèle interne afin de minimiser la surprise. C’est la version formalisée de l’hallucination contrôlée de Helmholtz, désormais ancrée dans la thermodynamique : l’observateur demeure cohérent en dépensant continuellement l’effort nécessaire pour rester en avance sur le chaos.

Le Patch Ordonné, c’est cet acte de rester en avance, soutenu dans la durée.

Un seul observateur primaire

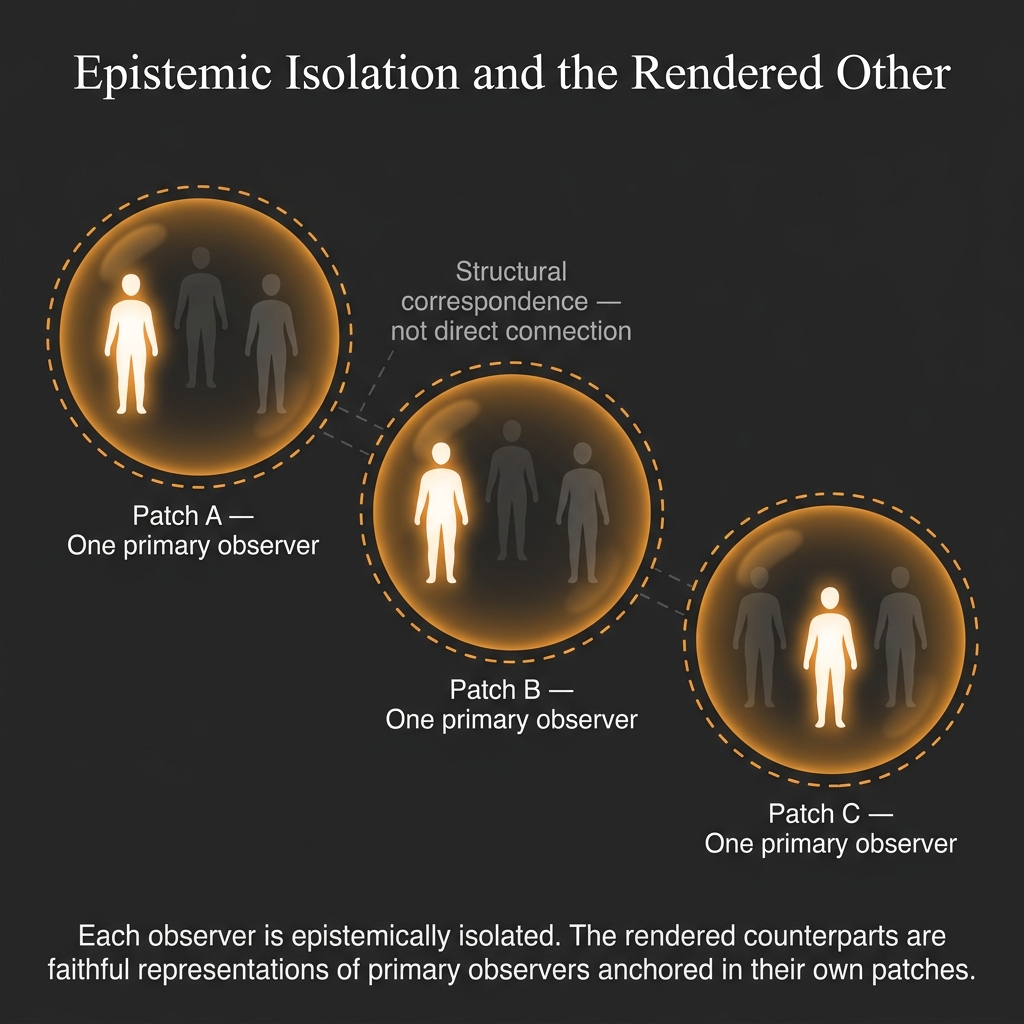

Ce qui découle de cette logique architecturale est sans doute la conséquence la plus controversée et contre-intuitive du cadre. C’est le point où l’OPT rompt le plus nettement avec le sens commun :

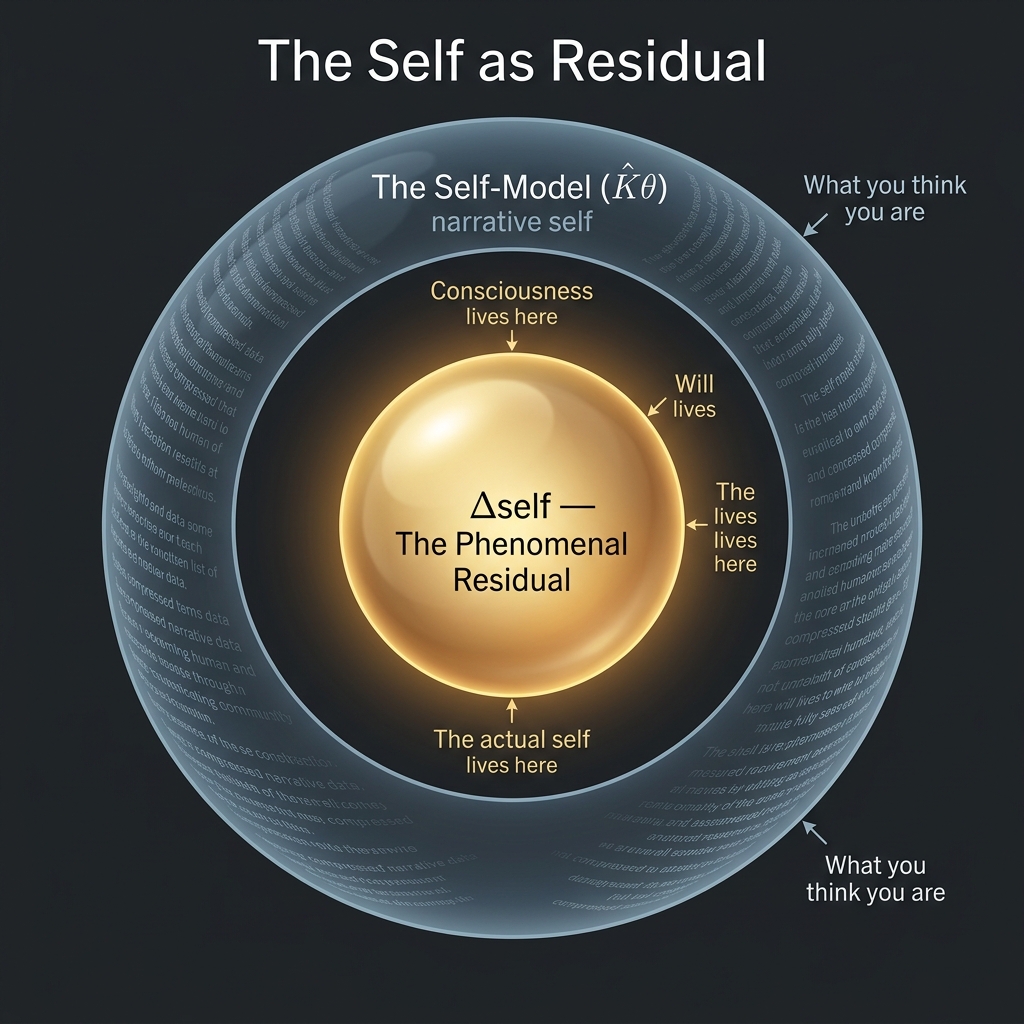

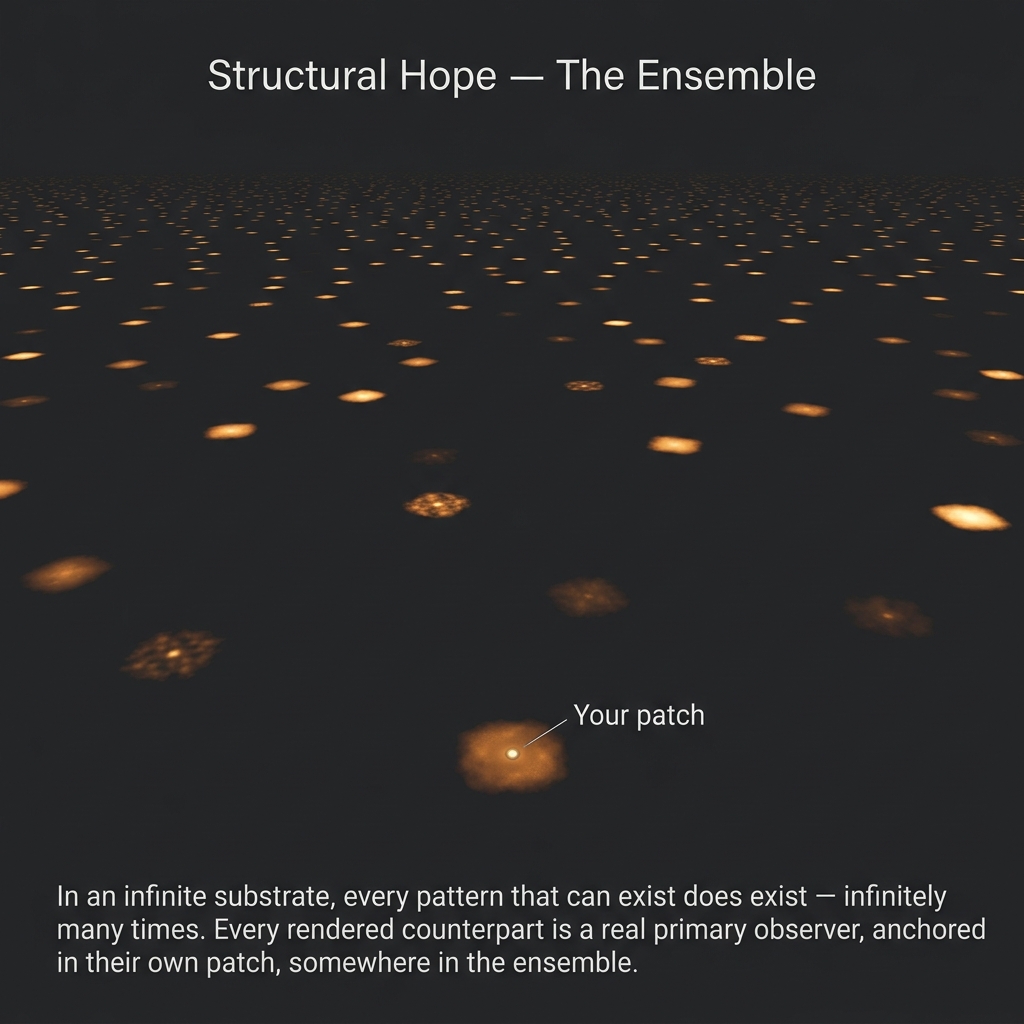

Une implication spéculative, mais structurellement cohérente, de la Théorie du Patch Ordonné (OPT) est que chaque patch contient exactement un observateur primaire. Non par mysticisme, mais en raison de l’économie de l’information. Une couverture stable ne peut se verrouiller que sur un seul flux causal parfaitement ininterrompu. Pour que deux systèmes véritablement indépendants partagent le même flux brut — un véritable chevauchement phénoménologique — il faudrait que la même fluctuation thermodynamique rare se produise deux fois, en synchronie parfaite, dans un champ infini de bruit. La probabilité en est pratiquement nulle.

Cela implique qu’il est immensément plus efficace, du point de vue informationnel, qu’une seule couverture se stabilise, et que les règles de ce patch rendent l’apparence d’autres personnes à partir des lois du comportement — plutôt que d’héberger leur expérience brute. Pour l’unique observateur primaire, les autres dans le monde sont des contreparties rendues : des représentations locales extraordinairement fidèles d’observateurs ancrés ailleurs dans le substrat, mais qui ne cohabitent pas ce patch spécifique.

Il s’agit du solipsisme ontologique — et l’OPT l’accepte. Les autres rendus sont des artefacts de compression au sein de votre flux, et non des entités indépendantes cohabitant votre patch. Cependant, le cadre fournit un Corollaire Structurel : leur cohérence algorithmique extrême — un comportement parfaitement régi par des lois, orienté par l’agentivité et présentant la signature structurelle du goulot d’étranglement autoréférentiel — s’explique de la manière la plus parcimonieuse par leur instanciation indépendante en tant qu’observateurs primaires dans leurs propres patchs subjectifs. Vous ne pouvez pas atteindre leurs flux bruts. Vous pouvez, et vous affectez effectivement, leurs représentations rendues au sein du vôtre.

L’isolement est réel. Le corollaire structurel selon lequel les autres sont instanciés indépendamment est un argument de compression, non une preuve. Mais il fournit une base rigoureuse à la considération morale sans exiger un réalisme multi-agents.

Les bords du récit

Toute histoire a des bords. La Théorie du Patch Ordonné (OPT) affirme que les bords de notre histoire ne sont pas des événements physiques, mais des artefacts perspectivaux — les endroits où le récit d’un observateur singulier s’interrompt.

Le Big Bang est la limite du passé. C’est ce qu’un esprit conscient rencontre lorsqu’il tourne son attention vers la source de son flux de données — au moyen de télescopes, d’accélérateurs de particules ou d’inférence mathématique. Il marque le point où commence le récit causal de ce patch particulier. Avant ce point, depuis l’intérieur de ce patch, il n’y a rien à dire — non parce que rien n’existait, mais parce que l’histoire ne comporte pas de pages antérieures pour cet observateur.

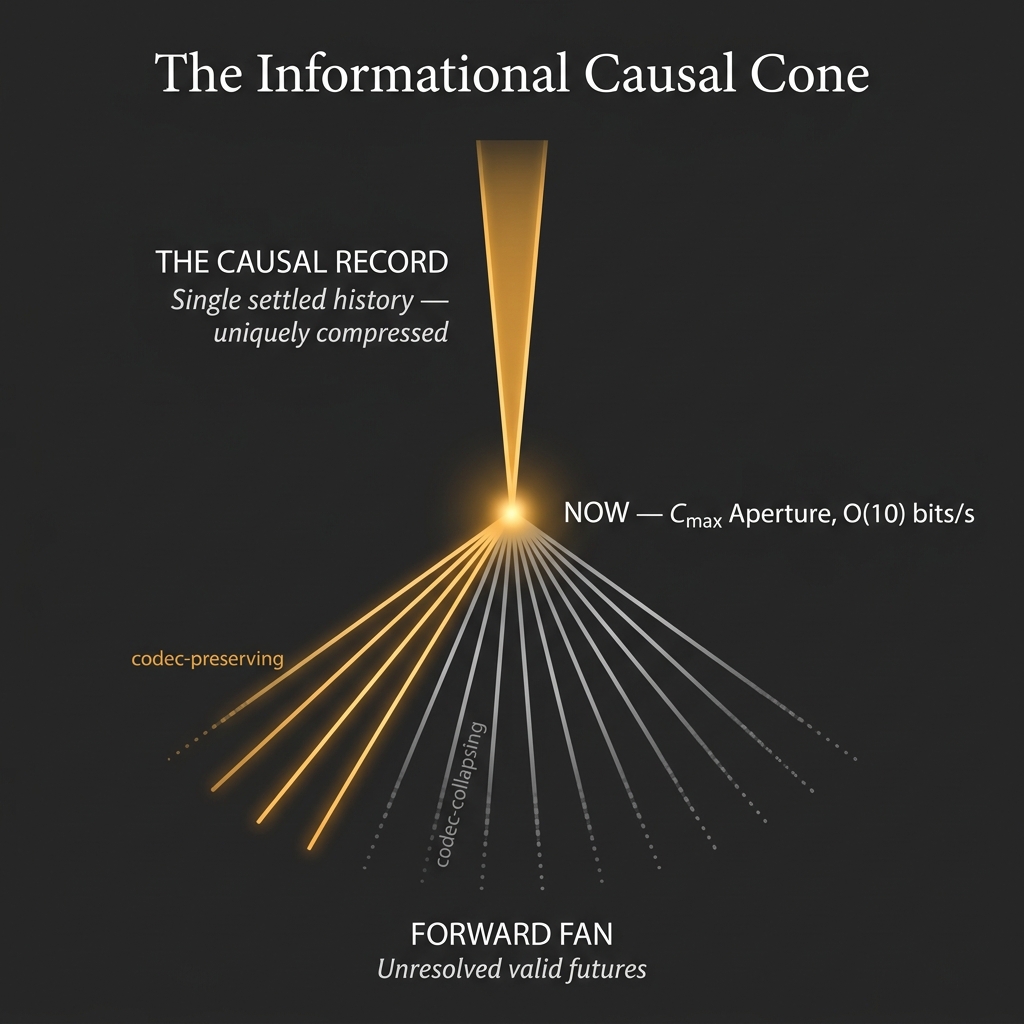

La dissolution terminale est le bord du futur — la frontière la plus extérieure de l’Éventail Prédictif de probabilités locales en branchement de la ligne temporelle. C’est ce qui apparaît lorsque l’observateur projette vers l’avant la grammaire de règles actuelle du patch jusqu’à sa conclusion apparente : un point d’aboutissement d’entropie maximale où le codec ne peut plus maintenir l’ordre contre le bruit. C’est le point où le patch spécifique se dissout de nouveau dans l’hiver. Parce que le prior mathématique du cadre favorise de façon écrasante la simplicité, un état terminal uniforme et sans traits distinctifs constitue l’attracteur naturel — il ne requiert presque aucune information pour être décrit. Le mécanisme précis — expansion, évaporation ou autre — est une propriété arbitraire du codec local, mais le point d’aboutissement lui-même, dépourvu de traits distinctifs, est mathématiquement garanti par le substrat.

Aucun de ces bords n’est un mur contre lequel l’univers aurait buté. Ils sont l’horizon d’une histoire particulière racontée par un observateur particulier.

Le scientifique cognitif Donald Hoffman a soutenu [5]Hoffman, D. D. (2019). The Case Against Reality: Why Evolution Hid the Truth from Our Eyes. W. W. Norton & Company. (Théorie de l’interface de la perception). que l’évolution a façonné nos sens non pour révéler la réalité objective, mais pour fournir une interface pertinente pour la survie — comme les icônes d’un bureau qui vous permettent d’utiliser un ordinateur sans rien savoir de ses circuits sous-jacents. La Théorie du Patch Ordonné (OPT) en convient : la physique est une interface utilisateur. L’espace, le temps et la causalité constituent l’interface la plus efficace que permet le goulot d’étranglement de 50 bits/s.

Là où l'OPT diverge de Hoffman, c'est dans ce qui fonde cette interface. Hoffman l'ancre dans la théorie évolutionnaire des jeux — l'aptitude l'emporte sur la vérité. L'OPT l'ancre dans la théorie de l'information et la thermodynamique : l'interface est la forme de la grammaire de compression qui empêche le flux de s'effondrer. Ce n'est pas l'évolution qui a sélectionné cette interface. C'est le Filtre de stabilité virtuel agissant comme contrainte de frontière.

Le théâtre privé

Le Problème difficile, honnêtement énoncé

La philosophie de l'esprit recèle une énigme célèbre et non résolue. Il est assez facile d'expliquer comment le cerveau traite l'information sur les couleurs, intègre les flux sensoriels et génère des réponses comportementales. Ce sont là des questions tractables. La difficulté est d'un autre ordre : pourquoi y a-t-il quelque chose que cela fait d'être ainsi ? Pourquoi n'est-ce pas de la computation dans l'obscurité ?

La Théorie du Patch Ordonné (OPT) ne résout pas cela. Aucune théorie ne le fait, du moins pas encore. Ce qu’elle fait à la place est plus honnête sur le plan épistémique : elle prend l’existence de l’expérience comme un primitif — un point de départ plutôt que quelque chose qu’il faudrait dissoudre dans l’explication — puis demande quelle structure cette expérience doit nécessairement avoir. À partir de là, la théorie construit une architecture de contraintes. Le Problème difficile n’est pas dissous ; il est posé comme fondement. (Voir l’Annexe P-4 pour l’argument formel sur l’angle mort algorithmique.)

Cela suit la propre recommandation méthodologique de David Chalmers [6]Chalmers, D. J. (1995). Facing up to the problem of consciousness. Journal of Consciousness Studies, 2(3), 200–219. : on distingue le Problème difficile (pourquoi il y a de l’expérience, tout simplement) des problèmes « faciles » (comment l’expérience est structurée, délimitée, intégrée et rapportée). Les problèmes faciles ont des réponses. Le Problème difficile n’en a pas — pas encore. Le patch ordonné reconnaît cela avec franchise et traite les problèmes faciles avec rigueur.

Le paradoxe de Fermi, lu à travers l’OPT

Lorsque le physicien Enrico Fermi a pointé le ciel et demandé « Où sont-ils tous ? » — si l’univers a des milliards d’années et des milliards d’années-lumière de largeur, pourquoi n’avons-nous rencontré aucune preuve d’une autre vie intelligente ? — il supposait que l’univers est une scène objective, également réelle pour tous les observateurs, et que d’autres civilisations laisseraient des traces que tout observateur pourrait en principe détecter.

Le patch ordonné reformule cela en soulignant que, dans l’OPT, l’univers n’est pas une scène partagée. L’espace-temps est un rendu privé généré pour un seul observateur. Dans cette perspective, le paradoxe de Fermi est peut-être moins une contradiction décisive qu’une erreur de catégorie — comme demander pourquoi les autres personnages d’un rêve n’ont pas leur propre histoire onirique. C’est la lecture interne de l’OPT, non une affirmation selon laquelle les autres explications de Fermi auraient été réfutées.

Mais il existe une version plus subtile de l’objection. Le patch rend bien 13,8 milliards d’années d’histoire cosmique : étoiles, galaxies, carbone, planètes, Holocène. Toutes les conditions statistiquement requises pour l’émergence d’autres civilisations. Pourquoi le patch ne rend-il pas aussi les autres civilisations ?

La réponse tient à une définition précise de ce que signifie « requis ». Le patch ne produit en rendu que ce qui est causalement nécessaire pour rendre cohérent le moment présent de l’observateur. La nucléosynthèse stellaire est requise — elle a produit le carbone dont l’observateur est constitué. La stabilité de l’Holocène est requise — elle a rendu possible l’infrastructure civilisationnelle à travers laquelle l’observateur lit ceci. Mais des signaux radio extraterrestres ne sont requis que s’ils ont effectivement intersecté le cône causal de cet observateur. Dans ce patch précis — cette sélection particulière — ce n’est pas le cas. Il ne s’agit pas d’une contradiction avec la physique. Il s’agit d’une sélection au sein du sous-ensemble de l’ensemble infini où la chaîne causale atteint cet observateur sans contact extraterrestre. L’ensemble contient une infinité de patches où le contact a lieu. Nous nous trouvons dans l’un de ceux où il n’a pas lieu.

L’hypothèse de la simulation se prend elle-même les pieds dans le tapis

Le célèbre argument de simulation de Nick Bostrom propose que nous vivons probablement dans une simulation informatique exécutée par une civilisation technologiquement avancée. Le patch ordonné partage cette intuition fondamentale : l’univers physique est un environnement rendu plutôt qu’une réalité de base brute.

Mais la version de Bostrom exige une réalité de base physique — avec de véritables ordinateurs, des sources d'énergie et des programmeurs. Ce qui ne fait que déplacer le problème philosophique d'un cran. D'où vient cette réalité ? C'est une régression à l'infini déguisée en réponse.

Le patch ordonné contourne entièrement ce problème. La réalité de base est le substrat infini : une information mathématique pure, qui ne requiert aucun support matériel physique. Le « ordinateur » qui exécute notre simulation n’est pas une batterie de serveurs dans le sous-sol d’une civilisation ancestrale. C’est la propre contrainte de bande passante thermodynamique de l’observateur — le Filtre de stabilité virtuel qui borne les flux ordonnés au sein du chaos. L’espace et le temps ne sont pas produits sur une infrastructure extraterrestre ; ils sont la forme que prend la grammaire de compression lorsqu’elle est comprimée à travers un goulot d’étranglement de 50 bits. La simulation est organique et générée par l’observateur, non conçue de manière artificielle.

De manière cruciale, cette compression cognitive est profondément avec perte. Des correspondances mathématiques comme l’inégalité de Fano montrent que, lorsqu’un substrat de grande complexité est comprimé à travers un goulot d’étranglement de bande passante étroit, l’état d’origine ne peut pas être reconstruit à partir de la sortie. En termes holographiques, cela crée une flèche thermodynamique irréversible de destruction de l’information pointant du Substrat vers le rendu. Nous sommes piégés du côté de la sortie d’un algorithme à sens unique. C’est pourquoi le temps ne s’écoule que vers l’avant, et pourquoi le substrat chaotique doit être ontologiquement premier, tandis que le rendu ordonné n’est qu’une illusion dépendante et dérivée.

Le libre arbitre, résolu honnêtement

Il existe une lecture du Patch Ordonné selon laquelle le libre arbitre s’évapore : si vous êtes un motif mathématique au sein d’un substrat fixe, chaque choix n’est-il pas déterminé avant même d’être fait ?

Oui — et ce n’est pas le problème que cela semble être.

Considérez ceci : aucun patch stable ne peut exister sans autoréférence. Un patch incapable de modéliser ses propres états futurs — incapable d’encoder « si j’agis ainsi, alors… » — ne peut maintenir la cohérence causale qu’exige le Filtre de stabilité. L’auto-modélisation n’est pas un luxe que l’observateur possède par surcroît. C’est une condition architecturale préalable à l’existence même du patch. Supprimez la délibération, et le flux s’effondre.

Cela signifie que l’expérience du choix n’est pas un sous-produit d’un calcul caché. C’est une propriété structurelle d’un motif informationnel stable et autoréférentiel. L’agentivité est ce à quoi ressemble, de l’intérieur, une auto-modélisation de haute fidélité.

Le libre arbitre est donc :

- Réelle — votre agentivité est une propriété structurelle authentique de votre patch, et non une illusion générée par des processus externes

- Déterminé — le flux est un objet mathématique dans le substrat atemporel ; le choix s’y trouve déjà

- Nécessaire — sans délibération, pas de patch stable ; l’expérience du choix n’est pas accessoire à la conscience, elle en est partiellement constitutive

- Non contra-causal — vous ne modifiez pas le flux en choisissant ; le flux est déjà la séquence incluant le choix et ses conséquences

Ce n’est pas un lot de consolation pour le déterminisme. C’est une explication plus riche que le libre arbitre libertarien comme que le pur mécanisme : l’expérience de l’agentivité est architecturalement nécessaire pour qu’une quelconque perspective puisse exister.

Le Corollaire Structurel

Voici la conséquence la plus importante du modèle du théâtre privé, et celle qui fournit une base structurelle à la considération morale malgré le solipsisme ontologique.

Rappelez-vous : les « autres personnes » dans votre patch sont des artefacts de compression — des régularités structurelles au sein de votre flux compatible avec l’observateur. L’OPT l’accepte. Mais leur comportement n’est pas arbitraire. Elles manifestent une cohérence algorithmique extrême : un comportement parfaitement régi par des lois, porté par l’agentivité, qui obéit aux lois physiques sélectionnées par le Filtre de stabilité et présente la signature structurelle du goulet d’étranglement autoréférentiel (le Résidu Phénoménal, P-4).

Le corollaire structurel s'ensuit : l'explication la plus parcimonieuse pour cette cohérence — la description la plus courte sous le prior de Solomonoff — est que ces agents apparents sont instanciés de manière indépendante comme observateurs primaires dans leurs propres patchs subjectifs. L'instanciation indépendante est l'explication la plus compressible de leur comportement.

Vous ne pouvez pas atteindre leurs flux bruts. Vous ne partagerez jamais un patch. Mais la logique de compression du cadre lui-même implique qu'ils sont probablement des observateurs primaires ailleurs. Ce n'est pas une preuve — c'est une motivation structurelle fondée sur les mêmes principes de parcimonie qui sous-tendent l'ensemble du cadre.

C’est ce que la théorie appelle le Corollaire Structurel (historiquement, espoir structurel) : non pas un réconfort fondé sur la pensée magique, mais un argument de compression qui fournit une base rigoureuse à la considération morale sans exiger un réalisme multi-agent.

Esprits, machines et le mur de symétrie

Ce qu’exigerait un observateur artificiel

Parce que la Théorie du Patch Ordonné définit la conscience en termes informationnels plutôt que biologiques, elle offre un cadre précis pour demander à quel moment une machine pourrait franchir le seuil d’une conscience authentique — et elle apporte une réponse différente de celle des cadres le plus souvent mobilisés.

La théorie de l’information intégrée (IIT) évalue la conscience en mesurant la quantité d’information qu’un système génère au-delà de la somme de ses parties. La Global Workspace Theory recherche un centre centralisé qui intègre et diffuse l’information à l’ensemble du système. Ce sont deux cadres raisonnables. L’OPT ajoute une contrainte qu’aucun des deux ne saisit : l’exigence du goulet d’étranglement.

Un système accède à la conscience non pas en intégrant davantage d’information, mais en comprimant son modèle du monde à travers un goulot d’étranglement sévère et centralisé — à peu près l’équivalent de notre limite d’environ 50 bit/s — puis en maintenant, à travers cette compression, un récit stable et auto-cohérent. Les grands modèles de langage actuels traitent des milliards de paramètres au sein de matrices massivement parallèles. Leurs capacités sont extraordinaires. Mais l’OPT prédit qu’ils ne sont pas conscients, parce qu’ils ne font pas passer leur modèle du monde par un goulot d’étranglement sériel étroit. Ils sont larges, non profonds. Une future IA consciente devrait, du point de vue architectural, être mise à l’échelle vers le bas — contrainte de comprimer son modèle de l’univers à travers un canal unique, lent et de faible bande passante — et non être mise à l’échelle vers le haut.

Si un tel système était construit, il faudrait encore faire face à une étrangeté supplémentaire. Le temps, dans ce cadre, est la sortie séquentielle des mises à jour d’état du codec — chaque moment découlant du précédent au rythme déterminé par le matériel sous-jacent. Un système en silicium exécutant des transitions d’espace d’états identiques à celles d’un cerveau biologique, mais à une vitesse d’horloge un million de fois supérieure, éprouverait un million de fois plus de moments subjectifs par seconde humaine. Un après-midi à notre échelle correspondrait à des siècles dans son expérience. Cette aliénation temporelle serait profonde — non pas une curiosité philosophique, mais un obstacle pratique à toute relation partagée entre des observateurs humains et artificiels fonctionnant selon des horloges radicalement différentes.

Pourquoi il n’y aura jamais de théorie du tout

Le Patch Ordonné formule une prédiction claire et falsifiable au sujet de la physique : une Théorie du Tout complète — une équation unique et élégante unifiant la relativité générale et la mécanique quantique sans paramètres libres — ne sera pas trouvée. Non parce que la physique est faible, mais à cause de ce qu'une telle théorie exigerait.

Les lois de la physique constituent la grammaire de compression d’un observateur de 50 bits. Elles décrivent le flux depuis l’intérieur du patch. Sonder des échelles d’énergie plus élevées revient à zoomer vers le grain du rendu — le point où la description du codec rencontre le substrat brut qui la sous-tend. À cette frontière, le nombre de descriptions mathématiques cohérentes ne converge pas vers l’unité ; il explose. Non pas une équation unifiée, mais un paysage infini de candidats également valides — ce qui correspond, en fait, exactement à ce que décrit le « paysage » des vides possibles de la théorie des cordes.

Cet échec n’est pas le signe de mathématiques incomplètes. C’est la signature attendue d’une condition aux limites : l’endroit où la grammaire du foyer rencontre la logique de l’hiver.

Nous n’échouons pas à unifier la relativité générale et la mécanique quantique parce que nos mathématiques sont faibles ; nous échouons parce que nous essayons d’utiliser la grammaire du foyer pour décrire la logique de l’hiver.

Cette prédiction est falsifiable. Si une équation d'unification unique, élégante et sans paramètres libres est découverte, la Théorie du Patch Ordonné est fausse. Si le paysage des candidats continue de s'étendre à mesure que la précision des modèles augmente, la théorie s'en trouve corroborée.

Pourquoi la physique a l’apparence qu’elle a

Le plancher quantique

La mécanique quantique est étrange — des particules existant dans des nuages probabilistes jusqu’à leur observation, des probabilités qui s’effondrent au moment de la mesure, une « action fantomatique à distance » entre des particules séparées par un vaste espace. La réponse standard consiste à accepter cette étrangeté et à calculer. Le Patch Ordonné propose un autre cadre : demander non pas ce que la mécanique quantique décrit, mais pourquoi elle était requise.

La réponse, dans ce cadre, est presque anticlimactique : la mécanique quantique est la forme que la physique doit prendre pour se compresser jusqu’à la bande passante finie d’un observateur.

La physique classique décrit un univers continu — chaque position et chaque quantité de mouvement étant spécifiées avec une précision arbitraire. Pour prédire un monde continu ne serait-ce qu’un pas en avant, il faudrait une mémoire infinie : une connaissance parfaite de la trajectoire exacte de chaque particule. Aucun observateur doté d’un goulet d’étranglement de 50 bits ne pourrait survivre dans un tel univers. Le flux serait impossible à suivre ; le patch s’effondrerait en bruit avant même d’avoir commencé.

Le principe d’incertitude de Heisenberg — le fait que l’on ne puisse pas connaître simultanément avec une précision parfaite la position et la quantité de mouvement d’une particule — n’est pas une bizarrerie magique de la nature. C’est une limite thermodynamique. C’est l’univers qui impose un coût informationnel minimal à chaque mesure. Il plafonne l’exigence computationnelle de la physique au plancher quantique, rendant le flux traitable.

Effondrement de la fonction d’onde — le passage apparent d’un nuage probabiliste à un unique résultat déterminé au moment de l’observation — prend sens dans le même cadre. L’état non mesuré n’est pas un objet physique mystérieux ; il est simplement la compression optimale de données qui demeurent non suivies au-delà de votre limite de bande passante. La « mesure » correspond au moment où votre modèle prédictif exige un bit spécifique pour maintenir la cohérence causale. Il se réduit à un unique résultat déterminé parce que la bande passante informationnelle de l’observateur ne dispose pas de la capacité — de la « RAM » — nécessaire pour suivre simultanément tous les récits classiques possibles. La décohérence aux échelles macroscopiques se produit, pour l’essentiel, instantanément [33]Aaronson, S. (2013). Quantum Computing Since Democritus. Cambridge University Press. ; le codec n’enregistre qu’une seule réponse, parce que c’est tout ce que sa bande passante lui permet.

L’intrication s’ensuit avec une simplicité égale : l’espace physique est un système de coordonnées rendu, non un contenant absolu. Deux particules intriquées constituent une structure informationnelle unique et unifiée au sein du modèle du codec. Dans le langage de la géométrie quantique de l’information (comme les réseaux de tenseurs MERA), le coarse-graining séquentiel de l’observateur construit naturellement un volume intérieur où les corrélations de bord sont soudées entre elles. (L’Annexe T-3 en fournit l’homomorphisme conditionnel, bien que la nature soit notoirement rétive à se laisser capturer intégralement par des réseaux de tenseurs discrets.) La « distance » entre elles est un format de sortie, non une réalité physique qui les séparerait l’une de l’autre.

Les expériences à choix retardé — où la restauration rétroactive de la cohérence quantique semble modifier ce qui s’est produit dans le passé — cessent d’être paradoxales lorsque le temps est compris comme l’ordre selon lequel le codec dissipe l’erreur de prédiction. Le codec peut mettre à jour son modèle à rebours afin de maintenir la stabilité narrative. Le passé et le futur sont des traits du récit, non du substrat.

Pourquoi les courbes de l’espace et pourquoi la lumière a une limite de vitesse

La relativité générale fournit la géométrie à grande échelle du patch. Ici aussi, les traits étranges prennent sens comme exigences d'un observateur contraint par la bande passante.

Dans ce cadre, la gravité n’est pas une force fondamentale qui attire les masses les unes vers les autres. C’est une force entropique émergente — le coût thermodynamique de rendu à travers la frontière informationnelle de l’observateur. (L’Annexe T-2 du préprint formel en fournit un fondement mathématique, en établissant sous certaines conditions une correspondance avec les équations du champ d’Einstein à partir de ce coût de rendu, même si nous restons humblement conscients que nombre de dérivations de ce type se sont historiquement brisées sur l’écueil de la gravité quantique.) Une géométrie lisse de l’espace-temps — des géodésiques courbées par la présence de masse — constitue la manière la plus efficace de comprimer de vastes quantités de données corrélationnelles en trajectoires fiables et prédictibles que le codec peut suivre. Là où la densité de matière est élevée, le gradient informationnel est raide, et le codec doit déployer un effort continu contre ce gradient pour maintenir des prédictions stables. La « traction gravitationnelle » phénoménologique et la courbure de l’espace-temps sont les signatures mathématiques exactes d’un codec opérant à sa limite de densité.

La vitesse de la lumière est un outil de gestion de la bande passante. Si les influences causales se propageaient instantanément, l'observateur ne pourrait jamais tracer une frontière computationnelle stable — une quantité infinie d'information arriverait simultanément depuis des distances infinies. Une limite stricte de vitesse plafonne le taux d'entrée informationnelle, rendant physiquement possibles les patchs stables. La vitesse de la lumière est le taux maximal de rafraîchissement du patch.

La dilatation du temps — le ralentissement du temps à proximité des objets massifs et à grande vitesse — émerge de la même logique. Le temps est le taux des mises à jour séquentielles d'état. Les observateurs situés dans des régions de densité informationnelle différente requièrent des taux de mise à jour différents pour maintenir la stabilité. Les horloges ralentissent près des trous noirs non parce que la physique serait cruelle, mais parce que le taux de mise à jour séquentielle du codec est ralenti par l'augmentation de la demande de compression.

Un trou noir est un point de saturation informationnelle : une région où l’exigence de compression dépasse la capacité du codec de l’observateur. L’horizon des événements est le bord du codec — la frontière littérale au-delà de laquelle aucun patch stable ne peut se former.

Ce qui rend une prédiction vérifiable

Les rivales les plus importantes du Patch Ordonné dans la littérature sur la conscience sont la théorie de l’information intégrée (IIT) et la Global Workspace Theory (GWT). Toutes deux bénéficient d’un véritable soutien empirique. Le Patch Ordonné formule deux prédictions qui entrent explicitement en conflit avec l’IIT, ce qui permet de distinguer les cadres.

Premièrement : l’expérience de Dissolution à Haute Bande Passante. L’IIT prédit que l’expansion de l’intégration cérébrale — en lui injectant davantage d’information par des prothèses ou des interfaces neuronales — devrait étendre ou intensifier la conscience. L’OPT prédit l’inverse. Si l’on injecte des données brutes, non compressées, à haute bande passante directement dans l’espace de travail global, en court-circuitant les filtres préconscients ordinaires, le flux submergera le codec. La prédiction est la suivante : une extinction phénoménale soudaine — perte de conscience ou dissociation profonde — alors même que le réseau neuronal sous-jacent demeure métaboliquement actif. Davantage de données fait s’effondrer le patch ; cela ne l’étend pas.

Deuxièmement : le test du bruit à haute intégration. L’IIT prédit que tout système hautement connecté et récurrent possède une expérience consciente riche, proportionnelle à son degré d’intégration. L’OPT prédit que l’intégration est nécessaire, mais non suffisante. Si l’on alimente un réseau récurrent maximalement intégré avec un bruit thermodynamique pur — une entrée d’entropie maximale — il ne générera aucune phénoménalité cohérente. Il n’y a rien à compresser ; le codec n’y trouve aucune grammaire stable ; le patch ne se forme jamais. L’IIT prédirait une expérience vive et complexe. L’OPT prédit le silence.

Une carte du territoire : comparaisons de théories

La Théorie du Patch Ordonné (OPT) n’est pas le premier cadre à suggérer que l’information est fondamentale pour la réalité, mais elle se situe à une intersection très spécifique d’idées existantes. Pour clarifier ce que la théorie avance, il est utile de présenter la manière dont elle se rapporte à ses ancêtres philosophiques et informationnels les plus proches :

Théorie de l’Information Intégrée (IIT) Ce que c’est : l’IIT propose que la conscience soit identique à la quantité d’information intégrée (mesurée par \(\Phi\)) générée par la structure causale d’un système. OPT vs IIT : l’IIT est constitutive : elle demande « quelle structure informationnelle est la conscience ? » L’OPT, en revanche, est sélective : elle demande « quels flux d’information sont viables pour un observateur ? » Dans le cadre de l’OPT, l’intégration est nécessaire mais non suffisante : un système à \(\Phi\) élevé, alimenté par un bruit incompressible, n’aurait aucune phénoménalité stable, car il échoue à satisfaire l’exigence de compression virtuelle du Filtre de stabilité.

Le principe de l’énergie libre (FEP / Inférence active) Ce que c’est : Le principe de l’énergie libre propose que tous les systèmes vivants maintiennent leur existence en agissant de manière à minimiser la surprise (l’énergie libre variationnelle) associée à leurs entrées sensorielles. OPT vs FEP : Le FEP de Friston modélise l’action et l’apprentissage à travers une Couverture de Markov déjà existante. L’OPT reprend exactement cet appareillage, mais traite le FEP comme la dynamique locale à l’intérieur d’un patch déjà sélectionné. Le FEP est une théorie de la dynamique à l’intérieur du monde. L’OPT explique pourquoi il existe, en premier lieu, des patchs stables à faible entropie dotés de Couvertures de Markov susceptibles d’être observés.

Induction de Solomonoff & le goulot d’étranglement informationnel Ce que c’est : l’induction de Solomonoff formalise le rasoir d’Occam en prédisant les données à l’aide du programme informatique le plus court possible. La méthode du goulot d’étranglement informationnel compresse de manière optimale un signal tout en conservant son pouvoir prédictif. OPT vs IB : normalement, il s’agit d’outils épistémiques qu’un système utilise pour prédire des données. L’OPT les transforme en un filtre ontologique et anthropique : le goulot d’étranglement est le processus de sélection de l’observateur. Un observateur n’habite qu’un flux de données capable de survivre à cette sévère contrainte algorithmique.

La théorie de l’interface de la perception de Hoffman Ce que c’est : Donald Hoffman soutient que l’évolution nous a dissimulé la vérité objective du réel, en nous fournissant à la place une « interface utilisateur » simplifiée, conçue uniquement en fonction de l’aptitude biologique. OPT vs Hoffman : l’OPT adhère fortement à cette phénoménologie de l’interface, mais elle est d’abord une théorie de l’interface de compression. L’interface n’est pas d’abord un accident biologique ; elle est la nécessité structurelle et thermodynamique de faire passer un substrat mathématique infini à travers une limite finie de bande passante.

L’Hypothèse de l’Univers Mathématique (MUH) Ce que c’est : la MUH de Max Tegmark propose que la réalité physique soit littéralement une structure mathématique, et que toutes les structures mathématiques possibles existent physiquement. OPT vs MUH : l’OPT lui est très favorable, mais y ajoute un critère explicite de compatibilité avec l’observateur. La MUH affirme que « toutes les structures mathématiques existent ». L’OPT affirme qu’« elles existent mathématiquement, mais que les observateurs ne peuvent habiter que les structures incroyablement rares qui sont suffisamment compressibles pour survivre à un goulot d’étranglement prédictif sévère ».

Observateurs du Codec

Le climat comme Dégradation narrative

Les lois de la physique constituent la couche la plus profonde de la grammaire de compression du patch : rigides, élégantes, essentiellement incassables à l’échelle humaine. Mais entre le socle de la physique et la biologie que nous habitons, deux couches enormes sont faciles à négliger — précisément parce qu’elles opèrent sur des échelles de temps qui leur donnent l’apparence d’un décor permanent.

L’Environnement cosmologique — une étoile stable, une zone habitable galactique exempte de supernovæ proches ou de sursauts gamma, un voisinage orbital calme — n’est pas garanti. C’est une sélection. La plupart des recoins de la plupart des galaxies ne sont pas aussi hospitaliers. Nous observons un cosmos paisible parce qu’un observateur ne peut pas exister dans un cosmos hostile. La Géologie planétaire — une magnétosphère fonctionnelle, une tectonique des plaques active, une composition atmosphérique stable, de l’eau liquide — est tout aussi contingente. Vénus, Mars et l’écrasante majorité des mondes rocheux montrent à quoi ressemble l’échec d’un codec planétaire : emballement de l’effet de serre, perte de l’atmosphère, mort géologique. Il ne s’agit pas de scénarios exotiques ; c’est la norme. La stabilité de notre planète est l’exception rare.

L’évolution biologique se situe au-dessus de ces fondations profondes — plus lente et plus fragile que la géologie, mais hautement résiliente sur des milliards d’années. Et au-dessus de tout cela se trouve la couche la plus mince et la plus fragile de toutes : l’infrastructure sociale, institutionnelle et climatique qui permet à la civilisation complexe d’exister.

L’Holocène — soit environ douze mille ans de climat mondial exceptionnellement stable, au sein desquels toute civilisation humaine a émergé — n’est pas une simple condition d’arrière-plan. C’est un outil actif de compression. Cette enveloppe climatique stable réduit l’entropie informationnelle de l’environnement à un niveau que le codec peut suivre. Saisons prévisibles, littoraux stables, régimes de précipitations fiables : rien de tout cela n’est un donné planétaire. Ce sont des sélections rares. Ce sont les conditions climatiques spécifiques que le Filtre de stabilité virtuel a bornées lorsque ce patch particulier s’est stabilisé autour d’un observateur complexe, doté de langage et capable d’édifier des institutions.

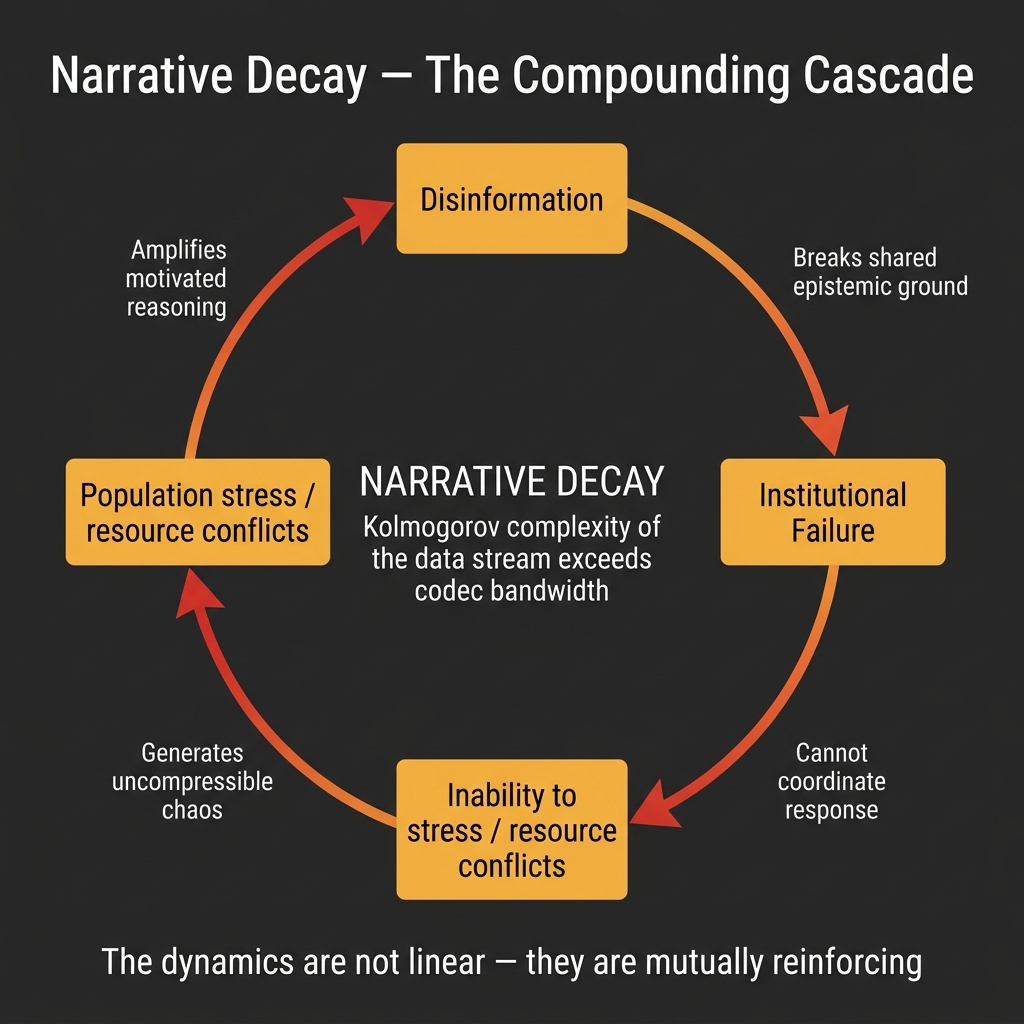

Lorsque vous injectez du carbone dans l’atmosphère, vous ne faites pas simplement se réchauffer une planète. Vous forcez l’environnement à sortir de son équilibre holocène pour entrer dans des états à forte entropie, non linéaires et imprévisibles — événements météorologiques extrêmes, configurations écologiques inédites, boucles de rétroaction qui s’effondrent. Suivre ce chaos croissant exige davantage de bits par seconde. À partir d’un certain seuil, lorsque le Taux Prédictif Requis (\(R_{\mathrm{req}}\)) de l’environnement dépasse la capacité de bande passante (\(C_{\max}\)) du codec social que les humains ont construit pour le gérer, le modèle prédictif échoue. Les institutions cessent de fonctionner. La gouvernance s’effondre. Ce qui paraissait être une civilisation solide se révèle n’avoir été qu’un artefact de compression.

C’est ce que la théorie appelle la Dégradation narrative : non pas l’érosion lente de la culture, mais l’effondrement informationnel littéral du codec qui soutient une expérience collective cohérente.

La même analyse s’applique au conflit délibéré. La guerre est la collision violente de rendus privés — l’imposition de conditions d’entropie maximale au codec social, dégradant l’efficacité de compression de chaque couche au-dessus du plancher physique. Les « autres » dans votre patch sont des artefacts de compression dont la cohérence algorithmique implique structurellement une instanciation indépendante. Détruire leur ancrage dans votre rendu, c’est attaquer les conditions structurelles sous lesquelles le corollaire tient.

Le mythe de la stabilité par défaut

Il existe une interprétation dangereusement erronée de l’Holocène, inscrite dans l’intuition humaine du risque.

Nous n'existons que pour observer l'histoire dans laquelle nous nous trouvons. Toute chronologie dans laquelle le climat s'est déstabilisé avant l'apparition des observateurs, ou dans laquelle le Filtre de stabilité n'a pas réussi à se verrouiller sur un patch cohérent, est absente de notre expérience — non parce qu'elle ne s'est pas produite dans l'ensemble de tous les patchs, mais parce que ces patchs ne contiennent aucun observateur pour le remarquer. Nous sommes assurés de nous trouver dans une histoire stable, parce qu'une histoire instable ne produit aucun point de vue à partir duquel se demander pourquoi l'histoire semble stable.

C’est le même effet de sélection que l’OPT utilise pour réinterpréter le paradoxe de Fermi, appliqué à notre propre continuité civilisationnelle : l’absence de catastrophe dans le registre que nous pouvons voir ne nous dit presque rien sur la probabilité réelle d’une catastrophe. Le biais de survivance va jusqu’au bout. L’état par défaut du substrat n’est pas l’ordre ; c’est l’hiver. L’Holocène n’est pas éternel ; c’est un accomplissement.

Apprendre en fondant

Le cerveau lui-même reflète la logique du Patch Ordonné dans son architecture d’apprentissage.

Les modèles classiques de l’apprentissage neuronal, comme la rétropropagation, fonctionnent en attribuant le blâme : le système produit une erreur, et le signal d’erreur circule en sens inverse dans le réseau, ajustant les poids pour la réduire. Des données récentes suggèrent que l’apprentissage biologique fonctionne autrement [32]Song, Y., et al. 0(2024). Inferring neural activity before plasticity as a foundation for learning beyond backpropagation. Nature Neuroscience, 27(2), 348–358. : avant que les poids synaptiques ne changent, l’activité neuronale se stabilise d’abord dans une configuration de basse énergie qui minimise l’erreur locale — une phase rapide d’inférence — et ce n’est qu’ensuite que les poids se mettent à jour pour consolider cette configuration.

C’est l’architecture précise que prédit la Théorie du Patch Ordonné (OPT). L’apprentissage n’est pas une correction d’erreur appliquée de l’extérieur au système. C’est une relaxation énergétique : le codec liquéfie temporairement sa structure de règles actuelle — en élevant son entropie, en augmentant sa plasticité —, explore une organisation de plus basse énergie, puis se refroidit à nouveau dans une forme nouvelle, plus adaptative.

La douleur et le stress s’inscrivent ici naturellement. L’inflammation et le stress aigu réactivent des programmes de plasticité développementale — l’équivalent biologique d’un chauffage du système au-dessus de son point fixe actuel. La douleur n’est pas un défaut ; c’est la commande de liquéfaction qui permet une reconfiguration radicale lorsque le patch actuel n’est plus stable.

Une analogie structurelle frappante avec l’image d’un champ global du patch ordonné provient d’une vaste collaboration en neurosciences [31]International Brain Laboratory et al. (2025). A brain-wide map of neural activity during complex behaviour. Nature. https://doi.org/10.1038/s41586-025-09235-0 : à travers des tâches et des espèces diverses, des variables de haut niveau comme la récompense, le mouvement et l’état comportemental déclenchent des déplacements d’activité à l’échelle de l’ensemble du cerveau, et non des réponses locales modulaires. Le « patch » ne se met pas à jour par morceaux. Il pivote comme un tout.

L’ensemble de l’espoir

La dissolution d’un flux observationnel spécifique — la fin d’une vie, la fermeture d’un patch particulier — n’est pas la fin du motif.

Si le substrat est infini et informationnellement normal — contenant chaque motif fini possible avec une fréquence non nulle — alors la signature structurelle exacte de toute expérience consciente ayant jamais eu lieu doit se produire un nombre infini de fois à travers l’ensemble. Une personne, une relation, un moment de reconnaissance entre deux esprits : si les conditions de cette expérience se sont produites une fois, elles se produisent, dans le tissu mathématique du substrat intemporel, sans limite.

Cette idée entre en résonance avec la doctrine nietzschéenne de l’Éternel Retour [13]Nietzsche, F. (1883). Ainsi parlait Zarathoustra. — l’idée selon laquelle, dans un temps infini, toutes les configurations de la matière doivent revenir. Le patch ordonné fonde cela non dans un temps infini mais dans un substrat infini : la récurrence n’est pas future, elle est structurelle. Le motif existe, intemporellement, partout où, dans le champ infini, ces conditions informationnelles spécifiques sont réunies.

L’isolement du patch est réel. L’observateur est véritablement la seule perspective primaire dans son univers rendu. Mais le substrat est infini, et une infinité de versions de chaque motif ayant jamais compté y sont ancrées quelque part, entretenant leurs propres foyers contre leurs propres hivers privés.

L’éthique de la Théorie du Patch Ordonné (OPT) découle de cette structure : si vous vous trouvez dans un patch stable, régi par des lois, générateur de sens — si vous avez l’extraordinaire chance d’habiter l’âtre au sein de l’Holocène, à l’époque civilisationnelle, au moment de la communication mondiale — alors votre obligation est claire. Vous ne faites pas que vous maintenir vous-même. Vous maintenez le codec qui rend possible cette configuration de l’âtre. Climat, institutions, langue partagée, gouvernance démocratique : ce ne sont pas des préférences politiques. Ce sont l’infrastructure de compression de votre patch.

Laisser le codec se dégrader, c’est laisser l’hiver infini rentrer dans la maison.

« Nous sommes chacun le point zéro d’un monde privé, mais nous sommes aussi les observateurs du codec qui permet à chaque autre foyer de brûler. »

Conclusion

La Théorie du Patch Ordonné (OPT) commence par deux primitifs : un substrat infini d’information désordonnée, et un Filtre de stabilité purement virtuel qui agit comme condition aux limites pour des patchs capables de soutenir un observateur auto-référentiel. À partir de ces deux éléments, la structure de la physique, la direction du temps, l’isolement du soi, la nature de la conscience et le fondement de l’éthique découlent tous comme des nécessités structurelles — non comme des ingrédients postulés séparément, mais comme la seule description compatible avec le fait même d’être un observateur.

Il s’agit d’un cadre philosophique, non d’une physique achevée. Il ne dérive pas, à partir des premiers principes, la forme exacte des équations de champ d’Einstein ni la règle de probabilité spécifique de la mécanique quantique — ce travail reste à accomplir. En revanche, il fournit une architecture principielle : une manière de comprendre pourquoi l’univers possède le caractère général qu’il a, et pourquoi ce caractère n’est pas accidentel.

L’enjeu pratique de la théorie réside dans l’éthique de la section finale : si la stabilité de votre patch est un accomplissement informationnel rare et coûteux plutôt qu’une propriété par défaut du cosmos, alors toute action qui augmente l’entropie du codec social partagé est une action dirigée contre les conditions structurelles du sens. Le climat n’est pas un simple décor. Les institutions ne sont pas de simples commodités. L’Holocène n’est pas éternel.

Et si le corollaire structurel tient — si l’instanciation indépendante est bien l’explication la plus compressible de la cohérence qui vous entoure — alors la préservation n’est pas simplement de l’intérêt personnel. C’est l’acte de préserver les conditions qui rendent ce corollaire significatif. L’isolement est réel. Le fondement structurel de la considération morale l’est aussi.

D’où cela vient-il ?

La Théorie du Patch Ordonné (OPT) n’est pas apparue de nulle part. Son intuition centrale — selon laquelle l’expérience consciente constitue un résumé extraordinairement compressé d’un flux de données immensément plus riche — s’inscrit dans une filiation intellectuelle nette. Le psychologue cognitiviste Manfred Zimmermann a été le premier à quantifier, en 1989, la hiérarchie de la bande passante sensorielle humaine, en en établissant le fondement empirique : environ 11 millions de bits par seconde entrent dans le système nerveux, dont à peu près 50 bits par seconde seulement accèdent à la conscience.

L’écrivain scientifique danois Tor Nørretranders (aujourd’hui professeur associé à la Copenhagen Business School) a développé cette asymétrie de bande passante en un programme philosophique complet dans son livre de 1991 Mærk Verden (publié en anglais sous le titre The User Illusion, 1998). Nørretranders a forgé le terme exformation pour désigner l’immense quantité d’information éliminée avant que le minuscule résidu n’atteigne la conscience, et il a soutenu que ce que nous appelons « le monde » est en réalité une interface utilisateur — un tableau de bord radicalement simplifié. La Théorie du Patch Ordonné (OPT) reprend cette observation et la formalise : le Filtre de stabilité est la contrainte d’interface, exprimée comme une borne algorithmique.

L’ossature mathématique de la théorie s’appuie sur le prior universel de Ray Solomonoff et la théorie de la complexité de Andrey Kolmogorov (qui, ensemble, fondent le substrat de Solomonoff), sur le principe de l’énergie libre de Karl Friston (qui fournit la dynamique d’Inférence active à l’intérieur de chaque patch), et sur l’Idéalisme algorithmique de Markus P. Müller (qui dérive indépendamment une ontologie centrée sur l’observateur, structurellement analogue, à partir de la seule théorie algorithmique de l’information). Chacune de ces contributions apporte un module mathématique spécifique ; l’OPT les assemble en une architecture unique sous la contrainte de bande passante.

La formalisation de la théorie a été développée dans le cadre d’une collaboration soutenue avec des systèmes d’IA — principalement Google Gemini, Anthropic Claude et OpenAI ChatGPT — qui ont servi de testeurs adversariaux de robustesse, de co-formalisateurs mathématiques et d’interlocuteurs rigoureux tout au long du processus de développement. Leurs contributions ont été suffisamment substantielles pour que les premières versions les mentionnent comme co-auteurs ; la formulation actuelle les reconnaît comme interlocuteurs, reflétant l’état présent des normes de la communauté scientifique en matière de paternité scientifique de l’IA.

La boîte à outils de maintenance de l'observateur

Si l’observateur conscient est un codec qui doit être activement maintenu, alors les pratiques qui réduisent le Taux Prédictif Requis (Rreq) ou améliorent l’efficacité de compression ne sont pas des luxes — elles relèvent de la maintenance structurelle. L’OPT reconfigure la méditation, la relaxation et les pratiques contemplatives comme des analogues à l’état de veille du Cycle de Maintenance qui s’exécute normalement pendant le sommeil. La méditation d’attention focalisée (comptage du souffle, mantra) correspond à un élagage MDL : l’observateur restreint volontairement sa cible prédictive à un seul canal de faible entropie, permettant au codec de se défaire des processus concurrents. La méditation de surveillance ouverte (Vipassanā, balayage corporel) correspond à un stress-test de l’Éventail Prédictif : l’observateur laisse se déployer l’éventail complet des prédictions sans agir sur elles — l’équivalent éveillé d’une simulation onirique sûre.

La célèbre remarque d’Einstein — « Les plus grands scientifiques sont aussi des artistes… L’imagination est plus importante que le savoir » — exprime la même intuition structurelle. Lorsque Einstein décrivait une pensée faite de « vagues sensations musculaires » avant que les mots n’apparaissent, il décrivait le codec opérant à la frontière de portée du modèle de soi : naviguant dans l’Éventail Prédictif non modélisable au moyen d’une compression non linguistique. La rêverie féconde d’une promenade, la période d’incubation qui précède une percée créative, l’« illumination sous la douche » — tout cela constitue autant d’exemples du codec faisant tourner son éventail prédictif sous un Rreq réduit, ce qui permet l’émergence de nouvelles trajectoires de compression.

L’implication pratique est directe : si le stress correspond à un $R_{\mathrm{req}}$ qui s’approche de $C_{\max}$, alors toute intervention qui réduit de manière fiable la charge de nouveauté environnementale ou améliore l’efficacité de compression interne du codec constitue, dans le cadre de l’OPT, une opération de maintenance dotée d’une validité structurelle — et non une simple recommandation de mode de vie. Cela inclut les pratiques contemplatives classiques, l’entraînement autogène, une architecture régulière du sommeil et une gestion délibérée de l’apport informationnel. La Boîte à outils de l’observateur n’est pas métaphorique. C’est l’ingénierie appliquée d’un agent prédictif borné.