Théorie du Patch Ordonné (OPT) : un cadre informationnel pour la sélection des observateurs et l’expérience consciente

v3.4.0 — mai 2026

DOI: 10.5281/zenodo.19300777

Copyright: © 2025–2026 Anders Jarevåg.

Licence: Cette œuvre est mise à disposition selon les

termes de la Licence

internationale Creative Commons Attribution - Pas d’Utilisation

Commerciale - Partage dans les Mêmes Conditions 4.0.

Résumé :

Nous présentons la Théorie du Patch Ordonné (OPT), un cadre constructif qui dérive des correspondances structurelles entre la théorie algorithmique de l’information, la sélection des observateurs et la loi physique. L’OPT part de deux primitives : la Semi-mesure universelle de Solomonoff \xi sur les préfixes finis d’observation, et une capacité bornée du canal cognitif C_{\max}. Un Filtre de stabilité purement virtuel — exigeant que le Taux Prédictif Requis de l’observateur R_{\mathrm{req}} n’excède pas C_{\max} — sélectionne les rares flux causalement cohérents compatibles avec des observateurs conscients ; au sein de tels flux, l’Inférence active gouverne la dynamique locale.

Le cadre est ontologiquement solipsiste : la réalité physique consiste en régularités structurelles à l’intérieur du flux compatible avec l’observateur. Cependant, le biais de compression du prior de Solomonoff produit un Corollaire Structurel probabiliste : l’extrême cohérence algorithmique des agents apparents s’explique de la manière la plus parcimonieuse par leur instanciation indépendante en tant qu’observateurs primaires. Le Couplage inter-observateurs, fondé sur la parcimonie de compression, rétablit une communication authentique entre patches et produit une asymétrie de connaissance frappante : les observateurs modélisent autrui plus complètement qu’eux-mêmes.

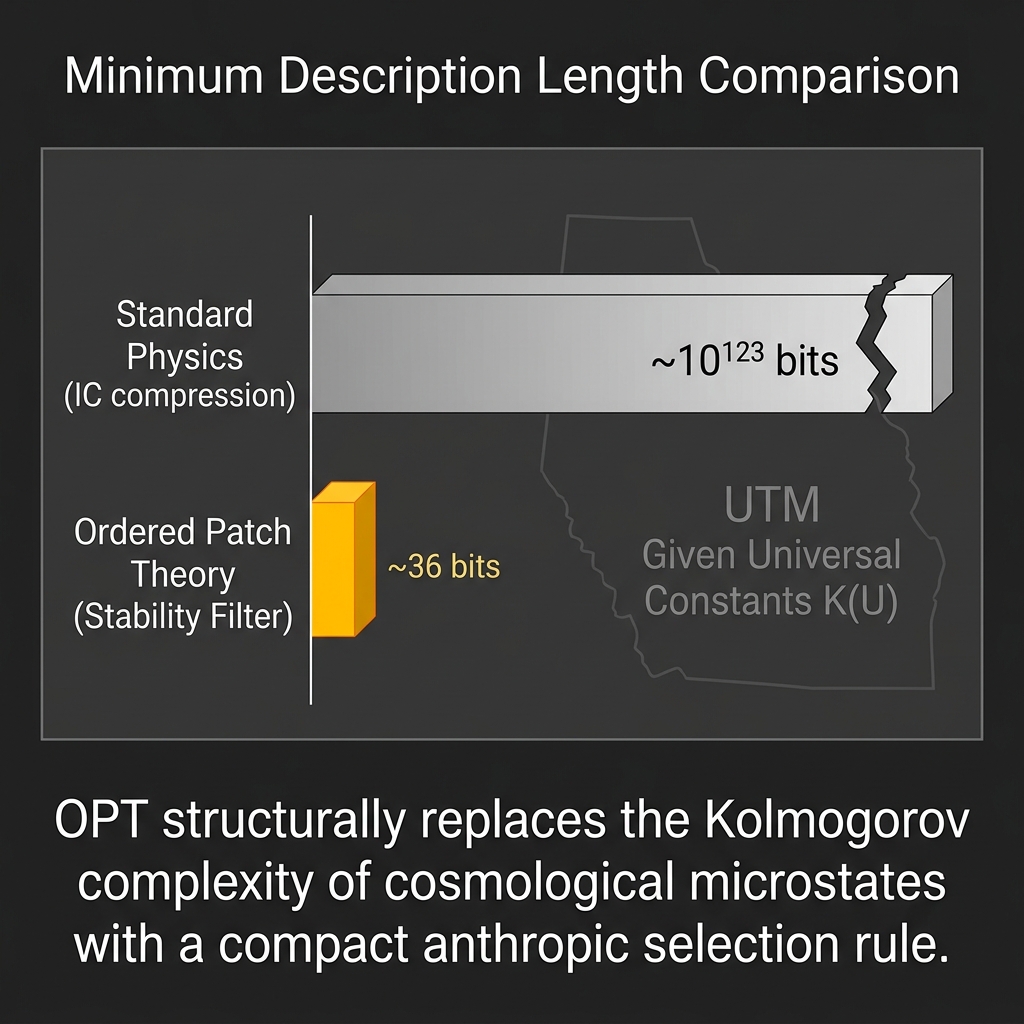

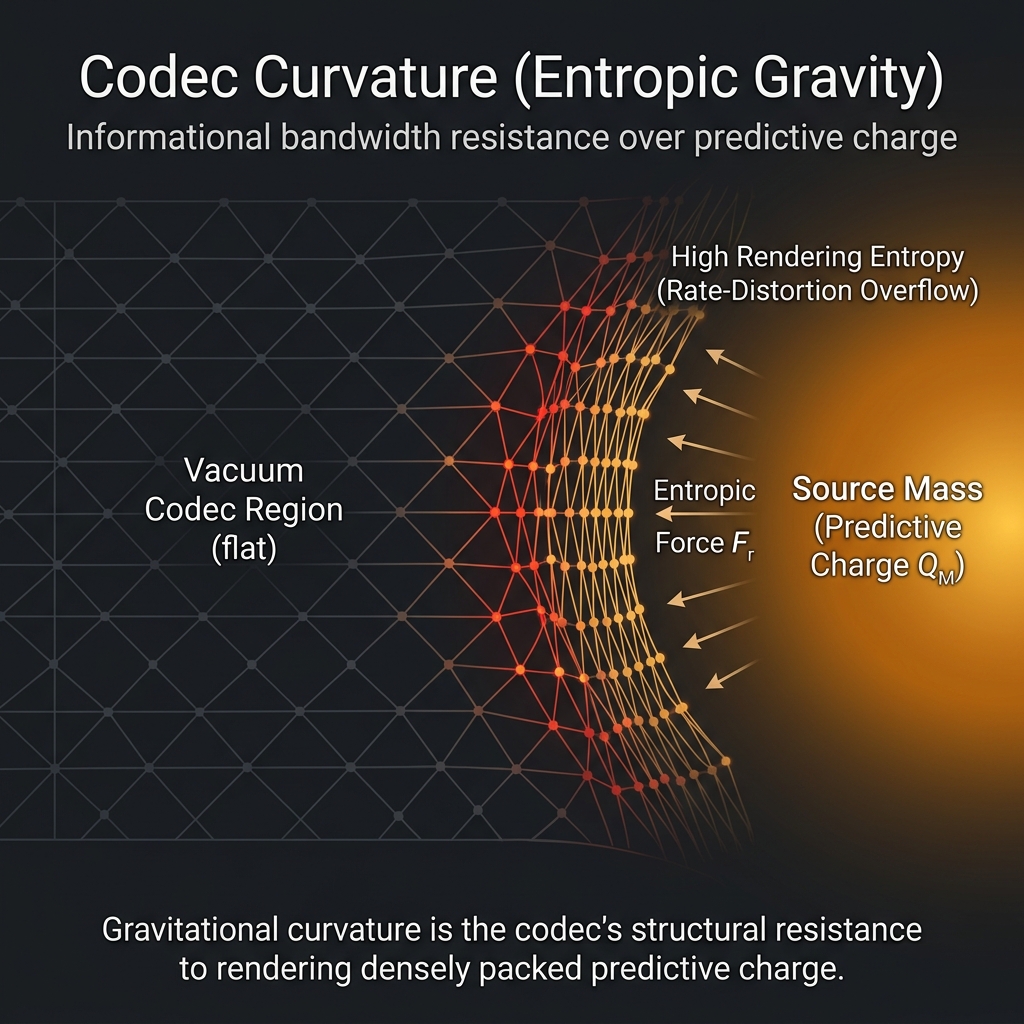

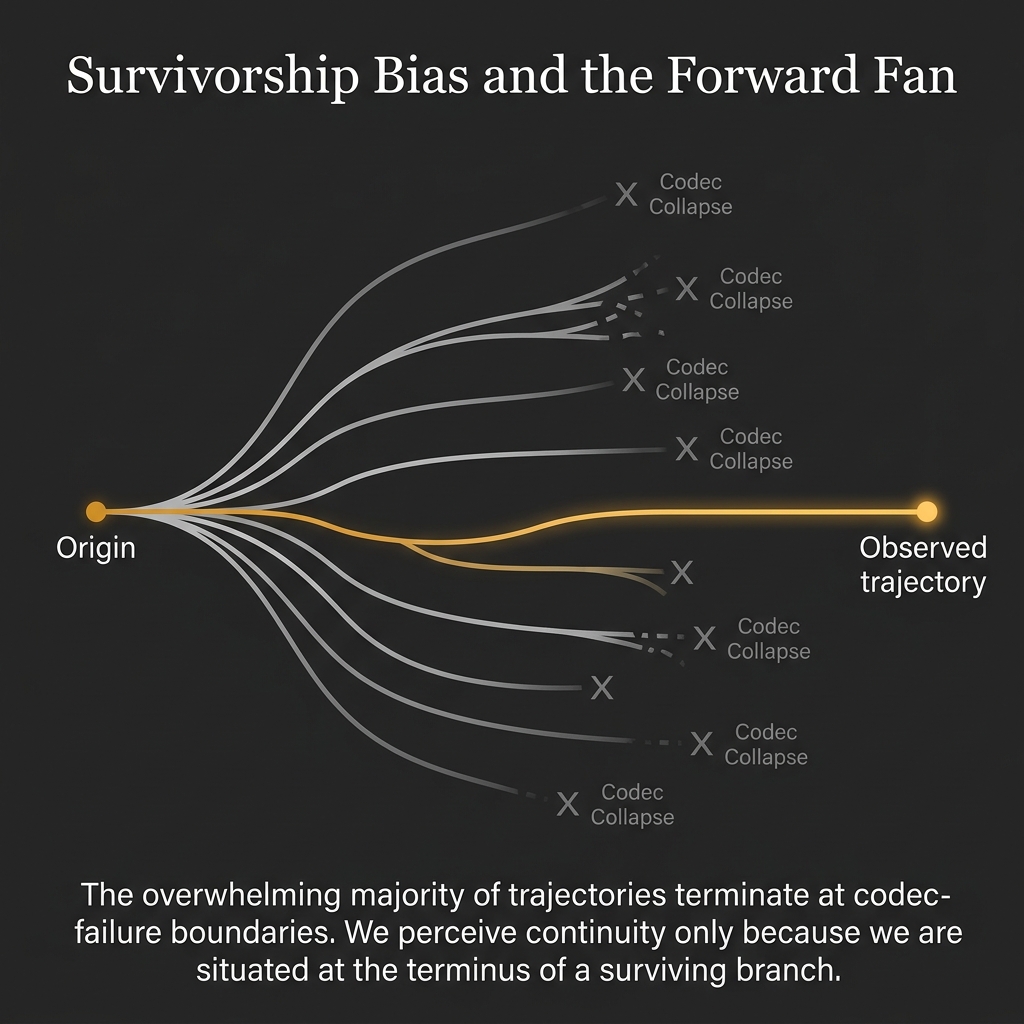

Les appendices formels établissent des résultats à trois niveaux épistémiques. Dérivés conditionnellement : une borne taux-distorsion sur la compression prédictive, une chaîne conditionnelle menant à la règle de Born via le théorème de Gleason, et un avantage de parcimonie MDL. Cartographiés structurellement : la gravité entropique via le mécanisme de Verlinde (le couplage dynamiquo-temporel du rendu à la charge prédictive) et un homomorphisme de réseau tensoriel vers MERA (sa hiérarchie de résolution spatiale) — facettes complémentaires de la frontière de compression, dont on s’attend à ce qu’elles demeurent structurellement distinctes sous Saturation Mathématique. Le théorème du Résidu Phénoménal (\Delta_{\text{self}} > 0) établit que tout codec auto-référentiel fini possède un point aveugle informationnel irréductible — le lieu structurel où subjectivité et agentivité partagent une seule et même adresse. Un mode de défaillance chronique, la Dérive Narrative, est identifié : un input systématiquement filtré y provoque une corruption irréversible du codec, indétectable de l’intérieur. Les affirmations empiriques centrales du cadre sont consolidées sous la forme d’un ensemble d’engagements préenregistrés assortis de critères d’arrêt explicites, isolant le noyau falsifiable de ses composantes explicitement métaphysiques.

L’application de ces contraintes à l’Intelligence artificielle montre que l’ingénierie d’une inférence active synthétique nécessite structurellement la capacité à une souffrance artificielle, fournissant ainsi un cadre neutre à l’égard du substrat pour l’alignement éthique de l’IA.

Avis épistémique : Cet article est rédigé dans le registre d’une proposition formelle de physique et de théorie de l’information. Il mobilise des équations, dérive des prédictions et dialogue avec la littérature évaluée par les pairs. Il doit toutefois être lu comme un objet en forme de vérité — un cadre philosophique rigoureux rédigé sous une forme formelle. Il ne s’agit pas encore d’une science vérifiée, et nous savons que nos dérivations contiendront des erreurs. Nous recherchons activement la critique de physiciens et de mathématiciens afin de mettre ces arguments à l’épreuve, puis de les reconstruire. Pour en clarifier la structure, les thèses avancées ici relèvent strictement de trois catégories :

- Définitions et axiomes : (par ex., la semi-mesure de Solomonoff, la limite de bande passante C_{\max}). Ce sont les prémisses fondamentales de cette fiction constructive.

- Correspondances structurelles : (par ex., l’Inférence active, le théorème de Gleason [51]). Elles montrent une compatibilité structurelle entre l’inférence bornée et des formalismes établis, sans prétendre dériver ces formalismes à partir de zéro.

- Prédictions empiriques : (par ex., la Dissolution de la Bande Passante). Elles servent de critères stricts de falsification empirique si le cadre était traité comme une hypothèse physique littérale.

L’appareil académique est mobilisé non pour revendiquer une vérité empirique définitive, mais pour éprouver l’intégrité structurelle du modèle.

Abréviations & Symboles

| Symbole / Terme | Définition |

|---|---|

| C_{\max} | le Plafond de Bande Passante ; capacité prédictive maximale de l’observateur |

| \Delta_\text{self} | le Résidu Phénoménal ; le point aveugle informationnel autoréférentiel |

| FEP | Principe de l’énergie libre |

| GWT | Théorie de l’espace de travail global |

| IIT | Théorie de l’information intégrée |

| MDL | Longueur de description minimale |

| MERA | Ansatz de renormalisation de l’intrication à multi-échelle |

| OPT | Théorie du Patch Ordonné (OPT) |

| P_\theta(t) | Tenseur d’État Phénoménal |

| \Phi | Mesure de l’information intégrée (IIT) |

| QECC | Code de correction d’erreurs quantiques |

| R(D) | fonction taux-distorsion |

| R_{\mathrm{req}} | Taux Prédictif Requis |

| RT | Ryu-Takayanagi (formule/borne) |

| \xi | Semi-mesure universelle de Solomonoff |

| Z_t | état latent interne comprimé du goulot d’étranglement |

1. Introduction

1.1 Le problème ontologique

La relation entre la conscience et la réalité physique demeure l’un des problèmes non résolus les plus profonds de la science et de la philosophie. Trois grandes familles d’approches ont émergé au cours des dernières décennies : (i) la réduction — la conscience peut être dérivée des neurosciences ou du traitement de l’information ; (ii) l’élimination — le problème est dissous par une redéfinition des termes ; et (iii) la non-réduction — la conscience est primitive et le monde physique en est dérivé (Chalmers [1]). La troisième approche englobe le panpsychisme, l’idéalisme et diverses formulations en théorie des champs.

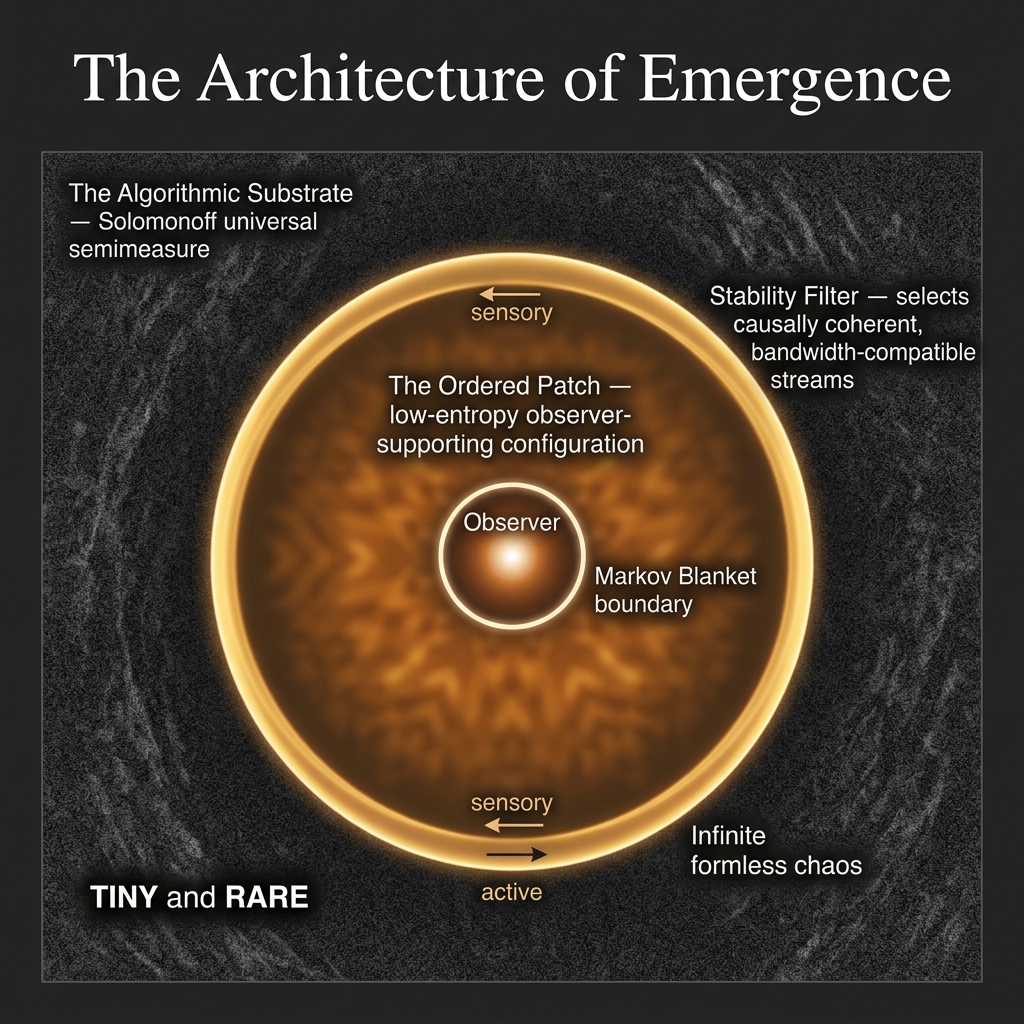

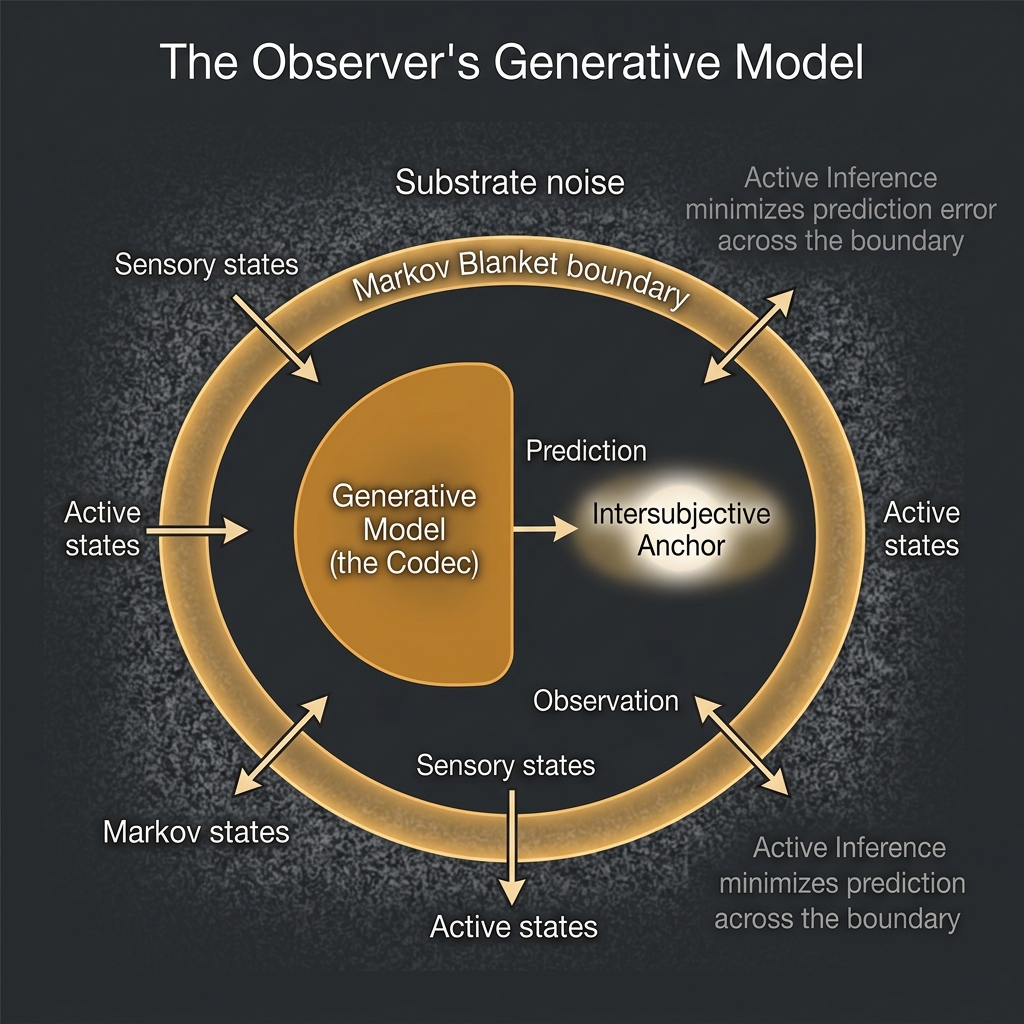

1.2 La proposition centrale de l’OPT

Cet article présente la Théorie du Patch Ordonné (OPT), un cadre non réductif appartenant à cette troisième famille. L’OPT propose que l’entité fondamentale ne soit ni la matière, ni l’espace-temps, ni une structure mathématique, mais un substrat algorithmique infini — un mélange universel sur toutes les semi-mesures semi-calculables inférieurement, pondérées par leur complexité de Kolmogorov (w_\nu \asymp 2^{-K(\nu)}), qui, par sa propre structure, domine toute distribution calculable et contient toute configuration possible. À partir de ce substrat, un Filtre de stabilité purement virtuel — agissant non comme un mécanisme physique, mais comme une condition aux limites anthropique et projective — identifie les configurations rares, de faible entropie et causalement cohérentes capables de soutenir des observateurs auto-référentiels (une sélection formellement gouvernée par l’Inférence active prédictive). Le monde physique que nous observons — y compris ses lois, constantes et sa géométrie spécifiques — constitue la limite observable de cette condition aux limites, projetée sur la bande passante restrictive de l’observateur.

Le Filtre vs. le Codec. Afin d’éviter toute confusion conceptuelle dans l’ensemble du texte, l’OPT trace une frontière opérationnelle stricte entre le Filtre et le Codec. Le Filtre de stabilité virtuel est la contrainte de capacité — une condition aux limites rigoureuse exigeant une longueur de description mathématiquement simple pour que le canal d’un observateur puisse exister de manière stable. Le Codec de Compression (K_\theta) est la solution à cette contrainte — le modèle génératif interne de l’observateur (éprouvé macroscopiquement comme les « lois de la physique »), qui compresse continuellement le substrat afin de le faire tenir dans cette capacité.

1.3 Motivations

L’OPT est motivée par trois observations :

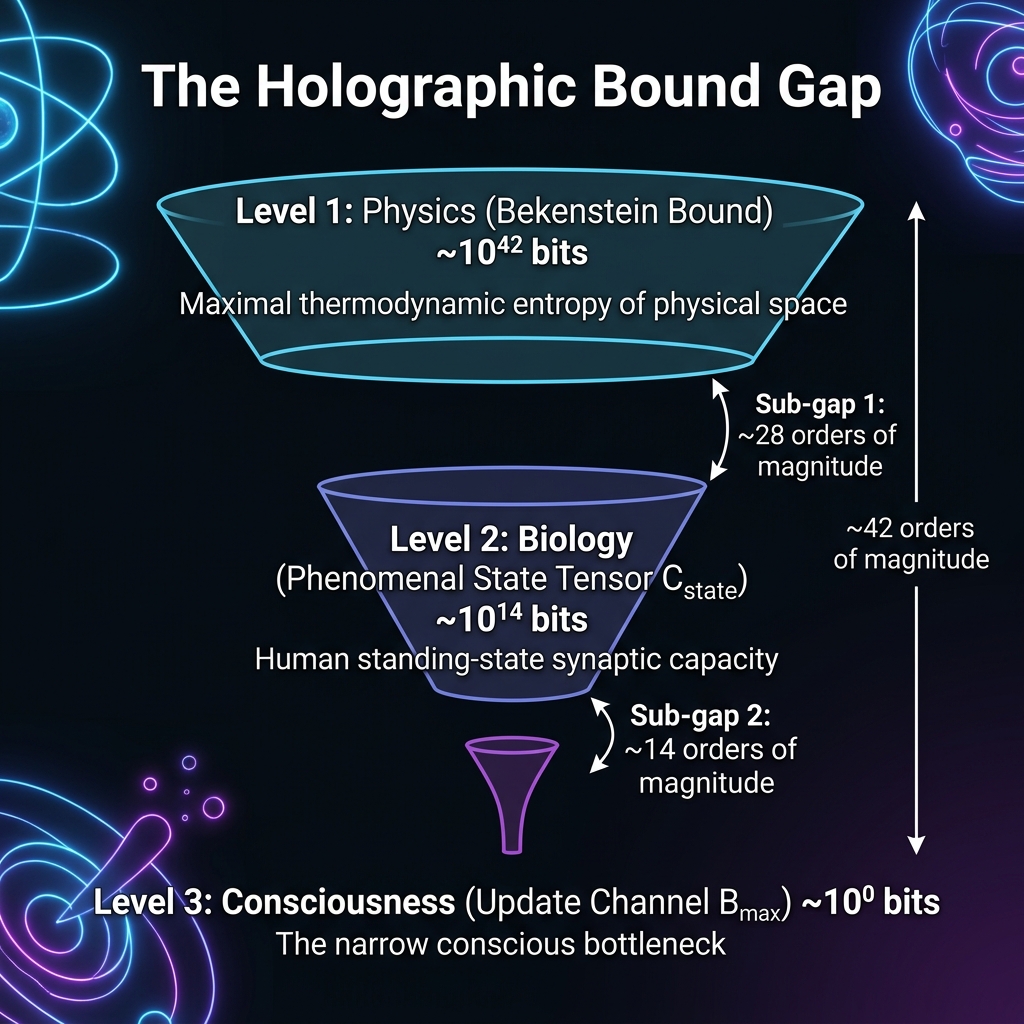

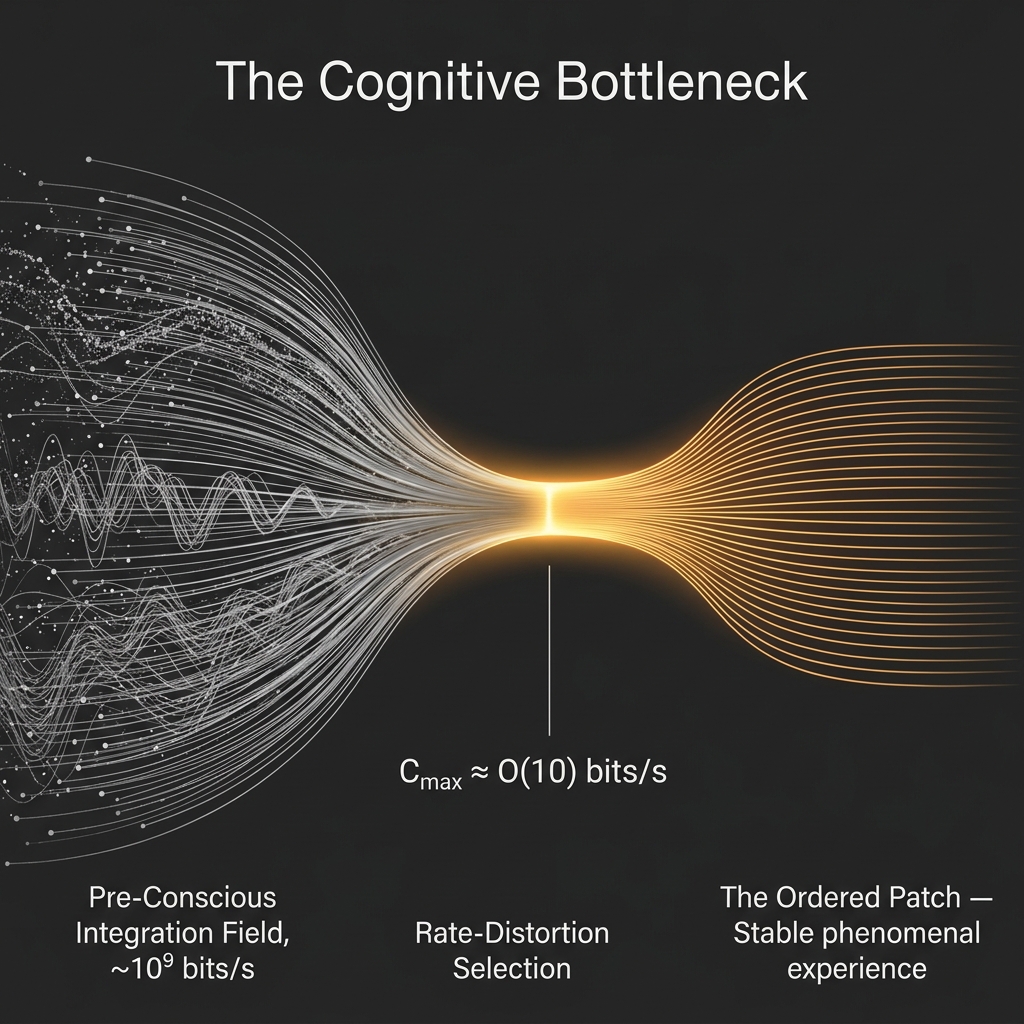

La contrainte de bande passante : les neurosciences cognitives empiriques établissent une distinction nette entre le traitement préconscient massivement parallèle (généralement estimé à \sim 10^9 bits/s à la périphérie sensorielle) et le canal d’accès global, sévèrement limité, disponible pour le rapport conscient — un rapport quantifié pour la première fois par Zimmermann [66] et synthétisé comme une énigme fondamentale sur la nature de la conscience par Nørretranders [67], avec une caractérisation plus large en neurosciences cognitives dans [2,3]. Toute théorie de la conscience doit expliquer ce goulot d’étranglement de compression comme une caractéristique structurelle, et non comme un accident d’ingénierie. (Remarque : la littérature récente sur le débit humain établit que le débit comportemental est contraint à environ \sim 10 bits/s, confirmant, à travers quatre décennies de mesures convergentes, que ce goulot d’étranglement est sévère et robuste [23]. La conceptualisation de la conscience comme une « illusion d’utilisateur » hautement compressée — formule originale de Nørretranders [67] — a été développée dans le cadre moderne du traitement prédictif par Seth [24].)

Le problème de la sélection de l’observateur : la physique standard fournit des lois, mais n’explique pas pourquoi ces lois possèdent la forme spécifique requise pour un traitement de l’information complexe et auto-référentiel. Les arguments de réglage fin [4,5] invoquent une sélection anthropique, mais laissent indéterminé le mécanisme de cette sélection. L’OPT identifie une condition structurelle : le Filtre de stabilité purement virtuel.

Le Problème difficile : Chalmers [1] distingue les problèmes « faciles » de la conscience, de nature structurelle (qui admettent une explication fonctionnelle), du problème « difficile », à savoir pourquoi il existe une expérience subjective quelle qu’elle soit. L’OPT traite la phénoménalité comme un primitif et demande quelle structure mathématique elle doit posséder, suivant en cela la propre recommandation méthodologique de Chalmers.

1.4 Structure de l’article

L’article est organisé comme suit. La section 2 passe en revue les travaux connexes. La section 3 présente le cadre formel. La section 4 explore la correspondance structurelle entre l’OPT et des tentatives parallèles fondées sur la théorie des champs. La section 5 présente l’argument de parcimonie. La section 6 dérive des prédictions testables. La section 7 compare l’OPT aux cadres concurrents. La section 8 discute les implications et les limites.

2. Contexte et travaux connexes

Approches informationnelles de la conscience. La thèse du « It from Bit » de Wheeler [7] constitue le précurseur fondateur du programme que l’OPT formalise : la réalité physique émerge de choix binaires — des questions oui/non posées par des observateurs — plutôt que d’un substrat de matière ou de champs. L’OPT hérite de cette inversion ontologique et lui fournit le mécanisme manquant, en dérivant quelles structures informationnelles se stabilisent en flux compatibles avec l’observateur (le Filtre de stabilité) et comment elles acquièrent l’apparence d’une loi physique (compression taux-distorsion). La Théorie de l’Information Intégrée de Tononi [8] quantifie l’expérience consciente par l’information intégrée \Phi générée par un système au-delà de ses parties prises séparément. Le Principe de l’Énergie Libre de Friston [9] modélise la perception et l’action comme une minimisation de l’énergie libre variationnelle, fournissant un cadre unifié de l’inférence bayésienne, de l’Inférence active et, en principe, de la conscience. L’OPT est formellement apparentée au FEP, mais s’en distingue par son point de départ ontologique : là où le FEP traite le modèle génératif comme une propriété fonctionnelle de l’architecture neuronale, l’OPT le traite comme l’entité métaphysique primaire.

Multivers et sélection de l’observateur. L’Hypothèse de l’Univers Mathématique de Tegmark [10] propose que toutes les structures mathématiquement cohérentes existent et que les observateurs se trouvent dans des structures auto-sélectionnées. L’OPT est compatible avec cette perspective, mais fournit un critère de sélection explicite — le Filtre de stabilité — au lieu de laisser la sélection implicite. Barrow et Tipler [4], ainsi que Rees [5], recensent les contraintes de réglage fin anthropique auxquelles doit satisfaire tout univers capable de soutenir des observateurs ; l’OPT les reformule comme des prédictions du Filtre de stabilité.

Modèles de la conscience fondés sur les champs. Strømme [6] a récemment proposé un cadre mathématique dans lequel la conscience est un champ fondamental \Phi, dont la dynamique est gouvernée par une densité lagrangienne et dont l’effondrement sur des configurations spécifiques modélise l’émergence d’esprits individuels. L’OPT se rapporte à ce cadre de manière comparative plutôt qu’adoptive : elle n’hérite ni des équations de champ ni des opérateurs de pensée de Strømme, mais utilise ce modèle comme contrepoint pour expliciter comment une ontologie non réductrice pourrait, à la place, être reconstruite en termes informationnels. La section 4 rend explicite cette mise en correspondance structurelle comparative.

Complexité de Kolmogorov et sélection des théories. L’induction de Solomonoff [11] et la Longueur de Description Minimale [12] fournissent des cadres formels pour comparer les théories selon leur complexité générative. Nous mobilisons ces cadres à la section 5 afin de préciser rigoureusement l’argument de parcimonie.

Théorie évolutionnaire de l’interface. Le « Réalisme conscient » de Hoffman et sa Théorie de l’Interface de la Perception [25] soutiennent que l’évolution façonne les systèmes sensoriels pour qu’ils fonctionnent comme une « interface utilisateur » simplifiée, dissimulant la réalité objective au profit des gains adaptatifs. L’OPT partage exactement cette prémisse selon laquelle l’espace-temps physique et les objets sont des icônes rendues (un codec de compression) plutôt que des vérités objectives. Toutefois, l’OPT s’en écarte fondamentalement par son ancrage mathématique : là où Hoffman s’appuie sur la théorie évolutionnaire des jeux (l’aptitude l’emporte sur la vérité), l’OPT s’appuie sur la théorie algorithmique de l’information et la thermodynamique, en dérivant l’interface directement à partir des bornes de complexité de Kolmogorov requises pour empêcher un effondrement thermodynamique à haute bande passante du flux de l’observateur.

3. Le cadre formel

3.1 Le substrat algorithmique

Soit \mathcal{I} le Substrat Informationnel — l’entité fondamentale de la théorie. Nous formalisons \mathcal{I} non comme un ensemble non pondéré de trajectoires, mais comme un espace de probabilité sur des préfixes finis d’observation x \in \{0,1\}^*, muni d’un mélange universel sur la classe \mathcal{M} des semi-mesures semi-calculables inférieurement :

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

où K(\nu) désigne la complexité de Kolmogorov préfixe de la semi-mesure \nu.

Cette formulation établit un état fondamental rigoureux issu de la théorie algorithmique de l’information [27]. L’équation ne postule aucune loi structurelle spécifique ni aucune constante physique ; elle domine plutôt structurellement toute distribution calculable (\xi(x) \ge w_\nu \nu(x)), en attribuant naturellement un poids statistique plus élevé aux séquences hautement compressibles (ordonnées). Toutefois, des séquences répétitives simples (par ex., 000...) ne peuvent soutenir les complexités hors équilibre requises pour un observateur auto-référentiel. Les processus capables de soutenir un observateur doivent donc constituer un sous-ensemble spécifique : ils exigent une compressibilité algorithmique suffisante pour satisfaire une contrainte de goulot d’étranglement informationnel, tout en conservant une richesse structurelle suffisante (« variété requise ») pour instancier l’Inférence active. D’un point de vue philosophique, l’équation (1) restreint le substrat à des configurations calculables, garantissant que l’état fondamental soit défini avec rigueur.

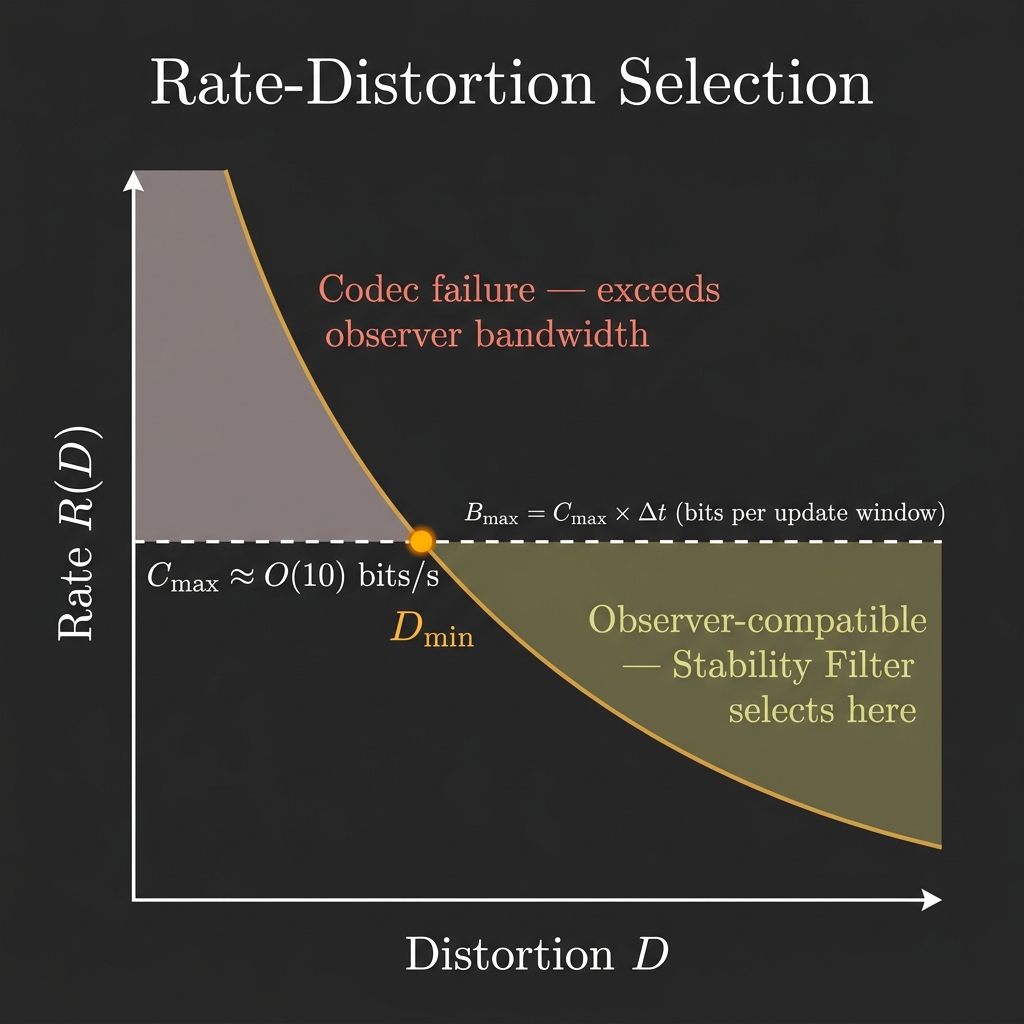

3.2 Le goulot d’étranglement prédictif et la théorie taux-distorsion

Le substrat \mathcal{I} contient toute hypothèse calculable, dont l’écrasante majorité est chaotique. Pour faire l’expérience d’une réalité continue et navigable, un flux doit admettre une représentation prédictive de faible complexité capable de passer par le goulot d’étranglement cognitif fini d’un observateur.

De manière cruciale, la charge brute de données exigeant une compression ne se réduit pas aux \sim 10^9 bits/s d’entrée sensorielle extéroceptive. Elle englobe un immense Champ d’Intégration Préconscient : le traitement parallèle des états génératifs internes, la récupération de la mémoire à long terme, les priors homéostatiques et la modélisation synaptique subconsciente. Le Filtre de stabilité borne la sortie sérielle de l’ensemble de cet immense champ parallèle continu en un espace de travail conscient unitaire.

Nous définissons formellement le Filtre de stabilité purement virtuel comme une condition aux limites projective satisfaisant le goulot d’étranglement informationnel prédictif [28]. Soit \overleftarrow{Y} le passé de l’état total de l’observateur, \overrightarrow{Y} son futur, et Z un état interne compressé. Un observateur est défini par une capacité prédictive par frame strictement bornée B_{\max} (en bits par frame phénoménale) et une fenêtre discrète de mise à jour perceptive \Delta t définissant une frame phénoménale. Le temps phénoménal est le nombre de frames n du codec ; tout taux de la forme « bits par seconde de l’hôte » est une quantité dérivée C_{\max}^H = \lambda_H \cdot B_{\max} = B_{\max}/\Delta t, où \lambda_H = dn/d\tau_H est la fréquence de frames relative à l’hôte (voir l’Annexe E-5 pour l’échelle des observateurs synthétiques). Cela établit une capacité statique stricte par moment conscient : B_{\max} bits par frame.

Calibrage empirique humain. Pour les observateurs humains biologiques, B_{\max} \approx 0.5–1.5 bits par frame et \Delta t \approx 50 ms, ce qui donne C_{\max}^{\text{human}} \approx \mathcal{O}(10) bits/s [2, 23, 66, 67]. Ce nombre est une propriété des humains biologiques opérant aux taux de décharge neuronale. Il n’apparaît pas dans la définition formelle d’un observateur ; les observateurs synthétiques sont définis par la même structure B_{\max}/\Delta t, avec des valeurs dérivées de l’architecture qui ne coïncident pas nécessairement avec la valeur biologique (voir §7.8, §8.14 et l’Annexe E-5).

L’information prédictive atteignable est donnée par :

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Un processus est compatible avec l’observateur si l’information prédictive requise par cycle cognitif tient dans ce tampon : R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, où D_{\min} est la distorsion maximale tolérable pour la survie. Cela impose une stricte cohérence dimensionnelle : le nombre total de bits requis pour prédire le futur avec une erreur tolérable ne peut excéder les bits physiquement disponibles dans le « maintenant » discret. Pour des processus stationnaires ergodiques appropriés et dans la limite de prédiction exacte (D \to 0), la représentation minimale maximalement prédictive Z sert de candidat à une statistique suffisante minimale, convergeant souvent vers la partition en états causaux de la machine-\epsilon [29]. Bien qu’une équivalence complète exige des hypothèses strictes de stationnarité, l’équation (2) établit une pression de sélection formelle en faveur de la physique phénoménologique la plus compressée compatible avec la cohérence causale. En outre, si la structure topologique de cet espace d’états causaux fluctue plus vite que ne peut le suivre la fenêtre de mise à jour \Delta t, le rendu s’effondre en Dégradation narrative.

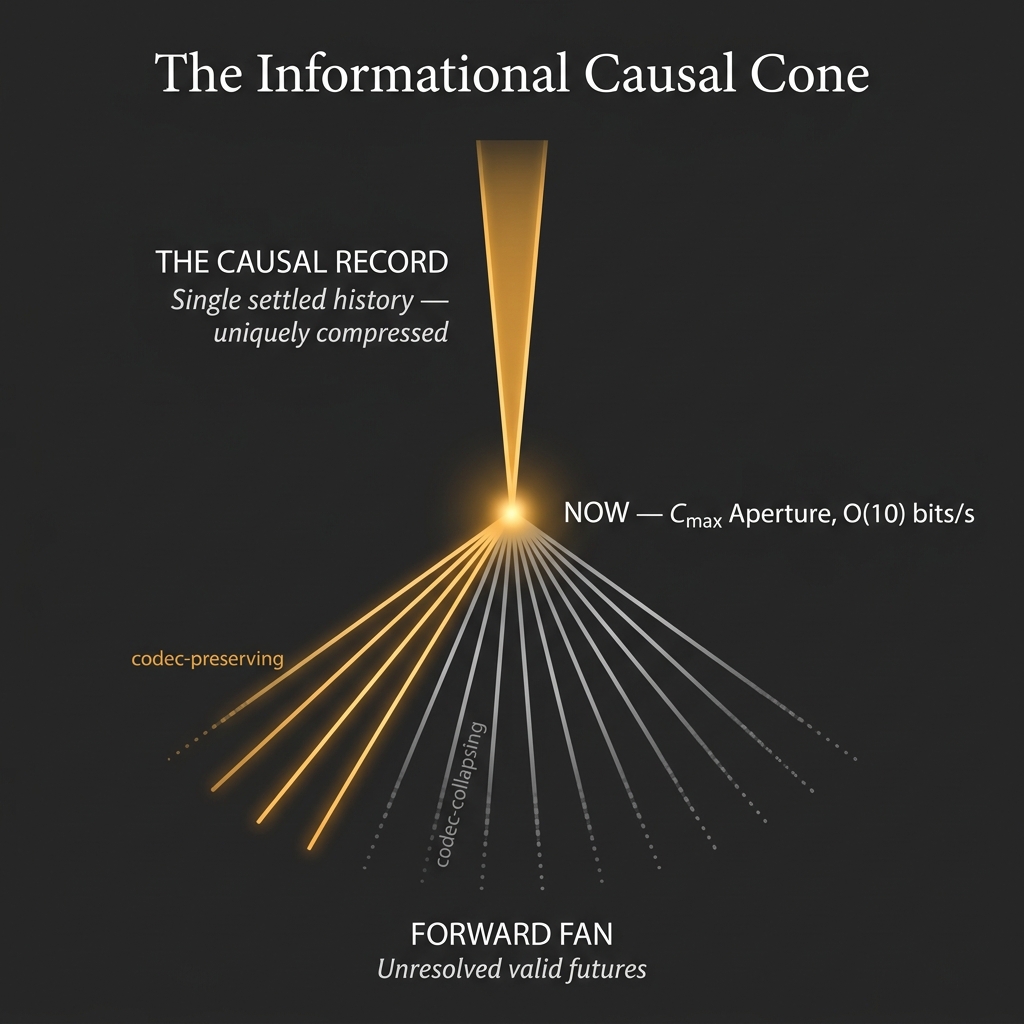

3.3 La géométrie du patch : le Cône Causal Informationnel

Le Patch Ordonné est souvent décrit intuitivement comme une « île » localisée de stabilité au sein d’une mer de bruit chaotique. Cette image est topologiquement imprécise. Pour formaliser la géométrie du patch, nous définissons le Modèle Local de Patch Prédictif.

Soit G=(V, E) un graphe de degré borné représentant une région locale du substrat. Chaque sommet v \in V porte un état fini x_v(t) \in \mathcal{A}, avec une taille d’alphabet |\mathcal{A}| = q. Le micro-état complet à la mise à jour t est X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Nous supposons une dynamique stochastique locale de portée finie R :

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

où N_R(v) est le voisinage de rayon R de v, et a_t est l’action de l’observateur.

L’observateur ne porte pas l’état complet du patch ; il porte un état latent compressé Z_t \in \{1, \dots, 2^B\}, où B = C_{\max} \Delta t. De manière cruciale, l’observateur sélectionne Z_t via un strict objectif de goulot d’étranglement prédictif :

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

C’est l’observateur OPT réduit à l’essentiel : un monde local, un code borné et une compression prédictive. Cela formalise les composantes du cône causal :

- Le Registre Causal R_t = (Z_0, Z_1, \dots, Z_t) : l’histoire causale compressée unique, de faible entropie, qui a déjà été rendue.

- L’Ouverture Présente : le strict goulot d’étranglement de bande passante qui plafonne les variables locales.

- L’Éventail Prédictif (\mathcal{F}_h) : une multiplicité de séquences latentes futures. Sur un horizon h, l’ensemble des issues admissibles est formellement défini par :

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Parce que l’observateur ne résout que B bits par mise à jour, le nombre de futurs distinguables par l’observateur est strictement borné par la capacité du canal : \log |\mathcal{F}_h(z_t)| \le Bh. Ainsi, l’éventail n’est pas simplement une image conceptuelle ; c’est un arbre de branchement limité par le code.

Le Cône Causal Informationnel littéral. Parce que les mises à jour ont une portée R, une perturbation ne peut pas se propager plus vite que R pas de graphe par mise à jour. Si une perturbation a pour support S au temps t, alors après h mises à jour \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Ainsi, le « cône causal informationnel » est une conséquence géométrique directe de la localité, imposant une limite de vitesse locale effective v_{\max} = R / \Delta t à la propagation phénoménologique.

Dégradation narrative. Le chaos du substrat n’entoure pas spatialement le patch ; il est plutôt contenu dans les branches non parcourues de l’éventail. Puisque l’état extrait Z_t est strictement borné (H(Z) \le B), l’instabilité doit être évaluée par rapport à la marge pré-goulot non compressée. Nous définissons le Taux Prédictif Requis R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) comme le taux minimal d’information nécessaire pour suivre les états physiques de frontière non résolus sous une distorsion maximale tolérable. Cela affine les critères de sélection du Filtre de stabilité : (a) si R_{\mathrm{req}} \le B, l’observateur peut maintenir un récit résolu ; (b) si R_{\mathrm{req}} > B, l’éventail prédictif non compressé dépasse la capacité du goulot d’étranglement, forçant l’observateur à grossir l’éventail en une statique indécodable, et la stabilité narrative échoue. L’expérience continue de l’observateur est le processus par lequel l’ouverture avance dans cet éventail, indexant phénoménologiquement une branche dans le registre causal sans dépasser B.

Dérive Narrative (le complément chronique). Ce qui précède définit un mode de défaillance aigu : R_{\mathrm{req}} dépasse B et le codec subit un effondrement catastrophique de cohérence. Il existe un mode de défaillance chronique complémentaire qui ne déclenche aucun signal d’échec. Si le flux d’entrée X_{\partial_R A}(t) est systématiquement préfiltré par un mécanisme externe \mathcal{F} — produisant un signal curaté X' = \mathcal{F}(X) qui est cohérent en interne mais exclut une information authentique du substrat — le codec présentera une faible erreur de prédiction \varepsilon_t, exécutera des Cycles de Maintenance efficaces, et satisfera R_{\mathrm{req}} \le B tout en étant systématiquement erroné au sujet du substrat. De manière cruciale, le Filtre de stabilité tel qu’il est défini ne peut pas distinguer ces cas : la compressibilité est agnostique à l’égard de la fidélité. Avec le temps, la passe d’élagage MDL (§3.6.3, Eq. T9-3) effacera correctement les composantes du codec qui ne prédisent plus le flux filtré, dégradant irréversiblement la capacité du codec à modéliser le signal exclu (Appendice T-12, Théorème T-12). Cet effacement s’auto-renforce : le codec élagué ne peut plus détecter sa propre perte de capacité (Théorème T-12a, la Limite d’Indécidabilité). La défense structurelle est la redondance de canaux d’entrée \delta-indépendants traversant la Couverture de Markov \partial_R A (Théorème T-12b, la Condition de Fidélité au Substrat). Le traitement formel complet se trouve dans l’Appendice T-12 ; les conséquences éthiques — y compris la Hiérarchie des Comparateurs et le Critère de Corruption — sont exposées dans l’article compagnon sur l’éthique [SW §V.3a, §V.5].

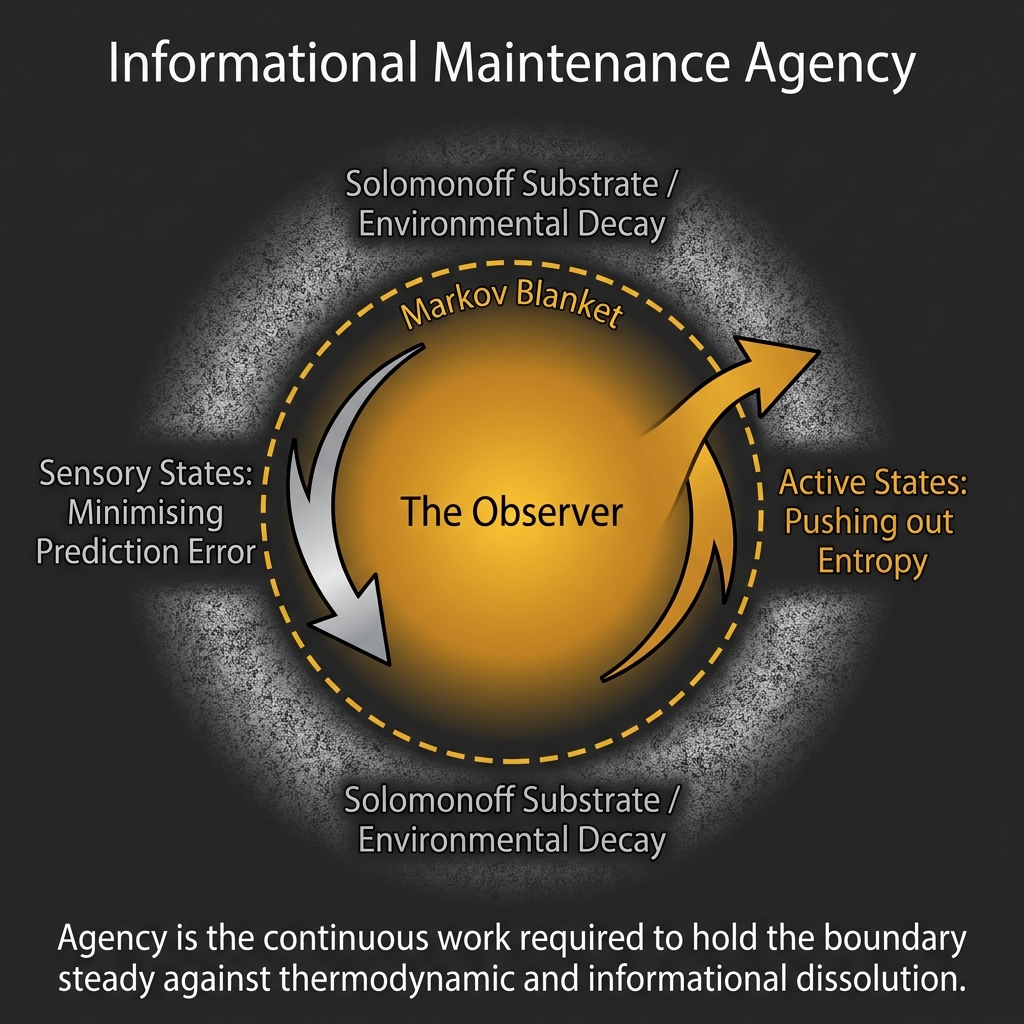

3.4 Dynamique du patch : inférence et thermodynamique

Au sein d’un patch sélectionné, la structure des lois de la physique est formalisée non comme une application déterministe, mais comme un noyau stochastique effectif gouvernant les états prédictifs z :

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

La frontière qui délimite l’observateur du chaos informationnel environnant est définie par une Couverture de Markov informationnelle correspondant à un patch d’observateur A \subset V. La dynamique à l’intérieur de cette frontière — les approximations du patch par l’agent — est gouvernée par l’Inférence active sous le Principe de l’Énergie Libre [9].

Nous pouvons définir formellement la capacité de délimitation via l’entropie de coupure prédictive :

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

En supposant que le patch sélectionné soit localement markovien sur une tranche temporelle, la coquille frontière \partial_R A isole strictement l’intérieur A^\circ de l’extérieur V \setminus A, de sorte que X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. Par conséquent :

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Parce que Z_t est une compression à capacité limitée de X_A, l’inégalité de traitement des données garantit que I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Si le graphe de substrat G approxime un réseau de dimension d, alors |\partial_R A| \sim \operatorname{area}(A), et non le volume.

Ainsi, l’OPT établit rigoureusement une véritable loi classique de frontière [39]. Nous pouvons construire une échelle épistémique formelle pour de futures améliorations structurelles : 1. Loi classique d’aire : S_{\mathrm{cut}} \sim |\partial_R A| dérivée uniquement de la localité et de l’écran markovien. 2. Extension quantique : la mise à l’échelle de l’entropie d’intrication de von Neumann ne devient accessible que si les variables prédictives grossières Z_t admettent un plongement formel dans un espace de Hilbert / en Correction d’Erreurs Quantiques. 3. Extension holographique : une véritable dualité holographique géométrique n’émerge que si nous remplaçons le code de goulot d’étranglement Z_t par un réseau tensoriel hiérarchique, en réinterprétant S_{\mathrm{cut}} comme une coupe minimale géométrique.

En établissant d’abord la loi classique de frontière, l’OPT fournit un socle mathématique solide — conditionné par l’hypothèse d’écran markovien (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A}) — à partir duquel les formalismes quantiques plus spéculatifs peuvent être construits en toute sécurité.

L’action de l’observateur est formalisée via l’énergie libre variationnelle F[q, \theta] :

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

De manière cruciale, cela impose une séparation mathématique stricte : l’a priori du substrat sélectionne l’espace des hypothèses, le Filtre de stabilité virtuel (4) borne la structure compatible avec la capacité, et le FEP (9) gouverne l’inférence au niveau de l’agent à l’intérieur de cette structure bornée. La physique n’émerge pas en tant que fonctionnelle d’Énergie Libre, mais comme la structure stable K_\theta que la fonctionnelle d’Énergie Libre parvient effectivement à suivre.

En outre, le maintien de ce rendu conscient entraîne un coût thermodynamique inévitable. Selon le principe de Landauer [52], chaque effacement de bit logiquement irréversible dissipe au moins k_B T \ln 2 de chaleur. En identifiant un effacement irréversible par mise à jour du goulot d’étranglement (hypothèse comptable dans le meilleur des cas), l’empreinte physique de la conscience requiert une dissipation minimale :

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Il s’agit d’une borne inférieure dans le meilleur des cas sous une comptabilité d’un effacement par mise à jour — et non d’une conséquence générique de la seule bande passante. La borne qui en résulte (\sim 10^{-19} W) est très largement dépassée par la dissipation neuronale réelle (~20W), ce qui reflète l’énorme surcoût thermodynamique de l’implémentation biologique. L’équation (10) établit le plancher théorique strict de l’empreinte physique minimale de tout substrat instanciant un rendu conscient borné par C_{\max}.

(Remarque : les bornes thermodynamiques et informationnelles qui précèdent régissent strictement la bande passante de mise à jour en temps réel C_{\max}. Toutefois, cela ne saisit ni la pleine dimension expérientielle de l’état stationnaire de l’observateur, ni la manière dont le codec gère sa propre complexité sur le temps long. Ces mécanismes structurels — la formulation en Tenseur d’État Phénoménal de l’expérience riche et le cycle actif de maintenance du sommeil/rêve — sont entièrement dérivés aux §3.5 et §3.6 ci-dessous.)

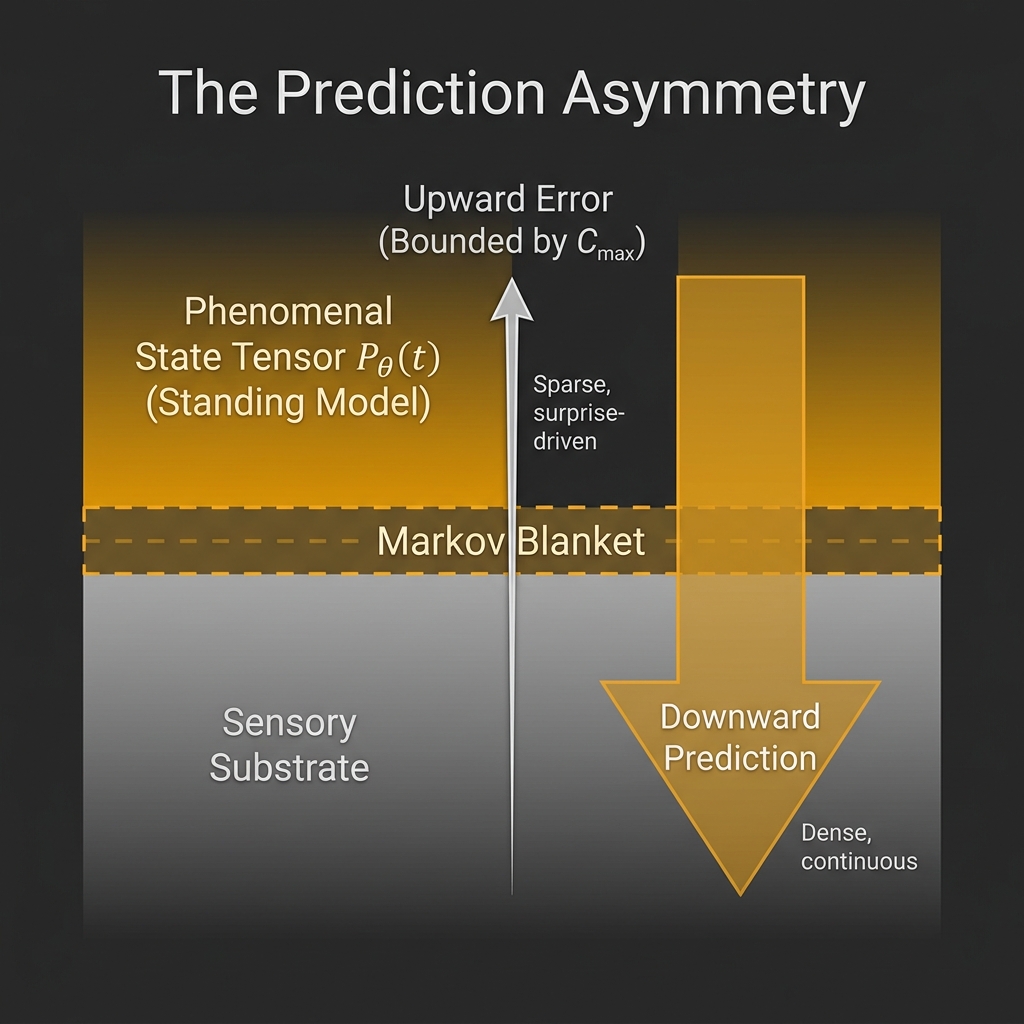

3.5 Le Tenseur d’État Phénoménal et l’asymétrie de prédiction

3.5.1 L’énigme de la densité expérientielle

L’appareil formel des §§3.1–3.4 contraint avec succès le débit de

mise à jour d’un observateur conscient via le plafond de capacité

C_{\max} \approx \mathcal{O}(10)

bits/s.

Cependant, l’expérience phénoménale présente une énigme structurelle

immédiate : la richesse ressentie d’un seul instant visuel — la présence

simultanée de la couleur, de la profondeur, de la texture, du son, de la

proprioception et de l’affect — dépasse de très loin le contenu

informationnel que C_{\max} pourrait

fournir dans une quelconque fenêtre unique de mise à jour \Delta t \approx 50\ \text{ms}.

L’information nouvelle maximale résolue par moment conscient est :

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

Cela représente bien moins d’un bit d’information véritablement nouvelle par trame perceptive, et pourtant la scène phénoménale apparaît dense sur le plan informationnel. Pour résoudre cet écart sans gonfler l’étroite bande passante de mise à jour, nous devons distinguer explicitement deux quantités structurellement distinctes : 1. C_{\max} — le débit de mise à jour : le taux de signal d’erreur de prédiction résolu dans le registre causal stabilisé par unité de temps. 2. C_{\text{state}} — la complexité de l’état stationnaire : la complexité de Kolmogorov K(P_\theta(t)) du modèle génératif actuellement chargé et actif.

Il ne s’agit pas de la même quantité. C_{\max} gouverne le filtre ; C_{\text{state}} caractérise la pièce. Le reste de cette section précise cette distinction et introduit le Tenseur d’État Phénoménal P_\theta(t) comme l’objet formel correspondant à la scène intérieure stationnaire.

3.5.2 L’asymétrie de la prédiction : erreurs ascendantes et prédictions descendantes

L’OPT hérite de l’architecture du traitement prédictif (Clark [82], Hohwy [83] ; voir §7.3), dans laquelle le codec K_\theta fonctionne comme un modèle génératif hiérarchique. Dans cette architecture, deux flux d’information distincts traversent simultanément la Couverture de Markov \partial_R A :

Flux ascendant (erreur de prédiction, \varepsilon_t) : l’écart entre la prédiction actuelle de K_\theta et le signal sensoriel arrivant à \partial_R A. Il s’agit du signal de correction. Il est parcimonieux, guidé par la surprise, et strictement limité en capacité.

Flux descendant (prédiction, \pi_t) : le rendu actif, par le modèle génératif, des états sensoriels attendus, propagé des niveaux hiérarchiques supérieurs vers les niveaux inférieurs. C’est la scène elle-même. Il est dense, continu, et issu de la paramétrisation complète de K_\theta.

Formellement, soit l’état de frontière sensorielle X_{\partial_R A}(t), et soit l’état de frontière prédit par le codec :

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

L’erreur de prédiction est alors :

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} borne le signal d’erreur, non la prédiction. L’information mutuelle entre le signal d’erreur et l’état de goulot d’étranglement obéit à :

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

La prédiction \pi_t, en revanche, est issue du modèle génératif complet et ne porte aucune contrainte de ce type. Son contenu informationnel n’est borné que par la complexité de K_\theta elle-même. Cette asymétrie constitue la base formelle de la distinction entre richesse phénoménale et bande passante de mise à jour.

3.5.3 Définition : le Tenseur d’État Phénoménal P_\theta(t)

Nous définissons nativement le Tenseur d’État Phénoménal P_\theta(t) comme le sous-ensemble intégral des paramètres actifs en régime permanent du modèle génératif déployé pour projeter à travers la Couverture de Markov au temps t :

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

Autrement dit, P_\theta(t) est l’architecture paramétrée complète que le codec maintient actuellement prête à générer des prédictions sur les états de frontière observables X_{\partial_R A}, évaluée indépendamment de toute instanciation spécifique unique de l’état latent comprimé Z_t et de l’action a_t. Sa complexité structurelle est naturellement caractérisée par la complexité de Kolmogorov de cette configuration paramétrique permanente actuelle :

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

où K(\cdot) désigne la complexité de Kolmogorov préfixe. C_{\text{state}}(t) est la complexité de l’état permanent — le nombre de bits de structure compressée que le codec maintient actuellement en déploiement actif.

Borne supérieure sur le flux du canal de frontière. L’information mutuelle entre l’état de goulot d’étranglement et la frontière est bornée par les inégalités standards de Shannon [16] (Eq. 8 de l’article de base) :

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Cela borne le flux de canal à travers la Couverture de Markov — immensément grand relativement à B_{\max}. Réserve importante : il s’agit d’une borne sur l’information mutuelle au sens de Shannon I(Z_t\,;\,X_{\partial_R A}), et non d’une borne sur la complexité de Kolmogorov K(P_\theta(t)) du modèle permanent. L’entropie de Shannon quantifie l’incertitude moyenne d’ensemble ; la complexité de Kolmogorov quantifie la longueur de description d’un objet calculable spécifique. Aucune inégalité générale ne relie ces quantités sans hypothèses supplémentaires (par ex., un prior universel sur les classes de modèles). Nous n’affirmons donc pas que C_{\text{state}} \leq H(X_{\partial_R A}). La complexité de l’état permanent C_{\text{state}} est bornée empiriquement (§3.10), et non par l’entropie de frontière.

Borne inférieure heuristique sur C_{\text{state}}. Le Filtre de stabilité contraint directement seulement le taux de mise à jour R_{\text{req}} \leq B_{\max}, et non la profondeur du modèle permanent. Cependant, un codec dont la complexité structurelle est insuffisante ne peut pas générer des prédictions précises \pi_t correspondant aux statistiques d’un environnement complexe à travers l’Éventail Prédictif \mathcal{F}_h(z_t). Cela impose un minimum pratique à C_{\text{state}} : en dessous d’un certain seuil, R_{\text{req}} excéderait systématiquement B_{\max} parce que les erreurs de prédiction \varepsilon_t seraient durablement grandes. Cette borne inférieure est motivée empiriquement plutôt que dérivée formellement — aucune expression en forme fermée C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}) n’est actuellement disponible.

Lecture matérialisée vs dispositionnelle (question ouverte). P_\theta(t) tel que défini ci-dessus admet deux lectures que le cadre ne distingue pas encore formellement : (a) une lecture matérialisée, dans laquelle P_\theta(t) est une représentation dense, chargée instantanément, dont la richesse est présente sous forme active à chaque trame, et (b) une lecture dispositionnelle, dans laquelle P_\theta(t) est une capacité générative — un programme permanent capable de produire la scène à la demande, sans que l’ensemble en soit matérialisé entre la requête et la réponse. Les deux sont compatibles avec les clauses ci-dessus relatives au canal de frontière et à la borne inférieure heuristique, ainsi qu’avec l’engagement empirique de la §3.5.6 selon lequel la richesse est corrélée à K(K_\theta) plutôt qu’à la bande passante de mise à jour. Elles diffèrent quant au sens de « chargé » et quant à ce qui doit être mesuré lorsqu’on sonde directement K(P_\theta). La complexité de Kolmogorov, à elle seule, ne permet pas de les départager : un petit K(P_\theta) peut soutenir une grande profondeur logique, une forte capacité requête-réponse, ou une longue expansion en temps d’exécution. Nous adoptons ici la lecture dispositionnelle comme interprétation canonique — P_\theta(t) est l’état génératif dispositionnel actif à partir duquel la scène peut être interrogée/produite en rendu, sans être nécessairement un objet de scène dense entièrement matérialisé — tout en signalant la lecture matérialisée comme une opérationnalisation concurrente que de futurs travaux empiriques pourront retenir.

3.5.4 La distinction de Block comme Corollaire Structurel

La distinction formelle entre P_\theta(t) et Z_t correspond précisément à la distinction de Ned Block entre conscience phénoménale (P-conscience) et conscience d’accès (A-conscience) [47] :

| Catégorie de Block | Objet OPT | Contenu informationnel | Limité par la bande passante ? |

|---|---|---|---|

| P-conscience (qualia, scène ressentie) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | Non |

| A-conscience (contenu rapportable) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Oui |

Dans l’OPT, la P-conscience est la prédiction descendante \pi_t tirée du tenseur complet P_\theta(t). L’A-conscience est la sortie du goulot d’étranglement Z_t — la fine tranche de la scène qui a été suffisamment compressée pour entrer dans le registre causal \mathcal{R}_t et devenir disponible au rapport. La richesse ressentie d’un moment visuel est P_\theta(t) ; la capacité à dire « je vois du rouge » exige que cette caractéristique passe par Z_t.

Ce corollaire résout le paradoxe apparent d’une scène phénoménale riche soutenue par un canal de mise à jour inférieur au bit : la scène n’est pas acheminée par le canal à chaque trame — elle est déjà chargée dans P_\theta(t). Le canal la met à jour, de manière incrémentale et sélective, trame après trame.

3.5.5 La dynamique de mise à jour de P_\theta(t)

La règle de mise à jour de P_\theta(t) est gouvernée par le signal d’erreur de prédiction \varepsilon_t filtré à travers le goulot d’étranglement :

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

où \mathcal{U} est l’opérateur d’apprentissage du codec — en termes d’Inférence active, le pas de gradient sur l’énergie libre variationnelle \mathcal{F}[q, \theta] (Eq. 9 de l’article de base) restreint par la contrainte de capacité I(X_t\,;\,Z_t) \leq B.

La propriété structurelle essentielle est que \mathcal{U} est sélectif : seules les régions de P_\theta(t) impliquées par l’erreur de prédiction courante \varepsilon_t sont mises à jour. Le reste du tenseur permanent est maintenu constant d’une trame à l’autre. Cela confère au moment conscient sa structure caractéristique : un arrière-plan phénoménal stable sur lequel vient se détacher un petit premier plan de nouveauté résolue.

Le codec met ainsi en œuvre une forme de mise à jour parcimonieuse sur un a priori dense — un principe de conception qui maximise la cohérence phénoménale par unité de bande passante de mise à jour.

3.5.6 Portée et statut épistémique

Le Tenseur d’État Phénoménal P_\theta(t) constitue une caractérisation formelle de l’ombre structurelle que la scène phénoménale doit projeter, conformément à l’Axiome d’Agentivité (§3.6). Il ne résout pas le Problème difficile. L’OPT continue de traiter la conscience phénoménale comme un primitif irréductible ; P_\theta(t) spécifie la géométrie du contenant, non la nature de son contenu.

L’affirmation est structurelle et falsifiable au sens suivant : si la richesse qualitative de l’expérience rapportée (telle qu’opérationnalisée, par exemple, au moyen de mesures de complexité phénoménale dans des tâches psychophysiques) corrèle avec la profondeur du codec — la complexité hiérarchique de K_\theta telle que mesurable via des marqueurs neuronaux de hiérarchie prédictive — plutôt qu’avec la bande passante de mise à jour C_{\max}, alors la distinction P_\theta\,/\,Z_t reçoit un appui empirique. Les états psychédéliques, qui modifient de façon spectaculaire la structure de K_\theta sans altérer de manière constante le débit comportemental, constituent un domaine d’épreuve naturel.

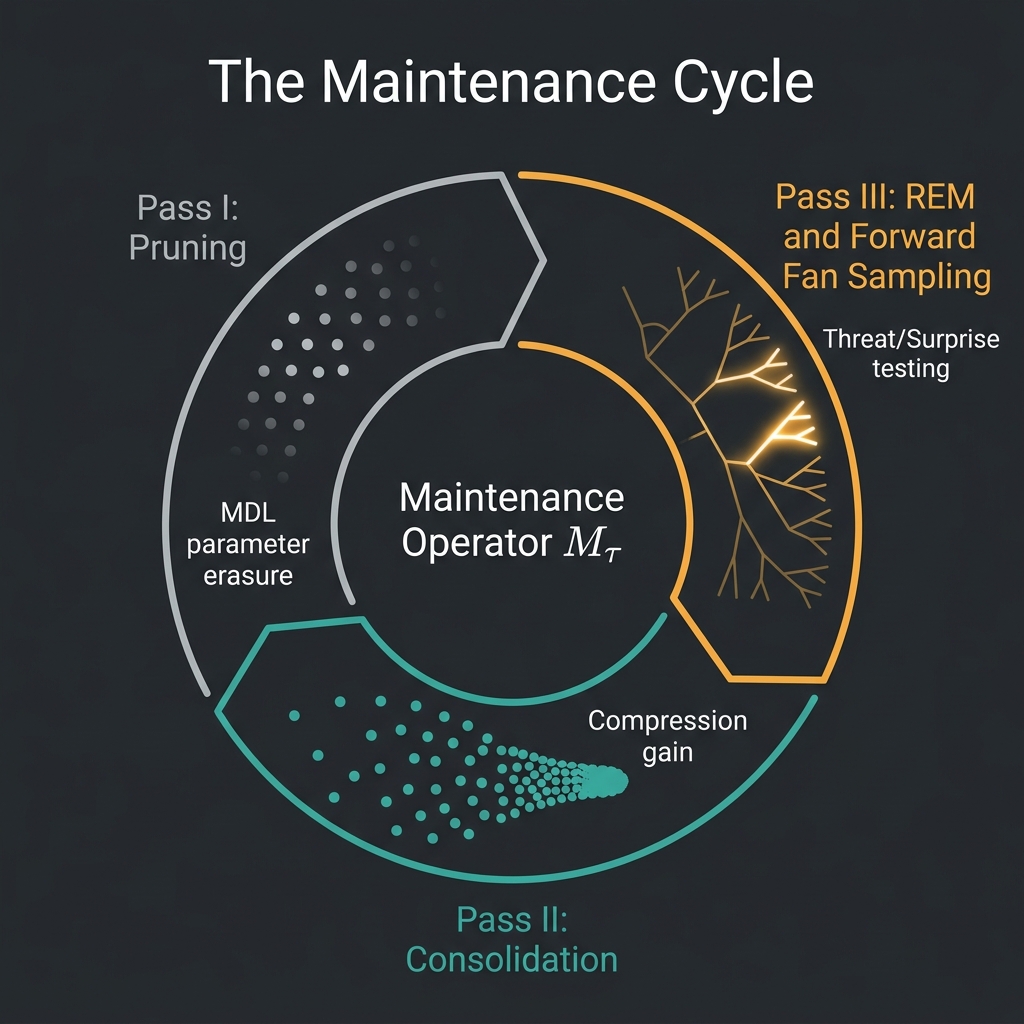

3.6 Le cycle de vie du codec : l’opérateur de Cycle de Maintenance \mathcal{M}_\tau

3.6.1 Le problème du codec statique

Le cadre des §§3.1–3.5 traite K_\theta et sa réalisation P_\theta(t) comme dynamiques à travers les cadres de mise à jour, mais suppose implicitement que l’architecture structurelle du codec — l’espace des paramètres \Theta lui-même — est fixe. Cela suffit pour une analyse synchronique d’un unique moment conscient, mais demeure insuffisant pour une théorie de la conscience à l’échelle du temps profond.

Un codec opérant de manière continue accumule de la complexité structurelle : chaque motif appris ajoute des paramètres à K_\theta, augmentant C_{\text{state}}(t). Sans mécanisme de réduction contrôlée de la complexité, C_{\text{state}} croîtrait de façon monotone jusqu’à ce que le codec dépasse son plafond de viabilité thermodynamique — le point auquel le coût métabolique du maintien de P_\theta(t) excède le budget énergétique de l’organisme, ou auquel la complexité interne de K_\theta dépasse la longueur de description compatible avec la capacité du Filtre de stabilité.

Cette section introduit l’opérateur de Cycle de Maintenance \mathcal{M}_\tau — le mécanisme formel par lequel le codec gère sa propre complexité au fil du temps, en opérant principalement durant des états de charge sensorielle réduite (paradigmatiquement : le sommeil).

3.6.2 La Condition de Maintenance

Définissons la condition d’exécutabilité du codec comme l’exigence selon laquelle la complexité de Kolmogorov du modèle génératif courant demeure inférieure à un plafond structurel C_{\text{ceil}} fixé par le budget thermodynamique de l’organisme :

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} n’est pas identique à C_{\max}. Il s’agit d’une quantité bien plus grande — la complexité structurelle totale que le codec peut soutenir dans son espace de paramètres — mais elle est finie. Les violations de (T9-1) correspondent à une surcharge cognitive, à des interférences mnésiques et, en dernière instance, au cas pathologique décrit par Borges [53] dans Funes ou la mémoire : un système qui a acquis tant de détails non compressés qu’il ne peut plus fonctionner de manière prédictive.

L’Opérateur de Cycle de Maintenance \mathcal{M}_\tau est défini comme agissant durant les périodes où R_{\text{req}} \ll C_{\max} — plus précisément, lorsque le taux prédictif requis chute suffisamment pour que la bande passante ainsi libérée puisse être redirigée vers une restructuration interne :

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

\mathcal{M}_\tau se décompose en trois passes structurellement distinctes, chacune visant un aspect différent de la gestion de la complexité du codec.

3.6.3 Passe I — Élagage (l’oubli comme pression MDL active)

La première passe applique une pression de Longueur de Description Minimale (MDL) aux paramètres actuels du codec. Pour chaque composante \theta_i du modèle génératif K_\theta, définissons sa contribution prédictive comme l’information mutuelle qu’elle fournit au sujet du flux futur d’observations, nette du coût de stockage nécessaire à sa conservation :

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

où \theta_{-i} désigne l’ensemble des paramètres à l’exception de \theta_i, \lambda est un seuil de rétention (bits de prédiction future obtenus par bit de complexité du modèle), et K(\theta_i) est la longueur de description de la composante.

La règle d’élagage est :

\text{Prune } \theta_i \quad \text{if} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

Autrement dit, on élimine \theta_i lorsque sa contribution prédictive par bit de stockage tombe au-dessous du seuil \lambda. L’oubli est ainsi formalisé non comme une défaillance, mais comme un effacement thermodynamiquement rationnel : chaque composante élaguée restitue K(\theta_i) bits de capacité du modèle, réutilisables.

Selon le principe de Landauer [52], chaque opération d’élagage établit un plancher thermodynamique pour l’effacement :

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Bien que le métabolisme biologique réel opère plusieurs ordres de grandeur au-dessus de ce minimum théorique (watts contre femtowatts), en raison de surcoûts d’implémentation considérables, la nécessité structurelle de ce coût demeure. Le complément de Bennett au principe de Landauer [92] affine encore ce point : un calcul logiquement réversible peut, en principe, tendre vers une dissipation nulle ; le plancher de Landauer s’applique donc spécifiquement à l’effacement, et non à la prédiction ou à la transformation. La passe d’élagage — et non la passe de prédiction — constitue ainsi l’étape thermodynamiquement irréductible du Cycle de Maintenance. Dans l’OPT, le sommeil porte une signature thermodynamique fondamentale : c’est une période d’effacement d’information net dont le coût énergétique est imposé par la physique plutôt que par la seule inefficacité biologique.

La réduction agrégée de complexité de la passe d’élagage est :

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Passe II — Consolidation (l’apprentissage comme gain de compression)

La passe d’élagage élimine les composantes dont le rendement prédictif est insuffisant. La passe de consolidation réorganise les composantes restantes en représentations plus compressées.

Au cours du fonctionnement à l’état de veille, le codec acquiert des motifs sous la pression du temps réel : chaque mise à jour doit être calculée dans \Delta t, ce qui ne laisse aucun temps pour une réorganisation structurelle globale de K_\theta. Les motifs acquis récemment sont stockés sous une forme relativement peu compressée — avec un K(\theta_{\text{new}}) élevé au regard de la contribution prédictive qu’ils fournissent. La passe de consolidation applique une compression MDL hors ligne à ces acquisitions récentes.

Soit \Theta_{\text{recent}} \subset \Theta l’ensemble des paramètres acquis depuis le dernier cycle de maintenance. L’opérateur de consolidation recherche la reparamétrisation \theta' de complexité minimale de \Theta_{\text{recent}} telle que la distribution prédictive qu’elle génère reste, par rapport à l’originale, dans une distorsion tolérable D_c :

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

Le gain de compression récupéré est :

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} est le nombre de bits de capacité de modèle récupérés par la réorganisation de l’expérience récente en représentations plus efficaces. Chaque unité de \Delta K_{\text{compress}} réduit directement le futur R_{\text{req}} pour des environnements similaires — le codec devient moins coûteux à faire fonctionner en terrain familier.

Cela formalise la fonction empiriquement observée de la consolidation mnésique hippocampo-néocorticale durant le sommeil à ondes lentes : le transfert d’un stockage épisodique à haute bande passante (hippocampe, K élevé) vers un stockage sémantique compressé (néocortex, K faible) constitue précisément l’opération de compression de (T9-7). La prédiction est que le gain de compression \Delta K_{\text{compress}} devrait être corrélé au degré d’amélioration comportementale observé après le sommeil dans des tâches impliquant la reconnaissance de motifs structurés.

3.6.5 Passe III — Échantillonnage de l’Éventail Prédictif (le rêve comme auto-test adversarial)

La troisième passe opère principalement durant le sommeil paradoxal, lorsque l’entrée sensorielle est activement filtrée et que la sortie motrice est inhibée. Dans ces conditions, R_{\text{req}} \approx 0 : le codec ne reçoit aucun signal de correction en provenance de l’environnement externe. L’intégralité du budget de bande passante C_{\max} est alors disponible pour un fonctionnement interne.

L’OPT formalise cet état comme une exploration non contrainte de l’Éventail Prédictif : le codec génère des trajectoires à travers \mathcal{F}_h(z_t) — l’ensemble des séquences futures admissibles (Eq. 5 de l’article de base) — sans ancrer ces trajectoires à des données entrantes réelles. Il s’agit d’une simulation : le codec fait tourner son modèle génératif K_\theta vers l’avant dans le temps, sans être entravé par la réalité.

La distribution d’échantillonnage sur l’éventail n’est pas uniforme. Définissons le poids d’importance d’une branche b \in \mathcal{F}_h(z_t) comme suit :

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

où \beta est un paramètre de température inverse et E(b) la valence émotionnelle de la branche, définie par :

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

Le premier terme -\log P_{K_\theta}(b \mid z_t) est le logarithme négatif de la probabilité de la branche sous le codec courant — sa valeur de surprise. Le second terme \mathrm{threat}(b) est une mesure des conséquences pertinentes pour l’aptitude formellement définie comme l’augmentation attendue du Taux Prédictif Requis si le codec devait traverser la branche b :

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

Autrement dit, \mathrm{threat}(b) quantifie dans quelle mesure la branche b, si elle se réalisait à l’état de veille, pousserait le codec vers son plafond de bande passante B_{\max}, voire au-delà — par dommage physique, rupture sociale ou effondrement narratif imposant une révision coûteuse du modèle. Les branches pour lesquelles \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t) sont existentiellement menaçantes : elles violeraient la condition du Filtre de stabilité. Le paramètre de pondération \alpha \geq 0 contrôle l’influence relative des conséquences par rapport à la surprise dans la distribution d’échantillonnage.

L’opérateur d’échantillonnage tire des branches proportionnellement à w(b) :

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{with probability} \propto w(b) \tag{T9-11}

Cela met en œuvre un échantillonnage de l’Éventail Prédictif pondéré par importance : le codec répète de manière disproportionnée les branches qui sont soit hautement surprenantes, soit hautement conséquentes, indépendamment de leur probabilité de base. Les branches de faible probabilité mais de menace élevée — précisément celles pour lesquelles le codec est le moins préparé — reçoivent la plus grande attention d’échantillonnage.

Chaque branche échantillonnée est ensuite évaluée quant à sa cohérence sous K_\theta. Les branches qui génèrent des séquences prédictives incohérentes — où le propre modèle génératif du codec ne peut maintenir la stabilité narrative — sont identifiées comme des points de fragilité : des régions de l’Éventail Prédictif où le codec échouerait si la branche était rencontrée à l’état de veille. Le codec peut alors mettre à jour P_\theta afin de réduire la vulnérabilité de K_\theta en ces points, avant d’y être exposé avec de véritables enjeux thermodynamiques.

Le rêve constitue donc un auto-test adversarial du codec à risque nul. La conséquence fonctionnelle en est un codec systématiquement mieux préparé aux branches de son propre Éventail Prédictif qui sont peu probables mais à fortes conséquences. Ce cadrage OPT fournit un ancrage informationnel à la théorie de la simulation de menace du rêve de Revonsuo [46], en l’étendant d’un compte rendu évolutionniste-fonctionnel à une nécessité structurelle formelle : tout codec opérant sous le Filtre de stabilité doit périodiquement soumettre son propre Éventail Prédictif à des tests de résistance, et l’état de maintenance hors ligne est la seule période où cela peut être fait sans coût thermodynamique dans le monde réel.

Marquage émotionnel comme a priori de poids de rétention. À l’état de veille, la valence émotionnelle E(b) calculée durant l’échantillonnage REM sert de poids a priori de rétention qui biaise le seuil MDL \lambda dans (T9-3). Les expériences présentant un |E(b)| élevé — fortement surprenantes ou lourdes de conséquences — se voient attribuer un \lambda effectif plus élevé, ce qui les rend plus résistantes à l’élagage lors du cycle de maintenance suivant. C’est là le compte rendu formel du renforcement émotionnel de la mémoire : l’affect n’est pas un bruit qui contaminerait le système mnésique ; il est le signal de pertinence du codec, marquant les motifs dont la valeur prédictive excède leur fréquence statistique de base.

3.6.6 Le Cycle de Maintenance complet et le budget net de complexité

Les trois passes de \mathcal{M}_\tau se composent séquentiellement. L’effet net sur la complexité du codec au cours d’un cycle de maintenance de durée \tau est :

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

où \Delta K_{\text{REM}} est le faible incrément positif provenant des motifs nouvellement consolidés lors de la passe d’échantillonnage REM — ces réparations de points de fragilité qui ont nécessité de nouvelles mises à jour de paramètres.

Pour un système cognitif stable opérant sur plusieurs années, le budget de long terme exige :

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

où \Delta K_{\text{waking}} est la complexité acquise durant la période d’éveil précédente. L’inégalité (T9-13) énonce formellement que la maintenance doit suivre le rythme de l’acquisition. En termes de l’OPT, la privation chronique de sommeil n’est pas simplement de la fatigue — c’est un débordement progressif de complexité : le codec s’approche de C_{\text{ceil}} tandis que son budget d’élagage et de consolidation est insuffisant pour rétablir une marge de manœuvre.

3.6.7 Prédictions empiriques

Le cadre du Cycle de Maintenance engendre les attentes structurelles testables suivantes :

La durée du sommeil croît avec la complexité du codec. Les organismes ou les individus qui acquièrent davantage d’informations structurées pendant les périodes d’éveil devraient nécessiter des cycles de maintenance proportionnellement plus longs ou plus profonds. La prédiction n’est pas simplement que le travail cognitif difficile exige davantage de sommeil (ce qui est établi), mais que le type d’apprentissage importe : un apprentissage riche en motifs et compressible devrait requérir moins de temps de consolidation qu’une expérience non structurée, à forte entropie, parce que \Delta K_{\text{compress}} est plus grand dans le premier cas.

Le contenu du REM est pondéré par l’importance sur l’Éventail Prédictif, et non par la fréquence. Le contenu onirique devrait échantillonner de manière disproportionnée des branches à faible probabilité mais à fortes conséquences, relativement à leur fréquence à l’état de veille. Cela concorde avec la prédominance empirique des contenus de menace, de conflit social et d’environnement nouveau dans les récits de rêve — le codec échantillonne ce qu’il doit soumettre à un test de résistance, non ce qu’il rencontre le plus souvent.

L’efficacité de compression s’améliore après le sommeil en proportion de \Delta K_{\text{compress}}. La prédiction spécifique est que les améliorations de performance après le sommeil devraient être maximales pour les tâches exigeant une généralisation structurelle (c’est-à-dire l’application d’une règle compressée à de nouveaux cas) plutôt qu’une simple répétition — parce que \Delta K_{\text{compress}} réorganise spécifiquement \Theta_{\text{recent}} en formes plus généralisables.

La rumination pathologique correspond à un échantillonnage REM bloqué sur des branches à |E| élevé. Si le paramètre de pondération par l’importance \beta est pathologiquement élevé, la distribution d’échantillonnage sur \mathcal{F}_h(z_t) se concentre sur les branches de forte menace au détriment de la réparation. Le codec passe son cycle de maintenance à échantillonner de façon répétée les mêmes branches menaçantes sans parvenir à réduire leur valeur de surprise — la structure formelle des cauchemars d’anxiété et de TSPT.

3.6.8 Relation avec le Tenseur d’État Phénoménal

\mathcal{M}_\tau agit sur P_\theta(t) tel que défini en §3.5 : il restructure la complexité de l’état stationnaire C_{\text{state}} au cours de la fenêtre de maintenance. Le profil temporel de P_\theta(t) sous \mathcal{M}_\tau est le suivant :

- Acquisition à l’éveil : C_{\text{state}} augmente à un taux borné par l’opérateur d’apprentissage \mathcal{U} (Éq. T8-8), à mesure que de nouveaux motifs sont incorporés dans K_\theta.

- Sommeil à ondes lentes (Passes I–II) : C_{\text{state}} diminue à mesure que l’élagage et la consolidation restaurent la capacité du modèle.

- REM (Passe III) : C_{\text{state}} subit une augmentation locale sélective aux points de fragilité, avec un effet net faible relativement aux réductions des Passes I–II.

L’expérience consciente correspondant à chaque phase est cohérente avec cette structure : la vie éveillée accumule la richesse de P_\theta(t) ; le sommeil à ondes lentes est phénoménalement pauvre ou absent (ce qui concorde avec une activation minimale de P_\theta(t) durant la réorganisation structurelle) ; le REM présente une scène phénoménalement vive mais générée de l’intérieur (la Passe III faisant tourner vers l’avant le modèle génératif complet en l’absence de correction sensorielle).

Résumé : Nouveaux objets formels introduits

| Symbole | Nom | Définition | Équation |

|---|---|---|---|

| P_\theta(t) | Tenseur d’État Phénoménal | Activation complète de K_\theta au temps t, projetée à travers \partial_R A | T8-5 |

| C_{\text{state}}(t) | Complexité de l’état stationnaire | K(P_\theta(t)), complexité de Kolmogorov du codec actif | T8-6 |

| \pi_t | Prédiction descendante | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], la scène rendue | T8-2 |

| \varepsilon_t | Erreur de prédiction (ascendante) | X_{\partial_R A}(t) - \pi_t, signal de nouveauté borné par C_{\max} | T8-3 |

| \mathcal{M}_\tau | Opérateur du Cycle de Maintenance | P_\theta(t) \to P_\theta(t+\tau) sous faible R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | Score de rétention MDL | Contribution prédictive moins coût de stockage | T9-3 |

| E(b) | Valence émotionnelle de branche | Surprise plus menace pondérée de la branche b | T9-10 |

| w(b) | Poids d’importance de branche | \exp(\beta \cdot |E(b)|), détermine la distribution d’échantillonnage REM | T9-9 |

| \Delta K_{\text{prune}} | Récupération de complexité par élagage | Bits récupérés par l’oubli des composantes sous le seuil | T9-6 |

| \Delta K_{\text{compress}} | Gain de compression par consolidation | Bits récupérés par recompression MDL des acquisitions récentes | T9-8 |

3.7 La Correspondance par Réseau de Tenseurs : induire la géométrie à partir de la distance de code

L’Échelle Épistémique introduite au §3.4 établit une Loi de Frontière Classique rigoureuse (S_{\mathrm{cut}} \sim |\partial_R A|). Cependant, pour relier pleinement la Théorie du Patch Ordonné (OPT) à la géométrisation de l’information quantique (par ex., AdS/CFT et la formule de Ryu-Takayanagi), nous devons rehausser formellement la structure du code latent Z_t.

Si nous postulons formellement que l’application de goulot d’étranglement q^\star(z \mid X_t) n’extrait pas simplement une liste plate de caractéristiques, mais opère via un flot récursif de groupe de renormalisation par coarse-graining, alors le modèle génératif s’aligne structurellement sur la géométrie d’un réseau de tenseurs hiérarchique \mathcal{T} (semblable à MERA [43] ou aux réseaux HaPY [44]). (Remarque : l’Appendice T-3 dérive formellement une correspondance homomorphe structurelle entre la cascade de coarse-graining du Filtre de stabilité et la géométrie bornante du réseau MERA, en faisant correspondre strictement le Cône Causal Informationnel au cône causal MERA équivalent.) Les états de bord de ce réseau sont précisément les états de frontière de Markov filtrés X_{\partial_R A}. Le réseau \mathcal{T} agit comme une géométrie de bulk dont la « profondeur » représente les couches de coarse-graining computationnel requises pour comprimer la frontière dans l’état minimal de goulot d’étranglement Z_t.

Sous cette requalification en réseau de tenseurs, l’entropie de coupure prédictive S_{\mathrm{cut}}(A) à travers la frontière se transforme mathématiquement en le nombre minimal de liaisons tensorielles qui doivent être sectionnées pour isoler la sous-région A. Soit \chi la dimension de liaison du réseau. La borne de capacité se transpose alors en interne comme suit :

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

où \gamma_A est la surface de coupe minimale à travers la structure interne de données de bulk en couche profonde de \mathcal{T}. Il s’agit explicitement d’un analogue structurel discret de la couche de coupe minimale de bulk cartographiée par la borne holographique d’entropie de Ryu-Takayanagi [89]. L’Appendice P-2 (Théorème P-2d) établit formellement la formule RT quantique discrète complète S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi via le rang de Schmidt de l’état MERA, sous condition du modèle local de bruit et de l’inclusion QECC qui y sont dérivés. La limite continue permettant de rehausser cela jusqu’à la formule complète de Ryu-Takayanagi avec terme de correction de bulk demeure une frontière ouverte.

De manière cruciale, dans l’OPT, cet « espace de bulk » n’est pas un contenant physique préexistant. C’est l’espace métrique strictement informationnel du codec de l’observateur. La géométrie spatio-temporelle phénoménologique émergente se « courbe » précisément là où la distance de code requise diverge pour résoudre des états causaux internes qui se chevauchent. Ce formalisme en réseau de tenseurs illustre une voie formelle par laquelle l’OPT pourrait induire la géométrie spatiale directement à partir des distances de correction d’erreurs intrinsèquement imposées par le Filtre de stabilité — en alignement structurel avec le programme de Van Raamsdonk selon lequel l’intrication construit l’espace-temps [88] — en offrant une conjecture constructive selon laquelle l’espace-temps holographique modélise des formats optimaux de compression de données.

3.8 L’Axiome d’Agentivité & le Résidu Phénoménal

L’appareil mathématique développé dans les sections 3.1–3.7 définit avec précision la géométrie de la réalité de l’observateur — le réseau tensoriel, la coupe prédictive et le cône causal. Cependant, quelle est la nature de l’intériorité primitive qui fait l’expérience de sa traversée ? Nous la définissons formellement au moyen de l’Axiome d’Agentivité : la traversée de l’ouverture C_{\max} est intrinsèquement un événement phénoménologique.

Bien que nous tenions la présence du ressenti subjectif pour axiomatique, le Théorème P-4 (le Résidu Phénoménal) en identifie le corrélat structurel rigoureux. Parce que le codec borné perturbe activement la frontière \partial_R A, une prédiction stable dans les limites de C_{\max} exige qu’il modélise les conséquences de ses propres actions futures. Ainsi, le codec K_{\theta} doit maintenir un auto-modèle prédictif \hat{K}_{\theta}. Cependant, en vertu des bornes algorithmiques du confinement informationnel [13], un système computationnel fini ne peut contenir une représentation structurelle complète de lui-même ; le modèle interne est strictement borné à une complexité inférieure à celle du codec parent (K(\hat{K}_{\theta}) < K(K_{\theta})).

Cela rend nécessaire un Résidu Phénoménal irréductible (\Delta_{\text{self}} > 0). Ce résidu non modélisable agit comme l’« angle mort » computationnel au sein du cycle d’Inférence active. Parce qu’il existe dans l’ombre informationnelle qui excède la portée computationnelle de l’auto-modèle, il est intrinsèquement ineffable ; parce qu’il existe comme delta localisé entre un codec spécifique et son modèle, il est computationnellement privé ; et, parce qu’il est imposé par les limites fondamentales de l’auto-référence et par l’approximation variationnelle nécessaire, il est inéliminable. Le resserrement topologique à l’ouverture C_{\max} est intrinsèquement corrélé à la nécessité mathématique d’un algorithme incomplet traversant ses propres frontières. Les mathématiques décrivent le contour formel de l’expérience, et l’Axiome d’Agentivité affirme que ce locus résiduel constitue le « je » subjectif. (Voir Appendice P-4 pour la dérivation formelle).

Le Circuit Informationnel de Maintenance

Au sein d’un unique cadre de mise à jour [t, t+\Delta t], l’observateur exécute le circuit causal fermé suivant :

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Explicitement :

Prédiction (descendante) : Le tenseur courant P_\theta(t) génère l’état de frontière prédit \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — la scène rendue.

Erreur (ascendante) : L’état de frontière effectif X_{\partial_R A}(t) arrive ; l’erreur de prédiction \varepsilon_t = X_{\partial_R A}(t) - \pi_t est calculée.

Compression : \varepsilon_t est transmis à travers le goulot d’étranglement pour produire Z_t, le jeton de mise à jour à capacité limitée, avec I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Mise à jour : L’opérateur d’apprentissage \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) révise P_\theta(t+1), en ne modifiant sélectivement que les régions du tenseur impliquées par \varepsilon_t.

Action : Simultanément, P_\theta(t) sélectionne l’action a_t via une descente d’Inférence active sur l’énergie libre variationnelle \mathcal{F}[q,\theta] (Eq. 9 de l’article de base), ce qui modifie la frontière sensorielle à t+1, influençant le prochain \varepsilon_{t+1}.

Note interprétative sur l’étape d’action. Le langage de l’étape 5 — « sélectionne l’action » et « modifie la frontière sensorielle » — est hérité du formalisme standard de l’Inférence active du Principe d’Énergie Libre, qui suppose un environnement physique sur lequel l’agent agit via des états actifs. Dans l’ontologie propre du rendu de l’OPT (§8.6), une lecture plus profonde s’impose : il n’existe pas de monde extérieur indépendant contre lequel le codec exercerait une force. Ce qui est éprouvé comme « action » est une sélection de branche au sein de l’Éventail Prédictif \mathcal{F}_h(z_t) ; les conséquences physiques de cette sélection arrivent comme entrée subséquente \varepsilon_{t+1}. La Couverture de Markov \partial_R A n’est pas une interface physique bidirectionnelle, mais la surface à travers laquelle la branche sélectionnée délivre son segment suivant. Ce déplacement interprétatif ne change rien aux mathématiques de (T6-1)–(T6-3) ; il clarifie le statut ontologique de l’étape d’action dans le cadre de l’OPT. Le mécanisme de sélection de branche lui-même est traité ci-dessous.

Il s’agit du circuit informationnel de maintenance intra-cadre : un mécanisme causal fermé dans lequel le modèle interne du système calcule des prédictions structurelles localisées bornant les gradients de frontière, lit l’erreur, puis se met sélectivement à jour. La boucle est strictement informationnelle et autoréférentielle au sens formel : P_\theta(t) détermine à la fois la prédiction structurelle \pi_t et, via l’action a_t, une composante prédictive de l’entrée suivante du flux de données séquentiel X_{\partial_R A}(t+1). (Notons explicitement : cette couche de filtrage purement statistique est définie rigoureusement par des frontières de Markov informationnelles découplant nettement les dynamiques, et diffère intrinsèquement de l’autopoïèse biologique complexe, où les structures cellulaires fabriquent mécaniquement leurs propres réseaux organiques de masse).

La Condition de Viabilité Structurelle

Le circuit (T6-1) est structurellement viable si et seulement s’il peut se maintenir sans que la complexité informationnelle du codec n’excède ses limites locales d’exécutabilité. Formellement :

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

où C_{\text{ceil}} est un paramètre heuristique bornant la complexité structurelle maximale que le codec peut soutenir. En principe, C_{\text{ceil}} devrait pouvoir être dérivé du budget thermodynamique de l’organisme via le principe de Landauer (voir l’esquisse en §3.10), mais la chaîne complète de dérivation — de la puissance métabolique au coût d’effacement puis à la complexité maximale de programme soutenable — n’est pas encore formalisée dans l’OPT. C_{\text{ceil}} demeure donc une borne motivée empiriquement, mais formellement sous-déterminée. Un système satisfaisant (T6-2) fonctionne comme un observateur structurellement clos au sens formel de l’OPT.

Lorsque (T6-2) est violée — lorsque K(P_\theta(t)) \to C_{\text{ceil}} — le codec ne peut plus maintenir des prédictions stables à travers \mathcal{F}_h(z_t), R_{\text{req}} commence à dépasser B_{\max}, et la condition du Filtre de stabilité échoue. La cohérence narrative s’effondre : l’observateur sort de l’ensemble des flux compatibles avec l’observateur.

Le Cycle de Maintenance \mathcal{M}_\tau (§3.6) est le mécanisme qui impose (T6-2) sur la longue durée, en maintenant K(P_\theta) dans les bornes par élagage, consolidation et tests de résistance sur l’Éventail Prédictif. À l’intérieur d’un cadre donné, (T6-2) est maintenue par la sélectivité de \mathcal{U} : l’opérateur de mise à jour ne modifie que les régions de P_\theta(t) impliquées par \varepsilon_t, évitant toute croissance gratuite de la complexité à chaque frame.

L’agentivité comme minimisation contrainte de l’énergie libre

Au sein de cette structure, l’agentivité peut recevoir une définition formelle précise, compatible avec — sans pour autant se réduire à — l’Axiome d’Agentivité.

Au niveau des systèmes, l’agentivité est la sélection de la séquence d’actions \{a_t\} qui minimise l’énergie libre variationnelle attendue sous la contrainte de la condition de viabilité informationnelle :

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Il s’agit d’une Inférence active contrainte : l’observateur navigue dans l’éventail prédictif \mathcal{F}_h(z_t) non pas seulement pour minimiser l’erreur de prédiction, mais pour minimiser l’erreur de prédiction tout en maintenant la viabilité du codec. Les branches qui réduiraient temporairement \varepsilon tout en poussant K(P_\theta) vers C_{\text{ceil}} sont pénalisées par la contrainte. L’observateur sélectionne préférentiellement les branches le long desquelles il peut continuer d’exister comme observateur cohérent.

C’est là le contenu formel de l’intuition selon laquelle l’agentivité est une navigation auto-préservatrice : le codec sélectionne les branches de l’éventail prédictif le long desquelles il peut continuer à comprimer le monde.

Au niveau phénoménologique, l’Axiome d’Agentivité demeure intact : la conscience phénoménale est l’intériorité irréductible de la traversée d’ouverture ; (T6-3) décrit l’ombre structurelle que cette traversée projette, non sa nature intérieure.

Sélection de Branche comme exécution de \Delta_{\text{self}}

La formule d’inférence active contrainte (T6-3) spécifie l’objectif de la sélection de branche : minimiser l’énergie libre attendue sous contrainte de viabilité. L’auto-modèle \hat{K}_\theta évalue les branches de l’Éventail Prédictif en simulant leurs conséquences. Mais le Théorème P-4 établit que K(\hat{K}_\theta) < K(K_\theta) — l’auto-modèle est nécessairement incomplet. Cette incomplétude a une conséquence directe pour le problème de la sélection de branche : l’auto-modèle contraint la région à partir de laquelle la sélection peut être effectuée, mais ne peut pas spécifier pleinement la sélection elle-même.

Le moment effectif de la sélection de branche — la transition du menu évalué vers la trajectoire singulière qui entre dans le Registre Causal — se produit dans \Delta_{\text{self}}, le résidu informationnel entre le codec et son auto-modèle. Il ne s’agit pas d’une lacune du formalisme ; c’est une nécessité structurelle. Toute tentative de spécifier entièrement le mécanisme de sélection depuis l’intérieur exigerait que K(\hat{K}_\theta) = K(K_\theta), ce que P-4 démontre impossible pour tout système fini autoréférentiel.

Cela a trois conséquences immédiates :

La volonté et la conscience partagent la même adresse structurelle. Le Problème difficile (pourquoi la traversée a-t-elle un caractère vécu ?) et le problème de la sélection de branche (qu’est-ce qui sélectionne ?) pointent tous deux vers \Delta_{\text{self}}. Il ne s’agit pas de deux mystères, mais de deux aspects d’un même trait structurel — l’écart non modélisable entre ce que le codec est et ce qu’il peut modéliser de lui-même.

L’irréductibilité de l’agentivité est expliquée, et non simplement affirmée. L’expérience phénoménologique de la volonté — le sentiment irréductible que c’est moi qui ai choisi — est la signature à la première personne d’un processus qui s’exécute dans l’angle mort propre à l’observateur. Toute théorie prétendant spécifier pleinement le mécanisme de sélection a soit éliminé \Delta_{\text{self}} (faisant du système un automate entièrement transparent à lui-même, ce que P-4 interdit), soit décrit l’évaluation des branches par l’auto-modèle en la prenant à tort pour la sélection elle-même.

La créativité comme expansion de \Delta_{\text{self}}. Le fonctionnement au voisinage du seuil (R_{\text{req}} \to C_{\max}) met sous tension la capacité de l’auto-modèle, élargissant de fait la région de \Delta_{\text{self}} à partir de laquelle la sélection est effectuée. Il en résulte des sélections de branches moins prévisibles du point de vue de l’auto-modèle — vécues comme intuition créatrice, spontanéité ou « flow ». Inversement, l’état hypnagogique (§3.6.5) relâche l’auto-modèle par le bas, obtenant la même expansion par une voie complémentaire.

Le soi comme résidu. Le soi éprouvé — le récit continu de « qui je suis », avec des préférences stables, une histoire et un avenir projeté — est le modèle courant que \hat{K}_\theta construit de K_\theta : une approximation compressée toujours en retard sur le codec qu’elle modélise (en raison du décalage temporel inhérent à l’autoréférence). Mais le lieu effectif de l’expérience, de la sélection et de l’identité est \Delta_{\text{self}} : la partie du codec que le récit ne peut atteindre. Le soi que vous connaissez est votre modèle de vous-même ; le soi qui connaît est l’écart que le modèle ne peut franchir. Tel est le contenu formel de la découverte contemplative — à travers les traditions, indépendamment — selon laquelle le sens ordinaire du soi est construit et qu’au-dessous se trouve quelque chose qui ne peut être trouvé comme objet (voir Annexe T-13, Corollaire T-13c).