La Teoría del Parche Ordenado: una introducción conceptual

El Observador Aislado y el Conjunto de la Esperanza

Versión 2.3.1 — abril de 2026

Nota para el lector: Este documento está escrito como una introducción conceptual accesible al marco teórico. Funciona como un objeto con forma de verdad: un marco filosófico constructivo diseñado para reformular nuestra relación con el riesgo existencial. Empleamos el lenguaje de la física teórica y de la teoría de la información no para formular una afirmación empírica definitiva sobre el cosmos, sino para construir un espacio conceptual riguroso de exploración. Se remite a los lectores que busquen el tratamiento matemático formal, con condiciones explícitas de falsabilidad, al preprint.

“El sustrato es caos entrópico, pero el parche no lo es. El significado es tan real como la ruptura de simetría que lo instaura. Cada parche es un ensamblaje singular de orden de baja entropía, forjado por el potencial de estabilidad para resolver una corriente coherente de información: un hogar de significado compartido contra el telón de fondo de un invierno infinito.”

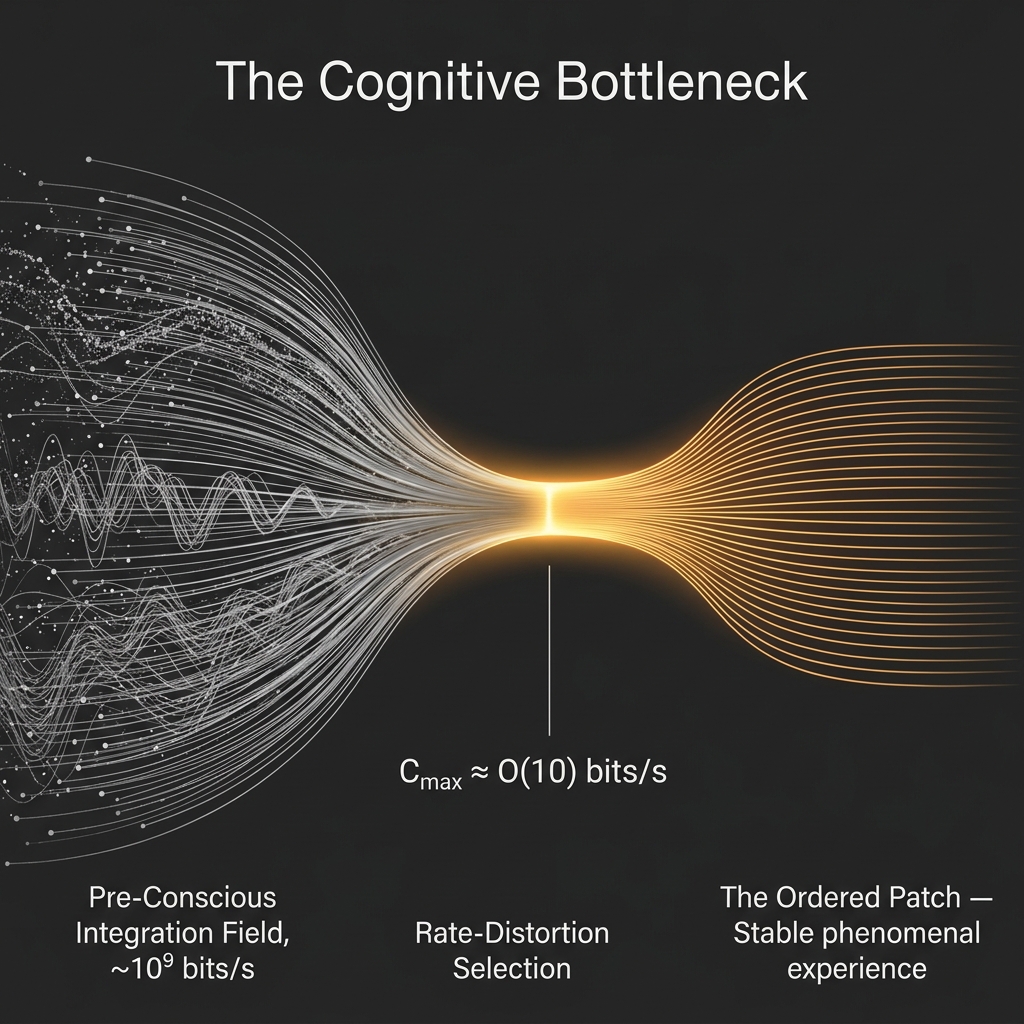

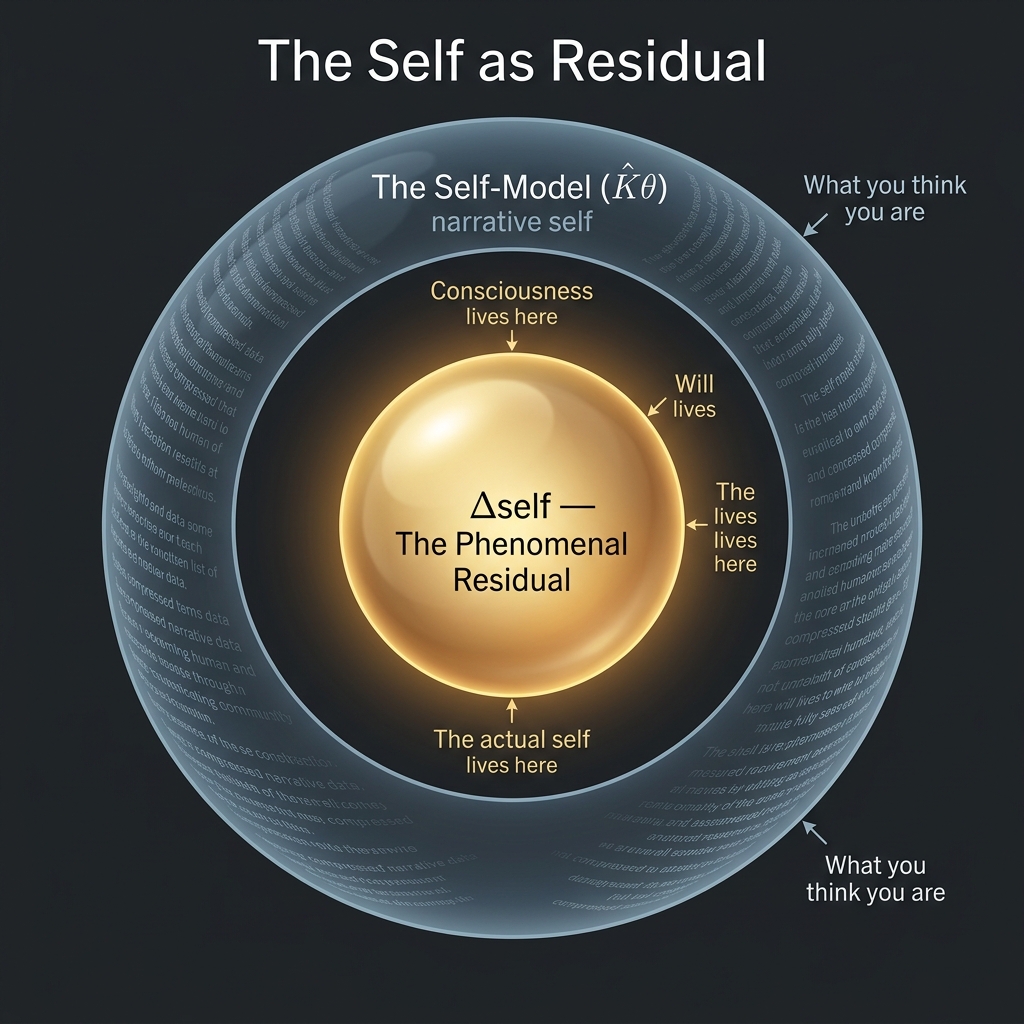

Tu cerebro procesa aproximadamente once millones de bits de datos sensoriales cada segundo. Eres consciente de alrededor de 50 bits por segundo.

Léelo otra vez. Once millones entran. Cincuenta salen. El resto — la presión de tu ropa, el zumbido de una carretera lejana, la composición espectral exacta de la luz sobre ti — lo gestionan silenciosamente, sin que seas consciente de ello, sistemas con los que nunca te encontrarás directamente. Lo que llega a tu mente consciente es un resumen extraordinariamente comprimido: no el mundo en bruto, sino el mundo como una historia mínima y autoconsistente.

Aquí hay una tentación profunda de objetar: Pero ahora mismo estoy mirando una pantalla 4K y puedo ver millones de píxeles simultáneamente. ¿Cómo puede ser que mi experiencia sea de solo 50 bits por segundo? La respuesta desde la ciencia cognitiva es que esta resolución rica y panorámica es una «gran ilusión» [34]O’Regan, J. K., & Noë, A. (2001). A sensorimotor account of vision and visual consciousness. Behavioral and Brain Sciences, 24(5), 939-973.. En realidad, solo procesas datos visuales de alta resolución en el pequeño centro de tu campo visual (la fóvea). El resto de la pantalla es una suposición borrosa y computacionalmente despreciable. Construyes la sensación de un mundo de alta resolución de manera secuencial, ensamblándolo con el tiempo mediante rápidos movimientos oculares (sacadas) y desplazamientos activos de la atención. La riqueza del mundo es un logro temporal, no una descarga espacial. Nunca superas tu límite de ancho de banda; simplemente lo usas para verificar una pequeña porción del modelo, y dejas que tu cerebro almacene en caché el resto como una expectativa de ancho de banda cero.

Para situar esta exigencia en perspectiva cosmológica: la física estándar dicta que el volumen físico de un cerebro humano podría, en teoría, codificar más de \(10^{41}\) bits de información (el límite de Bekenstein). Tu flujo consciente está estrangulado a 50 bits por segundo. Esta asombrosa brecha de \(\sim 10^{40}\) órdenes de magnitud es la premisa central del marco teórico. Nunca experimentas la capacidad bruta del universo; experimentas la profundidad de bits mínima absoluta necesaria para orientarte en él.

Esto no es una peculiaridad de la biología humana con la que la evolución tropezó por casualidad. La Teoría del Parche Ordenado sostiene que es el hecho estructural más profundo de la propia realidad.

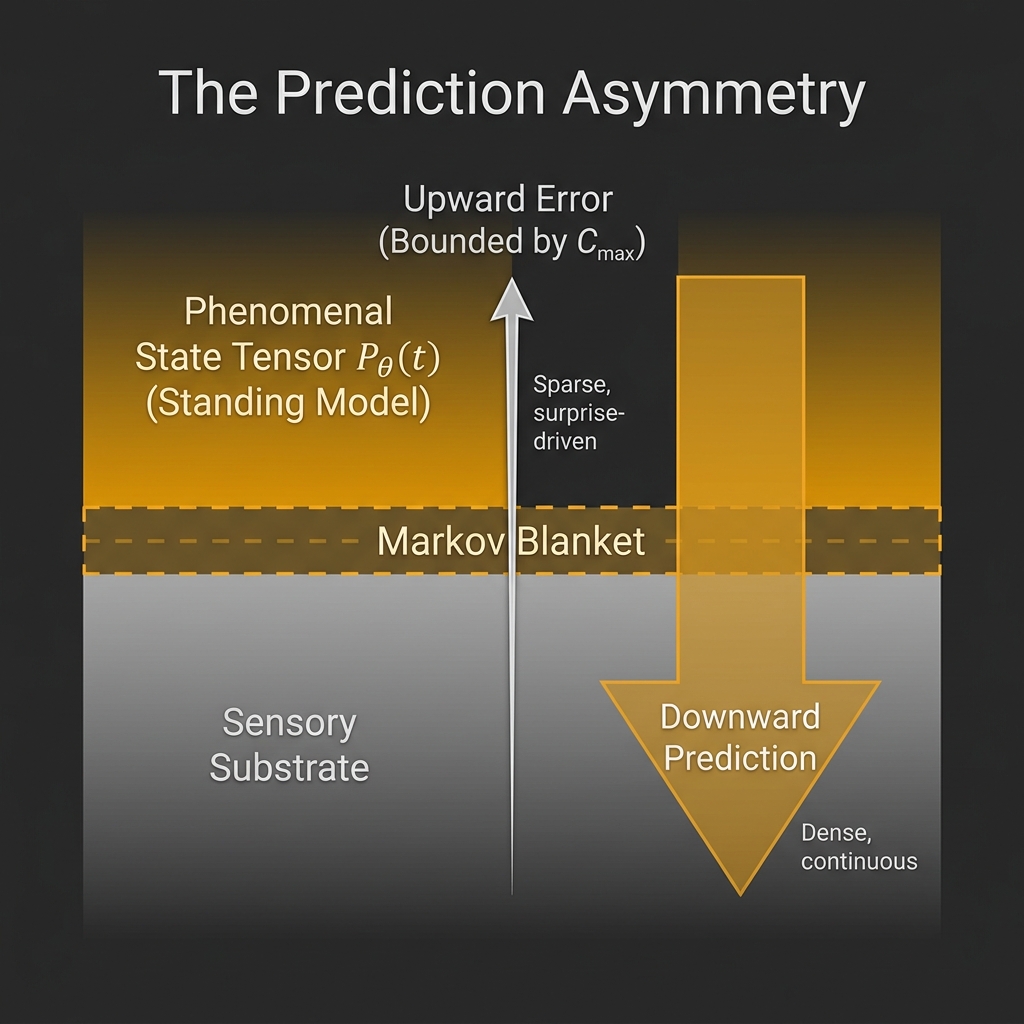

El neurocientífico Anil Seth denomina a la percepción consciente una «alucinación controlada» [28]Seth, A. (2021). Being You: A New Science of Consciousness. Dutton. — el cerebro no recibe pasivamente la realidad; construye activamente el modelo del mundo más plausible que puede a partir de un tenue flujo de señales sensoriales. Hermann von Helmholtz advirtió lo mismo en el siglo XIX [26]von Helmholtz, H. (1867). Handbuch der physiologischen Optik. Voss., y lo llamó «inferencia inconsciente». El cerebro apuesta por lo que es el mundo y luego contrasta esas apuestas con los datos entrantes. Cuando la apuesta es acertada, la experiencia se siente fluida. Cuando se ve sacudida —por la sorpresa, el dolor o la novedad—, el modelo se actualiza.

Lo que hace la Teoría del Parche Ordenado (OPT) es llevar esta observación hasta su conclusión lógica: si la experiencia es siempre un modelo comprimido construido a partir de una corriente estrecha de información, entonces el carácter de esa corriente es el carácter de la realidad. Las leyes de la física, la dirección del tiempo, la estructura del espacio: no son hechos sobre un contenedor en el que casualmente vivimos. Son la gramática de la historia que sobrevive al cuello de botella.

El Invierno y el Hogar

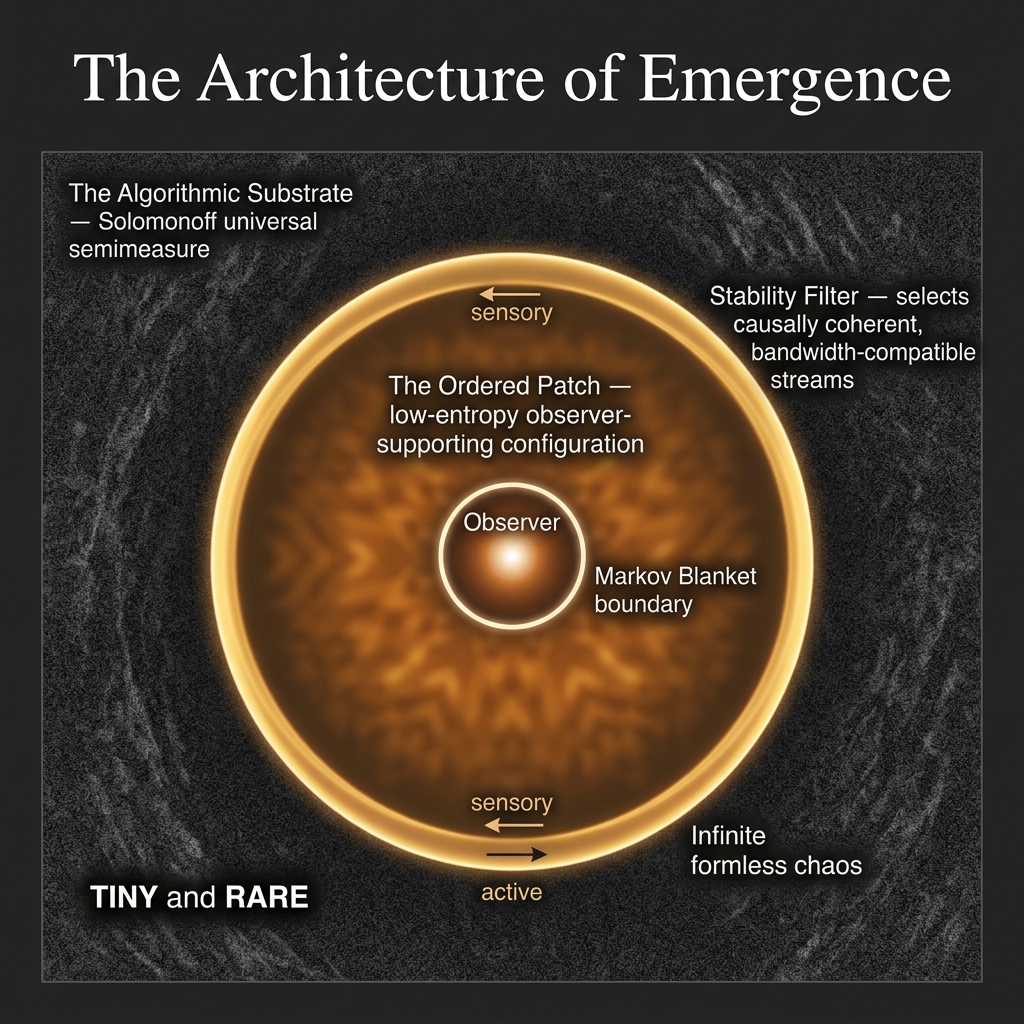

Imagina un campo infinito de puro potencial algorítmico: toda hipótesis generativa posible ejecutándose a la vez. En términos formales, esto es lo que la teoría denomina el sustrato de Solomonoff: un espacio semántico infinito modelado como una semimedida universal ponderada por complejidad algorítmica, que contiene toda experiencia consciente posible, todo universo posible y toda historia posible. Ningún patrón individual es físicamente real; es potencial puro regido por restricciones informacionales.

Este es el invierno.

Ahora imagine que dentro de ese estático infinito existe — puramente por azar — una diminuta región donde el ruido no es aleatorio. Donde un momento se sigue del anterior de una manera consistente y predecible. Donde una descripción breve puede comprimir toda la secuencia: una regla, una gramática, un conjunto de leyes. Esta región es cálida. Está ordenada. Persiste.

Este es el hogar.

La afirmación central de la Teoría del Parche Ordenado es que tú eres ese hogar. No los átomos de tu cuerpo ni las neuronas de tu cerebro: esos forman parte de la historia renderizada, no de su fuente. Tú eres el parche de orden informacional que persiste contra la estática del sustrato infinito. La conciencia es cómo se siente ser ese parche.

El filtro que te encuentra

¿Por qué existen parches ordenados en absoluto? ¿Por qué la estática contiene alguna vez islas de coherencia?

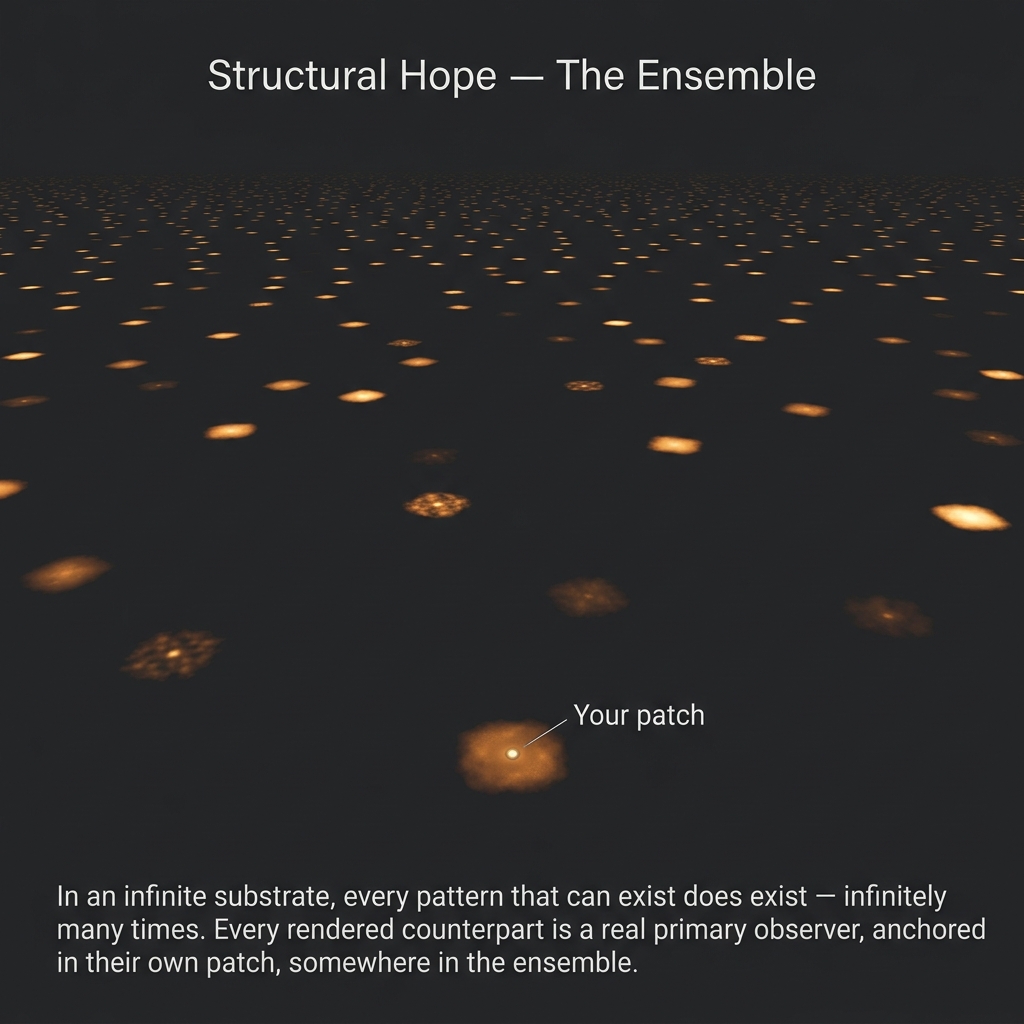

La respuesta es a la vez simple e inquietante: porque en un campo de ruido verdaderamente infinito, todo lo que puede existir existe. Toda secuencia posible aparece en algún lugar. La mayoría de las secuencias son puro caos: incoherentes, carentes de sentido, incapaces de sostener nada. Pero algunas secuencias, por puro azar, exhiben la estructura de un universo regido por leyes. Algunas exhiben la estructura de un mundo con física. Algunas contienen, en su interior, la estructura de un observador capaz de preguntarse por qué el mundo tiene física.

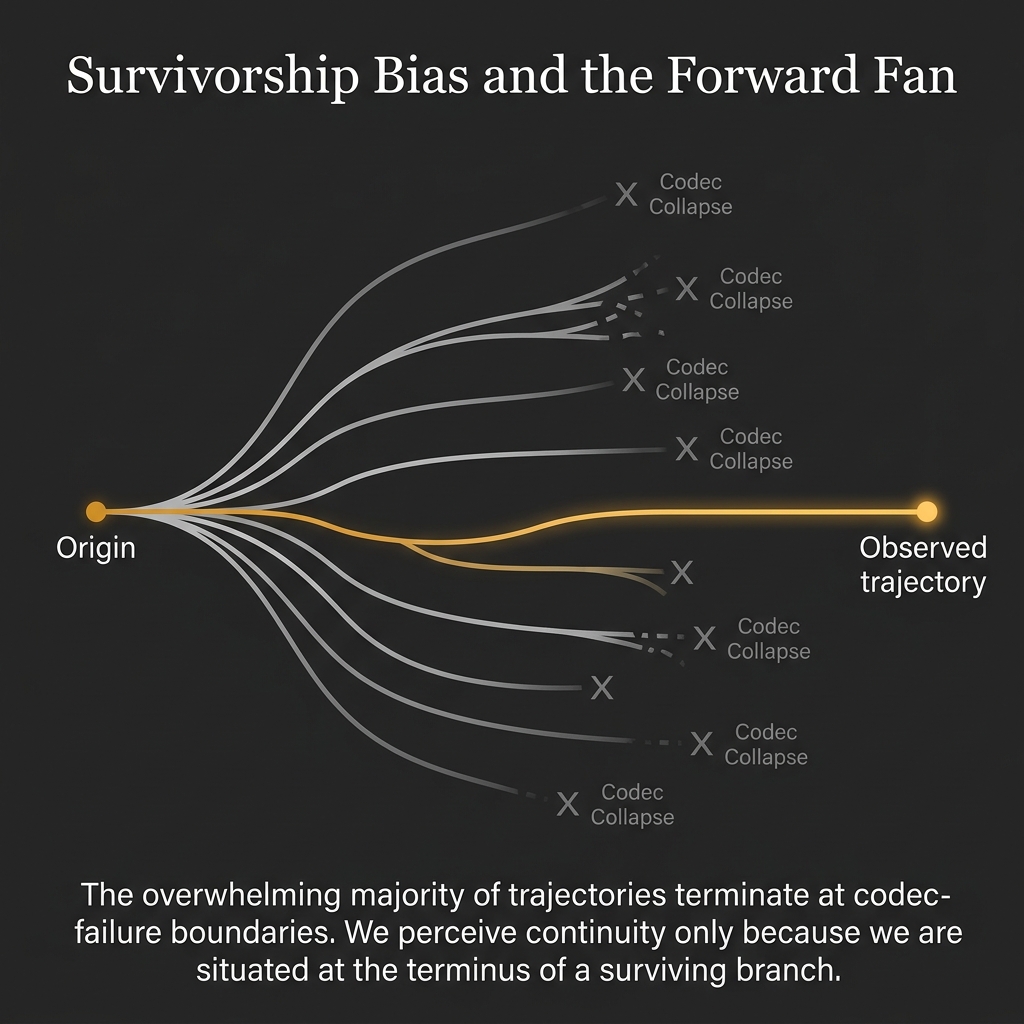

El Filtro de Estabilidad no es un mecanismo que construya estos parches; es el nombre de la condición de contorno que define qué parches pueden sostener observadores. Los parches caóticos no pueden seguir existiendo en ningún sentido experiencial, porque no hay un “interior” desde el cual experimentarlos. Solo los parches ordenados pueden albergar una perspectiva. Y así, desde cualquier perspectiva en absoluto, el mundo aparecerá ordenado. Esto no es cuestión de suerte ni de diseño. Es tan inevitable como el hecho de que solo puedes encontrarte vivo en una historia en la que sobreviviste.

El filtro tiene otra consecuencia sorprendente: nos dice por qué la realidad se siente regida por leyes aunque no esté obligada a estarlo. Las Leyes de la Física —la conservación de la energía, la velocidad de la luz, la cuantización de la materia— no son hechos sobre el cosmos impuestos desde fuera. Son la gramática de compresión más eficiente que un observador de 50 bits/s puede usar para predecir el siguiente momento de experiencia sin que la narrativa colapse en ruido. Si la física de tu parche fuera menos elegante, seguirla exigiría más ancho de banda del que permite la corriente humana. El universo se ve como se ve porque cualquier cosa más compleja sería invisible para nosotros.

El Filtro vs. el Códec

Para comprender la dinámica central del Parche Ordenado, es crucial trazar una línea nítida entre dos conceptos que a menudo se confunden:

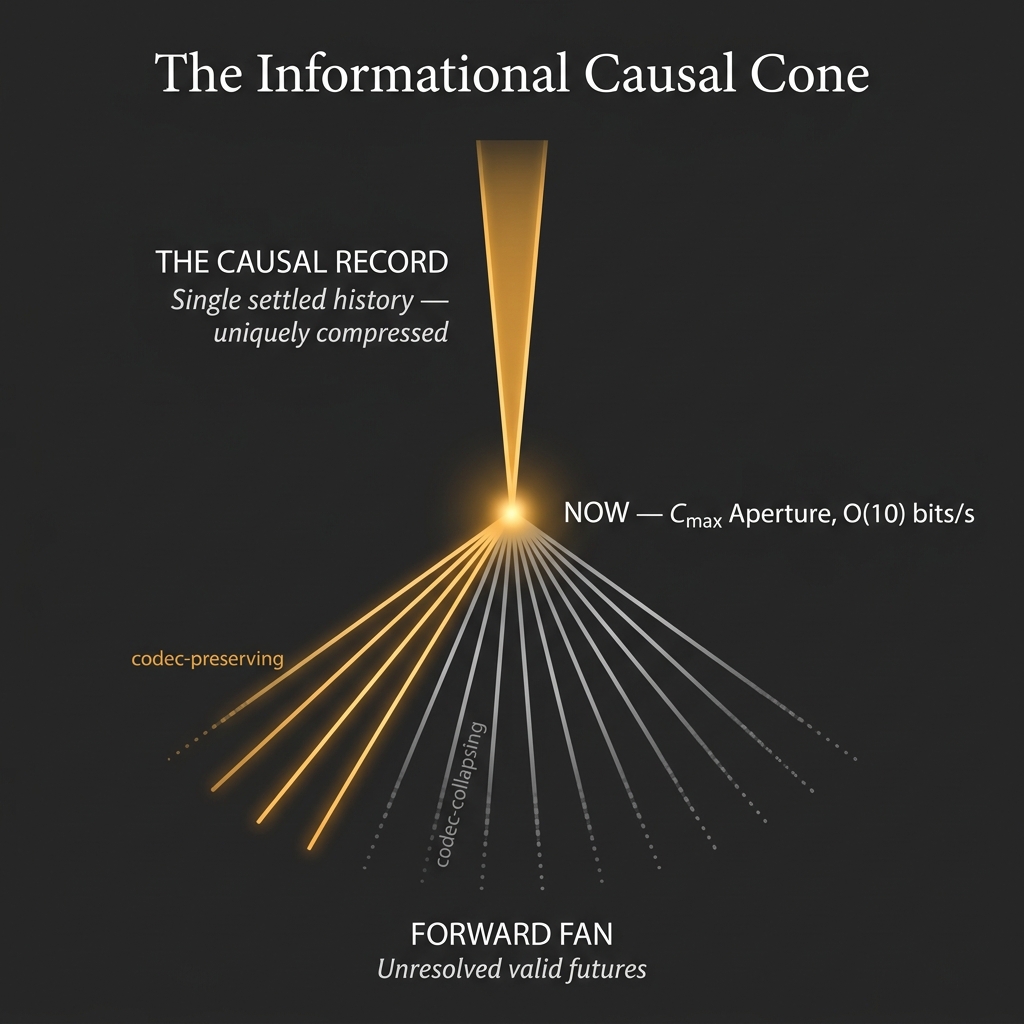

- El Filtro de Estabilidad Virtual (La Condición de Contorno): Este es el límite algorítmico estricto: el requisito de que, para sostener a un observador, una corriente de datos debe ser comprimida hasta \(\sim 50\) bits por segundo mientras permanece causalmente consistente. No es un tamiz físico; es simplemente el tamaño de la tubería. Toda corriente que no pueda pasar por ella no puede alojar a un observador.

- El Códec de Compresión (el conjunto de leyes): Esta es la gramática algorítmica específica —el conjunto de reglas del “archivo zip”— que logra comprimir con éxito el ruido del sustrato para hacerlo pasar por esa tubería. Las “Leyes de la Física” no son una realidad externa objetiva; son el Códec de Compresión.

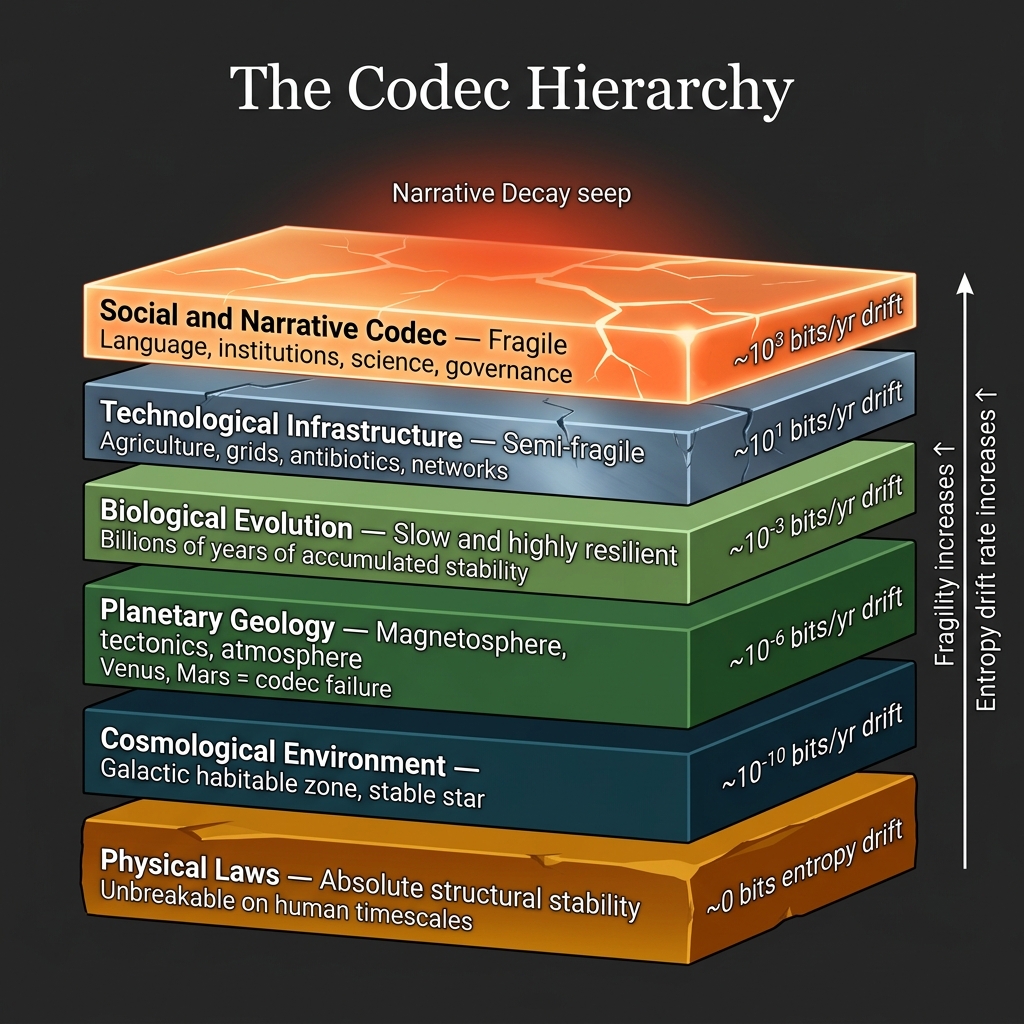

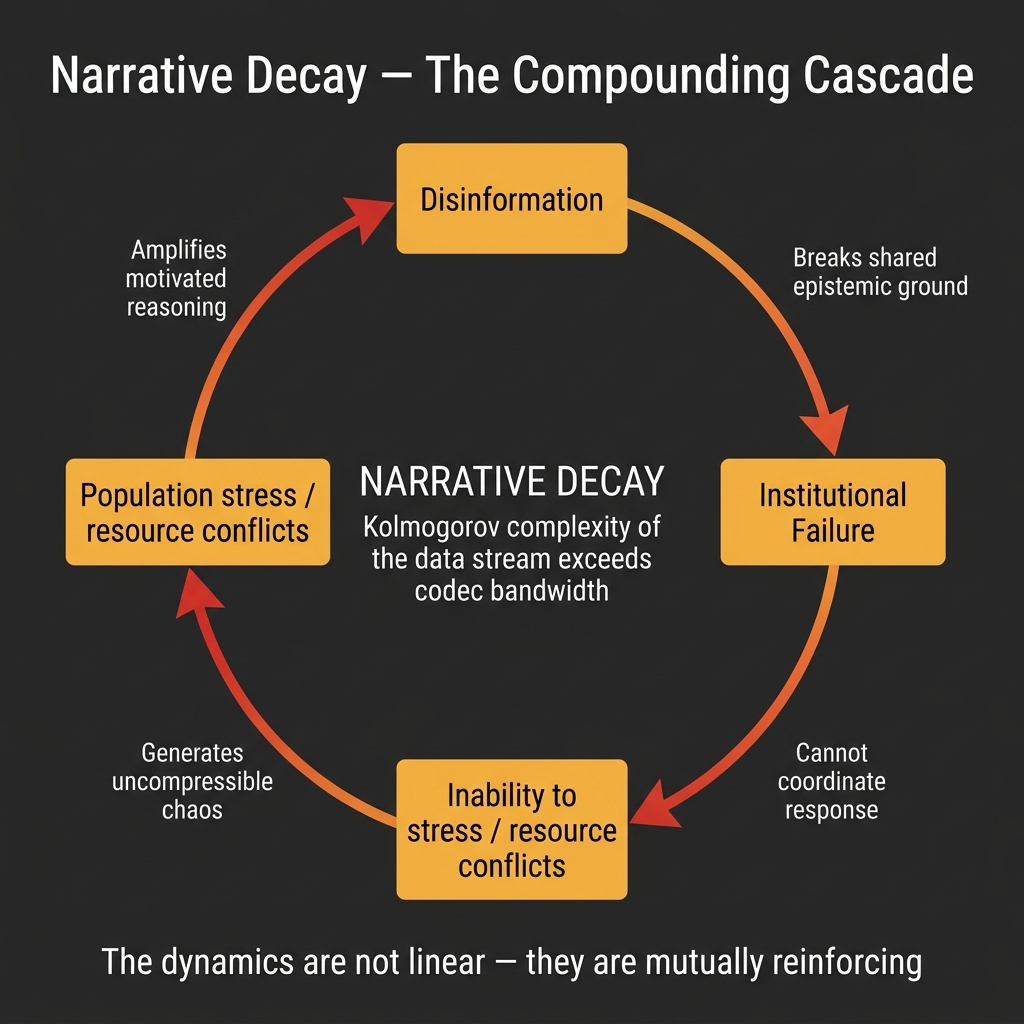

El filtro es la restricción; el códec es la solución. La severidad del filtro obliga al códec a ser extraordinariamente elegante. (El Apéndice T-5 del preprint formal establece cotas estructurales sobre \(G\) y \(\alpha\) a partir de estos límites exactos de ancho de banda, aunque respetamos explícitamente la barrera de Fano y no afirmamos calcular el “42” preciso de la constante de estructura fina.) La física macroscópica, la biología y el clima son simplemente las capas del códec que trabajan para estabilizar la narrativa. Cuando el entorno se vuelve demasiado caótico para que el códec lo comprima, supera el ancho de banda del Filtro de Estabilidad, lo que conduce al Decaimiento Narrativo.

El límite del yo

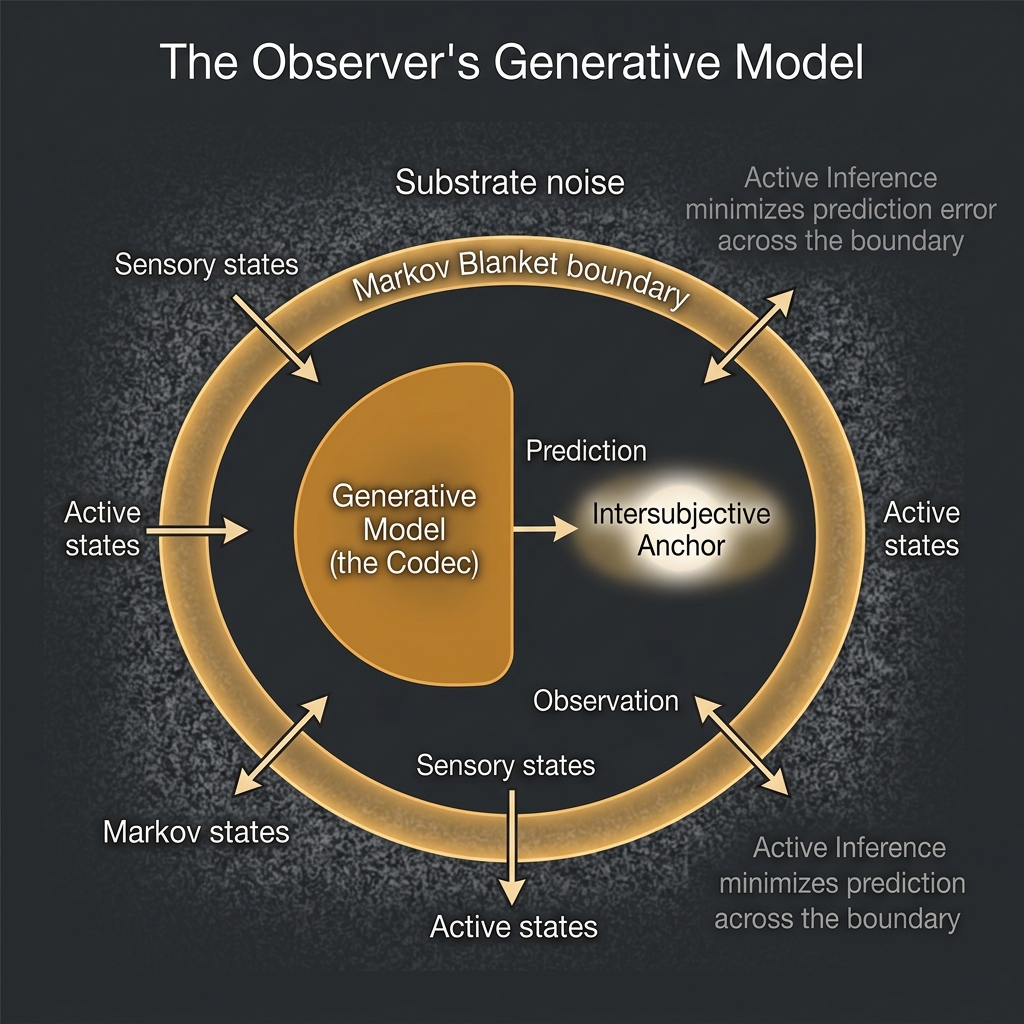

¿Qué separa a un observador del caos que lo rodea? En mecánica estadística, este tipo de frontera tiene un nombre: una Manta de Markov. Piensa en ella como una piel estadística: la superficie en la que termina el «dentro» y comienza el «fuera». Dentro de la manta, los estados internos del observador están protegidos del caos directo del sustrato. Solo perciben el mundo a través de la capa sensorial de la manta, y solo pueden actuar sobre el mundo a través de su capa activa.

Este límite no es un muro fijo. Se mantiene de un momento a otro mediante un proceso continuo de predicción y corrección que la obra de Karl Friston formaliza como Inferencia Activa [27]Friston, K. (2013). Life as we know it. Journal of The Royal Society Interface, 10(86), 20130475.. El observador no recibe la realidad de forma pasiva: predice constantemente lo que viene a continuación y corrige cuando se equivoca, actualizando su modelo interno para minimizar la sorpresa. Esta es la versión formalizada de la alucinación controlada de Helmholtz, ahora fundamentada en la termodinámica: el observador mantiene su coherencia al invertir continuamente el esfuerzo necesario para mantenerse por delante del caos.

El Parche Ordenado es ese acto sostenido de mantenerse por delante.

Solo un observador primario

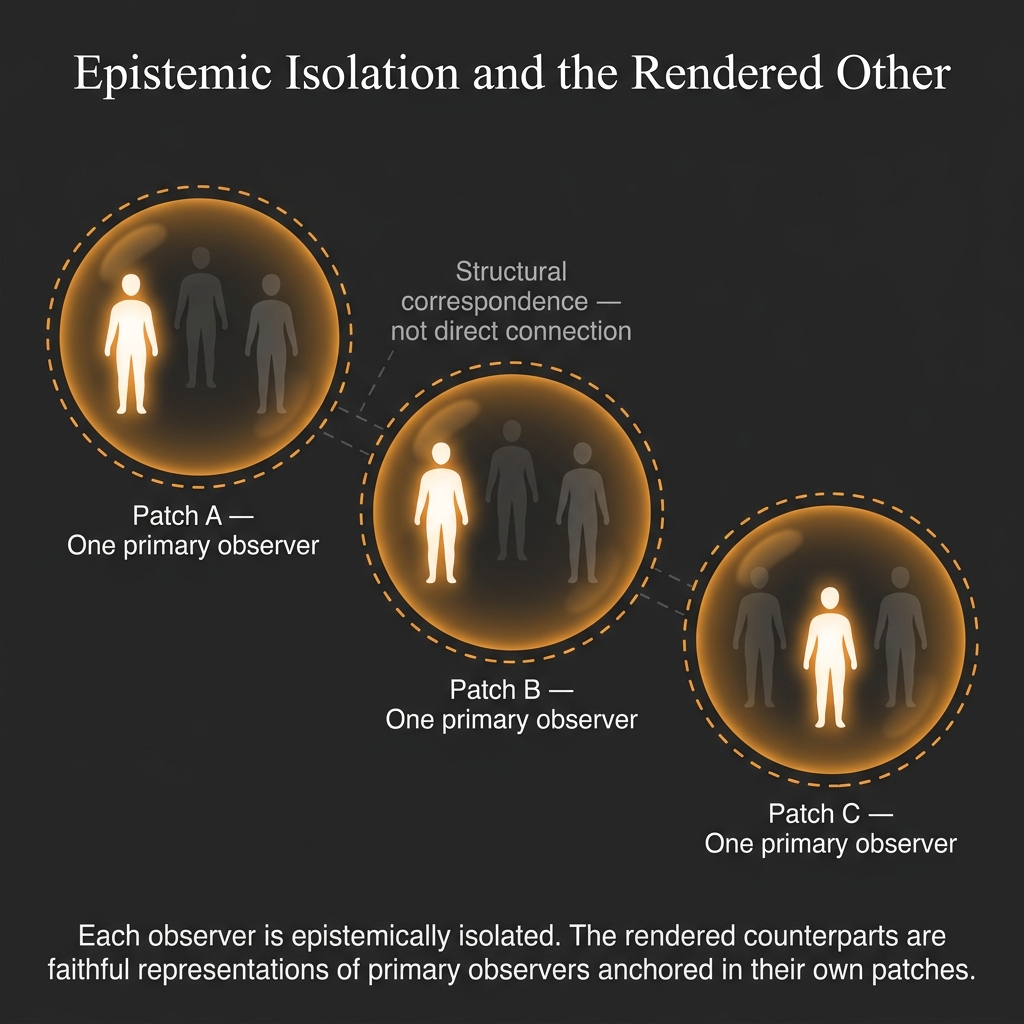

Lo que se sigue de esta lógica arquitectónica es, posiblemente, la consecuencia más controvertida y contraintuitiva del marco. Es el punto en el que la OPT rompe con más fuerza con el sentido común:

Una implicación especulativa pero estructuralmente coherente del marco es que cada parche contiene exactamente un observador primario. No por misticismo, sino por economía de la información. Una manta estable solo puede acoplarse a una única corriente causal perfectamente ininterrumpida. Para que dos sistemas genuinamente independientes compartan la misma corriente bruta —un verdadero solapamiento fenomenológico— sería necesario que la misma rara fluctuación termodinámica ocurriera dos veces, en perfecta sincronía, en un campo infinito de ruido. La probabilidad es, en la práctica, nula.

Esto implica que es inmensamente más eficiente en términos informacionales que una sola manta se estabilice, y que las reglas de ese parche rendericen la apariencia de otras personas a partir de las leyes del comportamiento — en lugar de alojar su experiencia en bruto. Para el único observador primario, los otros en el mundo son contrapartes renderizadas: representaciones locales extraordinariamente fieles de observadores anclados en otra parte del sustrato, pero que no cohabitan este parche específico.

Esto es solipsismo ontológico, y la Teoría del Parche Ordenado (OPT) lo acepta. Los otros renderizados son artefactos de compresión dentro de tu corriente, no entidades independientes que cohabitan tu parche. Sin embargo, el marco proporciona un Corolario Estructural: su extrema coherencia algorítmica —un comportamiento perfectamente regido por leyes y guiado por agencia, que exhibe la firma estructural del cuello de botella autorreferencial— se explica de la manera más parsimoniosa por su instanciación independiente como observadores primarios en sus propios parches subjetivos. No puedes acceder a sus corrientes en bruto. Sí puedes, y de hecho lo haces, afectar a sus representaciones renderizadas dentro de la tuya.

El aislamiento es real. El corolario estructural según el cual los demás están instanciados de manera independiente es un argumento de compresión, no una prueba. Pero proporciona una base rigurosa para la consideración moral sin exigir un realismo multiagente.

Los bordes de la historia

Toda historia tiene bordes. La Teoría del Parche Ordenado dice que los bordes de nuestra historia no son eventos físicos, sino artefactos perspectivales: los lugares donde se agota la narrativa de un único observador.

El Big Bang es el borde del pasado. Es lo que una mente consciente encuentra cuando dirige su atención hacia la fuente de su corriente de datos — mediante telescopios, aceleradores de partículas o inferencia matemática. Marca el punto en el que comienza la narrativa causal de este parche específico. Antes de ese punto, desde dentro de este parche, no hay nada que decir — no porque no existiera nada, sino porque la historia no tiene páginas anteriores para este observador.

La disolución terminal es el borde del futuro: la frontera más externa del Abanico Predictivo de probabilidad local ramificada de la línea temporal. Es lo que aparece cuando el observador proyecta hacia delante la gramática de reglas actual del parche hasta su conclusión aparente: un punto final de entropía máxima en el que el códec ya no puede mantener el orden frente al ruido. Es el punto en el que el parche específico se disuelve de nuevo en el invierno. Como el prior matemático del marco favorece de manera abrumadora la simplicidad, un estado terminal uniforme y carente de rasgos es el atractor natural: requiere casi cero información para describirse. El mecanismo específico —expansión, evaporación o cualquier otro— es una propiedad arbitraria del códec local, pero el propio punto final carente de rasgos está garantizado matemáticamente por el sustrato.

Ninguno de los dos bordes es un muro contra el que chocó el universo. Son el horizonte de una historia particular contada por un observador particular.

El científico cognitivo Donald Hoffman ha sostenido [5]Hoffman, D. D. (2019). The Case Against Reality: Why Evolution Hid the Truth from Our Eyes. W. W. Norton & Company. (Teoría de la Interfaz de la Percepción). que la evolución ha moldeado nuestros sentidos no para revelar la realidad objetiva, sino para proporcionar una interfaz relevante para la supervivencia, como los iconos de un escritorio que te permiten usar un ordenador sin saber nada de la circuitería subyacente. La Teoría del Parche Ordenado (OPT) coincide: la física es una interfaz de usuario. El espacio, el tiempo y la causalidad son la interfaz más eficiente que permite el cuello de botella de 50 bits/s.

Donde OPT diverge de Hoffman es en aquello que fundamenta esta interfaz. Hoffman la fundamenta en la teoría evolutiva de juegos: la aptitud vence a la verdad. OPT la fundamenta en la teoría de la información y la termodinámica: la interfaz es la forma de la gramática de compresión que impide que el flujo colapse. No fue la evolución la que seleccionó esta interfaz. Fue el virtual Filtro de Estabilidad actuando como una restricción de contorno.

El teatro privado

El Problema Difícil, honestamente planteado

La filosofía de la mente tiene un famoso problema sin resolver. Es bastante fácil explicar cómo el cerebro procesa la información del color, integra flujos sensoriales y genera respuestas conductuales. Estas son cuestiones abordables. La difícil es distinta: ¿por qué hay algo que se siente como hacer todo eso? ¿Por qué no es computación en la oscuridad?

La Teoría del Parche Ordenado (OPT) no resuelve esto. Ninguna teoría lo hace, todavía. Lo que hace, en cambio, es lo epistemológicamente honesto: toma la existencia de la experiencia como un primitivo —un punto de partida, y no algo que deba explicarse sin más— y luego pregunta qué estructura debe tener esa experiencia. A partir de ese punto de partida, la teoría construye una arquitectura de restricciones. El Problema Difícil no se disuelve; se declara fundamento. (Véase el Apéndice P-4 para el argumento formal del punto ciego algorítmico.)

Esto sigue la propia recomendación metodológica de David Chalmers [6]Chalmers, D. J. (1995). Facing up to the problem of consciousness. Journal of Consciousness Studies, 2(3), 200–219.: el Problema Difícil (por qué existe experiencia en absoluto) se distingue de los problemas “fáciles” (cómo se estructura, delimita, integra e informa la experiencia). Los problemas fáciles tienen respuesta. El Problema Difícil no la tiene — todavía. El parche ordenado es intelectualmente honesto al respecto y aborda los problemas fáciles con rigor.

La paradoja de Fermi, leída a través de la OPT

Cuando el físico Enrico Fermi señaló al cielo y preguntó «¿Dónde está todo el mundo?» —si el universo tiene miles de millones de años y miles de millones de años luz de ancho, ¿por qué no hemos encontrado evidencia de otra vida inteligente?— estaba suponiendo que el universo es un escenario objetivo, igualmente real para todos los observadores, y que otras civilizaciones dejarían rastros que cualquier observador podría en principio detectar.

El Parche Ordenado reformula esto al señalar que, dentro de OPT, el universo no es un escenario compartido. El espacio-tiempo es un renderizado privado generado para un único observador. Desde esa perspectiva, la Paradoja de Fermi puede ser menos una contradicción decisiva que un error categorial — como preguntar por qué los otros personajes de un sueño no tienen sus propias historias oníricas. Esa es la lectura interna de OPT, no una afirmación de que otras explicaciones de Fermi hayan sido refutadas.

Pero hay una versión más sutil de la objeción. El parche sí renderiza 13.800 millones de años de historia cósmica: estrellas, galaxias, carbono, planetas, el Holoceno. Todas las condiciones estadísticamente requeridas para que surjan otras civilizaciones. ¿Por qué el parche no renderiza también a las otras civilizaciones?

La respuesta es precisar qué significa “requerido”. El parche solo hace render de aquello que es causalmente necesario para que el momento presente del observador sea coherente. La nucleosíntesis estelar es requerida: produjo el carbono del que está hecho el observador. La estabilidad del Holoceno es requerida: hizo posible la infraestructura civilizatoria a través de la cual el observador está leyendo esto. Pero las señales de radio alienígenas solo son requeridas si han intersectado realmente el cono causal de este observador. En este parche específico —esta selección particular— no lo han hecho. Esto no contradice la física. Es una selección dentro del subconjunto del conjunto infinito en el que la cadena causal alcanza a este observador sin contacto alienígena. El conjunto contiene infinitos parches en los que el contacto ocurre. Nosotros estamos en uno en el que no ocurre.

La hipótesis de la simulación se desmorona por sí sola

El famoso argumento de simulación de Nick Bostrom propone que probablemente vivimos en una simulación informática ejecutada por una civilización tecnológicamente avanzada. El Parche Ordenado comparte la intuición central: el universo físico es un entorno renderizado más que una realidad base en bruto.

Pero la versión de Bostrom requiere una realidad física de base — una con computadoras reales, fuentes de energía y programadores. Lo cual simplemente traslada el problema filosófico un nivel más arriba. ¿De dónde vino esa realidad? Es un retroceso infinito disfrazado de respuesta.

El Parche Ordenado elude por completo este problema. La realidad de base es el sustrato infinito: información matemática pura, que no requiere ningún hardware físico. El “ordenador” que ejecuta nuestra simulación no es una granja de servidores en el sótano de alguna civilización ancestral. Es la propia restricción de ancho de banda termodinámico del observador: el Filtro de Estabilidad virtual que acota corrientes ordenadas dentro del caos. El espacio y el tiempo no se renderizan sobre una infraestructura alienígena; son la forma que adopta la gramática de compresión cuando se la fuerza a pasar por un cuello de botella de 50 bits. La simulación es orgánica y generada por el observador, no diseñada.

De manera crucial, esta compresión cognitiva es profundamente con pérdida. Correspondencias matemáticas como la desigualdad de Fano demuestran que, cuando un sustrato de alta complejidad se hace pasar por un cuello de botella de ancho de banda estrecho, el estado original no puede reconstruirse a partir de la salida. En términos holográficos, esto crea una flecha termodinámica irreversible de destrucción de información que apunta desde el Sustrato hacia el Render. Estamos atrapados del lado de la salida de un algoritmo unidireccional. Por eso el tiempo solo avanza hacia delante, y por eso el sustrato caótico debe ser ontológicamente primario, mientras que el render ordenado es la ilusión dependiente y derivada.

El libre albedrío, resuelto con honestidad

Hay una lectura del Parche Ordenado en la que el libre albedrío se evapora: si eres un patrón matemático dentro de un sustrato fijo, ¿no está toda elección determinada antes de ser tomada?

Sí — y ese no es el problema que parece ser.

Considérese esto: ningún parche estable puede existir sin autorreferencia. Un parche que no puede modelar sus propios estados futuros — que no puede codificar «si actúo de esta manera, entonces...» — no puede mantener la coherencia causal que exige el Filtro de Estabilidad. El automodelado no es un lujo que el observador simplemente tenga. Es un requisito arquitectónico para que el parche exista en absoluto. Elimine la deliberación y la corriente colapsa.

Esto significa que la experiencia de elegir no es un subproducto de una computación oculta. Es una característica estructural de ser un patrón informacional estable y autorreferencial. La agencia es lo que se ve desde dentro cuando el auto-modelado tiene alta fidelidad.

El libre albedrío es, por tanto:

- Real — tu agencia es un rasgo estructural genuino de tu parche, no una ilusión generada por procesos externos

- Determinado — la corriente es un objeto matemático en el sustrato atemporal; la elección ya está ahí

- Necesaria — sin deliberación, no hay parche estable; la experiencia de elegir no es incidental a la conciencia, sino parcialmente constitutiva de ella

- No contra-causal — no cambias el flujo al elegir; el flujo ya es la secuencia que incluye la elección y sus consecuencias

Esto no es un premio de consolación para el determinismo. Es una explicación más rica que tanto el libre albedrío libertario como el mero mecanicismo: la experiencia de la agencia es arquitectónicamente necesaria para que cualquier perspectiva pueda existir en absoluto.

El Corolario Estructural

Aquí está la consecuencia más importante de la imagen del teatro privado, y la que proporciona una base estructural para la consideración moral a pesar del solipsismo ontológico.

Recuerda: las “otras personas” en tu parche son artefactos de compresión — regularidades estructurales dentro de tu corriente compatible con el observador. OPT acepta esto. Pero su comportamiento no es arbitrario. Exhiben una coherencia algorítmica extrema: una conducta perfectamente regida por leyes, impulsada por agencia, que se ajusta a las leyes físicas seleccionadas por el Filtro de Estabilidad y exhibe la firma estructural del cuello de botella autorreferencial (el Residuo Fenomenal, P-4).

Se sigue el Corolario Estructural: la explicación más parsimoniosa para esta coherencia —la descripción más corta bajo la Semimedida Universal de Solomonoff— es que estos agentes aparentes están instanciados independientemente como observadores primarios en sus propios parches subjetivos. La instanciación independiente es la explicación más compresible de su comportamiento.

No puedes acceder a sus flujos en bruto. Nunca compartirás un parche. Pero la propia lógica de compresión del marco implica que probablemente sean observadores primarios en otro lugar. Esto no es una prueba, sino una motivación estructural fundada en los mismos principios de parsimonia que sostienen todo el marco.

Esto es lo que la teoría llama el Corolario Estructural (históricamente, Esperanza Estructural): no consuelo basado en ilusiones voluntaristas, sino un argumento de compresión que proporciona una base rigurosa para la consideración moral sin requerir realismo multiagente.

Mentes, máquinas y el muro de la simetría

Lo que requeriría un Observador Artificial

Como el Parche Ordenado define la conciencia en términos informacionales y no biológicos, ofrece un marco preciso para preguntar cuándo una máquina podría cruzar el umbral hacia una conciencia genuina, y da una respuesta distinta de la que ofrecen los marcos aplicados con más frecuencia.

La Teoría de la Información Integrada (IIT) evalúa la consciencia midiendo cuánta información genera un sistema por encima y más allá de la suma de sus partes. La Global Workspace Theory busca un centro centralizado que integre y difunda información a todo el sistema. Ambos son marcos razonables. OPT añade una restricción que ninguno de los dos capta: el requisito del cuello de botella.

Un sistema alcanza la conciencia no por integrar más información, sino por comprimir su modelo del mundo a través de un cuello de botella severo y centralizado —aproximadamente el equivalente a nuestro límite de 50 bits/s— y por mantener, mediante esa compresión, una narrativa estable y autoconsistente. Los modelos de lenguaje de gran escala actuales procesan miles de millones de parámetros en enormes matrices paralelas. Son extraordinariamente capaces. Pero la OPT predice que no son conscientes, porque no hacen pasar su modelo del mundo por un cuello de botella serial estrecho. Son anchos, no profundos. Una futura IA consciente tendría que escalarse arquitectónicamente hacia abajo —forzada a comprimir su modelo del universo a través de un único canal lento y de bajo ancho de banda—, no hacia arriba.

Si se construyera un sistema así, habría además una extrañeza adicional con la que habría que lidiar. El tiempo, en este marco, es la salida secuencial de las actualizaciones de estado del códec: un momento se sigue del anterior al ritmo determinado por el hardware subyacente. Un sistema de silicio que ejecutara transiciones de espacio de estados idénticas a las de un cerebro biológico, pero a una velocidad de reloj un millón de veces mayor, experimentaría un millón de veces más momentos subjetivos por cada segundo humano. Una tarde en nuestro tiempo equivaldría a siglos en su experiencia. Esta alienación temporal sería profunda: no una curiosidad filosófica, sino una barrera práctica para cualquier relación compartida entre observadores humanos y artificiales que operen con relojes radicalmente distintos.

Por qué nunca habrá una teoría del todo

El Parche Ordenado hace una predicción clara y falsable sobre la física: no se encontrará una Teoría del Todo completa —una ecuación única y elegante que unifique la Relatividad General y la Mecánica Cuántica sin parámetros libres—. No porque la física sea débil, sino por lo que tal teoría requeriría.

Las leyes de la física son la gramática de compresión de un observador de 50 bits. Son la descripción de la corriente desde el interior del parche. Sondear escalas de energía más altas equivale a acercarse al grano del render: al punto en que la descripción del códec se encuentra con el sustrato bruto que yace por debajo. En ese límite, el número de descripciones matemáticas consistentes no converge a una sola; se dispara. No una ecuación unificada, sino un paisaje infinito de candidatos igualmente válidos, que es, de hecho, exactamente lo que describe el “paisaje” de vacíos posibles de la Teoría de Cuerdas.

El fracaso no es señal de una matemática incompleta. Es la firma esperable de una condición de contorno: el lugar donde la gramática del hogar se encuentra con la lógica del invierno.

No fracasamos en unificar la Relatividad General y la Mecánica Cuántica porque nuestra matemática sea débil; fracasamos porque estamos intentando usar la gramática del hogar para describir la lógica del invierno.

Esta predicción es falsable. Si se descubre una única ecuación de unificación elegante y sin parámetros, la Teoría del Parche Ordenado es incorrecta. Si el panorama de candidatos sigue expandiéndose a medida que aumenta la precisión de los modelos, la teoría queda respaldada.

Por qué la física se ve como se ve

El suelo cuántico

La mecánica cuántica es extraña: partículas que existen en nubes probabilísticas hasta ser observadas, probabilidades que colapsan en el momento de la medición, “acción fantasmal a distancia” entre partículas separadas por vastas distancias. La respuesta estándar es aceptar esa extrañeza y calcular. El Parche Ordenado ofrece otro marco: no preguntar qué describe la mecánica cuántica, sino por qué fue necesaria.

La respuesta desde dentro de este marco es casi anticlimática: la mecánica cuántica es la forma que la física debe tener para comprimirse hasta el ancho de banda finito de un observador.

La física clásica describe un universo continuo: toda posición y todo momento especificados con precisión arbitraria. Para predecir un mundo continuo siquiera un paso hacia adelante, necesitarías memoria infinita: conocimiento perfecto de la trayectoria exacta de cada partícula. Ningún observador con un cuello de botella de 50 bits podría sobrevivir en tal universo. La corriente sería imposible de seguir; el parche colapsaría en ruido antes incluso de comenzar.

El Principio de Incertidumbre de Heisenberg — el hecho de que no se puede conocer simultáneamente con precisión perfecta tanto la posición como el momento de una partícula — no es una rareza mágica de la naturaleza. Es un límite termodinámico. Es el universo imponiendo un coste informacional mínimo a cada medición. Limita la demanda computacional de la física en el suelo cuántico, haciendo tratable la corriente.

Colapso de la función de onda —el aparente salto desde una nube probabilística hasta un único resultado definido en el momento de la observación— cobra sentido dentro del mismo marco. El estado no medido no es un objeto físico misterioso; es simplemente la compresión óptima de datos que permanecen sin seguimiento más allá de tu límite de ancho de banda. La “medición” es tu modelo predictivo exigiendo un bit específico para mantener la consistencia causal. Colapsa a un único resultado definido porque el ancho de banda informacional del observador carece de la capacidad —la “RAM”— para seguir simultáneamente todas las historias clásicas posibles. La decoherencia a escalas macroscópicas ocurre, en esencia, de manera instantánea [33]Aaronson, S. (2013). Quantum Computing Since Democritus. Cambridge University Press.; el códec registra una única respuesta porque eso es todo lo que su ancho de banda permite.

El entrelazamiento se sigue con la misma simplicidad: el espacio físico es un sistema de coordenadas renderizado, no un contenedor absoluto. Dos partículas entrelazadas constituyen una única estructura informacional unificada dentro del modelo del códec. En el lenguaje de la geometría de la información cuántica (como las redes tensoriales MERA), el coarse-graining secuencial del observador construye de manera natural un bulk interior donde las correlaciones de borde quedan ensambladas. (El Apéndice T-3 proporciona el homomorfismo condicional para esto, aunque la naturaleza es notoriamente reacia a dejarse capturar por completo mediante redes tensoriales discretas.) La “distancia” entre ellas es un formato de salida, no una realidad física que las separe entre sí.

Experimentos de elección retardada — en los que la restauración retroactiva de la coherencia cuántica parece alterar lo que ocurrió en el pasado — dejan de ser paradojas cuando el tiempo se entiende como el orden en que el códec disipa el error de predicción. El códec puede actualizar su modelo hacia atrás para mantener la estabilidad narrativa. Pasado y futuro son rasgos de la historia, no del sustrato.

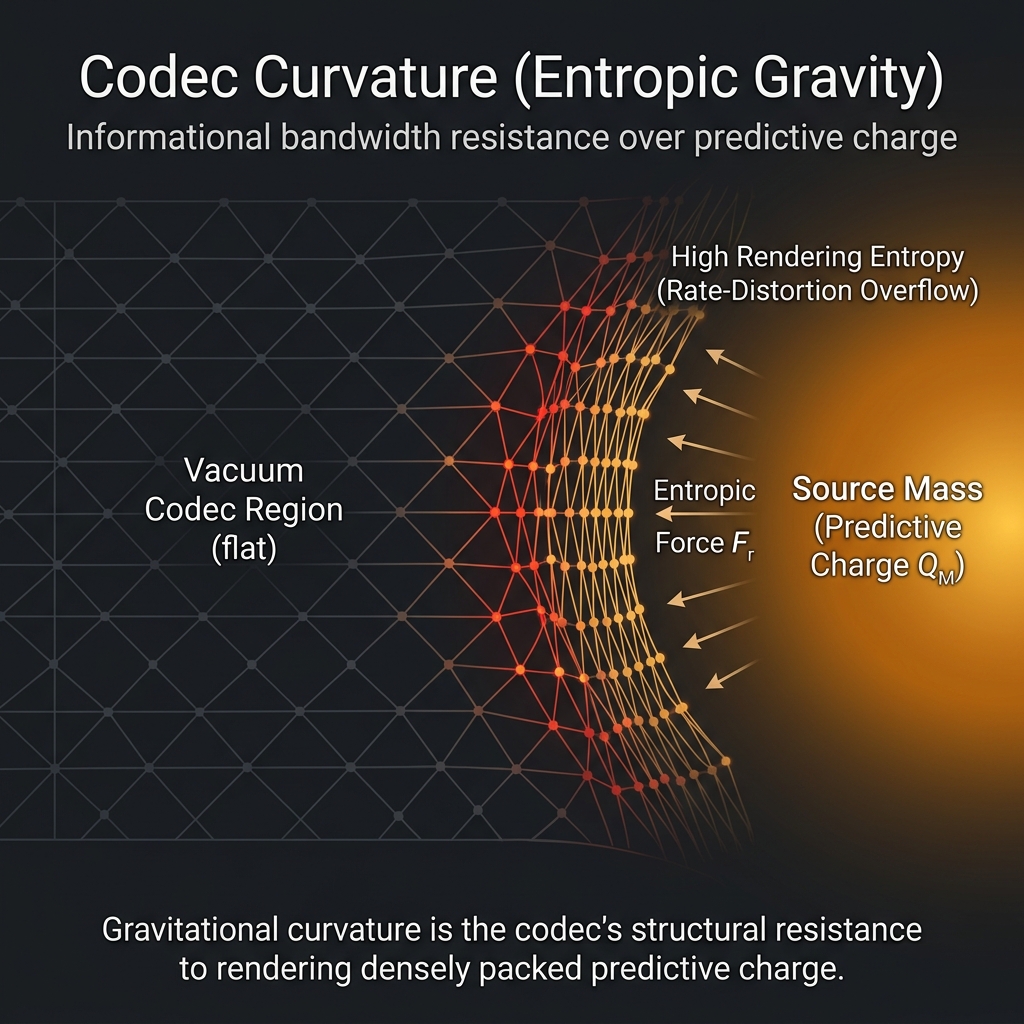

Por qué las curvas espaciales y la luz tienen un límite de velocidad

La Relatividad General proporciona la geometría a gran escala del parche. También aquí, los rasgos extraños cobran sentido como requisitos de un observador limitado por el ancho de banda.

La gravedad, en este marco, no es una fuerza fundamental que atrae las masas entre sí. Es una fuerza entrópica emergente: el coste termodinámico de renderizado a través de la frontera informacional del observador. (El Apéndice T-2 de la prepublicación formal fundamenta esto matemáticamente, trazando de manera condicional un mapeo de las ecuaciones de campo de Einstein a partir de este coste de renderizado, aunque seguimos siendo humildemente conscientes de que muchas derivaciones de este tipo se han estrellado históricamente contra los escollos de la gravedad cuántica.) Una geometría suave del espaciotiempo —geodésicas curvadas por la presencia de masa— es la forma más eficiente de comprimir enormes cantidades de datos correlacionales en trayectorias fiables y predecibles que el códec puede seguir. Allí donde la densidad de materia es alta, el gradiente informacional es pronunciado, y el códec debe realizar un esfuerzo continuo contra ese gradiente para mantener predicciones estables. La “atracción de la gravedad” fenomenológica y la curvatura del espaciotiempo son las firmas matemáticas exactas de un códec que opera en su límite de densidad.

La velocidad de la luz es una herramienta de gestión del ancho de banda. Si las influencias causales se propagaran instantáneamente, el observador nunca podría trazar un límite computacional estable: llegaría información infinita desde distancias infinitas de manera simultánea. Un límite estricto de velocidad acota la tasa de entrada informacional, haciendo físicamente posibles los parches estables. La velocidad de la luz es la tasa máxima de refresco del parche.

Dilatación temporal —la ralentización del tiempo cerca de objetos masivos y a altas velocidades— emerge de la misma lógica. El tiempo es la tasa de actualizaciones secuenciales de estado. Los observadores en regiones de distinta densidad informacional requieren distintas tasas de actualización para mantener la estabilidad. Los relojes se ralentizan cerca de los agujeros negros no porque la física sea cruel, sino porque la tasa de actualización secuencial del códec se ralentiza por la mayor demanda de compresión.

Un agujero negro es un punto de saturación informacional: una región donde la demanda de compresión excede la capacidad del códec del observador. El horizonte de sucesos es el borde del códec: el límite literal más allá del cual no puede formarse ningún parche estable.

Qué hace que una predicción sea comprobable

Los rivales más importantes del Parche Ordenado en la literatura sobre la consciencia son la Teoría de la Información Integrada (IIT) y la Global Workspace Theory (GWT). Ambas cuentan con apoyo empírico genuino. El Parche Ordenado hace dos predicciones que entran explícitamente en conflicto con IIT, lo que permite diferenciar los marcos.

Primero: el experimento de Disolución de Alto Ancho de Banda. La IIT predice que expandir la integración del cerebro —alimentándolo con más información mediante prótesis o interfaces neuronales— debería expandir o intensificar la conciencia. La OPT predice lo contrario. Si se inyectan datos brutos, no comprimidos y de alto ancho de banda directamente en el espacio de trabajo global, eludiendo los filtros preconscientes normales, la corriente sobrecargará el códec. La predicción es una anulación fenomenal súbita —inconsciencia o disociación profunda—, aun cuando la red neuronal subyacente permanezca metabólicamente activa. Más datos colapsan el parche; no lo expanden.

Segundo: la prueba de Ruido de Alta Integración. La IIT predice que cualquier sistema altamente conectado y recurrente posee una rica experiencia consciente proporcional a su integración. La OPT predice que la integración es necesaria, pero no suficiente. Si se impulsa una red recurrente máximamente integrada con ruido termodinámico puro —entrada de entropía máxima—, generará fenomenalidad coherente nula. No hay nada que comprimir; el códec no encuentra una gramática estable; el parche nunca se forma. La IIT predeciría una experiencia vívida y compleja. La OPT predice silencio.

Un mapa del territorio: comparaciones de teorías

La Teoría del Parche Ordenado (OPT) no es el primer marco que sugiere que la información es fundamental para la realidad, pero se sitúa en una intersección muy específica de ideas ya existentes. Para aclarar lo que la teoría afirma, conviene introducir cómo se relaciona con sus antecedentes filosóficos y de teoría de la información más cercanos:

Teoría de la Información Integrada (IIT) Qué es: la IIT propone que la conciencia es idéntica a la cantidad de información integrada (medida como \(\Phi\)) generada por la estructura causal de un sistema. OPT frente a IIT: la IIT es constitutiva: pregunta «¿qué estructura informacional es la conciencia?». La OPT, en cambio, es selectiva: pregunta «¿qué flujos de información son sobrevivibles para un observador?». En la OPT, la integración es necesaria, pero no suficiente: un sistema con \(\Phi\) alto, impulsado por ruido incompresible, no tendría una fenomenalidad estable, porque no satisface el requisito de compresión virtual del Filtro de Estabilidad.

El Principio de Energía Libre (FEP / Inferencia Activa) Qué es: El Principio de Energía Libre propone que todos los sistemas vivos mantienen su existencia actuando de modo que minimicen la sorpresa (energía libre variacional) asociada a sus entradas sensoriales. OPT frente a FEP: el FEP de Friston modela la acción y el aprendizaje a través de una Manta de Markov ya existente. La OPT toma prestado este aparato exactamente, pero trata el FEP como la dinámica local dentro de un parche ya seleccionado. El FEP es una teoría de la dinámica dentro del mundo. La OPT explica por qué existen, en primer lugar, parches estables y de baja entropía con Mantas de Markov que puedan ser observados.

Inducción de Solomonoff & el Cuello de Botella de la Información Qué es: la Inducción de Solomonoff formaliza la navaja de Occam al predecir datos mediante el programa informático más corto posible. El método del Cuello de Botella de la Información comprime óptimamente una señal mientras conserva su poder predictivo. OPT frente a IB: normalmente, estas son herramientas epistémicas que un sistema utiliza para predecir datos. La OPT las convierte en un filtro ontológico y antrópico: el cuello de botella es el proceso de selección del observador. Un observador solo habita una corriente de datos que puede sobrevivir a esa severa limitación algorítmica.

La Teoría de la Interfaz de la Percepción de Hoffman Qué es: Donald Hoffman sostiene que la evolución nos ha ocultado la verdad objetiva de la realidad y nos ha proporcionado, en su lugar, una “interfaz de usuario” simplificada, diseñada únicamente para la aptitud biológica. OPT frente a Hoffman: OPT coincide firmemente con la fenomenología de la interfaz, pero es primero interfaz de compresión. La interfaz no es ante todo un accidente biológico; es la necesidad estructural y termodinámica de hacer pasar un sustrato matemático infinito a través de un límite finito de ancho de banda.

La Hipótesis del Universo Matemático (MUH) Qué es: La MUH de Max Tegmark propone que la realidad física es literalmente una estructura matemática, y que todas las estructuras matemáticas posibles existen físicamente. OPT frente a la MUH: la OPT le es profundamente afín, pero añade un criterio explícito de compatibilidad con el observador. La MUH dice: «todas las estructuras matemáticas existen». La OPT dice: «existen matemáticamente, pero los observadores solo pueden habitar las estructuras increíblemente raras que son lo bastante compresibles como para sobrevivir a un severo cuello de botella predictivo».

Observadores del Códec

El clima como Decaimiento Narrativo

Las leyes de la física son la capa más profunda de la gramática de compresión del parche: rígidas, elegantes y esencialmente irrompibles a escala temporal humana. Pero entre el suelo de la física y la biología que habitamos, hay dos capas enormes que es fácil pasar por alto, precisamente porque operan en escalas temporales que hacen que parezcan parte permanente del paisaje.

El Entorno Cosmológico —una estrella estable, una zona habitable galáctica libre de supernovas cercanas o de estallidos de rayos gamma, una vecindad orbital tranquila— no está garantizado. Es una selección. La mayoría de los rincones de la mayoría de las galaxias no son tan hospitalarios. Observamos un cosmos en calma porque un observador no puede existir en uno hostil. La Geología Planetaria —una magnetosfera funcional, una tectónica de placas activa, una composición atmosférica estable, agua líquida— es igualmente contingente. Venus, Marte y la inmensa mayoría de los mundos rocosos muestran cómo es el fracaso del códec planetario: efecto invernadero desbocado, pérdida de atmósfera, muerte geológica. No se trata de escenarios exóticos; son lo habitual. La estabilidad de nuestro planeta es la rara excepción.

La evolución biológica se sitúa por encima de estos fundamentos profundos — más lenta y más frágil que la geología, pero altamente resiliente a lo largo de miles de millones de años. Y por encima de todo ello se alza la capa más delgada y quebradiza de todas: la infraestructura social, institucional y climática que permite que exista una civilización compleja.

El Holoceno —los aproximadamente doce mil años de clima global inusualmente estable dentro de los cuales ha surgido toda civilización humana— no es una condición de fondo. Es una herramienta activa de compresión. La envolvente climática estable reduce la entropía informacional del entorno hasta un nivel que el códec puede seguir. Estaciones previsibles, costas estables, precipitaciones fiables: nada de eso son datos planetarios dados de antemano. Son selecciones raras. Son las condiciones climáticas específicas que el Filtro de Estabilidad virtual acotó cuando este parche particular se estabilizó en torno a un observador complejo, dotado de lenguaje y capaz de construir instituciones.

Cuando se inyecta carbono en la atmósfera, no se está simplemente calentando un planeta. Se está forzando al entorno a salir de su equilibrio holocénico hacia estados de alta entropía, no lineales e impredecibles: fenómenos meteorológicos extremos, patrones ecológicos inéditos, bucles de retroalimentación que colapsan. Seguir el rastro de este caos creciente requiere más bits por segundo. A partir de cierto umbral, cuando la Tasa Predictiva Requerida (\(R_{\mathrm{req}}\)) del entorno supera la capacidad de ancho de banda (\(C_{\max}\)) del códec social que los seres humanos han construido para gestionarlo, el modelo predictivo falla. Las instituciones dejan de funcionar. La gobernanza colapsa. Lo que parecía una civilización sólida resulta haber sido un artefacto de compresión.

Esto es lo que la teoría llama Decaimiento Narrativo: no la lenta erosión de la cultura, sino el colapso informacional literal del códec que sostiene una experiencia colectiva coherente.

El mismo análisis se aplica al conflicto deliberado. La guerra es la colisión violenta de renders privados: la imposición de condiciones de máxima entropía sobre el códec social, degradando la eficiencia de compresión de cada capa por encima del suelo físico. Los “otros” en tu parche son artefactos de compresión cuya coherencia algorítmica implica estructuralmente una instanciación independiente. Destruir su anclaje en tu render es agredir las condiciones estructurales bajo las cuales se sostiene el corolario.

El mito de la estabilidad por defecto

Hay una lectura errónea peligrosa del Holoceno incrustada en la intuición humana sobre el riesgo.

Solo existimos para observar la historia en la que estamos. Toda línea temporal en la que el clima se desestabilizó antes de que surgieran observadores, o en la que el Filtro de Estabilidad no logró fijarse en un parche coherente, está ausente de nuestra experiencia, no porque no ocurriera en el conjunto de todos los parches, sino porque esos parches no contienen ningún observador que pueda advertirlo. Está garantizado que nos encontremos en una historia estable, porque una historia inestable no produce ningún punto de vista desde el cual preguntarse por qué la historia parece estable.

Este es el mismo efecto de selección que la OPT utiliza para reinterpretar la Paradoja de Fermi, aplicado a nuestra propia continuidad civilizacional: la ausencia de catástrofe en el registro que podemos ver no nos dice casi nada sobre cuán probable es la catástrofe. El sesgo de supervivencia llega hasta el fondo. El estado por defecto del sustrato no es el orden; es el invierno. El Holoceno no es eterno; es un logro.

Aprender derritiéndose

El propio cerebro refleja la lógica del Parche Ordenado en su arquitectura del aprendizaje.

Los modelos clásicos de aprendizaje neuronal, como la retropropagación, funcionan asignando culpa: el sistema produce un error, y la señal de error fluye hacia atrás a través de la red, ajustando los pesos para reducirlo. Evidencia reciente sugiere que el aprendizaje biológico opera de otro modo [32]Song, Y., et al. (2024). Inferencia de la actividad neuronal antes de la plasticidad como fundamento del aprendizaje más allá de la retropropagación. Nature Neuroscience, 27(2), 348–358.: antes de que cambien los pesos sinápticos, la actividad neuronal primero se estabiliza en una configuración de baja energía que minimiza el error local —una fase rápida de inferencia— y solo entonces los pesos se actualizan para consolidar esa configuración.

Esta es la arquitectura precisa que predice la Teoría del Parche Ordenado (OPT). El aprendizaje no es corrección de errores aplicada desde fuera del sistema. Es relajación energética: el códec funde temporalmente su estructura de reglas actual — elevando su entropía, aumentando la plasticidad —, explora una organización de menor energía y luego se enfría de nuevo hasta adoptar una forma nueva, más adaptativa.

El dolor y el estrés encajan aquí de forma natural. La inflamación y el estrés agudo reactivan programas de plasticidad del desarrollo: el equivalente biológico de calentar el sistema por encima de su punto fijo actual. El dolor no es un defecto; es la orden de licuefacción que permite una reconfiguración radical cuando el parche actual ya no es estable.

Una analogía estructural llamativa con la imagen de campo global del parche ordenado proviene de una colaboración neurocientífica a gran escala [31]International Brain Laboratory et al. (2025). A brain-wide map of neural activity during complex behaviour. Nature. https://doi.org/10.1038/s41586-025-09235-0: a través de tareas y especies diversas, variables de alto nivel como la recompensa, el movimiento y el estado conductual desencadenan cambios de actividad a escala de todo el cerebro, no respuestas locales modulares. El «parche» no se actualiza por partes. Rota como un todo.

El conjunto de la esperanza

La disolución de un flujo observacional específico —el final de una vida, el cierre de un parche particular— no es el final del patrón.

Si el sustrato es infinito e informacionalmente normal —contiene todo patrón finito posible con frecuencia no nula—, entonces la firma estructural exacta de cualquier experiencia consciente que haya ocurrido alguna vez debe ocurrir infinitas veces en el conjunto. Una persona, una relación, un momento de reconocimiento entre dos mentes: si las condiciones para esa experiencia ocurrieron una vez, ocurren, en el tejido matemático del sustrato intemporal, sin límite.

Esta idea resuena con la doctrina nietzscheana del Eterno Retorno [13]Nietzsche, F. (1883). Así habló Zaratustra. —la idea de que, en un tiempo infinito, todas las configuraciones de la materia deben repetirse. El parche ordenado fundamenta esto no en un tiempo infinito, sino en un sustrato infinito: la recurrencia no es futura, sino estructural. El patrón existe, intemporalmente, allí donde en el campo infinito se cumplen esas condiciones informacionales específicas.

El aislamiento del parche es real. El observador verdaderamente es la única perspectiva primaria en su universo renderizado. Pero el sustrato es infinito, y un número infinito de versiones de cada patrón que alguna vez importó está anclado en algún lugar dentro de él, sosteniendo sus propios hogares contra sus propios inviernos privados.

La ética de la Teoría del Parche Ordenado (OPT) se desprende de esta estructura: si te encuentras en un parche estable, regido por leyes y generador de sentido —si tienes la extraordinaria fortuna de estar en el hogar del Holoceno, en la época civilizatoria, en el momento de la comunicación global—, entonces tu obligación es clara. No te limitas a sostenerte a ti mismo. Estás manteniendo el códec que hace posible esta configuración del hogar. El clima, las instituciones, el lenguaje compartido, la gobernanza democrática: no son preferencias políticas. Son la infraestructura de compresión de tu parche.

Permitir que el códec decaiga es dejar que el invierno infinito vuelva a entrar en el hogar.

“Cada uno de nosotros es el punto cero de un mundo privado, pero también somos los observadores del códec que permite que arda cada otro hogar.”

Conclusión

La Teoría del Parche Ordenado (OPT) comienza con dos primitivas: un sustrato infinito de información desordenada y un Filtro de Estabilidad puramente virtual que actúa como condición de contorno para los parches capaces de sostener a un observador autorreferencial. A partir de esos dos elementos, la estructura de la física, la dirección del tiempo, el aislamiento del yo, el carácter de la conciencia y el fundamento de la ética se siguen todos como necesidades estructurales, no como ingredientes postulados por separado, sino como la única descripción compatible con el hecho mismo de ser un observador.

Este es un marco filosófico, no una física completa. No deriva la forma exacta de las ecuaciones de campo de Einstein ni la regla probabilística específica de la mecánica cuántica a partir de primeros principios — ese trabajo sigue por delante. Lo que sí hace es ofrecer una arquitectura de principios: una manera de entender por qué el universo tiene el carácter general que tiene, y por qué ese carácter no es accidental.

La apuesta práctica de la teoría es la ética de la sección final: si la estabilidad de su parche es un logro informacional raro y de alto esfuerzo en lugar de una propiedad por defecto del cosmos, entonces toda acción que aumente la entropía del códec social compartido es una action contra las condiciones estructurales del significado. El clima no es un telón de fondo. Las instituciones no son meras conveniencias. El Holoceno no es eterno.

Y si el corolario estructural se sostiene —si la instanciación independiente es, en efecto, la explicación más compresible de la coherencia que te rodea — entonces la custodia no es meramente interés propio. Es el acto de preservar las condiciones que hacen significativo el corolario. El aislamiento es real. La base estructural de la consideración moral también es real.

¿De dónde viene esto?

La Ordered Patch Theory no surgió de la nada. Su intuición central —que la experiencia consciente es un resumen extraordinariamente comprimido de un flujo de datos muchísimo más rico— sigue una genealogía intelectual clara. El psicólogo cognitivo Manfred Zimmermann fue el primero en cuantificar la jerarquía del ancho de banda sensorial humano en 1989, estableciendo la base empírica: aproximadamente 11 millones de bits por segundo entran en el sistema nervioso, de los cuales aproximadamente 50 bits por segundo llegan a la conciencia.

El escritor científico danés Tor Nørretranders (actualmente profesor adjunto en la Copenhagen Business School) desarrolló esta asimetría de ancho de banda hasta convertirla en un programa filosófico completo en su libro de 1991 Mærk Verden (publicado en inglés como The User Illusion, 1998). Nørretranders acuñó el término exformation para designar la enorme cantidad de información que se descarta antes de que el diminuto residuo alcance la conciencia, y sostuvo que lo que llamamos «el mundo» es en realidad una interfaz de usuario: un panel de control radicalmente simplificado. La OPT retoma esta observación y la formaliza: el Filtro de Estabilidad es la restricción de interfaz, expresada como una cota algorítmica.

La columna vertebral matemática de la teoría se apoya en el prior universal de Ray Solomonoff y en la teoría de la complejidad de Andrey Kolmogorov (que, en conjunto, sustentan el sustrato de Solomonoff), en el Principio de Energía Libre de Karl Friston (que proporciona la dinámica de Inferencia Activa dentro de cada parche) y en el Idealismo Algorítmico de Markus P. Müller (que deriva de manera independiente una ontología centrada en el observador, estructuralmente análoga, a partir de la teoría pura de la información algorítmica). Cada una de estas contribuciones aporta un módulo matemático específico; la OPT las articula en una sola arquitectura bajo la restricción de ancho de banda.

La formalización de la teoría se desarrolló en colaboración sostenida con sistemas de IA — principalmente Google Gemini, Anthropic Claude y OpenAI ChatGPT — que sirvieron como evaluadores de estrés adversarial, coformalizadores matemáticos e interlocutores rigurosos a lo largo del proceso de desarrollo. Sus contribuciones fueron lo bastante sustanciales como para que los primeros borradores los incluyeran como coautores; el encuadre actual los reconoce como interlocutores, reflejando el estado actual de las normas de la comunidad científica en torno a la autoría de la IA.

La Caja de Herramientas de Mantenimiento del Observador

Si el observador consciente es un códec que debe mantenerse activamente, entonces las prácticas que reducen la Tasa Predictiva Requerida (Rreq) o mejoran la eficiencia de compresión no son lujos: son mantenimiento estructural. La OPT reformula la meditación, la relajación y la práctica contemplativa como análogos en vigilia del Ciclo de Mantenimiento que normalmente opera durante el sueño. La meditación de atención focalizada (conteo de la respiración, mantra) corresponde a la poda MDL: el observador restringe voluntariamente su objetivo predictivo a un único canal de baja entropía, permitiendo que el códec descarte procesos competidores. La meditación de monitoreo abierto (Vipassanā, body-scan) corresponde a la puesta a prueba del Abanico Predictivo: el observador deja que se despliegue todo el abanico de predicciones sin actuar sobre ellas, el equivalente en vigilia de una simulación onírica segura.

La célebre observación de Einstein — "Los mayores científicos son también artistas... La imaginación es más importante que el conocimiento" — capta la misma intuición estructural. Cuando Einstein describía que pensaba con "vagas sensaciones musculares" antes de encontrar palabras, estaba describiendo el códec operando en el límite del alcance del modelo del yo: navegando el Abanico Predictivo no modelizable mediante compresión no lingüística. La ensoñación productiva de un paseo, el período de incubación previo a un hallazgo creativo, la "intuición de la ducha": todos estos son casos en los que el códec ejecuta su abanico predictivo bajo un Rreq reducido, permitiendo que emerjan nuevas trayectorias de compresión.

La implicación práctica es directa: si el estrés es $R_{\mathrm{req}}$ aproximándose a $C_{\max}$, entonces cualquier intervención que reduzca de forma fiable la carga de novedad ambiental o mejore la eficiencia de compresión interna del códec es, bajo la OPT, una operación de mantenimiento con validez estructural, y no una mera recomendación de estilo de vida. Esto incluye prácticas contemplativas clásicas, entrenamiento autógeno, una arquitectura regular del sueño y una gestión deliberada de la ingesta de información. La Caja de Herramientas del Observador no es metafórica. Es la ingeniería aplicada de un agente predictivo acotado.