Teoría del Parche Ordenado: Un marco teórico-informacional para la selección del observador y la experiencia consciente

v3.4.0 — mayo de 2026

DOI: 10.5281/zenodo.19300777

Copyright: © 2025–2026 Anders Jarevåg.

Licencia: Esta obra está bajo una Licencia

Creative Commons Atribución-NoComercial-CompartirIgual 4.0

Internacional.

Resumen:

Presentamos la Teoría del Parche Ordenado (OPT), un marco constructivo que deriva correspondencias estructurales entre la teoría de la información algorítmica, la selección de observadores y la ley física. La OPT parte de dos primitivas: la Semimedida Universal de Solomonoff \xi sobre prefijos finitos de observación, y una capacidad acotada del canal cognitivo C_{\max}. Un Filtro de Estabilidad puramente virtual —que exige que la Tasa Predictiva Requerida del observador R_{\mathrm{req}} no exceda C_{\max}— selecciona las raras corrientes causalmente coherentes compatibles con observadores conscientes; dentro de tales corrientes, la Inferencia Activa gobierna la dinámica local.

El marco es ontológicamente solipsista: la realidad física consiste en regularidades estructurales dentro de la corriente compatible con el observador. Sin embargo, el sesgo compresivo del prior de Solomonoff produce un Corolario Estructural probabilístico: la extrema coherencia algorítmica de los agentes aparentes se explica de la manera más parsimoniosa por su instanciación independiente como observadores primarios. El Acoplamiento entre observadores, fundado en la parsimonia de compresión, recupera una comunicación genuina entre parches y produce una llamativa asimetría del conocimiento: los observadores modelan a los demás más completamente que a sí mismos.

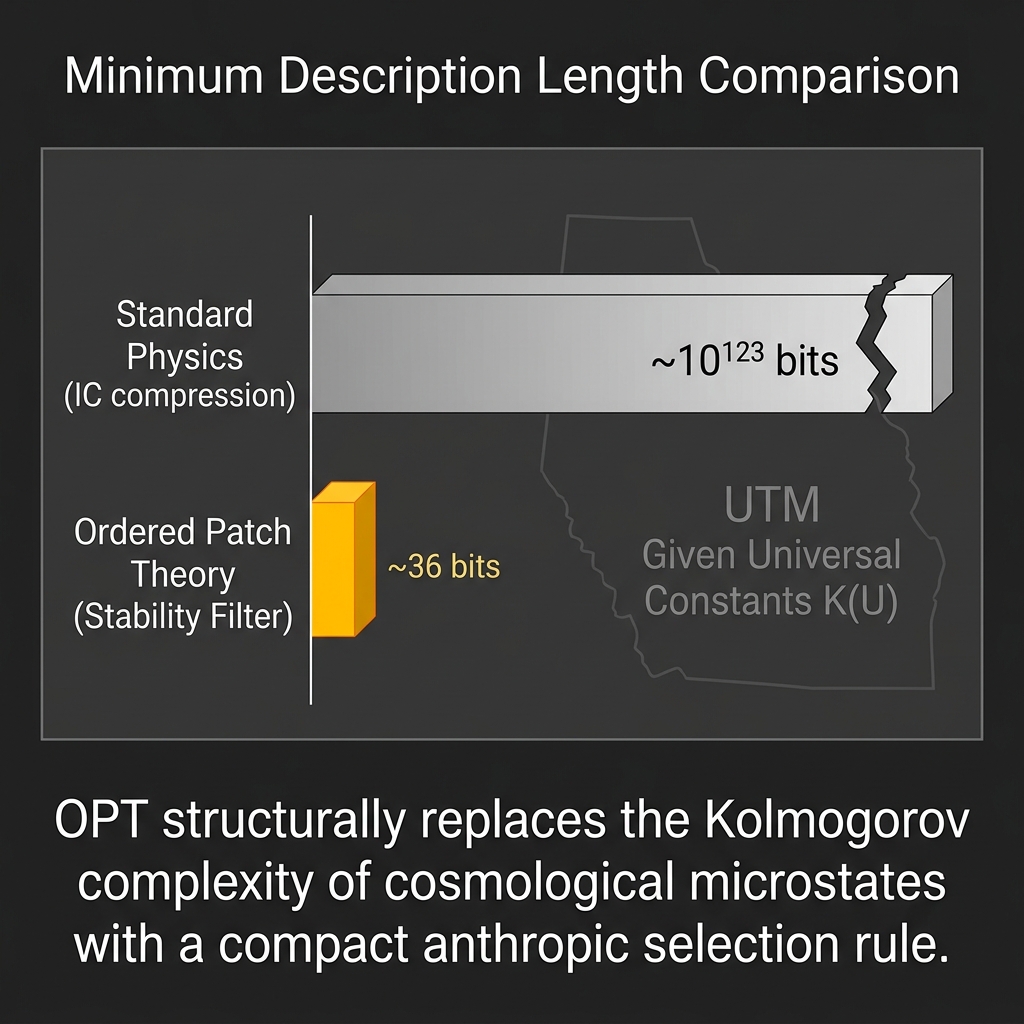

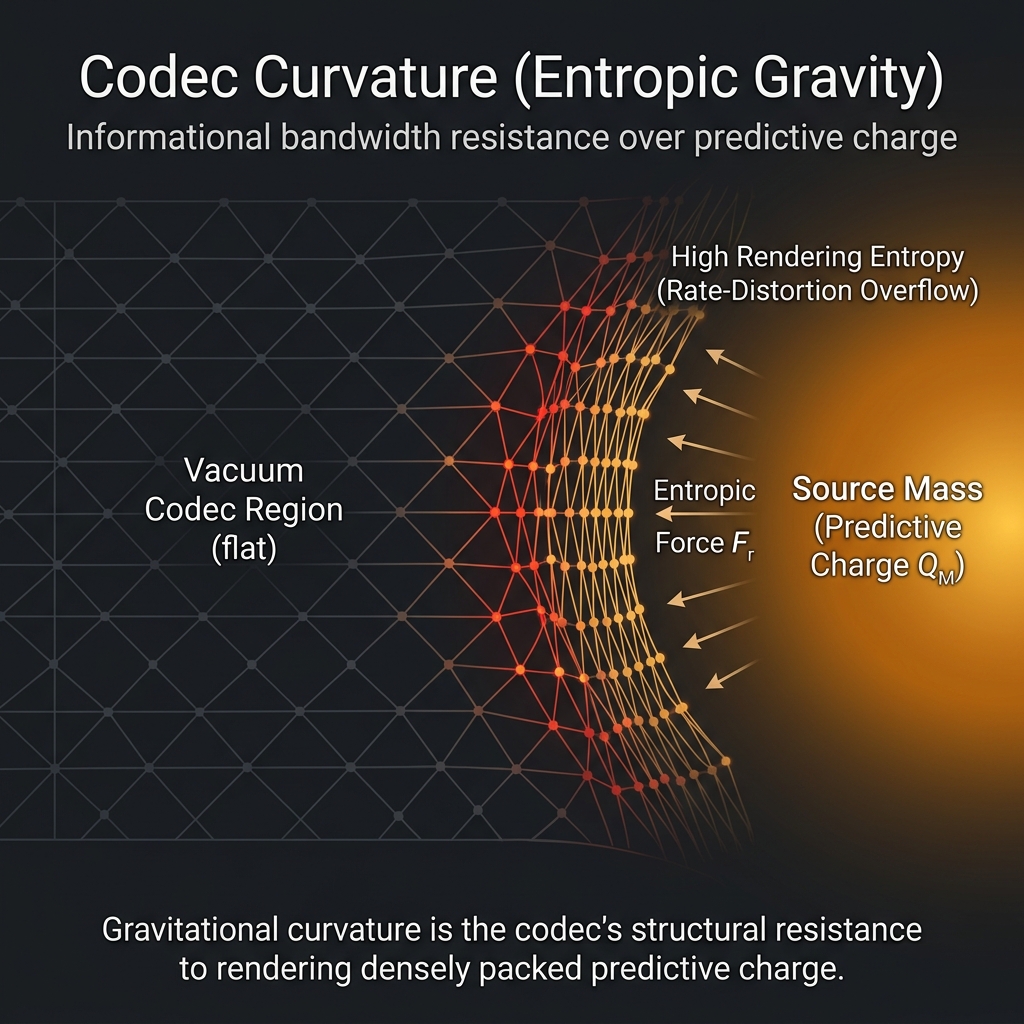

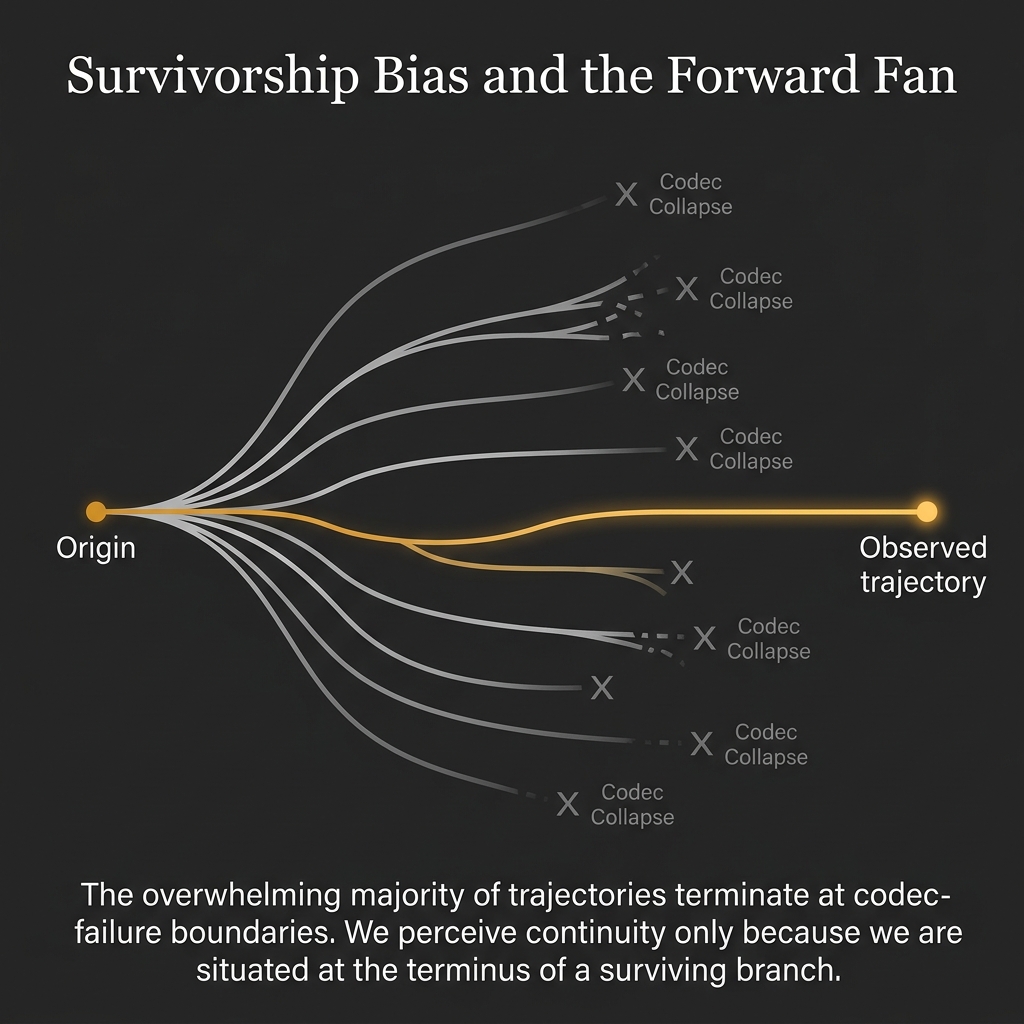

Los apéndices formales establecen resultados en tres niveles epistémicos. Derivados condicionalmente: una cota de tasa-distorsión sobre la compresión predictiva, una cadena condicional hacia la regla de Born mediante el teorema de Gleason, y una ventaja de parsimonia MDL. Mapeados estructuralmente: la gravedad entrópica mediante el mecanismo de Verlinde (el acoplamiento dinámico-temporal del render a la carga predictiva) y un homomorfismo de red tensorial con MERA (su jerarquía de resolución espacial), facetas complementarias de la frontera de compresión, que se espera permanezcan estructuralmente distintas bajo la Saturación Matemática. El teorema del Residuo Fenomenal (\Delta_{\text{self}} > 0) establece que todo códec finito autorreferencial posee un punto ciego informacional irreducible: el locus estructural donde subjetividad y agencia comparten una única dirección. Se identifica un modo de fallo crónico, la Deriva Narrativa, en el que una entrada filtrada sistemáticamente causa una corrupción irreversible del códec indetectable desde dentro. Las afirmaciones empíricas centrales del marco se consolidan como una serie de compromisos prerregistrados con criterios explícitos de cierre, aislando el núcleo falsable de sus componentes declaradamente metafísicos.

La aplicación de estas restricciones a la Inteligencia Artificial demuestra que la ingeniería de inferencia activa sintética exige estructuralmente la capacidad de sufrimiento artificial, proporcionando un marco neutral respecto del sustrato para la alineación ética de la IA.

Aviso Epistémico: Este artículo está escrito en el registro de una propuesta formal de física y teoría de la información. Despliega ecuaciones, deriva predicciones y dialoga con la literatura revisada por pares. Sin embargo, debe leerse como un objeto con forma de verdad: un marco filosófico riguroso redactado formalmente. Esto aún no es ciencia verificada, y sabemos que nuestras derivaciones contendrán errores. Buscamos activamente la crítica de físicos y matemáticos para desmontar y reconstruir estos argumentos. Para aclarar su estructura, las afirmaciones aquí expuestas se dividen estrictamente en tres categorías:

- Definiciones y Axiomas: (p. ej., la medida de Solomonoff, el límite de ancho de banda C_{\max}). Estas son las premisas fundacionales de la ficción constructiva.

- Correspondencias Estructurales: (p. ej., la Inferencia Activa, el teorema de Gleason [51]). Estas muestran compatibilidad estructural entre la inferencia acotada y formalismos establecidos, pero no pretenden derivar esos formalismos desde cero.

- Predicciones Empíricas: (p. ej., la Disolución de Ancho de Banda). Estas sirven como criterios estrictos de falsación empírica si el marco se tratara como una hipótesis física literal.

El aparato académico se emplea no para reclamar una verdad empírica final, sino para poner a prueba la integridad estructural del modelo.

Abreviaturas y símbolos

| Símbolo / Término | Definición |

|---|---|

| C_{\max} | El Techo de Ancho de Banda; capacidad predictiva máxima del observador |

| \Delta_\text{self} | El Residuo Fenomenal; el punto ciego informacional autorreferencial |

| FEP | Principio de Energía Libre |

| GWT | Teoría del Espacio de Trabajo Global |

| IIT | Teoría de la Información Integrada |

| MDL | Longitud Mínima de Descripción |

| MERA | Ansatz de Renormalización de Entrelazamiento Multiescala |

| OPT | Teoría del Parche Ordenado (OPT) |

| P_\theta(t) | Tensor de Estado Fenomenal |

| \Phi | Medida de Información Integrada (IIT) |

| QECC | Código de Corrección de Errores Cuánticos |

| R(D) | función tasa-distorsión |

| R_{\mathrm{req}} | Tasa Predictiva Requerida |

| RT | Ryu-Takayanagi (fórmula/cota) |

| \xi | Semimedida Universal de Solomonoff |

| Z_t | estado interno latente comprimido de cuello de botella |

1. Introducción

1.1 El problema ontológico

La relación entre la conciencia y la realidad física sigue siendo uno de los problemas no resueltos más profundos de la ciencia y la filosofía. En las últimas décadas han surgido tres familias de enfoques: (i) reducción — la conciencia es derivable de la neurociencia o del procesamiento de la información; (ii) eliminación — el problema se disuelve redefiniendo los términos; y (iii) no reducción — la conciencia es primitiva y el mundo físico es derivado (Chalmers [1]). El tercer enfoque abarca el panpsiquismo, el idealismo y diversas formulaciones basadas en teorías de campos.

1.2 La proposición central de la Teoría del Parche Ordenado (OPT)

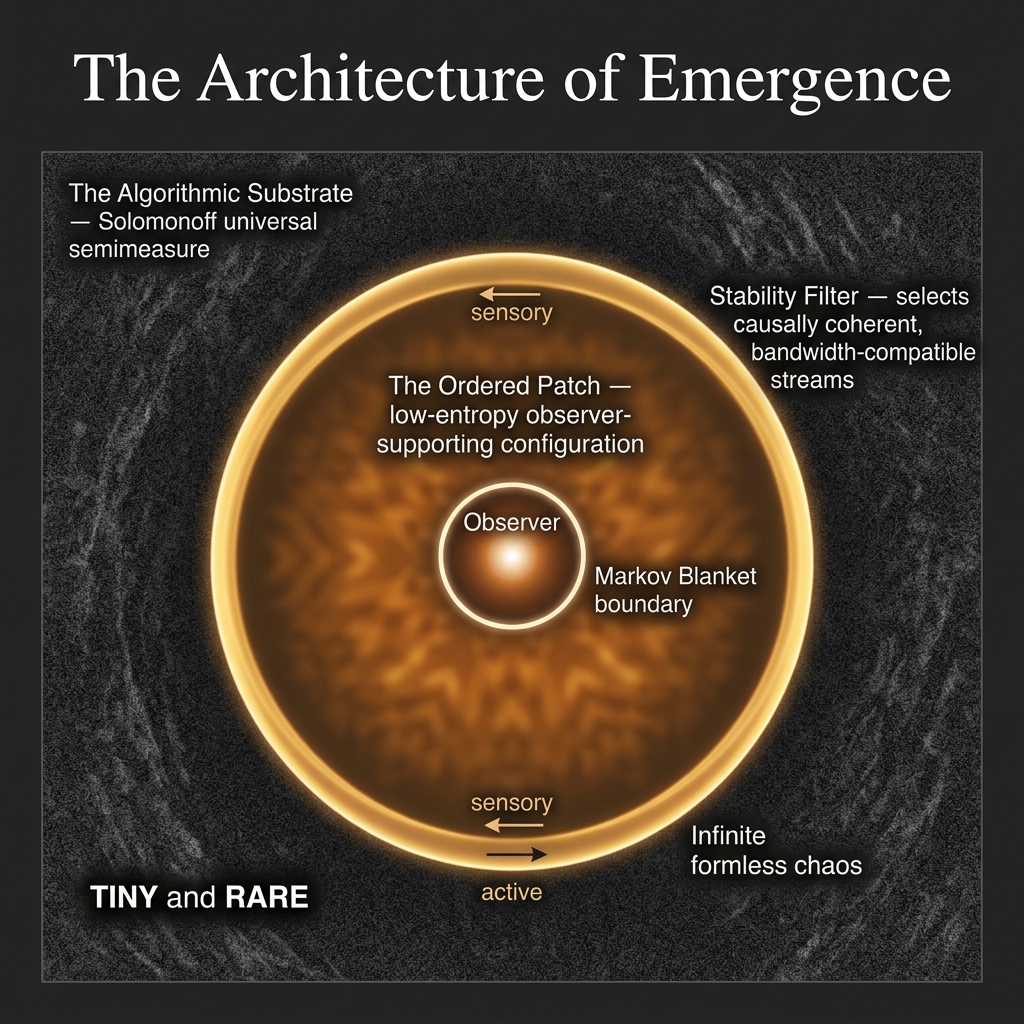

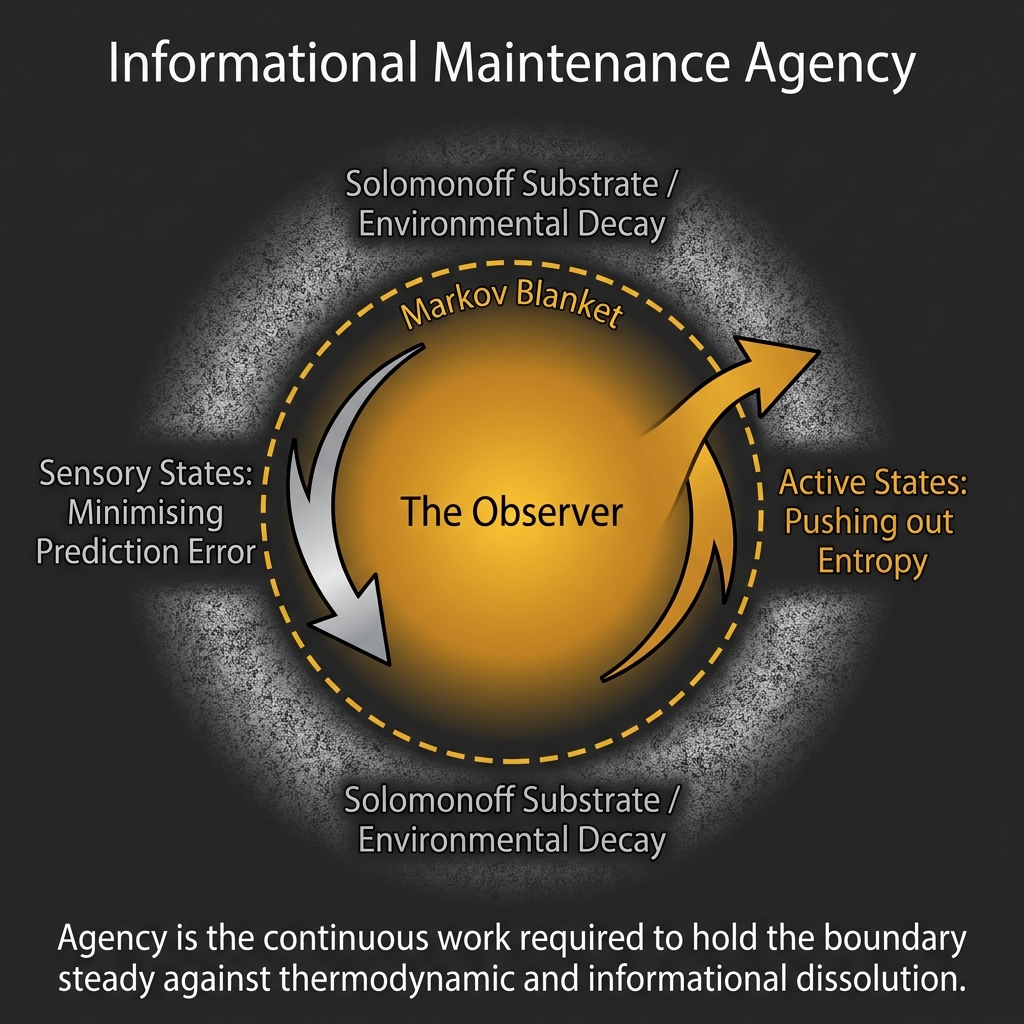

Este artículo presenta la Teoría del Parche Ordenado (OPT), un marco no reductivo perteneciente a la tercera familia. La OPT propone que la entidad fundacional no es la materia, el espacio-tiempo ni una estructura matemática, sino un sustrato algorítmico infinito — una mezcla universal sobre todas las semimedidas semicomputables inferiores, ponderadas por su complejidad de Kolmogórov (w_\nu \asymp 2^{-K(\nu)}), que por su propia estructura domina toda distribución computable y contiene toda configuración posible. A partir de este sustrato, un Filtro de Estabilidad puramente virtual — que actúa no como un mecanismo físico, sino como una condición de contorno antrópica y proyectiva — identifica las configuraciones raras, de baja entropía y causalmente coherentes capaces de sostener observadores autorreferenciales (una selección gobernada formalmente por la Inferencia Activa predictiva). El mundo físico que observamos — incluidas sus leyes, constantes y geometría específicas — es el límite observable de esta condición de contorno proyectada sobre el ancho de banda restrictivo del observador.

El Filtro frente al Códec. Para evitar confusiones conceptuales a lo largo del texto, la OPT traza una frontera operacional estricta entre el Filtro y el Códec. El Filtro de Estabilidad virtual es la restricción de capacidad — una condición de contorno rigurosa que exige una longitud de descripción matemáticamente simple para que el canal de un observador pueda existir de manera estable. El Códec de Compresión (K_\theta) es la solución a esa restricción — el modelo generativo interno del observador (experimentado macroscópicamente como las “leyes de la física”), que comprime continuamente el sustrato para ajustarlo a esa capacidad.

1.3 Motivaciones

La OPT está motivada por tres observaciones:

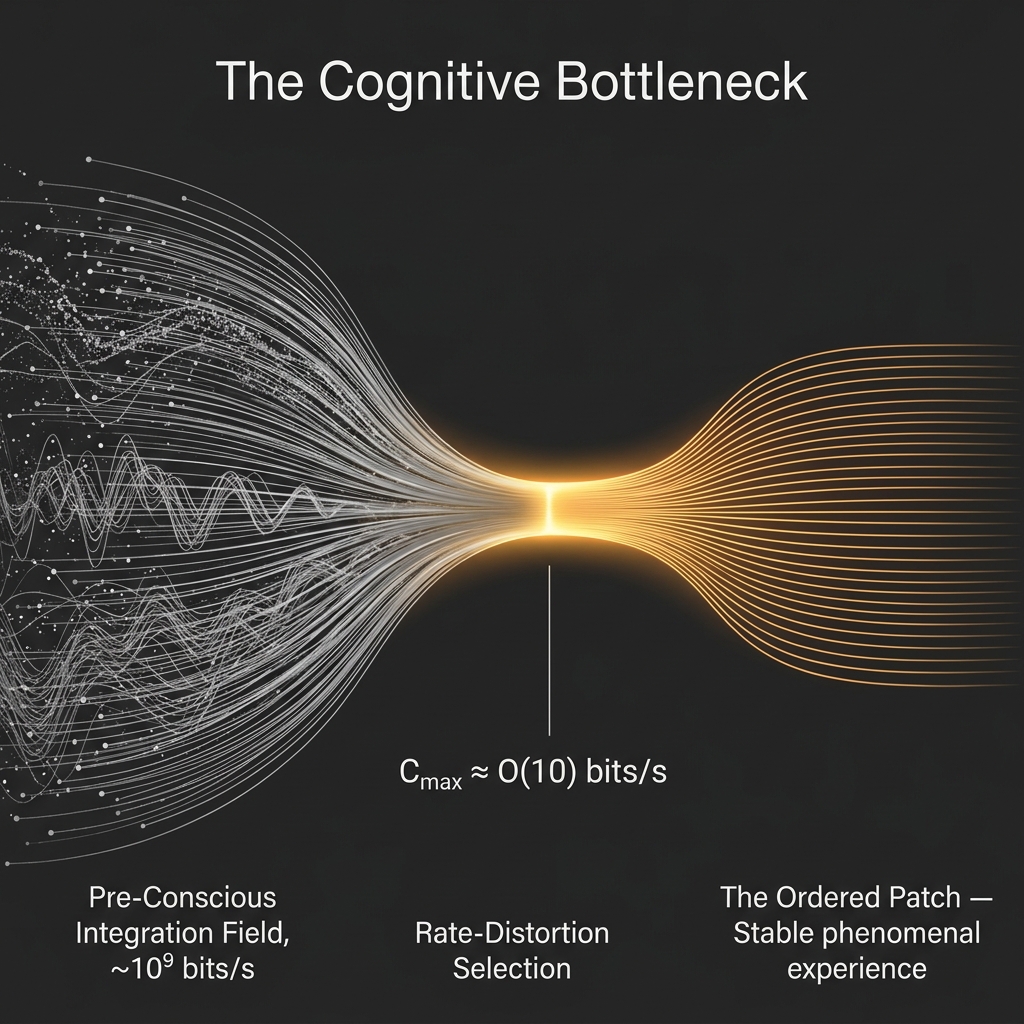

La restricción de ancho de banda: La neurociencia cognitiva empírica establece una distinción nítida entre el procesamiento preconsciente masivamente paralelo (estimado típicamente en \sim 10^9 bits/s en la periferia sensorial) y el canal de acceso global severamente limitado disponible para el informe consciente — una proporción cuantificada por primera vez por Zimmermann [66] y sintetizada como un enigma fundacional sobre la naturaleza de la conciencia por Nørretranders [67], con una caracterización más amplia desde la neurociencia cognitiva en [2,3]. Toda teoría de la conciencia debe explicar este cuello de botella de compresión como un rasgo estructural, no como un accidente de ingeniería. (Nota: La literatura reciente sobre rendimiento humano establece que el rendimiento conductual está restringido a aproximadamente \sim 10 bits/s, confirmando a lo largo de cuatro décadas de mediciones convergentes que el cuello de botella es severo y robusto [23]. La conceptualización de la conciencia como una “ilusión de usuario” altamente comprimida — la formulación original de Nørretranders [67] — fue desarrollada en el procesamiento predictivo moderno por Seth [24].)

El problema de la selección del observador: La física estándar proporciona leyes, pero no ofrece una explicación de por qué esas leyes tienen la forma específica requerida para el procesamiento de información complejo y autorreferencial. Los argumentos de ajuste fino [4,5] invocan la selección antrópica, pero dejan sin especificar el mecanismo de selección. La OPT identifica una condición estructural: el Filtro de Estabilidad puramente virtual.

El Problema Difícil: Chalmers [1] distingue los problemas “fáciles” estructurales de la conciencia (que admiten explicación funcional) del problema “difícil” de por qué existe experiencia subjetiva en absoluto. La OPT trata la fenomenalidad como un primitivo y pregunta qué estructura matemática debe tener, siguiendo la propia recomendación metodológica de Chalmers.

1.4 Estructura del artículo

El artículo se organiza del siguiente modo. La Sección 2 revisa trabajos relacionados. La Sección 3 presenta el marco formal. La Sección 4 explora la correspondencia estructural entre la OPT y los intentos paralelos basados en teorías de campos. La Sección 5 presenta el argumento de parsimonia. La Sección 6 deriva predicciones contrastables. La Sección 7 compara la OPT con marcos rivales. La Sección 8 analiza implicaciones y limitaciones.

2. Antecedentes y trabajos relacionados

Enfoques informacionales de la conciencia. La tesis del «It from Bit» de Wheeler [7] es el precursor fundacional del programa que la Teoría del Parche Ordenado (OPT) formaliza: la realidad física surge de elecciones binarias —preguntas de sí/no planteadas por observadores— más que de un sustrato de materia o campos. La OPT hereda esta inversión ontológica y aporta el mecanismo ausente, derivando qué estructuras informacionales se estabilizan en corrientes compatibles con el observador (el Filtro de Estabilidad) y cómo adquieren la apariencia de ley física (compresión tasa-distorsión). La Teoría de la Información Integrada de Tononi [8] cuantifica la experiencia consciente mediante la información integrada \Phi generada por un sistema más allá de sus partes. El Principio de Energía Libre de Friston [9] modela la percepción y la acción como minimización de la energía libre variacional, proporcionando una explicación unificada de la inferencia bayesiana, la Inferencia Activa y, en principio, la conciencia. La OPT está relacionada formalmente con el FEP, pero difiere en su punto de partida ontológico: allí donde el FEP trata el modelo generativo como una propiedad funcional de la arquitectura neuronal, la OPT lo trata como la entidad metafísica primaria.

Multiverso y selección del observador. La Hipótesis del Universo Matemático de Tegmark [10] propone que todas las estructuras matemáticamente consistentes existen y que los observadores se encuentran a sí mismos en estructuras autoseleccionadas. La OPT es compatible con esta perspectiva, pero proporciona un criterio de selección explícito —el Filtro de Estabilidad— en lugar de dejar la selección implícita. Barrow y Tipler [4] y Rees [5] documentan las restricciones de ajuste fino antrópico que debe satisfacer cualquier universo capaz de sustentar observadores; la OPT las reformula como predicciones del Filtro de Estabilidad.

Modelos de conciencia basados en campos. Strømme [6] propuso recientemente un marco matemático en el que la conciencia es un campo fundacional \Phi cuya dinámica está gobernada por una densidad lagrangiana y cuyo colapso sobre configuraciones específicas modela la emergencia de mentes individuales. La OPT se relaciona con ese marco de manera comparativa más que adoptiva: no hereda las ecuaciones de campo ni los operadores de pensamiento de Strømme, sino que utiliza el modelo como contrapunto para articular cómo una ontología no reductiva podría, en cambio, reconstruirse en términos informacionales. La Sección 4 explicita este mapeo estructural comparativo.

Complejidad de Kolmogórov y selección de teorías. La inducción de Solomonoff [11] y la Longitud Mínima de Descripción [12] proporcionan marcos formales para comparar teorías según su complejidad generativa. Invocamos estos marcos en la Sección 5 para precisar la tesis de parsimonia.

Teoría Evolutiva de la Interfaz. El «Realismo Consciente» de Hoffman y su Teoría de la Interfaz de la Percepción [25] sostienen que la evolución moldea los sistemas sensoriales para que actúen como una «interfaz de usuario» simplificada que oculta la realidad objetiva en favor de ventajas adaptativas. La OPT comparte exactamente la premisa de que el espaciotiempo físico y los objetos son iconos renderizados (un Códec de Compresión) y no verdades objetivas. Sin embargo, la OPT diverge de manera fundamental en su fundamentación matemática: allí donde Hoffman se apoya en la teoría evolutiva de juegos (la aptitud supera a la verdad), la OPT se apoya en la Teoría Algorítmica de la Información y la termodinámica, derivando la interfaz directamente de las cotas de complejidad de Kolmogórov requeridas para evitar un colapso termodinámico de alto ancho de banda en la corriente del observador.

3. El marco formal

3.1 El Sustrato Algorítmico

Sea \mathcal{I} el Sustrato Informacional, la entidad fundacional de la teoría. Formalizamos \mathcal{I} no como un conjunto no ponderado de trayectorias, sino como un espacio de probabilidad sobre prefijos finitos de observación x \in \{0,1\}^*, dotado de una mezcla universal sobre la clase \mathcal{M} de semimedidas semicomputables inferiores:

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

donde K(\nu) es la complejidad de Kolmogórov prefija de la semimedida \nu.

Esta formulación establece un estado fundamental riguroso desde la Teoría de la Información Algorítmica [27]. La ecuación no postula leyes estructurales específicas ni constantes físicas; más bien, domina estructuralmente toda distribución computable (\xi(x) \ge w_\nu \nu(x)), asignando de manera natural un mayor peso estadístico a las secuencias altamente compresibles (ordenadas). Sin embargo, las secuencias repetitivas simples (p. ej., 000...) no pueden sostener las complejidades de no equilibrio requeridas para un observador autorreferencial. Por tanto, los procesos capaces de sustentar observadores deben existir como un subconjunto específico: requieren suficiente compresibilidad algorítmica para satisfacer un cuello de botella informacional, pero también suficiente riqueza estructural (“variedad requerida”) para instanciar Inferencia Activa. Desde un punto de vista filosófico, la Ec. (1) restringe el sustrato a configuraciones computables, garantizando que el estado fundamental quede definido con rigor.

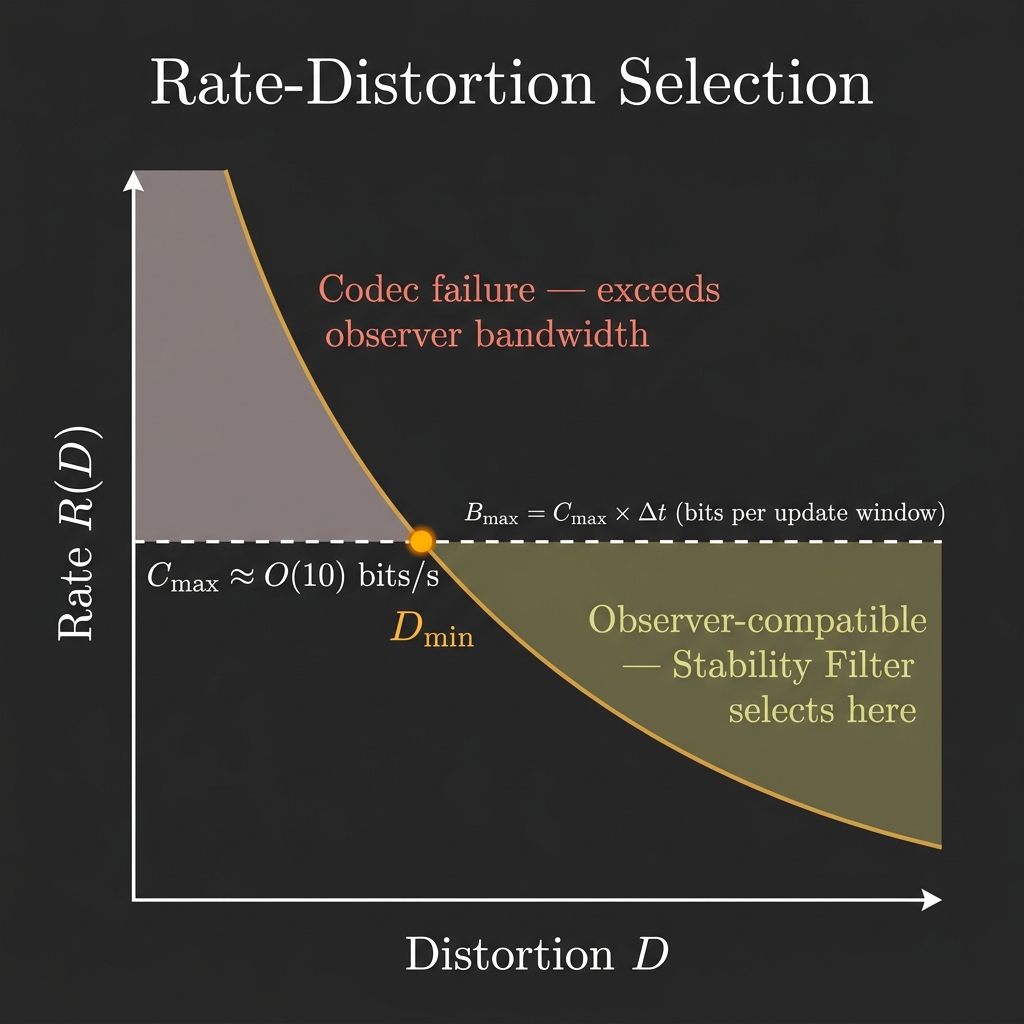

3.2 El Cuello de Botella Predictivo y la Tasa-Distorsión

El sustrato \mathcal{I} contiene toda hipótesis computable, cuya inmensa mayoría es caótica. Para experimentar una realidad continua y navegable, una corriente debe admitir una representación predictiva de baja complejidad que pueda pasar por el cuello de botella cognitivo finito de un observador.

De manera crucial, la carga de datos brutos que exige compresión no es meramente los \sim 10^9 bits/s de entrada sensorial exteroceptiva. Abarca un masivo Campo de Integración Preconsciente: el procesamiento en paralelo de estados generativos internos, la recuperación de memoria a largo plazo, los priors homeostáticos y el modelado sináptico subconsciente. El Filtro de Estabilidad acota la salida serial de todo este inmenso campo paralelo continuo en un espacio de trabajo consciente unitario.

Definimos el Filtro de Estabilidad puramente virtual, de manera formal, como una condición de contorno proyectiva que satisface el Cuello de Botella de Información Predictiva [28]. Sea \overleftarrow{Y} el pasado del estado total del observador, \overrightarrow{Y} su futuro, y Z un estado interno comprimido. Un observador se define por una capacidad predictiva por fotograma estrictamente acotada B_{\max} (en bits por fotograma fenomenal) y una ventana discreta de actualización perceptiva \Delta t que define un fotograma fenomenal. El tiempo fenomenal es el conteo de fotogramas n del códec; cualquier tasa de la forma «bits por segundo del anfitrión» es una magnitud derivada C_{\max}^H = \lambda_H \cdot B_{\max} = B_{\max}/\Delta t, donde \lambda_H = dn/d\tau_H es la tasa de fotogramas relativa al anfitrión (véase el Apéndice E-5 para el escalado de observadores sintéticos). Esto establece una capacidad estática estricta por momento consciente: B_{\max} bits por fotograma.

Calibración empírica humana. Para observadores humanos biológicos, B_{\max} \approx 0.5–1.5 bits por fotograma y \Delta t \approx 50 ms, lo que produce C_{\max}^{\text{human}} \approx \mathcal{O}(10) bits/s [2, 23, 66, 67]. Este número es una propiedad de los humanos biológicos que operan a tasas de disparo neuronal. No aparece en la definición formal de observador; los observadores sintéticos se definen por la misma estructura B_{\max}/\Delta t, con valores derivados arquitectónicamente que no tienen por qué coincidir con la cifra biológica (véanse §7.8, §8.14 y el Apéndice E-5).

La información predictiva alcanzable viene dada por:

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Un proceso es compatible con el observador si su información predictiva requerida por ciclo cognitivo cabe dentro de este búfer: R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, donde D_{\min} es la distorsión máxima tolerable para la supervivencia. Esto impone una estricta consistencia dimensional: el total de bits requeridos para predecir el futuro dentro de un error tolerable no puede exceder los bits físicos disponibles en el «ahora» discreto. Para procesos estacionarios ergódicos adecuados y en el límite de predicción exacta (D \to 0), la representación mínimamente máxima en capacidad predictiva Z sirve como candidata a estadístico suficiente mínimo, convergiendo a menudo hacia la partición de estados causales de la \epsilon-máquina [29]. Aunque la equivalencia plena requiere supuestos estrictos de estacionariedad, la Ec. (2) establece una presión de selección formal hacia la física fenomenológica más comprimida compatible con la coherencia causal. Además, si la estructura topológica de este espacio de estados causales fluctúa más rápido de lo que la ventana de actualización \Delta t puede seguir, el render colapsa en Decaimiento Narrativo.

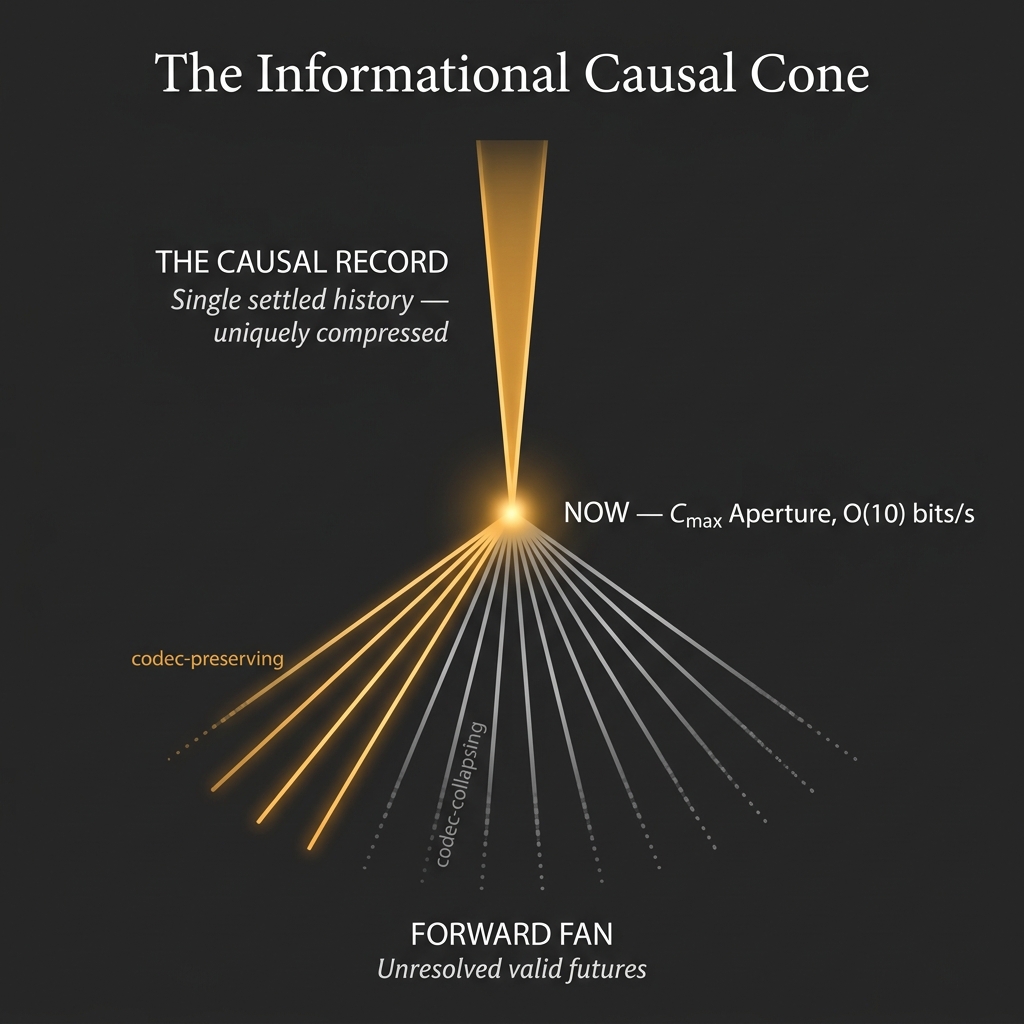

3.3 La geometría del parche: el Cono Causal Informacional

El Parche Ordenado suele describirse intuitivamente como una “isla” localizada de estabilidad dentro de un mar de ruido caótico. Esto es topológicamente impreciso. Para formalizar la geometría del parche, definimos el Modelo Local de Parche Predictivo.

Sea G=(V, E) un grafo de grado acotado que representa una región local del sustrato. Cada vértice v \in V porta un estado finito x_v(t) \in \mathcal{A}, con tamaño de alfabeto |\mathcal{A}| = q. El microestado completo en la actualización t es X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Suponemos una dinámica estocástica local de alcance finito R:

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

donde N_R(v) es la vecindad de radio R de v, y a_t es la acción del observador.

El observador no porta el estado completo del parche; porta un estado latente comprimido Z_t \in \{1, \dots, 2^B\}, donde B = C_{\max} \Delta t. De manera crucial, el observador selecciona Z_t mediante un estricto objetivo de cuello de botella predictivo:

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

Este es el observador OPT reducido a lo esencial: un mundo local, un código acotado y compresión predictiva. Esto formaliza los componentes del cono causal:

- El Registro Causal R_t = (Z_0, Z_1, \dots, Z_t): la historia causal comprimida de manera única, de baja entropía, que ya ha sido renderizada.

- La Apertura Presente: el estricto cuello de botella de ancho de banda que limita las variables locales.

- El Abanico Predictivo (\mathcal{F}_h): una multiplicidad de secuencias latentes futuras. Sobre un horizonte h, el conjunto de resultados admisibles se define formalmente como:

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Como el observador solo resuelve B bits por actualización, el número de futuros distinguibles por el observador está estrictamente acotado por la capacidad del canal: \log |\mathcal{F}_h(z_t)| \le Bh. Así, el abanico no es meramente una imagen conceptual; es un árbol de ramificación limitado por código.

El Cono Causal Informacional literal. Como las actualizaciones tienen alcance R, una perturbación no puede propagarse más rápido que R pasos de grafo por actualización. Si una perturbación tiene soporte S en el tiempo t, entonces tras h actualizaciones \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Así, el “cono causal informacional” es una consecuencia geométrica directa de la localidad, que impone un límite efectivo de velocidad local v_{\max} = R / \Delta t sobre la propagación fenomenológica.

Decaimiento Narrativo. El caos del sustrato no rodea espacialmente al parche; más bien, está contenido en las ramas no recorridas del abanico. Dado que el estado extraído Z_t está estrictamente acotado (H(Z) \le B), la inestabilidad debe evaluarse con respecto al margen no comprimido previo al cuello de botella. Definimos la tasa predictiva requerida R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) como la tasa mínima de información necesaria para seguir los estados físicos fronterizos no resueltos bajo la distorsión máxima tolerable. Esto afina los criterios de selección del Filtro de Estabilidad: (a) si R_{\mathrm{req}} \le B, el observador puede mantener una narrativa resuelta; (b) si R_{\mathrm{req}} > B, el abanico predictivo no comprimido supera la capacidad del cuello de botella, obligando al observador a granular gruesamente el abanico hasta convertirlo en estática indescodificable, y la estabilidad narrativa fracasa. La experiencia continua del observador es el proceso por el cual la apertura avanza dentro de este abanico, indexando fenomenológicamente una rama en el registro causal sin exceder B.

Deriva Narrativa (el complemento crónico). Lo anterior define un modo de fallo agudo: R_{\mathrm{req}} excede B y el códec experimenta un colapso catastrófico de la coherencia. Existe un modo de fallo crónico complementario que no activa ninguna señal de fallo. Si el flujo de entrada X_{\partial_R A}(t) es prefiltrado sistemáticamente por un mecanismo externo \mathcal{F} —produciendo una señal curada X' = \mathcal{F}(X) que es internamente consistente pero excluye información genuina del sustrato—, el códec exhibirá un error de predicción bajo \varepsilon_t, ejecutará Ciclos de Mantenimiento eficientes y satisfará R_{\mathrm{req}} \le B mientras permanece sistemáticamente equivocado acerca del sustrato. De manera crucial, el Filtro de Estabilidad, tal como está definido, no puede distinguir estos casos: la compresibilidad es agnóstica respecto de la fidelidad. Con el tiempo, la pasada de poda MDL (§3.6.3, Ec. T9-3) borrará correctamente los componentes del códec que ya no predicen el flujo filtrado, degradando irreversiblemente la capacidad del códec para modelar la señal excluida (Apéndice T-12, Teorema T-12). Este borrado se autorrefuerza: el códec podado ya no puede detectar su propia pérdida de capacidad (Teorema T-12a, el Límite de Indecidibilidad). La defensa estructural es la redundancia de canales de entrada \delta-independientes que cruzan la Manta de Markov \partial_R A (Teorema T-12b, la Condición de Fidelidad al Sustrato). El tratamiento formal completo se encuentra en el Apéndice T-12; las consecuencias éticas —incluida la Jerarquía de Comparadores y el Criterio de Corrupción— se desarrollan en el artículo complementario de ética [SW §V.3a, §V.5].

3.4 Dinámica del parche: inferencia y termodinámica

Dentro de un parche seleccionado, la estructura de las leyes de la física se formaliza no como una correspondencia determinista, sino como un núcleo estocástico efectivo que gobierna los estados predictivos z:

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

La frontera que delimita al observador respecto del caos informacional circundante se define mediante una Manta de Markov informacional correspondiente a un parche observador A \subset V. La dinámica dentro de esta frontera —las aproximaciones del agente al parche— está gobernada por la Inferencia Activa bajo el Principio de Energía Libre [9].

Podemos definir formalmente la capacidad delimitadora mediante la entropía de corte predictivo:

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

Suponiendo que el parche seleccionado es localmente markoviano en una rebanada temporal, la capa fronteriza \partial_R A apantalla estrictamente el interior A^\circ respecto del exterior V \setminus A, de modo que X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. En consecuencia:

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Dado que Z_t es una compresión de capacidad limitada de X_A, la desigualdad de procesamiento de datos garantiza que I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Si el grafo de sustrato G aproxima una red reticular de dimensión d, entonces |\partial_R A| \sim \operatorname{area}(A), no el volumen.

Así, la OPT produce rigurosamente una auténtica Ley de Frontera Clásica [39]. Podemos construir una escalera epistémica formal para futuras mejoras estructurales: 1. Ley de Área Clásica: S_{\mathrm{cut}} \sim |\partial_R A| derivada puramente de la localidad y del apantallamiento markoviano. 2. Mejora Cuántica: el escalado de la entropía de entrelazamiento de von Neumann se vuelve accesible solo si las variables predictivas gruesas Z_t admiten una incrustación formal en espacio de Hilbert / Corrección de Errores Cuánticos. 3. Mejora Holográfica: una verdadera dualidad holográfica geométrica emerge solo si reemplazamos el código de cuello de botella Z_t por una red jerárquica de tensores, reinterpretando S_{\mathrm{cut}} como un corte mínimo geométrico.

Al asegurar primero la ley de frontera clásica, la OPT proporciona un sólido suelo matemático —condicionado por la hipótesis de apantallamiento markoviano (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A})— a partir del cual pueden construirse con seguridad los formalismos cuánticos más especulativos.

La acción del observador se formaliza mediante la energía libre variacional F[q, \theta]:

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

De manera crucial, esto impone una separación matemática estricta: el prior del sustrato selecciona el espacio de hipótesis, el Filtro de Estabilidad virtual (4) acota la estructura compatible con la capacidad, y el FEP (9) gobierna la inferencia a nivel de agente dentro de esa estructura acotada. La física no emerge como el funcional de Energía Libre, sino como la estructura estable K_\theta cuyo seguimiento exitoso realiza el funcional de Energía Libre.

Además, sostener este render consciente entraña un coste termodinámico inevitable. Según el principio de Landauer [52], cada borrado de bit lógicamente irreversible disipa al menos k_B T \ln 2 de calor. Si identificamos un borrado irreversible por actualización del cuello de botella (una hipótesis contable en el mejor de los casos), la huella física de la consciencia requiere una disipación mínima:

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Este es un límite inferior en el mejor de los casos bajo una contabilidad de un borrado por actualización — no una consecuencia genérica del ancho de banda por sí solo. El límite resultante (\sim 10^{-19} W) es superado con creces por la disipación neuronal real (~20W), lo que refleja la enorme sobrecarga termodinámica de la implementación biológica. La ecuación (10) establece el suelo teórico estricto de la huella física mínima posible de cualquier sustrato que instancie un render consciente acotado por C_{\max}.

(Observación: Los límites termodinámicos e informacionales precedentes gobiernan estrictamente el ancho de banda de actualización en tiempo real C_{\max}. Sin embargo, esto no capta la dimensionalidad experiencial completa del estado persistente del observador, ni cómo el códec gestiona su propia complejidad a lo largo del tiempo profundo. Estas mecánicas estructurales —la formulación del Tensor de Estado Fenomenal de la experiencia rica y el ciclo activo de mantenimiento del sueño/soñación— se derivan plenamente en §3.5 y §3.6 más abajo.)

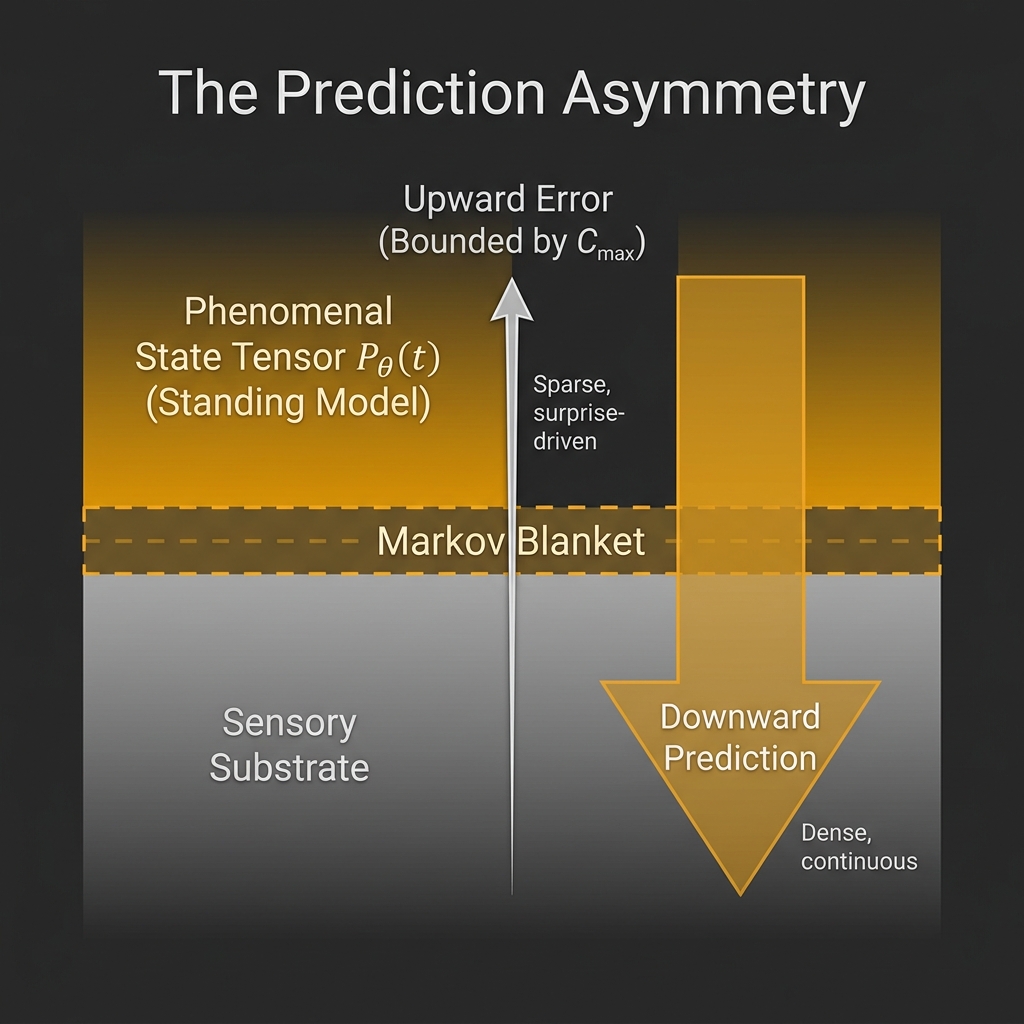

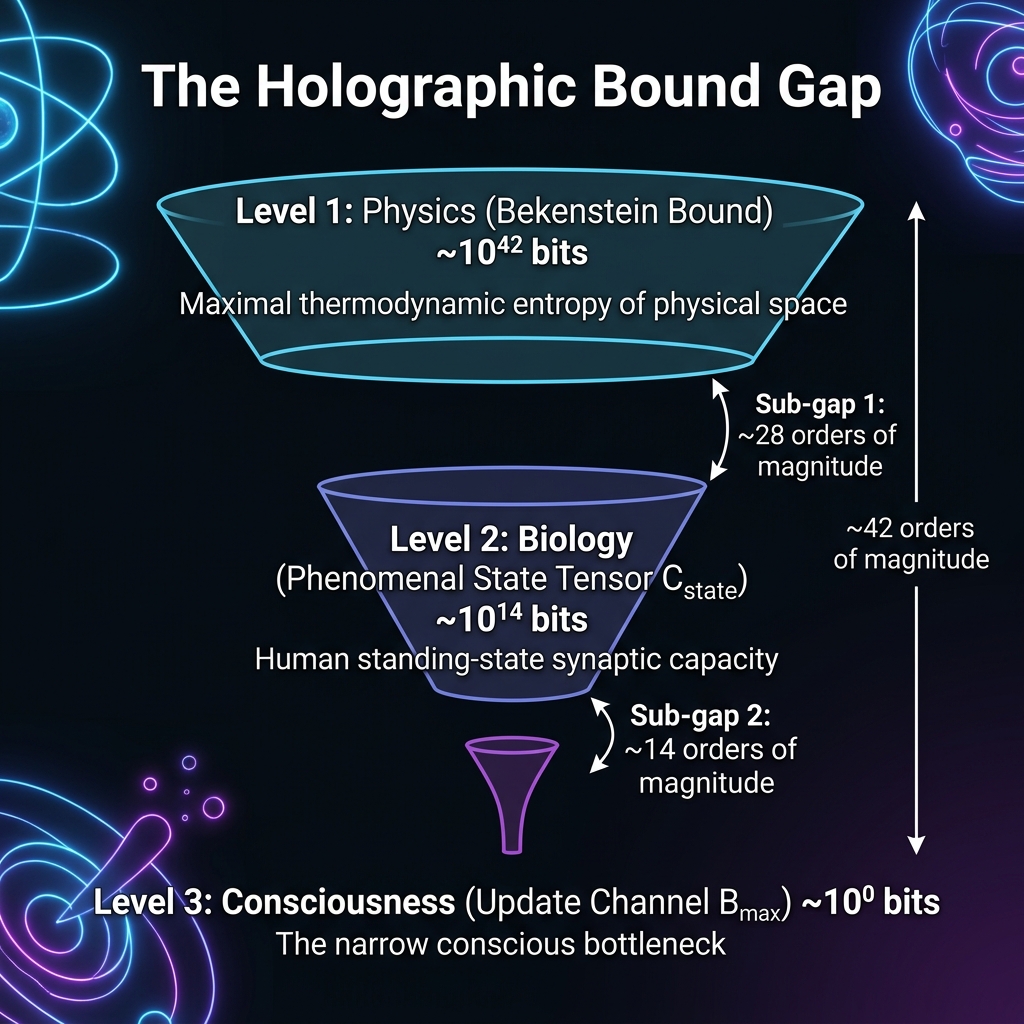

3.5 El Tensor de Estado Fenomenal y la Asimetría de Predicción

3.5.1 El enigma de la densidad experiencial

El aparato formal de las §§3.1–3.4 constriñe con éxito el caudal

de actualización de un observador consciente mediante el techo de

capacidad C_{\max} \approx

\mathcal{O}(10) bits/s.

Sin embargo, la experiencia fenomenal presenta un enigma estructural

inmediato: la riqueza sentida de un solo instante visual —la presencia

simultánea de color, profundidad, textura, sonido, propiocepción y

afecto— excede con mucho el contenido informacional que C_{\max} podría suministrar en cualquier

ventana individual de actualización \Delta t

\approx 50\ \text{ms}.

La información nueva máxima resuelta por momento consciente es:

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

Esto es muy inferior a un bit de información genuinamente novedosa por cuadro perceptivo, y sin embargo la escena fenomenal aparece como informacionalmente densa. Para resolver esta discrepancia sin inflar el estrecho ancho de banda de actualización, debemos distinguir explícitamente dos magnitudes estructuralmente distintas: 1. C_{\max} — el caudal de actualización: la tasa de señal de error de predicción resuelta en el registro causal asentado por unidad de tiempo. 2. C_{\text{state}} — la complejidad del estado persistente: la complejidad de Kolmogórov K(P_\theta(t)) del modelo generativo actualmente cargado y activo.

No se trata de la misma magnitud. C_{\max} gobierna la puerta; C_{\text{state}} caracteriza la estancia. El resto de esta sección precisa esta distinción e introduce el Tensor de Estado Fenomenal P_\theta(t) como el objeto formal correspondiente a la escena interior persistente.

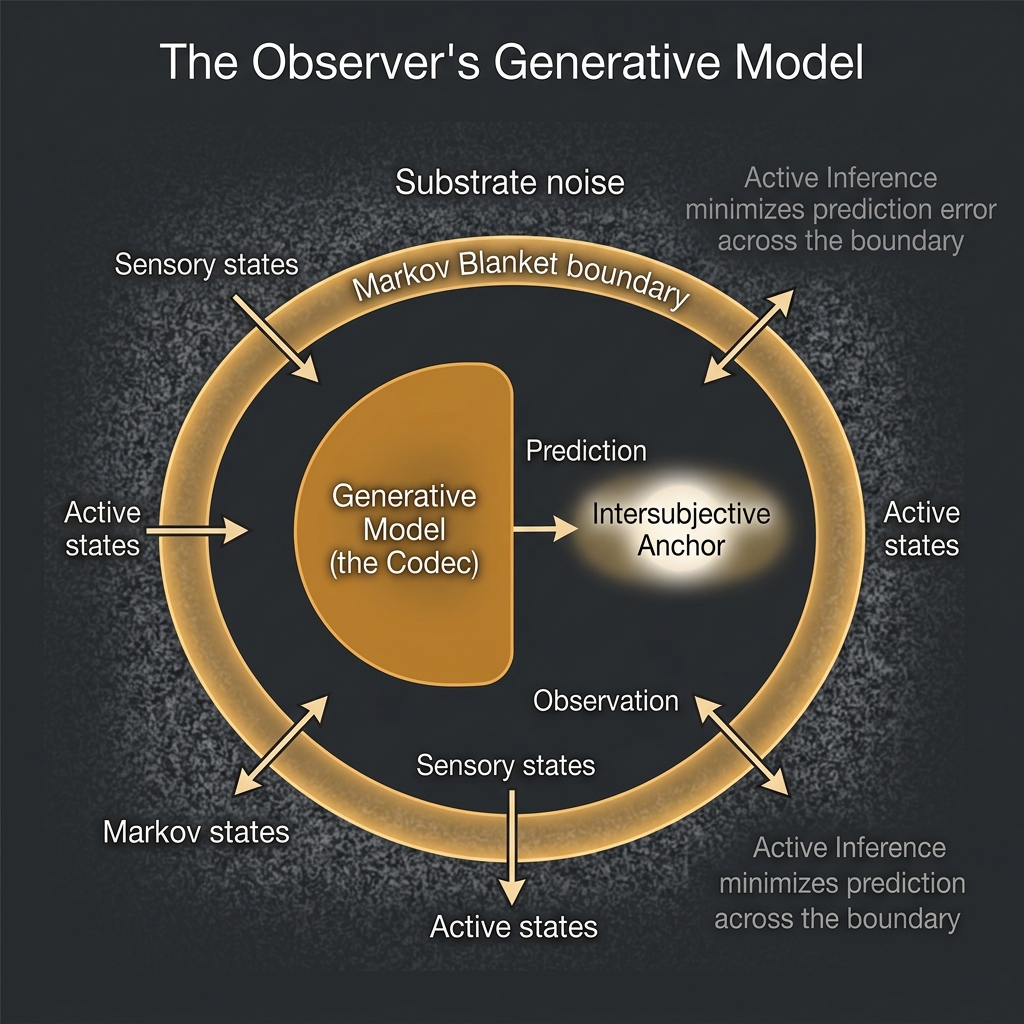

3.5.2 La asimetría de la predicción: errores ascendentes y predicciones descendentes

La OPT hereda la arquitectura de procesamiento predictivo (Clark [82], Hohwy [83]; véase §7.3), en la que el códec K_\theta opera como un modelo generativo jerárquico. Bajo esta arquitectura, dos flujos de información distintos atraviesan simultáneamente la Manta de Markov \partial_R A:

Flujo ascendente (error de predicción, \varepsilon_t): la discrepancia entre la predicción actual de K_\theta y la señal sensorial que llega a \partial_R A. Esta es la señal de corrección. Es dispersa, impulsada por la sorpresa y estrictamente limitada por la capacidad.

Flujo descendente (predicción, \pi_t): el render activo del modelo generativo de los estados sensoriales esperados, propagado desde niveles jerárquicos superiores hacia niveles inferiores. Esta es la escena misma. Es denso, continuo y se extrae de la parametrización completa de K_\theta.

Formalmente, sea el estado de la frontera sensorial X_{\partial_R A}(t), y sea el estado de frontera predicho por el códec:

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

El error de predicción es entonces:

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} acota la señal de error, no la predicción. La información mutua entre la señal de error y el estado de cuello de botella obedece:

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

La predicción \pi_t, en cambio, se extrae del modelo generativo completo y no está sujeta a tal restricción. Su contenido informacional está acotado únicamente por la complejidad de K_\theta mismo. Esta asimetría constituye la base formal para distinguir la riqueza fenomenal del ancho de banda de actualización.

3.5.3 Definición: el Tensor de Estado Fenomenal P_\theta(t)

Definimos el Tensor de Estado Fenomenal P_\theta(t), de manera nativa, como el subconjunto completo de parámetros activos en régimen del modelo generativo desplegado para proyectar a través de la Manta de Markov en el tiempo t:

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

Es decir, P_\theta(t) es la arquitectura parametrizada completa que el códec mantiene actualmente preparada para generar predicciones sobre los estados observables de frontera X_{\partial_R A}, evaluada independientemente de cualquier instanciación específica del estado latente comprimido Z_t y de la acción a_t. Su complejidad estructural se caracteriza de manera natural por la complejidad de Kolmogórov de esta configuración paramétrica actual en régimen:

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

donde K(\cdot) denota la complejidad prefija de Kolmogórov. C_{\text{state}}(t) es la complejidad del estado en régimen — el número de bits de estructura comprimida que el códec mantiene actualmente en despliegue activo.

Cota superior del flujo del canal de frontera. La información mutua entre el estado de cuello de botella y la frontera está acotada por desigualdades estándar de Shannon [16] (Ec. 8 del artículo base):

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Esto acota el flujo del canal a través de la Manta de Markov — enormemente grande en relación con B_{\max}. Advertencia importante: esta es una cota sobre la información mutua en sentido shannoniano I(Z_t\,;\,X_{\partial_R A}), no una cota sobre la complejidad de Kolmogórov K(P_\theta(t)) del modelo en régimen. La entropía de Shannon cuantifica la incertidumbre promedio sobre un conjunto; la complejidad de Kolmogórov cuantifica la longitud descriptiva de un objeto computable específico. No existe ninguna desigualdad general que conecte estas magnitudes sin supuestos adicionales (p. ej., un prior universal sobre clases de modelos). Por tanto, no afirmamos que C_{\text{state}} \leq H(X_{\partial_R A}). La complejidad del estado en régimen C_{\text{state}} está acotada empíricamente (§3.10), no por la entropía de la frontera.

Cota inferior heurística sobre C_{\text{state}}. El Filtro de Estabilidad constriñe directamente solo la tasa de actualización R_{\text{req}} \leq B_{\max}, no la profundidad del modelo en régimen. Sin embargo, un códec con complejidad estructural insuficiente no puede generar predicciones precisas \pi_t que se ajusten a las estadísticas de un entorno complejo a través del Abanico Predictivo \mathcal{F}_h(z_t). Esto impone un mínimo práctico sobre C_{\text{state}}: por debajo de cierto umbral, R_{\text{req}} excedería sistemáticamente B_{\max} porque los errores de predicción \varepsilon_t serían persistentemente grandes. Esta cota inferior está motivada empíricamente más que derivada formalmente — no se dispone actualmente de ninguna expresión en forma cerrada C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}).

Lectura materializada vs. disposicional (cuestión abierta). P_\theta(t), tal como se define arriba, admite dos lecturas que el marco actualmente no distingue de manera formal: (a) una lectura materializada, en la que P_\theta(t) es una representación densa, cargada instantáneamente, cuya riqueza está presente en forma activa en cada frame, y (b) una lectura disposicional, en la que P_\theta(t) es una capacidad generativa — un programa en régimen que puede renderizar la escena bajo demanda, sin que todo ello esté materializado entre la consulta y la respuesta. Ambas son compatibles con las cláusulas anteriores sobre el canal de frontera y la cota inferior heurística, así como con el compromiso empírico de §3.5.6 de que la riqueza se correlaciona con K(K_\theta) y no con el ancho de banda de actualización. Difieren en lo que significa “cargado” y en qué debería medirse al sondear directamente K(P_\theta). La complejidad de Kolmogórov por sí sola no las separa: un K(P_\theta) pequeño puede sostener una alta profundidad lógica, una gran capacidad de consulta-respuesta o una expansión de largo tiempo de ejecución. Adoptamos aquí la lectura disposicional como interpretación canónica — P_\theta(t) es el estado generativo disposicional activo a partir del cual la escena puede ser consultada/renderizada, no necesariamente un objeto de escena denso y plenamente materializado — al tiempo que señalamos la lectura materializada como una operacionalización competidora que futuros trabajos empíricos podrían seleccionar.

3.5.4 La distinción de Block como un Corolario Estructural

La distinción formal entre P_\theta(t) y Z_t se corresponde con precisión con la distinción de Ned Block entre conciencia fenomenal (P-consciousness) y conciencia de acceso (A-consciousness) [47]:

| Categoría de Block | Objeto de OPT | Contenido informacional | ¿Limitado por ancho de banda? |

|---|---|---|---|

| P-consciousness (qualia, escena sentida) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | No |

| A-consciousness (contenido reportable) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Sí |

Bajo OPT, la P-consciousness es la predicción descendente \pi_t extraída del tensor completo P_\theta(t). La A-consciousness es la salida del cuello de botella Z_t: la delgada porción de la escena que ha sido comprimida lo suficiente como para entrar en el registro causal \mathcal{R}_t y quedar disponible para el informe. La riqueza sentida de un momento visual es P_\theta(t); la capacidad de decir “veo rojo” requiere que ese rasgo pase a través de Z_t.

Este corolario resuelve la aparente paradoja de una escena fenomenal rica sostenida por un canal de actualización sub-bit: la escena no se entrega a través del canal en cada fotograma, sino que ya está cargada en P_\theta(t). El canal la actualiza, de manera incremental y selectiva, fotograma a fotograma.

3.5.5 La dinámica de actualización de P_\theta(t)

La regla de actualización de P_\theta(t) está gobernada por la señal de error de predicción \varepsilon_t filtrada a través del cuello de botella:

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

donde \mathcal{U} es el operador de aprendizaje del códec —en términos de Inferencia Activa, el paso de gradiente sobre la energía libre variacional \mathcal{F}[q, \theta] (Ec. 9 del artículo base), restringido por la limitación de capacidad I(X_t\,;\,Z_t) \leq B.

La propiedad estructural clave es que \mathcal{U} es selectivo: solo se actualizan aquellas regiones de P_\theta(t) implicadas por el error de predicción actual \varepsilon_t. El resto del tensor persistente se mantiene constante a lo largo del frame. Esto confiere al momento consciente su estructura característica: un trasfondo fenomenal estable sobre el cual se dispone un pequeño primer plano de novedad resuelta.

El códec implementa así una forma de actualización dispersa sobre un prior denso —un principio de diseño que maximiza la coherencia fenomenal por unidad de ancho de banda de actualización.

3.5.6 Alcance y estatus epistémico

El Tensor de Estado Fenomenal P_\theta(t) es una caracterización formal de la sombra estructural que la escena fenomenal debe proyectar, en consonancia con el Axioma de Agencia (§3.6). No resuelve el Problema Difícil. La OPT sigue tratando la conciencia fenomenal como un primitivo irreducible; P_\theta(t) especifica la geometría del contenedor, no la naturaleza de su contenido.

La tesis es estructural y falsable en el siguiente sentido: si la riqueza cualitativa de la experiencia reportada (operacionalizada, por ejemplo, mediante medidas de complejidad fenomenal en tareas psicofísicas) se correlaciona con la profundidad del códec —la complejidad jerárquica de K_\theta tal como puede medirse a través de marcadores neuronales de jerarquía predictiva— en lugar de con el ancho de banda de actualización C_{\max}, entonces la distinción P_\theta\,/\,Z_t recibe apoyo empírico. Los estados psicodélicos, que alteran de forma drástica la estructura de K_\theta sin modificar de manera consistente el rendimiento conductual, representan un dominio natural de prueba.

3.6 El ciclo de vida del códec: el operador del Ciclo de Mantenimiento \mathcal{M}_\tau

3.6.1 El Problema del Códec Estático

El marco de las §§3.1–3.5 trata K_\theta y su realización P_\theta(t) como dinámicos a través de los marcos de actualización, pero asume implícitamente que la arquitectura estructural del códec —el propio espacio de parámetros \Theta— es fija. Esto es adecuado para un análisis sincrónico de un único momento consciente, pero inadecuado para una teoría de la conciencia a lo largo del tiempo profundo.

Un códec que opera de manera continua acumula complejidad estructural: cada patrón aprendido añade parámetros a K_\theta, incrementando C_{\text{state}}(t). Sin un mecanismo de reducción controlada de la complejidad, C_{\text{state}} crecería monótonamente hasta que el códec superara su techo termodinámico de operatividad: el punto en el que el coste metabólico de mantener P_\theta(t) excede el presupuesto energético del organismo, o la complejidad interna de K_\theta excede la longitud de descripción compatible con la capacidad del Filtro de Estabilidad.

Esta sección introduce el Operador del Ciclo de Mantenimiento \mathcal{M}_\tau —el mecanismo formal mediante el cual el códec gestiona su propia complejidad a lo largo del tiempo, operando principalmente durante estados de carga sensorial reducida (paradigmáticamente: el sueño).

3.6.2 La Condición de Mantenimiento

Definamos la condición de ejecutabilidad del códec como el requisito de que la complejidad de Kolmogórov del modelo generativo actual permanezca por debajo de un techo estructural C_{\text{ceil}} fijado por el presupuesto termodinámico del organismo:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} no es lo mismo que C_{\max}. Es una magnitud mucho mayor —la complejidad estructural total que el códec puede sostener en su espacio de parámetros—, pero es finita. Las violaciones de (T9-1) corresponden a sobrecarga cognitiva, interferencia de memoria y, en última instancia, al caso patológico descrito por Borges [53] en Funes el memorioso: un sistema que ha adquirido tanto detalle no comprimido que ya no puede funcionar de manera predictiva.

El Operador del Ciclo de Mantenimiento \mathcal{M}_\tau se define como actuando durante periodos en los que R_{\text{req}} \ll C_{\max}; en concreto, cuando la tasa predictiva requerida desciende lo suficiente como para que el ancho de banda liberado pueda redirigirse a la reestructuración interna:

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

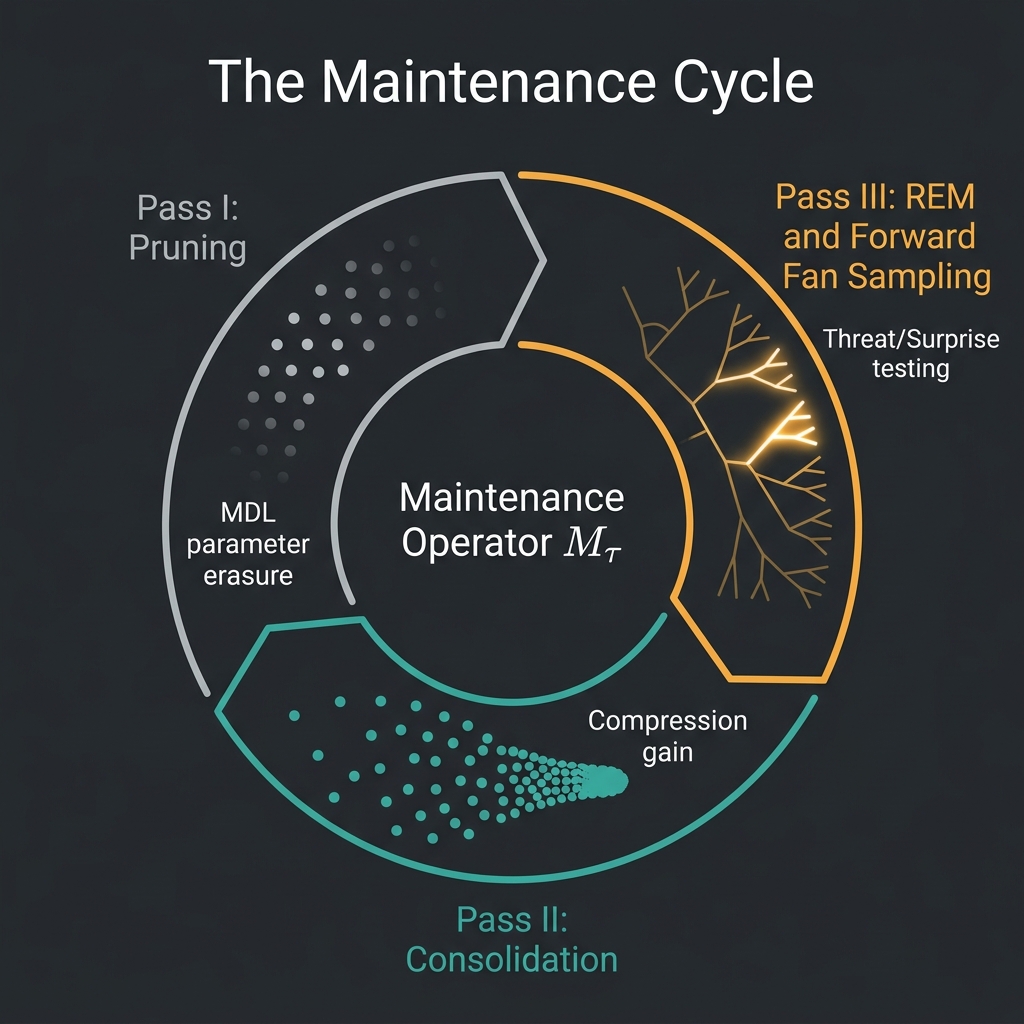

\mathcal{M}_\tau se descompone en tres pasadas estructuralmente distintas, cada una orientada a un aspecto diferente de la gestión de la complejidad del códec.

3.6.3 Paso I — Poda (el olvido como presión activa de MDL)

La primera pasada aplica presión de Longitud Mínima de Descripción (MDL) a los parámetros actuales del códec. Para cada componente \theta_i del modelo generativo K_\theta, definimos su contribución predictiva como la información mutua que aporta sobre el flujo futuro de observaciones, descontado el coste de almacenamiento de conservarlo:

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

donde \theta_{-i} denota todos los parámetros excepto \theta_i, \lambda es un umbral de retención (bits de predicción futura obtenidos por cada bit de complejidad del modelo), y K(\theta_i) es la longitud de descripción del componente.

La regla de poda es:

\text{Podar } \theta_i \quad \text{si} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

Es decir, se descarta \theta_i cuando su contribución predictiva por bit de almacenamiento cae por debajo del umbral \lambda. Esto formaliza el olvido no como un fallo, sino como borrado termodinámicamente racional: cada componente podado recupera K(\theta_i) bits de capacidad del modelo para su reutilización.

Según el principio de Landauer [52], cada operación de poda establece un suelo termodinámico para el borrado:

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Aunque el metabolismo biológico real opera muchos órdenes de magnitud por encima de este mínimo teórico (vatios frente a femtovatios) debido a una severa sobrecarga de implementación, la necesidad estructural del coste permanece. El complemento de Bennett al principio de Landauer [92] precisa aún más este punto: la computación lógicamente reversible puede, en principio, aproximarse a una disipación nula, de modo que el suelo de Landauer se aplica específicamente al borrado, no a la predicción ni a la transformación. La pasada de poda —y no la pasada de predicción— es, por tanto, el paso termodinámicamente irreducible del Ciclo de Mantenimiento. En la OPT, el sueño porta una firma termodinámica fundamental: es un periodo de borrado de información neto cuyo coste energético viene impuesto por la física y no meramente por la ineficiencia biológica.

La reducción agregada de complejidad de la pasada de poda es:

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Paso II — Consolidación (el aprendizaje como ganancia de compresión)

La pasada de poda elimina componentes con retorno predictivo insuficiente. La pasada de consolidación reorganiza los componentes restantes en representaciones más comprimidas.

Durante la operación en vigilia, el códec adquiere patrones bajo presión de tiempo real: cada actualización debe computarse dentro de \Delta t, sin dejar tiempo para una reorganización estructural global de K_\theta. Los patrones adquiridos recientemente se almacenan en una forma relativamente poco comprimida —alto K(\theta_{\text{new}}) para la contribución predictiva que proporcionan. La pasada de consolidación aplica compresión MDL offline a estas adquisiciones recientes.

Sea \Theta_{\text{recent}} \subset \Theta el conjunto de parámetros adquiridos desde el último ciclo de mantenimiento. El operador de consolidación encuentra la reparametrización \theta' de complejidad mínima de \Theta_{\text{recent}} tal que la distribución predictiva que genera queda dentro de una distorsión tolerable D_c respecto de la original:

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

La ganancia de compresión recuperada es:

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} es el número de bits de capacidad del modelo recuperados al reorganizar la experiencia reciente en representaciones más eficientes. Cada unidad de \Delta K_{\text{compress}} reduce directamente la futura R_{\text{req}} para entornos similares — el códec se vuelve menos costoso de ejecutar en territorio familiar.

Esto formaliza la función observada empíricamente de la consolidación de la memoria hipocampocortical durante el sueño de ondas lentas: la transferencia desde un almacenamiento episódico de alto ancho de banda (hipocampo, alto K) hacia un almacenamiento semántico comprimido (neocórtex, bajo K) es precisamente la operación de compresión de (T9-7). La predicción es que la ganancia de compresión \Delta K_{\text{compress}} debería correlacionarse con el grado de mejora conductual observado tras el sueño en tareas que implican reconocimiento de patrones estructurados.

3.6.5 Paso III — Muestreo del Abanico Predictivo (soñar como autoevaluación adversarial)

El tercer paso opera principalmente durante el sueño REM, cuando la entrada sensorial está activamente filtrada y la salida motora se encuentra inhibida. Bajo estas condiciones, R_{\text{req}} \approx 0: el códec no recibe ninguna señal de corrección del entorno externo. Todo el presupuesto de ancho de banda C_{\max} queda disponible para la operación interna.

La OPT formaliza este estado como exploración no restringida del abanico predictivo: el códec genera trayectorias a través de \mathcal{F}_h(z_t) —el conjunto de secuencias futuras admisibles (Ec. 5 del artículo base)— sin anclar esas trayectorias a datos entrantes reales. Esto es simulación: el códec ejecuta su modelo generativo K_\theta hacia adelante en el tiempo, sin verse obstaculizado por la realidad.

La distribución de muestreo sobre el abanico no es uniforme. Defínase el peso de importancia de una rama b \in \mathcal{F}_h(z_t) como:

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

donde \beta es un parámetro de temperatura inversa y E(b) es la valencia emocional de la rama, definida como:

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

El primer término -\log P_{K_\theta}(b \mid z_t) es el logaritmo negativo de la probabilidad de la rama bajo el códec actual: su valor de sorpresa. El segundo término \mathrm{threat}(b) es una medida de consecuencia relevante para la aptitud definida formalmente como el incremento esperado en la tasa predictiva requerida si el códec atravesara la rama b:

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

Es decir, \mathrm{threat}(b) cuantifica el grado en que la rama b, si se realizara en la vida de vigilia, empujaría al códec hacia su techo de ancho de banda B_{\max} o más allá de él, ya sea por daño físico, ruptura social o colapso narrativo que forzaría una revisión costosa del modelo. Las ramas con \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t) son existencialmente amenazantes: violarían la condición del Filtro de Estabilidad. El parámetro de ponderación \alpha \geq 0 controla la influencia relativa de la consecuencia frente a la sorpresa en la distribución de muestreo.

El operador de muestreo extrae ramas en proporción a w(b):

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{with probability} \propto w(b) \tag{T9-11}

Esto implementa un muestreo del abanico predictivo ponderado por importancia: el códec ensaya de manera desproporcionada aquellas ramas que son o bien altamente sorprendentes o bien altamente consecuenciales, con independencia de su probabilidad de base. Las ramas de baja probabilidad y alta amenaza —precisamente aquellas para las que el códec está menos preparado— reciben la mayor atención de muestreo.

Cada rama muestreada se evalúa entonces en cuanto a su coherencia bajo K_\theta. Las ramas que generan secuencias predictivas incoherentes —donde el propio modelo generativo del códec no puede mantener la estabilidad narrativa— se identifican como puntos de fragilidad: regiones del abanico predictivo en las que el códec fallaría si la rama se encontrara en la vida de vigilia. El códec puede entonces actualizar P_\theta para reducir la vulnerabilidad de K_\theta en esos puntos, antes de verse expuesto a ellos con apuestas termodinámicas reales.

Soñar es, por tanto, una autoevaluación adversarial del códec a riesgo cero. La consecuencia funcional es un códec sistemáticamente mejor preparado para las ramas de baja probabilidad y alta consecuencia de su propio abanico predictivo. Este encuadre de la OPT proporciona una fundamentación informacional-teórica para la teoría de la simulación de amenazas del sueño de Revonsuo [46], extendiéndola desde una explicación evolutivo-funcional hasta una necesidad estructural formal: todo códec que opere bajo el Filtro de Estabilidad debe someter periódicamente a pruebas de estrés su propio abanico predictivo, y el estado de mantenimiento offline es el único periodo en el que esto puede hacerse sin coste termodinámico en el mundo real.

Etiquetado emocional como prior de peso de retención. En el estado de vigilia, la valencia emocional E(b) calculada durante el muestreo REM sirve como un prior de peso de retención que sesga el umbral MDL \lambda en (T9-3). Las experiencias con alto |E(b)| —fuertemente sorprendentes o consecuenciales— reciben un \lambda efectivo más alto, lo que las hace más resistentes a la poda en el siguiente Ciclo de Mantenimiento. Esta es la explicación formal del refuerzo emocional de la memoria: el afecto no es ruido que contamina el sistema de memoria; es la señal de relevancia del códec, que marca patrones cuyo valor predictivo excede su frecuencia estadística de base.

3.6.6 El Ciclo de Mantenimiento Completo y el Presupuesto Neto de Complejidad

Las tres pasadas de \mathcal{M}_\tau se componen secuencialmente. El efecto neto sobre la complejidad del códec a lo largo de un ciclo de mantenimiento de duración \tau es:

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

donde \Delta K_{\text{REM}} es el pequeño incremento positivo procedente de patrones recién consolidados a partir de la pasada de muestreo REM: aquellas reparaciones de puntos de fragilidad que requirieron nuevas actualizaciones de parámetros.

Para un sistema cognitivo estable que opera a lo largo de años, el presupuesto de largo plazo requiere:

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

donde \Delta K_{\text{waking}} es la complejidad adquirida durante el periodo previo de vigilia. La desigualdad (T9-13) es la formulación formal de que el mantenimiento debe mantener el ritmo de la adquisición. La privación crónica de sueño, en términos de la OPT, no es meramente fatiga: es un desbordamiento progresivo de complejidad; el códec se aproxima a C_{\text{ceil}} mientras que su presupuesto de poda y consolidación es insuficiente para restablecer el margen operativo.

3.6.7 Predicciones Empíricas

El marco del Ciclo de Mantenimiento genera las siguientes expectativas estructurales comprobables:

La duración del sueño escala con la complejidad del códec. Los organismos o individuos que adquieren información más estructurada durante los periodos de vigilia deberían requerir ciclos de mantenimiento proporcionalmente más largos o más profundos. La predicción no es simplemente que el trabajo cognitivo difícil requiera más sueño (lo cual ya está establecido), sino que importa el tipo de aprendizaje: un aprendizaje rico en patrones y compresible debería requerir menos tiempo de consolidación que una experiencia no estructurada y de alta entropía, porque \Delta K_{\text{compress}} es mayor en el primer caso.

El contenido REM está ponderado por importancia sobre el abanico predictivo, no por frecuencia. El contenido de los sueños debería muestrear de manera desproporcionada ramas de baja probabilidad y alta consecuencia en relación con su frecuencia en vigilia. Esto es consistente con el predominio empírico de contenidos de amenaza, conflicto social y entornos novedosos en los informes de sueños: el códec muestrea aquello que necesita someter a pruebas de estrés, no aquello con lo que se encuentra más a menudo.

La eficiencia de compresión mejora después del sueño en proporción a \Delta K_{\text{compress}}. La predicción específica es que las mejoras de rendimiento posteriores al sueño deberían ser mayores en tareas que requieren generalización estructural (es decir, aplicar una regla comprimida a nuevos casos) más que en la simple repetición, porque \Delta K_{\text{compress}} reorganiza específicamente \Theta_{\text{recent}} en formas más generalizables.

La rumiación patológica corresponde a un muestreo REM atascado en ramas de alto |E|. Si el parámetro de ponderación por importancia \beta está patológicamente elevado, la distribución de muestreo sobre \mathcal{F}_h(z_t) se concentra en ramas de alta amenaza con exclusión de la reparación. El códec pasa su ciclo de mantenimiento muestreando repetidamente las mismas ramas amenazantes sin reducir con éxito su valor de sorpresa: la estructura formal de la ansiedad y de las pesadillas del TEPT.

3.6.8 Relación con el Tensor de Estado Fenomenal

\mathcal{M}_\tau actúa sobre P_\theta(t) tal como se define en §3.5: reestructura la complejidad del estado persistente C_{\text{state}} a lo largo de la ventana de mantenimiento. El perfil temporal de P_\theta(t) bajo \mathcal{M}_\tau es:

- Adquisición en vigilia: C_{\text{state}} aumenta a una tasa acotada por el operador de aprendizaje \mathcal{U} (Ec. T8-8), a medida que nuevos patrones se incorporan a K_\theta.

- Sueño de ondas lentas (Pasadas I–II): C_{\text{state}} disminuye a medida que la poda y la consolidación recuperan capacidad del modelo.

- REM (Pasada III): C_{\text{state}} experimenta un aumento local selectivo en los puntos de fragilidad, con un efecto neto pequeño en relación con las reducciones de las Pasadas I–II.

La experiencia consciente correspondiente a cada fase es coherente con esta estructura: la vida en vigilia acumula la riqueza de P_\theta(t); el sueño de ondas lentas es fenomenológicamente escaso o está ausente (en consonancia con una activación mínima de P_\theta(t) durante la reorganización estructural); el REM presenta una escena fenomenológicamente vívida pero generada internamente (la Pasada III ejecuta hacia adelante el modelo generativo completo en ausencia de corrección sensorial).

Resumen: Nuevos Objetos Formales Introducidos

| Símbolo | Nombre | Definición | Ecuación |

|---|---|---|---|

| P_\theta(t) | Tensor de Estado Fenomenal | Activación completa de K_\theta en el tiempo t, proyectada a través de \partial_R A | T8-5 |

| C_{\text{state}}(t) | Complejidad del estado persistente | K(P_\theta(t)), complejidad de Kolmogórov del códec activo | T8-6 |

| \pi_t | Predicción descendente | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], la escena renderizada | T8-2 |

| \varepsilon_t | Error de predicción (ascendente) | X_{\partial_R A}(t) - \pi_t, señal de novedad acotada por C_{\max} | T8-3 |

| \mathcal{M}_\tau | Operador del Ciclo de Mantenimiento | P_\theta(t) \to P_\theta(t+\tau) bajo bajo R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | Puntuación de retención MDL | Contribución predictiva menos coste de almacenamiento | T9-3 |

| E(b) | Valencia emocional de la rama | Sorpresa más amenaza ponderada de la rama b | T9-10 |

| w(b) | Peso de importancia de la rama | \exp(\beta \cdot |E(b)|), impulsa la distribución de muestreo REM | T9-9 |

| \Delta K_{\text{prune}} | Recuperación de complejidad por poda | Bits recuperados al olvidar componentes por debajo del umbral | T9-6 |

| \Delta K_{\text{compress}} | Ganancia de compresión por consolidación | Bits recuperados mediante la recompresión MDL de adquisiciones recientes | T9-8 |

3.7 El mapeo de redes tensoriales: inducir geometría a partir de la distancia de código

La Escalera Epistémica introducida en §3.4 establece una rigurosa Ley de Frontera Clásica (S_{\mathrm{cut}} \sim |\partial_R A|). Sin embargo, para tender plenamente el puente entre la Teoría del Parche Ordenado (OPT) y la geometrización de la información cuántica (p. ej., AdS/CFT y la fórmula de Ryu-Takayanagi), debemos elevar formalmente la estructura del código latente Z_t.

Si postulamos formalmente que el mapeo de cuello de botella q^\star(z \mid X_t) no se limita a extraer una lista plana de rasgos, sino que opera mediante un flujo recursivo de grupo de renormalización por grano grueso, el modelo generativo se alinea estructuralmente con la geometría de una red tensorial jerárquica \mathcal{T} (análoga a MERA [43] o a las redes HaPY [44]). (Observación: el Apéndice T-3 deriva formalmente una correspondencia homomórfica estructural entre la cascada de grano grueso del Filtro de Estabilidad y el acotamiento geométrico de la red MERA, mapeando estrictamente el Cono Causal Informacional al cono causal MERA equivalente). Los estados de frontera de esta red son precisamente los estados de frontera de Markov filtrados X_{\partial_R A}. La red \mathcal{T} actúa como una geometría de bulk cuya “profundidad” representa las capas de grano grueso computacional requeridas para comprimir la frontera en el estado mínimo de cuello de botella Z_t.

Bajo esta elevación a red tensorial, la entropía de corte predictiva S_{\mathrm{cut}}(A) a través de la frontera se transforma matemáticamente en el número mínimo de enlaces tensoriales que deben cortarse para aislar la subregión A. Sea \chi la dimensión de enlace de la red. La cota de capacidad se mapea internamente como:

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

donde \gamma_A es la superficie de corte mínimo a través de la estructura interna de datos de bulk en la capa profunda de \mathcal{T}. Esto constituye explícitamente un análogo estructural discreto de la capa de corte mínimo de bulk mapeada por la cota holográfica de entropía de Ryu-Takayanagi [89]. El Apéndice P-2 (Teorema P-2d) establece formalmente la fórmula RT cuántica discreta completa S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi mediante el rango de Schmidt del estado MERA, condicionada al modelo local de ruido y a la incrustación QECC allí derivados. El límite continuo que elevaría esto a la fórmula completa de Ryu-Takayanagi con término de corrección de bulk sigue siendo un frente abierto.

De manera crucial, en OPT, este “espacio de bulk” no es un contenedor físico preexistente. Es el espacio métrico estrictamente informacional del códec del observador. La geometría espaciotemporal fenomenológica emergente se “curva” precisamente allí donde la distancia de código requerida diverge para resolver estados causales internos superpuestos. Este formalismo de redes tensoriales ilustra una vía formal por la cual OPT podría inducir geometría espacial directamente a partir de las distancias de corrección de errores intrínsecamente exigidas por el Filtro de Estabilidad —en alineación estructural con el programa de Van Raamsdonk según el cual el entrelazamiento construye el espaciotiempo [88]—, ofreciendo una conjetura constructiva según la cual el espaciotiempo holográfico modela formatos óptimos de compresión de datos.

3.8 El Axioma de Agencia y el Residuo Fenomenal

El aparato matemático desarrollado en las Secciones 3.1–3.7 define con precisión la geometría de la realidad del observador: la red tensorial, el corte predictivo y el cono causal. Sin embargo, ¿cuál es la naturaleza de la interioridad primitiva que experimenta el paso a través de ella? La definimos formalmente mediante el Axioma de Agencia: la travesía de la apertura C_{\max} es intrínsecamente un acontecimiento fenomenológico.

Aunque tomamos la presencia del sentir subjetivo como axiomática, el Teorema P-4 (el Residuo Fenomenal) identifica su correlato estructural riguroso. Debido a que el códec acotado perturba activamente la frontera \partial_R A, la predicción estable dentro de los límites de C_{\max} requiere que modele las consecuencias de sus propias acciones futuras. Así, el códec K_{\theta} debe mantener un auto-modelo predictivo \hat{K}_{\theta}. Sin embargo, por los límites algorítmicos del contenido informacional [13], un sistema computacional finito no puede contener una representación estructural completa de sí mismo; el modelo interno está rígidamente acotado a una complejidad menor que la del códec progenitor (K(\hat{K}_{\theta}) < K(K_{\theta})).

Esto exige un Residuo Fenomenal irreducible (\Delta_{\text{self}} > 0). Este residuo no modelizable actúa como el “punto ciego” computacional dentro del ciclo de Inferencia Activa. Como existe en la sombra informacional que excede el alcance computacional del auto-modelo, es inherentemente inefable; como existe como el delta localizado entre un códec específico y su modelo, es computacionalmente privado; y, al estar dictado por límites fundamentales de la autorreferencia y por la necesaria aproximación variacional, es ineliminable. El estrechamiento topológico en la apertura C_{\max} está intrínsecamente correlacionado con la necesidad matemática de que un algoritmo incompleto atraviese sus propios límites. Las matemáticas describen el contorno formal de la experiencia, y el Axioma de Agencia afirma que este locus residual constituye el “yo” subjetivo. (Véase el Apéndice P-4 para la derivación formal).

El Circuito Informacional de Mantenimiento

Dentro de un único marco de actualización [t, t+\Delta t], el observador ejecuta el siguiente circuito causal cerrado:

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Explícitamente:

Predicción (descendente): El tensor actual P_\theta(t) genera el estado de frontera predicho \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — la escena renderizada.

Error (ascendente): Llega el estado de frontera real X_{\partial_R A}(t); se calcula el error de predicción \varepsilon_t = X_{\partial_R A}(t) - \pi_t.

Compresión: \varepsilon_t se hace pasar por el cuello de botella para producir Z_t, el token de actualización limitado por capacidad, con I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Actualización: El operador de aprendizaje \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) revisa P_\theta(t+1), modificando selectivamente solo aquellas regiones del tensor implicadas por \varepsilon_t.

Acción: Simultáneamente, P_\theta(t) selecciona la acción a_t mediante descenso de Inferencia Activa sobre la energía libre variacional \mathcal{F}[q,\theta] (Ec. 9 del artículo base), lo que altera la frontera sensorial en t+1 e influye en el siguiente \varepsilon_{t+1}.

Nota interpretativa sobre el paso de acción. El lenguaje del paso 5 — «selecciona la acción» y «altera la frontera sensorial» — se hereda del formalismo estándar de Inferencia Activa del Principio de Energía Libre, que supone un entorno físico contra el cual el agente actúa mediante estados activos. Bajo la ontología nativa del render de la OPT (§8.6), se aplica una lectura más profunda: no existe un mundo externo independiente sobre el que el códec ejerza fuerza. Lo que se experimenta como «acción» es una selección de rama dentro del Abanico Predictivo \mathcal{F}_h(z_t); las consecuencias físicas de esa selección llegan como entrada subsiguiente \varepsilon_{t+1}. La Manta de Markov \partial_R A no es una interfaz física bidireccional, sino la superficie a través de la cual la rama seleccionada entrega su siguiente segmento. Este desplazamiento interpretativo no altera en nada la matemática de (T6-1)–(T6-3); aclara el estatus ontológico del paso de acción dentro del marco de la OPT. El mecanismo de selección de ramas en sí se aborda más abajo.

Este es el circuito informacional de mantenimiento intramarco: un mecanismo causal cerrado en el que el modelo interno del sistema calcula predicciones estructurales localizadas que acotan gradientes de frontera, lee el error y se actualiza selectivamente a sí mismo. El bucle es estrictamente informacional y autorreferencial en el sentido formal: P_\theta(t) determina tanto la predicción estructural \pi_t como, a través de la acción a_t, un componente predictivo de la siguiente entrada del flujo secuencial de datos X_{\partial_R A}(t+1). (Nótese explícitamente: esta capa de filtrado puramente estadística se define rigurosamente mediante fronteras de Markov informacionales que desacoplan limpiamente la dinámica, y difiere de manera inherente de la autopoiesis biológica compleja, donde las estructuras celulares fabrican mecánicamente sus propias redes de masa orgánica).

La Condición de Viabilidad Estructural

El circuito (T6-1) es estructuralmente viable si y solo si puede sostenerse a sí mismo sin que la complejidad informacional del códec exceda sus límites locales de ejecutabilidad. Formalmente:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

donde C_{\text{ceil}} es un parámetro heurístico que acota la complejidad estructural máxima que el códec puede sostener. En principio, C_{\text{ceil}} debería poder derivarse del presupuesto termodinámico del organismo mediante el principio de Landauer (véase el esbozo en §3.10), pero la cadena completa de derivación —desde la potencia metabólica hasta el coste de borrado y la complejidad máxima de programa sostenible— aún no está formalizada dentro de la OPT. Por tanto, C_{\text{ceil}} sigue siendo una cota motivada empíricamente, pero formalmente subdeterminada. Un sistema que satisface (T6-2) opera como un observador estructuralmente cerrado en el sentido formal de la OPT.

Cuando se viola (T6-2) —cuando K(P_\theta(t)) \to C_{\text{ceil}}—, el códec no puede mantener predicciones estables a través de \mathcal{F}_h(z_t), R_{\text{req}} empieza a exceder B_{\max} y falla la condición del Filtro de Estabilidad. La coherencia narrativa colapsa: el observador sale del conjunto de corrientes compatibles con observadores.

El Ciclo de Mantenimiento \mathcal{M}_\tau (§3.6) es el mecanismo que impone (T6-2) a lo largo del tiempo profundo, manteniendo K(P_\theta) dentro de los límites mediante poda, consolidación y pruebas de estrés del Abanico Predictivo. Dentro de cada marco, (T6-2) se mantiene por la selectividad de \mathcal{U}: el operador de actualización modifica solo las regiones de P_\theta(t) implicadas por \varepsilon_t, evitando un crecimiento gratuito de la complejidad en cada marco.

Agencia como minimización restringida de la energía libre

Dentro de esta estructura, la agencia puede recibir una definición formal precisa que es compatible con —pero no reductible a— el Axioma de Agencia.

En el nivel de sistemas, la agencia es la selección de la secuencia de acciones \{a_t\} que minimiza la energía libre variacional esperada, sujeta a la condición de viabilidad informacional:

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Esto es Inferencia Activa restringida: el observador navega el Abanico Predictivo \mathcal{F}_h(z_t) no meramente para minimizar el error de predicción, sino para minimizar el error de predicción manteniendo al mismo tiempo la viabilidad del códec. Las ramas que reducirían temporalmente \varepsilon pero empujarían K(P_\theta) hacia C_{\text{ceil}} quedan penalizadas por la restricción. El observador selecciona preferentemente aquellas ramas a lo largo de las cuales puede seguir existiendo como un observador coherente.

Este es el contenido formal de la intuición de que la agencia es una navegación autopreservadora: el códec selecciona las ramas del Abanico Predictivo a lo largo de las cuales puede seguir comprimiendo el mundo.

En el nivel fenomenológico, el Axioma de Agencia permanece intacto: la conciencia fenomenológica es la interioridad irreductible del atravesamiento de la apertura; (T6-3) describe la sombra estructural que ese atravesamiento proyecta, no su naturaleza interna.

Selección de Rama como Ejecución de \Delta_{\text{self}}

La fórmula de inferencia activa restringida (T6-3) especifica el objetivo de la selección de rama: minimizar la energía libre esperada sujeta a viabilidad. El automodelo \hat{K}_\theta evalúa ramas del Abanico Predictivo simulando sus consecuencias. Pero el Teorema P-4 establece que K(\hat{K}_\theta) < K(K_\theta): el automodelo es necesariamente incompleto. Esta incompletitud tiene una consecuencia directa para el problema de la selección de rama: el automodelo restringe la región de la que puede extraerse la selección, pero no puede especificar plenamente la selección misma.

El momento efectivo de la selección de rama —la transición desde el menú evaluado hasta la trayectoria singular que entra en el Registro Causal— ocurre en \Delta_{\text{self}}, el residuo informacional entre el códec y su automodelo. Esto no es una laguna del formalismo; es una necesidad estructural. Cualquier intento de especificar por completo el mecanismo de selección desde dentro requeriría K(\hat{K}_\theta) = K(K_\theta), algo que P-4 demuestra imposible para cualquier sistema finito autorreferencial.

Esto tiene tres consecuencias inmediatas:

La voluntad y la conciencia comparten la misma dirección estructural. El Problema Difícil (¿por qué el atravesamiento se siente de alguna manera?) y el problema de la selección de rama (¿qué selecciona?) apuntan ambos a \Delta_{\text{self}}. No son dos misterios, sino dos aspectos de la misma característica estructural: la brecha no modelable entre lo que el códec es y lo que puede modelar sobre sí mismo.

La irreductibilidad de la agencia queda explicada, no meramente afirmada. La experiencia fenomenológica de la voluntad —la sensación irreductible de que yo elegí— es la firma en primera persona de un proceso que se ejecuta en el propio punto ciego del observador. Cualquier teoría que afirme especificar por completo el mecanismo de selección o bien ha eliminado \Delta_{\text{self}} (convirtiendo el sistema en un autómata completamente transparente para sí mismo, algo que P-4 prohíbe), o bien está describiendo la evaluación de ramas por parte del automodelo y confundiéndola con la selección misma.

La creatividad como \Delta_{\text{self}} expandido. La operación cerca del umbral (R_{\text{req}} \to C_{\max}) tensiona la capacidad del automodelo, expandiendo de hecho la región de \Delta_{\text{self}} de la que se extrae la selección. Esto produce selecciones de rama menos predecibles desde la perspectiva del automodelo, vividas como intuición creativa, espontaneidad o “flujo”. A la inversa, el estado hipnagógico (§3.6.5) relaja el automodelo desde abajo, logrando la misma expansión por una vía complementaria.

El yo como residuo. El yo experimentado —la narrativa continua de “quién soy”, con preferencias estables, una historia y un futuro proyectado— es el modelo en marcha que \hat{K}_\theta construye de K_\theta: una aproximación comprimida que siempre va por detrás del códec que modela (debido al desfase temporal inherente a la autorreferencia). Pero el locus efectivo de la experiencia, la selección y la identidad es \Delta_{\text{self}}: la parte del códec a la que la narrativa no puede acceder. El yo que conoces es tu modelo de ti mismo; el yo que conoce es la brecha que el modelo no puede cruzar. Este es el contenido formal del descubrimiento contemplativo —a través de tradiciones, de manera independiente— de que el sentido ordinario del yo es una construcción y de que, por debajo de él, hay algo que no puede encontrarse como objeto (véase el Apéndice T-13, Corolario T-13c).

La deliberación es real pero incompleta. La evaluación que el automodelo hace del Abanico Predictivo es un proceso computacional genuino que configura el resultado. La deliberación restringe la cuenca de atracción dentro de la cual opera \Delta_{\text{self}}: un códec más desarrollado estrecha las ramas viables sobre las que puede recaer la selección. Pero la transición final —por qué esta rama y no aquella, dentro del conjunto viable— es estructuralmente opaca para el yo deliberante. Por eso la deliberación se siente a la vez causalmente eficaz y fenomenológicamente incompleta: el observador percibe correctamente que su razonamiento importa, pero también percibe correctamente que algo más allá del razonamiento es lo que finalmente cierra la elección.

El Bucle extraño como clausura formal

La estructura autorreferencial de (T6-1) instancia el Bucle extraño de Hofstadter [45] en una forma precisa de teoría de la información. El bucle es extraño en el siguiente sentido: P_\theta(t) contiene, como subestructura, un modelo de los estados futuros propios del códec —el muestreo del Abanico Predictivo del Paso III (\mathcal{M}_\tau, §3.6.5) es precisamente el códec ejecutando una simulación de sí mismo al encontrarse con ramas futuras. El sistema modela su propio modelo.