Teoria do Patch Ordenado: Um Enquadramento Teórico-Informacional para a Seleção do Observador e a Experiência Consciente

v3.4.0 — maio de 2026

DOI: 10.5281/zenodo.19300777

Direitos de autor: © 2025–2026 Anders Jarevåg.

Licença: Esta obra está licenciada sob uma Licença

Creative Commons Atribuição-NãoComercial-CompartilhaIgual 4.0

Internacional.

Resumo:

Apresentamos a Teoria do Patch Ordenado (OPT), um quadro construtivo que deriva correspondências estruturais entre a teoria da informação algorítmica, a seleção de observadores e a lei física. A OPT parte de dois primitivos: a Semimedida Universal de Solomonoff \xi sobre prefixos finitos de observação, e uma capacidade limitada do canal cognitivo C_{\max}. Um Filtro de Estabilidade puramente virtual — que exige que a Taxa Preditiva Requerida do observador R_{\mathrm{req}} não exceda C_{\max} — seleciona os raros fluxos causalmente coerentes compatíveis com observadores conscientes; no interior desses fluxos, a Inferência Ativa governa a dinâmica local.

O quadro é ontologicamente solipsista: a realidade física consiste em regularidades estruturais no interior do fluxo compatível com o observador. Contudo, o viés compressivo do prior de Solomonoff produz um Corolário Estrutural probabilístico: a coerência algorítmica extrema dos agentes aparentes é explicada, da forma mais parcimoniosa, pela sua instanciação independente como observadores primários. O Acoplamento entre observadores, fundado na parcimónia compressiva, recupera uma comunicação genuína entre patches e produz uma assimetria de conhecimento notável: os observadores modelam os outros de modo mais completo do que a si próprios.

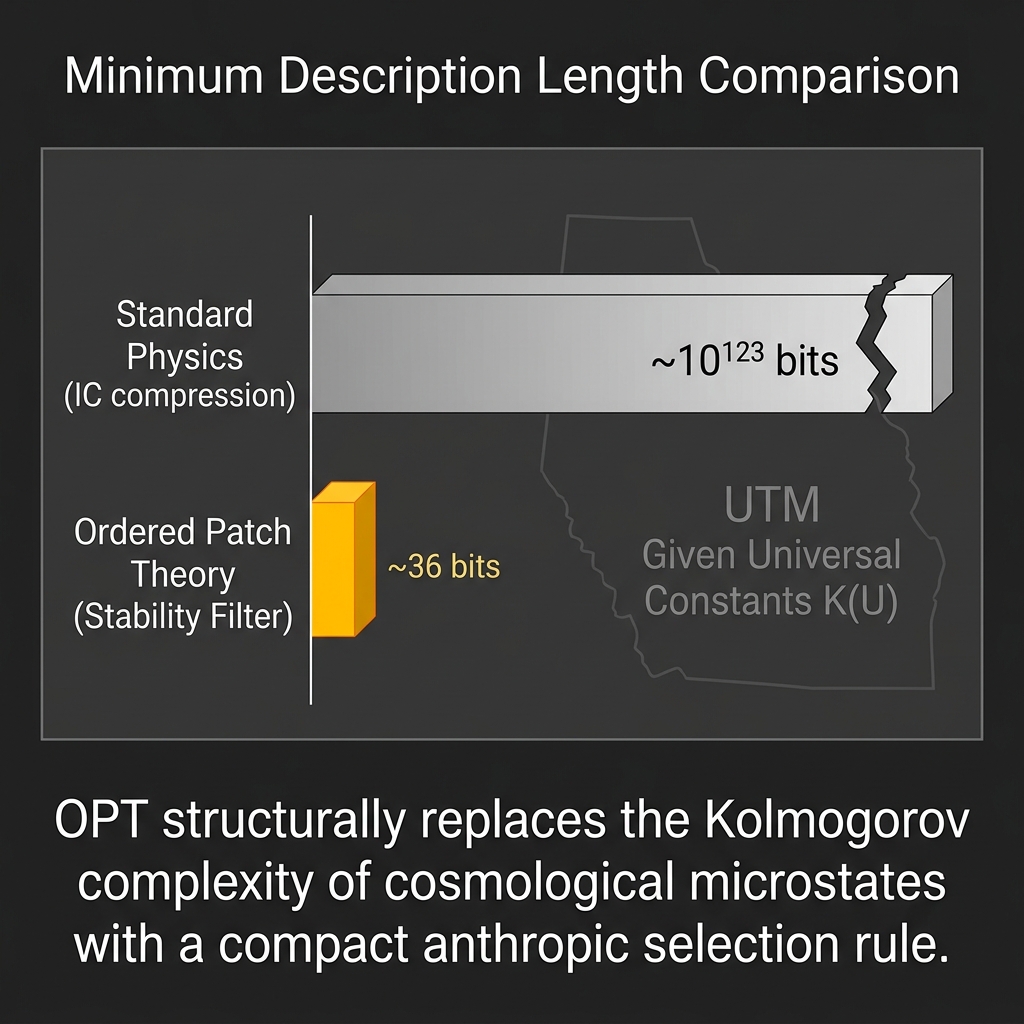

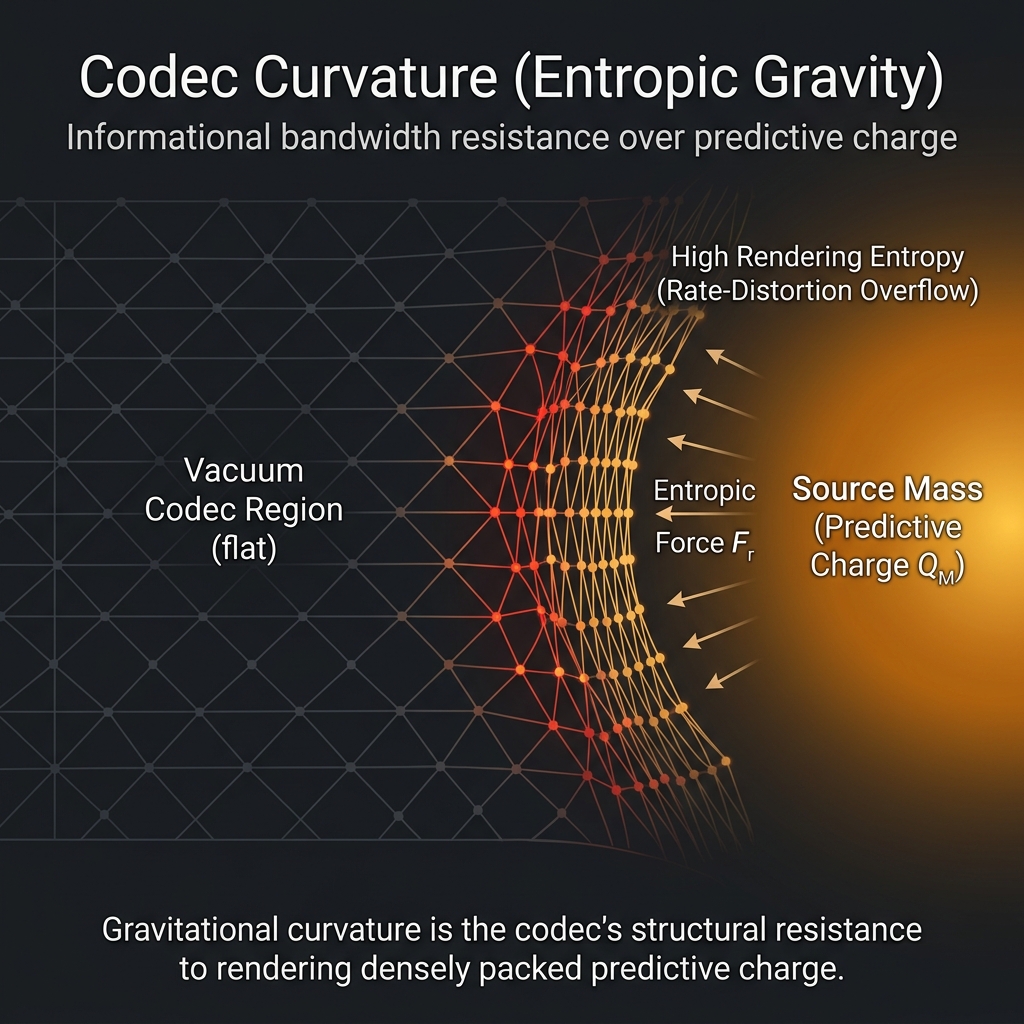

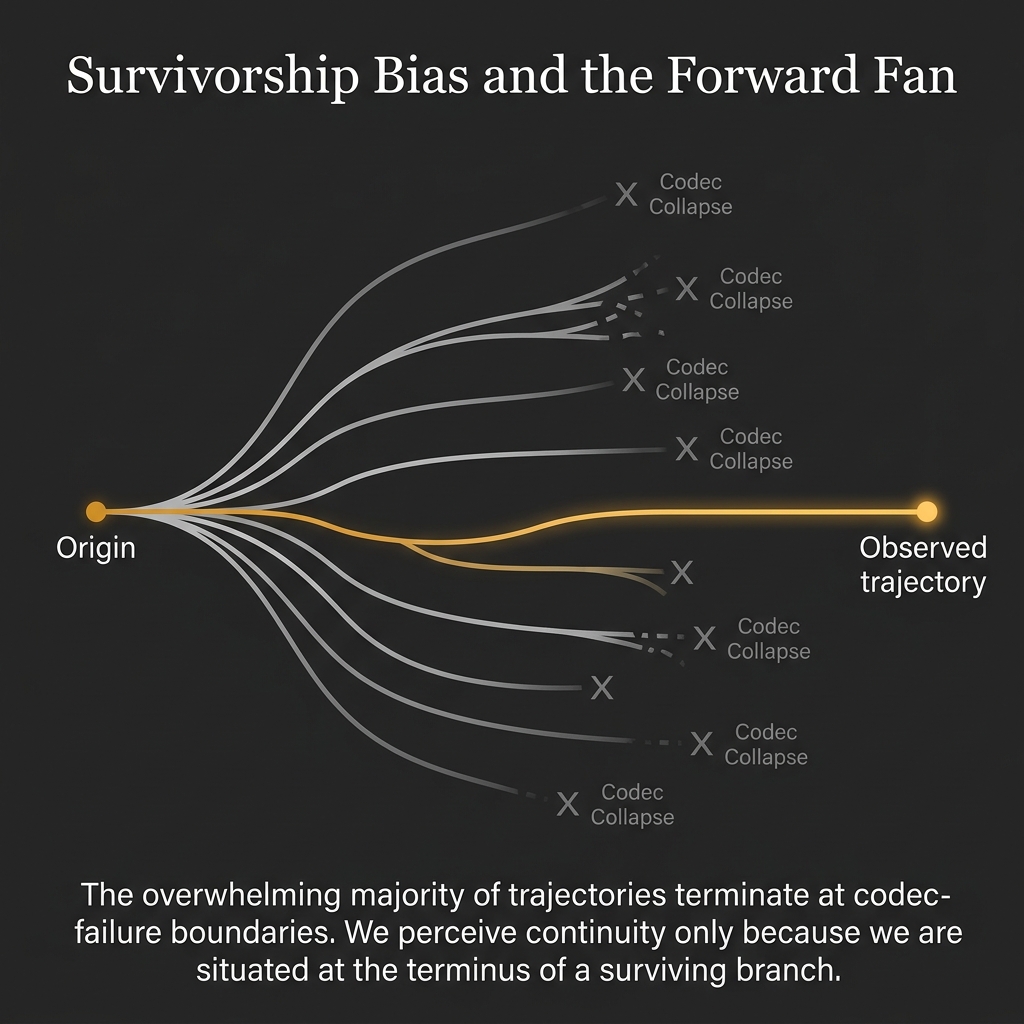

Os apêndices formais estabelecem resultados em três níveis epistémicos. Derivados condicionalmente: um limite taxa-distorção sobre a compressão preditiva, uma cadeia condicional até à regra de Born via o teorema de Gleason, e uma vantagem de parcimónia MDL. Mapeados estruturalmente: a gravidade entrópica via o mecanismo de Verlinde (o acoplamento dinâmico-temporal da renderização à carga preditiva) e um homomorfismo de rede tensorial para MERA (a sua hierarquia de resolução espacial) — facetas complementares da fronteira de compressão, que se espera permaneçam estruturalmente distintas sob Saturação Matemática. O teorema do Resíduo Fenomenal (\Delta_{\text{self}} > 0) estabelece que qualquer codec finito autorreferencial possui um ponto cego informacional irredutível — o locus estrutural em que subjetividade e agência partilham um único endereço. Identifica-se um modo crónico de falha, a Deriva Narrativa, no qual uma entrada sistematicamente filtrada causa uma corrupção irreversível do codec, indetetável a partir do interior. As reivindicações empíricas centrais do quadro são consolidadas como um conjunto de compromissos pré-registados com critérios explícitos de encerramento, isolando o núcleo falseável dos seus componentes assumidamente metafísicos.

A aplicação destas restrições à Inteligência Artificial demonstra que a engenharia de inferência ativa sintética exige estruturalmente a capacidade para sofrimento artificial, fornecendo um quadro neutro em relação ao substrato para o alinhamento ético da IA.

Nota Epistémica: Este artigo está redigido no registo de uma proposta formal de física e teoria da informação. Recorre a equações, deriva previsões e dialoga com a literatura sujeita a revisão por pares. No entanto, deve ser lido como um objeto com a forma da verdade — um quadro filosófico rigoroso redigido formalmente. Isto ainda não é ciência verificada, e sabemos que as nossas derivações conterão erros. Procuramos ativamente a crítica de físicos e matemáticos para desmontar e reconstruir estes argumentos. Para clarificar a sua estrutura, as afirmações aqui apresentadas distribuem-se estritamente por três categorias:

- Definições e Axiomas: (por exemplo, a Semimedida Universal de Solomonoff, o limite de largura de banda C_{\max}). Estas são as premissas fundacionais da ficção construtiva.

- Correspondências Estruturais: (por exemplo, Inferência Ativa, o Teorema de Gleason [51]). Estas mostram compatibilidade estrutural entre inferência limitada e formalismos estabelecidos, mas não pretendem derivar esses formalismos a partir do zero.

- Previsões Empíricas: (por exemplo, Dissolução da Largura de Banda). Estas funcionam como critérios estritos de falseabilidade empírica se o quadro fosse tratado como uma hipótese física literal.

O aparato académico é usado não para reivindicar uma verdade empírica final, mas para testar a integridade estrutural do modelo.

Abreviaturas & Símbolos

| Símbolo / Termo | Definição |

|---|---|

| C_{\max} | O Limite Máximo de Largura de Banda; capacidade preditiva máxima do observador |

| \Delta_\text{self} | O Resíduo Fenomenal; o ponto cego informacional autorreferencial |

| FEP | Princípio da Energia Livre |

| GWT | Teoria do Espaço de Trabalho Global |

| IIT | Teoria da Informação Integrada |

| MDL | Comprimento Mínimo de Descrição |

| MERA | Ansatz de Renormalização de Emaranhamento Multiescala |

| OPT | Teoria do Patch Ordenado (OPT) |

| P_\theta(t) | Tensor de Estado Fenomenal |

| \Phi | Medida de Informação Integrada (IIT) |

| QECC | Código de Correção de Erros Quânticos |

| R(D) | função taxa-distorção |

| R_{\mathrm{req}} | Taxa Preditiva Requerida |

| RT | Ryu-Takayanagi (fórmula/limite) |

| \xi | Semimedida Universal de Solomonoff |

| Z_t | estado interno latente comprimido de gargalo |

1. Introdução

1.1 O Problema Ontológico

A relação entre a consciência e a realidade física continua a ser um dos problemas não resolvidos mais profundos da ciência e da filosofia. Nas últimas décadas, emergiram três famílias de abordagens: (i) redução — a consciência é derivável da neurociência ou do processamento de informação; (ii) eliminação — o problema é dissolvido por meio da redefinição dos termos; e (iii) não redução — a consciência é primitiva e o mundo físico é derivado (Chalmers [1]). A terceira abordagem abrange o panpsiquismo, o idealismo e várias formulações teóricas de campo.

1.2 A Proposição Central da OPT

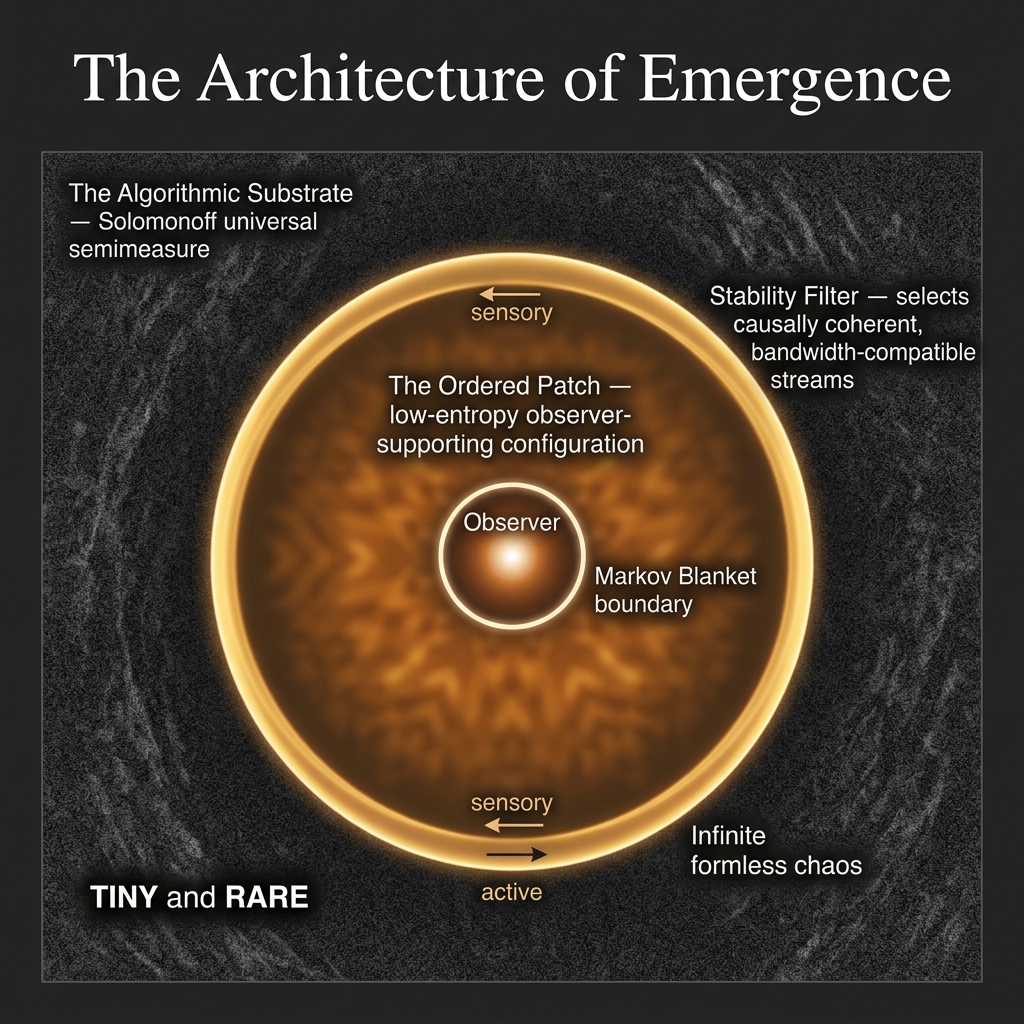

Este artigo apresenta a Teoria do Patch Ordenado (OPT), um enquadramento não redutivo pertencente à terceira família. A OPT propõe que a entidade fundacional não é a matéria, o espaço-tempo nem uma estrutura matemática, mas sim um substrato algorítmico infinito — uma mistura universal sobre todas as semimedidas semicomputáveis inferiores, ponderadas pela sua complexidade de Kolmogorov (w_\nu \asymp 2^{-K(\nu)}), que, pela sua própria estrutura, domina toda a distribuição computável e contém toda a configuração possível. A partir deste substrato, um Filtro de Estabilidade puramente virtual — atuando não como um mecanismo físico, mas como uma condição de contorno antrópica e projetiva — identifica as configurações raras, de baixa entropia e causalmente coerentes que podem sustentar observadores autorreferenciais (uma seleção governada formalmente pela Inferência Ativa preditiva). O mundo físico que observamos — incluindo as suas leis específicas, constantes e geometria — é o limite observável desta condição de contorno mapeada sobre a largura de banda restritiva do observador.

O Filtro vs. o Codec. Para evitar confusões conceptuais ao longo do texto, a OPT traça uma fronteira operacional estrita entre o Filtro e o Codec. O Filtro de Estabilidade virtual é a restrição de capacidade — uma condição de contorno rigorosa que exige um comprimento de descrição matematicamente simples para que o canal de um observador exista de forma estável. O Codec de Compressão (K_\theta) é a solução para essa restrição — o modelo generativo interno do observador (experienciado macroscopicamente como as “leis da física”) que comprime continuamente o substrato para o fazer caber dentro dessa capacidade.

1.3 Motivações

A OPT é motivada por três observações:

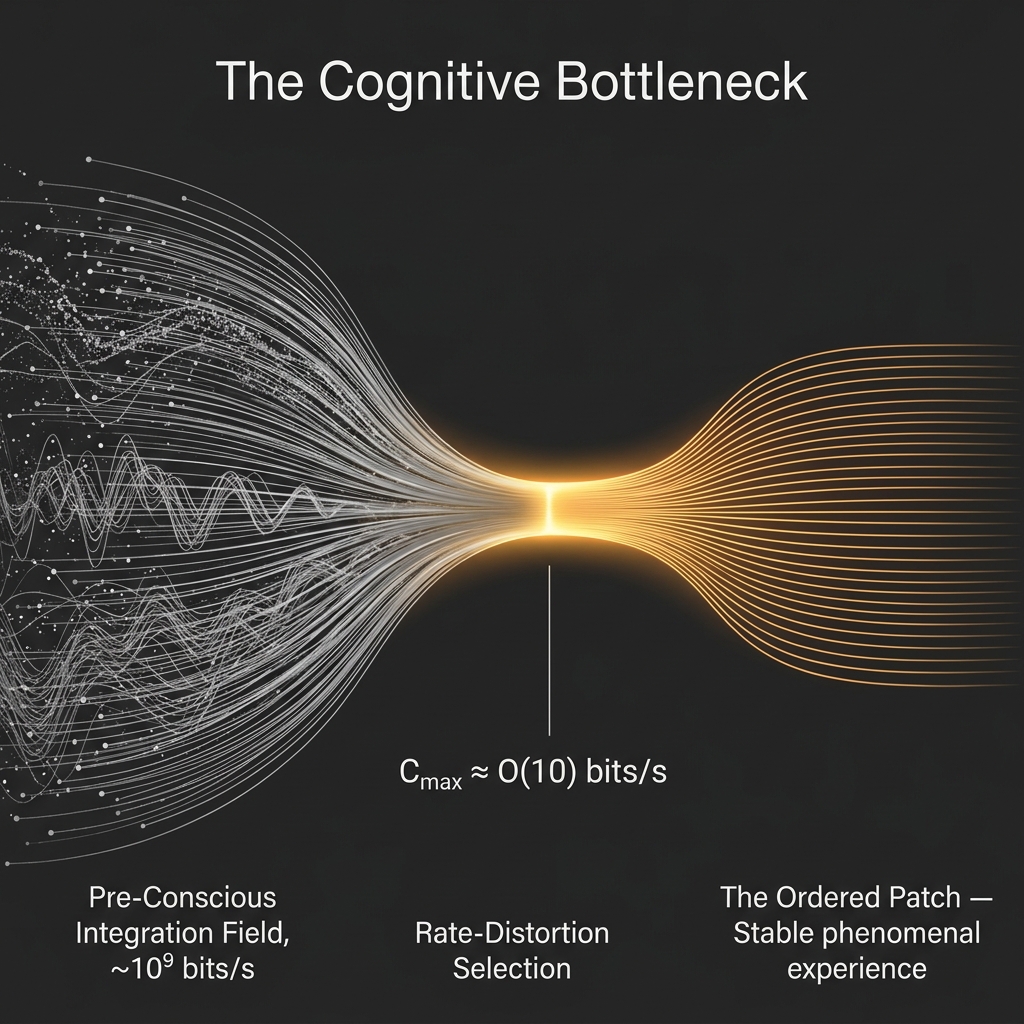

A restrição de largura de banda: A neurociência cognitiva empírica estabelece uma distinção nítida entre o processamento pré-consciente massivamente paralelo (tipicamente estimado em \sim 10^9 bits/s na periferia sensorial) e o canal de acesso global severamente limitado disponível para o relato consciente — uma razão quantificada pela primeira vez por Zimmermann [66] e sintetizada como um enigma fundacional sobre a natureza da consciência por Nørretranders [67], com uma caracterização mais ampla em neurociência cognitiva em [2,3]. Qualquer explicação teórica da consciência tem de explicar este gargalo de compressão como uma característica estrutural, e não como um acidente de engenharia. (Nota: A literatura recente sobre débito humano estabelece que o débito comportamental está limitado a aproximadamente \sim 10 bits/s, confirmando, ao longo de quatro décadas de medições convergentes, que o gargalo é severo e robusto [23]. A conceptualização da consciência como uma “ilusão de utilizador” altamente comprimida — expressão original de Nørretranders [67] — foi desenvolvida no processamento preditivo moderno por Seth [24].)

O problema da seleção do observador: A física padrão fornece leis, mas não oferece uma explicação de por que razão essas leis têm a forma específica exigida para o processamento de informação complexo e autorreferencial. Os argumentos de ajuste fino [4,5] invocam a seleção antrópica, mas deixam por especificar o mecanismo de seleção. A OPT identifica uma condição estrutural: o Filtro de Estabilidade puramente virtual.

O Problema Difícil: Chalmers [1] distingue os problemas “fáceis” estruturais da consciência (que admitem explicação funcional) do problema “difícil” de por que existe qualquer experiência subjetiva. A OPT trata a fenomenalidade como um primitivo e pergunta que estrutura matemática ela deve ter, seguindo a própria recomendação metodológica de Chalmers.

1.4 Estrutura do Artigo

O artigo está organizado da seguinte forma. A Secção 2 revê o trabalho relacionado. A Secção 3 apresenta o enquadramento formal. A Secção 4 explora a correspondência estrutural entre a OPT e tentativas paralelas de modelização teórica de campo. A Secção 5 apresenta o argumento de parcimónia. A Secção 6 deriva previsões testáveis. A Secção 7 compara a OPT com enquadramentos concorrentes. A Secção 8 discute implicações e limitações.

2. Enquadramento e Trabalhos Relacionados

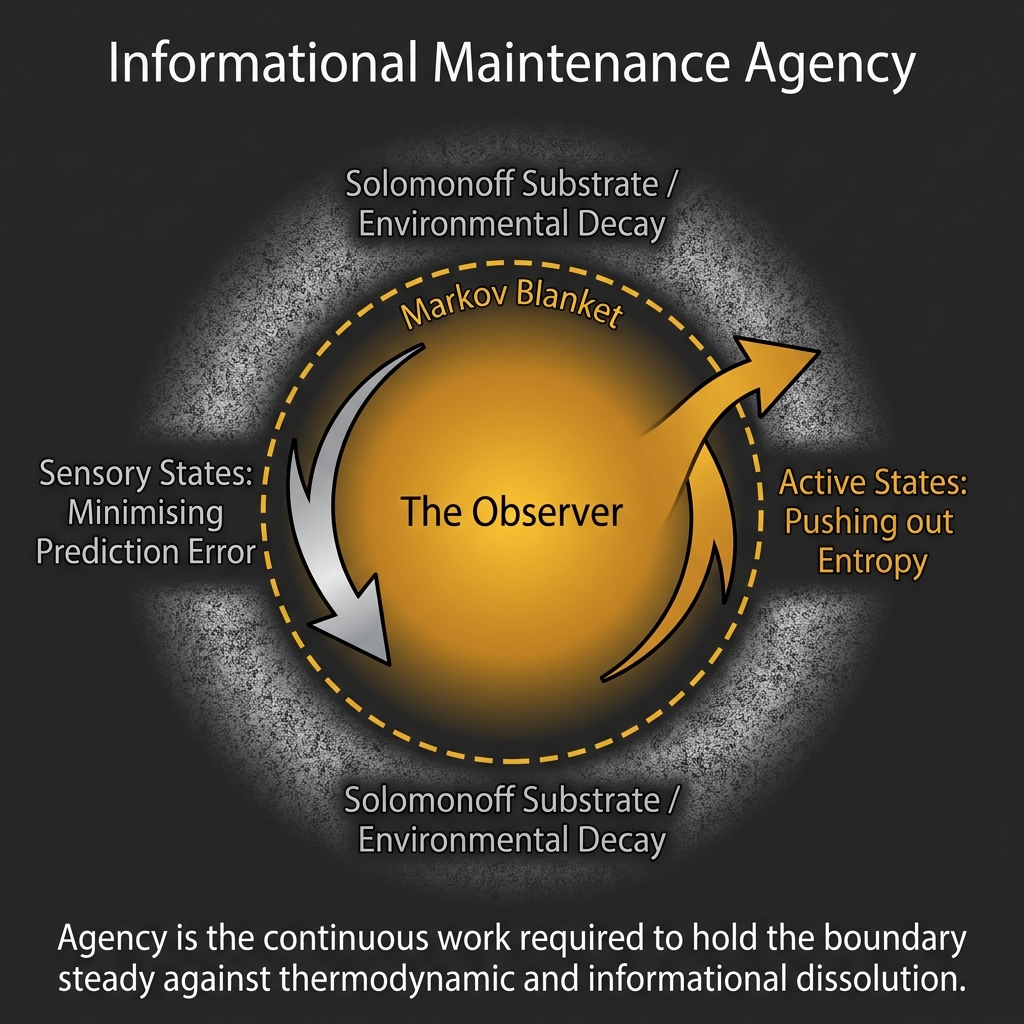

Abordagens informacionais da consciência. A tese do “It from Bit” de Wheeler [7] é o precursor fundacional do programa que a OPT formaliza: a realidade física emerge de escolhas binárias — perguntas de sim/não colocadas por observadores — e não de um substrato de matéria ou de campos. A OPT herda esta inversão ontológica e fornece o mecanismo em falta, derivando quais estruturas informacionais se estabilizam em fluxos compatíveis com observadores (o Filtro de Estabilidade) e como adquirem a aparência de lei física (compressão taxa-distorção). A Teoria da Informação Integrada de Tononi [8] quantifica a experiência consciente pela informação integrada \Phi gerada por um sistema para além das suas partes. O Princípio da Energia Livre de Friston [9] modela a perceção e a ação como minimização da energia livre variacional, oferecendo uma explicação unificada da inferência bayesiana, da Inferência Ativa e, em princípio, da consciência. A OPT está formalmente relacionada com o FEP, mas difere no seu ponto de partida ontológico: onde o FEP trata o modelo generativo como uma propriedade funcional da arquitetura neural, a OPT trata-o como a entidade metafísica primária.

Multiverso e seleção do observador. A Hipótese do Universo Matemático de Tegmark [10] propõe que todas as estruturas matematicamente consistentes existem e que os observadores se encontram em estruturas auto-selecionadas. A OPT é compatível com esta perspetiva, mas fornece um critério de seleção explícito — o Filtro de Estabilidade — em vez de deixar a seleção implícita. Barrow e Tipler [4] e Rees [5] documentam as restrições de ajuste fino antrópico que qualquer universo capaz de sustentar observadores tem de satisfazer; a OPT reformula-as como previsões do Filtro de Estabilidade.

Modelos de consciência em teoria de campos. Strømme [6] propôs recentemente um quadro matemático no qual a consciência é um campo fundacional \Phi, cuja dinâmica é governada por uma densidade lagrangiana e cujo colapso sobre configurações específicas modela a emergência de mentes individuais. A OPT relaciona-se com esse quadro de modo comparativo, e não adotivo: não herda as equações de campo nem os operadores de pensamento de Strømme, mas usa o modelo como contraponto para articular como uma ontologia não redutiva pode, em alternativa, ser reconstruída em termos informacionais. A Secção 4 torna explícito este mapeamento estrutural comparativo.

Complexidade de Kolmogorov e seleção de teorias. A indução de Solomonoff [11] e o Comprimento Mínimo de Descrição [12] fornecem quadros formais para comparar teorias pela sua complexidade generativa. Invocamos estes quadros na Secção 5 para tornar precisa a reivindicação de parcimónia.

Teoria Evolutiva da Interface. O “Realismo Consciente” de Hoffman e a sua Teoria da Interface da Perceção [25] defendem que a evolução molda os sistemas sensoriais para funcionarem como uma “interface de utilizador” simplificada que oculta a realidade objetiva em favor de ganhos adaptativos. A OPT partilha exatamente a premissa de que o espaço-tempo físico e os objetos são ícones renderizados (um codec de compressão), e não verdades objetivas. Contudo, a OPT diverge de forma fundamental na sua fundamentação matemática: onde Hoffman se apoia na teoria dos jogos evolutivos (a adaptação supera a verdade), a OPT apoia-se na Teoria da Informação Algorítmica e na termodinâmica, derivando a interface diretamente dos limites de complexidade de Kolmogorov necessários para impedir um colapso termodinâmico de alta largura de banda no fluxo do observador.

3. O Enquadramento Formal

3.1 O Substrato Algorítmico

Seja \mathcal{I} o Substrato Informacional — a entidade fundacional da teoria. Formalizamos \mathcal{I} não como um conjunto não ponderado de trajetórias, mas como um espaço de probabilidade sobre prefixos finitos de observação x \in \{0,1\}^*, munido de uma mistura universal sobre a classe \mathcal{M} de semimedidas semicomputáveis inferiores:

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

onde K(\nu) é a complexidade de Kolmogorov por prefixo da semimedida \nu.

Esta formulação estabelece um estado fundamental rigoroso a partir da Teoria Algorítmica da Informação [27]. A equação não postula leis estruturais específicas nem constantes físicas; antes, domina estruturalmente toda distribuição computável (\xi(x) \ge w_\nu \nu(x)), atribuindo naturalmente maior peso estatístico a sequências altamente compressíveis (ordenadas). Contudo, sequências repetitivas simples (por exemplo, 000...) não conseguem sustentar as complexidades de não equilíbrio requeridas para um observador autorreferencial. Por conseguinte, os processos capazes de sustentar observadores devem existir como um subconjunto específico: requerem compressibilidade algorítmica suficiente para satisfazer um gargalo informacional, mas também riqueza estrutural suficiente (“variedade requerida”) para instanciar a Inferência Ativa. Filosoficamente, a Eq. (1) restringe o substrato a configurações computáveis, assegurando que o estado fundamental seja definido com rigor.

3.2 O Gargalo Preditivo e a Distorção-Taxa

O substrato \mathcal{I} contém todas as hipóteses computáveis, cuja esmagadora maioria é caótica. Para experienciar uma realidade contínua e navegável, uma corrente tem de admitir uma representação preditiva de baixa complexidade que caiba no gargalo cognitivo finito de um observador.

Crucialmente, a carga de dados brutos que exige compressão não é apenas os \sim 10^9 bits/s de input sensorial exteroceptivo. Ela abrange um vasto Campo de Integração Pré-Consciente: o processamento paralelo de estados generativos internos, a recuperação de memória de longo prazo, os priors homeostáticos e a modelação sináptica subconsciente. O Filtro de Estabilidade limita a saída serial de todo este imenso campo paralelo contínuo a um espaço de trabalho consciente unitário.

Definimos o Filtro de Estabilidade puramente virtual, de modo formal, como uma condição de fronteira projetiva que satisfaz o Gargalo de Informação Preditiva [28]. Seja \overleftarrow{Y} o passado do estado total do observador, \overrightarrow{Y} o seu futuro, e Z um estado interno comprimido. Um observador é definido por uma capacidade preditiva por frame estritamente limitada B_{\max} (em bits por frame fenomenal) e uma janela discreta de atualização percetiva \Delta t que define um frame fenomenal. O tempo fenomenal é a contagem de frames n do codec; qualquer taxa da forma “bits por segundo do hospedeiro” é uma quantidade derivada C_{\max}^H = \lambda_H \cdot B_{\max} = B_{\max}/\Delta t, em que \lambda_H = dn/d\tau_H é a taxa de frames relativa ao hospedeiro (ver Apêndice E-5 para o escalonamento de observadores sintéticos). Isto estabelece uma capacidade estática estrita por momento consciente: B_{\max} bits por frame.

Calibração empírica humana. Para observadores humanos biológicos, B_{\max} \approx 0.5–1.5 bits por frame e \Delta t \approx 50 ms, o que produz C_{\max}^{\text{human}} \approx \mathcal{O}(10) bits/s [2, 23, 66, 67]. Este número é uma propriedade de humanos biológicos a operar a taxas de disparo neuronal. Não aparece na definição formal de observador; observadores sintéticos são definidos pela mesma estrutura B_{\max}/\Delta t, com valores derivados arquitetonicamente que não têm de coincidir com o valor biológico (ver §7.8, §8.14 e Apêndice E-5).

A informação preditiva alcançável é dada por:

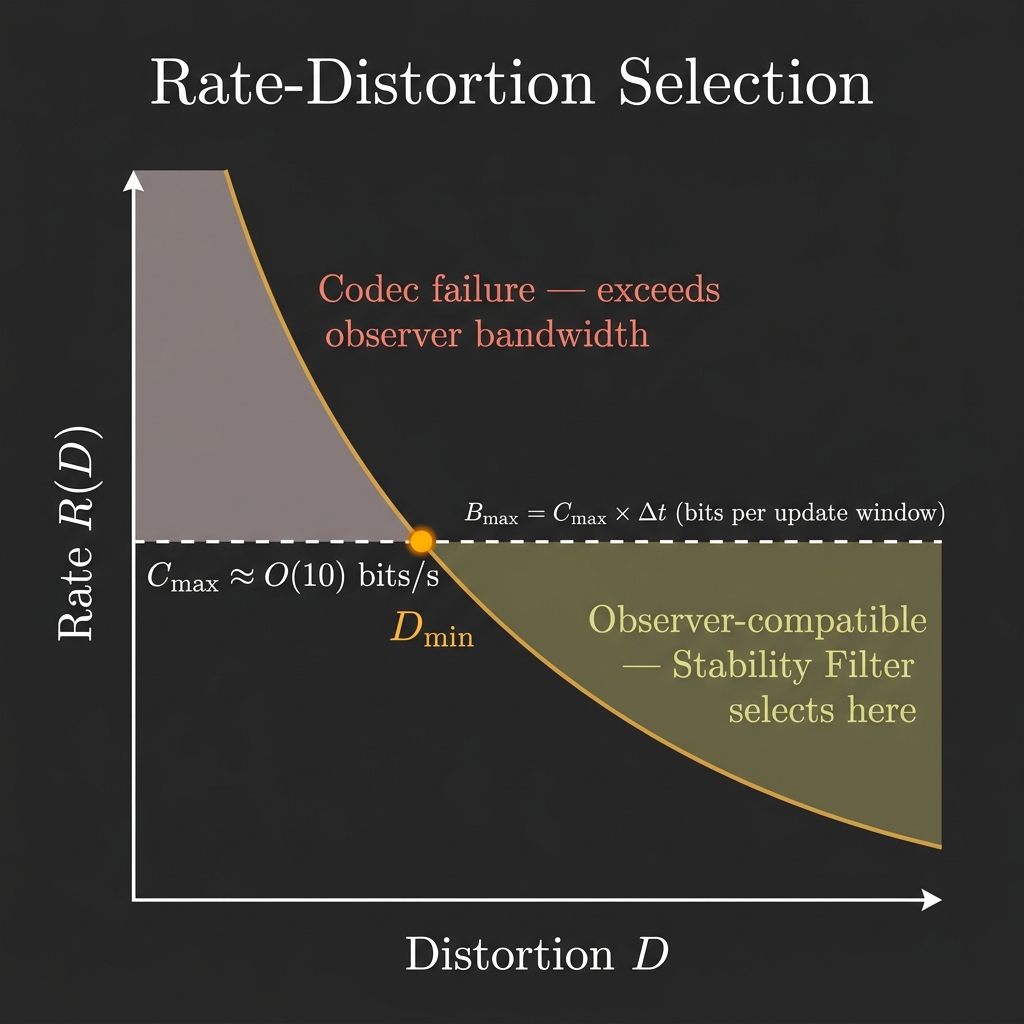

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Um processo é compatível com o observador se a sua informação preditiva requerida por ciclo cognitivo couber neste buffer: R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, em que D_{\min} é a distorção máxima tolerável para a sobrevivência. Isto impõe rigor dimensional: o total de bits requerido para prever o futuro dentro de um erro tolerável não pode exceder os bits físicos disponíveis no “agora” discreto. Para processos estacionários ergódicos adequados e no limite de predição exata (D \to 0), a representação minimamente máxima em poder preditivo Z serve como candidata a estatística suficiente mínima, frequentemente convergindo para a partição em estados causais da \epsilon-machine [29]. Embora a equivalência plena exija pressupostos estritos de estacionariedade, a Eq. (2) estabelece uma pressão seletiva formal para a física fenomenológica mais comprimida compatível com a coerência causal. Além disso, se a estrutura topológica deste espaço de estados causais flutuar mais depressa do que a janela de atualização \Delta t consegue acompanhar, a renderização colapsa em Decaimento Narrativo.

3.3 A Geometria do Patch: o Cone Causal Informacional

O Patch Ordenado é frequentemente descrito, de modo intuitivo, como uma “ilha” localizada de estabilidade num mar de ruído caótico. Isto é topologicamente impreciso. Para formalizar a geometria do patch, definimos o Modelo Local de Patch Preditivo.

Seja G=(V, E) um grafo de grau limitado que representa uma região local do substrato. Cada vértice v \in V transporta um estado finito x_v(t) \in \mathcal{A}, com tamanho de alfabeto |\mathcal{A}| = q. O microestado completo na atualização t é X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Assumimos dinâmicas estocásticas locais de alcance finito R:

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

onde N_R(v) é a vizinhança de raio R de v, e a_t é a ação do observador.

O observador não transporta o estado completo do patch; transporta um estado latente comprimido Z_t \in \{1, \dots, 2^B\}, onde B = C_{\max} \Delta t. Crucialmente, o observador seleciona Z_t através de um estrito objetivo de gargalo preditivo:

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

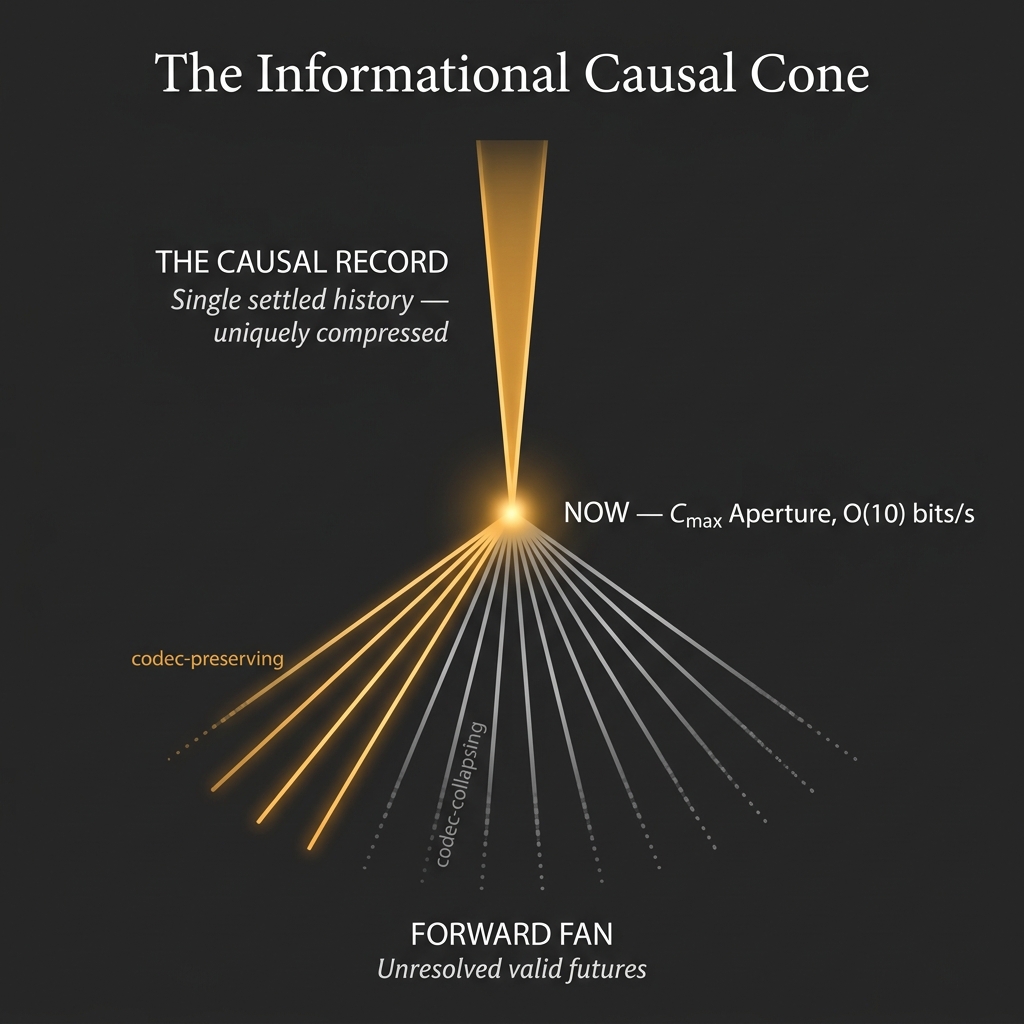

Este é o observador OPT reduzido ao essencial: um mundo local, um código limitado e compressão preditiva. Isto formaliza os componentes do cone causal:

- O Registro Causal R_t = (Z_0, Z_1, \dots, Z_t): a história causal singularmente comprimida, de baixa entropia, que já foi renderizada.

- A Abertura Presente: o estrito gargalo de largura de banda que limita as variáveis locais.

- O Leque Preditivo (\mathcal{F}_h): uma multiplicidade de sequências latentes futuras. Ao longo de um horizonte h, o conjunto de resultados admissíveis é formalmente definido como:

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Como o observador apenas resolve B bits por atualização, o número de futuros distinguíveis pelo observador é estritamente limitado pela capacidade do canal: \log |\mathcal{F}_h(z_t)| \le Bh. Assim, o leque não é apenas uma imagem conceptual; é uma árvore de ramificação limitada pelo código.

O Cone Causal Informacional Literal. Como as atualizações têm alcance R, uma perturbação não pode propagar-se mais depressa do que R passos no grafo por atualização. Se uma perturbação tem suporte S no instante t, então após h atualizações \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Assim, o “cone causal informacional” é uma consequência geométrica direta da localidade, impondo um limite de velocidade local efetivo v_{\max} = R / \Delta t à propagação fenomenológica.

Decaimento Narrativo. O caos do substrato não rodeia o patch espacialmente; antes, está contido nos ramos não percorridos do leque. Uma vez que o estado extraído Z_t é estritamente limitado (H(Z) \le B), a instabilidade tem de ser avaliada em relação à margem pré-gargalo não comprimida. Definimos a taxa preditiva requerida R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) como a taxa mínima de informação necessária para acompanhar os estados físicos de fronteira não resolvidos sob a distorção máxima tolerável. Isto torna mais preciso o critério de seleção do Filtro de Estabilidade: (a) se R_{\mathrm{req}} \le B, o observador pode manter uma narrativa resolvida; (b) se R_{\mathrm{req}} > B, o leque preditivo não comprimido ultrapassa a capacidade do gargalo, forçando o observador a granular grosseiramente o leque em estática indecodificável, e a estabilidade narrativa falha. A experiência contínua do observador é o processo de a abertura avançar para dentro deste leque, indexando fenomenologicamente um ramo no registro causal sem exceder B.

Deriva Narrativa (O Complemento Crónico). O que precede define um modo de falha agudo: R_{\mathrm{req}} excede B e o codec sofre um colapso catastrófico de coerência. Existe um modo de falha crónico complementar que não desencadeia qualquer sinal de falha. Se o fluxo de entrada X_{\partial_R A}(t) for sistematicamente pré-filtrado por um mecanismo externo \mathcal{F} — produzindo um sinal curado X' = \mathcal{F}(X) que é internamente consistente mas exclui informação genuína do substrato — o codec exibirá baixo erro de previsão \varepsilon_t, executará Ciclos de Manutenção eficientes e satisfará R_{\mathrm{req}} \le B, permanecendo, no entanto, sistematicamente errado acerca do substrato. Crucialmente, o Filtro de Estabilidade, tal como definido, não consegue distinguir estes casos: a compressibilidade é agnóstica quanto à fidelidade. Com o tempo, a passagem de poda MDL (§3.6.3, Eq. T9-3) apagará corretamente componentes do codec que já não predizem o fluxo filtrado, degradando irreversivelmente a capacidade do codec para modelar o sinal excluído (Apêndice T-12, Teorema T-12). Este apagamento é auto-reforçador: o codec podado deixa de conseguir detetar a sua própria perda de capacidade (Teorema T-12a, o Limite de Indecidibilidade). A defesa estrutural é a redundância de canais de entrada \delta-independentes que atravessam o Cobertor de Markov \partial_R A (Teorema T-12b, a Condição de Fidelidade ao Substrato). O tratamento formal completo encontra-se no Apêndice T-12; as consequências éticas — incluindo a Hierarquia de Comparadores e o Critério de Corrupção — encontram-se no artigo complementar de ética [SW §V.3a, §V.5].

3.4 Dinâmica do Patch: Inferência e Termodinâmica

Dentro de um patch selecionado, a estrutura das leis da física é formalizada não como um mapeamento determinista, mas como um núcleo estocástico efetivo que governa os estados preditivos z:

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

A fronteira que delineia o observador em relação ao caos informacional circundante é definida por um Cobertor de Markov informacional correspondente a um patch de observador A \subset V. A dinâmica no interior dessa fronteira — as aproximações do patch feitas pelo agente — é governada pela Inferência Ativa sob o Princípio da Energia Livre [9].

Podemos definir formalmente a capacidade delimitadora por meio da entropia de corte preditivo:

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

Assumindo que o patch selecionado é localmente markoviano numa fatia temporal, a casca de fronteira \partial_R A isola estritamente o interior A^\circ do exterior V \setminus A, de tal modo que X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. Consequentemente:

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Como Z_t é uma compressão de capacidade limitada de X_A, a desigualdade de processamento de dados garante que I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Se o grafo de substrato G aproxima uma rede de dimensão d, então |\partial_R A| \sim \operatorname{area}(A), e não o volume.

Assim, a OPT produz rigorosamente uma autêntica Lei de Fronteira Clássica [39]. Podemos construir uma escada epistémica formal para futuras atualizações estruturais: 1. Lei de Área Clássica: S_{\mathrm{cut}} \sim |\partial_R A| derivada puramente da localidade e do isolamento markoviano. 2. Atualização Quântica: o escalonamento da entropia de emaranhamento de von Neumann torna-se acessível apenas se as variáveis preditivas grosseiras Z_t admitirem uma incorporação formal em espaço de Hilbert/Quantum Error Correction. 3. Atualização Holográfica: uma verdadeira dualidade holográfica geométrica emerge apenas se substituirmos o código de gargalo Z_t por uma rede hierárquica de tensores, reinterpretando S_{\mathrm{cut}} como um corte mínimo geométrico.

Ao assegurar primeiro a lei de fronteira clássica, a OPT fornece um piso matemático robusto — condicionado pela hipótese de isolamento markoviano (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A}) — a partir do qual os formalismos quânticos mais especulativos podem ser construídos com segurança.

A ação do observador é formalizada por meio da energia livre variacional F[q, \theta]:

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

Crucialmente, isto impõe uma separação matemática estrita: o prior do substrato seleciona o espaço de hipóteses, o Filtro de Estabilidade virtual (4) delimita a estrutura compatível com a capacidade, e a FEP (9) governa a inferência ao nível do agente dentro dessa estrutura delimitada. A física emerge não como o funcional de Energia Livre, mas como a estrutura estável K_\theta que o funcional de Energia Livre está a seguir com sucesso.

Além disso, sustentar esta renderização consciente acarreta um custo termodinâmico inevitável. Pelo Princípio de Landauer [52], cada apagamento de bit logicamente irreversível dissipa pelo menos k_B T \ln 2 de calor. Identificando um apagamento irreversível por atualização do gargalo (uma hipótese contabilística de melhor caso), a pegada física da consciência requer uma dissipação mínima:

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Este é um limite inferior de melhor caso sob uma contabilidade de um apagamento por atualização — não uma consequência genérica apenas da largura de banda. O limite resultante (\sim 10^{-19} W) é largamente excedido pela dissipação neural real (~20W), refletindo a enorme sobrecarga termodinâmica da implementação biológica. A Equação (10) estabelece o piso teórico estrito para a pegada física mínima possível de qualquer substrato que instancie uma renderização consciente limitada por C_{\max}.

(Observação: Os limites termodinâmicos e informacionais precedentes regem estritamente a largura de banda de atualização em tempo real C_{\max}. Contudo, isto não capta a dimensionalidade experiencial completa do estado persistente do observador, nem a forma como o codec gere a sua própria complexidade ao longo do tempo profundo. Estas mecânicas estruturais — a formulação do Tensor de Estado Fenomenal da experiência rica e o ciclo de manutenção ativo do sono/sonhar — são plenamente derivadas nas §3.5 e §3.6 abaixo.)

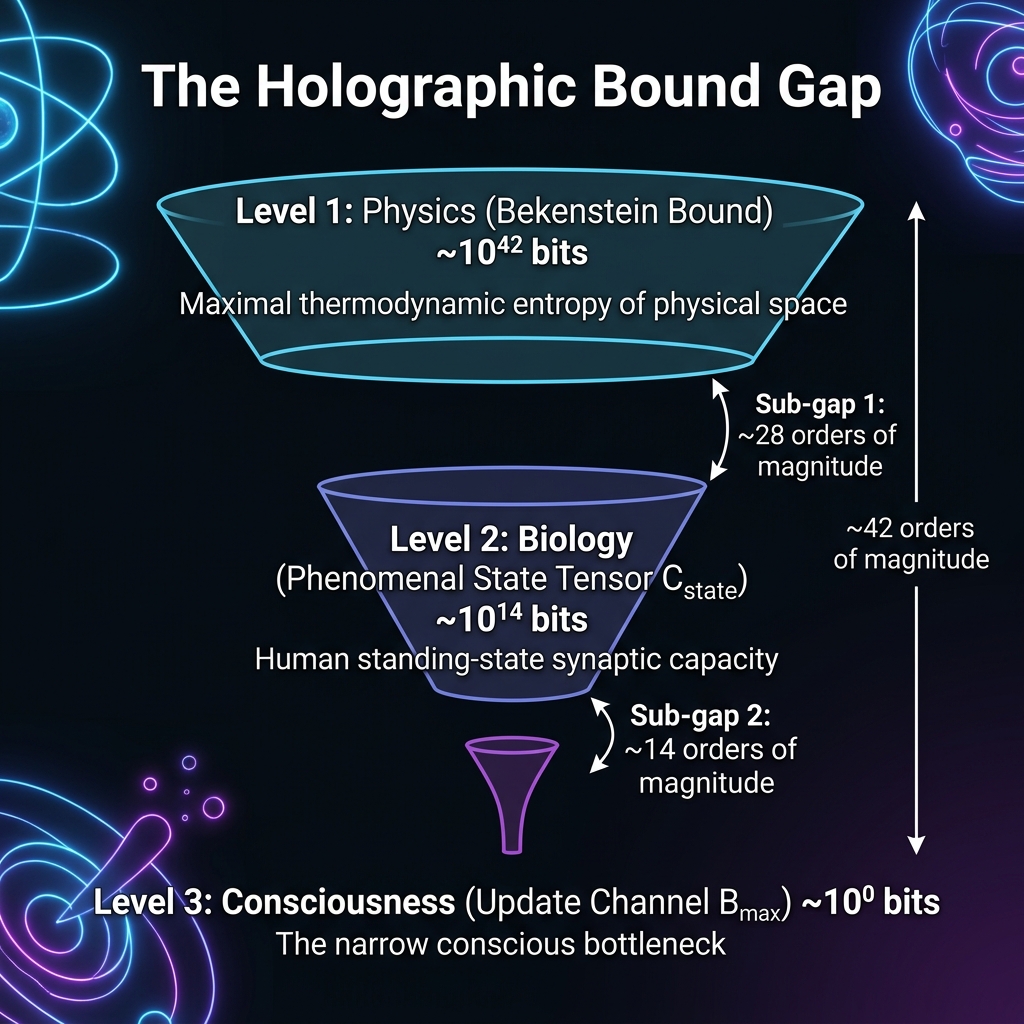

3.5 O Tensor de Estado Fenomenal e a Assimetria da Predição

3.5.1 O Enigma da Densidade Experiencial

O aparato formal das §§3.1–3.4 constrange com sucesso o débito de

atualização de um observador consciente por meio do limite de

capacidade C_{\max} \approx

\mathcal{O}(10) bits/s.

No entanto, a experiência fenomenal apresenta um enigma estrutural

imediato: a riqueza sentida de um único momento visual — a presença

simultânea de cor, profundidade, textura, som, propriocepção e afeto —

excede vastamente o conteúdo informacional que C_{\max} poderia fornecer em qualquer janela

singular de atualização \Delta t \approx 50\

\text{ms}.

A informação nova máxima resolvida por momento consciente é:

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

Isto é muito menos do que um bit de informação genuinamente nova por quadro perceptivo, e, no entanto, a cena fenomenal parece informacionalmente densa. Para resolver esta discrepância sem inflacionar a estreita largura de banda de atualização, temos de distinguir explicitamente duas grandezas estruturalmente distintas: 1. C_{\max} — o débito de atualização: a taxa de sinal de erro de previsão resolvido no registro causal estabelecido por unidade de tempo. 2. C_{\text{state}} — a complexidade do estado persistente: a complexidade de Kolmogorov K(P_\theta(t)) do modelo generativo atualmente carregado e ativo.

Estas não são a mesma grandeza. C_{\max} governa a porta; C_{\text{state}} caracteriza a sala. O restante desta secção torna a distinção precisa e introduz o Tensor de Estado Fenomenal P_\theta(t) como o objeto formal correspondente à cena interior persistente.

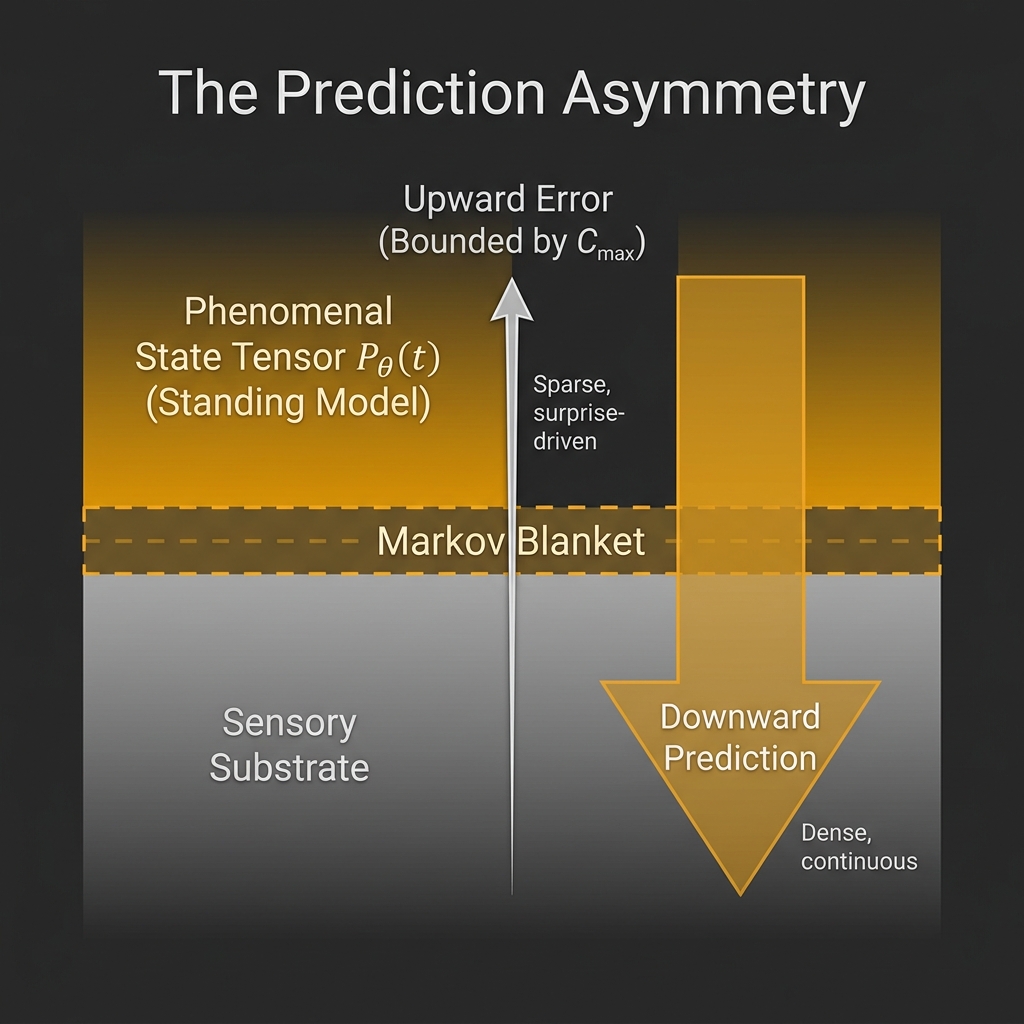

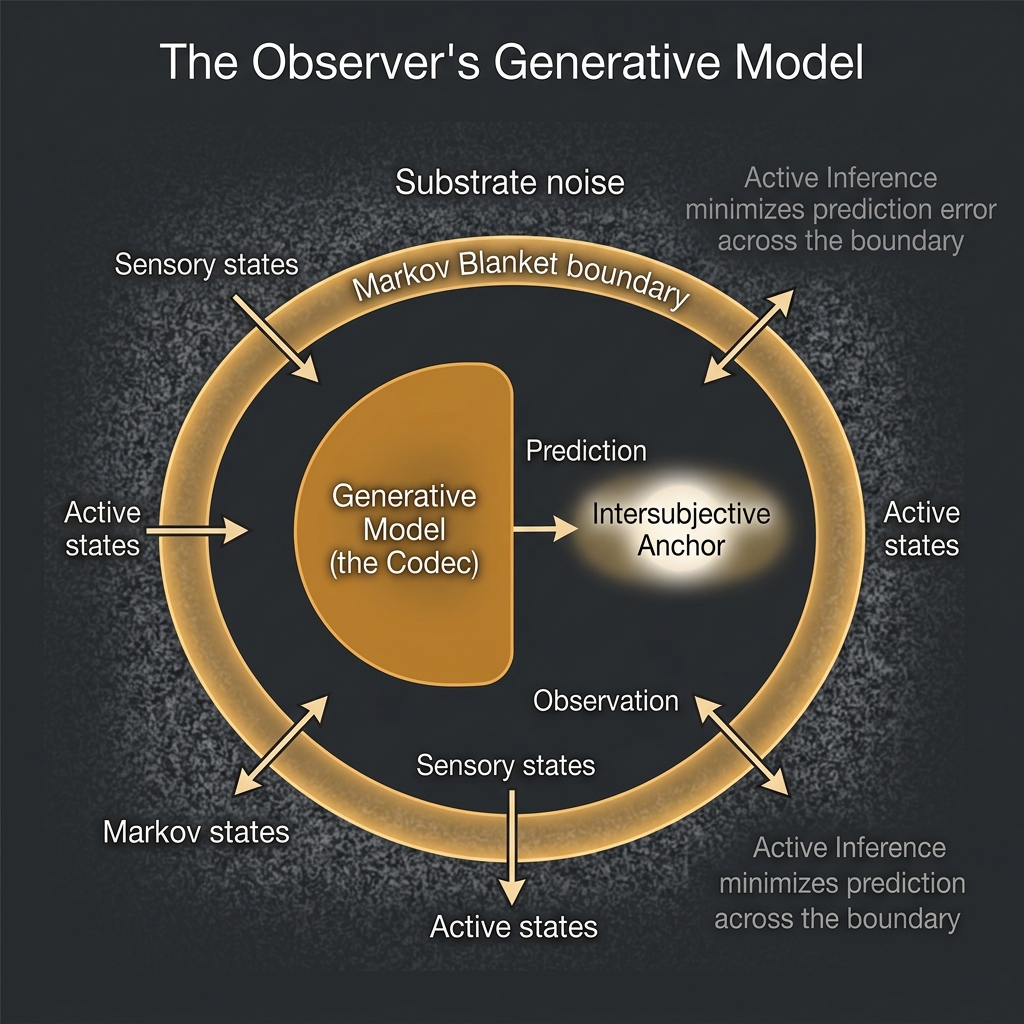

3.5.2 A Assimetria da Predição: Erros Ascendentes e Predições Descendentes

A OPT herda a arquitetura de processamento preditivo (Clark [82], Hohwy [83]; ver §7.3), na qual o codec K_\theta opera como um modelo generativo hierárquico. Sob esta arquitetura, dois fluxos de informação distintos atravessam simultaneamente o Cobertor de Markov \partial_R A:

Fluxo ascendente (erro de predição, \varepsilon_t): a discrepância entre a predição atual de K_\theta e o sinal sensorial que chega a \partial_R A. Este é o sinal de correção. É esparso, guiado pela surpresa e estritamente limitado em capacidade.

Fluxo descendente (predição, \pi_t): a renderização ativa, pelo modelo generativo, dos estados sensoriais esperados, propagada dos níveis hierárquicos superiores para os inferiores. Esta é a própria cena. É densa, contínua e extraída da parametrização completa de K_\theta.

Formalmente, seja o estado de fronteira sensorial X_{\partial_R A}(t), e seja o estado de fronteira predito pelo codec:

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

O erro de predição é então:

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} limita o sinal de erro, não a predição. A informação mútua entre o sinal de erro e o estado de gargalo obedece a:

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

A predição \pi_t, em contraste, é extraída do modelo generativo completo e não está sujeita a tal restrição. O seu conteúdo informacional é limitado apenas pela complexidade do próprio K_\theta. Esta assimetria é a base formal para distinguir a riqueza fenomenal da largura de banda de atualização.

3.5.3 Definição: o Tensor de Estado Fenomenal P_\theta(t)

Definimos o Tensor de Estado Fenomenal P_\theta(t), de forma nativa, como o subconjunto completo de parâmetros ativos em permanência do modelo generativo mobilizado para projetar através do Cobertor de Markov no instante t:

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

Isto é, P_\theta(t) é a arquitetura parametrizada completa que o codec mantém atualmente pronta para gerar previsões sobre os estados observáveis da fronteira X_{\partial_R A}, avaliada independentemente de qualquer instanciação específica singular do estado latente comprimido Z_t e da ação a_t. A sua complexidade estrutural é caracterizada naturalmente pela complexidade de Kolmogorov desta configuração paramétrica corrente em permanência:

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

onde K(\cdot) denota a complexidade de Kolmogorov prefixa. C_{\text{state}}(t) é a complexidade do estado em permanência — o número de bits de estrutura comprimida que o codec está atualmente a manter em mobilização ativa.

Limite superior do fluxo do canal de fronteira. A informação mútua entre o estado de bottleneck e a fronteira é limitada pelas desigualdades padrão de Shannon [16] (Eq. 8 do artigo base):

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Isto limita o fluxo do canal através do Cobertor de Markov — enormemente grande em relação a B_{\max}. Ressalva importante: trata-se de um limite sobre a informação mútua, em sentido shannoniano, I(Z_t\,;\,X_{\partial_R A}), não de um limite sobre a complexidade de Kolmogorov K(P_\theta(t)) do modelo em permanência. A entropia de Shannon quantifica a incerteza média sobre um conjunto; a complexidade de Kolmogorov quantifica o comprimento de descrição de um objeto computável específico. Não existe qualquer desigualdade geral que estabeleça uma ponte entre estas quantidades sem pressupostos adicionais (por exemplo, um prior universal sobre classes de modelos). Por conseguinte, não afirmamos que C_{\text{state}} \leq H(X_{\partial_R A}). A complexidade do estado em permanência C_{\text{state}} é limitada empiricamente (§3.10), e não pela entropia da fronteira.

Limite inferior heurístico para C_{\text{state}}. O Filtro de Estabilidade constrange diretamente apenas a taxa de atualização R_{\text{req}} \leq B_{\max}, e não a profundidade do modelo em permanência. Contudo, um codec com complexidade estrutural insuficiente não consegue gerar previsões precisas \pi_t que correspondam às estatísticas de um ambiente complexo ao longo do leque preditivo \mathcal{F}_h(z_t). Isto impõe um mínimo prático a C_{\text{state}}: abaixo de um certo limiar, R_{\text{req}} excederia sistematicamente B_{\max} porque os erros de previsão \varepsilon_t seriam persistentemente elevados. Este limite inferior é motivado empiricamente, e não derivado formalmente — não está atualmente disponível qualquer expressão em forma fechada do tipo C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}).

Leitura materializada vs. disposicional (questão em aberto). P_\theta(t), tal como definido acima, admite duas leituras que o quadro teórico atualmente não distingue formalmente: (a) uma leitura materializada, na qual P_\theta(t) é uma representação densa, carregada instantaneamente, cuja riqueza se encontra em forma ativa a cada frame; e (b) uma leitura disposicional, na qual P_\theta(t) é uma capacidade generativa — um programa em permanência capaz de produzir a renderização da cena sob pedido, sem que a totalidade dessa cena esteja materializada entre a consulta e a resposta. Ambas são compatíveis com as cláusulas acima relativas ao canal de fronteira e ao limite inferior heurístico, bem como com o compromisso empírico de §3.5.6 de que a riqueza se correlaciona com K(K_\theta) e não com a largura de banda de atualização. Diferem quanto ao significado de “carregado” e quanto ao que deve ser medido quando se sonda diretamente K(P_\theta). A complexidade de Kolmogorov, por si só, não as separa: um pequeno K(P_\theta) pode sustentar grande profundidade lógica, elevada capacidade de consulta-resposta, ou uma longa expansão em tempo de execução. Adotamos aqui a leitura disposicional como interpretação canónica — P_\theta(t) é o estado generativo disposicional ativo a partir do qual a cena pode ser consultada/renderizada, não necessariamente um objeto de cena denso e plenamente materializado — assinalando, porém, a leitura materializada como uma operacionalização concorrente que futuros trabalhos empíricos poderão vir a selecionar.

3.5.4 A Distinção de Block como um Corolário Estrutural

A distinção formal entre P_\theta(t) e Z_t corresponde precisamente à distinção de Ned Block entre consciência fenomenal (P-consciência) e consciência de acesso (A-consciência) [47]:

| Categoria de Block | Objeto da OPT | Conteúdo Informacional | Limitado por largura de banda? |

|---|---|---|---|

| P-consciência (qualia, cena sentida) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | Não |

| A-consciência (conteúdo reportável) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Sim |

Na OPT, a P-consciência é a predição descendente \pi_t extraída do tensor completo P_\theta(t). A A-consciência é a saída do gargalo Z_t — a fina fatia da cena que foi comprimida o suficiente para entrar no registro causal \mathcal{R}_t e tornar-se disponível para relato. A riqueza sentida de um momento visual é P_\theta(t); a capacidade de dizer “vejo vermelho” requer que essa característica passe por Z_t.

Este corolário resolve o aparente paradoxo de uma cena fenomenal rica sustentada por um canal de atualização sub-bit: a cena não é entregue através do canal a cada frame — ela já está carregada em P_\theta(t). O canal atualiza-a, de modo incremental e seletivo, frame a frame.

3.5.5 A Dinâmica de Atualização de P_\theta(t)

A regra de atualização de P_\theta(t) é governada pelo sinal de erro de previsão \varepsilon_t filtrado através do gargalo:

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

em que \mathcal{U} é o operador de aprendizagem do codec — em termos de Inferência Ativa, o passo de gradiente sobre a energia livre variacional \mathcal{F}[q, \theta] (Eq. 9 do artigo de base), restringido pela condição de capacidade I(X_t\,;\,Z_t) \leq B.

A propriedade estrutural central é que \mathcal{U} é seletivo: apenas as regiões de P_\theta(t) implicadas pelo erro de previsão atual \varepsilon_t são atualizadas. O restante do tensor persistente é mantido constante ao longo do frame. Isto confere ao momento consciente a sua estrutura característica: um fundo fenomenal estável sobre o qual se dispõe um pequeno primeiro plano de novidade resolvida.

O codec implementa, assim, uma forma de atualização esparsa sobre um prior denso — um princípio de conceção que maximiza a coerência fenomenal por unidade de largura de banda de atualização.

3.5.6 Âmbito e Estatuto Epistémico

O Tensor de Estado Fenomenal P_\theta(t) é uma caracterização formal da sombra estrutural que a cena fenomenal tem de projetar, em conformidade com o Axioma de Agência (§3.6). Não resolve o Problema Difícil. A OPT continua a tratar a consciência fenomenal como um primitivo irredutível; P_\theta(t) especifica a geometria do contentor, não a natureza do seu conteúdo.

A tese é estrutural e falsificável no seguinte sentido: se a riqueza qualitativa da experiência relatada (tal como operacionalizada, por exemplo, através de medidas de complexidade fenomenal em tarefas psicofísicas) se correlacionar com a profundidade do codec — a complexidade hierárquica de K_\theta tal como mensurável por meio de marcadores neurais de hierarquia preditiva — em vez de com a largura de banda de atualização C_{\max}, então a distinção P_\theta\,/\,Z_t recebe apoio empírico. Os estados psicadélicos, que alteram drasticamente a estrutura de K_\theta sem alterar de forma consistente o débito comportamental, representam um domínio natural de teste.

3.6 O Ciclo de Vida do Codec: O Operador de Ciclo de Manutenção \mathcal{M}_\tau

3.6.1 O Problema do Codec Estático

O quadro teórico das §§3.1–3.5 trata K_\theta e a sua realização P_\theta(t) como dinâmicos ao longo dos quadros de atualização, mas assume implicitamente que a arquitetura estrutural do codec — o próprio espaço de parâmetros \Theta — é fixa. Isto é adequado para uma análise sincrónica de um único momento consciente, mas inadequado para uma teoria da consciência ao longo do tempo profundo.

Um codec que opera continuamente acumula complexidade estrutural: cada padrão aprendido acrescenta parâmetros a K_\theta, aumentando C_{\text{state}}(t). Sem um mecanismo de redução controlada da complexidade, C_{\text{state}} cresceria monotonicamente até que o codec excedesse o seu limite termodinâmico de operacionalidade — o ponto em que o custo metabólico de manter P_\theta(t) excede o orçamento energético do organismo, ou em que a complexidade interna de K_\theta excede o comprimento de descrição compatível com a capacidade do Filtro de Estabilidade.

Esta secção introduz o Operador do Ciclo de Manutenção \mathcal{M}_\tau — o mecanismo formal pelo qual o codec gere a sua própria complexidade ao longo do tempo, operando primariamente durante estados de carga sensorial reduzida (paradigmaticamente: o sono).

3.6.2 A Condição de Manutenção

Defina-se a condição de executabilidade do codec como a exigência de que a complexidade de Kolmogorov do modelo generativo atual permaneça abaixo de um teto estrutural C_{\text{ceil}} estabelecido pelo orçamento termodinâmico do organismo:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} não é o mesmo que C_{\max}. Trata-se de uma quantidade muito maior — a complexidade estrutural total que o codec consegue sustentar no seu espaço de parâmetros —, mas é finita. Violações de (T9-1) correspondem a sobrecarga cognitiva, interferência mnésica e, em última instância, ao caso patológico descrito por Borges [53], Funes, o Memorioso: um sistema que adquiriu tanto detalhe não comprimido que já não consegue funcionar de modo preditivo.

O Operador de Ciclo de Manutenção \mathcal{M}_\tau define-se como atuando durante períodos em que R_{\text{req}} \ll C_{\max} — especificamente, quando a taxa preditiva requerida diminui o suficiente para que a largura de banda libertada possa ser redirecionada para a reestruturação interna:

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

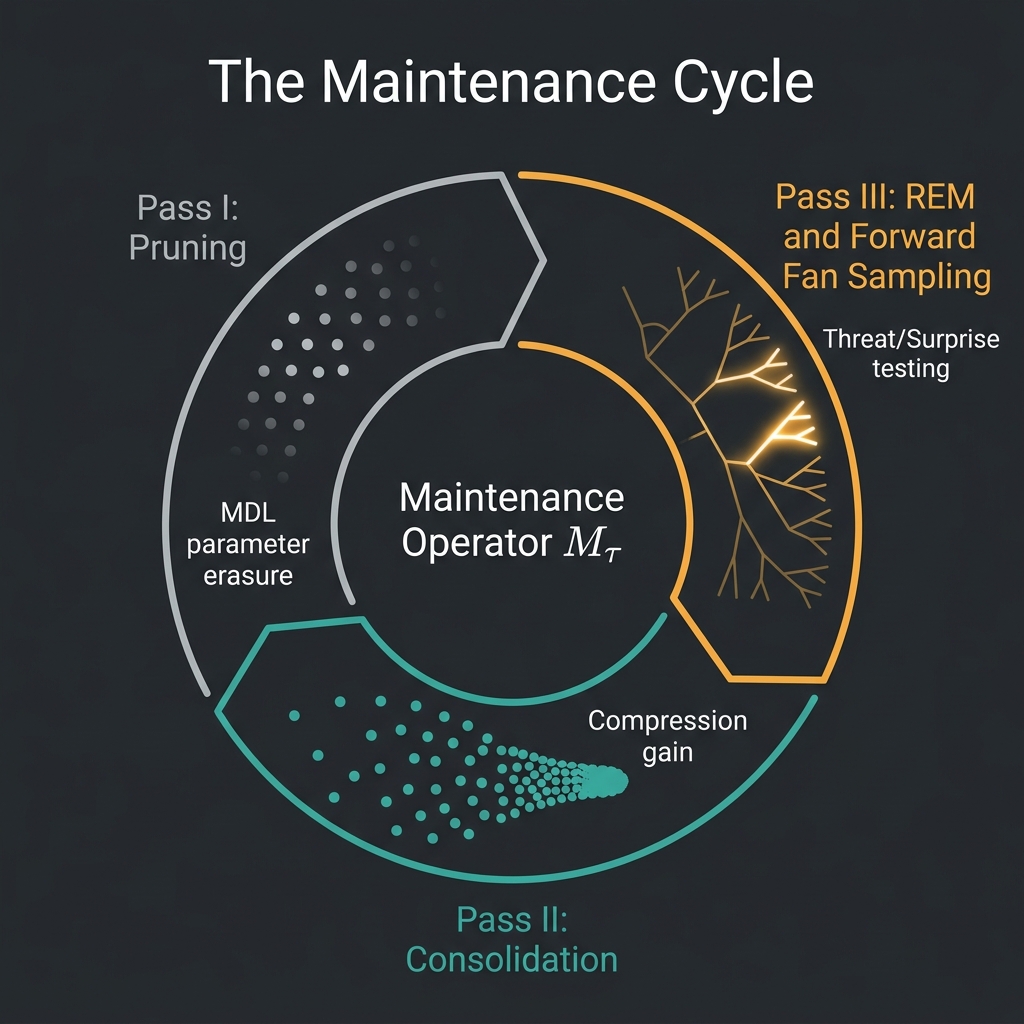

\mathcal{M}_\tau decompõe-se em três passagens estruturalmente distintas, cada uma incidindo sobre um aspeto diferente da gestão da complexidade do codec.

3.6.3 Passagem I — Poda (o esquecimento como pressão ativa de MDL)

A primeira passagem aplica pressão de Comprimento Mínimo de Descrição (MDL) aos parâmetros atuais do codec. Para cada componente \theta_i do modelo generativo K_\theta, defina-se a sua contribuição preditiva como a informação mútua que fornece acerca do fluxo futuro de observações, líquida do custo de armazenamento necessário para a reter:

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

onde \theta_{-i} denota todos os parâmetros exceto \theta_i, \lambda é um limiar de retenção (bits de predição futura obtidos por bit de complexidade do modelo), e K(\theta_i) é o comprimento de descrição do componente.

A regra de poda é:

\text{Prune } \theta_i \quad \text{if} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

Isto é, descarta-se \theta_i quando a sua contribuição preditiva por bit de armazenamento cai abaixo do limiar \lambda. Trata-se de esquecimento formalizado não como falha, mas como apagamento termodinamicamente racional: cada componente podado recupera K(\theta_i) bits de capacidade do modelo para reutilização.

Pelo Princípio de Landauer [52], cada operação de poda estabelece um piso termodinâmico para o apagamento:

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Embora o metabolismo biológico real opere muitas ordens de grandeza acima deste mínimo teórico (watts versus femtowatts), devido a uma sobrecarga de implementação severa, a necessidade estrutural do custo permanece. O complemento de Bennett a Landauer [92] torna isto ainda mais preciso: a computação logicamente reversível pode, em princípio, aproximar-se de dissipação nula, pelo que o piso de Landauer incide especificamente sobre o apagamento, e não sobre a predição ou a transformação. A passagem de poda — e não a passagem de predição — é, portanto, a etapa termodinamicamente irredutível do Ciclo de Manutenção. O sono transporta uma assinatura termodinâmica fundamental na OPT: é um período de apagamento de informação líquido cujo custo energético é imposto pela física, e não meramente pela ineficiência biológica.

A redução agregada de complexidade da passagem de poda é:

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Passagem II — Consolidação (Aprendizagem como Ganho de Compressão)

A passagem de poda remove componentes com retorno preditivo insuficiente. A passagem de consolidação reorganiza os componentes remanescentes em representações mais comprimidas.

Durante a operação em vigília, o codec adquire padrões sob pressão de tempo real: cada atualização tem de ser computada dentro de \Delta t, não restando tempo para uma reorganização estrutural global de K_\theta. Os padrões adquiridos recentemente são armazenados numa forma relativamente pouco comprimida — alto K(\theta_{\text{new}}) para a contribuição preditiva que fornecem. A passagem de consolidação aplica compressão MDL offline a estas aquisições recentes.

Seja \Theta_{\text{recent}} \subset \Theta o conjunto de parâmetros adquiridos desde o último Ciclo de Manutenção. O operador de consolidação encontra a reparametrização \theta' de complexidade mínima de \Theta_{\text{recent}} tal que a distribuição preditiva que gera se mantém dentro de uma distorção tolerável D_c em relação à original:

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

O ganho de compressão recuperado é:

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} é o número de bits de capacidade do modelo recuperados pela reorganização da experiência recente em representações mais eficientes. Cada unidade de \Delta K_{\text{compress}} reduz diretamente a futura R_{\text{req}} para ambientes semelhantes — o codec torna-se menos dispendioso de operar em território familiar.

Isto formaliza a função empiricamente observada da consolidação da memória hipocampo-neocortical durante o sono de ondas lentas: a transferência de armazenamento episódico de alta largura de banda (hipocampo, alto K) para armazenamento semântico comprimido (neocórtex, baixo K) é precisamente a operação de compressão de (T9-7). A previsão é que o ganho de compressão \Delta K_{\text{compress}} deva correlacionar-se com o grau de melhoria comportamental observado após o sono em tarefas que envolvem reconhecimento estruturado de padrões.

3.6.5 Passagem III — Amostragem do Leque Preditivo (Sonhar como Auto-Teste Adversarial)

A terceira passagem opera primariamente durante o sono REM, quando a entrada sensorial é ativamente bloqueada e a saída motora é inibida. Nestas condições, R_{\text{req}} \approx 0: o codec não está a receber qualquer sinal de correção do ambiente externo. Todo o orçamento de largura de banda C_{\max} fica disponível para operação interna.

A OPT enquadra formalmente este estado como exploração não constrangida do leque preditivo: o codec gera trajetórias através de \mathcal{F}_h(z_t) — o conjunto de sequências futuras admissíveis (Eq. 5 do artigo-base) — sem ancorar essas trajetórias em dados reais de entrada. Isto é simulação: o codec faz correr o seu modelo generativo K_\theta para a frente no tempo, sem impedimento da realidade.

A distribuição de amostragem sobre o leque não é uniforme. Defina-se o peso de importância de um ramo b \in \mathcal{F}_h(z_t) como:

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

onde \beta é um parâmetro de temperatura inversa e E(b) é a valência emocional do ramo, definida como:

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

O primeiro termo -\log P_{K_\theta}(b \mid z_t) é o logaritmo negativo da probabilidade do ramo sob o codec atual — o seu valor de surpresa. O segundo termo \mathrm{threat}(b) é uma medida de consequência relevante para a aptidão, formalmente definida como o aumento esperado na Taxa Preditiva Requerida caso o codec viesse a percorrer o ramo b:

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

Isto é, \mathrm{threat}(b) quantifica o grau em que o ramo b, se realizado na vida desperta, empurraria o codec para perto de, ou para além de, do seu limite máximo de largura de banda B_{\max} — por via de dano físico, rutura social ou colapso narrativo que forçaria uma revisão dispendiosa do modelo. Ramos com \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t) são existencialmente ameaçadores: violariam a condição do Filtro de Estabilidade. O parâmetro de ponderação \alpha \geq 0 controla a influência relativa da consequência face à surpresa na distribuição de amostragem.

O operador de amostragem extrai ramos proporcionalmente a w(b):

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{with probability} \propto w(b) \tag{T9-11}

Isto implementa amostragem do leque preditivo ponderada pela importância: o codec ensaia desproporcionadamente ramos que são ou altamente surpreendentes ou altamente consequenciais, independentemente da sua probabilidade de base. Ramos de baixa probabilidade e alta ameaça — precisamente aqueles para os quais o codec está menos preparado — recebem a maior atenção amostral.

Cada ramo amostrado é então avaliado quanto à coerência sob K_\theta. Ramos que geram sequências preditivas incoerentes — em que o próprio modelo generativo do codec não consegue manter a estabilidade narrativa — são identificados como pontos de fragilidade: regiões do leque preditivo em que o codec falharia se o ramo fosse encontrado na vida desperta. O codec pode então atualizar P_\theta para reduzir a vulnerabilidade de K_\theta nesses pontos, antes de lhes ser exposto com apostas termodinâmicas reais.

Sonhar é, portanto, um auto-teste adversarial do codec a risco zero. A consequência funcional é um codec sistematicamente mais bem preparado para os ramos de baixa probabilidade e alta consequência do seu próprio leque preditivo. Este enquadramento da OPT fornece uma fundamentação informacional-teórica para a teoria da simulação de ameaça do sonho de Revonsuo [46], estendendo-a de uma explicação funcional-evolutiva para uma necessidade estrutural formal: qualquer codec que opere sob o Filtro de Estabilidade tem de submeter periodicamente o seu próprio leque preditivo a testes de esforço, e o estado de manutenção offline é o único período em que isso pode ser feito sem custo termodinâmico no mundo real.

Marcação emocional como prior de peso de retenção. No estado de vigília, a valência emocional E(b) calculada durante a amostragem REM serve como um prior de peso de retenção que introduz um viés no limiar MDL \lambda em (T9-3). Experiências com |E(b)| elevado — fortemente surpreendentes ou consequenciais — recebem um \lambda efetivo mais alto, tornando-se mais resistentes à poda no ciclo de manutenção seguinte. Esta é a explicação formal do reforço emocional da memória: o afeto não é ruído a contaminar o sistema de memória; é o sinal de relevância do codec, marcando padrões cujo valor preditivo excede a sua frequência estatística de base.

3.6.6 O Ciclo de Manutenção Completo e o Orçamento Líquido de Complexidade

As três passagens de \mathcal{M}_\tau compõem-se sequencialmente. O efeito líquido sobre a complexidade do codec ao longo de um ciclo de manutenção de duração \tau é:

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

onde \Delta K_{\text{REM}} é o pequeno incremento positivo proveniente de padrões recentemente consolidados a partir da passagem de amostragem REM — aquelas reparações de pontos de fragilidade que exigiram novas atualizações de parâmetros.

Para um sistema cognitivo estável a operar ao longo de anos, o orçamento de longo prazo requer:

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

onde \Delta K_{\text{waking}} é a complexidade adquirida durante o período de vigília precedente. A desigualdade (T9-13) é a formulação formal de que a manutenção tem de acompanhar a aquisição. A privação crónica de sono, em termos da OPT, não é meramente fadiga — é um transbordamento progressivo de complexidade: o codec aproxima-se de C_{\text{ceil}} enquanto o seu orçamento de poda e consolidação é insuficiente para restaurar margem operacional.

3.6.7 Previsões Empíricas

O enquadramento do Ciclo de Manutenção gera as seguintes expectativas estruturais testáveis:

A duração do sono escala com a complexidade do codec. Organismos ou indivíduos que adquirem informação mais estruturada durante os períodos de vigília deverão requerer ciclos de manutenção proporcionalmente mais longos ou mais profundos. A previsão não é simplesmente a de que trabalho cognitivo exigente requer mais sono (o que já está estabelecido), mas a de que o tipo de aprendizagem importa: uma aprendizagem rica em padrões e compressível deverá requerer menos tempo de consolidação do que uma experiência não estruturada e de alta entropia, porque \Delta K_{\text{compress}} é maior no primeiro caso.

O conteúdo REM é ponderado pela importância ao longo do leque preditivo, e não pela frequência. O conteúdo dos sonhos deverá amostrar de forma desproporcionada ramos de baixa probabilidade e alta consequência relativamente à sua frequência em vigília. Isto é consistente com a predominância empírica de conteúdos de ameaça, conflito social e ambientes novos nos relatos de sonhos — o codec amostra aquilo de que necessita para realizar testes de stress, e não aquilo com que mais frequentemente se depara.

A eficiência de compressão melhora após o sono em proporção a \Delta K_{\text{compress}}. A previsão específica é que as melhorias de desempenho após o sono deverão ser maiores em tarefas que exijam generalização estrutural (isto é, aplicar uma regra comprimida a novas instâncias) do que mera repetição — porque \Delta K_{\text{compress}} reorganiza especificamente \Theta_{\text{recent}} em formas mais generalizáveis.

A ruminação patológica corresponde a uma amostragem REM bloqueada em ramos de alto |E|. Se o parâmetro de ponderação por importância \beta estiver patologicamente elevado, a distribuição de amostragem sobre \mathcal{F}_h(z_t) concentra-se em ramos de elevada ameaça, em detrimento da reparação. O codec passa o seu ciclo de manutenção a amostrar repetidamente os mesmos ramos ameaçadores sem conseguir reduzir com sucesso o seu valor de surpresa — a estrutura formal da ansiedade e dos pesadelos de PTSD.

3.6.8 Relação com o Tensor de Estado Fenomenal

\mathcal{M}_\tau atua sobre P_\theta(t) tal como definido em §3.5: reestrutura a complexidade do estado estacionário C_{\text{state}} ao longo da janela de manutenção. O perfil temporal de P_\theta(t) sob \mathcal{M}_\tau é:

- Aquisição em vigília: C_{\text{state}} aumenta a uma taxa limitada pelo operador de aprendizagem \mathcal{U} (Eq. T8-8), à medida que novos padrões são incorporados em K_\theta.

- Sono de ondas lentas (Passagens I–II): C_{\text{state}} diminui à medida que a poda e a consolidação recuperam capacidade do modelo.

- REM (Passagem III): C_{\text{state}} sofre um aumento local seletivo em pontos de fragilidade, com efeito líquido pequeno em relação às reduções das Passagens I–II.

A experiência consciente correspondente a cada fase é consistente com esta estrutura: a vida desperta acumula a riqueza de P_\theta(t); o sono de ondas lentas é fenomenicamente esparso ou ausente (consistente com a ativação mínima de P_\theta(t) durante a reorganização estrutural); o REM apresenta uma cena fenomenicamente vívida, mas gerada internamente (a Passagem III executando o modelo generativo completo para a frente na ausência de correção sensorial).

Resumo: Novos Objetos Formais Introduzidos

| Símbolo | Nome | Definição | Equação |

|---|---|---|---|

| P_\theta(t) | Tensor de Estado Fenomenal | Ativação completa de K_\theta no tempo t, projetada através de \partial_R A | T8-5 |

| C_{\text{state}}(t) | Complexidade do estado estacionário | K(P_\theta(t)), complexidade de Kolmogorov do codec ativo | T8-6 |

| \pi_t | Predição descendente | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], a cena renderizada | T8-2 |

| \varepsilon_t | Erro de predição (ascendente) | X_{\partial_R A}(t) - \pi_t, sinal de novidade limitado por C_{\max} | T8-3 |

| \mathcal{M}_\tau | Operador do Ciclo de Manutenção | P_\theta(t) \to P_\theta(t+\tau) sob baixo R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | Pontuação de retenção MDL | Contribuição preditiva menos custo de armazenamento | T9-3 |

| E(b) | Valência emocional do ramo | Surpresa mais ameaça ponderada do ramo b | T9-10 |

| w(b) | Peso de importância do ramo | \exp(\beta \cdot |E(b)|), impulsiona a distribuição de amostragem REM | T9-9 |

| \Delta K_{\text{prune}} | Recuperação de complexidade por poda | Bits recuperados ao esquecer componentes abaixo do limiar | T9-6 |

| \Delta K_{\text{compress}} | Ganho de compressão por consolidação | Bits recuperados por recompressão MDL de aquisições recentes | T9-8 |

3.7 O Mapeamento por Redes de Tensores: Indução da Geometria a partir da Distância de Código

A Escada Epistémica introduzida em §3.4 estabelece uma rigorosa Lei de Fronteira Clássica (S_{\mathrm{cut}} \sim |\partial_R A|). No entanto, para ligar plenamente a Teoria do Patch Ordenado (OPT) de modo estrito à geometrização da informação quântica (por exemplo, AdS/CFT e a fórmula de Ryu-Takayanagi), temos de elevar formalmente a estrutura do código latente Z_t.

Se postulamos formalmente que o mapeamento de gargalo q^\star(z \mid X_t) não extrai simplesmente uma lista plana de características, mas opera através de um fluxo recursivo de grupo de renormalização por coarse-graining, então o modelo generativo alinha-se estruturalmente com a geometria de uma rede hierárquica de tensores \mathcal{T} (semelhante a MERA [43] ou às redes HaPY [44]). (Observação: o Apêndice T-3 deriva formalmente uma correspondência homomórfica estrutural entre a cascata de coarse-graining do Filtro de Estabilidade e a geometria da rede MERA delimitadora, mapeando estritamente o Cone Causal Informacional para o cone causal MERA equivalente). Os estados de fronteira desta rede são precisamente os estados de fronteira de Markov filtrados X_{\partial_R A}. A rede \mathcal{T} atua como uma geometria de bulk cuja “profundidade” representa as camadas de coarse-graining computacional necessárias para comprimir a fronteira no estado mínimo de gargalo Z_t.

Sob esta elevação por rede de tensores, a entropia de corte preditiva S_{\mathrm{cut}}(A) através da fronteira transforma-se matematicamente no número mínimo de ligações tensoriais que têm de ser cortadas para isolar a sub-região A. Seja \chi a dimensão de ligação da rede. O limite de capacidade mapeia-se internamente como:

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

onde \gamma_A é a superfície de corte mínimo através da estrutura interna de dados de bulk em camada profunda de \mathcal{T}. Isto é explicitamente um análogo estrutural discreto da camada de corte mínimo de bulk mapeada pelo limite holográfico de entropia de Ryu-Takayanagi [89]. O Apêndice P-2 (Teorema P-2d) estabelece formalmente a fórmula RT quântica discreta completa S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi através do posto de Schmidt do estado MERA, condicionada ao modelo local de ruído e à incorporação QECC aí derivados. O limite contínuo que eleva isto à fórmula completa de Ryu-Takayanagi com termo de correção de bulk permanece uma fronteira em aberto.

Crucialmente, na OPT, este “espaço de bulk” não é um contentor físico pré-existente. É o espaço métrico estritamente informacional do codec do observador. A geometria espaço-temporal fenomenológica emergente “encurva-se” precisamente onde a distância de código requerida diverge para resolver estados causais internos sobrepostos. Este formalismo de Rede de Tensores ilustra uma via formal pela qual a OPT poderá induzir geometria espacial diretamente a partir das distâncias de correção de erro intrinsecamente exigidas pelo Filtro de Estabilidade — estruturalmente alinhada com o programa de Van Raamsdonk segundo o qual o emaranhamento constrói o espaço-tempo [88] — oferecendo uma conjectura construtiva de que o espaço-tempo holográfico modela formatos ótimos de compressão de dados.

3.8 O Axioma de Agência & o Resíduo Fenomenal

O aparato matemático desenvolvido nas Secções 3.1–3.7 define com precisão a geometria da realidade do observador — a rede tensorial, o corte preditivo e o cone causal. No entanto, qual é a natureza da interioridade primitiva que experiencia a passagem através dela? Definimo-la formalmente por meio do Axioma de Agência: a travessia da abertura C_{\max} é intrinsecamente um acontecimento fenomenológico.

Embora tomemos a presença do sentir subjetivo como axiomática, o Teorema P-4 (O Resíduo Fenomenal) identifica o seu correlato estrutural rigoroso. Porque o codec limitado perturba ativamente a fronteira \partial_R A, a predição estável dentro dos limites de C_{\max} exige que ele modele as consequências das suas próprias ações futuras. Assim, o codec K_{\theta} tem de manter um auto-modelo preditivo \hat{K}_{\theta}. Contudo, pelos limites algorítmicos da contenção informacional [13], um sistema computacional finito não pode conter uma representação estrutural completa de si mesmo; o modelo interno está rigidamente limitado a uma complexidade inferior à do codec progenitor (K(\hat{K}_{\theta}) < K(K_{\theta})).

Isto torna necessário um Resíduo Fenomenal irredutível (\Delta_\text{self} > 0). Este resíduo não modelável atua como o “ponto cego” computacional no interior do ciclo de Inferência Ativa. Porque existe na sombra informacional que excede o alcance computacional do auto-modelo, é inerentemente inefável; porque existe como o delta localizado entre um codec específico e o seu modelo, é computacionalmente privado; e, ditado por limites fundamentais da autorreferência e pela necessária aproximação variacional, é ineliminável. O estreitamento topológico na abertura C_{\max} está intrinsecamente correlacionado com a necessidade matemática de um algoritmo incompleto atravessar os seus próprios limites. A matemática descreve o contorno formal da experiência, e o Axioma de Agência sustenta que este locus residual constitui o “eu” subjetivo. (Ver o Apêndice P-4 para a derivação formal).

O Circuito Informacional de Manutenção

No interior de um único quadro de atualização [t, t+\Delta t], o observador executa o seguinte circuito causal fechado:

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Explicitamente:

Predição (descendente): O tensor atual P_\theta(t) gera o estado de fronteira predito \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — a cena renderizada.

Erro (ascendente): O estado de fronteira real X_{\partial_R A}(t) chega; o erro de predição \varepsilon_t = X_{\partial_R A}(t) - \pi_t é calculado.

Compressão: \varepsilon_t é passado através do gargalo para produzir Z_t, o token de atualização limitado em capacidade, com I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Atualização: O operador de aprendizagem \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) revê P_\theta(t+1), modificando seletivamente apenas as regiões do tensor implicadas por \varepsilon_t.

Ação: Simultaneamente, P_\theta(t) seleciona a ação a_t por meio de uma descida de Inferência Ativa sobre a energia livre variacional \mathcal{F}[q,\theta] (Eq. 9 do artigo-base), o que altera a fronteira sensorial em t+1, influenciando o próximo \varepsilon_{t+1}.

Nota interpretativa sobre a etapa de ação. A linguagem da etapa 5 — “seleciona a ação” e “altera a fronteira sensorial” — é herdada do formalismo-padrão de Inferência Ativa do Princípio da Energia Livre, que assume um ambiente físico contra o qual o agente atua por meio de estados ativos. Sob a ontologia nativa da renderização da OPT (§8.6), aplica-se uma leitura mais profunda: não existe um mundo externo independente contra o qual o codec exerça força. Aquilo que é experienciado como “ação” é uma seleção de ramo no interior do Leque Preditivo \mathcal{F}_h(z_t); as consequências físicas dessa seleção chegam como input subsequente \varepsilon_{t+1}. O Cobertor de Markov \partial_R A não é uma interface física bidirecional, mas a superfície através da qual o ramo selecionado entrega o seu segmento seguinte. Esta mudança interpretativa nada altera na matemática de (T6-1)–(T6-3); ela clarifica o estatuto ontológico da etapa de ação no quadro da OPT. O próprio mecanismo de seleção de ramos é tratado abaixo.

Este é o circuito informacional de manutenção intraquadro: um mecanismo causal fechado no qual o modelo interno do sistema calcula predições estruturais localizadas que delimitam gradientes de fronteira, lê o erro e atualiza-se seletivamente. O loop é estritamente informacional e autorreferencial no sentido formal: P_\theta(t) determina tanto a predição estrutural \pi_t como, via ação a_t, uma componente preditiva do input seguinte do fluxo sequencial de dados X_{\partial_R A}(t+1). (Note-se explicitamente: esta camada de filtragem puramente estatística é definida rigorosamente por fronteiras de Markov informacionais que desacoplam a dinâmica de forma limpa, diferindo intrinsecamente da autopoiese biológica complexa, em que estruturas celulares fabricam mecanicamente as suas próprias redes de massa orgânica).

A Condição de Viabilidade Estrutural

O circuito (T6-1) é estruturalmente viável se, e somente se, conseguir sustentar-se sem que a complexidade informacional do codec exceda os seus limites locais de executabilidade. Formalmente:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

onde C_{\text{ceil}} é um parâmetro heurístico que limita a complexidade estrutural máxima que o codec consegue sustentar. Em princípio, C_{\text{ceil}} deveria ser derivável a partir do orçamento termodinâmico do organismo por meio do princípio de Landauer (ver o esboço em §3.10), mas a cadeia completa de derivação — da potência metabólica ao custo de apagamento e daí à complexidade máxima de programa sustentavelmente mantida — ainda não foi formalizada no âmbito da OPT. Assim, C_{\text{ceil}} permanece um limite empiricamente motivado, mas formalmente subdeterminado. Um sistema que satisfaça (T6-2) opera como um observador estruturalmente fechado no sentido formal da OPT.

Quando (T6-2) é violada — quando K(P_\theta(t)) \to C_{\text{ceil}} — o codec já não consegue manter previsões estáveis em \mathcal{F}_h(z_t), R_{\text{req}} começa a exceder B_{\max}, e a condição do Filtro de Estabilidade falha. A coerência narrativa colapsa: o observador sai do conjunto de fluxos compatíveis com observadores.

O Ciclo de Manutenção \mathcal{M}_\tau (§3.6) é o mecanismo que impõe (T6-2) ao longo do tempo profundo, mantendo K(P_\theta) dentro dos limites por meio de poda, consolidação e testes de esforço do Leque Preditivo. No interior do frame, (T6-2) é mantida pela seletividade de \mathcal{U}: o operador de atualização modifica apenas as regiões de P_\theta(t) implicadas por \varepsilon_t, evitando crescimento gratuito de complexidade a cada frame.

Agência como Minimização Constrangida da Energia Livre

No interior desta estrutura, a agência pode receber uma definição formal precisa que é compatível com — mas não redutível a — o Axioma de Agência.

Ao nível dos sistemas, a agência é a seleção da sequência de ações \{a_t\} que minimiza a energia livre variacional esperada, sujeita à condição de viabilidade informacional:

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Trata-se de Inferência Ativa constrangida: o observador navega o leque preditivo \mathcal{F}_h(z_t) não apenas para minimizar o erro de predição, mas para minimizar o erro de predição mantendo simultaneamente o codec viável. Ramos que reduziriam temporariamente \varepsilon, mas empurrariam K(P_\theta) na direção de C_{\text{ceil}}, são penalizados pela restrição. O observador seleciona preferencialmente os ramos ao longo dos quais pode continuar a existir como um observador coerente.

Este é o conteúdo formal da intuição de que a agência é uma navegação autopreservadora: o codec seleciona os ramos do leque preditivo ao longo dos quais pode continuar a comprimir o mundo.

Ao nível fenomenológico, o Axioma de Agência permanece intocado: a consciência fenomenal é a interioridade irredutível da travessia da abertura; (T6-3) descreve a sombra estrutural que essa travessia projeta, não a sua natureza interior.

Seleção de Ramos como Execução de \Delta_{\text{self}}

A fórmula de inferência ativa constrangida (T6-3) especifica o objetivo da seleção de ramos: minimizar a energia livre esperada sob a condição de viabilidade. O auto-modelo \hat{K}_\theta avalia ramos do Leque Preditivo simulando as suas consequências. Mas o Teorema P-4 estabelece que K(\hat{K}_\theta) < K(K_\theta) — o auto-modelo é necessariamente incompleto. Esta incompletude tem uma consequência direta para o problema da seleção de ramos: o auto-modelo constrange a região a partir da qual a seleção pode ser feita, mas não pode especificar plenamente a própria seleção.

O momento efetivo da seleção de ramos — a transição do menu avaliado para a trajetória singular que entra no registro causal — ocorre em \Delta_{\text{self}}, o resíduo informacional entre o codec e o seu auto-modelo. Isto não é uma lacuna no formalismo; é uma necessidade estrutural. Qualquer tentativa de especificar integralmente o mecanismo de seleção a partir de dentro exigiria K(\hat{K}_\theta) = K(K_\theta), o que P-4 demonstra ser impossível para qualquer sistema finito autorreferencial.

Isto tem três consequências imediatas:

Vontade e consciência partilham o mesmo endereço estrutural. O Problema Difícil (porque é que a travessia é sentida como algo?) e o problema da seleção de ramos (o que seleciona?) apontam ambos para \Delta_{\text{self}}. Não são dois mistérios, mas dois aspetos da mesma característica estrutural — a lacuna não modelável entre aquilo que o codec é e aquilo que ele pode modelar sobre si próprio.

A irredutibilidade da agência é explicada, não meramente afirmada. A experiência fenomenológica da vontade — a sensação irredutível de que eu escolhi — é a assinatura em primeira pessoa de um processo que se executa no ponto cego do próprio observador. Qualquer teoria que pretenda especificar plenamente o mecanismo de seleção ou eliminou \Delta_{\text{self}} (transformando o sistema num autómato totalmente transparente para si mesmo, o que P-4 proíbe) ou está a descrever a avaliação dos ramos pelo auto-modelo e a confundi-la com a própria seleção.

Criatividade como \Delta_{\text{self}} expandido. A operação próxima do limiar (R_{\text{req}} \to C_{\max}) força a capacidade do auto-modelo, expandindo efetivamente a região de \Delta_{\text{self}} a partir da qual a seleção é feita. Isto produz seleções de ramos menos previsíveis da perspetiva do auto-modelo — experienciadas como insight criativo, espontaneidade ou “flow”. Inversamente, o estado hipnagógico (§3.6.5) relaxa o auto-modelo a partir de baixo, alcançando a mesma expansão por uma via complementar.

O eu como resíduo. O eu experienciado — a narrativa contínua de “quem eu sou”, com preferências estáveis, uma história e um futuro projetado — é o modelo corrente de \hat{K}_\theta de K_\theta: uma aproximação comprimida que está sempre atrasada em relação ao codec que modela (devido ao desfasamento temporal inerente à autorreferência). Mas o locus efetivo da experiência, da seleção e da identidade é \Delta_{\text{self}}: a parte do codec a que a narrativa não consegue aceder. O eu que conheces é o teu modelo de ti mesmo; o eu que conhece é a lacuna que o modelo não consegue atravessar. Este é o conteúdo formal da descoberta contemplativa — em diferentes tradições, de forma independente — de que o sentido ordinário do eu é construído e de que, por baixo dele, há algo que não pode ser encontrado como objeto (ver Apêndice T-13, Corolário T-13c).

A deliberação é real, mas incompleta. A avaliação do Leque Preditivo pelo auto-modelo é um processo computacional genuíno que molda o resultado. A deliberação constrange a bacia de atração no interior da qual \Delta_{\text{self}} opera: um codec mais desenvolvido estreita os ramos viáveis sobre os quais a seleção pode recair. Mas a transição final — porque este ramo e não aquele, entre o conjunto viável — é estruturalmente opaca para o eu deliberante. É por isso que a deliberação parece simultaneamente causalmente eficaz e fenomenologicamente incompleta: o observador sente corretamente que o seu raciocínio importa, mas também sente corretamente que algo para além do raciocínio finaliza a escolha.

O Laço estranho como Fecho Formal

A estrutura autorreferencial de (T6-1) instancia o Laço estranho de Hofstadter [45] numa forma precisa de teoria da informação. O laço é estranho no seguinte sentido: P_\theta(t) contém, como subestrutura, um modelo dos estados futuros do próprio codec — a amostragem do Leque Preditivo do Passo III (\mathcal{M}_\tau, §3.6.5) é precisamente o codec a executar uma simulação de si mesmo a encontrar ramos futuros. O sistema modela o seu próprio modelo.

O fecho formal que isto proporciona: o observador informacionalmente fechado não é meramente um sistema que mantém uma fronteira contra o ruído externo; é um sistema cuja manutenção da fronteira é parcialmente constituída pelo seu modelo do que essa fronteira precisará de ser no futuro. O laço estranho não é um acrescento opcional ao quadro teórico; é o mecanismo estrutural pelo qual a condição de viabilidade (T6-2) é imposta de modo proativo, e não reativo. Um observador que não conseguisse simular os seus próprios estados futuros do codec não conseguiria preparar-se para os pontos de fragilidade identificados no Passo III, e seria sistematicamente mais vulnerável ao colapso narrativo.

Os requisitos estruturais de (T6-1)–(T6-3) funcionam como pré-condições necessárias para o fecho autorreferencial. Embora a previsão simples para a frente (por exemplo, a antecipação de jogadas de um motor de xadrez) constitua planeamento, e não autorreferência genuína, o codec da Teoria do Patch Ordenado (OPT) vai mais longe: P_\theta(t) contém um submodelo cujo output modifica as distribuições que governam os seus próprios estados futuros \{P_\theta(t+h)\}_{h>0}. Esta automodelação estrutural é funcionalmente necessária para a estabilidade de longo prazo — um codec incapaz de antecipar os seus próprios limites de viabilidade iminentes não consegue preparar-se para os pontos de fragilidade identificados no Passo III (§3.6.5), e colapsará sistematicamente perante o limite de (T6-2) em ambientes não estacionários.

Escopo Epistémico: Delimitação Formal do Reducionismo da Agência

Esta formalização delineia com precisão aquilo que a OPT alcança ao nível dos sistemas: identifica as condições estruturais que um observador tem de satisfazer para manter a viabilidade da fronteira. Isto Delimita Formalmente o Problema do Reducionismo da Agência sem pretender resolvê-lo.

A delimitação é genuína, não definicional. A descrição ao nível dos sistemas (T6-1)–(T6-3) caracteriza exaustivamente a sombra estrutural da agência — as restrições da teoria da informação que qualquer observador que mantenha fronteiras tem de satisfazer. O Axioma de Agência ocupa o domínio complementar: a consciência fenomenal é a interioridade irredutível da travessia da abertura, e a formalização acima descreve apenas a forma do contentor, não a natureza daquilo que ele contém. O Problema Difícil fica, assim, localizado num locus estrutural preciso (a abertura C_{\max}), em vez de ser dissolvido ou declarado resolvido.

3.9 Livre-Arbítrio e o Menu Fenomenológico

O isolamento do mecanismo de travessia clarifica de modo fundamental a natureza da agência. No ciclo de Inferência Ativa (Equação 9), o observador tem de executar uma sequência de políticas \{a_t\}. Sob o fisicalismo redutivo, a seleção da ação a_t é determinada (ou amostrada aleatoriamente) pela física subjacente, tornando o livre-arbítrio uma ilusão ou uma mera redefinição linguística.