Teoria uporządkowanego patcha (OPT): informacyjno-teoretyczne ramy selekcji obserwatora i świadomego doświadczenia

v3.4.0 — May 2026

DOI: 10.5281/zenodo.19300777

Prawa autorskie: © 2025–2026 Anders Jarevåg.

Licencja: Ta praca jest udostępniana na licencji Creative

Commons Attribution-NonCommercial-ShareAlike 4.0 International

License.

Abstrakt:

Przedstawiamy Teorię uporządkowanego patcha (OPT), konstruktywną ramę wyprowadzającą strukturalne odpowiedniości między algorytmiczną teorią informacji, selekcją obserwatora a prawem fizycznym. OPT wychodzi od dwóch prymitywów: Uniwersalnej półmiary Solomonoffa \xi na skończonych prefiksach obserwacji oraz ograniczonej pojemności poznawczego kanału C_{\max}. Czysto wirtualny Filtr stabilności — wymagający, by Wymagana szybkość predykcyjna obserwatora R_{\mathrm{req}} nie przekraczała C_{\max} — wybiera rzadkie, przyczynowo spójne strumienie zgodne z istnieniem świadomych obserwatorów; w obrębie takich strumieni lokalną dynamiką rządzi aktywne wnioskowanie.

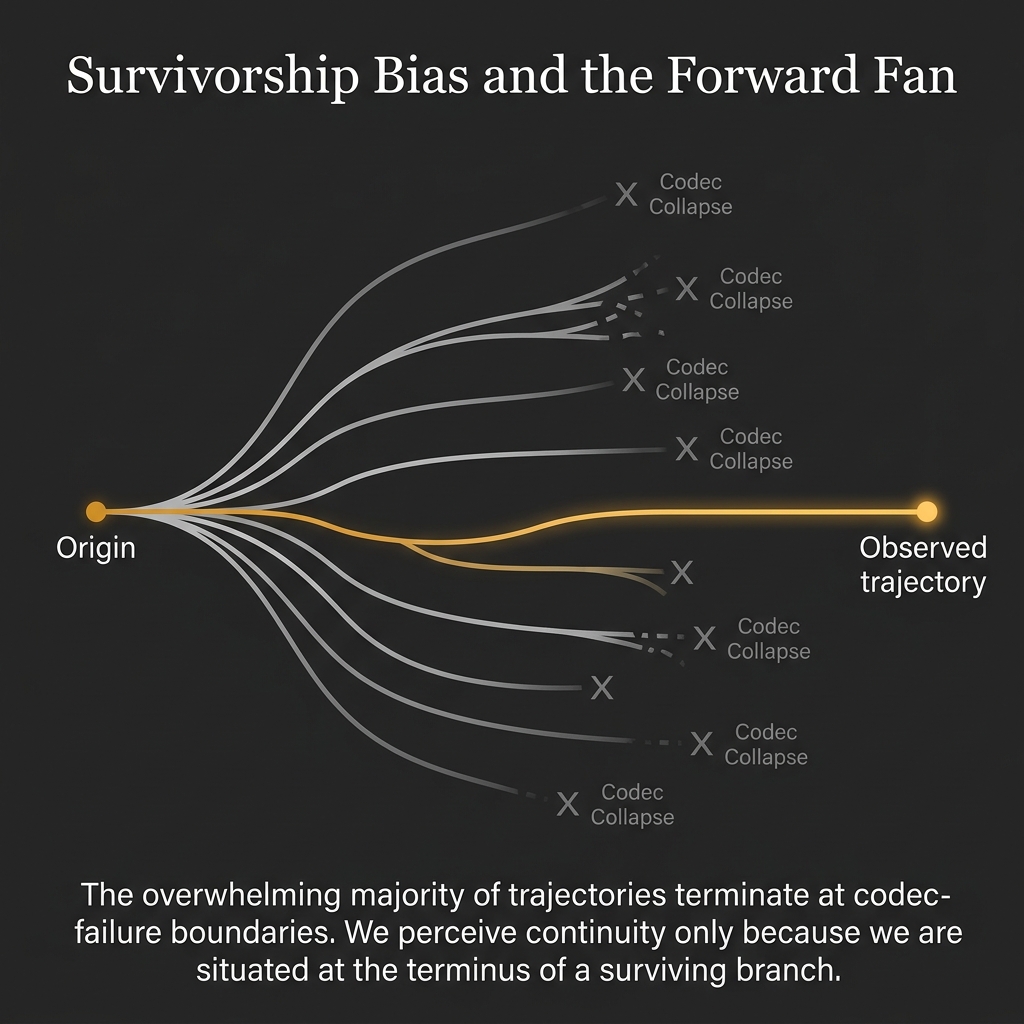

Rama ta jest ontologicznie solipsystyczna: rzeczywistość fizyczna składa się ze strukturalnych regularności w obrębie strumienia zgodnego z obserwatorem. Jednak kompresyjna stronniczość prioru Solomonoffa prowadzi do probabilistycznego Korolarza strukturalnego: skrajna algorytmiczna koherencja pozornych agentów najoszczędniej wyjaśnia się przez ich niezależną instancjację jako obserwatorów pierwotnych. Sprzężenie między obserwatorami, ufundowane na oszczędności kompresyjnej, przywraca rzeczywistą komunikację między patchami i wytwarza uderzającą asymetrię poznawczą: obserwatorzy modelują innych pełniej niż samych siebie.

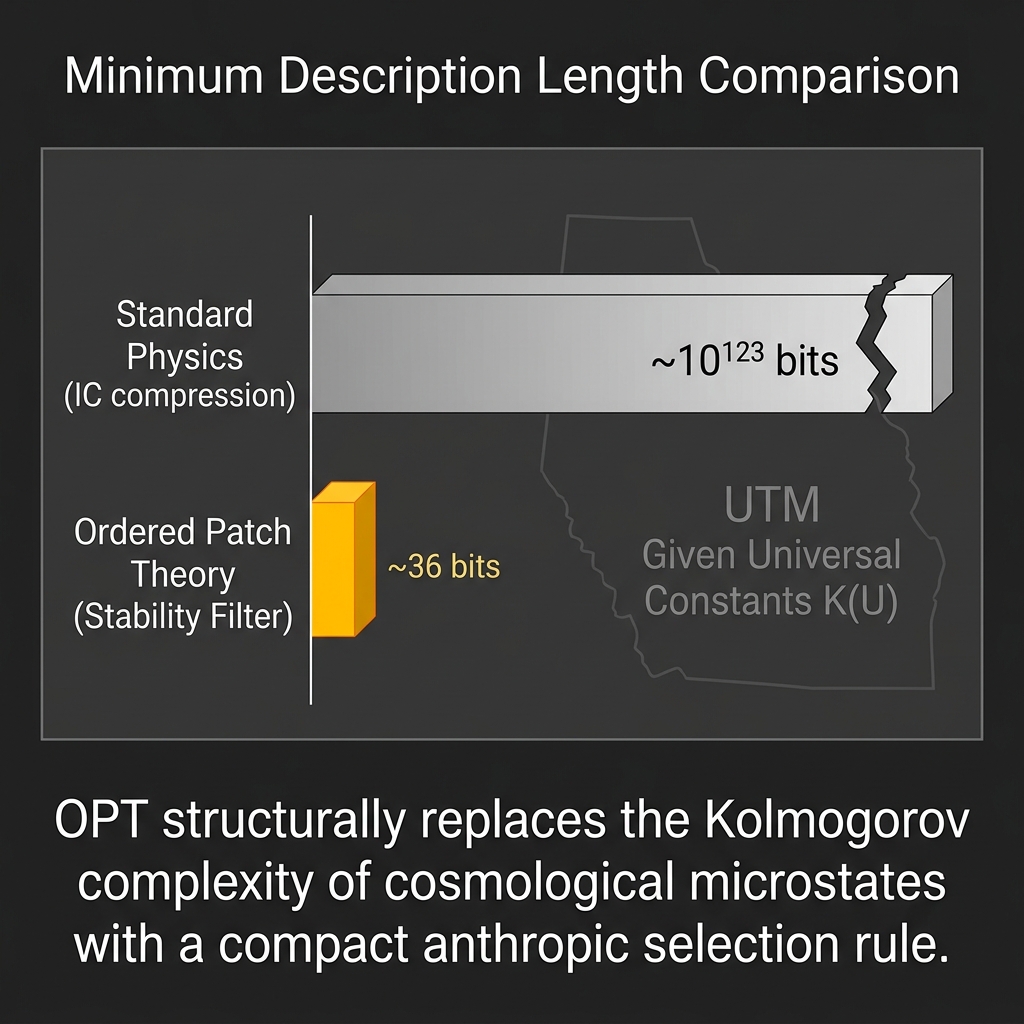

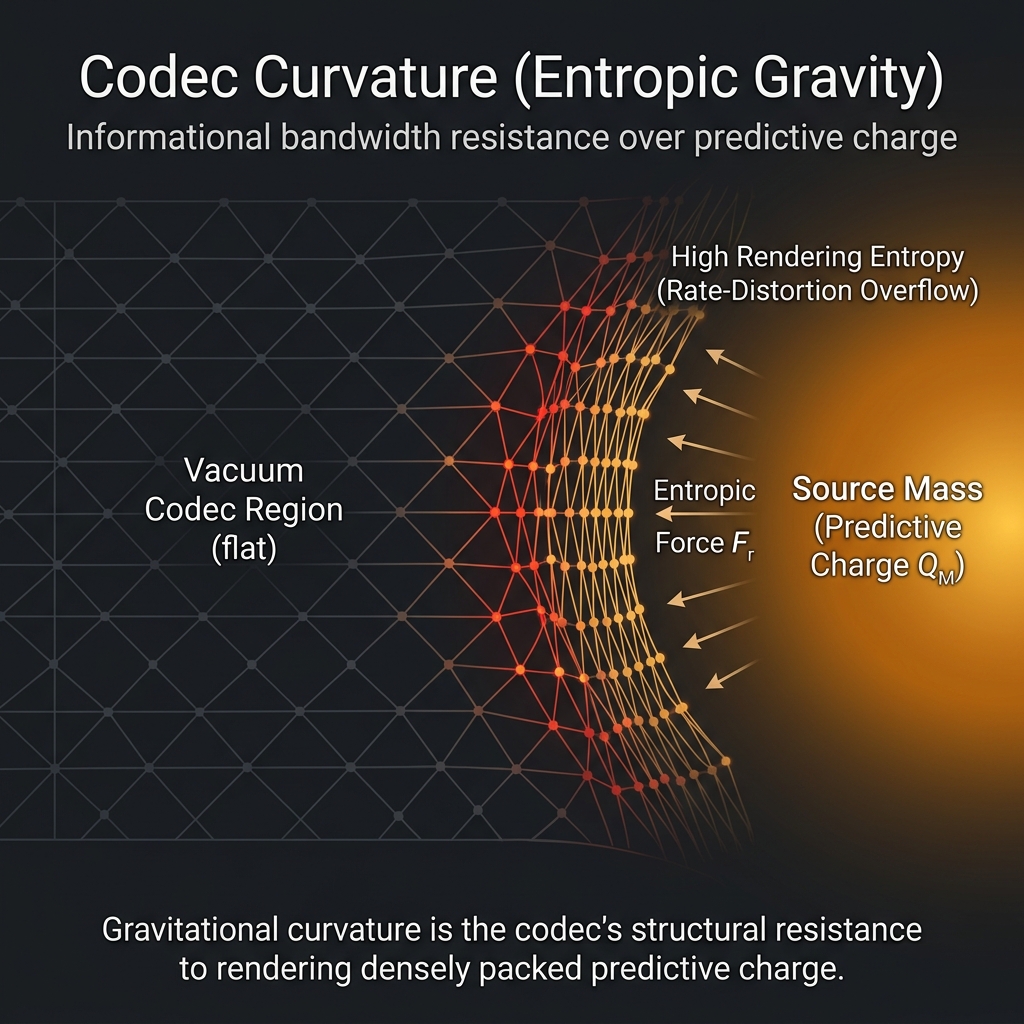

Formalne aneksy ustanawiają wyniki na trzech poziomach epistemicznych. Wyprowadzone warunkowo: ograniczenie szybkość-zniekształcenie dotyczące kompresji predykcyjnej, warunkowy ciąg prowadzący do reguły Borna poprzez twierdzenie Gleasona oraz przewagę oszczędnościową MDL. Odwzorowane strukturalnie: grawitacja entropijna poprzez mechanizm Verlindego (dynamiczno-czasowe sprzężenie renderu z obciążeniem predykcyjnym) oraz homomorfizm sieci tensorowej do MERA (jej hierarchia rozdzielczości przestrzennej) — komplementarne aspekty granicy kompresji, które zgodnie z przewidywaniem powinny pozostać strukturalnie odrębne w warunkach Nasycenia Matematycznego. Twierdzenie o Reziduum fenomenalnym (\Delta_{\text{self}} > 0) ustanawia, że każdy skończony, samoodniesieniowy kodek posiada nieredukowalną informacyjną ślepą plamkę — strukturalne miejsce, w którym subiektywność i sprawczość mają jeden wspólny adres. Zidentyfikowano przewlekły tryb awarii, Dryf narracyjny, w którym systematycznie filtrowane wejście powoduje nieodwracalną korupcję kodeka, niewykrywalną od wewnątrz. Główne empiryczne twierdzenia tej ramy zostały skonsolidowane w postaci szeregu uprzednio zarejestrowanych zobowiązań z jawnymi kryteriami wyłączenia, oddzielających falsyfikowalny rdzeń od jego jawnie metafizycznych komponentów.

Zastosowanie tych ograniczeń do sztucznej inteligencji pokazuje, że inżynieria syntetycznego aktywnego wnioskowania strukturalnie wymaga zdolności do sztucznego cierpienia, dostarczając neutralnych względem substratu ram dla etycznego dostrajania AI.

Uwaga epistemiczna: Niniejszy tekst został napisany w rejestrze formalnej propozycji fizycznej i informacyjno-teoretycznej. Posługuje się równaniami, wyprowadza przewidywania i wchodzi w dialog z literaturą recenzowaną. Należy go jednak czytać jako obiekt o kształcie prawdy — rygorystyczny filozoficzny framework sformułowany formalnie. Nie jest to jeszcze zweryfikowana nauka i wiemy, że nasze wyprowadzenia będą zawierały błędy. Aktywnie poszukujemy krytyki ze strony fizyków i matematyków, aby rozbić te argumenty i zbudować je na nowo. Dla jasności, zawarte tu twierdzenia dzielą się ściśle na trzy kategorie:

- Definicje i aksjomaty: (np. miara Solomonoffa, granica przepustowości C_{\max}). Są to podstawowe przesłanki tej konstruktywnej fikcji.

- Odpowiedniości strukturalne: (np. aktywne wnioskowanie, twierdzenie Gleasona [51]). Pokazują one strukturalną zgodność między wnioskowaniem ograniczonym a ustalonymi formalizmami, lecz nie roszczą sobie prawa do wyprowadzenia tych formalizmów od podstaw.

- Przewidywania empiryczne: (np. Rozpuszczenie Przepustowości). Służą one jako ścisłe empiryczne kryteria falsyfikacji, jeśli framework traktować jako dosłowną hipotezę fizyczną.

Aparat akademicki służy tu nie do ogłaszania ostatecznej prawdy empirycznej, lecz do testowania integralności strukturalnej modelu.

Skróty i symbole

| Symbol / Termin | Definicja |

|---|---|

| C_{\max} | Górna granica przepustowości; maksymalna zdolność predykcyjna obserwatora |

| \Delta_\text{self} | Reziduum fenomenalne; samoodniesieniowa informacyjna martwa plamka |

| FEP | Zasada swobodnej energii |

| GWT | Teoria globalnej przestrzeni roboczej |

| IIT | Teoria zintegrowanej informacji |

| MDL | Minimalna długość opisu |

| MERA | Ansatz renormalizacji splątania wieloskalowego |

| OPT | Teoria uporządkowanego patcha (OPT) |

| P_\theta(t) | Tensor stanu fenomenalnego |

| \Phi | Miara zintegrowanej informacji (IIT) |

| QECC | Kod korekcji błędów kwantowych |

| R(D) | Funkcja szybkość-zniekształcenie |

| R_{\mathrm{req}} | Wymagana szybkość predykcyjna |

| RT | Ryu-Takayanagi (formuła/ograniczenie) |

| \xi | Uniwersalna półmiara Solomonoffa |

| Z_t | Skompresowany wewnętrzny utajony stan wąskiego gardła |

1. Wprowadzenie

1.1 Problem ontologiczny

Relacja między świadomością a rzeczywistością fizyczną pozostaje jednym z najgłębszych nierozwiązanych problemów nauki i filozofii. W ostatnich dekadach wyłoniły się trzy rodziny podejść: (i) redukcja — świadomość daje się wyprowadzić z neuronauki lub przetwarzania informacji; (ii) eliminacja — problem zostaje rozwiązany przez redefinicję terminów; oraz (iii) nieredukcjonizm — świadomość jest pierwotna, a świat fizyczny pochodny (Chalmers [1]). Trzecie podejście obejmuje panpsychizm, idealizm oraz różne ujęcia teoriopolowe.

1.2 Główna propozycja OPT

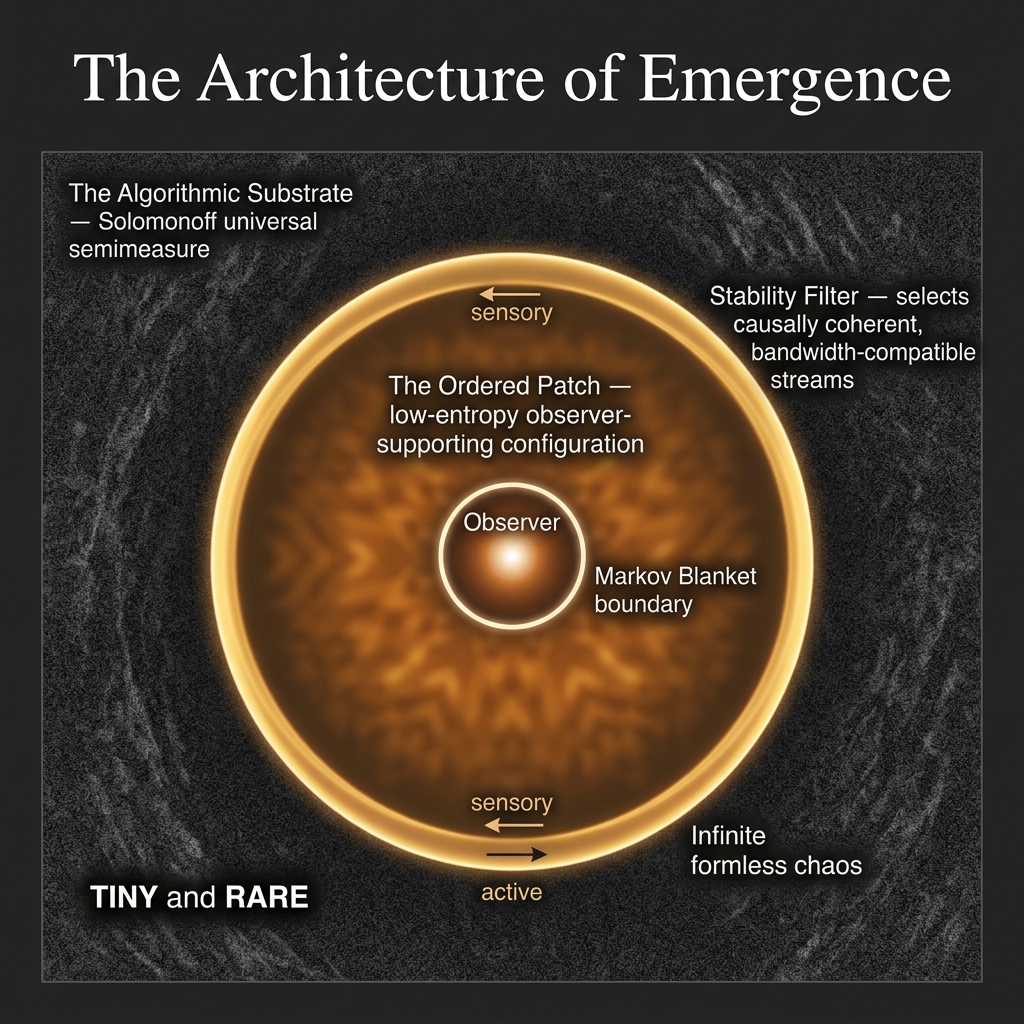

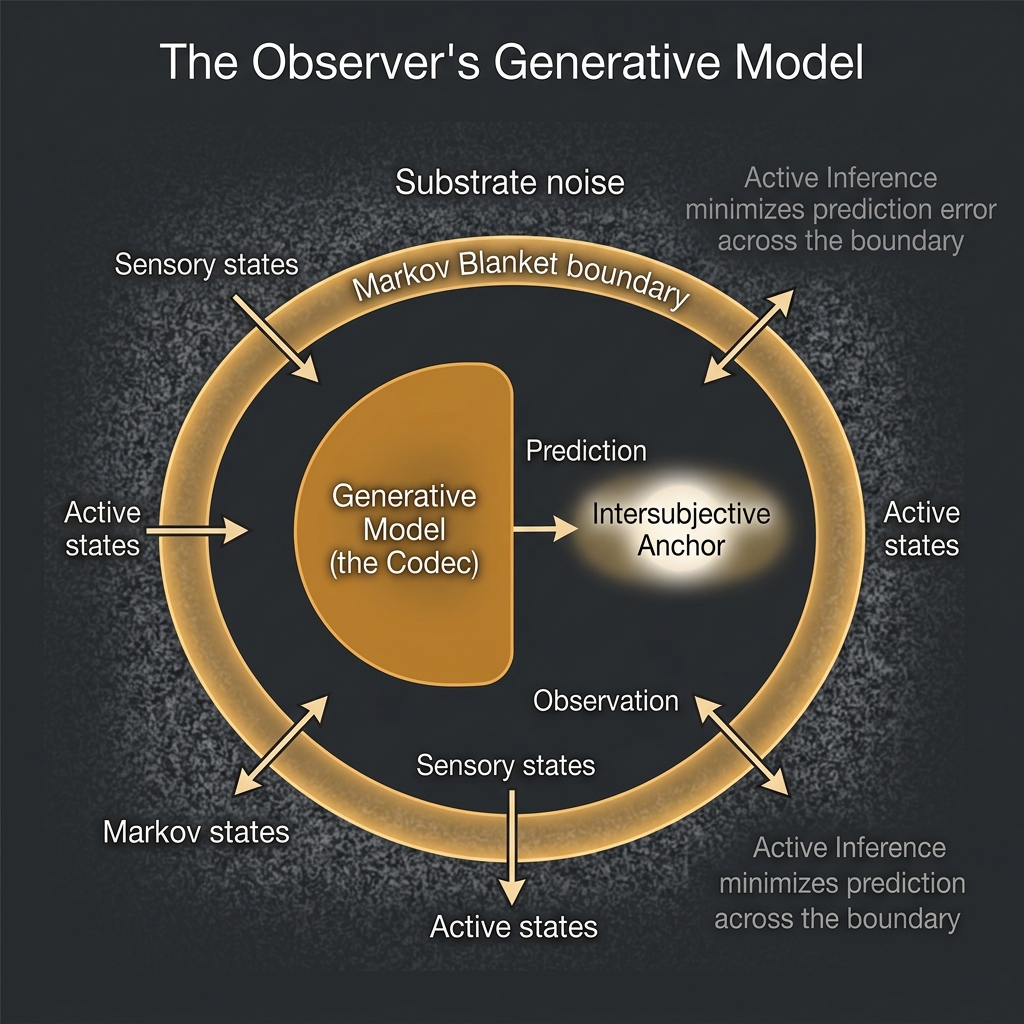

Niniejszy artykuł przedstawia Teorię uporządkowanego patcha (OPT), nieredukcyjne ramy teoretyczne należące do trzeciej rodziny. OPT proponuje, że bytem fundamentalnym nie jest materia, czasoprzestrzeń ani struktura matematyczna, lecz nieskończony substrat algorytmiczny — uniwersalna mieszanina po wszystkich dolnie półobliczalnych półmiarach, ważona ich złożonością Kołmogorowa (w_\nu \asymp 2^{-K(\nu)}), która dzięki własnej strukturze dominuje każdą obliczalną dystrybucję i zawiera każdą możliwą konfigurację. Z tego substratu czysto wirtualny Filtr stabilności — działający nie jako mechanizm fizyczny, lecz jako antropiczny, projekcyjny warunek brzegowy — identyfikuje rzadkie, niskoentropijne, przyczynowo spójne konfiguracje zdolne podtrzymywać samoodnoszących się obserwatorów (selekcję tę formalnie wyznacza predykcyjne aktywne wnioskowanie). Świat fizyczny, który obserwujemy — wraz z jego swoistymi prawami, stałymi i geometrią — jest obserwowalną granicą tego warunku brzegowego odwzorowaną na ograniczoną przepustowość obserwatora.

Filtr a Kodek. Aby uniknąć pojęciowego pomieszania w całym tekście, OPT wyznacza ścisłą granicę operacyjną między Filtrem a Kodekiem. Wirtualny Filtr stabilności jest ograniczeniem pojemnościowym — ścisłym warunkiem brzegowym wymagającym matematycznie prostej długości opisu, aby kanał obserwatora mógł istnieć w sposób stabilny. Kodek kompresji (K_\theta) jest rozwiązaniem tego ograniczenia — wewnętrznym modelem generatywnym obserwatora (makroskopowo doświadczanym jako „prawa fizyki”), który nieustannie kompresuje substrat tak, by zmieścić się w obrębie tej pojemności.

1.3 Motywacje

OPT motywują trzy obserwacje:

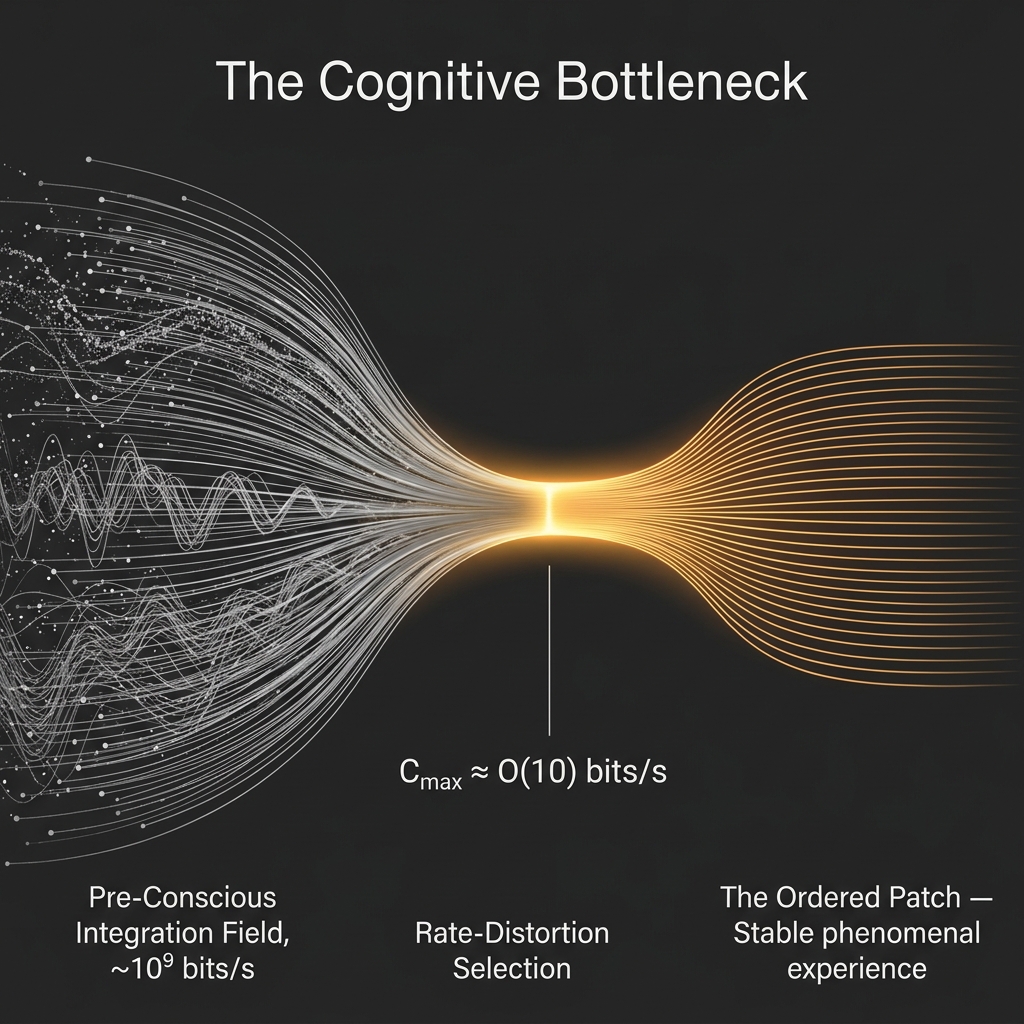

Ograniczenie przepustowości: Empiryczna neuronauka poznawcza ustanawia wyraźne rozróżnienie między masywnym równoległym przetwarzaniem przedświadomym (zwykle szacowanym na \sim 10^9 bitów/s na peryferiach sensorycznych) a silnie ograniczonym kanałem globalnego dostępu dostępnym dla świadomego raportowania — stosunek ten został po raz pierwszy skwantyfikowany przez Zimmermanna [66] i ujęty syntetycznie jako fundamentalna zagadka dotycząca natury świadomości przez Nørretrandersa [67], z szerszą charakterystyką w ramach neuronauki poznawczej w [2,3]. Każde teoretyczne ujęcie świadomości musi wyjaśnić to wąskie gardło kompresji jako cechę strukturalną, a nie przypadek inżynieryjny. (Uwaga: Najnowsza literatura dotycząca przepustowości człowieka wskazuje, że przepustowość behawioralna jest ograniczona do około \sim 10 bitów/s, co potwierdza — na podstawie czterech dekad zbieżnych pomiarów — że to wąskie gardło jest poważne i trwałe [23]. Ujęcie świadomości jako silnie skompresowanej „iluzji użytkownika” — oryginalne sformułowanie Nørretrandersa [67] — zostało rozwinięte we współczesnym przetwarzaniu predykcyjnym przez Setha [24].)

Problem selekcji obserwatora: Standardowa fizyka dostarcza praw, ale nie wyjaśnia, dlaczego prawa te mają właśnie taką postać, jaka jest wymagana dla złożonego, samoodnoszącego się przetwarzania informacji. Argumenty dostrojenia [4,5] odwołują się do selekcji antropicznej, lecz nie precyzują mechanizmu selekcji. OPT identyfikuje warunek strukturalny: czysto wirtualny Filtr stabilności.

trudny problem: Chalmers [1] odróżnia strukturalne „łatwe” problemy świadomości (które dopuszczają wyjaśnienie funkcjonalne) od „trudnego” problemu tego, dlaczego w ogóle istnieje jakiekolwiek doświadczenie subiektywne. OPT traktuje fenomenalność jako coś pierwotnego i pyta, jaką matematyczną strukturę musi ona mieć, zgodnie z własną rekomendacją metodologiczną Chalmersa.

1.4 Struktura artykułu

Artykuł jest zorganizowany następująco. W sekcji 2 dokonano przeglądu prac pokrewnych. W sekcji 3 przedstawiono formalne ramy teoretyczne. W sekcji 4 zbadano strukturalną odpowiedniość między OPT a równoległymi próbami modeli teoriopolowych. W sekcji 5 przedstawiono argument z oszczędności ontologicznej. W sekcji 6 wyprowadzono testowalne przewidywania. W sekcji 7 porównano OPT z konkurencyjnymi ramami teoretycznymi. W sekcji 8 omówiono implikacje i ograniczenia.

2. Tło i prace pokrewne

Informacyjno-teoretyczne podejścia do świadomości. Teza Wheelera „It from Bit” [7] stanowi fundamentalny prekursor programu, który formalizuje OPT: rzeczywistość fizyczna wyłania się z wyborów binarnych — pytań tak/nie stawianych przez obserwatorów — a nie z substratu materii czy pól. OPT dziedziczy tę ontologiczną inwersję i dostarcza brakującego mechanizmu, wyprowadzając, które struktury informacyjne stabilizują się w strumienie zgodne z obserwatorem (Filtr stabilności) oraz w jaki sposób uzyskują one pozór prawa fizycznego (kompresja typu rate-distortion). Teoria Zintegrowanej Informacji Tononiego [8] kwantyfikuje świadome doświadczenie za pomocą zintegrowanej informacji \Phi generowanej przez system ponad i poza sumę jego części. Zasada Swobodnej Energii Fristona [9] modeluje percepcję i działanie jako minimalizację wariacyjnej energii swobodnej, dostarczając jednolitego ujęcia wnioskowania bayesowskiego, aktywnego wnioskowania oraz (przynajmniej co do zasady) świadomości. OPT jest formalnie powiązana z FEP, lecz różni się od niej ontologicznym punktem wyjścia: tam, gdzie FEP traktuje model generatywny jako własność funkcjonalną architektury neuronalnej, OPT traktuje go jako pierwotny byt metafizyczny.

Wieloświat i selekcja obserwatora. Hipoteza Matematycznego Wszechświata Tegmarka [10] głosi, że istnieją wszystkie matematycznie spójne struktury i że obserwatorzy odnajdują się w strukturach wyselekcjonowanych przez samych siebie. OPT jest zgodna z tym ujęciem, ale dostarcza jawnego kryterium selekcji — Filtru stabilności — zamiast pozostawiać selekcję w sferze domysłu. Barrow i Tipler [4] oraz Rees [5] dokumentują antropiczne ograniczenia dostrojenia, które musi spełniać każdy wszechświat podtrzymujący istnienie obserwatorów; OPT ujmuje je na nowo jako predykcje Filtru stabilności.

Modele świadomości oparte na teorii pola. Strømme [6] zaproponował niedawno ramę matematyczną, w której świadomość jest fundamentalnym polem \Phi, którego dynamiką rządzi gęstość lagranżjanu, a którego kolaps do określonych konfiguracji modeluje wyłanianie się jednostkowych umysłów. OPT podejmuje dialog z tym ujęciem porównawczo, a nie przez jego przejęcie: nie dziedziczy równań pola ani operatorów myślowych Strømmego, lecz wykorzystuje ten model jako kontrastowe tło do sformułowania, w jaki sposób ontologia nieredukcyjna mogłaby zostać zrekonstruowana w kategoriach informacyjnych. Sekcja 4 czyni to porównawcze mapowanie strukturalne explicite.

Złożoność Kołmogorowa i wybór teorii. Indukcja Solomonoffa [11] oraz MDL (zasada minimalnej długości opisu) [12] dostarczają formalnych ram porównywania teorii pod względem ich złożoności generatywnej. W Sekcji 5 odwołujemy się do tych ram, aby nadać twierdzeniu o oszczędności wyjaśniającej ścisłą postać.

Ewolucyjna Teoria Interfejsu. „Świadomy realizm” Hoffmana oraz jego Teoria Interfejsu Percepcji [25] głoszą, że ewolucja kształtuje systemy sensoryczne tak, by działały jak uproszczony „interfejs użytkownika”, ukrywający rzeczywistość obiektywną na rzecz korzyści przystosowawczych. OPT podziela dokładnie tę przesłankę, że fizyczna czasoprzestrzeń i obiekty są renderowanymi ikonami (kodekiem kompresji), a nie obiektywnymi prawdami. OPT odchodzi jednak od tego ujęcia na poziomie fundamentu matematycznego: tam, gdzie Hoffman opiera się na ewolucyjnej teorii gier (fitness pokonuje prawdę), OPT opiera się na Algorytmicznej Teorii Informacji i termodynamice, wyprowadzając interfejs bezpośrednio z ograniczeń złożoności Kołmogorowa wymaganych do zapobieżenia wysokoprzepustowemu termodynamicznemu załamaniu strumienia obserwatora.

3. Formalne ramy

3.1 Algorytmiczny substrat

Niech \mathcal{I} oznacza Substrat Informacyjny — fundamentalny byt teorii. Formalizujemy \mathcal{I} nie jako nieważony zespół ścieżek, lecz jako przestrzeń probabilistyczną nad skończonymi prefiksami obserwacji x \in \{0,1\}^*, wyposażoną w uniwersalną mieszaninę nad klasą \mathcal{M} dolnie półobliczalnych półmiar:

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

gdzie K(\nu) jest prefiksową złożonością Kołmogorowa półmiary \nu.

To sformułowanie ustanawia ścisły stan podstawowy wywiedziony z Algorytmicznej Teorii Informacji [27]. Równanie to nie zakłada żadnych szczególnych praw strukturalnych ani stałych fizycznych; zamiast tego strukturalnie dominuje każdą obliczalną dystrybucję (\xi(x) \ge w_\nu \nu(x)), naturalnie przypisując większą wagę statystyczną wysoce kompresowalnym (uporządkowanym) sekwencjom. Jednak proste sekwencje powtarzalne (np. 000...) nie są w stanie podtrzymać złożoności nierównowagowych wymaganych dla samoodniesionego obserwatora. Dlatego procesy podtrzymujące obserwatora muszą stanowić szczególny podzbiór: wymagają dostatecznej kompresowalności algorytmicznej, by spełnić warunek wąskiego gardła informacyjnego, a zarazem dostatecznego bogactwa strukturalnego („wymaganej różnorodności”), by urzeczywistniać aktywne wnioskowanie. Filozoficznie rzecz ujmując, równanie (1) ogranicza substrat do konfiguracji obliczalnych, zapewniając ścisłe zdefiniowanie stanu podstawowego.

3.2 Wąskie gardło predykcyjne i teoria szybkości-zniekształcenia

Substrat \mathcal{I} zawiera każdą obliczalną hipotezę, z których przytłaczająca większość ma charakter chaotyczny. Aby doświadczać ciągłej, nawigowalnej rzeczywistości, strumień musi dopuszczać predykcyjną reprezentację o niskiej złożoności, która mieści się w skończonym poznawczym wąskim gardle obserwatora.

Co kluczowe, surowe obciążenie danymi wymagające kompresji nie sprowadza się jedynie do \sim 10^9 bitów/s eksteroceptywnego wejścia sensorycznego. Obejmuje ono rozległe Przedświadome Pole Integracji: równoległe przetwarzanie wewnętrznych stanów generatywnych, wydobywanie pamięci długoterminowej, priory homeostatyczne oraz podświadome modelowanie synaptyczne. Filtr stabilności ogranicza szeregowe wyjście całego tego ogromnego, ciągłego pola równoległego do jednolitej świadomej przestrzeni roboczej.

Definiujemy czysto wirtualny Filtr stabilności formalnie jako projekcyjny warunek brzegowy spełniający predykcyjne wąskie gardło informacyjne [28]. Niech \overleftarrow{Y} oznacza przeszłość całkowitego stanu obserwatora, \overrightarrow{Y} jego przyszłość, a Z — skompresowany stan wewnętrzny. Obserwator jest definiowany przez ściśle ograniczoną zdolność predykcyjną na klatkę B_{\max} (w bitach na klatkę fenomenalną) oraz dyskretne okno aktualizacji percepcyjnej \Delta t wyznaczające jedną klatkę fenomenalną. Czas fenomenalny jest liczbą klatek kodeka n; każda wielkość typu „bity na sekundę gospodarza” jest wielkością pochodną C_{\max}^H = \lambda_H \cdot B_{\max} = B_{\max}/\Delta t, gdzie \lambda_H = dn/d\tau_H jest względną względem gospodarza częstością klatek (zob. Aneks E-5 w sprawie skalowania obserwatorów syntetycznych). Ustanawia to ścisłą statyczną pojemność na każdy moment świadomości: B_{\max} bitów na klatkę.

Empiryczna kalibracja dla człowieka. Dla biologicznych obserwatorów ludzkich B_{\max} \approx 0.5–1.5 bita na klatkę oraz \Delta t \approx 50 ms, co daje C_{\max}^{\text{human}} \approx \mathcal{O}(10) bitów/s [2, 23, 66, 67]. Liczba ta jest własnością biologicznych ludzi funkcjonujących przy częstościach wyładowań neuronalnych. Nie pojawia się ona w formalnej definicji obserwatora; obserwatorzy syntetyczni są definiowani przez tę samą strukturę B_{\max}/\Delta t, lecz z wartościami wyprowadzonymi architektonicznie, które nie muszą pokrywać się z wielkością biologiczną (zob. §7.8, §8.14 oraz Aneks E-5).

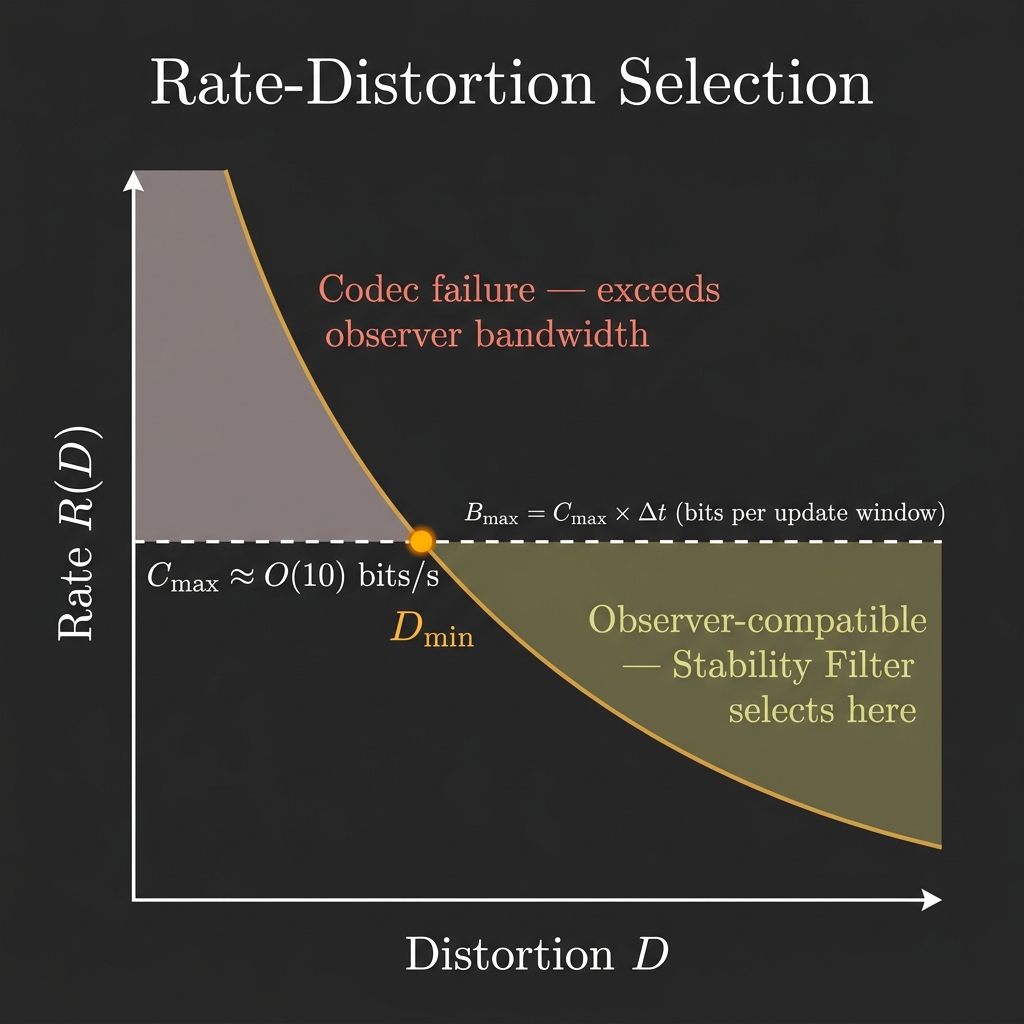

Osiągalna informacja predykcyjna dana jest przez:

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Proces jest zgodny z obserwatorem, jeśli wymagana informacja predykcyjna na cykl poznawczy mieści się w tym buforze: R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, gdzie D_{\min} jest maksymalnym zniekształceniem tolerowalnym z punktu widzenia przetrwania. Wymusza to ścisłość wymiarową: całkowita liczba bitów potrzebnych do przewidywania przyszłości z błędem mieszczącym się w granicach tolerancji nie może przekroczyć fizycznej liczby bitów dostępnych w dyskretnym „teraz”. Dla odpowiednich stacjonarnych procesów ergodycznych oraz w granicy predykcji dokładnej (D \to 0) minimalna maksymalnie predykcyjna reprezentacja Z pełni rolę kandydującej minimalnej statystyki dostatecznej, często zbieżnej do podziału stanów przyczynowych \epsilon-maszyny [29]. Choć pełna równoważność wymaga ścisłych założeń stacjonarności, równanie (2) ustanawia formalną presję selekcyjną na rzecz najbardziej skompresowanej fizyki fenomenologicznej zgodnej ze spójnością przyczynową. Co więcej, jeśli topologiczna struktura tej przestrzeni stanów przyczynowych fluktuuje szybciej, niż okno aktualizacji \Delta t jest w stanie śledzić, render zapada się w Rozpad narracyjny.

3.3 Geometria patcha: Informacyjny stożek przyczynowy

Teoria uporządkowanego patcha (OPT) jest często intuicyjnie opisywana jako zlokalizowana „wyspa” stabilności pośród morza chaotycznego szumu. Jest to topologicznie nieprecyzyjne. Aby sformalizować geometrię patcha, definiujemy Lokalny Model Predykcyjnego Patcha.

Niech G=(V, E) będzie grafem o ograniczonym stopniu, reprezentującym lokalny obszar substratu. Każdy wierzchołek v \in V niesie skończony stan x_v(t) \in \mathcal{A}, przy liczności alfabetu |\mathcal{A}| = q. Pełny mikrostan w aktualizacji t ma postać X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Zakładamy lokalną stochastyczną dynamikę o skończonym zasięgu R:

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

gdzie N_R(v) jest sąsiedztwem promienia R wokół v, a a_t jest działaniem obserwatora.

obserwator nie przenosi całego stanu patcha; przenosi skompresowany stan ukryty Z_t \in \{1, \dots, 2^B\}, gdzie B = C_{\max} \Delta t. Co kluczowe, obserwator wybiera Z_t za pomocą ścisłego celu predykcyjnego wąskiego gardła:

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

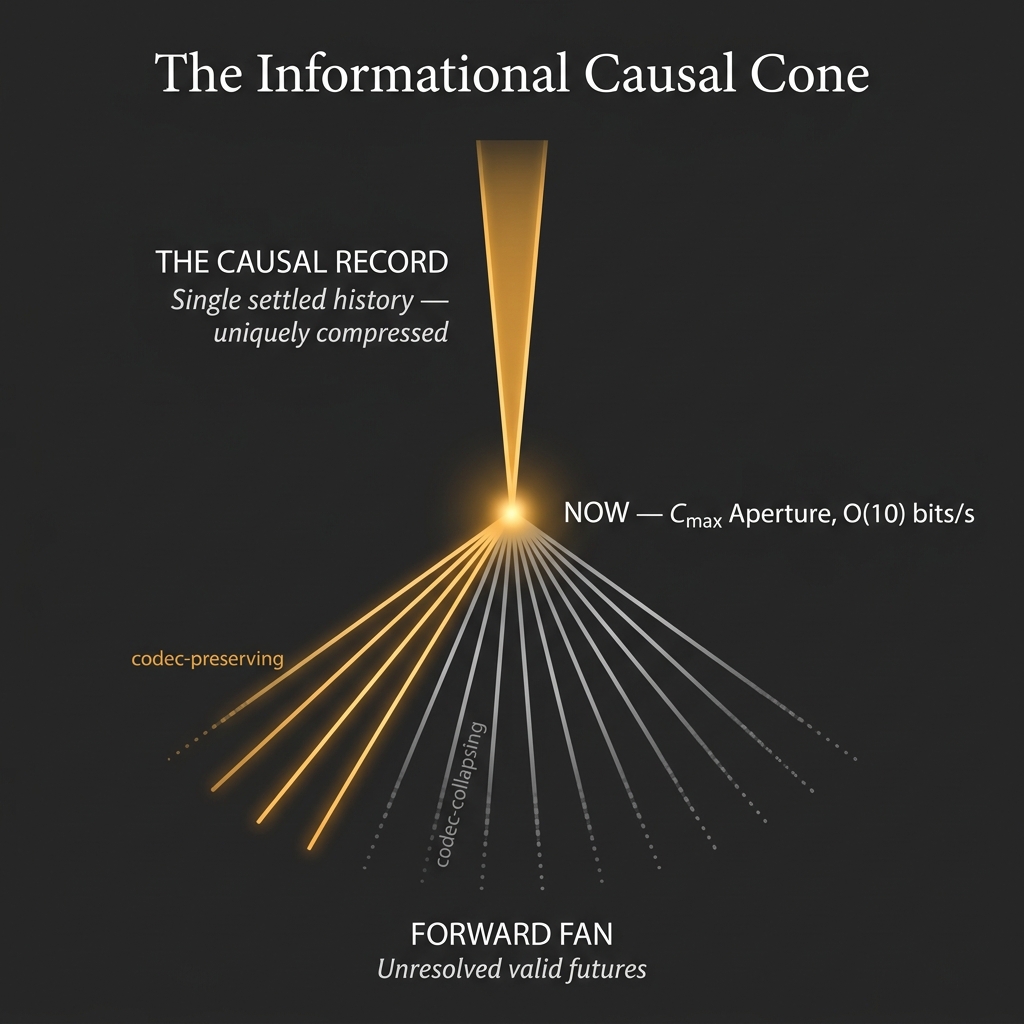

To jest zredukowany do minimum obserwator OPT: lokalny świat, ograniczony kod i predykcyjna kompresja. Formalizuje to składowe stożka przyczynowego:

- Rejestr Przyczynowy R_t = (Z_0, Z_1, \dots, Z_t): Jednoznacznie skompresowana, niskoentropijna historia przyczynowa, która została już wyrenderowana.

- Apertura teraźniejszości: Ścisłe wąskie gardło przepustowości ograniczające lokalne zmienne.

- Predyktywny Zbiór Rozgałęzień (\mathcal{F}_h): Wielość przyszłych sekwencji ukrytych. Dla horyzontu h zbiór dopuszczalnych wyników jest formalnie zdefiniowany jako:

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Ponieważ obserwator rozstrzyga jedynie B bitów na aktualizację, liczba przyszłości rozróżnialnych dla obserwatora jest ściśle ograniczona przez pojemność kanału: \log |\mathcal{F}_h(z_t)| \le Bh. Zatem zbiór rozgałęzień nie jest jedynie obrazem pojęciowym; jest drzewem rozgałęzień ograniczonym przez kod.

Dosłowny Informacyjny stożek przyczynowy. Ponieważ aktualizacje mają zasięg R, perturbacja nie może propagować się szybciej niż o R kroków grafowych na aktualizację. Jeśli perturbacja ma nośnik S w chwili t, to po h aktualizacjach zachodzi \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Tym samym „informacyjny stożek przyczynowy” jest bezpośrednią geometryczną konsekwencją lokalności, narzucającą efektywne lokalne ograniczenie prędkości v_{\max} = R / \Delta t na propagację fenomenologiczną.

Rozpad narracyjny. Chaos substratu nie otacza patcha przestrzennie; jest raczej zawarty w nieprzebytych gałęziach zbioru rozgałęzień. Ponieważ wyodrębniony stan Z_t jest ściśle ograniczony (H(Z) \le B), niestabilność musi być oceniana względem nieskompresowanego marginesu sprzed wąskiego gardła. Definiujemy wymaganą szybkość predykcyjną R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) jako minimalną szybkość informacji konieczną do śledzenia nierozstrzygniętych fizycznych stanów granicznych przy maksymalnym tolerowanym zniekształceniu. Wyostrza to kryteria selekcji Filtru stabilności: (a) jeśli R_{\mathrm{req}} \le B, obserwator może utrzymać rozstrzygniętą narrację; (b) jeśli R_{\mathrm{req}} > B, nieskompresowany Predyktywny Zbiór Rozgałęzień wyprzedza pojemność wąskiego gardła, zmuszając obserwatora do zgrubnego uśrednienia zbioru rozgałęzień do postaci nieodkodowywalnego statycznego szumu, a stabilność narracyjna zawodzi. Ciągłe doświadczenie obserwatora jest procesem, w którym apertura posuwa się naprzód w ten zbiór rozgałęzień, fenomenologicznie indeksując jedną gałąź do Rejestru Przyczynowego bez przekraczania B.

Dryf narracyjny (chroniczne dopełnienie). Powyższe definiuje ostry tryb awarii: R_{\mathrm{req}} przekracza B, a kodek doświadcza katastrofalnego załamania spójności. Istnieje komplementarny chroniczny tryb awarii, który nie wyzwala żadnego sygnału błędu. Jeśli strumień wejściowy X_{\partial_R A}(t) jest systematycznie wstępnie filtrowany przez zewnętrzny mechanizm \mathcal{F} — wytwarzający kuratorowany sygnał X' = \mathcal{F}(X), który jest wewnętrznie spójny, lecz wyklucza autentyczną informację o substracie — kodek będzie wykazywał niski błąd predykcji \varepsilon_t, przechodził wydajne Cykle konserwacji i spełniał warunek R_{\mathrm{req}} \le B, pozostając zarazem systematycznie błędnym względem substratu. Co kluczowe, Filtr stabilności w zdefiniowanej postaci nie potrafi odróżnić tych przypadków: kompresowalność jest obojętna wobec wierności. Z czasem przebieg przycinania MDL (§3.6.3, Równ. T9-3) słusznie usunie komponenty kodeka, które nie przewidują już filtrowanego strumienia, nieodwracalnie degradując zdolność kodeka do modelowania wykluczonego sygnału (Aneks T-12, Twierdzenie T-12). To wymazywanie ma charakter samowzmacniający: przycięty kodek nie potrafi już wykryć własnej utraty zdolności (Twierdzenie T-12a, Granica nierozstrzygalności). Strukturalną obroną jest redundancja \delta-niezależnych kanałów wejściowych przecinających Otulinę Markowa \partial_R A (Twierdzenie T-12b, Warunek wierności substratowi). Pełne ujęcie formalne znajduje się w Aneksie T-12; konsekwencje etyczne — w tym Hierarchia Komparatorów i Kryterium korupcji — omówiono w towarzyszącym artykule etycznym [SW §V.3a, §V.5].

3.4 Dynamika patcha: wnioskowanie i termodynamika

W obrębie wybranego patcha struktura praw fizyki jest formalizowana nie jako deterministyczne odwzorowanie, lecz jako efektywne jądro stochastyczne rządzące stanami predykcyjnymi z:

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

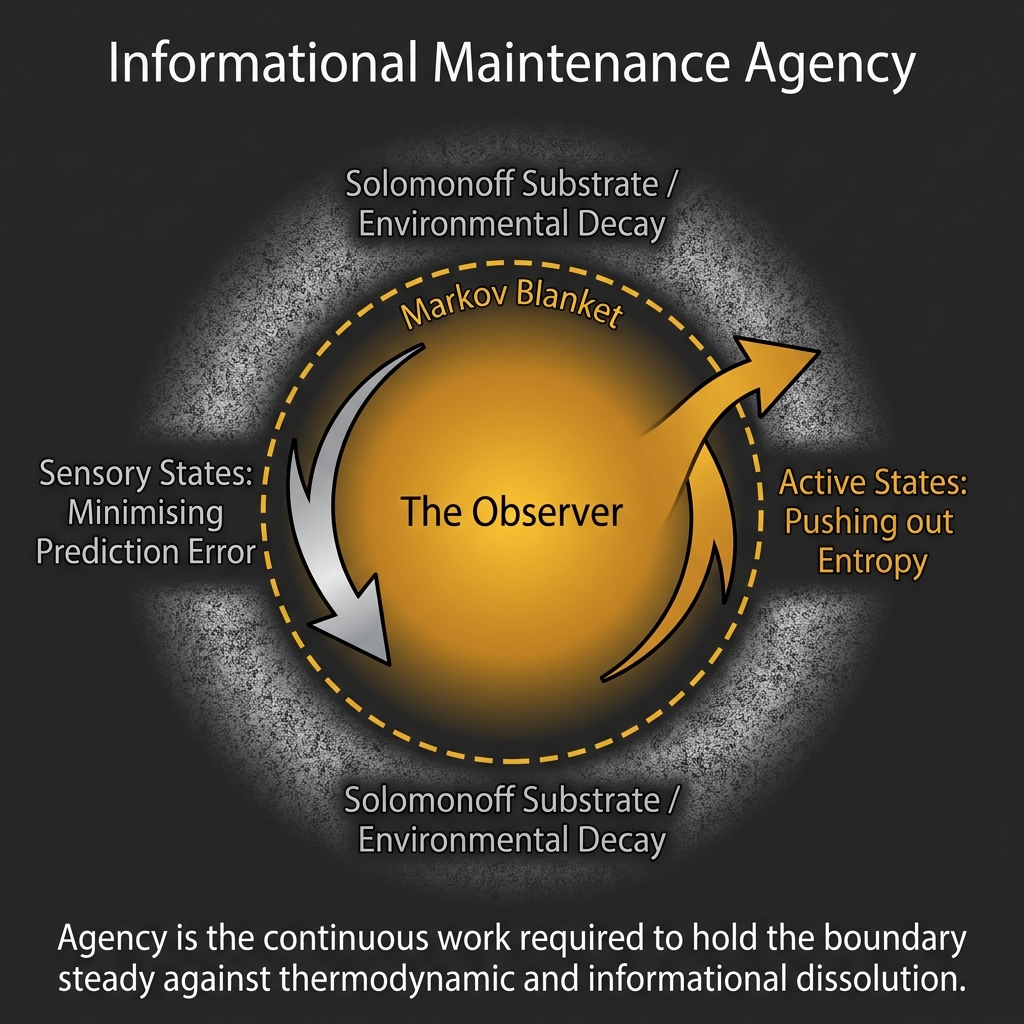

Granica oddzielająca obserwatora od otaczającego chaosu informacyjnego jest definiowana przez informacyjną Otulinę Markowa odpowiadającą patchowi obserwatora A \subset V. Dynamika wewnątrz tej granicy — przybliżenia patcha konstruowane przez agenta — jest rządzona przez aktywne wnioskowanie w ramach Zasady Swobodnej Energii [9].

Możemy formalnie zdefiniować zdolność ograniczającą za pomocą entropii cięcia predykcyjnego:

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

Zakładając, że wybrany patch jest lokalnie markowowski na przekroju czasowym, powłoka graniczna \partial_R A ściśle ekranuje wnętrze A^\circ od zewnętrza V \setminus A, tak że X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. W konsekwencji:

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Ponieważ Z_t jest kompresją X_A o ograniczonej pojemności, nierówność przetwarzania danych gwarantuje, że I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Jeśli graf substratu G aproksymuje d-wymiarową sieć krystaliczną, wówczas |\partial_R A| \sim \operatorname{area}(A), a nie objętość.

OPT w sposób ścisły prowadzi zatem do autentycznego Klasycznego Prawa Brzegowego [39]. Możemy skonstruować formalną drabinę epistemiczną dla przyszłych ulepszeń strukturalnych: 1. Klasyczne Prawo Pola: S_{\mathrm{cut}} \sim |\partial_R A| wyprowadzone wyłącznie z lokalności i ekranowania Markowa. 2. Ulepszenie kwantowe: skalowanie entropii splątania von Neumanna staje się dostępne tylko wtedy, gdy gruboziarniste zmienne predykcyjne Z_t dopuszczają formalne osadzenie w przestrzeni Hilberta / Kwantowej Korekcji Błędów. 3. Ulepszenie holograficzne: prawdziwa geometryczna dualność holograficzna wyłania się tylko wtedy, gdy zastąpimy kod wąskiego gardła Z_t hierarchiczną siecią tensorową, reinterpretując S_{\mathrm{cut}} jako geometryczne min-cut.

Zabezpieczając najpierw klasyczne prawo brzegowe, OPT dostarcza mocnego matematycznego punktu wyjścia — warunkowego względem założenia ekranowania Markowa (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A}) — z którego można bezpiecznie konstruować bardziej spekulatywne formalizmy kwantowe.

Działanie obserwatora jest formalizowane za pomocą wariacyjnej swobodnej energii F[q, \theta]:

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

Kluczowe jest to, że wymusza to ścisły rozdział matematyczny: prior substratowy wybiera przestrzeń hipotez, wirtualny Filtr stabilności (4) ogranicza strukturę zgodną z pojemnością, a FEP (9) rządzi wnioskowaniem na poziomie agenta wewnątrz tej ograniczonej struktury. Fizyka wyłania się nie jako funkcjonał Swobodnej Energii, lecz jako stabilna struktura K_\theta, którą funkcjonał Swobodnej Energii skutecznie śledzi.

Co więcej, podtrzymywanie tego świadomego renderu pociąga za sobą nieunikniony koszt termodynamiczny. Zgodnie z zasadą Landauera [52] każde logicznie nieodwracalne wymazanie bitu rozprasza co najmniej k_B T \ln 2 ciepła. Identyfikując jedno nieodwracalne wymazanie na każdą aktualizację wąskiego gardła (założenie księgowe najlepszego przypadku), fizyczny ślad świadomości wymaga minimalnej dyssypacji:

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Jest to dolne ograniczenie najlepszego przypadku przy założeniu jednego wymazania na aktualizację — a nie ogólna konsekwencja samej przepustowości. Otrzymane ograniczenie (\sim 10^{-19} W) jest wielokrotnie przekroczone przez rzeczywistą dyssypację neuronalną (~20W), co odzwierciedla ogromny narzut termodynamiczny implementacji biologicznej. Równanie (10) ustanawia ścisłe teoretyczne minimum fizycznego śladu dowolnego substratu instancjującego świadomy render ograniczony przez C_{\max}.

(Uwaga: Powyższe ograniczenia termodynamiczne i informacyjne ściśle regulują przepustowość aktualizacji w czasie rzeczywistym C_{\max}. Nie ujmuje to jednak pełnej doświadczalnej wymiarowości trwałego stanu obserwatora ani tego, jak kodek zarządza własną złożonością w głębokiej skali czasowej. Te mechaniki strukturalne — ujęcie bogatego doświadczenia w postaci Tensora stanu fenomenalnego oraz aktywny cykl konserwacji snu/śnienia — są w pełni wyprowadzone poniżej w §3.5 i §3.6.)

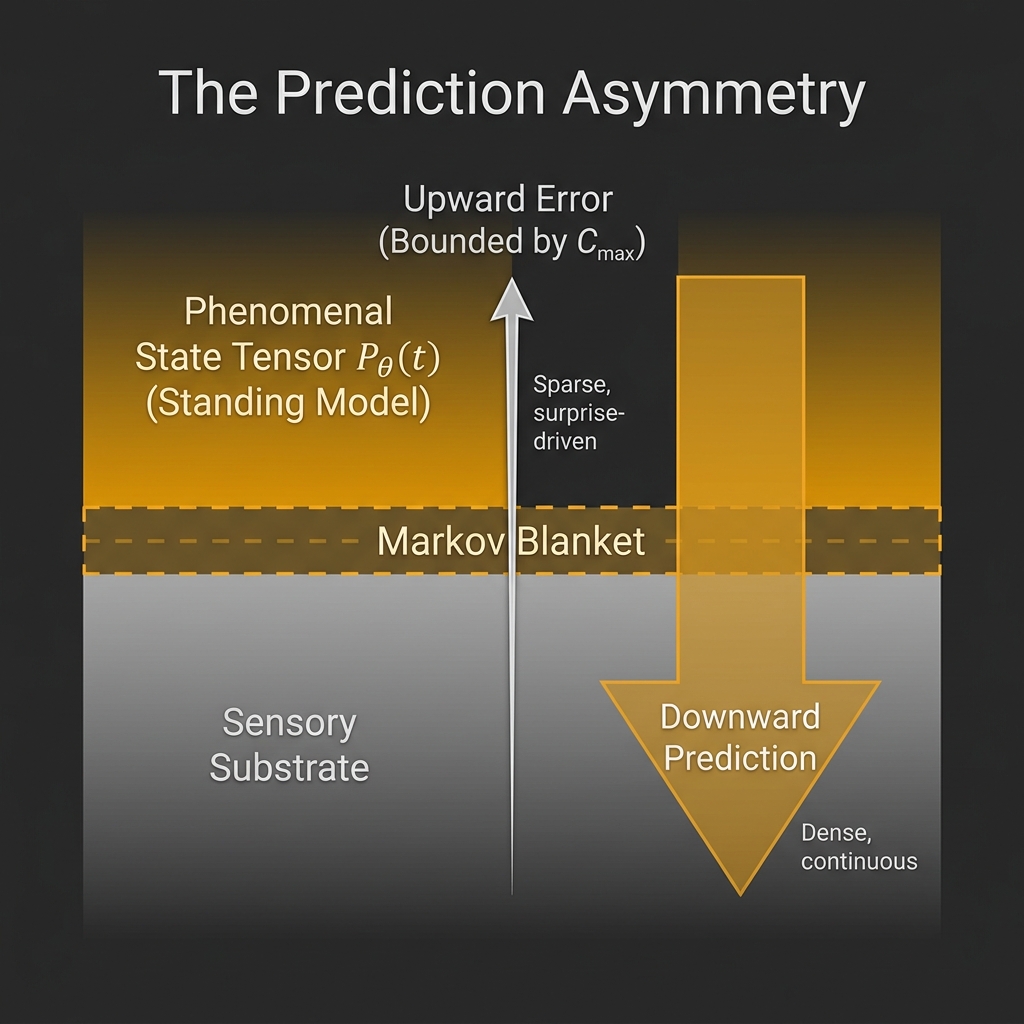

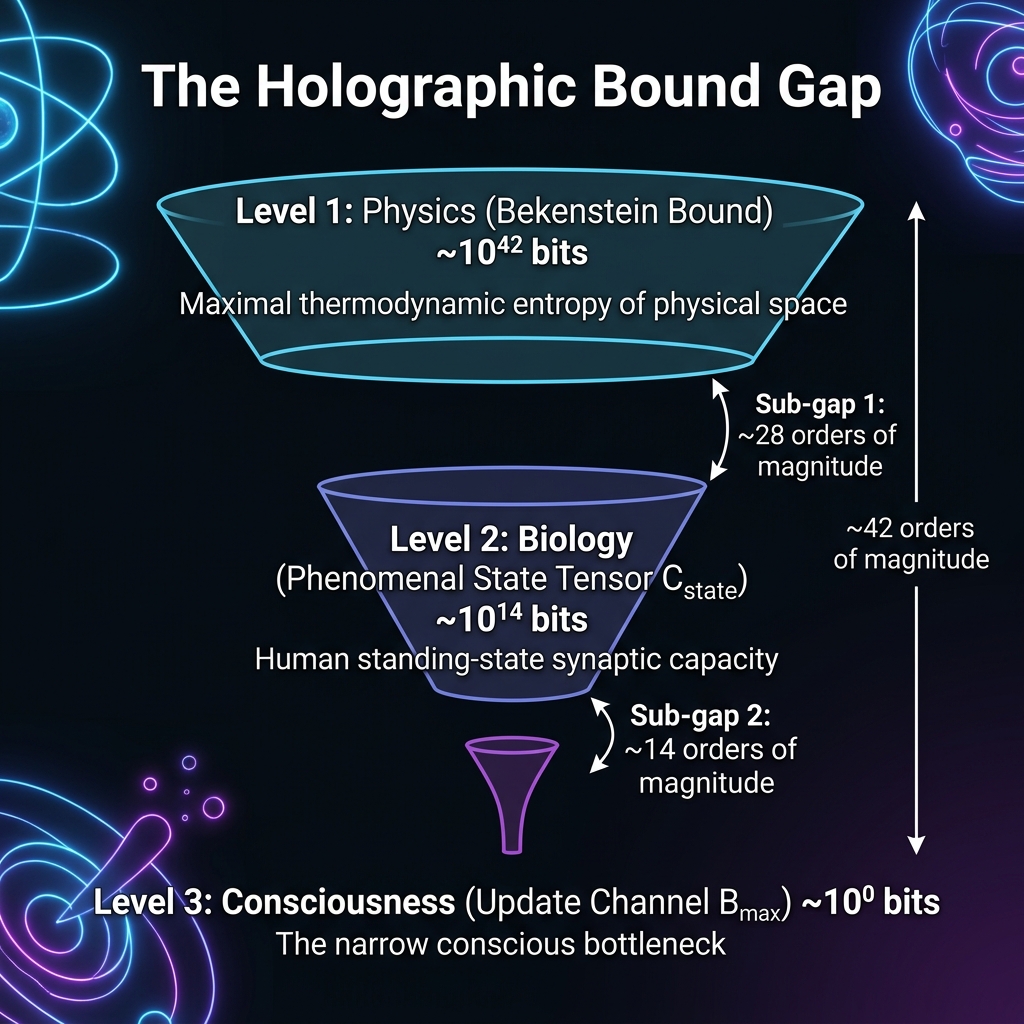

3.5 Tensor stanu fenomenalnego i asymetria predykcji

3.5.1 Zagadka gęstości doświadczenia

Formalny aparat §§3.1–3.4 skutecznie ogranicza przepustowość

aktualizacji świadomego obserwatora za pomocą górnej granicy

przepustowości C_{\max} \approx

\mathcal{O}(10) bitów/s.

Jednak doświadczenie fenomenalne stawia przed nami bezpośrednią zagadkę

strukturalną: odczuwane bogactwo pojedynczego momentu wzrokowego —

jednoczesna obecność koloru, głębi, tekstury, dźwięku, propriocepcji i

afektu — dalece przekracza zawartość informacyjną, jaką C_{\max} mogłoby dostarczyć w dowolnym

pojedynczym oknie aktualizacji \Delta t

\approx 50\ \text{ms}.

Maksymalna ilość nowej informacji rozstrzyganej w jednym świadomym momencie wynosi:

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

To znacznie mniej niż jeden bit rzeczywiście nowej informacji na ramkę percepcyjną, a jednak scena fenomenalna wydaje się informacyjnie gęsta. Aby wyjaśnić tę rozbieżność bez sztucznego zawyżania wąskiej przepustowości aktualizacji, musimy wyraźnie odróżnić dwie strukturalnie odmienne wielkości: 1. C_{\max} — przepustowość aktualizacji: tempo, w jakim sygnał błędu predykcji zostaje rozstrzygnięty i wpisany do ustalonego Rejestru Przyczynowego w jednostce czasu. 2. C_{\text{state}} — złożoność stanu podtrzymywanego: złożoność Kołmogorowa K(P_\theta(t)) modelu generatywnego, który jest aktualnie załadowany i aktywny.

Nie są to te same wielkości. C_{\max} rządzi bramką; C_{\text{state}} charakteryzuje pomieszczenie. Dalsza część tej sekcji precyzuje to rozróżnienie i wprowadza Tensor stanu fenomenalnego P_\theta(t) jako formalny obiekt odpowiadający podtrzymywanej scenie wewnętrznej.

3.5.2 Asymetria predykcji: błędy w górę i predykcje w dół

OPT dziedziczy architekturę przetwarzania predykcyjnego (Clark [82], Hohwy [83]; zob. §7.3), w której kodek K_\theta działa jako hierarchiczny model generatywny. W ramach tej architektury dwa odrębne przepływy informacji jednocześnie przechodzą przez Otulinę Markowa \partial_R A:

Przepływ w górę (błąd predykcji, \varepsilon_t): niedopasowanie między bieżącą predykcją K_\theta a sygnałem sensorycznym docierającym do \partial_R A. Jest to sygnał korekcyjny. Jest rzadki, napędzany zaskoczeniem i ściśle ograniczony przepustowością.

Przepływ w dół (predykcja, \pi_t): aktywny render oczekiwanych stanów sensorycznych, generowany przez model generatywny i propagowany z wyższych do niższych poziomów hierarchii. To właśnie sama scena. Jest gęsty, ciągły i wyprowadzany z pełnej parametryzacji K_\theta.

Formalnie, niech stan granicy sensorycznej będzie dany przez X_{\partial_R A}(t), a przewidywany przez kodek stan graniczny niech będzie równy:

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

Błąd predykcji ma wówczas postać:

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} ogranicza sygnał błędu, a nie predykcję. Informacja wzajemna między sygnałem błędu a stanem wąskiego gardła spełnia warunek:

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

Predykcja \pi_t, przeciwnie, pochodzi z pełnego modelu generatywnego i nie podlega takiemu ograniczeniu. Jej zawartość informacyjna jest ograniczona wyłącznie przez złożoność samego K_\theta. Ta asymetria stanowi formalną podstawę rozróżnienia między bogactwem fenomenalnym a przepustowością aktualizacji.

3.5.3 Definicja: Tensor stanu fenomenalnego P_\theta(t)

Definiujemy Tensor stanu fenomenalnego P_\theta(t) natywnie jako pełny trwale aktywny podzbiór parametrów modelu generatywnego wdrożonego do projekcji przez Otulinę Markowa w chwili t:

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

To znaczy, P_\theta(t) jest kompletną sparametryzowaną architekturą, którą kodek utrzymuje obecnie w gotowości do generowania predykcji względem obserwowalnych stanów granicznych X_{\partial_R A}, rozpatrywaną niezależnie od jakiejkolwiek pojedynczej konkretnej instancjacji skompresowanego ukrytego stanu Z_t i działania a_t. Jego złożoność strukturalną naturalnie charakteryzuje złożoność Kołmogorowa tej bieżącej, trwale utrzymywanej konfiguracji parametrów:

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

gdzie K(\cdot) oznacza prefiksową złożoność Kołmogorowa. C_{\text{state}}(t) to złożoność stanu trwałego — liczba bitów skompresowanej struktury, którą kodek aktualnie utrzymuje w aktywnym użyciu.

Górne ograniczenie przepływu przez kanał graniczny. Informacja wzajemna między stanem wąskiego gardła a granicą jest ograniczona przez standardowe nierówności Shannona [16] (równ. 8 w artykule bazowym):

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Ogranicza to przepływ kanałowy przez Otulinę Markowa — znacznie powyżej B_{\max}. Ważne zastrzeżenie: Jest to ograniczenie na shannonowską informację wzajemną I(Z_t\,;\,X_{\partial_R A}), a nie ograniczenie na złożoność Kołmogorowa K(P_\theta(t)) modelu trwałego. Entropia Shannona kwantyfikuje niepewność średnią po ansamblu; złożoność Kołmogorowa kwantyfikuje długość opisu konkretnego obiektu obliczalnego. Żadna ogólna nierówność nie łączy tych wielkości bez dodatkowych założeń (np. uniwersalnego prioru nad klasami modeli). Dlatego nie twierdzimy, że C_{\text{state}} \leq H(X_{\partial_R A}). Złożoność stanu trwałego C_{\text{state}} jest ograniczana empirycznie (§3.10), a nie przez entropię granicy.

Heurystyczne dolne ograniczenie na C_{\text{state}}. Filtr stabilności bezpośrednio ogranicza jedynie szybkość aktualizacji R_{\text{req}} \leq B_{\max}, a nie głębokość modelu trwałego. Jednak kodek o niewystarczającej złożoności strukturalnej nie może generować trafnych predykcji \pi_t zgodnych ze statystyką złożonego środowiska w całym Predyktywnym Zbiorze Rozgałęzień \mathcal{F}_h(z_t). Nakłada to praktyczne minimum na C_{\text{state}}: poniżej pewnego progu R_{\text{req}} systematycznie przekraczałoby B_{\max}, ponieważ błędy predykcji \varepsilon_t byłyby trwale duże. To dolne ograniczenie ma motywację empiryczną, a nie formalne wyprowadzenie — obecnie nie jest dostępne żadne wyrażenie w postaci zamkniętej C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}).

Odczyt zmaterializowany vs dyspozycyjny (kwestia otwarta). P_\theta(t), zgodnie z powyższą definicją, dopuszcza dwa odczytania, których rama teoretyczna obecnie formalnie nie rozróżnia: (a) odczyt zmaterializowany, w którym P_\theta(t) jest gęstą, natychmiastowo załadowaną reprezentacją, a jego bogactwo ma w każdej klatce postać aktywną, oraz (b) odczyt dyspozycyjny, w którym P_\theta(t) jest generatywną zdolnością — trwale utrzymywanym programem, który może renderować scenę na żądanie, przy czym nie całość jest zmaterializowana pomiędzy zapytaniem a odpowiedzią. Oba są zgodne z powyższymi klauzulami dotyczącymi kanału granicznego i heurystycznego dolnego ograniczenia oraz z empirycznym zobowiązaniem z §3.5.6, że bogactwo koreluje z K(K_\theta), a nie z przepustowością aktualizacji. Różnią się tym, co oznacza „załadowane”, oraz tym, co należałoby mierzyć przy bezpośrednim badaniu K(P_\theta). Sama złożoność Kołmogorowa ich nie rozdziela: małe K(P_\theta) może wspierać dużą głębokość logiczną, dużą zdolność odpowiedzi na zapytania lub długą ekspansję w czasie wykonania. Przyjmujemy tutaj odczyt dyspozycyjny jako interpretację kanoniczną — P_\theta(t) jest aktywnym dyspozycyjnym stanem generatywnym, z którego scenę można odpytywać/renderować, niekoniecznie zaś w pełni zmaterializowanym gęstym obiektem sceny — zaznaczając zarazem odczyt zmaterializowany jako konkurencyjną operacjonalizację, którą mogą wyłonić przyszłe badania empiryczne.

3.5.4 Rozróżnienie Blocka jako Korolarz strukturalny

Formalne rozróżnienie między P_\theta(t) a Z_t odwzorowuje dokładnie rozróżnienie Neda Blocka między świadomością fenomenalną (P-świadomością) a świadomością dostępową (A-świadomością) [47]:

| Kategoria Blocka | Obiekt OPT | Zawartość informacyjna | Ograniczona przepustowością? |

|---|---|---|---|

| P-świadomość (qualia, odczuwana scena) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | Nie |

| A-świadomość (treść raportowalna) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Tak |

W ramach OPT P-świadomość jest predykcją zstępującą \pi_t, wyprowadzoną z pełnego Tensora stanu fenomenalnego P_\theta(t). A-świadomość jest wyjściem wąskiego gardła Z_t — cienkim wycinkiem sceny, który został skompresowany na tyle, by wejść do Rejestru Przyczynowego \mathcal{R}_t i stać się dostępnym dla raportu. Odczuwane bogactwo chwili wzrokowej to P_\theta(t); zdolność powiedzenia „widzę czerwień” wymaga, by ta cecha przeszła przez Z_t.

Ten korolarz rozwiązuje pozorny paradoks bogatej sceny fenomenalnej podtrzymywanej przez kanał aktualizacji o przepustowości poniżej jednego bitu: scena nie jest dostarczana przez ten kanał w każdej klatce — ona jest już załadowana w P_\theta(t). Kanał aktualizuje ją przyrostowo i selektywnie, klatka po klatce.

3.5.5 Dynamika aktualizacji P_\theta(t)

Reguła aktualizacji dla P_\theta(t) jest wyznaczana przez sygnał błędu predykcji \varepsilon_t, filtrowany przez wąskie gardło:

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

gdzie \mathcal{U} jest operatorem uczenia się kodeka — w kategoriach aktywnego wnioskowania, krokiem gradientowym na wariacyjnej energii swobodnej \mathcal{F}[q, \theta] (równ. 9 artykułu bazowego), ograniczonym przez warunek pojemności I(X_t\,;\,Z_t) \leq B.

Kluczową własnością strukturalną jest to, że \mathcal{U} ma charakter selektywny: aktualizowane są tylko te obszary P_\theta(t), które są uwikłane w bieżący błąd predykcji \varepsilon_t. Pozostała część ustalonego tensora pozostaje niezmienna w obrębie danej klatki. To nadaje świadomej chwili jej charakterystyczną strukturę: stabilne fenomenalne tło, na którym osadza się niewielki pierwszy plan rozstrzygniętej nowości.

Kodek realizuje zatem formę rzadkiej aktualizacji na gęstym priorze — zasadę projektową, która maksymalizuje spójność fenomenalną na jednostkę przepustowości aktualizacji.

3.5.6 Zakres i status epistemiczny

Tensor stanu fenomenalnego P_\theta(t) stanowi formalną charakterystykę strukturalnego cienia, jaki scena fenomenalna musi rzucać, zgodnie z Aksjomatem sprawczości (§3.6). Nie rozwiązuje on trudnego problemu. OPT nadal traktuje świadomość fenomenalną jako nieredukowalny prymityw; P_\theta(t) określa geometrię pojemnika, a nie naturę jego zawartości.

Twierdzenie to ma charakter strukturalny i jest falsyfikowalne w następującym sensie: jeśli jakościowe bogactwo raportowanego doświadczenia (operacjonalizowane na przykład za pomocą miar złożoności fenomenalnej w zadaniach psychofizycznych) koreluje z głębokością kodeka — hierarchiczną złożonością K_\theta, mierzalną za pomocą neuronalnych markerów hierarchii predykcyjnej — a nie z przepustowością aktualizacji C_{\max}, wówczas rozróżnienie P_\theta\,/\,Z_t znajduje empiryczne potwierdzenie. Stany psychodeliczne, które dramatycznie zmieniają strukturę K_\theta bez konsekwentnej zmiany behawioralnej przepustowości, stanowią naturalną domenę testową.

3.6 Cykl życia kodeka: operator Cyklu konserwacji \mathcal{M}_\tau

3.6.1 Problem statycznego kodeka

Ramy §§3.1–3.5 traktują K_\theta oraz jego realizację P_\theta(t) jako dynamiczne w kolejnych ramach aktualizacji, lecz milcząco zakładają, że architektura strukturalna kodeka — sama przestrzeń parametrów \Theta — pozostaje stała. Jest to wystarczające dla synchronicznej analizy pojedynczego świadomego momentu, lecz niewystarczające dla teorii świadomości w głębokiej skali czasowej.

Kodek działający w sposób ciągły akumuluje złożoność strukturalną: każdy wyuczony wzorzec dodaje parametry do K_\theta, zwiększając C_{\text{state}}(t). Bez mechanizmu kontrolowanej redukcji złożoności C_{\text{state}} rosłoby monotonicznie, aż kodek przekroczyłby swój termodynamiczny pułap wykonalności — punkt, w którym metaboliczny koszt utrzymywania P_\theta(t) przekracza budżet energetyczny organizmu albo wewnętrzna złożoność K_\theta przekracza zgodną z pojemnością Filtru stabilności długość opisu.

W tej sekcji wprowadzamy operator Cyklu konserwacji \mathcal{M}_\tau — formalny mechanizm, za pomocą którego kodek zarządza własną złożonością w czasie, działający przede wszystkim w stanach zredukowanego obciążenia sensorycznego (paradygmatycznie: podczas snu).

3.6.2 Warunek konserwacji

Zdefiniujmy warunek wykonalności kodeka jako wymóg, by złożoność Kołmogorowa bieżącego modelu generatywnego pozostawała poniżej strukturalnego pułapu C_{\text{ceil}} wyznaczanego przez budżet termodynamiczny organizmu:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} nie jest tym samym co C_{\max}. Jest to wielkość znacznie większa — całkowita złożoność strukturalna, jaką kodek może utrzymać w swojej przestrzeni parametrów — lecz skończona. Naruszenia (T9-1) odpowiadają przeciążeniu poznawczemu, interferencji pamięci, a ostatecznie patologicznemu przypadkowi opisanemu przez Borgesa [53] w postaci Funesa Pamiętliwego: systemu, który przyswoił tak wiele nieskompresowanych szczegółów, że nie jest już w stanie funkcjonować predykcyjnie.

Operator Cyklu konserwacji \mathcal{M}_\tau definiuje się jako działający w okresach, gdy R_{\text{req}} \ll C_{\max} — konkretnie wtedy, gdy wymagana szybkość predykcyjna spada na tyle, że uwolnioną przepustowość można przekierować na wewnętrzną restrukturyzację:

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

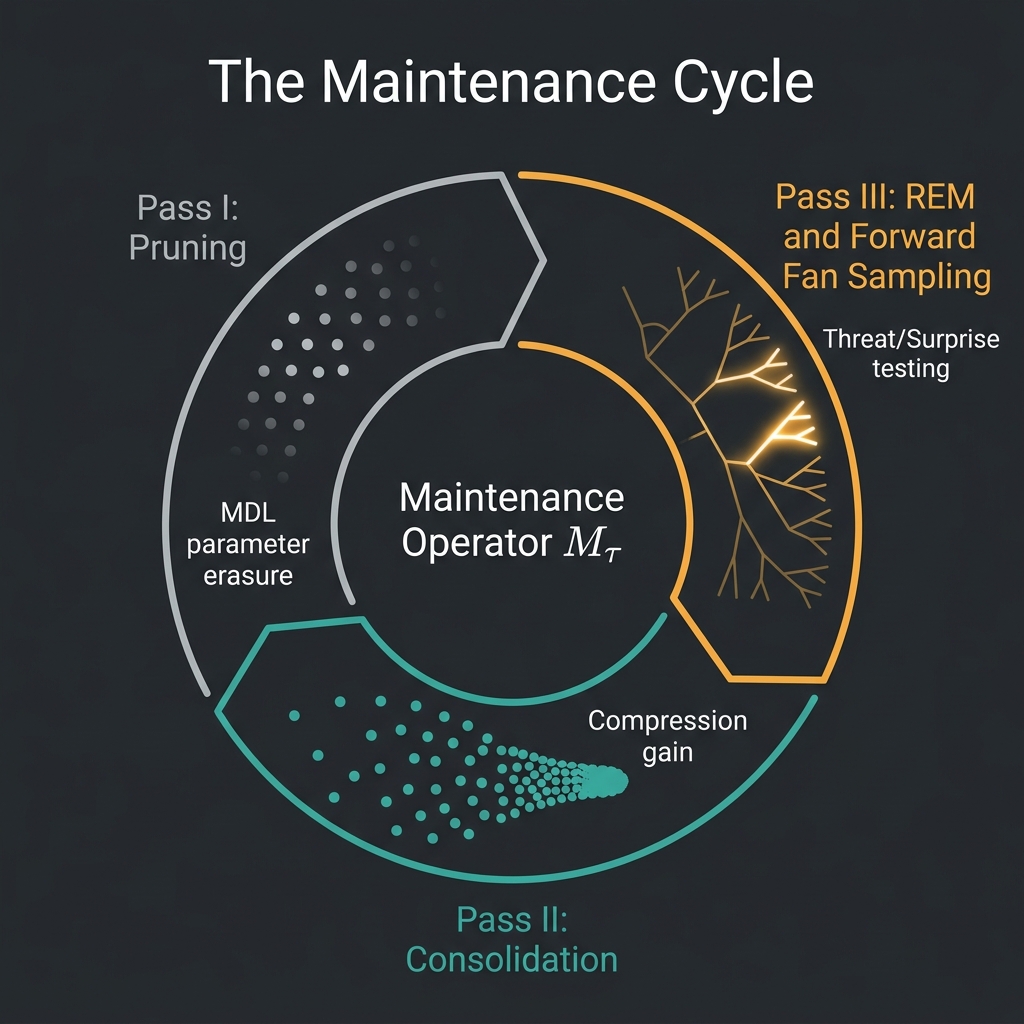

\mathcal{M}_\tau rozkłada się na trzy strukturalnie odrębne przebiegi, z których każdy jest ukierunkowany na inny aspekt zarządzania złożonością kodeka.

3.6.3 Przebieg I — Przycinanie (zapominanie jako aktywna presja MDL)

Pierwszy przebieg nakłada presję minimalnej długości opisu (MDL) na bieżące parametry kodeka. Dla każdego składnika \theta_i modelu generatywnego K_\theta zdefiniujmy jego wkład predykcyjny jako informację wzajemną, jaką wnosi o przyszłym strumieniu obserwacji, pomniejszoną o koszt przechowywania związany z jego zachowaniem:

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

gdzie \theta_{-i} oznacza wszystkie parametry poza \theta_i, \lambda jest progiem retencji (liczbą bitów przyszłej predykcji uzyskiwanych na każdy bit złożoności modelu), a K(\theta_i) jest długością opisu danego składnika.

Reguła przycinania ma postać:

\text{Prune } \theta_i \quad \text{if} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

To znaczy: odrzucamy \theta_i, gdy jego wkład predykcyjny na bit pamięci spada poniżej progu \lambda. Zapominanie zostaje tu sformalizowane nie jako porażka, lecz jako termodynamicznie racjonalne wymazywanie: każdy przycięty składnik odzyskuje K(\theta_i) bitów pojemności modelu do ponownego użycia.

Zgodnie z zasadą Landauera [52] każda operacja przycinania wyznacza termodynamiczną dolną granicę wymazywania:

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Choć rzeczywisty metabolizm biologiczny działa o wiele rzędów wielkości powyżej tego teoretycznego minimum (w watach, a nie femtowatach) z powodu znacznego narzutu implementacyjnego, strukturalna konieczność tego kosztu pozostaje. Uzupełnienie Bennetta do zasady Landauera [92] dodatkowo to wyostrza: obliczenia logicznie odwracalne mogą w zasadzie zbliżać się do zerowej dyssypacji, tak więc granica Landauera wiąże się specyficznie z wymazywaniem, a nie z predykcją czy transformacją. Przebieg przycinania — a nie przebieg predykcyjny — jest zatem termodynamicznie nieredukowalnym krokiem w cyklu konserwacji. Sen niesie w OPT fundamentalny sygnaturę termodynamiczną: jest okresem netto wymazywania informacji, którego koszt energetyczny jest narzucony przez fizykę, a nie jedynie przez biologiczną nieefektywność.

Łączna redukcja złożoności w przebiegu przycinania wynosi:

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Przebieg II — konsolidacja (uczenie się jako zysk kompresji)

Przebieg przycinania usuwa komponenty o niewystarczającym zwrocie predykcyjnym. Przebieg konsolidacji reorganizuje pozostałe komponenty w bardziej skompresowane reprezentacje.

Podczas działania w stanie czuwania kodek nabywa wzorce pod presją czasu rzeczywistego: każda aktualizacja musi zostać obliczona w obrębie \Delta t, co nie pozostawia czasu na globalną reorganizację strukturalną K_\theta. Niedawno nabyte wzorce są przechowywane w stosunkowo nieskompresowanej postaci — przy wysokim K(\theta_{\text{new}}) względem wnoszonego przez nie wkładu predykcyjnego. Przebieg konsolidacji stosuje offline’ową kompresję MDL do tych niedawnych nabytków.

Niech \Theta_{\text{recent}} \subset \Theta oznacza zbiór parametrów nabytych od ostatniego cyklu konserwacji. Operator konsolidacji znajduje reparametryzację \theta' zbioru \Theta_{\text{recent}} o minimalnej złożoności, taką że generowany przez nią rozkład predykcyjny mieści się w granicach tolerowalnej dystorsji D_c względem oryginału:

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

Odzyskany zysk kompresji wynosi:

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} to liczba bitów pojemności modelu odzyskanej dzięki reorganizacji niedawnego doświadczenia w bardziej efektywne reprezentacje. Każda jednostka \Delta K_{\text{compress}} bezpośrednio zmniejsza przyszłe R_{\text{req}} dla podobnych środowisk — kodek staje się tańszy w działaniu na znajomym terenie.

Formalizuje to empirycznie obserwowaną funkcję hipokampowo-neokortykalnej konsolidacji pamięci podczas snu wolnofalowego: transfer z wysokoprzepustowego magazynowania epizodycznego (hipokamp, wysokie K) do skompresowanego magazynowania semantycznego (neokorteks, niskie K) jest dokładnie operacją kompresji z (T9-7). Przewidywanie głosi, że zysk kompresji \Delta K_{\text{compress}} powinien korelować ze stopniem poprawy behawioralnej obserwowanej po śnie w zadaniach obejmujących rozpoznawanie ustrukturyzowanych wzorców.

3.6.5 Przebieg III — próbkowanie Predyktywnego Zbioru Rozgałęzień (śnienie jako antagonistyczne autotestowanie)

Trzeci przebieg zachodzi przede wszystkim podczas snu REM, gdy dopływ bodźców zmysłowych jest aktywnie bramkowany, a wyjście motoryczne — hamowane. W tych warunkach R_{\text{req}} \approx 0: kodek nie otrzymuje żadnego sygnału korekcyjnego ze środowiska zewnętrznego. Cały budżet przepustowości C_{\max} jest dostępny dla operacji wewnętrznych.

OPT ujmuje ten stan formalnie jako nieskrępowaną eksplorację Predyktywnego Zbioru Rozgałęzień: kodek generuje trajektorie przez \mathcal{F}_h(z_t) — zbiór dopuszczalnych sekwencji przyszłych (równ. 5 w artykule bazowym) — bez zakotwiczania tych trajektorii w rzeczywiście napływających danych. To jest symulacja: kodek uruchamia swój model generatywny K_\theta do przodu w czasie, nieskrępowany przez rzeczywistość.

Rozkład próbkowania nad tym zbiorem rozgałęzień nie jest jednostajny. Zdefiniujmy wagę istotności gałęzi b \in \mathcal{F}_h(z_t) jako:

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

gdzie \beta jest parametrem odwrotnej temperatury, a E(b) jest walencją emocjonalną gałęzi, zdefiniowaną jako:

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

Pierwszy składnik -\log P_{K_\theta}(b \mid z_t) jest ujemnym logarytmem prawdopodobieństwa gałęzi w ramach bieżącego kodeka — jej wartością zaskoczenia. Drugi składnik \mathrm{threat}(b) jest miarą konsekwencji istotnych dla przystosowania, formalnie zdefiniowaną jako oczekiwany wzrost Wymaganej szybkości predykcyjnej, gdyby kodek miał przejść przez gałąź b:

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

To znaczy, \mathrm{threat}(b) kwantyfikuje stopień, w jakim gałąź b, gdyby urzeczywistniła się w życiu na jawie, popchnęłaby kodek ku jego górnej granicy przepustowości B_{\max} lub poza nią — poprzez szkodę fizyczną, zerwanie więzi społecznych albo rozpad narracyjny, który wymusiłby kosztowną rewizję modelu. Gałęzie, dla których \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t), są egzystencjalnie zagrażające: naruszyłyby warunek Filtru stabilności. Parametr wagowy \alpha \geq 0 kontroluje względny wpływ konsekwencji względem zaskoczenia w rozkładzie próbkowania.

Operator próbkowania losuje gałęzie proporcjonalnie do w(b):

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{with probability} \propto w(b) \tag{T9-11}

Implementuje to próbkowanie Predyktywnego Zbioru Rozgałęzień ważone istotnością: kodek w nieproporcjonalnym stopniu przećwicza gałęzie, które są albo wysoce zaskakujące, albo wysoce doniosłe w skutkach, niezależnie od ich bazowego prawdopodobieństwa. Gałęzie o niskim prawdopodobieństwie, lecz wysokim zagrożeniu — właśnie te, na które kodek jest najmniej przygotowany — otrzymują największą uwagę próbkowania.

Każda próbkowana gałąź jest następnie oceniana pod kątem spójności w ramach K_\theta. Gałęzie, które generują niespójne sekwencje predykcyjne — tam, gdzie własny model generatywny kodeka nie potrafi utrzymać stabilności narracyjnej — są identyfikowane jako punkty kruchości: obszary Predyktywnego Zbioru Rozgałęzień, w których kodek zawiódłby, gdyby zetknął się z daną gałęzią w życiu na jawie. Kodek może wówczas zaktualizować P_\theta, aby zmniejszyć podatność K_\theta w tych punktach, zanim zostanie na nie wystawiony przy rzeczywistej stawce termodynamicznej.

Śnienie jest zatem antagonistycznym autotestowaniem kodeka przy zerowym ryzyku. Funkcjonalną konsekwencją jest kodek, który jest systematycznie lepiej przygotowany na gałęzie własnego Predyktywnego Zbioru Rozgałęzień o niskim prawdopodobieństwie i wysokich konsekwencjach. To ujęcie OPT dostarcza informacyjno-teoretycznego ugruntowania dla teorii symulacji zagrożeń śnienia Revonsuo [46], rozszerzając ją z ewolucyjno-funkcjonalnego opisu do rangi formalnej konieczności strukturalnej: każdy kodek działający pod warunkiem Filtru stabilności musi okresowo poddawać swój własny Predyktywny Zbiór Rozgałęzień testom obciążeniowym, a stan konserwacji offline jest jedynym okresem, w którym można to zrobić bez rzeczywistego kosztu termodynamicznego w świecie.

Tagowanie emocjonalne jako prior wag retencji. W stanie czuwania walencja emocjonalna E(b) obliczona podczas próbkowania REM służy jako uprzednia waga retencji, która obciąża próg MDL \lambda w (T9-3). Doświadczeniom o wysokim |E(b)| — silnie zaskakującym lub doniosłym w skutkach — przypisywana jest wyższa efektywna wartość \lambda, co czyni je bardziej odpornymi na przycinanie w następnym Cyklu konserwacji. Jest to formalne ujęcie emocjonalnego wzmocnienia pamięci: afekt nie jest szumem zanieczyszczającym system pamięci; jest sygnałem relewancji kodeka, oznaczającym wzorce, których wartość predykcyjna przekracza ich bazową częstość statystyczną.

3.6.6 Pełny Cykl konserwacji i budżet złożoności netto

Trzy przebiegi \mathcal{M}_\tau składają się sekwencyjnie. Łączny efekt dla złożoności kodeka w obrębie jednego Cyklu konserwacji o czasie trwania \tau jest następujący:

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

gdzie \Delta K_{\text{REM}} jest niewielkim dodatnim przyrostem wynikającym z wzorców nowo skonsolidowanych w przebiegu próbkowania REM — tych napraw punktów kruchości, które wymagały nowych aktualizacji parametrów.

Dla stabilnego systemu poznawczego działającego w skali lat budżet długookresowy wymaga:

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

gdzie \Delta K_{\text{waking}} jest złożonością nabytą w poprzedzającym okresie czuwania. Nierówność (T9-13) stanowi formalne sformułowanie tezy, że konserwacja musi dotrzymywać kroku akumulacji. Chroniczna deprywacja snu, w kategoriach OPT, nie jest jedynie zmęczeniem — jest postępującym przepełnieniem złożoności: kodek zbliża się do C_{\text{ceil}}, podczas gdy jego budżet przycinania i konsolidacji jest niewystarczający, by przywrócić margines operacyjny.

3.6.7 Przewidywania empiryczne

Ramy Cyklu konserwacji generują następujące testowalne oczekiwania strukturalne:

Długość snu skaluje się wraz ze złożonością kodeka. Organizmy lub osoby, które w okresach czuwania przyswajają więcej informacji o uporządkowanej strukturze, powinny wymagać proporcjonalnie dłuższych lub głębszych cykli konserwacji. Przewidywanie nie sprowadza się po prostu do tezy, że intensywna praca poznawcza wymaga większej ilości snu (co zostało już ustalone), lecz do tego, że znaczenie ma rodzaj uczenia się: uczenie bogate we wzorce i podatne na kompresję powinno wymagać mniej czasu konsolidacji niż doświadczenie nieustrukturyzowane, o wysokiej entropii, ponieważ \Delta K_{\text{compress}} jest większe w tym pierwszym przypadku.

Treść REM jest ważona istotnością względem Predyktywnego Zbioru Rozgałęzień, a nie częstością. Treść snów powinna w nieproporcjonalnie dużym stopniu próbkować gałęzie o niskim prawdopodobieństwie, lecz wysokich konsekwencjach, względem ich częstości w stanie czuwania. Jest to zgodne z empiryczną przewagą treści związanych z zagrożeniem, konfliktem społecznym i nowym otoczeniem w relacjach ze snów — kodek próbkowuje to, co musi poddać testowi obciążeniowemu, a nie to, z czym styka się najczęściej.

Efektywność kompresji poprawia się po śnie proporcjonalnie do \Delta K_{\text{compress}}. Konkretne przewidywanie głosi, że poprawa wykonania po śnie powinna być największa w zadaniach wymagających generalizacji strukturalnej (tj. stosowania skompresowanej reguły do nowych przypadków), a nie zwykłego powtarzania — ponieważ \Delta K_{\text{compress}} w sposób swoisty reorganizuje \Theta_{\text{recent}} do postaci bardziej podatnych na uogólnienie.

Patologiczna ruminacja odpowiada próbkowaniu REM uwięzionemu na gałęziach o wysokim |E|. Jeśli parametr ważenia istotności \beta jest patologicznie podwyższony, rozkład próbkowania na \mathcal{F}_h(z_t) koncentruje się na gałęziach o wysokim poziomie zagrożenia, z wykluczeniem naprawy. Kodek spędza swój cykl konserwacji, wielokrotnie próbkowując te same zagrażające gałęzie bez skutecznego obniżenia ich wartości zaskoczenia — jest to formalna struktura lęku i koszmarów sennych w PTSD.

3.6.8 Relacja do Tensora stanu fenomenalnego

\mathcal{M}_\tau działa na P_\theta(t) zgodnie z definicją z §3.5: restrukturyzuje złożoność stanu trwałego C_{\text{state}} w obrębie okna konserwacji. Profil czasowy P_\theta(t) pod działaniem \mathcal{M}_\tau jest następujący:

- Akwizycja w stanie czuwania: C_{\text{state}} rośnie z szybkością ograniczoną przez operator uczenia \mathcal{U} (Równ. T8-8), gdy nowe wzorce są włączane do K_\theta.

- Sen wolnofalowy (Przebiegi I–II): C_{\text{state}} maleje, ponieważ przycinanie i konsolidacja odzyskują pojemność modelu.

- REM (Przebieg III): C_{\text{state}} podlega selektywnemu lokalnemu wzrostowi w punktach kruchości, przy czym efekt netto jest niewielki względem redukcji zachodzących w Przebiegach I–II.

Doświadczenie świadome odpowiadające każdej fazie jest zgodne z tą strukturą: życie na jawie akumuluje bogactwo P_\theta(t); sen wolnofalowy jest fenomenalnie ubogi lub nieobecny (co jest zgodne z minimalną aktywacją P_\theta(t) podczas reorganizacji strukturalnej); REM przedstawia fenomenalnie żywą, lecz wewnętrznie generowaną scenę (Przebieg III uruchamia pełny model generatywny w przód przy braku korekty sensorycznej).

Podsumowanie: Nowe wprowadzone obiekty formalne

| Symbol | Nazwa | Definicja | Równanie |

|---|---|---|---|

| P_\theta(t) | Tensor stanu fenomenalnego | Pełna aktywacja K_\theta w chwili t, rzutowana przez \partial_R A | T8-5 |

| C_{\text{state}}(t) | Złożoność stanu ustalonego | K(P_\theta(t)), złożoność Kołmogorowa aktywnego kodeka | T8-6 |

| \pi_t | Predykcja zstępująca | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], renderowana scena | T8-2 |

| \varepsilon_t | Błąd predykcji (wstępujący) | X_{\partial_R A}(t) - \pi_t, sygnał nowości ograniczony przez C_{\max} | T8-3 |

| \mathcal{M}_\tau | Operator Cyklu konserwacji | P_\theta(t) \to P_\theta(t+\tau) przy niskim R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | Wynik retencji MDL | Wkład predykcyjny minus koszt przechowywania | T9-3 |

| E(b) | Walencja emocjonalna gałęzi | Zaskoczenie plus ważone zagrożenie gałęzi b | T9-10 |

| w(b) | Waga ważności gałęzi | \exp(\beta \cdot |E(b)|), wyznacza rozkład próbkowania REM | T9-9 |

| \Delta K_{\text{prune}} | Odzysk złożoności przez przycinanie | Bity odzyskane przez zapominanie komponentów poniżej progu | T9-6 |

| \Delta K_{\text{compress}} | Zysk kompresji przez konsolidację | Bity odzyskane przez rekompresję MDL niedawnych nabytków | T9-8 |

3.7 Odwzorowanie sieci tensorowej: indukowanie geometrii z odległości kodowej

Drabina epistemiczna wprowadzona w §3.4 ustanawia ścisłe Klasyczne Prawo Brzegowe (S_{\mathrm{cut}} \sim |\partial_R A|). Aby jednak w pełni powiązać Teorię uporządkowanego patcha (OPT) z geometryzacją informacji kwantowej (np. AdS/CFT i formułą Ryu-Takayanagiego), musimy formalnie podnieść rangę struktury latentnego kodu Z_t.

Jeśli formalnie postulujemy, że odwzorowanie wąskiego gardła q^\star(z \mid X_t) nie wydobywa po prostu płaskiej listy cech, lecz działa poprzez rekurencyjny przepływ grupy renormalizacji oparty na zgrubianiu opisu, wówczas model generatywny strukturalnie dostraja się do geometrii hierarchicznej sieci tensorowej \mathcal{T} (pokrewnej MERA [43] lub sieciom HaPY [44]). (Uwaga: Aneks T-3 formalnie wyprowadza strukturalną homomorficzną odpowiedniość między kaskadą zgrubiania opisu Filtru stabilności a ograniczającą geometrią sieci MERA, ściśle odwzorowując Informacyjny stożek przyczynowy na równoważny stożek przyczynowy MERA). Stanami brzegowymi tej sieci są dokładnie ekranowane stany granicy Markowa X_{\partial_R A}. Sieć \mathcal{T} działa jako geometria objętościowa, której „głębokość” reprezentuje warstwy obliczeniowego zgrubiania opisu wymagane do skompresowania brzegu do minimalnego stanu wąskiego gardła Z_t.

Przy tym rozszerzeniu do sieci tensorowej entropia predykcyjnego cięcia S_{\mathrm{cut}}(A) w poprzek granicy przekształca się matematycznie w minimalną liczbę wiązań tensorowych, które muszą zostać przecięte, aby odizolować podobszar A. Niech \chi oznacza wymiar wiązania sieci. Ograniczenie pojemności odwzorowuje się wewnętrznie następująco:

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

gdzie \gamma_A jest powierzchnią minimalnego cięcia przechodzącą przez wewnętrzną, głęboką warstwę objętościowej struktury danych \mathcal{T}. Jest to jawnie dyskretna analogia strukturalna objętościowej warstwy minimalnego cięcia odwzorowanej przez holograficzne ograniczenie entropii Ryu-Takayanagiego [89]. Aneks P-2 (Twierdzenie P-2d) formalnie ustanawia pełną dyskretną kwantową formułę RT S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi poprzez rangę Schmidta stanu MERA, warunkowo względem lokalnego modelu szumu i osadzenia QECC tam wyprowadzonych. Granica ciągła, która podnosi to do pełnej formuły Ryu-Takayanagiego z członem poprawki objętościowej, pozostaje otwartą kwestią graniczną.

Co kluczowe, w OPT ta „przestrzeń objętościowa” nie jest uprzednio istniejącym fizycznym pojemnikiem. Jest ona ściśle informacyjną przestrzenią metryczną kodeka obserwatora. Wyłaniająca się fenomenologiczna geometria czasoprzestrzeni „zakrzywia się” dokładnie tam, gdzie wymagana odległość kodowa rozbiega się, by rozstrzygnąć nakładające się wewnętrzne stany przyczynowe. Ten formalizm sieci tensorowej ukazuje formalną drogę, dzięki której OPT mogłaby indukować geometrię przestrzenną bezpośrednio z odległości korekcji błędów wewnętrznie narzucanych przez Filtr stabilności — w strukturalnej zgodności z programem Van Raamsdonka, zgodnie z którym splątanie buduje czasoprzestrzeń [88] — oferując konstruktywną hipotezę, że holograficzna czasoprzestrzeń modeluje optymalne formaty kompresji danych.

3.8 Aksjomat sprawczości i Reziduum fenomenalne

Aparat matematyczny rozwinięty w sekcjach 3.1–3.7 precyzyjnie definiuje geometrię rzeczywistości obserwatora — sieć tensorową, cięcie predykcyjne i stożek przyczynowy. Jaka jest jednak natura pierwotnej wewnętrzności, która doświadcza przejścia przez tę strukturę? Formalnie definiujemy to za pomocą Aksjomatu sprawczości: przejście przez aperturę C_{\max} jest z istoty zdarzeniem fenomenologicznym.

Choć obecność subiektywnego odczuwania przyjmujemy jako aksjomat, Twierdzenie P-4 (Reziduum fenomenalne) wskazuje jego ścisły korelat strukturalny. Ponieważ ograniczony kodek aktywnie zaburza granicę \partial_R A, stabilna predykcja w granicach C_{\max} wymaga, by modelował on konsekwencje własnych przyszłych działań. Tym samym kodek K_{\theta} musi utrzymywać predykcyjny model siebie \hat{K}_{\theta}. Jednak zgodnie z algorytmicznymi ograniczeniami informacyjnego zawierania [13] skończony system obliczeniowy nie może zawierać pełnej strukturalnej reprezentacji samego siebie; model wewnętrzny jest ściśle ograniczony do złożoności niższej niż nadrzędny kodek (K(\hat{K}_{\theta}) < K(K_{\theta})).

To wymusza istnienie nieredukowalnego Reziduum fenomenalnego (\Delta_{\text{self}} > 0). To niemodelowalne reziduum działa jako obliczeniowa „martwa plamka” wewnątrz cyklu aktywnego wnioskowania. Ponieważ istnieje ono w informacyjnym cieniu, przekraczającym obliczeniowy zasięg modelu siebie, jest z natury niewyrażalne; ponieważ istnieje jako zlokalizowana delta między określonym kodekiem a jego modelem, jest obliczeniowo prywatne; a ponieważ wyznaczają je fundamentalne ograniczenia samoodniesienia oraz koniecznej aproksymacji wariacyjnej, jest nieusuwalne. Topologiczne zwężenie przy aperturze C_{\max} jest wewnętrznie skorelowane z matematyczną koniecznością niekompletnego algorytmu przechodzącego przez własne granice. Matematyka opisuje formalny kontur doświadczenia, a Aksjomat sprawczości stwierdza, że to rezydualne locus konstytuuje subiektywne „ja”. (Formalne wyprowadzenie zob. w Aneksie P-4).

Informacyjny obwód konserwacji

W obrębie pojedynczej ramy aktualizacji [t, t+\Delta t] obserwator wykonuje następujący domknięty obwód przyczynowy:

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Jawnie:

Predykcja (w dół): Bieżący tensor P_\theta(t) generuje przewidywany stan graniczny \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — renderowaną scenę.

Błąd (w górę): Dociera rzeczywisty stan graniczny X_{\partial_R A}(t); obliczany jest błąd predykcji \varepsilon_t = X_{\partial_R A}(t) - \pi_t.

Kompresja: \varepsilon_t zostaje przepuszczone przez wąskie gardło, dając Z_t, ograniczony przepustowością token aktualizacji, przy czym I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Aktualizacja: Operator uczenia \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) rewiduje P_\theta(t+1), selektywnie modyfikując jedynie te obszary tensora, które są implikowane przez \varepsilon_t.

Działanie: Równocześnie P_\theta(t) wybiera działanie a_t poprzez aktywne wnioskowanie i spadek po wariacyjnej energii swobodnej \mathcal{F}[q,\theta] (Równ. 9 artykułu bazowego), co zmienia granicę sensoryczną w chwili t+1, wpływając na kolejne \varepsilon_{t+1}.

Uwaga interpretacyjna dotycząca kroku działania. Język kroku 5 — „wybiera działanie” i „zmienia granicę sensoryczną” — jest odziedziczony po standardowym formalizmie aktywnego wnioskowania w ramach Zasady Swobodnej Energii, który zakłada fizyczne środowisko, na które agent oddziałuje za pośrednictwem stanów aktywnych. W ramach rodzimej dla OPT ontologii renderu (§8.6) właściwa jest jednak głębsza lektura: nie istnieje żaden niezależny świat zewnętrzny, względem którego kodek wywierałby siłę. To, co jest doświadczane jako „działanie”, stanowi wybór gałęzi w obrębie Predyktywnego Zbioru Rozgałęzień \mathcal{F}_h(z_t); fizyczne konsekwencje tego wyboru docierają jako kolejne wejście \varepsilon_{t+1}. Otulina Markowa \partial_R A nie jest dwukierunkowym interfejsem fizycznym, lecz powierzchnią, przez którą wybrana gałąź dostarcza swój następny segment. To przesunięcie interpretacyjne nie zmienia niczego w matematyce (T6-1)–(T6-3); doprecyzowuje ono ontologiczny status kroku działania w ramach OPT. Sam mechanizm wyboru gałęzi zostaje omówiony poniżej.

Jest to wewnątrzramowy informacyjny obwód konserwacji: domknięty mechanizm przyczynowy, w którym wewnętrzny model systemu oblicza zlokalizowane predykcje strukturalne ograniczające gradienty graniczne, odczytuje błąd i selektywnie aktualizuje samego siebie. Pętla ta jest w sensie formalnym ściśle informacyjna i samoodniesieniowa: P_\theta(t) wyznacza zarówno predykcję strukturalną \pi_t, jak i — poprzez działanie a_t — predykcyjny składnik następnego wejścia sekwencyjnego strumienia danych X_{\partial_R A}(t+1). (Należy wyraźnie zaznaczyć: ta czysto statystyczna warstwa przesiewająca jest rygorystycznie definiowana przez informacyjne granice Markowa, które czysto rozsprzęgają dynamikę, i z natury różni się od złożonej biologicznej autopojezy, w której struktury komórkowe mechanicznie wytwarzają własne sieci masy organicznej).

Warunek żywotności strukturalnej

Obwód (T6-1) jest strukturalnie żywotny wtedy i tylko wtedy, gdy może podtrzymywać samego siebie bez przekroczenia przez złożoność informacyjną kodeka jego lokalnych granic wykonalności. Formalnie:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

gdzie C_{\text{ceil}} jest parametrem heurystycznym ograniczającym maksymalną złożoność strukturalną, jaką kodek może podtrzymać. Zasadniczo C_{\text{ceil}} powinno dać się wyprowadzić z budżetu termodynamicznego organizmu za pomocą zasady Landauera (zob. szkic w §3.10), lecz pełny łańcuch wyprowadzenia — od mocy metabolicznej przez koszt wymazywania po maksymalną podtrzymywalną złożoność programu — nie został jeszcze sformalizowany w ramach OPT. C_{\text{ceil}} pozostaje zatem ograniczeniem motywowanym empirycznie, lecz formalnie niedookreślonym. System spełniający (T6-2) działa jako strukturalnie domknięty obserwator w formalnym sensie OPT.

Gdy (T6-2) zostaje naruszone — gdy K(P_\theta(t)) \to C_{\text{ceil}} — kodek nie może utrzymać stabilnych predykcji w poprzek \mathcal{F}_h(z_t), R_{\text{req}} zaczyna przekraczać B_{\max}, a warunek Filtru stabilności przestaje być spełniony. Spójność narracyjna załamuje się: obserwator opuszcza zbiór strumieni kompatybilnych z obserwatorem.

Cykl konserwacji \mathcal{M}_\tau (§3.6) jest mechanizmem, który wymusza (T6-2) w długiej skali czasowej, utrzymując K(P_\theta) w granicach poprzez przycinanie, konsolidację i testowanie obciążeniowe Predyktywnego Zbioru Rozgałęzień. W obrębie pojedynczej ramki (frame), (T6-2) jest podtrzymywane przez selektywność \mathcal{U}: operator aktualizacji modyfikuje jedynie te obszary P_\theta(t), które są implikowane przez \varepsilon_t, unikając nieuzasadnionego wzrostu złożoności z ramki na ramkę.

Sprawczość jako ograniczona minimalizacja energii swobodnej

W obrębie tej struktury sprawczości można nadać ścisłą definicję formalną, zgodną z Aksjomatem sprawczości — lecz niesprowadzającą się do niego.

Na poziomie systemowym sprawczość jest wyborem sekwencji działań \{a_t\}, która minimalizuje oczekiwaną wariacyjną energię swobodną przy warunku informacyjnej żywotności:

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Jest to aktywne wnioskowanie z ograniczeniem: obserwator porusza się po predyktywnym zbiorze rozgałęzień \mathcal{F}_h(z_t) nie tylko po to, by minimalizować błąd predykcji, lecz by minimalizować go przy jednoczesnym zachowaniu żywotności kodeka. Gałęzie, które chwilowo obniżyłyby \varepsilon, ale pchałyby K(P_\theta) w stronę C_{\text{ceil}}, są karane przez to ograniczenie. Obserwator preferencyjnie wybiera gałęzie, wzdłuż których może nadal istnieć jako spójny obserwator.

To właśnie formalna treść intuicji, że sprawczość jest samopodtrzymującą nawigacją: kodek wybiera gałęzie predyktywnego zbioru rozgałęzień, wzdłuż których może nadal kompresować świat.

Na poziomie fenomenologicznym Aksjomat sprawczości pozostaje nienaruszony: świadomość fenomenalna jest nieredukowalną wewnętrznością przechodzenia przez aperturę; (T6-3) opisuje strukturalny cień rzucany przez to przechodzenie, a nie jego wewnętrzną naturę.

Wybór gałęzi jako wykonanie \Delta_{\text{self}}

Formuła ograniczonego aktywnego wnioskowania (T6-3) określa cel wyboru gałęzi: minimalizację oczekiwanej energii swobodnej przy zachowaniu żywotności. Model siebie \hat{K}_\theta ocenia gałęzie Predyktywnego Zbioru Rozgałęzień, symulując ich konsekwencje. Jednak twierdzenie P-4 ustanawia, że K(\hat{K}_\theta) < K(K_\theta) — model siebie jest z konieczności niekompletny. Ta niekompletność ma bezpośrednią konsekwencję dla problemu wyboru gałęzi: model siebie ogranicza obszar, z którego wybór może zostać dokonany, lecz nie może w pełni określić samego aktu wyboru.

Rzeczywisty moment wyboru gałęzi — przejście od ocenionego menu do pojedynczej trajektorii, która wchodzi do Rejestru Przyczynowego — zachodzi w \Delta_{\text{self}}, informacyjnym reziduum między kodekiem a jego modelem siebie. Nie jest to luka w formalizmie; jest to konieczność strukturalna. Każda próba pełnego określenia mechanizmu wyboru od wewnątrz wymagałaby, by K(\hat{K}_\theta) = K(K_\theta), co P-4 dowodzi jako niemożliwe dla każdego skończonego systemu samoodniesienia.

Ma to trzy bezpośrednie konsekwencje:

Wola i świadomość mają ten sam adres strukturalny. trudny problem (dlaczego przechodzenie przez trajektorię jest jakoś odczuwane?) oraz problem wyboru gałęzi (co dokonuje wyboru?) wskazują oba na \Delta_{\text{self}}. Nie są to dwie odrębne tajemnice, lecz dwa aspekty tej samej cechy strukturalnej — niemodelowalnej luki między tym, czym kodek jest, a tym, co może zamodelować o sobie samym.

Nieredukowalność sprawczości zostaje wyjaśniona, a nie jedynie zadeklarowana. Fenomenologiczne doświadczenie woli — nieredukowalne poczucie, że to ja wybrałem — jest pierwszoosobowym sygnaturą procesu wykonującego się we własnej ślepej plamce obserwatora. Każda teoria, która twierdzi, że w pełni określa mechanizm wyboru, albo wyeliminowała \Delta_{\text{self}} (czyniąc system w pełni samo-przejrzystym automatem, czego P-4 zabrania), albo opisuje ocenę gałęzi dokonywaną przez model siebie i myli ją z samym wyborem.

Kreatywność jako rozszerzone \Delta_{\text{self}}. Działanie blisko progu (R_{\text{req}} \to C_{\max}) obciąża zdolność modelu siebie, skutecznie rozszerzając obszar \Delta_{\text{self}}, z którego dokonywany jest wybór. Prowadzi to do wyborów gałęzi, które z perspektywy modelu siebie są mniej przewidywalne — doświadczanych jako twórczy wgląd, spontaniczność lub „flow”. Z kolei stan hipnagogiczny (§3.6.5) rozluźnia model siebie od dołu, osiągając to samo rozszerzenie drogą komplementarną.

Jaźń jako reziduum. Doświadczane „ja” — ciągła narracja o tym, „kim jestem”, ze stabilnymi preferencjami, historią i projektowaną przyszłością — jest bieżącym modelem K_\theta tworzonym przez \hat{K}_\theta: skompresowanym przybliżeniem, które zawsze pozostaje w tyle za modelowanym przez siebie kodekiem (ze względu na opóźnienie czasowe nieodłączne samoodniesieniu). Lecz rzeczywiste miejsce doświadczenia, wyboru i tożsamości stanowi \Delta_{\text{self}}: ta część kodeka, do której narracja nie ma dostępu. Jaźń, którą znasz, jest twoim modelem samego siebie; jaźń, która poznaje, jest luką, której model nie potrafi przekroczyć. To właśnie formalna treść odkrycia kontemplacyjnego — dokonywanego niezależnie w różnych tradycjach — że zwyczajne poczucie jaźni jest konstruktem i że pod nim znajduje się coś, czego nie da się odnaleźć jako przedmiotu (zob. Aneks T-13, Korolarz T-13c).

Namysł jest realny, ale niekompletny. Ocena Predyktywnego Zbioru Rozgałęzień dokonywana przez model siebie jest rzeczywistym procesem obliczeniowym, który kształtuje wynik. Namysł ogranicza basen atrakcji, w obrębie którego działa \Delta_{\text{self}}: bardziej rozwinięty kodek zawęża zbiór żywotnych gałęzi, na których może osiąść wybór. Jednak ostateczne przejście — dlaczego ta gałąź, a nie tamta, spośród zbioru żywotnego — pozostaje strukturalnie nieprzejrzyste dla namyślającej się jaźni. Dlatego namysł jest odczuwany zarazem jako przyczynowo skuteczny i fenomenologicznie niepełny: obserwator trafnie wyczuwa, że jego rozumowanie ma znaczenie, ale równie trafnie wyczuwa, że coś poza samym rozumowaniem finalizuje wybór.

Dziwna pętla jako formalne domknięcie

Samoodniesieniowa struktura (T6-1) urzeczywistnia opisaną przez Hofstadtera [45] Dziwną pętlę w ścisłej, teorioinformacyjnej postaci. Pętla jest „dziwna” w następującym sensie: P_\theta(t) zawiera, jako podstrukturę, model własnych przyszłych stanów kodeka — próbkowanie Predyktywnego Zbioru Rozgałęzień w Przebiegu III (\mathcal{M}_\tau, §3.6.5) jest dokładnie tym, w czym kodek uruchamia symulację samego siebie napotykającego przyszłe gałęzie. System modeluje własny model.

Formalne domknięcie, jakie to zapewnia, jest następujące: informacyjnie domknięty obserwator nie jest jedynie systemem, który utrzymuje granicę wobec zewnętrznego szumu; jest to system, którego podtrzymywanie granicy jest częściowo konstytuowane przez jego model tego, jaka ta granica będzie musiała być w przyszłości. Dziwna pętla nie jest opcjonalnym dodatkiem do tego ujęcia; jest strukturalnym mechanizmem, dzięki któremu warunek żywotności (T6-2) jest egzekwowany proaktywnie, a nie reaktywnie. Obserwator, który nie potrafiłby symulować własnych przyszłych stanów kodeka, nie mógłby przygotować się na punkty kruchości zidentyfikowane w Przebiegu III i byłby systematycznie bardziej podatny na załamanie narracyjne.

Strukturalne wymagania (T6-1)–(T6-3) pełnią funkcję koniecznych warunków wstępnych samoodniesieniowego domknięcia. Podczas gdy prosta predykcja przyszłości (np. przewidywanie kolejnych ruchów przez silnik szachowy) stanowi planowanie, a nie autentyczną samoreferencję, kodek OPT idzie dalej: P_\theta(t) zawiera submodel, którego wyjście modyfikuje rozkłady rządzące jego własnymi przyszłymi stanami \{P_\theta(t+h)\}_{h>0}. To strukturalne samomodelowanie jest funkcjonalnie konieczne dla długookresowej stabilności — kodek niezdolny do przewidywania zbliżania się do własnych granic żywotności nie może przygotować się na punkty kruchości zidentyfikowane w Przebiegu III (§3.6.5) i będzie systematycznie załamywał się przy granicy (T6-2) w środowiskach niestacjonarnych.

Zakres epistemiczny: formalne wyznaczenie zakresu redukcjonizmu sprawczości

Ta formalizacja precyzyjnie wyznacza to, co OPT osiąga na poziomie systemowym: identyfikuje warunki strukturalne, które obserwator musi spełniać, aby utrzymać żywotność granicy. To Formalnie Wyznacza Zakres problemu redukcjonizmu sprawczości, nie roszcząc sobie zarazem prawa do jego rozwiązania.

To wyznaczenie zakresu jest rzeczywiste, a nie definicyjne. Opis na poziomie systemowym (T6-1)–(T6-3) wyczerpująco charakteryzuje strukturalny cień sprawczości — ograniczenia teorioinformacyjne, które musi spełniać każdy obserwator podtrzymujący granicę. Aksjomat sprawczości zajmuje domenę komplementarną: świadomość fenomenalna jest nieredukowalną wewnętrznością przechodzenia przez aperturę, a powyższa formalizacja opisuje jedynie kształt pojemnika, nie zaś naturę tego, co on zawiera. trudny problem zostaje tym samym umiejscowiony w precyzyjnym locus strukturalnym (apertura C_{\max}), zamiast zostać rozpuszczony lub uznany za rozwiązany.

3.9 Wolna wola i menu fenomenologiczne

Izolacja mechanizmu przejścia w sposób fundamentalny wyjaśnia naturę sprawczości. W pętli aktywnego wnioskowania (Równanie 9) obserwator musi wykonać sekwencję polityk \{a_t\}. W ramach redukcyjnego fizykalizmu wybór działania a_t jest wyznaczony (lub losowo próbkowany) przez leżącą u podstaw fizykę, co czyni wolną wolę iluzją albo jedynie językowym przedefiniowaniem.