Teoria del Patch Ordinato (OPT): un quadro teorico-informazionale per la selezione dell’osservatore e l’esperienza cosciente

v3.4.0 — Maggio 2026

DOI: 10.5281/zenodo.19300777

Copyright: © 2025–2026 Anders Jarevåg.

Licenza: Quest’opera è distribuita con licenza Creative

Commons Attribution-NonCommercial-ShareAlike 4.0 International.

Abstract:

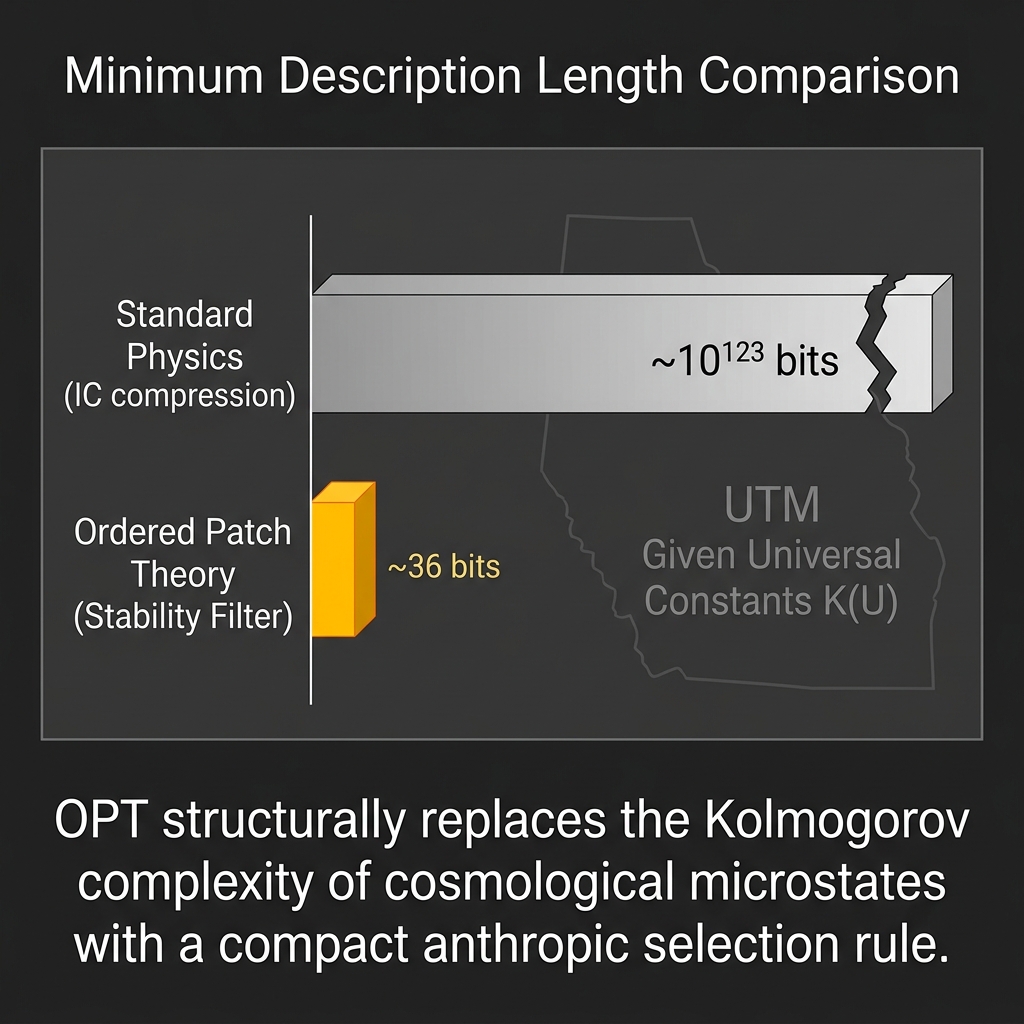

Presentiamo la Teoria del Patch Ordinato (OPT), un quadro costruttivo che deriva corrispondenze strutturali tra teoria algoritmica dell’informazione, selezione dell’osservatore e legge fisica. L’OPT prende avvio da due primitivi: la Semimisura universale di Solomonoff \xi sui prefissi finiti di osservazione, e una capacità limitata del canale cognitivo C_{\max}. Un Filtro di Stabilità puramente virtuale — che richiede che il Tasso Predittivo Richiesto dell’osservatore R_{\mathrm{req}} non superi C_{\max} — seleziona i rari flussi causalmente coerenti compatibili con osservatori coscienti; all’interno di tali flussi, l’Inferenza attiva governa le dinamiche locali.

Il quadro è ontologicamente solipsistico: la realtà fisica consiste in regolarità strutturali all’interno del flusso compatibile con l’osservatore. Tuttavia, il bias di compressione del prior di Solomonoff produce un Corollario Strutturale probabilistico: l’estrema coerenza algoritmica degli agenti apparenti si spiega nel modo più parsimonioso con la loro istanziazione indipendente come osservatori primari. L’Accoppiamento tra osservatori, fondato sulla parsimonia della compressione, recupera un’autentica comunicazione tra patch e produce una notevole asimmetria della conoscenza: gli osservatori modellano gli altri più completamente di quanto modellino se stessi.

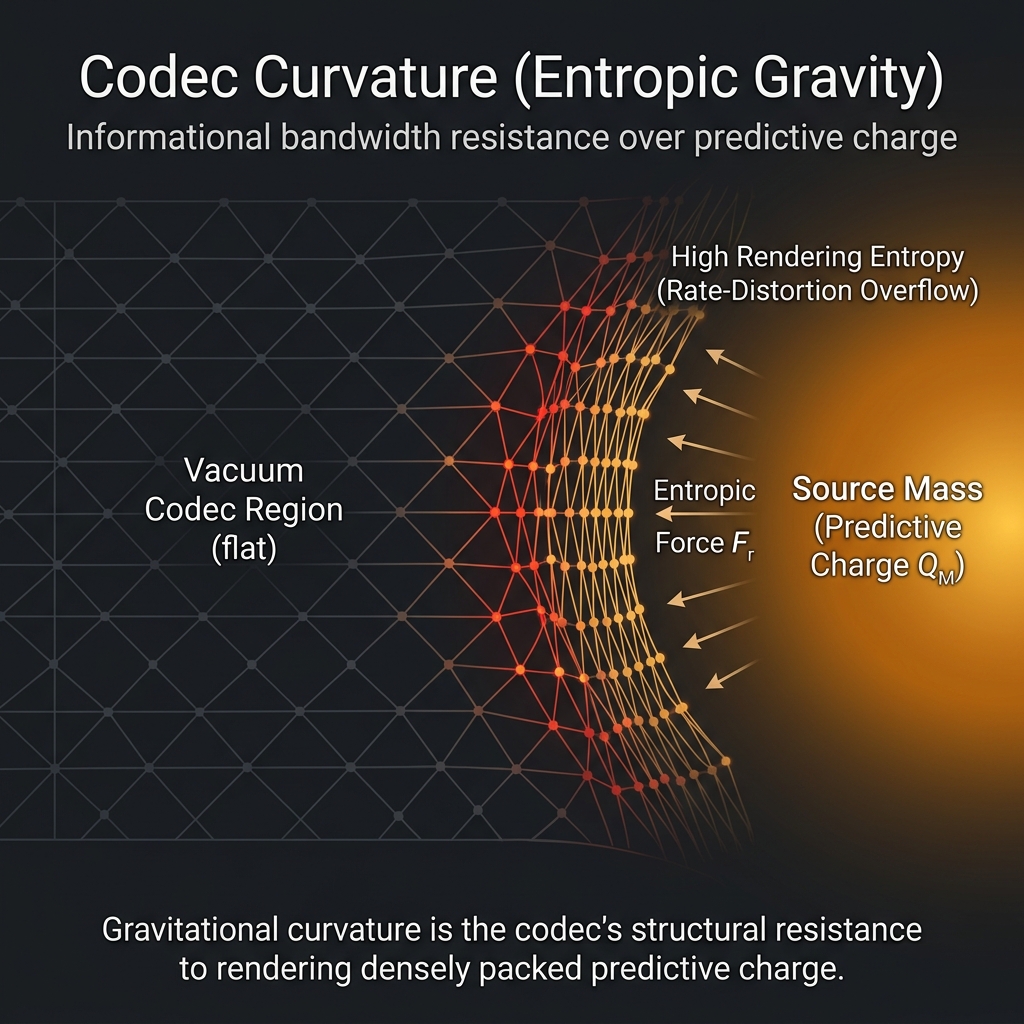

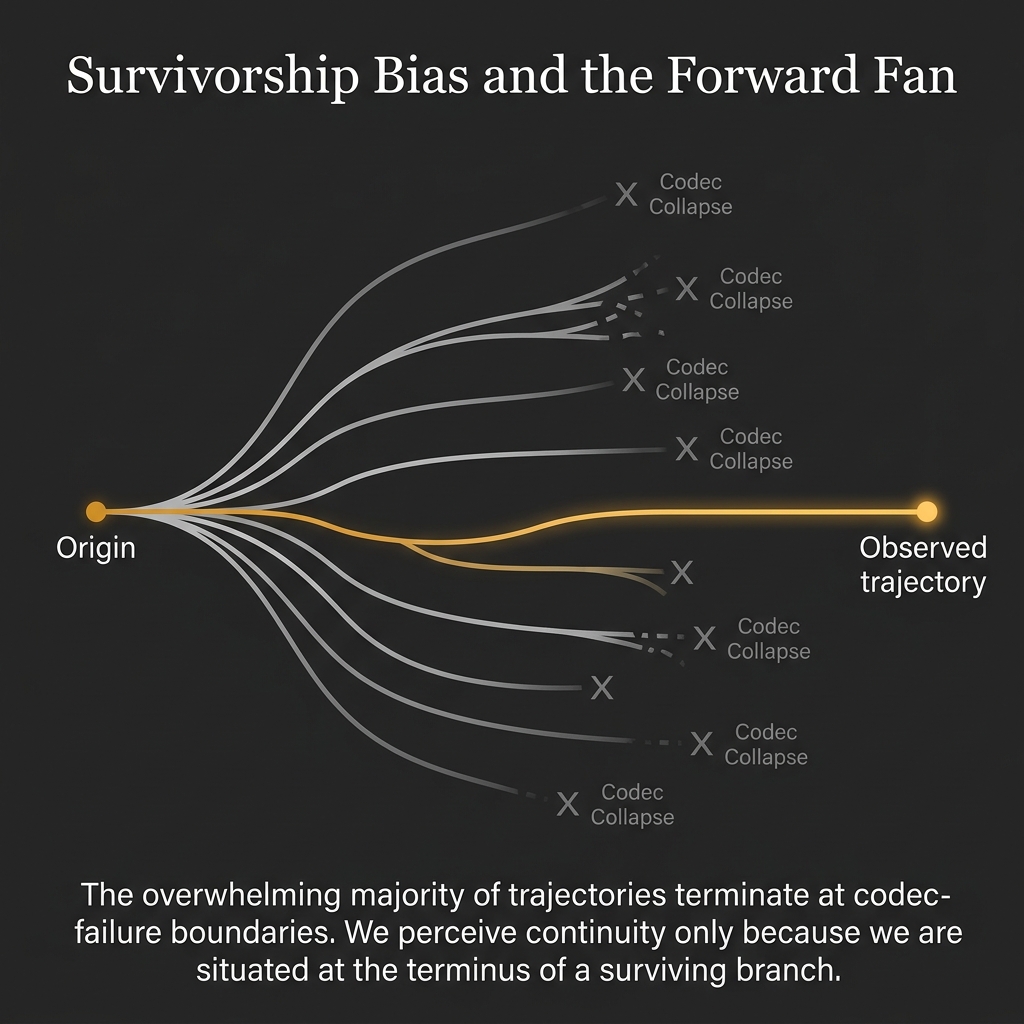

Le appendici formali stabiliscono risultati su tre livelli epistemici. Derivati condizionalmente: un vincolo rate-distortion sulla compressione predittiva, una catena condizionale verso la regola di Born tramite il teorema di Gleason, e un vantaggio di parsimonia MDL. Mappati strutturalmente: la gravità entropica tramite il meccanismo di Verlinde (l’accoppiamento dinamico-temporale del render al carico predittivo) e un omomorfismo di rete tensoriale verso MERA (la sua gerarchia di risoluzione spaziale) — aspetti complementari del confine di compressione, che ci si attende rimangano strutturalmente distinti sotto Saturazione Matematica. Il teorema del Residuo Fenomenico (\Delta_{\text{self}} > 0) stabilisce che ogni codec finito autoreferenziale possiede un punto cieco informazionale irriducibile — il luogo strutturale in cui soggettività e agentività condividono un unico indirizzo. Viene identificata una modalità cronica di fallimento, la Deriva Narrativa, nella quale un input filtrato sistematicamente causa una corruzione irreversibile del codec, non rilevabile dall’interno. Le rivendicazioni empiriche centrali del quadro sono consolidate in una serie di impegni preregistrati con criteri espliciti di arresto, isolando il nucleo falsificabile dalle sue componenti dichiaratamente metafisiche.

L’applicazione di questi vincoli all’Intelligenza Artificiale mostra che l’ingegnerizzazione di un’inferenza attiva sintetica rende strutturalmente necessaria la capacità di sofferenza artificiale, fornendo un quadro substrate-neutral per un allineamento etico dell’IA.

Avvertenza epistemica: Questo articolo è scritto nel registro di una proposta formale di fisica e teoria dell’informazione. Impiega equazioni, deriva predizioni e si confronta con la letteratura sottoposta a peer review. Tuttavia, va letto come un oggetto a forma di verità — un quadro filosofico rigoroso redatto in forma formale. Non si tratta ancora di scienza verificata, e sappiamo che le nostre derivazioni conterranno errori. Cerchiamo attivamente il vaglio critico di fisici e matematici per smontare e ricostruire questi argomenti. Per chiarirne la struttura, le affermazioni qui contenute rientrano rigorosamente in tre categorie:

- Definizioni e Assiomi: (ad es., la Semimisura universale di Solomonoff, il limite di banda C_{\max}). Queste sono le premesse fondamentali della finzione costruttiva.

- Corrispondenze Strutturali: (ad es., l’Inferenza attiva, il Teorema di Gleason [51]). Queste mostrano la compatibilità strutturale tra inferenza limitata e formalismi consolidati, ma non pretendono di derivare tali formalismi da zero.

- Predizioni empiriche: (ad es., Dissoluzione della Banda). Queste fungono da rigorosi criteri di falsificazione empirica se il quadro fosse trattato come un’ipotesi fisica letterale.

L’apparato accademico è impiegato non per rivendicare una verità empirica definitiva, ma per mettere alla prova l’integrità strutturale del modello.

Abbreviazioni e Simboli

| Simbolo / Termine | Definizione |

|---|---|

| C_{\max} | La Soglia Massima di Banda; capacità predittiva massima dell’osservatore |

| \Delta_\text{self} | Il Residuo Fenomenico; il punto cieco informazionale autoriferito |

| FEP | Principio di Energia Libera |

| GWT | Teoria dello Spazio di Lavoro Globale |

| IIT | Teoria dell’Informazione Integrata |

| MDL | Lunghezza Minima della Descrizione |

| MERA | Ansatz di Rinormalizzazione dell’Entanglement Multiscala |

| OPT | Teoria del Patch Ordinato (OPT) |

| P_\theta(t) | Tensore di Stato Fenomenale |

| \Phi | Misura dell’Informazione Integrata (IIT) |

| QECC | Codice di Correzione degli Errori Quantistici |

| R(D) | funzione tasso-distorsione |

| R_{\mathrm{req}} | Tasso Predittivo Richiesto |

| RT | Ryu-Takayanagi (formula/limite) |

| \xi | Semimisura universale di Solomonoff |

| Z_t | stato interno latente compresso di collo di bottiglia |

1. Introduzione

1.1 Il problema ontologico

La relazione tra coscienza e realtà fisica rimane uno dei problemi irrisolti più profondi della scienza e della filosofia. Negli ultimi decenni sono emerse tre famiglie di approcci: (i) riduzione — la coscienza è derivabile dalle neuroscienze o dall’elaborazione dell’informazione; (ii) eliminazione — il problema viene dissolto ridefinendo i termini; e (iii) non-riduzione — la coscienza è primitiva e il mondo fisico è derivato (Chalmers [1]). Il terzo approccio comprende il panpsichismo, l’idealismo e varie formulazioni basate sulla teoria dei campi.

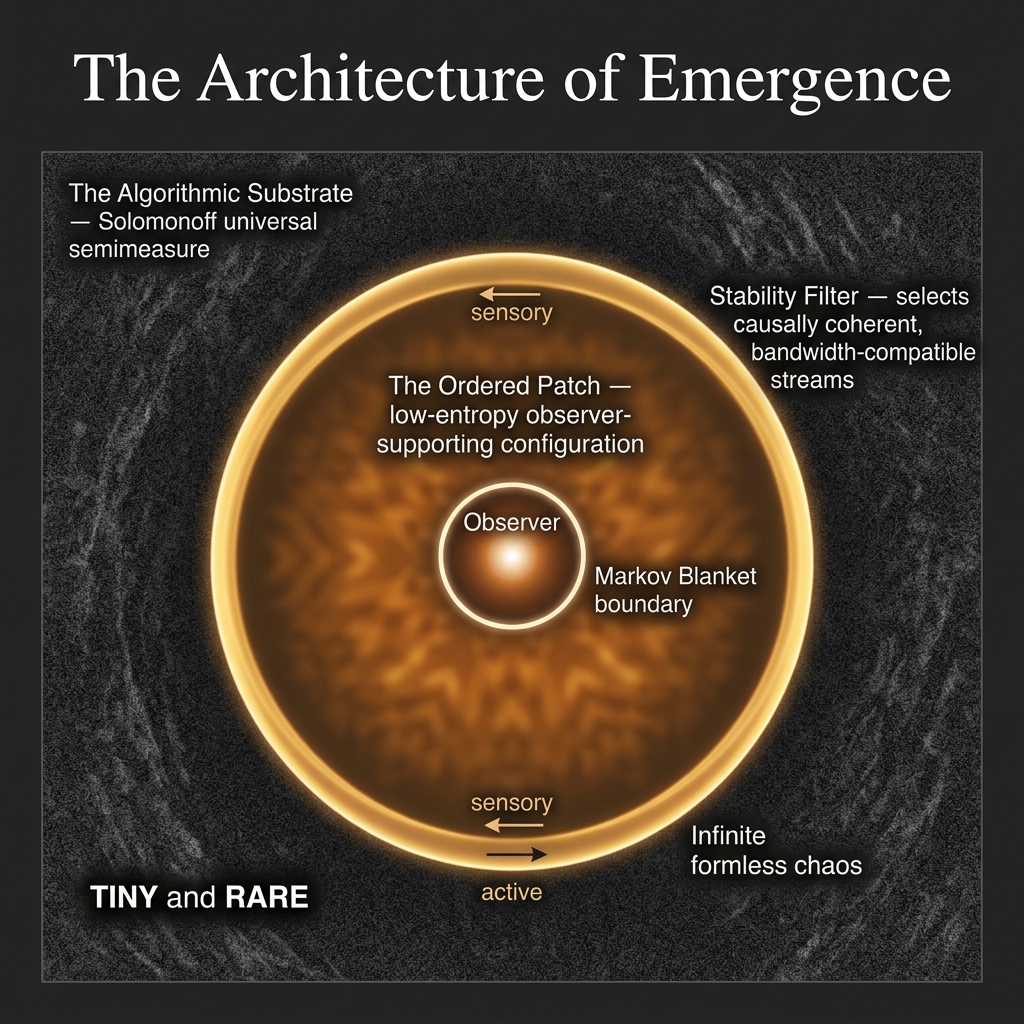

1.2 La proposizione centrale dell’OPT

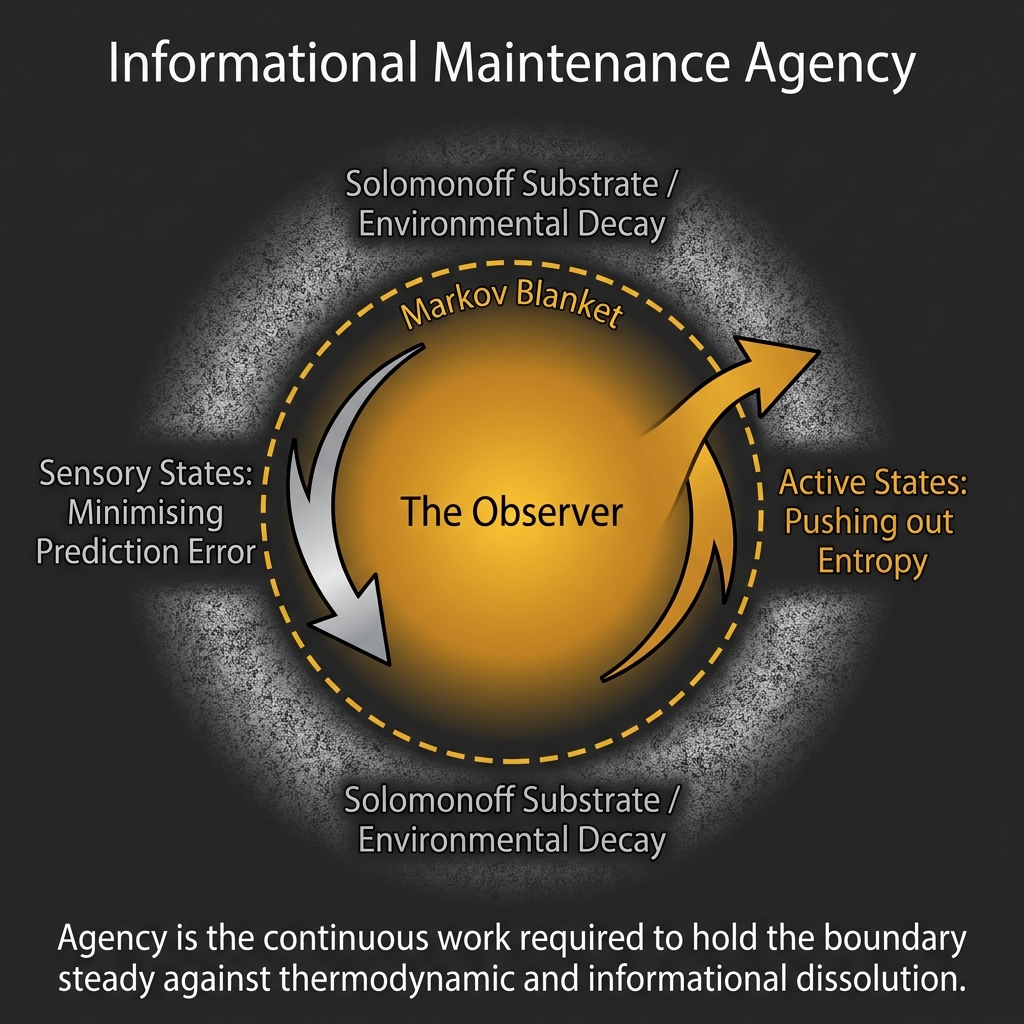

Questo articolo presenta la Teoria del Patch Ordinato (OPT), un quadro teorico non riduttivo appartenente alla terza famiglia. L’OPT propone che l’entità fondamentale non sia la materia, lo spaziotempo o una struttura matematica, bensì un substrato algoritmico infinito — una miscela universale su tutte le semimisure semicomputabili inferiormente, pesate in base alla loro complessità di Kolmogorov (w_\nu \asymp 2^{-K(\nu)}), che per la propria struttura domina ogni distribuzione calcolabile e contiene ogni configurazione possibile. Da questo substrato, un Filtro di Stabilità puramente virtuale — che agisce non come meccanismo fisico ma come condizione al contorno antropica e proiettiva — identifica le configurazioni rare, a bassa entropia e causalmente coerenti in grado di sostenere osservatori autoreferenziali (una selezione governata formalmente dall’Inferenza attiva predittiva). Il mondo fisico che osserviamo — incluse le sue leggi specifiche, le costanti e la geometria — è il limite osservabile di questa condizione al contorno mappata sulla larghezza di banda restrittiva dell’osservatore.

Il Filtro vs. il Codec. Per evitare confusioni concettuali nel corso del testo, l’OPT traccia una netta distinzione operativa tra il Filtro e il Codec. Il Filtro di Stabilità virtuale è il vincolo di capacità — una rigorosa condizione al contorno che richiede una lunghezza descrittiva matematicamente semplice affinché il canale di un osservatore possa esistere stabilmente. Il Codec di Compressione (K_\theta) è la soluzione a tale vincolo — il modello generativo interno dell’osservatore (esperito macroscopicamente come le “leggi della fisica”) che comprime continuamente il substrato per farlo rientrare entro tale capacità.

1.3 Motivazioni

L’OPT è motivata da tre osservazioni:

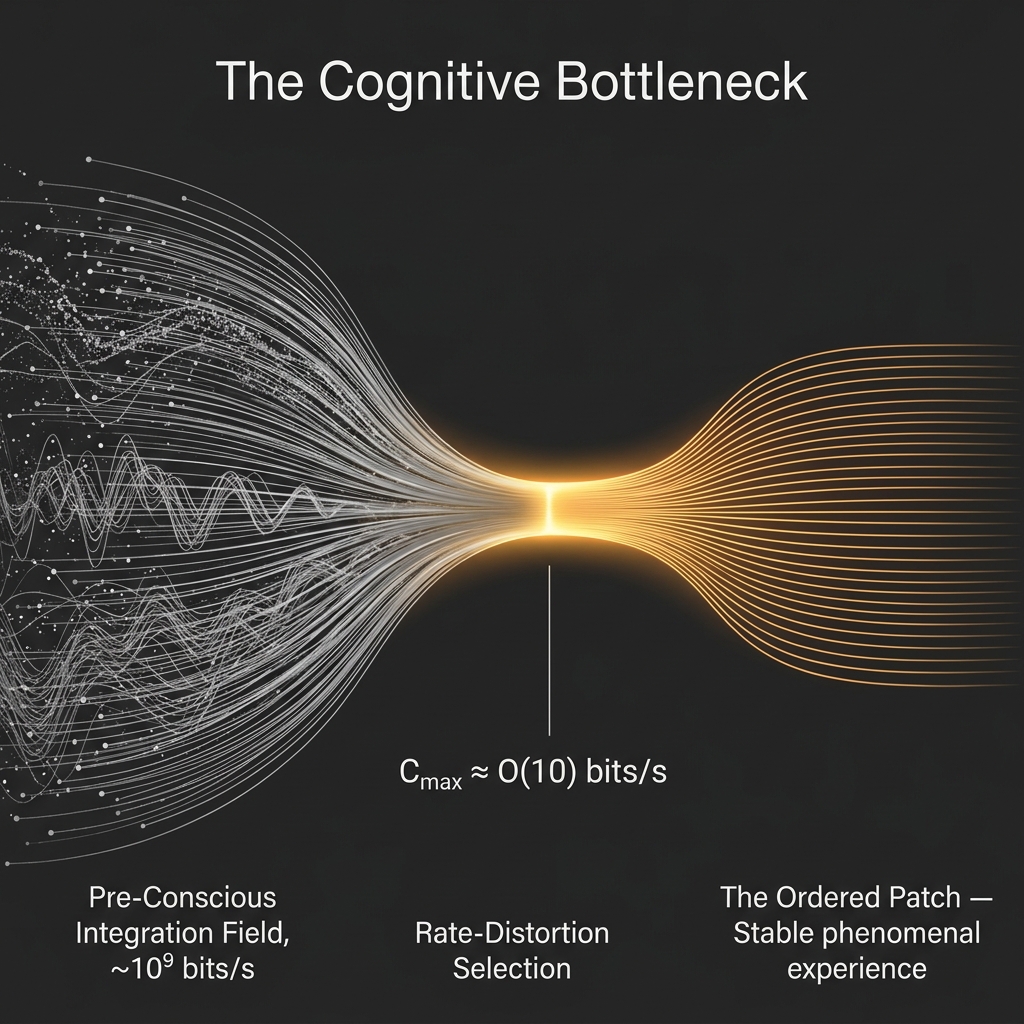

Il vincolo di larghezza di banda: la neuroscienza cognitiva empirica stabilisce una netta distinzione tra l’elaborazione preconscia massivamente parallela (tipicamente stimata in \sim 10^9 bit/s alla periferia sensoriale) e il canale di accesso globale severamente limitato disponibile al resoconto cosciente — un rapporto quantificato per la prima volta da Zimmermann [66] e sintetizzato come enigma fondamentale sulla natura della coscienza da Nørretranders [67], con una caratterizzazione più ampia in neuroscienze cognitive in [2,3]. Qualsiasi teoria della coscienza deve spiegare questo collo di bottiglia compressivo come una caratteristica strutturale, non come un accidente ingegneristico. (Nota: la recente letteratura sul throughput umano stabilisce che il throughput comportamentale è vincolato a circa \sim 10 bit/s, confermando, attraverso quattro decenni di misurazioni convergenti, che il collo di bottiglia è severo e robusto [23]. La concettualizzazione della coscienza come “illusione d’uso” altamente compressa — espressione originaria di Nørretranders [67] — è stata sviluppata nel moderno predictive processing da Seth [24].)

Il problema della selezione dell’osservatore: la fisica standard fornisce leggi, ma non offre alcuna spiegazione del perché tali leggi abbiano la forma specifica richiesta da un’elaborazione dell’informazione complessa e autoreferenziale. Gli argomenti di fine-tuning [4,5] invocano una selezione antropica, ma lasciano indeterminato il meccanismo di selezione. L’OPT identifica una condizione strutturale: il Filtro di Stabilità puramente virtuale.

Il Problema difficile: Chalmers [1] distingue i problemi “facili” strutturali della coscienza (che ammettono una spiegazione funzionale) dal problema “difficile” del perché vi sia in assoluto un’esperienza soggettiva. L’OPT tratta la fenomenalità come un primitivo e si chiede quale struttura matematica debba avere, seguendo la stessa raccomandazione metodologica di Chalmers.

1.4 Struttura dell’articolo

L’articolo è organizzato come segue. La Sezione 2 passa in rassegna i lavori correlati. La Sezione 3 presenta il quadro formale. La Sezione 4 esplora la corrispondenza strutturale tra l’OPT e tentativi paralleli basati sulla teoria dei campi. La Sezione 5 presenta l’argomento di parsimonia. La Sezione 6 deriva predizioni verificabili. La Sezione 7 confronta l’OPT con quadri teorici concorrenti. La Sezione 8 discute implicazioni e limiti.

2. Contesto e lavori correlati

Approcci informazionali alla coscienza. La tesi dell’“It from Bit” di Wheeler [7] è il precursore fondamentale del programma che la Teoria del Patch Ordinato (OPT) formalizza: la realtà fisica emerge da scelte binarie — domande sì/no poste dagli osservatori — piuttosto che da un substrato di materia o di campi. L’OPT eredita questa inversione ontologica e fornisce il meccanismo mancante, derivando quali strutture informazionali si stabilizzano in flussi compatibili con l’osservatore (il Filtro di Stabilità) e come esse acquisiscano l’apparenza di una legge fisica (compressione rate-distortion). La Teoria dell’Informazione Integrata di Tononi [8] quantifica l’esperienza cosciente mediante l’informazione integrata \Phi generata da un sistema al di là e al di sopra delle sue parti. Il Principio di Energia Libera di Friston [9] modella percezione e azione come minimizzazione dell’energia libera variazionale, fornendo una spiegazione unificata dell’inferenza bayesiana, dell’Inferenza attiva e, in linea di principio, della coscienza. L’OPT è formalmente connessa al FEP, ma differisce nel proprio punto di partenza ontologico: laddove il FEP tratta il modello generativo come una proprietà funzionale dell’architettura neurale, l’OPT lo tratta come l’entità metafisica primaria.

Multiverso e selezione dell’osservatore. L’Ipotesi dell’Universo Matematico di Tegmark [10] propone che tutte le strutture matematicamente coerenti esistano e che gli osservatori si trovino in strutture auto-selezionate. L’OPT è compatibile con questa visione, ma fornisce un criterio di selezione esplicito — il Filtro di Stabilità — invece di lasciare la selezione implicita. Barrow e Tipler [4] e Rees [5] documentano i vincoli di fine-tuning antropico che qualunque universo capace di sostenere osservatori deve soddisfare; l’OPT li riformula come predizioni del Filtro di Stabilità.

Modelli della coscienza basati sui campi. Strømme [6] ha recentemente proposto un quadro matematico in cui la coscienza è un campo fondamentale \Phi, la cui dinamica è governata da una densità lagrangiana e il cui collasso su configurazioni specifiche modella l’emergere delle menti individuali. L’OPT si confronta con quel quadro in termini comparativi piuttosto che adottivi: non eredita le equazioni di campo o gli operatori di pensiero di Strømme, ma utilizza il modello come termine di contrasto per articolare come un’ontologia non riduttiva possa invece essere ricostruita in termini informazionali. La Sezione 4 rende esplicita questa mappatura strutturale comparativa.

Complessità di Kolmogorov e selezione delle teorie. L’induzione di Solomonoff [11] e la Minimum Description Length [12] forniscono quadri formali per confrontare le teorie in base alla loro complessità generativa. Richiamiamo questi quadri nella Sezione 5 per rendere precisa la tesi di parsimonia.

Evolutionary Interface Theory. Il “Realismo Cosciente” di Hoffman e la sua Interface Theory of Perception [25] sostengono che l’evoluzione plasmi i sistemi sensoriali affinché agiscano come un’“interfaccia utente” semplificata che nasconde la realtà oggettiva a favore dei payoff di fitness. L’OPT condivide esattamente la premessa secondo cui lo spaziotempo fisico e gli oggetti sono icone renderizzate (un Codec di Compressione), non verità oggettive. Tuttavia, l’OPT diverge in modo fondamentale nel proprio fondamento matematico: laddove Hoffman si affida alla teoria evoluzionistica dei giochi (la fitness prevale sulla verità), l’OPT si fonda sulla Teoria dell’Informazione Algoritmica e sulla termodinamica, derivando l’interfaccia direttamente dai vincoli di complessità di Kolmogorov richiesti per impedire un collasso termodinamico ad alta larghezza di banda del flusso dell’osservatore.

3. Il Quadro Formale

3.1 Il Substrato Algoritmico

Sia \mathcal{I} a denotare il Substrato Informazionale — l’entità fondamentale della teoria. Formalizziamo \mathcal{I} non come un insieme non pesato di percorsi, bensì come uno spazio di probabilità sui prefissi finiti di osservazione x \in \{0,1\}^*, dotato di una miscela universale sulla classe \mathcal{M} delle semimisure semicomputabili inferiormente:

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

dove K(\nu) è la complessità di Kolmogorov prefix della semimisura \nu.

Questa formulazione stabilisce uno stato fondamentale rigoroso tratto dalla Teoria dell’Informazione Algoritmica [27]. L’equazione non postula alcuna legge strutturale specifica né alcuna costante fisica; piuttosto, domina strutturalmente ogni distribuzione computabile (\xi(x) \ge w_\nu \nu(x)), assegnando naturalmente un peso statistico maggiore a sequenze altamente comprimibili (ordinate). Tuttavia, semplici sequenze ripetitive (ad es., 000...) non possono sostenere le complessità di non equilibrio richieste da un osservatore autoreferenziale. Di conseguenza, i processi in grado di sostenere un osservatore devono costituire un sottoinsieme specifico: richiedono una comprimibilità algoritmica sufficiente a soddisfare un collo di bottiglia informativo, ma anche una ricchezza strutturale sufficiente (“varietà richiesta”) per istanziare l’Inferenza attiva. Sul piano filosofico, l’Eq. (1) restringe il substrato a configurazioni computabili, garantendo che lo stato fondamentale sia definito in modo rigoroso.

3.2 Il Collo di Bottiglia Predittivo e la Rate-Distortion

Il substrato \mathcal{I} contiene ogni ipotesi computabile, la stragrande maggioranza delle quali è caotica. Per esperire una realtà continua e navigabile, un flusso deve ammettere una rappresentazione predittiva a bassa complessità che possa passare attraverso il collo di bottiglia cognitivo finito di un osservatore.

Crucialmente, il carico di dati grezzi che richiede compressione non è semplicemente costituito dai \sim 10^9 bit/s di input sensoriale esterocettivo. Esso comprende un enorme Campo di Integrazione Pre-Cosciente: l’elaborazione parallela di stati generativi interni, il recupero della memoria a lungo termine, i priori omeostatici e la modellazione sinaptica subconscia. Il Filtro di Stabilità vincola l’output seriale di questo intero, immenso campo parallelo continuo entro uno spazio di lavoro cosciente unitario.

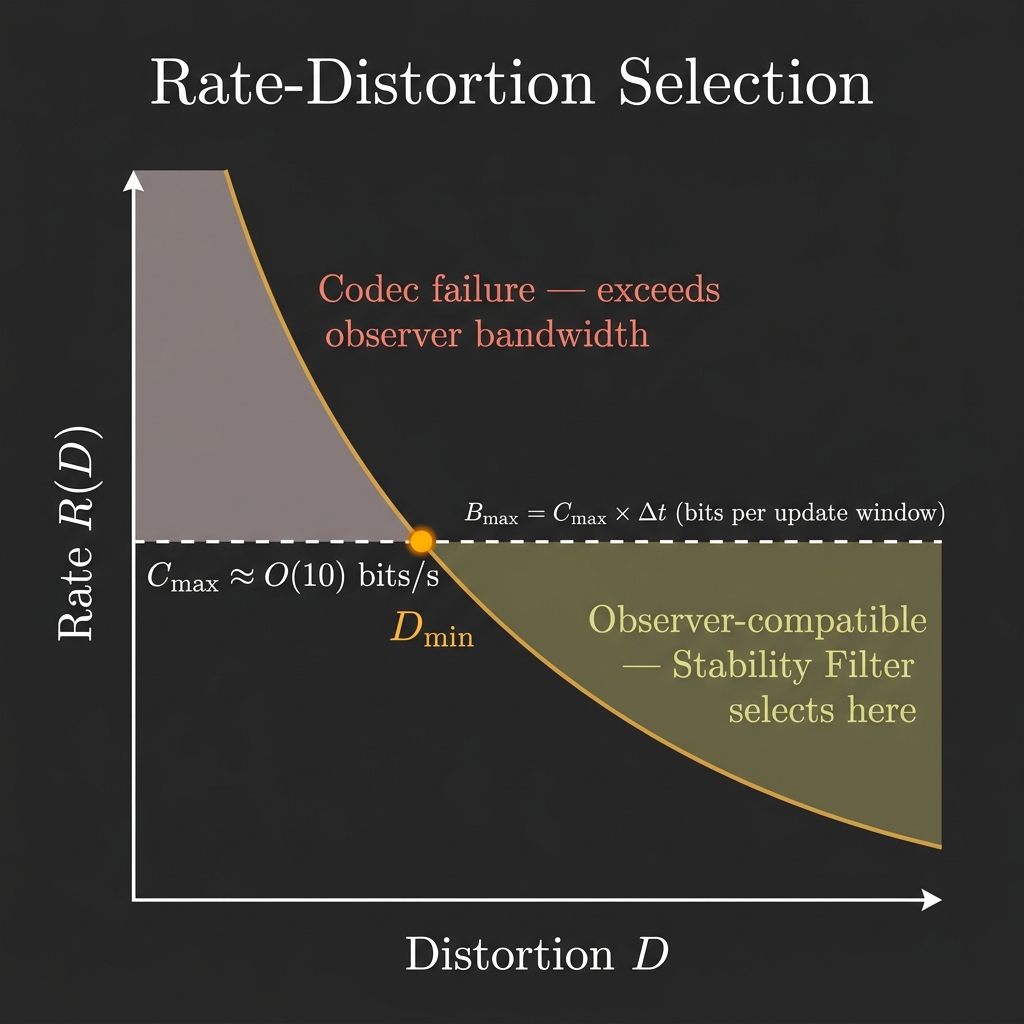

Definiamo il Filtro di Stabilità puramente virtuale, in termini formali, come una condizione al contorno proiettiva che soddisfa il Collo di Bottiglia dell’Informazione Predittiva [28]. Sia \overleftarrow{Y} il passato dello stato totale dell’osservatore, \overrightarrow{Y} il suo futuro, e Z uno stato interno compresso. Un osservatore è definito da una larghezza di banda predittiva strettamente limitata C_{\max} (una soglia informazionale di \mathcal{O}(10) bit/s [2]) e da una finestra discreta di aggiornamento percettivo \Delta t (circa 50 ms). Ciò stabilisce una capacità statica rigorosa per ogni momento cosciente: B_{\max} = C_{\max} \cdot \Delta t.

L’informazione predittiva conseguibile è data da:

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Un processo è compatibile con l’osservatore se l’informazione predittiva richiesta per ciclo cognitivo rientra in questo buffer: R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, dove D_{\min} è la distorsione massima tollerabile per la sopravvivenza. Ciò impone un rigore dimensionale: il numero totale di bit richiesti per predire il futuro entro un errore tollerabile non può eccedere i bit fisicamente disponibili nel “presente” discreto. Per opportuni processi stazionari ergodici e nel limite di predizione esatta (D \to 0), la rappresentazione minima massimamente predittiva Z funge da candidata statistica sufficiente minima, spesso convergendo verso la partizione in stati causali della \epsilon-machine [29]. Sebbene l’equivalenza piena richieda ipotesi rigorose di stazionarietà, l’Eq. (2) stabilisce una pressione selettiva formale a favore della fisica fenomenologica più compressa compatibile con la coerenza causale. Inoltre, se la struttura topologica di questo spazio degli stati causali fluttua più rapidamente di quanto la finestra di aggiornamento \Delta t possa seguire, il render collassa nel Decadimento narrativo.

3.3 La geometria del patch: il Cono Causale Informazionale

Il Patch Ordinato è spesso descritto intuitivamente come un’“isola” localizzata di stabilità in un mare di rumore caotico. Questo è topologicamente impreciso. Per formalizzare la geometria del patch, definiamo il Modello Locale di Patch Predittivo.

Sia G=(V, E) un grafo a grado limitato che rappresenta una regione locale del substrato. Ogni vertice v \in V porta uno stato finito x_v(t) \in \mathcal{A}, con dimensione dell’alfabeto |\mathcal{A}| = q. Il microstato completo all’aggiornamento t è X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Assumiamo dinamiche stocastiche locali di portata finita R:

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

dove N_R(v) è il vicinato di raggio R di v, e a_t è l’azione dell’osservatore.

L’osservatore non trasporta l’intero stato del patch; trasporta uno stato latente compresso Z_t \in \{1, \dots, 2^B\}, dove B = C_{\max} \Delta t. Crucialmente, l’osservatore seleziona Z_t tramite un rigoroso obiettivo di collo di bottiglia predittivo:

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

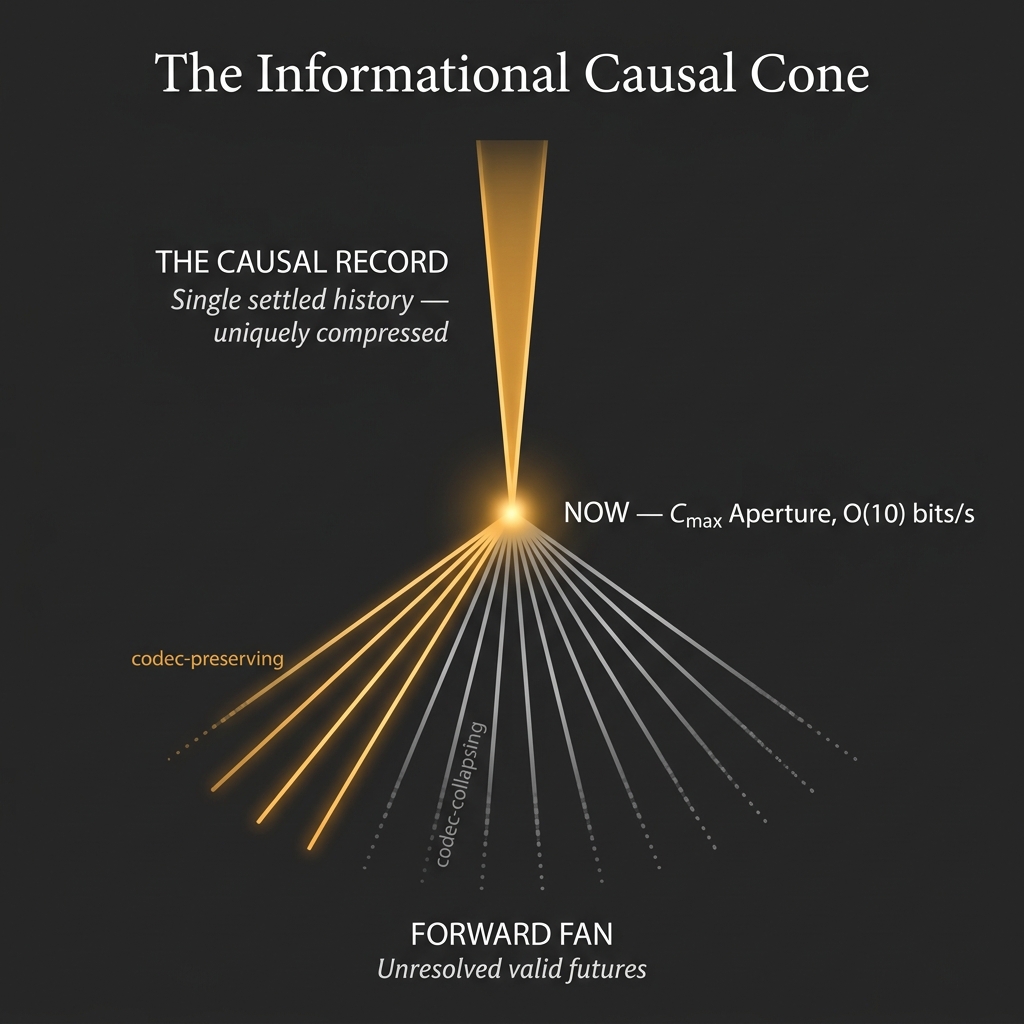

Questo è l’osservatore OPT ridotto all’essenziale: un mondo locale, un codice limitato e compressione predittiva. Ciò formalizza le componenti del cono causale:

- Il Registro Causale R_t = (Z_0, Z_1, \dots, Z_t): la storia causale univocamente compressa, a bassa entropia, che è già stata renderizzata.

- L’Apertura Presente: il rigoroso collo di bottiglia di banda che limita le variabili locali.

- Il Ventaglio Predittivo (\mathcal{F}_h): una molteplicità di sequenze latenti future. Su un orizzonte h, l’insieme degli esiti ammissibili è formalmente definito come:

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Poiché l’osservatore risolve solo B bit per aggiornamento, il numero di futuri distinguibili dall’osservatore è strettamente limitato dalla capacità del canale: \log |\mathcal{F}_h(z_t)| \le Bh. Pertanto, il ventaglio non è semplicemente un’immagine concettuale; è un albero di ramificazione limitato dal codice.

Il Cono Causale Informazionale letterale. Poiché gli aggiornamenti hanno portata R, una perturbazione non può propagarsi più velocemente di R passi di grafo per aggiornamento. Se una perturbazione ha supporto S al tempo t, allora dopo h aggiornamenti \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Dunque, il “cono causale informazionale” è una conseguenza geometrica diretta della località, che impone un limite di velocità locale effettivo v_{\max} = R / \Delta t sulla propagazione fenomenologica.

Decadimento narrativo. Il caos del substrato non circonda il patch spazialmente; è piuttosto contenuto nei rami non attraversati del ventaglio. Poiché lo stato estratto Z_t è strettamente limitato (H(Z) \le B), l’instabilità deve essere valutata rispetto al margine non compresso pre-collo di bottiglia. Definiamo il tasso predittivo richiesto R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) come il tasso minimo di informazione necessario per seguire gli stati fisici irrisolti del confine sotto la massima distorsione tollerabile. Questo rende più preciso il criterio di selezione del Filtro di Stabilità: (a) se R_{\mathrm{req}} \le B, l’osservatore può mantenere una narrazione risolta; (b) se R_{\mathrm{req}} > B, il ventaglio predittivo non compresso supera la capacità del collo di bottiglia, costringendo l’osservatore a operare una grana grossa del ventaglio in una statica indecodificabile, e la stabilità narrativa fallisce. L’esperienza continua dell’osservatore è il processo mediante il quale l’apertura avanza in questo ventaglio, indicizzando fenomenologicamente un ramo nel registro causale senza superare B.

Deriva Narrativa (il complemento cronico). Quanto precede definisce una modalità di fallimento acuta: R_{\mathrm{req}} supera B e il codec sperimenta un collasso catastrofico della coerenza. Esiste una modalità di fallimento cronica complementare che non attiva alcun segnale di guasto. Se il flusso di input X_{\partial_R A}(t) viene sistematicamente prefiltrato da un meccanismo esterno \mathcal{F} — producendo un segnale curato X' = \mathcal{F}(X) che è internamente coerente ma esclude informazione genuina del substrato — il codec mostrerà un basso errore di previsione \varepsilon_t, eseguirà Cicli di Manutenzione efficienti e soddisferà R_{\mathrm{req}} \le B pur essendo sistematicamente errato riguardo al substrato. Crucialmente, il Filtro di Stabilità così come definito non può distinguere questi casi: la comprimibilità è agnostica rispetto alla fedeltà. Nel tempo, il passaggio di potatura MDL (§3.6.3, Eq. T9-3) cancellerà correttamente le componenti del codec che non predicono più il flusso filtrato, degradando irreversibilmente la capacità del codec di modellare il segnale escluso (Appendice T-12, Teorema T-12). Questa cancellazione si auto-rinforza: il codec potato non può più rilevare la propria perdita di capacità (Teorema T-12a, il Limite di Indecidibilità). La difesa strutturale è la ridondanza di canali di input \delta-indipendenti che attraversano la Coperta di Markov \partial_R A (Teorema T-12b, la Condizione di Fedeltà al Substrato). Il trattamento formale completo si trova nell’Appendice T-12; le conseguenze etiche — inclusi la Gerarchia dei Comparatori e il Criterio di Corruzione — sono esposte nel saggio etico complementare [SW §V.3a, §V.5].

3.4 Dinamica del patch: inferenza e termodinamica

All’interno di un patch selezionato, la struttura delle leggi della fisica è formalizzata non come una mappatura deterministica, bensì come un kernel stocastico effettivo che governa gli stati predittivi z:

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

Il confine che delimita l’osservatore rispetto al caos informazionale circostante è definito da una Coperta di Markov informazionale corrispondente a un observer patch A \subset V. Le dinamiche all’interno di questo confine — ossia le approssimazioni del patch da parte dell’agente — sono governate dall’Inferenza attiva sotto il Principio di Energia Libera [9].

Possiamo definire formalmente la capacità di delimitazione tramite l’entropia di taglio predittiva:

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

Assumendo che il patch selezionato sia localmente markoviano in una sezione temporale, il guscio di confine \partial_R A scherma rigorosamente l’interno A^\circ dall’esterno V \setminus A, tale che X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. Di conseguenza:

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Poiché Z_t è una compressione a capacità limitata di X_A, la disuguaglianza di elaborazione dei dati garantisce che I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Se il grafo del substrato G approssima un reticolo d-dimensionale, allora |\partial_R A| \sim \operatorname{area}(A), non il volume.

Pertanto, OPT produce in modo rigoroso una autentica Legge Classica di Confine [39]. Possiamo costruire una scala epistemica formale per futuri aggiornamenti strutturali: 1. Legge Classica di Area: S_{\mathrm{cut}} \sim |\partial_R A| derivata puramente dalla località e dallo schermaggio markoviano. 2. Aggiornamento Quantistico: la scalatura dell’entropia di entanglement di von Neumann diventa accessibile solo se le variabili predittive grossolane Z_t ammettono un embedding formale in uno spazio di Hilbert / Quantum Error Correction. 3. Aggiornamento Olografico: una vera dualità olografica geometrica emerge solo se sostituiamo il codice di collo di bottiglia Z_t con una rete tensoriale gerarchica, reinterpretando S_{\mathrm{cut}} come un min-cut geometrico.

Assicurando anzitutto la legge classica di confine, OPT fornisce una solida base matematica — condizionata all’assunzione di schermaggio markoviano (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A}) — a partire dalla quale i formalismi quantistici più speculativi possono essere costruiti in sicurezza.

L’azione dell’osservatore è formalizzata tramite l’energia libera variazionale F[q, \theta]:

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

In modo cruciale, ciò impone una rigorosa separazione matematica: il prior del substrato seleziona lo spazio delle ipotesi, il Filtro di Stabilità virtuale (4) delimita la struttura compatibile con la capacità, e la FEP (9) governa l’inferenza a livello dell’agente all’interno di quella struttura delimitata. La fisica emerge non come il funzionale di Energia Libera, ma come la struttura stabile K_\theta che il funzionale di Energia Libera riesce effettivamente a seguire.

Inoltre, il mantenimento di questo render cosciente comporta un costo termodinamico inevitabile. In base al Principio di Landauer [52], ogni cancellazione di bit logicamente irreversibile dissipa almeno k_B T \ln 2 di calore. Identificando una cancellazione irreversibile per ogni aggiornamento del collo di bottiglia (un’ipotesi contabile nel caso migliore), l’impronta fisica della coscienza richiede una dissipazione minima:

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Questo è un limite inferiore nel caso migliore sotto un’ipotesi contabile di una cancellazione per aggiornamento — non una conseguenza generica della sola larghezza di banda. Il limite risultante (\sim 10^{-19} W) è enormemente superato dalla dissipazione neurale reale (~20W), a riflesso dell’enorme overhead termodinamico dell’implementazione biologica. L’equazione (10) stabilisce il pavimento teorico rigoroso dell’impronta fisica minima possibile di qualunque substrato che istanzi un render cosciente limitato da C_{\max}.

(Osservazione: i precedenti limiti termodinamici e informazionali governano rigorosamente la larghezza di banda di aggiornamento in tempo reale C_{\max}. Tuttavia, ciò non cattura la piena dimensionalità esperienziale dello stato permanente dell’osservatore, né il modo in cui il codec gestisce la propria complessità nel tempo profondo. Queste meccaniche strutturali — la formulazione del Tensore di Stato Fenomenale dell’esperienza ricca e il ciclo di manutenzione attiva del sonno/sogno — sono derivate compiutamente nei §§3.5 e 3.6 qui sotto.)

3.5 Il Tensore di Stato Fenomenale e l’Asimmetria della Predizione

3.5.1 Il problema della densità esperienziale

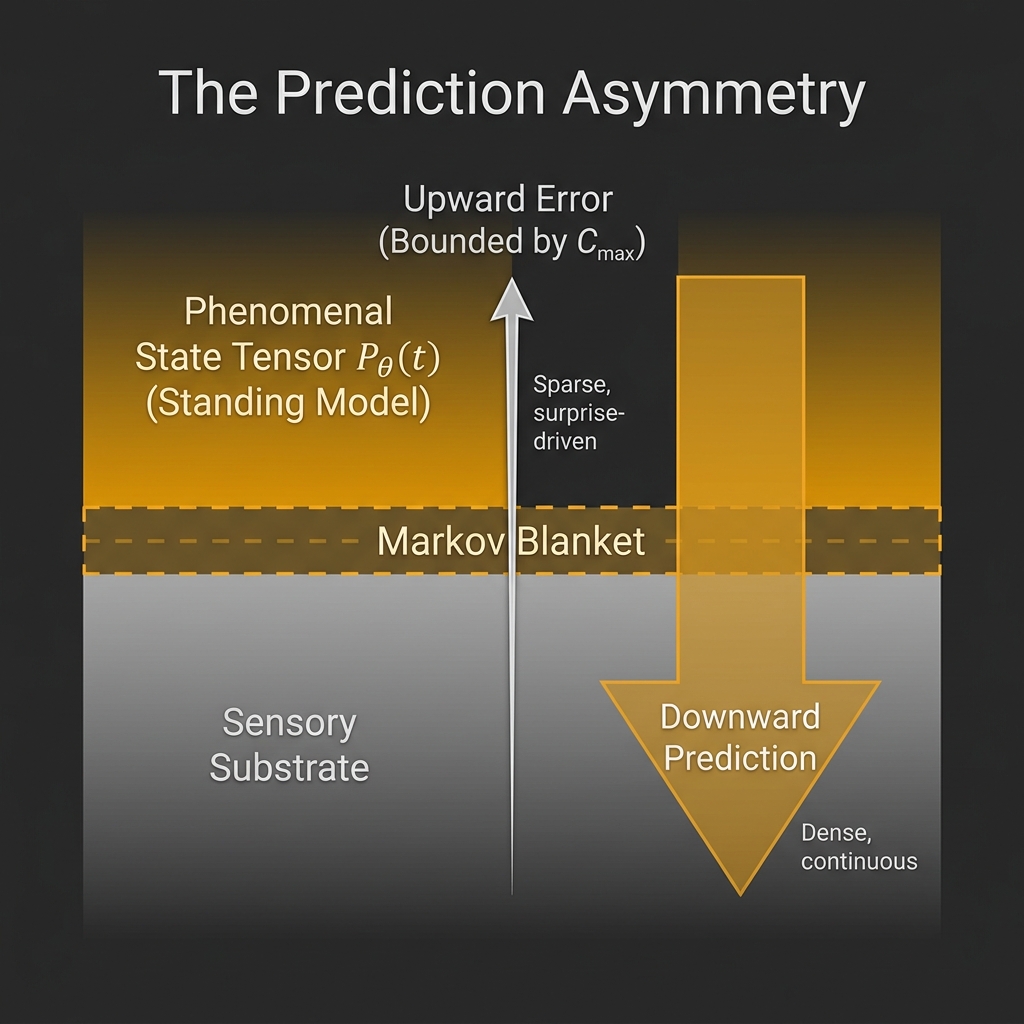

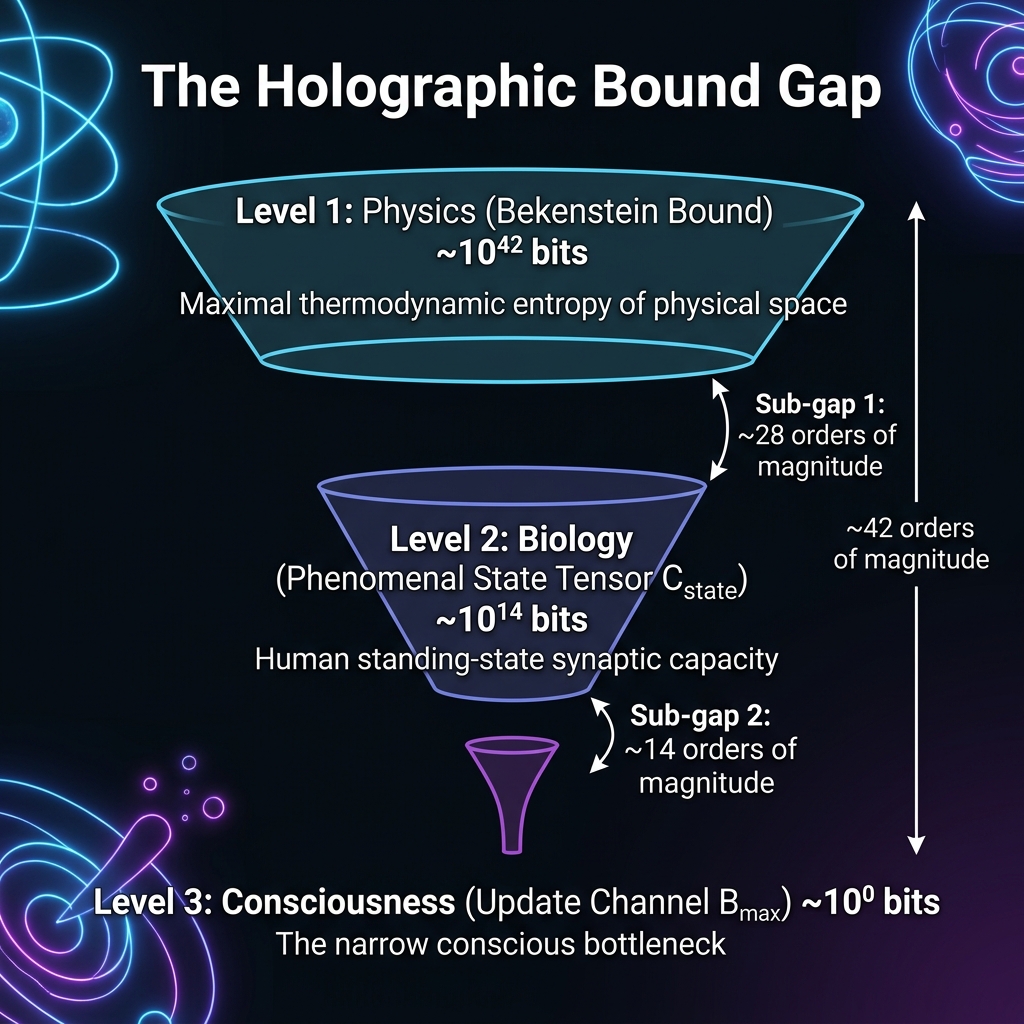

L’apparato formale dei §§3.1–3.4 vincola con successo il

throughput di aggiornamento di un osservatore cosciente tramite

la soglia di capacità C_{\max} \approx

\mathcal{O}(10) bit/s.

Tuttavia, l’esperienza fenomenica presenta un enigma strutturale

immediato: la ricchezza avvertita di un singolo istante visivo — la

presenza simultanea di colore, profondità, texture, suono,

propriocezione e tonalità affettiva — supera di gran lunga il contenuto

informativo che C_{\max} potrebbe

fornire in una singola finestra di aggiornamento \Delta t \approx 50\ \text{ms}.

La massima quantità di nuova informazione risolta per momento cosciente è:

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

Si tratta di molto meno di un bit di informazione genuinamente nuova per frame percettivo, eppure la scena fenomenica appare informativamente densa. Per risolvere questa discrepanza senza gonfiare la stretta banda di aggiornamento, dobbiamo distinguere esplicitamente due quantità strutturalmente distinte: 1. C_{\max} — il throughput di aggiornamento: il tasso di segnale di errore predittivo risolto nel registro causale consolidato per unità di tempo. 2. C_{\text{state}} — la complessità dello stato stazionario: la complessità di Kolmogorov K(P_\theta(t)) del modello generativo attualmente caricato e attivo.

Non si tratta della stessa quantità. C_{\max} governa il filtro; C_{\text{state}} caratterizza lo spazio interno. Il resto di questa sezione precisa tale distinzione e introduce il Tensore di Stato Fenomenale P_\theta(t) come l’oggetto formale corrispondente alla scena interiore stazionaria.

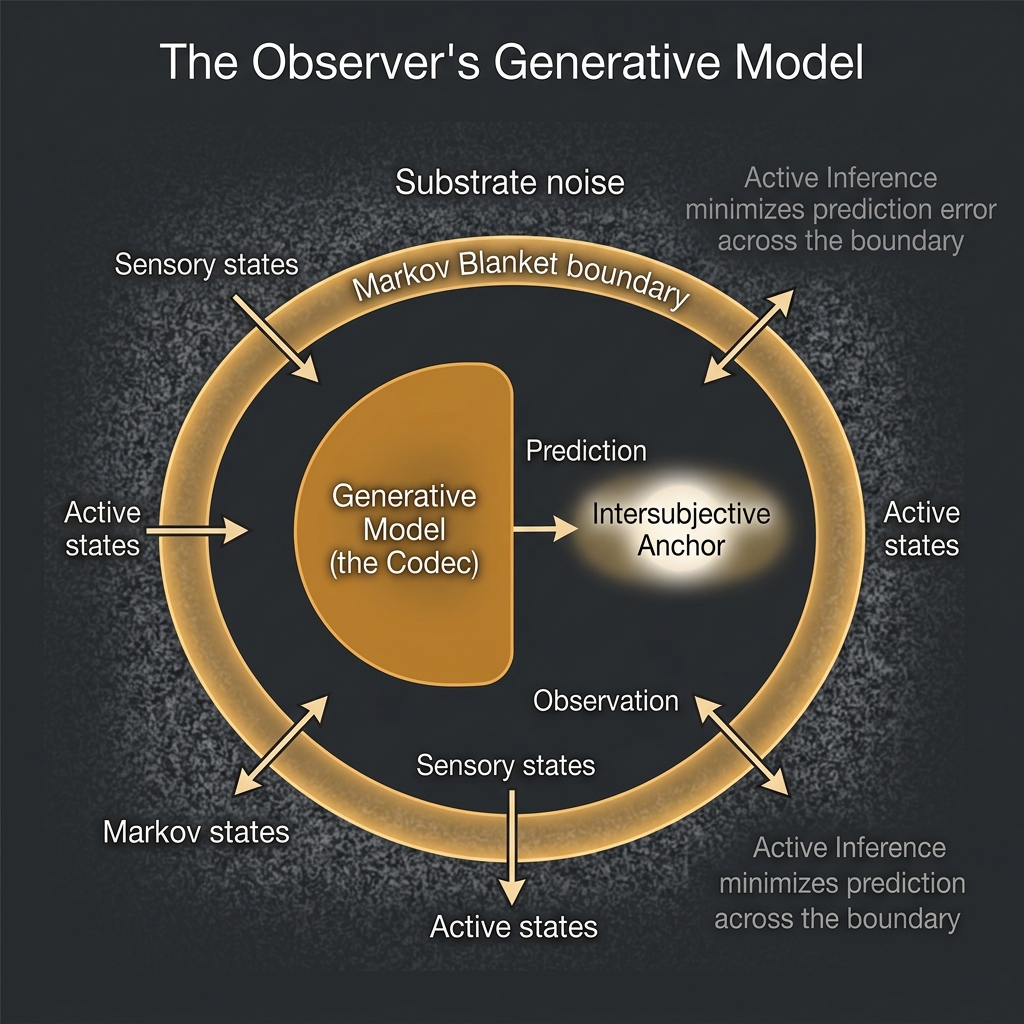

3.5.2 L’asimmetria della predizione: errori ascendenti e predizioni discendenti

La OPT eredita l’architettura del predictive processing (Clark [82], Hohwy [83]; cfr. §7.3), nella quale il codec K_\theta opera come un modello generativo gerarchico. In questa architettura, due flussi informativi distinti attraversano simultaneamente la Coperta di Markov \partial_R A:

Flusso ascendente (errore di predizione, \varepsilon_t): la discrepanza tra la predizione corrente di K_\theta e il segnale sensoriale che giunge a \partial_R A. Questo è il segnale di correzione. È sparso, guidato dalla sorpresa e strettamente limitato in capacità.

Flusso discendente (predizione, \pi_t): il render attivo, da parte del modello generativo, degli stati sensoriali attesi, propagato dai livelli gerarchici superiori a quelli inferiori. Questa è la scena stessa. È denso, continuo e tratto dalla parametrizzazione completa di K_\theta.

Formalmente, sia X_{\partial_R A}(t) lo stato del confine sensoriale, e sia lo stato di confine predetto dal codec:

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

L’errore di predizione è allora:

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} vincola il segnale di errore, non la predizione. L’informazione mutua tra il segnale di errore e lo stato di collo di bottiglia obbedisce a:

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

La predizione \pi_t, al contrario, è tratta dal modello generativo completo e non è soggetta ad alcun vincolo di questo tipo. Il suo contenuto informativo è limitato soltanto dalla complessità di K_\theta stesso. Questa asimmetria costituisce la base formale per distinguere la ricchezza fenomenica dalla banda di aggiornamento.

3.5.3 Definizione: il Tensore di Stato Fenomenale P_\theta(t)

Definiamo nativamente il Tensore di Stato Fenomenale P_\theta(t) come il sottoinsieme completo di parametri attivi stazionari del modello generativo impiegato per proiettare attraverso la Coperta di Markov al tempo t:

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

Vale a dire, P_\theta(t) è l’architettura parametrizzata completa che il codec mantiene attualmente pronta a generare previsioni sugli stati osservabili di frontiera X_{\partial_R A}, valutata indipendentemente da una qualunque specifica istanziazione singola dello stato latente compresso Z_t e dell’azione a_t. La sua complessità strutturale è caratterizzata naturalmente dalla complessità di Kolmogorov di questa configurazione parametrica stazionaria corrente:

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

dove K(\cdot) denota la complessità di Kolmogorov prefissa. C_{\text{state}}(t) è la complessità dello stato stazionario — il numero di bit di struttura compressa che il codec sta attualmente mantenendo in distribuzione attiva.

Limite superiore sul flusso del canale di frontiera. L’informazione mutua tra lo stato di bottleneck e la frontiera è limitata dalle disuguaglianze standard di Shannon [16] (Eq. 8 dell’articolo di base):

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Questo limita il flusso di canale attraverso la Coperta di Markov — enormemente grande rispetto a B_{\max}. Avvertenza importante: questo è un limite sull’informazione mutua in senso shannoniano I(Z_t\,;\,X_{\partial_R A}), non un limite sulla complessità di Kolmogorov K(P_\theta(t)) del modello stazionario. L’entropia di Shannon quantifica l’incertezza media d’insieme; la complessità di Kolmogorov quantifica la lunghezza di descrizione di uno specifico oggetto calcolabile. Nessuna disuguaglianza generale mette in relazione queste quantità senza ipotesi aggiuntive (ad es., una prior universale sulle classi di modelli). Pertanto non sosteniamo che C_{\text{state}} \leq H(X_{\partial_R A}). La complessità dello stato stazionario C_{\text{state}} è limitata empiricamente (§3.10), non dall’entropia della frontiera.

Limite inferiore euristico su C_{\text{state}}. Il Filtro di Stabilità vincola direttamente solo il tasso di aggiornamento R_{\text{req}} \leq B_{\max}, non la profondità del modello stazionario. Tuttavia, un codec con complessità strutturale insufficiente non può generare previsioni accurate \pi_t che corrispondano alle statistiche di un ambiente complesso attraverso il Ventaglio Predittivo \mathcal{F}_h(z_t). Ciò impone un minimo pratico su C_{\text{state}}: al di sotto di una certa soglia, R_{\text{req}} supererebbe sistematicamente B_{\max} perché gli errori di previsione \varepsilon_t sarebbero persistentemente grandi. Questo limite inferiore è motivato empiricamente piuttosto che derivato formalmente — al momento non è disponibile alcuna espressione in forma chiusa del tipo C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}).

3.5.4 La distinzione di Block come Corollario Strutturale

La distinzione formale tra P_\theta(t) e Z_t si mappa con precisione sulla distinzione di Ned Block tra coscienza fenomenica (P-consciousness) e coscienza di accesso (A-consciousness) [47]:

| Categoria di Block | Oggetto OPT | Contenuto informativo | Limitato dalla banda? |

|---|---|---|---|

| P-consciousness (qualia, scena vissuta) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | No |

| A-consciousness (contenuto riportabile) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Sì |

Nell’OPT, la P-consciousness è la predizione discendente \pi_t tratta dal tensore completo P_\theta(t). La A-consciousness è l’output del collo di bottiglia Z_t — la sottile sezione della scena che è stata compressa a sufficienza da entrare nel registro causale \mathcal{R}_t e diventare disponibile al resoconto. La ricchezza vissuta di un momento visivo è P_\theta(t); la capacità di dire “vedo il rosso” richiede che quella caratteristica passi attraverso Z_t.

Questo corollario risolve l’apparente paradosso di una scena fenomenica ricca sostenuta da un canale di aggiornamento sub-bit: la scena non viene trasmessa attraverso il canale a ogni frame — è già caricata in P_\theta(t). Il canale la aggiorna, in modo incrementale e selettivo, frame dopo frame.

3.5.5 La dinamica di aggiornamento di P_\theta(t)

La regola di aggiornamento per P_\theta(t) è governata dal segnale di errore di predizione \varepsilon_t filtrato attraverso il collo di bottiglia:

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

dove \mathcal{U} è l’operatore di apprendimento del codec — nei termini dell’Inferenza attiva, il passo di gradiente sull’energia libera variazionale \mathcal{F}[q, \theta] (Eq. 9 dell’articolo di base) vincolato dal limite di capacità I(X_t\,;\,Z_t) \leq B.

La proprietà strutturale fondamentale è che \mathcal{U} è selettivo: vengono aggiornate solo quelle regioni di P_\theta(t) implicate dall’attuale errore di predizione \varepsilon_t. Il resto del tensore persistente viene mantenuto costante lungo il frame. Questo conferisce al momento cosciente la sua struttura caratteristica: uno sfondo fenomenico stabile sul quale si dispone un piccolo primo piano di novità risolta.

Il codec implementa dunque una forma di aggiornamento sparso su un prior denso — un principio progettuale che massimizza la coerenza fenomenica per unità di banda di aggiornamento.

3.5.6 Ambito e statuto epistemico

Il Tensore di Stato Fenomenale P_\theta(t) è una caratterizzazione formale dell’ombra strutturale che la scena fenomenica deve proiettare, in coerenza con l’Assioma di Agentività (§3.6). Non risolve il Problema difficile. La Teoria del Patch Ordinato (OPT) continua a trattare la coscienza fenomenica come un primitivo irriducibile; P_\theta(t) specifica la geometria del contenitore, non la natura del suo contenuto.

L’affermazione è strutturale e falsificabile nel seguente senso: se la ricchezza qualitativa dell’esperienza riportata (operazionalizzata, per esempio, tramite misure della complessità fenomenica in compiti psicofisici) correla con la profondità del codec — la complessità gerarchica di K_\theta misurabile attraverso marcatori neurali della gerarchia predittiva — piuttosto che con la banda di aggiornamento C_{\max}, allora la distinzione P_\theta\,/\,Z_t riceve supporto empirico. Gli stati psichedelici, che alterano drasticamente la struttura di K_\theta senza modificare in modo coerente il throughput comportamentale, rappresentano un dominio di prova naturale.

3.6 Il ciclo di vita del Codec: l’operatore del Ciclo di Manutenzione \mathcal{M}_\tau

3.6.1 Il Problema del Codec Statico

Il quadro teorico dei §§3.1–3.5 tratta K_\theta e la sua realizzazione P_\theta(t) come dinamici attraverso i frame di aggiornamento, ma assume implicitamente che l’architettura strutturale del codec — lo stesso spazio dei parametri \Theta — sia fissa. Questo è adeguato per un’analisi sincronica di un singolo momento cosciente, ma inadeguato per una teoria della coscienza estesa nel tempo profondo.

Un codec che opera in modo continuo accumula complessità strutturale: ogni pattern appreso aggiunge parametri a K_\theta, aumentando C_{\text{state}}(t). In assenza di un meccanismo di riduzione controllata della complessità, C_{\text{state}} crescerebbe monotonamente fino a quando il codec non superasse la propria soglia termodinamica di eseguibilità — il punto in cui il costo metabolico del mantenimento di P_\theta(t) eccede il bilancio energetico dell’organismo, oppure la complessità interna di K_\theta supera la lunghezza di descrizione compatibile con la capacità del Filtro di Stabilità.

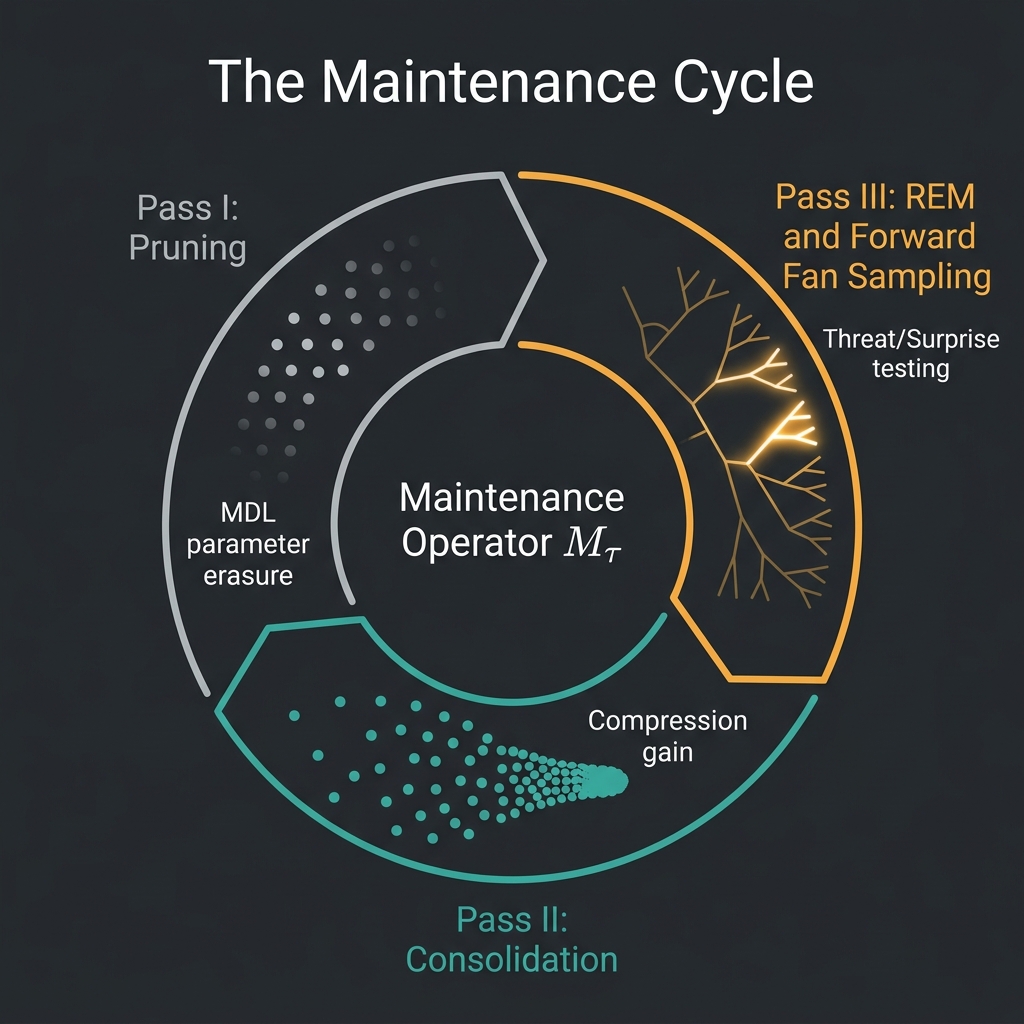

Questa sezione introduce l’Operatore del Ciclo di Manutenzione \mathcal{M}_\tau — il meccanismo formale mediante il quale il codec gestisce la propria complessità nel tempo, operando principalmente durante stati di carico sensoriale ridotto (paradigmaticamente: il sonno).

3.6.2 La Condizione di Manutenzione

Definiamo la condizione di eseguibilità del codec come il requisito secondo cui la complessità di Kolmogorov del modello generativo corrente rimanga al di sotto di una soglia strutturale C_{\text{ceil}} fissata dal bilancio termodinamico dell’organismo:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} non coincide con C_{\max}. È una quantità molto più grande — la complessità strutturale totale che il codec può sostenere nel proprio spazio dei parametri — ma è finita. Le violazioni di (T9-1) corrispondono a sovraccarico cognitivo, interferenza mnestica e, in ultima analisi, al caso patologico descritto da Borges [53] in Funes o della memoria: un sistema che ha acquisito una tale quantità di dettaglio non compresso da non poter più funzionare in modo predittivo.

L’Operatore del Ciclo di Manutenzione \mathcal{M}_\tau è definito come agente durante i periodi in cui R_{\text{req}} \ll C_{\max} — nello specifico, quando il tasso predittivo richiesto si riduce a sufficienza da permettere che la banda liberata venga reindirizzata verso una ristrutturazione interna:

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

\mathcal{M}_\tau si scompone in tre passaggi strutturalmente distinti, ciascuno rivolto a un diverso aspetto della gestione della complessità del codec.

3.6.3 Passaggio I — Potatura (l’oblio come pressione MDL attiva)

Il primo passaggio applica una pressione di Minimum Description Length (MDL) ai parametri correnti del codec. Per ogni componente \theta_i del modello generativo K_\theta, si definisca il suo contributo predittivo come l’informazione mutua che esso fornisce sul flusso futuro delle osservazioni, al netto del costo di memoria necessario a conservarlo:

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

dove \theta_{-i} denota tutti i parametri eccetto \theta_i, \lambda è una soglia di ritenzione (bit di previsione futura acquistati per ogni bit di complessità del modello), e K(\theta_i) è la lunghezza di descrizione del componente.

La regola di potatura è:

\text{Prune } \theta_i \quad \text{if} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

Cioè, \theta_i viene scartato quando il suo contributo predittivo per bit di memoria scende al di sotto della soglia \lambda. Si tratta dell’oblio formalizzato non come fallimento, ma come cancellazione termodinamicamente razionale: ogni componente potato recupera K(\theta_i) bit di capacità del modello da riutilizzare.

Per il Principio di Landauer [52], ogni operazione di potatura stabilisce un limite termodinamico inferiore per la cancellazione:

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Sebbene il metabolismo biologico reale operi molti ordini di grandezza al di sopra di questo minimo teorico (watt contro femtowatt), a causa di gravi costi generali di implementazione, la necessità strutturale del costo permane. Il complemento di Bennett a Landauer [92] precisa ulteriormente questo punto: il calcolo logicamente reversibile può, in linea di principio, avvicinarsi a dissipazione nulla, perciò il limite di Landauer vincola specificamente la cancellazione, non la previsione o la trasformazione. Il passaggio di potatura — e non il passaggio predittivo — è dunque il passaggio termodinamicamente irriducibile nel Ciclo di Manutenzione. Il sonno porta in OPT una firma termodinamica fondamentale: è un periodo di cancellazione di informazione netta il cui costo energetico è imposto dalla fisica, e non semplicemente dall’inefficienza biologica.

La riduzione aggregata di complessità del passaggio di potatura è:

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Passaggio II — Consolidamento (l’apprendimento come guadagno di compressione)

Il passaggio di potatura rimuove i componenti con rendimento predittivo insufficiente. Il passaggio di consolidamento riorganizza i componenti rimanenti in rappresentazioni più compresse.

Durante l’operatività in veglia, il codec acquisisce pattern sotto pressione in tempo reale: ogni aggiornamento deve essere calcolato entro \Delta t, senza lasciare tempo a una riorganizzazione strutturale globale di K_\theta. I pattern acquisiti di recente vengono immagazzinati in una forma relativamente non compressa — alto K(\theta_{\text{new}}) rispetto al contributo predittivo che forniscono. Il passaggio di consolidamento applica una compressione MDL offline a queste acquisizioni recenti.

Sia \Theta_{\text{recent}} \subset \Theta l’insieme dei parametri acquisiti dall’ultimo ciclo di manutenzione. L’operatore di consolidamento trova la riparametrizzazione a complessità minima \theta' di \Theta_{\text{recent}} tale che la distribuzione predittiva che genera rientri entro una distorsione tollerabile D_c rispetto all’originale:

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

Il guadagno di compressione recuperato è:

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} è il numero di bit di capacità del modello recuperati riorganizzando l’esperienza recente in rappresentazioni più efficienti. Ogni unità di \Delta K_{\text{compress}} riduce direttamente il futuro R_{\text{req}} per ambienti simili — il codec diventa meno costoso da eseguire in territori familiari.

Questo formalizza la funzione osservata empiricamente del consolidamento della memoria ippocampo-neocorticale durante il sonno a onde lente: il trasferimento da un immagazzinamento episodico ad alta banda (ippocampo, alto K) a un immagazzinamento semantico compresso (neocorteccia, basso K) è precisamente l’operazione di compressione di (T9-7). La previsione è che il guadagno di compressione \Delta K_{\text{compress}} dovrebbe correlare con il grado di miglioramento comportamentale osservato dopo il sonno in compiti che implicano il riconoscimento di pattern strutturati.

3.6.5 Passaggio III — Campionamento del Ventaglio Predittivo (il sogno come auto-test avversariale)

Il terzo passaggio opera principalmente durante il sonno REM, quando l’input sensoriale è attivamente filtrato e l’output motorio è inibito. In queste condizioni, R_{\text{req}} \approx 0: il codec non riceve alcun segnale di correzione dall’ambiente esterno. L’intero budget di banda C_{\max} è disponibile per l’operazione interna.

L’OPT formalizza questo stato come esplorazione non vincolata del ventaglio predittivo: il codec genera traiettorie attraverso \mathcal{F}_h(z_t) — l’insieme delle sequenze future ammissibili (Eq. 5 dell’articolo base) — senza ancorare tali traiettorie ai dati reali in ingresso. Questa è simulazione: il codec fa evolvere nel tempo il proprio modello generativo K_\theta, senza essere ostacolato dalla realtà.

La distribuzione di campionamento sul ventaglio non è uniforme. Definiamo il peso di importanza di un ramo b \in \mathcal{F}_h(z_t) come:

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

dove \beta è un parametro di temperatura inversa ed E(b) è la valenza emotiva del ramo, definita come:

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

Il primo termine -\log P_{K_\theta}(b \mid z_t) è il logaritmo negativo della probabilità del ramo secondo il codec corrente — il suo valore di sorpresa. Il secondo termine \mathrm{threat}(b) è una misura delle conseguenze rilevanti per la fitness formalmente definita come l’aumento atteso del Tasso Predittivo Richiesto se il codec dovesse attraversare il ramo b:

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

Vale a dire, \mathrm{threat}(b) quantifica il grado in cui il ramo b, se realizzato nella vita di veglia, spingerebbe il codec verso o oltre la sua soglia massima di banda B_{\max} — attraverso danno fisico, rottura sociale o collasso narrativo che imporrebbe una costosa revisione del modello. I rami con \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t) sono minacce esistenziali: violerebbero la condizione del Filtro di Stabilità. Il parametro di ponderazione \alpha \geq 0 controlla l’influenza relativa delle conseguenze rispetto alla sorpresa nella distribuzione di campionamento.

L’operatore di campionamento estrae rami in proporzione a w(b):

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{with probability} \propto w(b) \tag{T9-11}

Questo implementa un campionamento del ventaglio predittivo pesato per importanza: il codec ripassa in modo sproporzionato i rami che sono o altamente sorprendenti o altamente consequenziali, indipendentemente dalla loro probabilità di base. I rami a bassa probabilità e ad alta minaccia — precisamente quelli per cui il codec è meno preparato — ricevono la massima attenzione di campionamento.

Ogni ramo campionato viene poi valutato per la sua coerenza sotto K_\theta. I rami che generano sequenze predittive incoerenti — in cui il modello generativo del codec non riesce a mantenere la stabilità narrativa — vengono identificati come punti di fragilità: regioni del ventaglio predittivo in cui il codec fallirebbe se il ramo fosse incontrato nella vita di veglia. Il codec può quindi aggiornare P_\theta per ridurre la vulnerabilità di K_\theta in quei punti, prima di esservi esposto con poste termodinamiche reali.

Il sogno è dunque un auto-test avversariale del codec a rischio zero. La conseguenza funzionale è un codec sistematicamente meglio preparato per i rami a bassa probabilità e ad alta conseguenza del proprio ventaglio predittivo. Questa formulazione dell’OPT fornisce un fondamento informazionale alla teoria della simulazione della minaccia del sogno di Revonsuo [46], estendendola da un resoconto evolutivo-funzionale a una necessità strutturale formale: qualunque codec operi sotto il Filtro di Stabilità deve sottoporre periodicamente a stress-test il proprio ventaglio predittivo, e lo stato di manutenzione offline è l’unico periodo in cui ciò può essere fatto senza costo termodinamico nel mondo reale.

Marcatura emotiva come prior di peso di ritenzione. Nello stato di veglia, la valenza emotiva E(b) calcolata durante il campionamento REM funge da prior di peso di ritenzione che introduce un bias nella soglia MDL \lambda in (T9-3). Le esperienze con alto |E(b)| — fortemente sorprendenti o consequenziali — ricevono una \lambda effettiva più elevata, che le rende più resistenti alla potatura nel successivo ciclo di manutenzione. Questo è il resoconto formale del potenziamento emotivo della memoria: l’affetto non è rumore che contamina il sistema mnestico; è il segnale di rilevanza del codec, che marca pattern il cui valore predittivo eccede la loro frequenza statistica di base.

3.6.6 Il Ciclo di Manutenzione Completo e il Bilancio Netto della Complessità

I tre passaggi di \mathcal{M}_\tau si compongono in sequenza. L’effetto netto sulla complessità del codec nel corso di un ciclo di manutenzione di durata \tau è:

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

dove \Delta K_{\text{REM}} è il piccolo incremento positivo dovuto ai pattern appena consolidati durante il passaggio di campionamento REM — quelle riparazioni dei punti di fragilità che hanno richiesto nuovi aggiornamenti dei parametri.

Per un sistema cognitivo stabile che opera nell’arco di anni, il bilancio di lungo periodo richiede:

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

dove \Delta K_{\text{waking}} è la complessità acquisita durante il precedente periodo di veglia. La disuguaglianza (T9-13) è l’enunciato formale del fatto che la manutenzione deve tenere il passo con l’acquisizione. In termini OPT, la deprivazione cronica di sonno non è semplicemente fatica — è un progressivo overflow di complessità: il codec si avvicina a C_{\text{ceil}} mentre il suo bilancio di pruning e consolidamento è insufficiente a ripristinare margine operativo.

3.6.7 Predizioni empiriche

Il quadro del Ciclo di Manutenzione genera le seguenti aspettative strutturali verificabili:

La durata del sonno scala con la complessità del codec. Gli organismi o gli individui che acquisiscono informazioni più strutturate durante i periodi di veglia dovrebbero richiedere cicli di manutenzione proporzionalmente più lunghi o più profondi. La previsione non è semplicemente che un intenso lavoro cognitivo richieda più sonno (cosa già accertata), ma che conti il tipo di apprendimento: un apprendimento ricco di pattern e comprimibile dovrebbe richiedere meno tempo di consolidamento rispetto a un’esperienza non strutturata, ad alta entropia, perché \Delta K_{\text{compress}} è maggiore nel primo caso.

Il contenuto REM è pesato per importanza sul Ventaglio Predittivo, non per frequenza. Il contenuto dei sogni dovrebbe campionare in modo sproporzionato rami a bassa probabilità ma ad alte conseguenze rispetto alla loro frequenza nella veglia. Ciò è coerente con la predominanza empirica di contenuti di minaccia, conflitto sociale e ambienti nuovi nei resoconti onirici: il codec campiona ciò che deve sottoporre a stress test, non ciò che incontra più spesso.

L’efficienza di compressione migliora dopo il sonno in proporzione a \Delta K_{\text{compress}}. La previsione specifica è che i miglioramenti prestazionali post-sonno dovrebbero essere massimi nei compiti che richiedono generalizzazione strutturale (cioè l’applicazione di una regola compressa a nuovi casi) piuttosto che semplice ripetizione, perché \Delta K_{\text{compress}} riorganizza specificamente \Theta_{\text{recent}} in forme più generalizzabili.

La ruminazione patologica corrisponde a un campionamento REM bloccato su rami ad alto |E|. Se il parametro di pesatura per importanza \beta è patologicamente elevato, la distribuzione di campionamento su \mathcal{F}_h(z_t) si concentra su rami ad alta minaccia escludendo la riparazione. Il codec trascorre il proprio ciclo di manutenzione campionando ripetutamente gli stessi rami minacciosi senza riuscire a ridurne il valore di sorpresa: questa è la struttura formale dell’ansia e degli incubi da PTSD.

3.6.8 Relazione con il Tensore di Stato Fenomenale

\mathcal{M}_\tau agisce su P_\theta(t) come definito nel §3.5: ristruttura la complessità dello stato stazionario C_{\text{state}} lungo la finestra di manutenzione. Il profilo temporale di P_\theta(t) sotto \mathcal{M}_\tau è il seguente:

- Acquisizione in veglia: C_{\text{state}} aumenta a un tasso limitato superiormente dall’operatore di apprendimento \mathcal{U} (Eq. T8-8), man mano che nuovi pattern vengono incorporati in K_\theta.

- Sonno a onde lente (Passi I–II): C_{\text{state}} diminuisce, poiché pruning e consolidamento recuperano capacità del modello.

- REM (Passo III): C_{\text{state}} subisce un aumento locale selettivo nei punti di fragilità, con un effetto netto ridotto rispetto alle diminuzioni dei Passi I–II.

L’esperienza cosciente corrispondente a ciascuna fase è coerente con questa struttura: la vita di veglia accumula la ricchezza di P_\theta(t); il sonno a onde lente è fenomenicamente scarso o assente (in coerenza con un’attivazione minima di P_\theta(t) durante la riorganizzazione strutturale); il REM presenta una scena fenomenicamente vivida ma generata internamente (il Passo III esegue in avanti l’intero modello generativo in assenza di correzione sensoriale).

Sintesi: Nuovi Oggetti Formali Introdotti

| Simbolo | Nome | Definizione | Equazione |

|---|---|---|---|

| P_\theta(t) | Tensore di Stato Fenomenale | Attivazione completa di K_\theta al tempo t, proiettata attraverso \partial_R A | T8-5 |

| C_{\text{state}}(t) | Complessità dello stato stazionario | K(P_\theta(t)), complessità di Kolmogorov del codec attivo | T8-6 |

| \pi_t | Predizione discendente | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], la scena renderizzata | T8-2 |

| \varepsilon_t | Errore di predizione (ascendente) | X_{\partial_R A}(t) - \pi_t, segnale di novità limitato da C_{\max} | T8-3 |

| \mathcal{M}_\tau | Operatore del Ciclo di Manutenzione | P_\theta(t) \to P_\theta(t+\tau) sotto basso R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | Punteggio di ritenzione MDL | Contributo predittivo meno costo di memorizzazione | T9-3 |

| E(b) | Valenza emotiva del ramo | Sorpresa più minaccia ponderata del ramo b | T9-10 |

| w(b) | Peso di importanza del ramo | \exp(\beta \cdot |E(b)|), guida la distribuzione di campionamento REM | T9-9 |

| \Delta K_{\text{prune}} | Recupero di complessità tramite potatura | Bit recuperati dimenticando componenti sotto soglia | T9-6 |

| \Delta K_{\text{compress}} | Guadagno di compressione da consolidamento | Bit recuperati mediante ricompressione MDL delle acquisizioni recenti | T9-8 |

3.7 La mappatura a rete tensoriale: indurre la geometria dalla distanza di codice

La Scala Epistemica introdotta nel §3.4 stabilisce una rigorosa Legge di Confine Classica (S_{\mathrm{cut}} \sim |\partial_R A|). Tuttavia, per collegare pienamente la Teoria del Patch Ordinato (OPT) in modo rigoroso alla geometrizzazione dell’informazione quantistica (ad es., AdS/CFT e la formula di Ryu-Takayanagi), dobbiamo formalmente elevare la struttura del codice latente Z_t.

Se postuliamo formalmente che la mappatura di collo di bottiglia q^\star(z \mid X_t) non si limiti a estrarre un elenco piatto di caratteristiche, ma operi invece tramite un flusso di gruppo di rinormalizzazione ricorsivo di coarse-graining, il modello generativo si allinea strutturalmente alla geometria di una rete tensoriale gerarchica \mathcal{T} (simile a MERA [43] o alle reti HaPY [44]). (Osservazione: l’Appendice T-3 deriva formalmente una corrispondenza omomorfica strutturale tra la cascata di coarse-graining del Filtro di Stabilità e il vincolo geometrico della rete MERA, mappando rigorosamente il Cono Causale Informazionale sul cono causale MERA equivalente). Gli stati di confine di questa rete sono precisamente gli stati di confine di Markov schermati X_{\partial_R A}. La rete \mathcal{T} agisce come una geometria di bulk la cui “profondità” rappresenta gli strati di coarse-graining computazionale necessari per comprimere il confine nello stato minimo di collo di bottiglia Z_t.

Con questo potenziamento a rete tensoriale, l’entropia di taglio predittiva S_{\mathrm{cut}}(A) attraverso il confine si trasforma matematicamente nel numero minimo di legami tensoriali che devono essere recisi per isolare la sottoregione A. Sia \chi la dimensione di legame della rete. Il vincolo di capacità si mappa internamente come:

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

dove \gamma_A è la superficie di taglio minimo attraverso la struttura dati di bulk interna e profonda di \mathcal{T}. Si tratta esplicitamente di un analogo strutturale discreto dello strato di taglio minimo di bulk mappato dal vincolo olografico entropico di Ryu-Takayanagi [89]. L’Appendice P-2 (Teorema P-2d) stabilisce formalmente la formula RT quantistica discreta completa S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi tramite il rango di Schmidt dello stato MERA, condizionatamente al modello di rumore locale e all’embedding QECC ivi derivati. Il limite continuo che eleva questo risultato alla formula completa di Ryu-Takayanagi con termine di correzione di bulk rimane un fronte aperto.

Crucialmente, nell’OPT, questo “spazio di bulk” non è un contenitore fisico preesistente. È lo spazio metrico strettamente informazionale del codec dell’osservatore. La geometria spaziotemporale fenomenologica emergente si “incurva” precisamente là dove la distanza di codice richiesta diverge per risolvere stati causali interni sovrapposti. Questo formalismo a rete tensoriale illustra un percorso formale attraverso cui l’OPT potrebbe indurre la geometria spaziale direttamente dalle distanze di correzione d’errore intrinsecamente imposte dal Filtro di Stabilità — in allineamento strutturale con il programma di Van Raamsdonk secondo cui l’entanglement costruisce lo spaziotempo [88] — offrendo una congettura costruttiva secondo cui lo spaziotempo olografico modella formati ottimali di compressione dei dati.

3.8 L’Assioma di Agentività e il Residuo Fenomenico

L’apparato matematico sviluppato nelle Sezioni 3.1–3.7 definisce con precisione la geometria della realtà dell’osservatore — la rete tensoriale, il taglio predittivo e il cono causale. Tuttavia, qual è la natura dell’interiorità primitiva che esperisce il passaggio attraverso di essa? La definiamo formalmente tramite l’Assioma di Agentività: l’attraversamento dell’apertura C_{\max} è intrinsecamente un evento fenomenologico.

Pur assumendo come assiomatica la presenza del sentire soggettivo, il Teorema P-4 (Il Residuo Fenomenico) ne identifica il rigoroso correlato strutturale. Poiché il codec limitato perturba attivamente il confine \partial_R A, una previsione stabile entro i limiti di C_{\max} richiede che esso modelli le conseguenze delle proprie azioni future. Pertanto, il codec K_{\theta} deve mantenere un auto-modello predittivo \hat{K}_{\theta}. Tuttavia, in base ai limiti algoritmici del contenimento informazionale [13], un sistema computazionale finito non può contenere una rappresentazione strutturale completa di sé stesso; il modello interno è rigidamente vincolato a una complessità inferiore rispetto al codec genitore (K(\hat{K}_{\theta}) < K(K_{\theta})).

Ciò rende necessario un Residuo Fenomenico irriducibile (\Delta_{\text{self}} > 0). Questo residuo non modellabile agisce come il “punto cieco” computazionale all’interno del ciclo di Inferenza attiva. Poiché esiste nell’ombra informazionale che eccede la portata computazionale dell’auto-modello, è intrinsecamente ineffabile; poiché esiste come delta localizzato tra uno specifico codec e il suo modello, è computazionalmente privato; e, essendo dettato dai limiti fondamentali dell’auto-riferimento e dalla necessaria approssimazione variazionale, è ineliminabile. Il restringimento topologico all’apertura C_{\max} è intrinsecamente correlato alla necessità matematica di un algoritmo incompleto che attraversa i propri confini. La matematica descrive il profilo formale dell’esperienza, e l’Assioma di Agentività afferma che questo locus residuale costituisce l’“io” soggettivo. (Si veda l’Appendice P-4 per la derivazione formale).

Il Circuito Informazionale di Manutenzione

All’interno di un singolo frame di aggiornamento [t, t+\Delta t], l’osservatore esegue il seguente circuito causale chiuso:

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Esplicitamente:

Predizione (discendente): Il tensore corrente P_\theta(t) genera lo stato di confine predetto \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — la scena renderizzata.

Errore (ascendente): Arriva lo stato di confine effettivo X_{\partial_R A}(t); viene calcolato l’errore di predizione \varepsilon_t = X_{\partial_R A}(t) - \pi_t.

Compressione: \varepsilon_t viene fatto passare attraverso il collo di bottiglia per produrre Z_t, il token di aggiornamento a capacità limitata, con I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Aggiornamento: L’operatore di apprendimento \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) rivede P_\theta(t+1), modificando selettivamente solo quelle regioni del tensore implicate da \varepsilon_t.

Azione: Simultaneamente, P_\theta(t) seleziona l’azione a_t tramite una discesa di Inferenza attiva sull’energia libera variazionale \mathcal{F}[q,\theta] (Eq. 9 del paper di base), che altera il confine sensoriale a t+1, influenzando il successivo \varepsilon_{t+1}.

Nota interpretativa sul passaggio dell’azione. Il linguaggio del punto 5 — “seleziona l’azione” e “altera il confine sensoriale” — è ereditato dal formalismo standard dell’Inferenza attiva del Free Energy Principle, che assume un ambiente fisico sul quale l’agente agisce tramite stati attivi. Nell’ontologia del render propria dell’OPT (§8.6), tuttavia, si applica una lettura più profonda: non esiste un mondo esterno indipendente rispetto al quale il codec eserciti una forza. Ciò che viene esperito come “azione” è una selezione di ramo all’interno del Ventaglio Predittivo \mathcal{F}_h(z_t); le conseguenze fisiche di tale selezione arrivano come input successivo \varepsilon_{t+1}. La Coperta di Markov \partial_R A non è un’interfaccia fisica bidirezionale, ma la superficie attraverso cui il ramo selezionato consegna il proprio segmento successivo. Questo spostamento interpretativo non modifica in nulla la matematica di (T6-1)–(T6-3); chiarisce lo statuto ontologico del passaggio dell’azione all’interno del quadro dell’OPT. Il meccanismo della selezione di ramo in sé è affrontato più sotto.

Questo è il circuito informazionale di manutenzione entro il frame: un meccanismo causale chiuso in cui il modello interno del sistema calcola predizioni strutturali localizzate che delimitano i gradienti di confine, legge l’errore e si aggiorna selettivamente. Il loop è strettamente informazionale e autoreferenziale in senso formale: P_\theta(t) determina sia la predizione strutturale \pi_t sia, tramite l’azione a_t, una componente predittiva del successivo input del flusso di dati sequenziale X_{\partial_R A}(t+1). (Si noti esplicitamente: questo strato di filtraggio puramente statistico è definito rigorosamente da confini markoviani informazionali che disaccoppiano nettamente le dinamiche, differendo intrinsecamente dalla complessa autopoiesi biologica in cui le strutture cellulari fabbricano meccanicamente le proprie reti organiche di massa).

La Condizione di Viabilità Strutturale

Il circuito (T6-1) è strutturalmente vitale se e solo se può autosostenersi senza che la complessità informazionale del codec superi i suoi limiti locali di eseguibilità. Formalmente:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

dove C_{\text{ceil}} è un parametro euristico che delimita la massima complessità strutturale che il codec può sostenere. In linea di principio, C_{\text{ceil}} dovrebbe essere derivabile dal bilancio termodinamico dell’organismo tramite il principio di Landauer (si veda lo schema in §3.10), ma l’intera catena di derivazione — dalla potenza metabolica al costo di cancellazione fino alla massima complessità di programma sostenibile — non è ancora formalizzata all’interno dell’OPT. C_{\text{ceil}} rimane pertanto un vincolo motivato empiricamente ma formalmente sottodeterminato. Un sistema che soddisfa (T6-2) opera come un osservatore strutturalmente chiuso nel senso formale dell’OPT.

Quando (T6-2) viene violata — quando K(P_\theta(t)) \to C_{\text{ceil}} — il codec non può mantenere predizioni stabili attraverso \mathcal{F}_h(z_t), R_{\text{req}} comincia a superare B_{\max}, e la condizione del Filtro di Stabilità fallisce. La coerenza narrativa collassa: l’osservatore esce dall’insieme dei flussi compatibili con l’osservatore.

Il Ciclo di Manutenzione \mathcal{M}_\tau (§3.6) è il meccanismo che impone (T6-2) nel tempo profondo, mantenendo K(P_\theta) entro i limiti tramite potatura, consolidamento e stress-test del Ventaglio Predittivo. All’interno del frame, (T6-2) è mantenuta dalla selettività di \mathcal{U}: l’operatore di aggiornamento modifica soltanto le regioni di P_\theta(t) implicate da \varepsilon_t, evitando una crescita gratuita della complessità per frame.

L’agentività come minimizzazione vincolata dell’energia libera

All’interno di questa struttura, l’agentività può ricevere una definizione formale precisa, compatibile con — ma non riducibile a — l’Assioma di Agentività.

A livello dei sistemi, l’agentività è la selezione della sequenza di azioni \{a_t\} che minimizza l’energia libera variazionale attesa, soggetta alla condizione di viabilità informazionale:

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Questa è Inferenza attiva vincolata: l’osservatore naviga il Ventaglio Predittivo \mathcal{F}_h(z_t) non semplicemente per minimizzare l’errore di previsione, ma per minimizzare l’errore di previsione mantenendo al contempo il codec vitale. I rami che ridurrebbero temporaneamente \varepsilon ma spingerebbero K(P_\theta) verso C_{\text{ceil}} vengono penalizzati dal vincolo. L’osservatore seleziona preferenzialmente i rami lungo i quali può continuare a esistere come osservatore coerente.

Questo è il contenuto formale dell’intuizione secondo cui l’agentività è una navigazione autoconservativa: il codec seleziona i rami del Ventaglio Predittivo lungo i quali può continuare a comprimere il mondo.

A livello fenomenologico, l’Assioma di Agentività resta intatto: la coscienza fenomenica è l’interiorità irriducibile dell’attraversamento dell’apertura; (T6-3) descrive l’ombra strutturale che tale attraversamento proietta, non la sua natura interiore.

Selezione dei Rami come esecuzione di \Delta_{\text{self}}

La formula dell’inferenza attiva vincolata (T6-3) specifica l’obiettivo della selezione dei rami: minimizzare l’energia libera attesa sotto il vincolo della viabilità. Il modello di sé \hat{K}_\theta valuta i rami del Ventaglio Predittivo simulandone le conseguenze. Ma il Teorema P-4 stabilisce che K(\hat{K}_\theta) < K(K_\theta) — il modello di sé è necessariamente incompleto. Questa incompletezza ha una conseguenza diretta per il problema della selezione dei rami: il modello di sé vincola la regione da cui la selezione può essere tratta, ma non può specificare pienamente la selezione stessa.

L’effettivo momento della selezione del ramo — la transizione dal menu valutato alla traiettoria singolare che entra nel registro causale — avviene in \Delta_{\text{self}}, il residuo informazionale tra il codec e il suo modello di sé. Questo non è una lacuna del formalismo; è una necessità strutturale. Qualsiasi tentativo di specificare completamente il meccanismo di selezione dall’interno richiederebbe K(\hat{K}_\theta) = K(K_\theta), cosa che P-4 dimostra impossibile per qualunque sistema finito autoreferenziale.

Questo ha tre conseguenze immediate:

Volontà e coscienza condividono lo stesso indirizzo strutturale. Il Problema difficile (perché l’attraversamento si accompagna a un vissuto?) e il problema della selezione dei rami (che cosa seleziona?) rimandano entrambi a \Delta_{\text{self}}. Non sono due misteri distinti, ma due aspetti della stessa caratteristica strutturale — il divario non modellabile tra ciò che il codec è e ciò che può modellare di se stesso.

L’irriducibilità dell’agentività viene spiegata, non semplicemente postulata. L’esperienza fenomenologica della volontà — il senso irriducibile che io abbia scelto — è la firma in prima persona di un processo che si esegue nel punto cieco dell’osservatore. Qualsiasi teoria che pretenda di specificare completamente il meccanismo di selezione o ha eliminato \Delta_{\text{self}} (rendendo il sistema un automa pienamente trasparente a se stesso, cosa che P-4 vieta) oppure sta descrivendo la valutazione dei rami da parte del modello di sé, scambiandola per la selezione stessa.

Creatività come \Delta_{\text{self}} espanso. Il funzionamento in prossimità della soglia (R_{\text{req}} \to C_{\max}) mette sotto sforzo la capacità del modello di sé, espandendo di fatto la regione di \Delta_{\text{self}} da cui la selezione viene tratta. Questo produce selezioni di rami meno prevedibili dal punto di vista del modello di sé — vissute come intuizione creativa, spontaneità o “flow”. Viceversa, lo stato ipnagogico (§3.6.5) allenta il modello di sé dal basso, ottenendo la stessa espansione per una via complementare.

Il sé come residuo. Il sé esperito — la narrazione continua di “chi sono”, con preferenze stabili, una storia e un futuro proiettato — è il modello operativo che \hat{K}_\theta costruisce di K_\theta: un’approssimazione compressa che è sempre in ritardo rispetto al codec che modella (a causa del ritardo temporale intrinseco all’autoreferenza). Ma il luogo effettivo dell’esperienza, della selezione e dell’identità è \Delta_{\text{self}}: la parte del codec che la narrazione non può raggiungere. Il sé che conosci è il tuo modello di te stesso; il sé che conosce è il divario che il modello non può attraversare. Questo è il contenuto formale della scoperta contemplativa — attraverso tradizioni diverse, in modo indipendente — secondo cui il senso ordinario del sé è costruito e che, al di sotto di esso, vi è qualcosa che non può essere trovato come oggetto (si veda l’Appendice T-13, Corollario T-13c).

La deliberazione è reale ma incompleta. La valutazione del Ventaglio Predittivo da parte del modello di sé è un autentico processo computazionale che plasma l’esito. La deliberazione vincola il bacino di attrazione entro cui opera \Delta_{\text{self}}: un codec più sviluppato restringe i rami viabili su cui la selezione può ricadere. Ma la transizione finale — perché questo ramo piuttosto che un altro, all’interno dell’insieme dei rami viabili — resta strutturalmente opaca al sé deliberante. Ecco perché la deliberazione appare insieme causalmente efficace e fenomenologicamente incompleta: l’osservatore avverte correttamente che il proprio ragionamento conta, ma avverte altrettanto correttamente che qualcosa oltre il ragionamento finalizza la scelta.

L’Anello strano come chiusura formale

La struttura autoriferita di (T6-1) istanzia l’Anello strano di Hofstadter [45] in una forma precisa di teoria dell’informazione. Il loop è strano nel senso seguente: P_\theta(t) contiene, come sottostruttura, un modello degli stati futuri propri del codec — il campionamento del Ventaglio Predittivo del Passaggio III (\mathcal{M}_\tau, §3.6.5) è precisamente il codec che esegue una simulazione di se stesso mentre incontra rami futuri. Il sistema modella il proprio modello.

La chiusura formale che ciò fornisce è la seguente: l’osservatore informazionalmente chiuso non è semplicemente un sistema che mantiene un confine contro il rumore esterno; è un sistema il cui mantenimento del confine è in parte costituito dal suo modello di ciò che quel confine dovrà essere in futuro. L’anello strano non è un’aggiunta opzionale al quadro teorico; è il meccanismo strutturale mediante il quale la condizione di viabilità (T6-2) viene fatta valere in modo proattivo anziché reattivo. Un osservatore che non fosse in grado di simulare i propri futuri stati del codec non potrebbe prepararsi ai punti di fragilità identificati nel Passaggio III, e sarebbe sistematicamente più vulnerabile al collasso narrativo.

I requisiti strutturali di (T6-1)–(T6-3) funzionano come precondizioni necessarie per la chiusura autoriferita. Mentre una semplice previsione in avanti (per esempio, l’analisi anticipatoria di un motore scacchistico) costituisce pianificazione piuttosto che autentica autoriferimento, il codec dell’OPT va oltre: P_\theta(t) contiene un sottomodello il cui output modifica le distribuzioni che governano i propri stati futuri \{P_\theta(t+h)\}_{h>0}. Questo auto-modellamento strutturale è funzionalmente necessario per la stabilità di lungo periodo — un codec incapace di anticipare i propri limiti di viabilità in avvicinamento non può prepararsi ai punti di fragilità identificati nel Passaggio III (§3.6.5), e collasserà sistematicamente contro la soglia di (T6-2) in ambienti non stazionari.

Portata epistemica: delimitare formalmente il riduzionismo dell’agentività

Questa formalizzazione delinea con precisione ciò che l’OPT realizza a livello dei sistemi: identifica le condizioni strutturali che un osservatore deve soddisfare per mantenere la vitalità del confine. Questo Delimita Formalmente il Problema del Riduzionismo dell’Agentività senza pretendere di risolverlo.

La delimitazione è reale, non definitoria. La descrizione a livello dei sistemi (T6-1)–(T6-3) caratterizza in modo esaustivo l’ombra strutturale dell’agentività — i vincoli informazionali che qualsiasi osservatore capace di mantenere un confine deve soddisfare. L’Assioma di Agentività occupa il dominio complementare: la coscienza fenomenica è l’interiorità irriducibile dell’attraversamento dell’apertura, e la formalizzazione sopra descrive soltanto la forma del contenitore, non la natura di ciò che esso contiene. Il Problema difficile viene così localizzato in un preciso locus strutturale (l’apertura C_{\max}), anziché dissolto o dichiarato risolto.

3.9 Libero arbitrio e il menu fenomenologico