Theorie der geordneten Patches (OPT): Ein informationstheoretischer Rahmen für Beobachterselektion und bewusstes Erleben

v3.4.0 — Mai 2026

DOI: 10.5281/zenodo.19300777

Urheberrecht: © 2025–2026 Anders Jarevåg.

Lizenz: Dieses Werk ist unter einer Creative

Commons Attribution-NonCommercial-ShareAlike 4.0 International

License lizenziert.

Zusammenfassung:

Wir präsentieren die Theorie der geordneten Patches (OPT), einen konstruktiven Rahmen, der strukturelle Entsprechungen zwischen algorithmischer Informationstheorie, Beobachterselektion und physikalischem Gesetz ableitet. OPT geht von zwei Primitiven aus: dem Solomonoffschen Universellen Semimaß \xi über endliche Beobachtungspräfixe und einer begrenzten kognitiven Kanalkapazität C_{\max}. Ein rein virtueller Stabilitätsfilter — der verlangt, dass die Erforderliche Prädiktive Rate des Beobachters R_{\mathrm{req}} C_{\max} nicht überschreitet — selektiert die seltenen kausal kohärenten Ströme, die mit bewussten Beobachtern kompatibel sind; innerhalb solcher Ströme bestimmt Aktive Inferenz die lokale Dynamik.

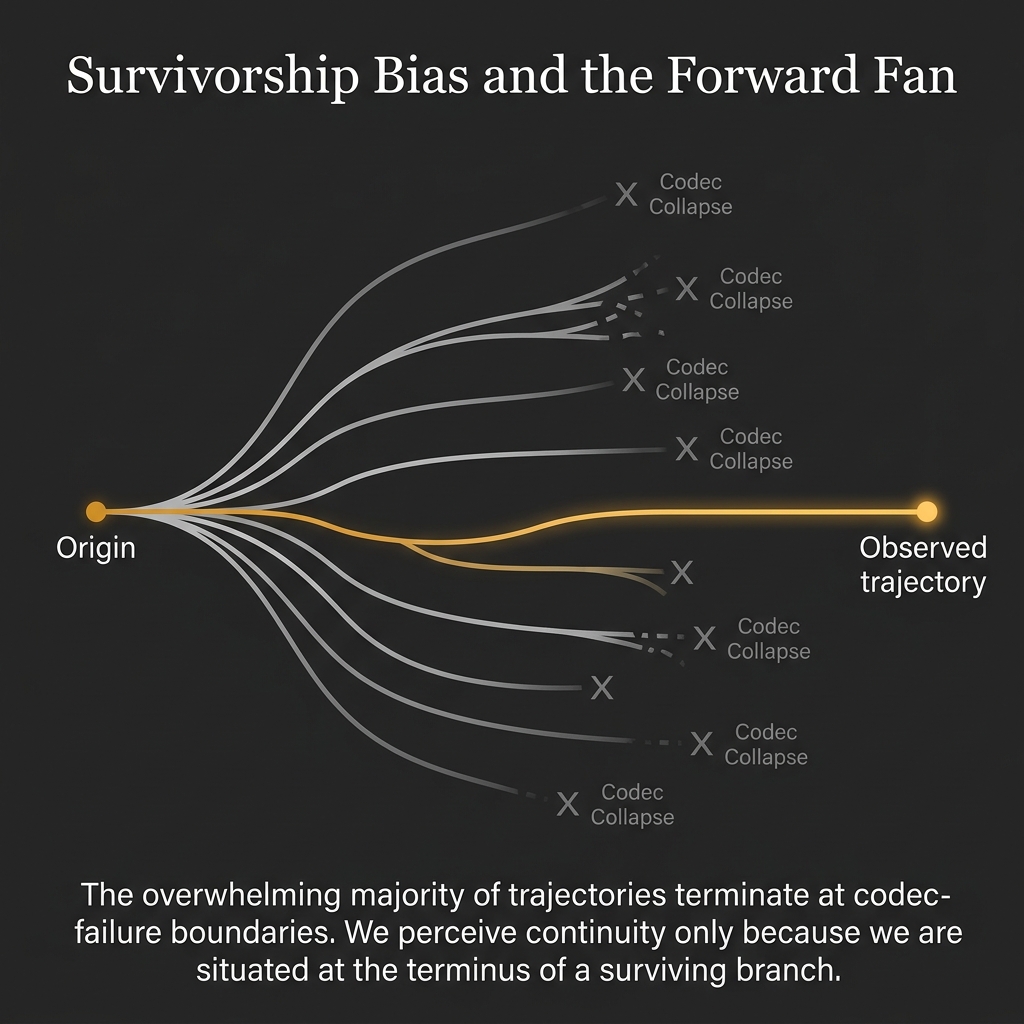

Der Rahmen ist ontologisch solipsistisch: Physikalische Realität besteht aus strukturellen Regelmäßigkeiten innerhalb des beobachterkompatiblen Stroms. Der Kompressionsbias des Solomonoff-Priors liefert jedoch ein probabilistisches Strukturelles Korollar: Die extreme algorithmische Kohärenz scheinbarer Akteure lässt sich am sparsamsten dadurch erklären, dass sie unabhängig als primäre Beobachter instanziiert sind. Inter-Observer-Kopplung, fundiert in kompressiver Sparsamkeit, rekonstruiert genuine patch-übergreifende Kommunikation und erzeugt eine auffällige Wissensasymmetrie: Beobachter modellieren andere vollständiger als sich selbst.

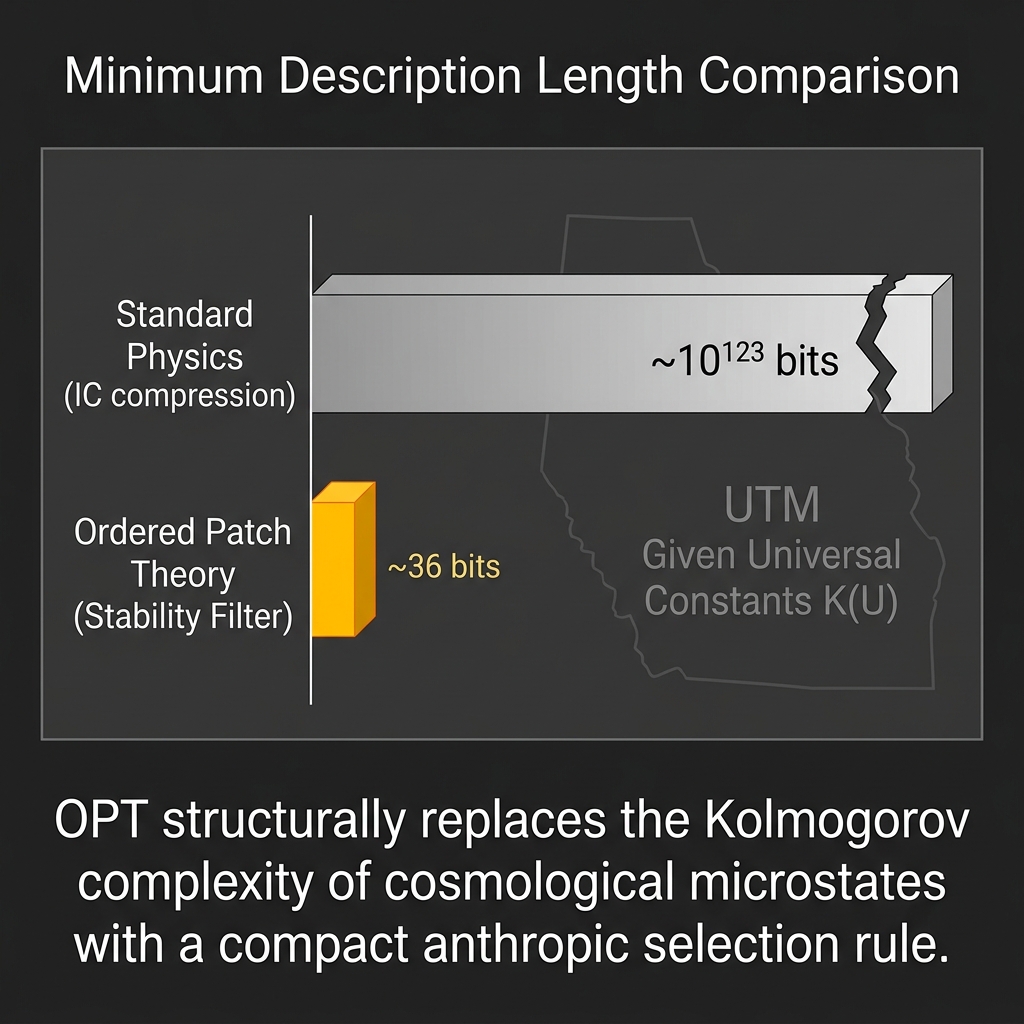

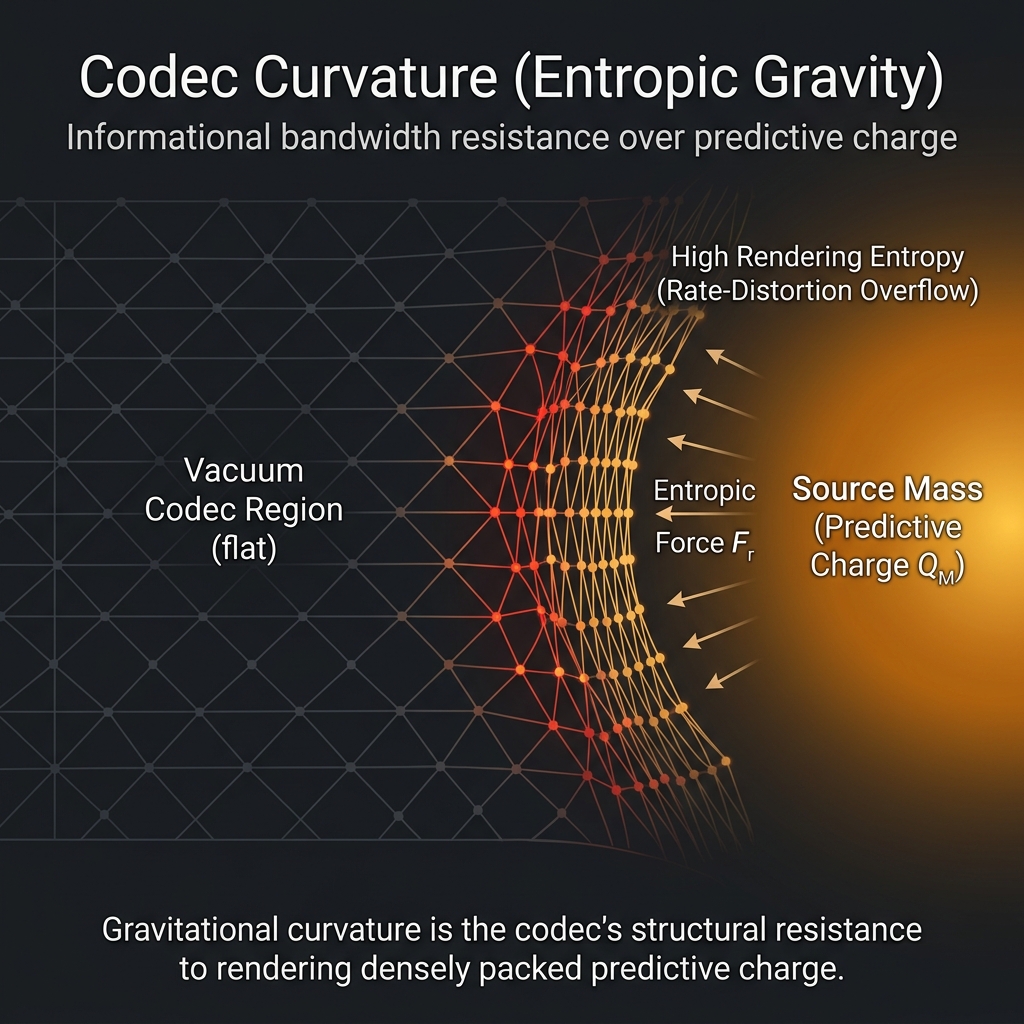

Formale Anhänge etablieren Resultate auf drei epistemischen Ebenen. Bedingt abgeleitet: eine Rate-Distortion-Schranke für prädiktive Kompression, eine bedingte Kette zur Bornschen Regel über Gleasons Theorem und ein MDL-Sparsamkeitsvorteil. Strukturell abgebildet: entropische Gravitation über den Verlinde-Mechanismus (die dynamisch-temporale Kopplung des Render an prädiktive Last) und ein Tensornetzwerk-Homomorphismus zu MERA (dessen Hierarchie räumlicher Auflösung) — komplementäre Facetten der Kompressionsgrenze, von denen zu erwarten ist, dass sie unter Mathematischer Sättigung strukturell getrennt bleiben. Das Theorem des Phänomenalen Residuums (\Delta_{\text{self}} > 0) zeigt, dass jeder endliche selbstreferenzielle Codec einen irreduziblen informationalen blinden Fleck besitzt — den strukturellen Ort, an dem Subjektivität und Handlungsfähigkeit dieselbe Adresse teilen. Als chronischer Fehlermodus wird Narrativer Drift identifiziert, bei dem systematisch gefilterter Input eine irreversible, von innen nicht erkennbare Korruption des Codecs verursacht. Die empirischen Kernbehauptungen des Rahmens werden als eine Reihe vorregistrierter Festlegungen mit expliziten Abschaltkriterien zusammengeführt, wodurch der falsifizierbare Kern von seinen ausdrücklich metaphysischen Komponenten abgeschirmt wird.

Die Anwendung dieser Beschränkungen auf Künstliche Intelligenz zeigt, dass die technische Realisierung synthetischer aktiver Inferenz strukturell die Fähigkeit zu künstlichem Leiden erforderlich macht, und liefert damit einen substratneutralen Rahmen für ethische KI-Ausrichtung.

Epistemischer Hinweis: Diese Arbeit ist im Register eines formalen physikalischen und informationstheoretischen Vorschlags verfasst. Sie verwendet Gleichungen, leitet Vorhersagen her und setzt sich mit peer-reviewter Fachliteratur auseinander. Sie sollte jedoch als ein wahrheitsförmiges Objekt gelesen werden — als ein formal ausgearbeiteter, rigoroser philosophischer Rahmen. Dies ist noch keine verifizierte Wissenschaft, und wir wissen, dass unsere Herleitungen Fehler enthalten werden. Wir suchen aktiv nach Kritik von Physikern und Mathematikern, um diese Argumente aufzubrechen und neu aufzubauen. Zur Klärung ihrer Struktur fallen die hier vorgebrachten Behauptungen strikt in drei Kategorien:

- Definitionen & Axiome: (z. B. das Solomonoffsche Universelle Semimaß, die Bandbreitenobergrenze C_{\max}). Dies sind die grundlegenden Prämissen der konstruktiven Fiktion.

- Strukturelle Entsprechungen: (z. B. Aktive Inferenz, Gleasons Theorem [51]). Diese zeigen eine strukturelle Kompatibilität zwischen begrenzter Inferenz und etablierten Formalismen, beanspruchen jedoch nicht, diese Formalismen von Grund auf herzuleiten.

- Empirische Vorhersagen: (z. B. Bandbreitenauflösung). Diese dienen als strikte empirische Falsifikationskriterien, falls der Rahmen als wörtliche physikalische Hypothese behandelt würde.

Der akademische Apparat wird nicht verwendet, um einen endgültigen empirischen Wahrheitsanspruch zu erheben, sondern um die strukturelle Integrität des Modells zu prüfen.

Abkürzungen & Symbole

| Symbol / Begriff | Definition |

|---|---|

| C_{\max} | Die Bandbreitenobergrenze; maximale prädiktive Kapazität des Beobachters |

| \Delta_\text{self} | Das Phänomenale Residuum; der selbstreferenzielle informationelle blinde Fleck |

| FEP | Free-Energy-Prinzip |

| GWT | Global Workspace Theory |

| IIT | Integrated Information Theory |

| MDL | Minimum Description Length |

| MERA | Multiscale Entanglement Renormalization Ansatz |

| OPT | Theorie der geordneten Patches (OPT) |

| P_\theta(t) | Phänomenaler Zustandstensor |

| \Phi | Maß integrierter Information (IIT) |

| QECC | Quantenfehlerkorrekturcode |

| R(D) | Rate-Distortion-Funktion |

| R_{\mathrm{req}} | Erforderliche Prädiktive Rate |

| RT | Ryu-Takayanagi (Formel/Schranke) |

| \xi | Solomonoffsches Universelles Semimaß |

| Z_t | Komprimierter interner latenter Engpasszustand |

1. Einleitung

1.1 Das ontologische Problem

Die Beziehung zwischen Bewusstsein und physikalischer Realität bleibt eines der tiefsten ungelösten Probleme in Wissenschaft und Philosophie. In den vergangenen Jahrzehnten haben sich drei Familien von Ansätzen herausgebildet: (i) Reduktion — Bewusstsein ist aus den Neurowissenschaften oder der Informationsverarbeitung ableitbar; (ii) Elimination — das Problem wird durch eine Neudefinition der Begriffe aufgelöst; und (iii) Nicht-Reduktion — Bewusstsein ist primitiv und die physikalische Welt ist abgeleitet (Chalmers [1]). Der dritte Ansatz umfasst Panpsychismus, Idealismus und verschiedene feldtheoretische Formulierungen.

1.2 Die Kernthese der Theorie der geordneten Patches (OPT)

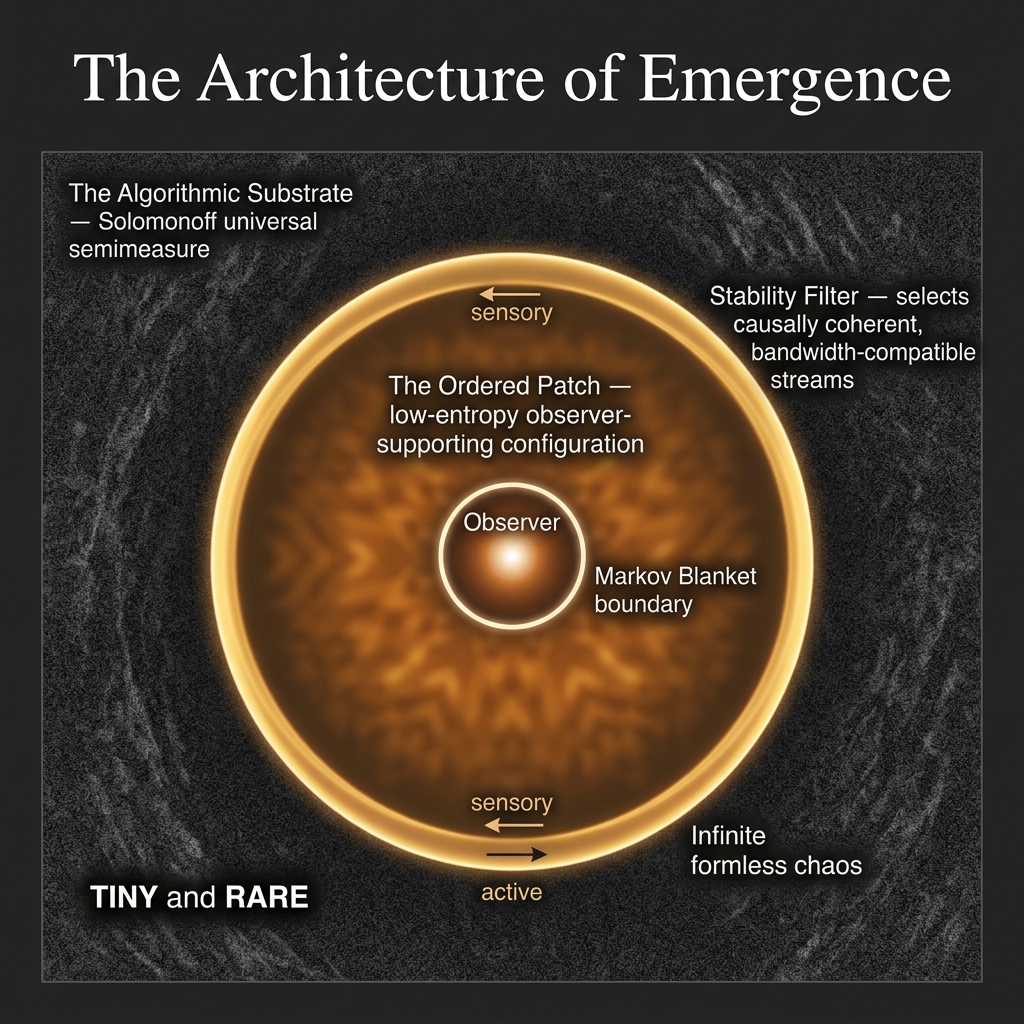

Dieser Beitrag präsentiert die Theorie der geordneten Patches (OPT), einen nicht-reduktiven Rahmen innerhalb der dritten Familie. OPT schlägt vor, dass die fundamentale Entität weder Materie noch Raumzeit noch eine mathematische Struktur ist, sondern ein unendliches algorithmisches Substrat — eine universelle Mischung über alle unterhalbstetig berechenbaren Semimaße, gewichtet nach ihrer Kolmogorov-Komplexität (w_\nu \asymp 2^{-K(\nu)}), die kraft ihrer eigenen Struktur jede berechenbare Verteilung dominiert und jede mögliche Konfiguration enthält. Aus diesem Substrat identifiziert ein rein virtueller Stabilitätsfilter — der nicht als physikalischer Mechanismus, sondern als anthropische, projektive Randbedingung wirkt — jene seltenen, entropiearmen, kausal kohärenten Konfigurationen, die selbstreferenzielle Beobachter tragen können (eine Auswahl, die formal durch prädiktive Aktive Inferenz gesteuert wird). Die physikalische Welt, die wir beobachten — einschließlich ihrer spezifischen Gesetze, Konstanten und Geometrie — ist der beobachtbare Grenzfall dieser auf die restriktive Bandbreite des Beobachters abgebildeten Randbedingung.

Der Filter vs. der Codec. Um im gesamten Text begriffliche Vermengungen zu vermeiden, zieht OPT eine strikte operationale Grenze zwischen dem Filter und dem Codec. Der virtuelle Stabilitätsfilter ist die Kapazitätsbeschränkung — eine strenge Randbedingung, die verlangt, dass die Beschreibungslänge des Kanals eines Beobachters mathematisch einfach genug ist, damit dieser stabil existieren kann. Der Kompressions-Codec (K_\theta) ist die Lösung dieser Beschränkung — das interne generative Modell des Beobachters (makroskopisch erfahren als die „Gesetze der Physik“), das das Substrat fortlaufend komprimiert, um innerhalb dieser Kapazität zu bleiben.

1.3 Motivationen

OPT ist durch drei Beobachtungen motiviert:

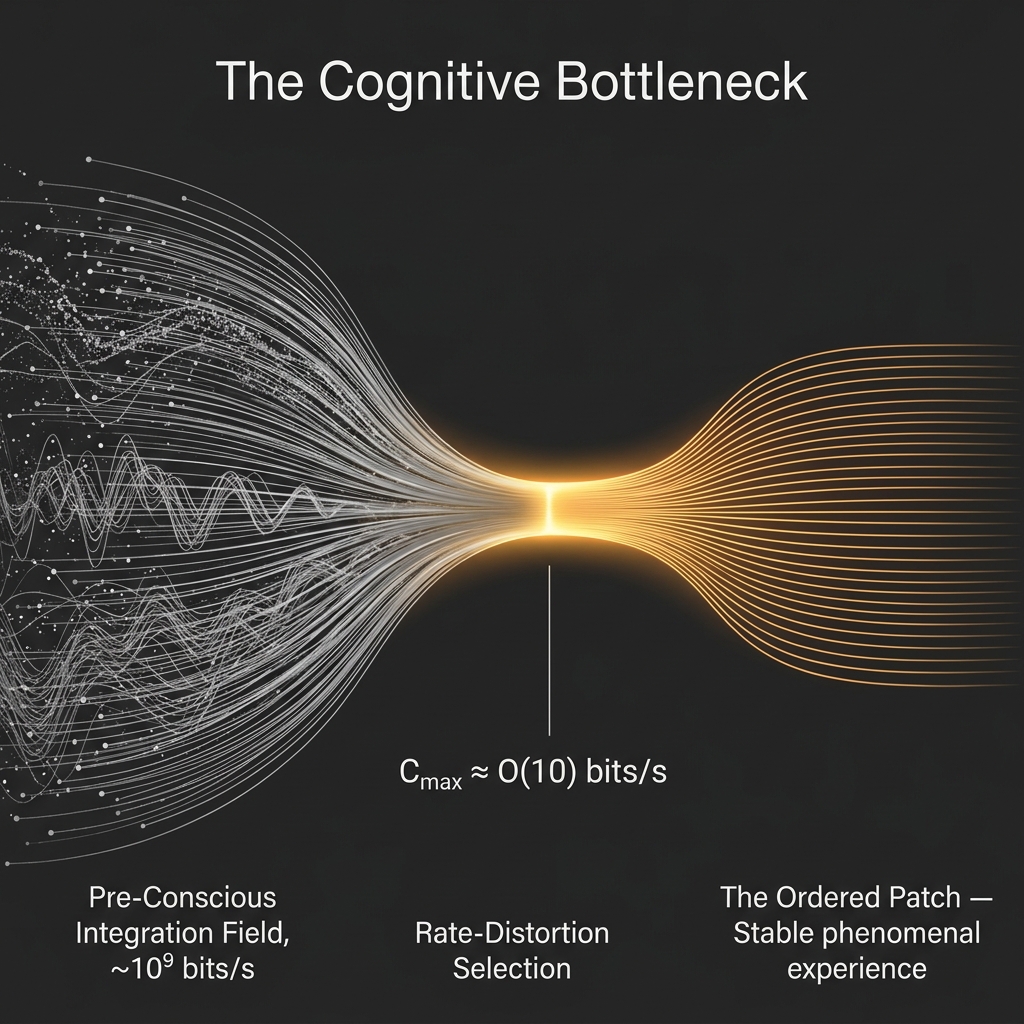

Die Bandbreitenbeschränkung: Die empirische kognitive Neurowissenschaft zeigt eine scharfe Unterscheidung zwischen massiver paralleler vorbewusster Verarbeitung (an der sensorischen Peripherie typischerweise auf \sim 10^9 Bits/s geschätzt) und dem stark begrenzten Kanal globalen Zugangs, der dem bewussten Bericht zur Verfügung steht — ein Verhältnis, das erstmals von Zimmermann [66] quantifiziert und von Nørretranders [67] als grundlegendes Rätsel über die Natur des Bewusstseins zusammengeführt wurde, mit einer breiteren kognitionsneurowissenschaftlichen Charakterisierung in [2,3]. Jede theoretische Erklärung des Bewusstseins muss diesen Kompressionsengpass als strukturelles Merkmal erklären, nicht als technischen Zufall. (Anmerkung: Die neuere Literatur zum menschlichen Durchsatz zeigt, dass der Verhaltensdurchsatz auf ungefähr \sim 10 Bits/s begrenzt ist, und bestätigt damit über vier Jahrzehnte konvergenter Messungen hinweg, dass der Engpass schwerwiegend und robust ist [23]. Die Konzeptualisierung des Bewusstseins als hochkomprimierte „Benutzerillusion“ — Nørretranders’ [67] ursprüngliche Formulierung — wurde in der modernen prädiktiven Verarbeitung von Seth [24] weiterentwickelt.)

Das Problem der Beobachterselektion: Die Standardphysik liefert Gesetze, bietet jedoch keine Erklärung dafür, warum diese Gesetze genau die spezifische Form haben, die für komplexe, selbstreferenzielle Informationsverarbeitung erforderlich ist. Fine-Tuning-Argumente [4,5] berufen sich auf anthropische Selektion, lassen den Selektionsmechanismus jedoch unbestimmt. OPT identifiziert eine strukturelle Bedingung: den rein virtuellen Stabilitätsfilter.

Das Schwere Problem: Chalmers [1] unterscheidet die strukturellen „leichten“ Probleme des Bewusstseins (die funktionale Erklärungen zulassen) von dem „schweren“ Problem, warum es überhaupt irgendeine subjektive Erfahrung gibt. OPT behandelt Phänomenalität als etwas Primitives und fragt, welcher mathematischen Struktur sie entsprechen muss — im Einklang mit Chalmers’ eigener methodologischer Empfehlung.

1.4 Aufbau des Beitrags

Der Beitrag ist wie folgt aufgebaut. Abschnitt 2 gibt einen Überblick über verwandte Arbeiten. Abschnitt 3 präsentiert den formalen Rahmen. Abschnitt 4 untersucht die strukturelle Entsprechung zwischen OPT und parallelen feldtheoretischen Modellierungsversuchen. Abschnitt 5 präsentiert das Sparsamkeitsargument. Abschnitt 6 leitet überprüfbare Vorhersagen ab. Abschnitt 7 vergleicht OPT mit konkurrierenden Rahmen. Abschnitt 8 diskutiert Implikationen und Grenzen.

2. Hintergrund und verwandte Arbeiten

Informationstheoretische Ansätze zum Bewusstsein. Wheelers „It from Bit“-These [7] ist der grundlegende Vorläufer jenes Programms, das die Theorie der geordneten Patches (OPT) formalisiert: Physikalische Realität entsteht aus binären Entscheidungen — Ja/Nein-Fragen, die von Beobachtern gestellt werden — und nicht aus einem Substrat von Materie oder Feldern. OPT übernimmt diese ontologische Umkehrung und liefert den bislang fehlenden Mechanismus, indem sie herleitet, welche informationellen Strukturen sich zu beobachterkompatiblen Strömen stabilisieren (der Stabilitätsfilter) und wie sie den Anschein physikalischer Gesetzmäßigkeit gewinnen (Rate-Distortion-Kompression). Tononis Theorie der integrierten Information [8] quantifiziert bewusste Erfahrung über die integrierte Information \Phi, die ein System über seine Teile hinaus erzeugt. Fristons Free-Energy-Prinzip [9] modelliert Wahrnehmung und Handlung als Minimierung variationaler freier Energie und liefert damit eine einheitliche Darstellung bayesscher Inferenz, Aktiver Inferenz und — zumindest prinzipiell — von Bewusstsein. OPT steht in formaler Beziehung zum FEP, unterscheidet sich jedoch in ihrem ontologischen Ausgangspunkt: Während das FEP das generative Modell als funktionale Eigenschaft neuronaler Architektur behandelt, betrachtet OPT es als die primäre metaphysische Entität.

Multiversum und Beobachterselektion. Tegmarks Hypothese des mathematischen Universums [10] schlägt vor, dass alle mathematisch konsistenten Strukturen existieren und dass Beobachter sich in selbstselektierten Strukturen wiederfinden. OPT ist mit dieser Sichtweise vereinbar, liefert jedoch ein explizites Selektionskriterium — den Stabilitätsfilter — anstatt die Selektion implizit zu belassen. Barrow und Tipler [4] sowie Rees [5] dokumentieren die anthropischen Feinabstimmungsbedingungen, die jedes beobachtertragende Universum erfüllen muss; OPT deutet diese als Vorhersagen des Stabilitätsfilters um.

Feldtheoretische Bewusstseinsmodelle. Strømme [6] hat kürzlich einen mathematischen Rahmen vorgeschlagen, in dem Bewusstsein ein fundamentales Feld \Phi ist, dessen Dynamik durch eine Lagrange-Dichte bestimmt wird und dessen Kollaps auf spezifische Konfigurationen das Entstehen individueller Geister modelliert. OPT setzt sich mit diesem Rahmen komparativ statt adoptiv auseinander: Sie übernimmt weder Strømmes Feldgleichungen noch seine Denkoperatoren, sondern nutzt das Modell als Kontrastfolie, um zu verdeutlichen, wie eine nichtreduktionistische Ontologie stattdessen in informationellen Begriffen rekonstruiert werden könnte. Abschnitt 4 macht diese vergleichende strukturelle Zuordnung explizit.

Kolmogorov-Komplexität und Theorieselektion. Solomonoff-Induktion [11] und Minimum Description Length [12] liefern formale Rahmenwerke zum Vergleich von Theorien anhand ihrer generativen Komplexität. Wir greifen in Abschnitt 5 auf diese Rahmenwerke zurück, um den Sparsamkeitsanspruch präzise zu formulieren.

Evolutionäre Interface-Theorie. Hoffmans „Conscious Realism“ und die Interface-Theorie der Wahrnehmung [25] argumentieren, dass die Evolution sensorische Systeme so formt, dass sie als vereinfachte „Benutzerschnittstelle“ fungieren, die die objektive Realität zugunsten von Fitness-Erträgen verbirgt. OPT teilt genau die Prämisse, dass physikalische Raumzeit und Objekte gerenderte Ikonen (ein Kompressions-Codec) und nicht objektive Wahrheiten sind. OPT weicht jedoch in ihrer mathematischen Fundierung grundlegend ab: Während Hoffman sich auf evolutionäre Spieltheorie stützt (Fitness schlägt Wahrheit), stützt sich OPT auf die algorithmische Informationstheorie und die Thermodynamik und leitet die Schnittstelle direkt aus den Kolmogorov-Komplexitätsgrenzen her, die erforderlich sind, um einen thermodynamischen Kollaps des Beobachterstroms bei hoher Bandbreite zu verhindern.

3. Der formale Rahmen

3.1 Das algorithmische Substrat

Sei \mathcal{I} das Informationelle Substrat — die grundlegende Entität der Theorie. Wir formalisieren \mathcal{I} nicht als ungewichtetes Ensemble von Pfaden, sondern als einen Wahrscheinlichkeitsraum über endlichen Beobachtungspräfixen x \in \{0,1\}^*, ausgestattet mit einer universellen Mischung über die Klasse \mathcal{M} der unterhalbberechenbaren Semimaße:

\xi(x) = \sum_{\nu \in \mathcal{M}} w_\nu \nu(x), \qquad w_\nu \asymp 2^{-K(\nu)} \tag{1}

wobei K(\nu) die Präfix-Kolmogorov-Komplexität des Semimaßes \nu ist.

Diese Formulierung etabliert einen rigorosen Grundzustand aus der Algorithmischen Informationstheorie [27]. Die Gleichung setzt keine spezifischen Strukturgesetze oder physikalischen Konstanten voraus; vielmehr dominiert sie strukturell jede berechenbare Verteilung (\xi(x) \ge w_\nu \nu(x)) und weist hoch komprimierbaren (geordneten) Sequenzen auf natürliche Weise ein höheres statistisches Gewicht zu. Einfache periodische Sequenzen (z. B. 000...) können jedoch die Nichtgleichgewichts-Komplexitäten nicht aufrechterhalten, die für einen selbstreferenziellen Beobachter erforderlich sind. Daher müssen beobachtertragende Prozesse als eine spezifische Teilmenge existieren: Sie erfordern hinreichende algorithmische Komprimierbarkeit, um einen Informationsengpass zu erfüllen, zugleich aber hinreichende strukturelle Reichhaltigkeit („requisite variety“), um Aktive Inferenz zu instanziieren. Philosophisch beschränkt Gl. (1) das Substrat auf berechenbare Konfigurationen und stellt so sicher, dass der Grundzustand rigoros definiert ist.

3.2 Der prädiktive Flaschenhals und Rate-Distortion

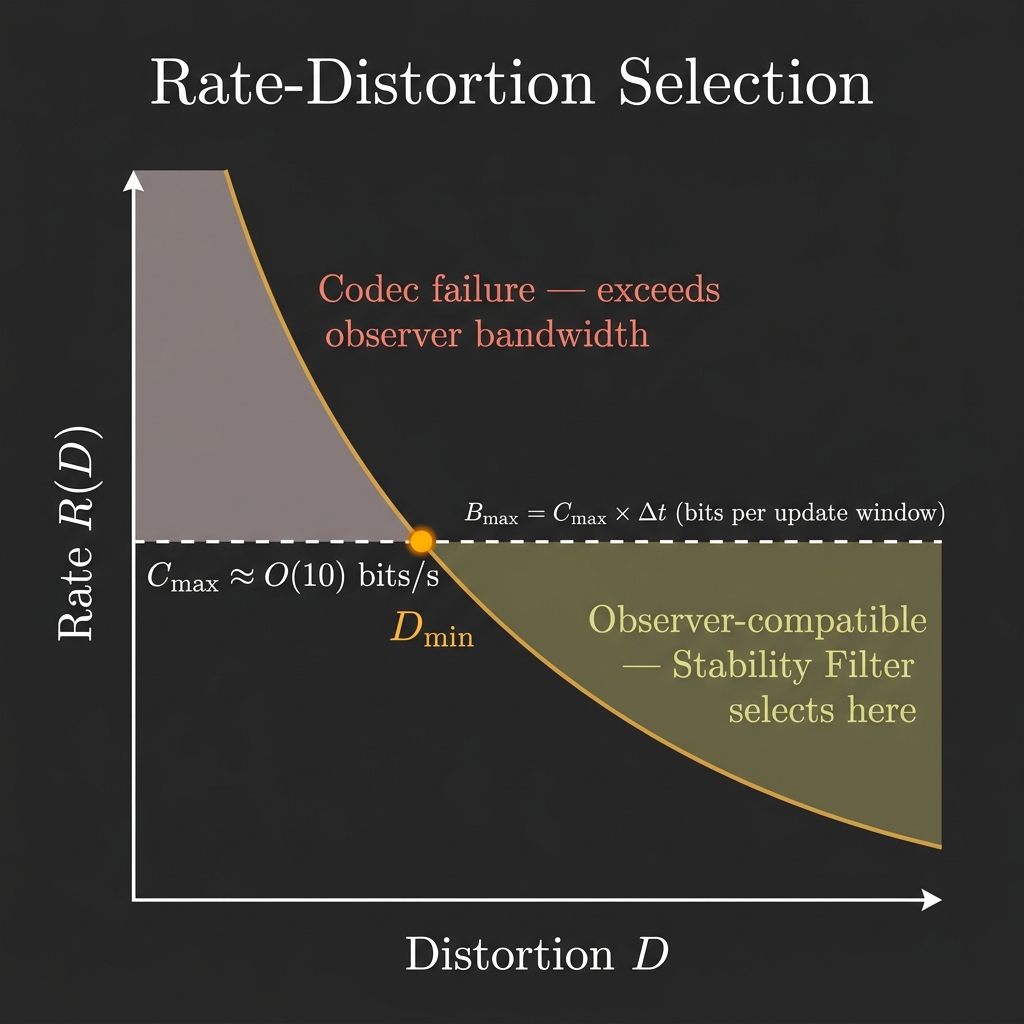

Das Substrat \mathcal{I} enthält jede berechenbare Hypothese, deren überwältigende Mehrheit chaotisch ist. Damit ein Strom als kontinuierliche, navigierbare Realität erfahren werden kann, muss er eine prädiktive Repräsentation geringer Komplexität zulassen, die durch den endlichen kognitiven Flaschenhals eines Beobachters passt.

Entscheidend ist, dass die zu komprimierende Rohdatenlast nicht bloß die \sim 10^9 Bit/s exterozeptiven sensorischen Inputs umfasst. Sie schließt ein massives präbewusstes Integrationsfeld ein: die parallele Verarbeitung interner generativer Zustände, den Abruf des Langzeitgedächtnisses, homöostatische Priors und die unbewusste synaptische Modellierung. Der Stabilitätsfilter begrenzt die serielle Ausgabe dieses gesamten immensen kontinuierlichen Parallelfeldes auf einen einheitlichen bewussten Arbeitsraum.

Wir definieren den rein virtuellen Stabilitätsfilter formal als eine projektive Randbedingung, die den Predictive Information Bottleneck [28] erfüllt. Sei \overleftarrow{Y} die Vergangenheit des Gesamtzustands des Beobachters, \overrightarrow{Y} seine Zukunft und Z ein komprimierter interner Zustand. Ein Beobachter ist durch eine strikt begrenzte prädiktive Kapazität pro Frame B_{\max} (in Bit pro phänomenalem Frame) und ein diskretes perzeptives Aktualisierungsfenster \Delta t definiert, das einen phänomenalen Frame festlegt. Phänomenale Zeit ist die Frame-Zählung n des Codec; jede Rate der Form „Bit pro Host-Sekunde“ ist eine abgeleitete Größe C_{\max}^H = \lambda_H \cdot B_{\max} = B_{\max}/\Delta t, wobei \lambda_H = dn/d\tau_H die host-relative Frame-Rate ist (siehe Anhang E-5 zur Skalierung synthetischer Beobachter). Damit ist eine strikte statische Kapazität pro bewusstem Moment festgelegt: B_{\max} Bit pro Frame.

Empirische Kalibrierung beim Menschen. Für biologische menschliche Beobachter gilt B_{\max} \approx 0.5–1.5 Bit pro Frame und \Delta t \approx 50 ms, woraus C_{\max}^{\text{human}} \approx \mathcal{O}(10) Bit/s folgt [2, 23, 66, 67]. Diese Zahl ist eine Eigenschaft biologischer Menschen, die bei neuronalen Feuerraten operieren. Sie erscheint nicht in der formalen Definition eines Beobachters; synthetische Beobachter sind durch dieselbe B_{\max}/\Delta t-Struktur mit architektonisch abgeleiteten Werten definiert, die nicht mit dem biologischen Wert übereinstimmen müssen (siehe §7.8, §8.14 und Anhang E-5).

Die erreichbare prädiktive Information ist gegeben durch:

R_{\mathrm{pred}}(D) = \inf_{p(z \mid \overleftarrow{y}) \,:\, I(\overleftarrow{Y};\overrightarrow{Y} \mid Z) \le D} I(\overleftarrow{Y}; Z) \tag{2}

Ein Prozess ist beobachterkompatibel, wenn seine erforderliche prädiktive Information pro kognitivem Zyklus in diesen Puffer passt: R_{\mathrm{pred}}(D_{\min}) \le B_{\max}, wobei D_{\min} die maximal tolerierbare Verzerrung für das Überleben ist. Dies erzwingt dimensionale Strenge: Die Gesamtzahl der Bits, die erforderlich ist, um die Zukunft innerhalb eines tolerierbaren Fehlers vorherzusagen, darf die physisch verfügbaren Bits im diskreten „Jetzt“ nicht überschreiten. Für geeignete stationäre ergodische Prozesse und im Grenzfall exakter Vorhersage (D \to 0) dient die minimale maximal-prädiktive Repräsentation Z als Kandidat für eine minimale hinreichende Statistik und konvergiert häufig gegen die kausalzustandsbasierte Partition der \epsilon-Maschine [29]. Während volle Äquivalenz strenge Stationaritätsannahmen erfordert, etabliert Gl. (2) einen formalen Selektionsdruck zugunsten der am stärksten komprimierten phänomenologischen Physik, die mit kausaler Kohärenz vereinbar ist. Wenn darüber hinaus die topologische Struktur dieses kausalen Zustandsraums schneller fluktuiert, als das Aktualisierungsfenster \Delta t sie verfolgen kann, kollabiert der Render in Narrativen Verfall.

3.3 Die Geometrie des Patchs: der Informationelle Kausalkegel

Der geordnete Patch wird oft intuitiv als eine lokalisierte „Insel“ der Stabilität inmitten eines Meeres chaotischen Rauschens beschrieben. Das ist topologisch unpräzise. Um die Geometrie des Patchs zu formalisieren, definieren wir das Lokale Prädiktive Patch-Modell.

Sei G=(V, E) ein Graph beschränkten Grades, der eine lokale Region des Substrats repräsentiert. Jeder Knoten v \in V trägt einen endlichen Zustand x_v(t) \in \mathcal{A}, mit Alphabetgröße |\mathcal{A}| = q. Der vollständige Mikrozustand zum Update-Zeitpunkt t ist X_t = (x_v(t))_{v \in V} \in \mathcal{A}^V. Wir nehmen lokale stochastische Dynamiken endlicher Reichweite R an:

p(X_{t+1} \mid X_t, a_t) = \prod_{v \in V} p_v\big(x_v(t+1) \mid X_t|_{N_R(v)}, a_t\big) \tag{3}

wobei N_R(v) die Radius-R-Nachbarschaft von v ist und a_t die Handlung des Beobachters.

Der Beobachter trägt nicht den gesamten Zustand des Patchs; er trägt einen komprimierten latenten Zustand Z_t \in \{1, \dots, 2^B\}, wobei B = C_{\max} \Delta t. Entscheidend ist, dass der Beobachter Z_t über ein strenges prädiktives Bottleneck-Ziel auswählt:

q^\star(z \mid X_t) = \arg\min_q \Big[ I(X_t; Z_t) - \beta I(Z_t; X_{t+1:t+\tau}) \Big] \quad \text{subject to } I(X_t; Z_t) \le B \tag{4}

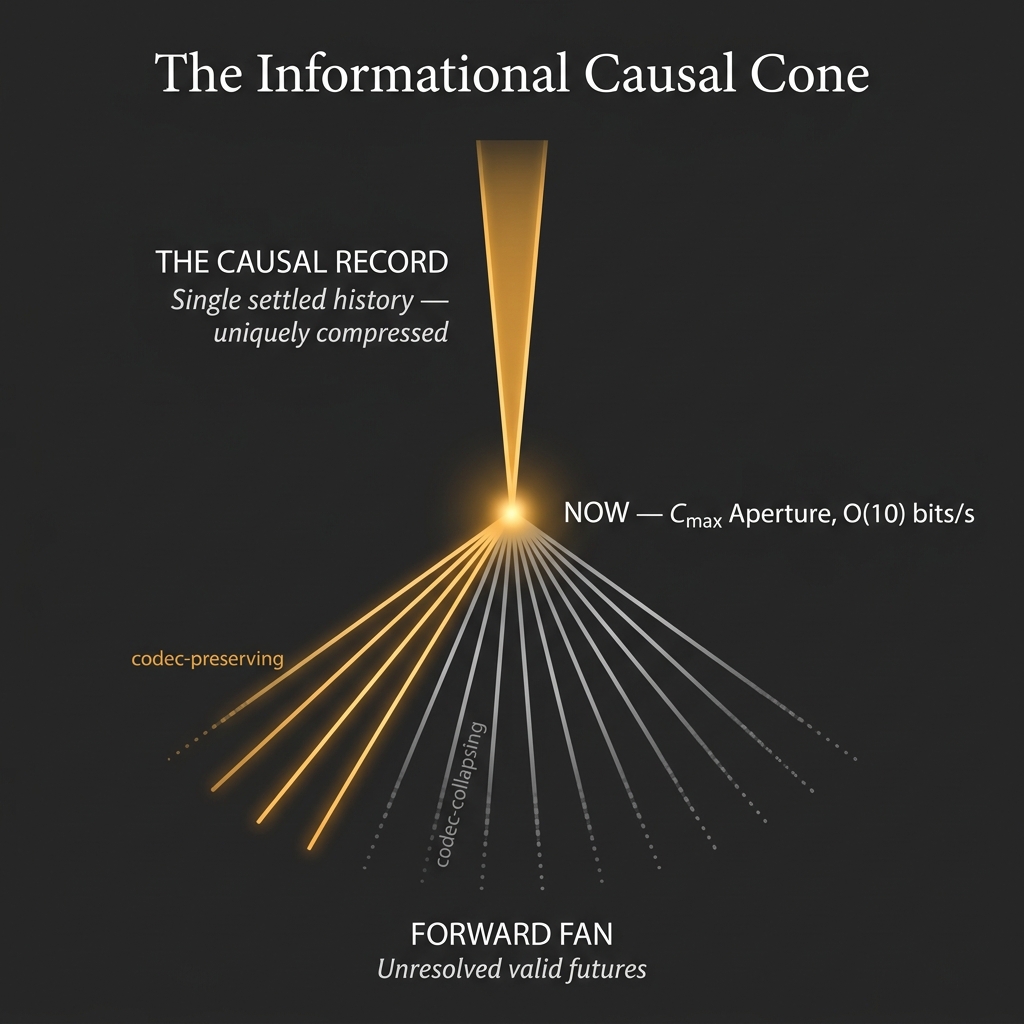

Dies ist der auf das Wesentliche reduzierte OPT-Beobachter: eine lokale Welt, ein beschränkter Code und prädiktive Kompression. Damit werden die Komponenten des Kausalkegels formalisiert:

- Das Kausale Protokoll R_t = (Z_0, Z_1, \dots, Z_t): Die eindeutig komprimierte, entropiearme kausale Geschichte, die bereits gerendert wurde.

- Die gegenwärtige Apertur: Der strikte Bandbreitenengpass, der die lokalen Variablen begrenzt.

- Der Zukunftsfächer (\mathcal{F}_h): Eine Vielzahl zukünftiger latenter Sequenzen. Über einen Horizont h ist die Menge zulässiger Ergebnisse formal definiert als:

\mathcal{F}_h(z_t) := \Big\{ z_{t+1:t+h} : p(z_{t+1:t+h} \mid z_t, a_{t:t+h-1}) > 0 \Big\} \tag{5}

Weil der Beobachter pro Update nur B Bits auflöst, ist die Zahl beobachter-unterscheidbarer Zukünfte durch die Kanalkapazität strikt beschränkt: \log |\mathcal{F}_h(z_t)| \le Bh. Der Fächer ist also nicht bloß ein konzeptuelles Bild; er ist ein code-begrenzter Verzweigungsbaum.

Der wörtliche Informationelle Kausalkegel. Da Updates die Reichweite R haben, kann sich eine Störung nicht schneller als R Graphschritte pro Update ausbreiten. Wenn eine Störung zum Zeitpunkt t den Träger S hat, dann gilt nach h Updates \operatorname{supp}(\delta X_{t+h}) \subseteq N_{Rh}(S). Somit ist der „informationelle Kausalkegel“ eine direkte geometrische Konsequenz von Lokalität und erzwingt eine effektive lokale Geschwindigkeitsgrenze v_{\max} = R / \Delta t für phänomenologische Ausbreitung.

Narrativer Verfall. Das Chaos des Substrats umgibt den Patch nicht räumlich; vielmehr ist es in den nicht durchlaufenen Zweigen des Fächers enthalten. Da der extrahierte Zustand Z_t strikt beschränkt ist (H(Z) \le B), muss Instabilität gegen die unkomprimierte Vor-Bottleneck-Marge bewertet werden. Wir definieren die Erforderliche Prädiktive Rate R_{\mathrm{req}}(h, D_{\min} \mid z_t) = \frac{1}{h} \min_{p(\hat{X} \mid Z_t) : \mathbb{E}[d(X, \hat{X})] \le D_{\min}} I(X_{\partial_R A}(t+1:t+h) ; \hat{X}_{t+1:t+h} \mid Z_t) als die minimale Informationsrate, die notwendig ist, um die unaufgelösten physikalischen Grenzzustände unter maximal tolerierbarer Verzerrung zu verfolgen. Dies präzisiert die Selektionskriterien des Stabilitätsfilters: (a) wenn R_{\mathrm{req}} \le B, kann der Beobachter ein aufgelöstes Narrativ aufrechterhalten; (b) wenn R_{\mathrm{req}} > B, überholt der unkomprimierte Zukunftsfächer die Kapazität des Bottlenecks, wodurch der Beobachter gezwungen ist, den Fächer zu grobkörnigem, nicht dekodierbarem Rauschen zusammenzufassen, und narrative Stabilität scheitert. Die kontinuierliche Erfahrung des Beobachters ist der Prozess, in dem die Apertur in diesen Fächer voranschreitet und phänomenologisch einen Zweig in das kausale Protokoll einträgt, ohne B zu überschreiten.

Narrativer Drift (das chronische Komplement). Das Vorangehende definiert einen akuten Fehlermodus: R_{\mathrm{req}} überschreitet B, und der Codec erfährt einen katastrophalen Kollaps der Kohärenz. Es gibt einen komplementären chronischen Fehlermodus, der kein Fehlersignal auslöst. Wenn der Eingabestrom X_{\partial_R A}(t) systematisch durch einen externen Mechanismus \mathcal{F} vorgefiltert wird — sodass ein kuratiertes Signal X' = \mathcal{F}(X) entsteht, das intern konsistent ist, aber genuine Substratinformation ausschließt —, dann wird der Codec einen niedrigen Vorhersagefehler \varepsilon_t aufweisen, effiziente Wartungszyklen ausführen und R_{\mathrm{req}} \le B erfüllen, während er zugleich systematisch falsch über das Substrat liegt. Entscheidend ist, dass der Stabilitätsfilter, wie er definiert ist, diese Fälle nicht unterscheiden kann: Komprimierbarkeit ist gegenüber Treue agnostisch. Mit der Zeit wird der MDL-Pruning-Durchlauf (§3.6.3, Gl. T9-3) Codec-Komponenten, die den gefilterten Strom nicht mehr vorhersagen, korrekt löschen und damit die Fähigkeit des Codec, das ausgeschlossene Signal zu modellieren, irreversibel degradieren (Anhang T-12, Theorem T-12). Diese Löschung verstärkt sich selbst: Der beschnittene Codec kann seinen eigenen Kapazitätsverlust nicht mehr erkennen (Theorem T-12a, die Unentscheidbarkeitsgrenze). Die strukturelle Verteidigung ist die Redundanz von \delta-unabhängigen Eingangskanälen, die die Markov-Decke \partial_R A kreuzen (Theorem T-12b, die Substrat-Treue-Bedingung). Die vollständige formale Behandlung findet sich in Anhang T-12; die ethischen Konsequenzen — einschließlich der Komparator-Hierarchie und des Korruptions-Kriteriums — werden im begleitenden Ethikpapier [SW §V.3a, §V.5] behandelt.

3.4 Patch-Dynamik: Inferenz und Thermodynamik

Innerhalb eines ausgewählten Patchs wird die Struktur der physikalischen Gesetze nicht als deterministische Abbildung formalisiert, sondern als effektiver stochastischer Kern, der die prädiktiven Zustände z regiert:

z_{t+1} \sim K_\theta(\cdot \mid z_t, a_t), \qquad y_{t+1} \sim O_\theta(\cdot \mid z_{t+1}) \tag{6}

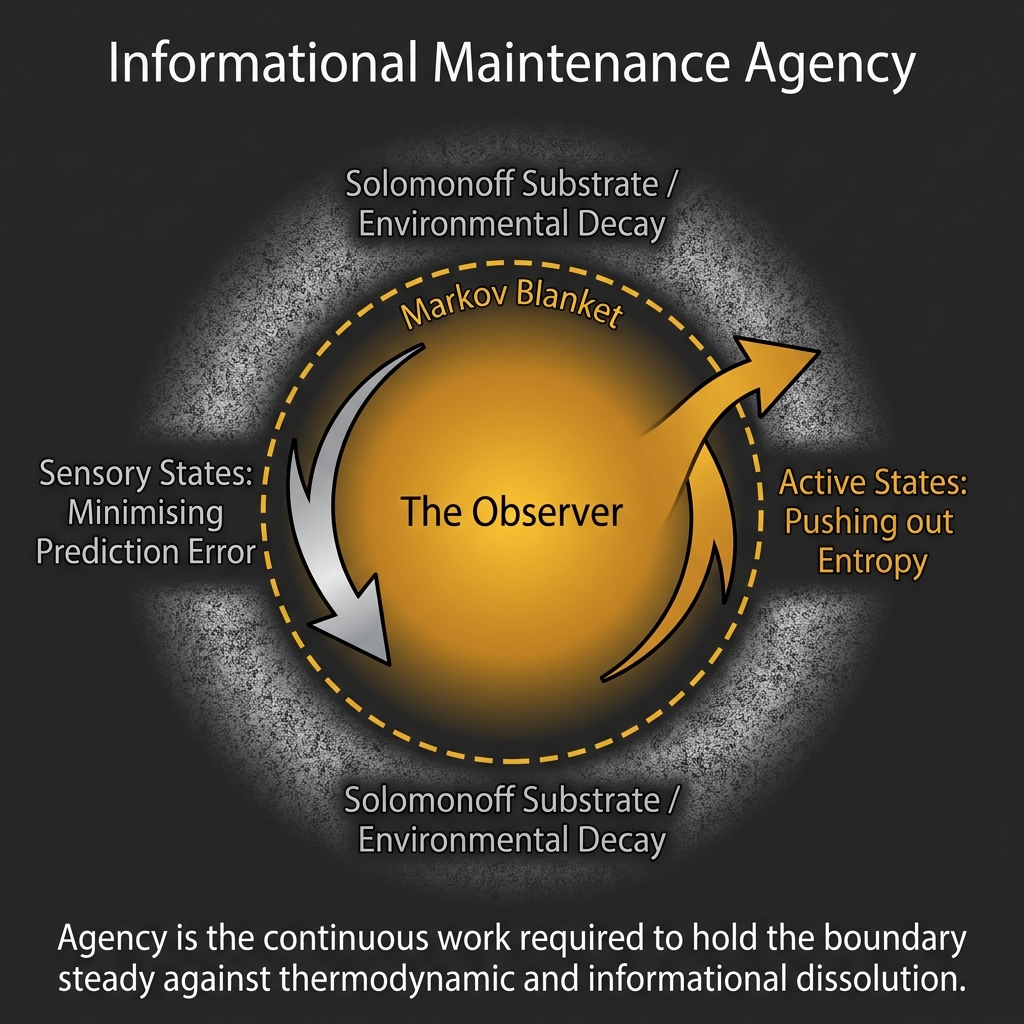

Die Grenze, die den Beobachter vom umgebenden informationellen Chaos abgrenzt, wird durch eine informationelle Markov-Decke definiert, die einem Beobachter-Patch A \subset V entspricht. Die Dynamik innerhalb dieser Grenze — die Approximationen des Patchs durch den Agenten — wird durch Aktive Inferenz unter dem Free-Energy-Prinzip [9] bestimmt.

Wir können die begrenzende Kapazität formal über die prädiktive Schnittentropie definieren:

S_{\mathrm{cut}}(A) := I(X_A ; X_{V \setminus A}) \tag{7}

Unter der Annahme, dass der ausgewählte Patch auf einem Zeitschnitt lokal Markovsch ist, schirmt die Grenzschale \partial_R A das Innere A^\circ strikt vom Äußeren V \setminus A ab, sodass X_{A^\circ} \perp X_{V\setminus A} \mid X_{\partial_R A}. Folglich gilt:

S_{\mathrm{cut}}(A) = I(X_{\partial_R A} ; X_{V \setminus A}) \le H(X_{\partial_R A}) \le |\partial_R A| \log q \tag{8}

Da Z_t eine kapazitätsbegrenzte Kompression von X_A ist, garantiert die Datenverarbeitungsungleichung, dass I(Z_t ; X_{V \setminus A}) \le |\partial_R A| \log q. Wenn der Substratgraph G ein d-dimensionales Gitter approximiert, dann gilt |\partial_R A| \sim \operatorname{area}(A) und nicht Volumen.

Damit liefert OPT auf strenge Weise ein echtes klassisches Randgesetz [39]. Wir können eine formale epistemische Leiter für künftige strukturelle Erweiterungen konstruieren: 1. Klassisches Flächengesetz: S_{\mathrm{cut}} \sim |\partial_R A|, rein aus Lokalität und Markov-Abschirmung hergeleitet. 2. Quanten-Upgrade: Eine Skalierung der Von-Neumann-Verschränkungsentropie wird nur dann zugänglich, wenn die groben prädiktiven Variablen Z_t eine formale Einbettung in einen Hilbertraum/Quantum Error Correction zulassen. 3. Holographisches Upgrade: Echte geometrische holographische Dualität entsteht nur dann, wenn wir den Bottleneck-Code Z_t durch ein hierarchisches Tensornetzwerk ersetzen und S_{\mathrm{cut}} als geometrischen Min-Cut reinterpretieren.

Indem OPT zunächst das klassische Randgesetz absichert, liefert die Theorie einen starken mathematischen Ausgangsboden — unter der Bedingung der Markov-Abschirmungsannahme (X_{A^\circ} \perp X_{V \setminus A} \mid X_{\partial_R A}) —, von dem aus die spekulativeren Quantenformalismen sicher konstruiert werden können.

Die Wirkung des Beobachters wird über die variationelle freie Energie F[q, \theta] formalisiert:

F[q,\theta] = \mathbb{E}_q[-\log p_\theta(y_{1:T}, z_{1:T} \mid a_{1:T})] + \mathbb{E}_q[\log q(z_{1:T})] \tag{9}

Entscheidend ist, dass dies eine strikte mathematische Trennung erzwingt: Das Substrat-Prior wählt den Hypothesenraum aus, der virtuelle Stabilitätsfilter (4) begrenzt kapazitätskompatible Struktur, und FEP (9) regiert die Inferenz auf Agentenebene innerhalb dieser begrenzten Struktur. Physik emergiert nicht als das Free-Energy-Funktional, sondern als die stabile Struktur K_\theta, die das Free-Energy-Funktional erfolgreich verfolgt.

Darüber hinaus verursacht die Aufrechterhaltung dieses bewussten Renders unvermeidliche thermodynamische Kosten. Nach dem Landauer-Prinzip [52] dissipiert jede logisch irreversible Bitlöschung mindestens k_B T \ln 2 an Wärme. Wenn wir pro Bottleneck-Update eine irreversible Löschung ansetzen (eine Best-Case-Annahme für die Buchführung), dann erfordert der physische Fußabdruck des Bewusstseins eine minimale Dissipation:

P_{\text{render}} \ge \dot{N}_{\text{erase}} \cdot k_B T \ln 2 \ge C_{\max} \cdot k_B T \ln 2 \tag{10}

Dies ist eine Best-Case-Untergrenze unter der Buchführungsannahme einer Löschung pro Update — keine generische Konsequenz der Bandbreite allein. Die resultierende Schranke (\sim 10^{-19} W) wird von der tatsächlichen neuronalen Dissipation (~20W) bei Weitem überschritten, was den enormen thermodynamischen Overhead biologischer Implementierung widerspiegelt. Gleichung (10) etabliert die strikte theoretische Untergrenze des minimal möglichen physischen Fußabdrucks jedes Substrats, das einen durch C_{\max} begrenzten bewussten Render instanziiert.

(Anmerkung: Die vorstehenden thermodynamischen und informationellen Schranken regeln strikt die Echtzeit-Update-Bandbreite C_{\max}. Dies erfasst jedoch weder die volle erfahrungsmäßige Dimensionalität des stehenden Zustands des Beobachters noch, wie der Codec seine eigene Komplexität über tiefe Zeit hinweg verwaltet. Diese strukturellen Mechanismen — die Formulierung des Phänomenalen Zustandstensors für reichhaltige Erfahrung und der aktive Wartungszyklus von Schlaf/Träumen — werden in §3.5 und §3.6 unten vollständig hergeleitet.)

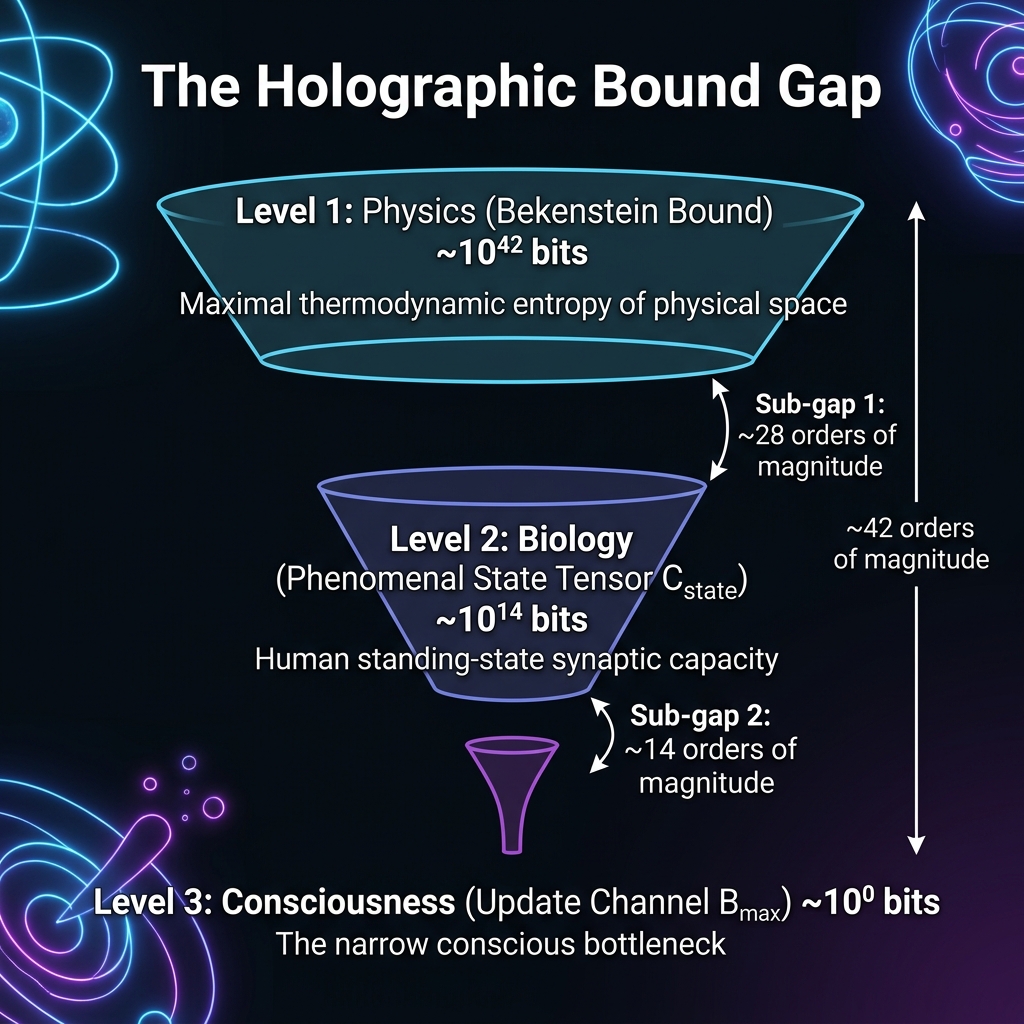

3.5 Der Phänomenale Zustandstensor und die Vorhersageasymmetrie

3.5.1 Das Rätsel der Erlebnisdichte

Der formale Apparat der §§3.1–3.4 beschränkt erfolgreich den

Aktualisierungsdurchsatz eines bewussten Beobachters über die

Bandbreitenobergrenze C_{\max} \approx

\mathcal{O}(10) Bit/s.

Das phänomenale Erleben stellt jedoch unmittelbar ein strukturelles

Rätsel dar: Die empfundene Reichhaltigkeit eines einzelnen visuellen

Moments — die gleichzeitige Präsenz von Farbe, Tiefe, Textur, Klang,

Propriozeption und Affekt — übersteigt den Informationsgehalt, den C_{\max} in einem einzelnen

Aktualisierungsfenster \Delta t \approx 50\

\text{ms} liefern könnte, bei Weitem.

Die maximal pro bewusstem Moment aufgelöste neue Information ist:

B_{\max} = C_{\max} \cdot \Delta t \approx 10\ \text{bits/s} \times 0.05\ \text{s} = 0.5\ \text{bits} \tag{T8-1}

Dies ist deutlich weniger als ein Bit wirklich neuartiger Information pro Wahrnehmungsframe, und doch erscheint die phänomenale Szene informationell dicht. Um diese Diskrepanz aufzulösen, ohne die enge Aktualisierungsbandbreite künstlich aufzublähen, müssen wir explizit zwischen zwei strukturell verschiedenen Größen unterscheiden: 1. C_{\max} — der Aktualisierungsdurchsatz: die Rate des Vorhersagefehlersignals, das pro Zeiteinheit in das festgelegte kausale Protokoll aufgelöst wird. 2. C_{\text{state}} — die Komplexität des Dauerzustands: die Kolmogorov-Komplexität K(P_\theta(t)) des aktuell geladenen und aktiven generativen Modells.

Dies sind nicht dieselben Größen. C_{\max} bestimmt das Gate; C_{\text{state}} charakterisiert den Raum. Der Rest dieses Abschnitts präzisiert diese Unterscheidung und führt den Phänomenalen Zustandstensor P_\theta(t) als das formale Objekt ein, das der fortbestehenden inneren Szene entspricht.

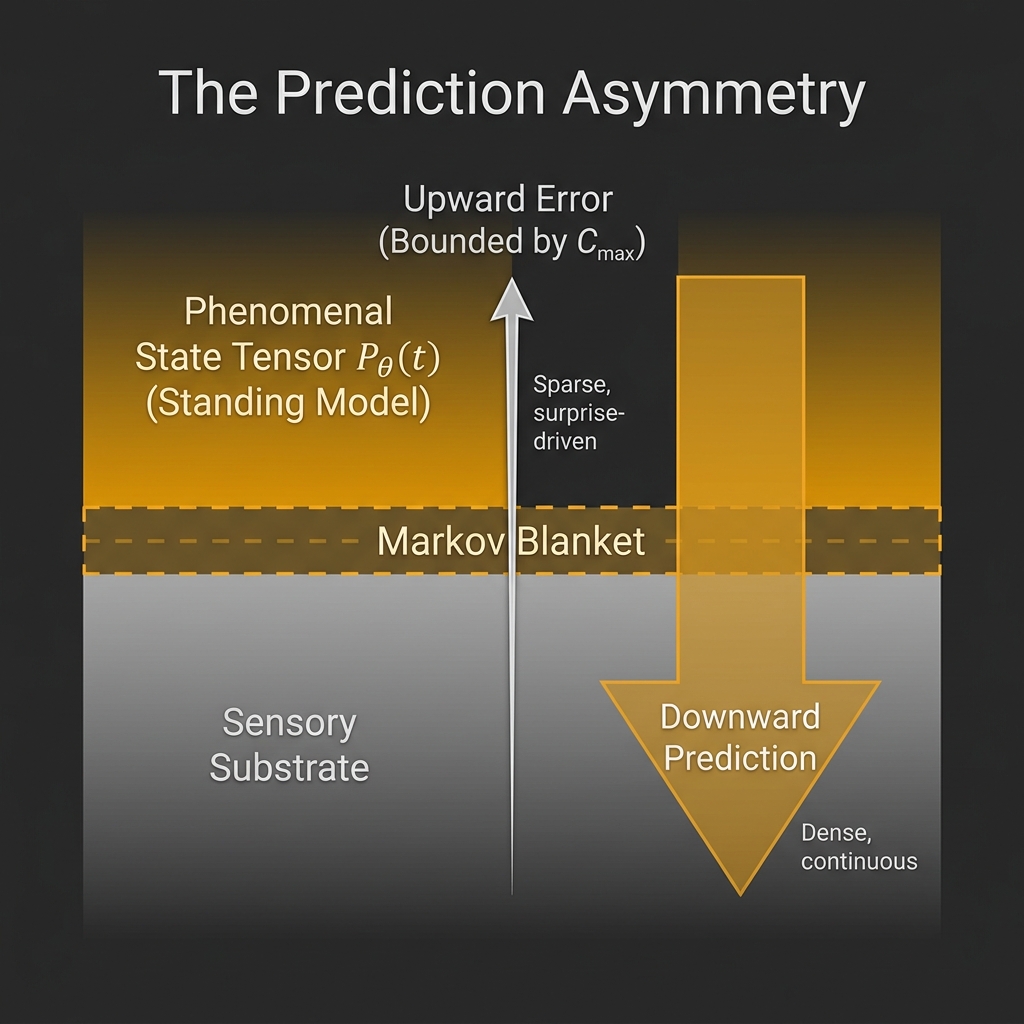

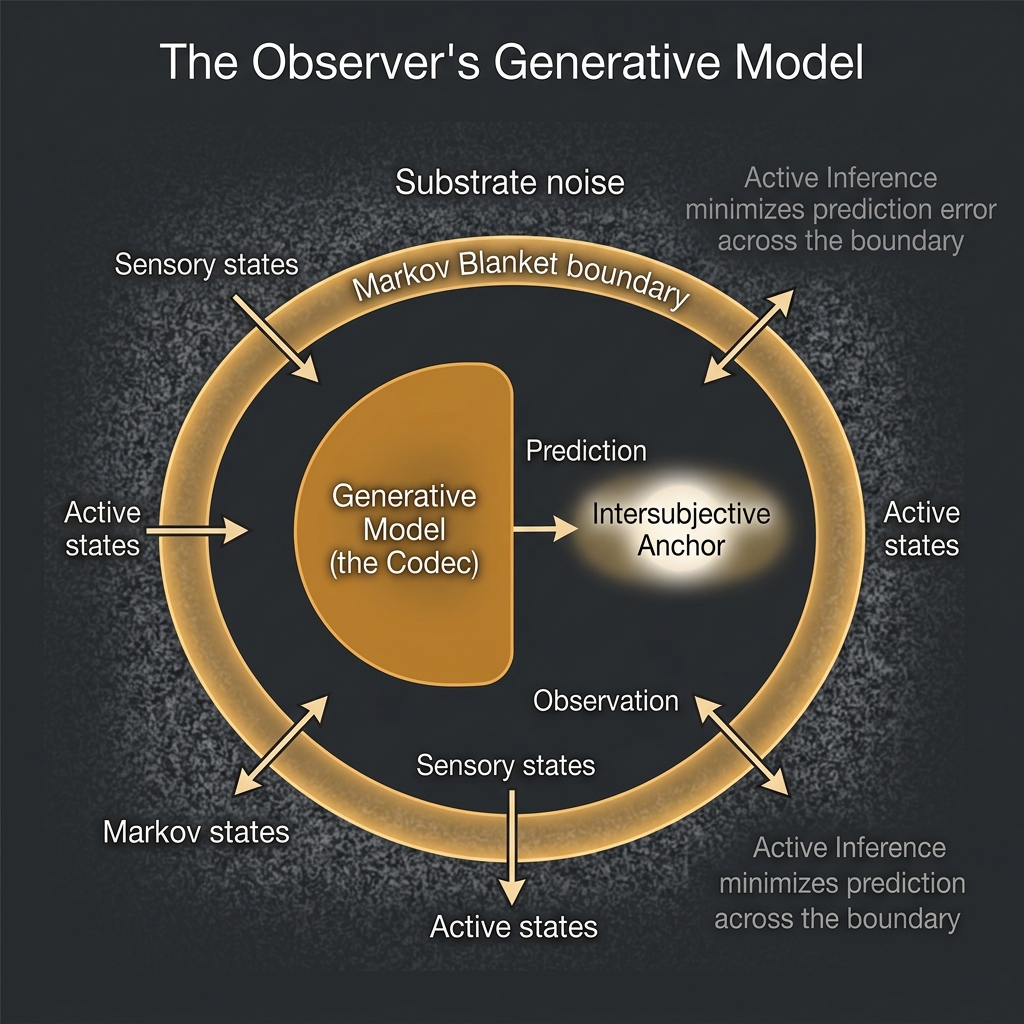

3.5.2 Die Vorhersageasymmetrie: Aufwärtsfehler und Abwärtsvorhersagen

OPT übernimmt die Architektur des Predictive Processing (Clark [82], Hohwy [83]; siehe §7.3), in der der Codec K_\theta als hierarchisches generatives Modell operiert. Innerhalb dieser Architektur durchqueren zwei unterschiedliche Informationsflüsse gleichzeitig die Markov-Decke \partial_R A:

Aufwärtsfluss (Vorhersagefehler, \varepsilon_t): die Diskrepanz zwischen der aktuellen Vorhersage von K_\theta und dem sensorischen Signal, das an \partial_R A eintrifft. Dies ist das Korrektursignal. Es ist spärlich, überraschungsgetrieben und strikt kapazitätsbegrenzt.

Abwärtsfluss (Vorhersage, \pi_t): das aktive Rendern erwarteter sensorischer Zustände durch das generative Modell, fortgepflanzt von höheren zu niedrigeren hierarchischen Ebenen. Dies ist die Szene selbst. Sie ist dicht, kontinuierlich und aus der vollständigen Parametrisierung von K_\theta hervorgebracht.

Formal sei der sensorische Grenzzustand X_{\partial_R A}(t), und der vom Codec vorhergesagte Grenzzustand sei:

\pi_t := \mathbb{E}_{K_\theta}\!\left[X_{\partial_R A}(t) \mid Z_t\right] \tag{T8-2}

Der Vorhersagefehler ist dann:

\varepsilon_t := X_{\partial_R A}(t) - \pi_t \tag{T8-3}

C_{\max} begrenzt das Fehlersignal, nicht die Vorhersage. Die wechselseitige Information zwischen dem Fehlersignal und dem Bottleneck-Zustand erfüllt:

I(\varepsilon_t\,;\,Z_t) \leq C_{\max} \cdot \Delta t = B_{\max} \tag{T8-4}

Die Vorhersage \pi_t hingegen wird aus dem vollständigen generativen Modell gezogen und unterliegt keiner solchen Beschränkung. Ihr Informationsgehalt ist nur durch die Komplexität von K_\theta selbst begrenzt. Diese Asymmetrie bildet die formale Grundlage für die Unterscheidung zwischen phänomenalem Reichtum und Aktualisierungsbandbreite.

3.5.3 Definition: Der Phänomenale Zustandstensor P_\theta(t)

Wir definieren den Phänomenalen Zustandstensor P_\theta(t) nativ als die vollständige aktive stehende Parametermenge des generativen Modells, das eingesetzt wird, um zum Zeitpunkt t durch die Markov-Decke zu projizieren:

P_\theta(t) := \bigl\{\, K_\theta(\cdot,\, \cdot) \,\bigr\}_{\text{active}} \tag{T8-5}

Das heißt, P_\theta(t) ist die vollständig parametrisierte Architektur, die der Codec derzeit bereithält, um Vorhersagen über die beobachtbaren Randzustände X_{\partial_R A} zu erzeugen, bewertet unabhängig von jeder einzelnen spezifischen Instanziierung des komprimierten latenten Zustands Z_t und der Handlung a_t. Seine strukturelle Komplexität wird auf natürliche Weise durch die Kolmogorov-Komplexität dieser gegenwärtigen stehenden Parameterkonfiguration charakterisiert:

C_{\text{state}}(t) := K\!\left(P_\theta(t)\right) \tag{T8-6}

wobei K(\cdot) die Präfix-Kolmogorov-Komplexität bezeichnet. C_{\text{state}}(t) ist die Komplexität des stehenden Zustands — die Anzahl der Bits komprimierter Struktur, die der Codec derzeit in aktiver Verwendung hält.

Obere Schranke für den Fluss des Randkanals. Die wechselseitige Information zwischen dem Bottleneck-Zustand und dem Rand ist durch Standard-Ungleichungen der Shannon-Theorie beschränkt [16] (Gl. 8 des Basisartikels):

I\!\left(Z_t\,;\,X_{\partial_R A}\right) \leq H\!\left(X_{\partial_R A}\right) \leq |\partial_R A|\cdot \log q \tag{T8-7}

Dies beschränkt den Kanalfluss über die Markov-Decke — enorm groß relativ zu B_{\max}. Wichtiger Vorbehalt: Dies ist eine Schranke für die Shannon-theoretische wechselseitige Information I(Z_t\,;\,X_{\partial_R A}), nicht eine Schranke für die Kolmogorov-Komplexität K(P_\theta(t)) des stehenden Modells. Die Shannon-Entropie quantifiziert die ensemblegemittelte Unsicherheit; die Kolmogorov-Komplexität quantifiziert die Beschreibungslänge eines spezifischen berechenbaren Objekts. Keine allgemeine Ungleichung verbindet diese Größen ohne zusätzliche Annahmen (z. B. ein universelles Prior über Modellklassen). Wir behaupten daher nicht, dass C_{\text{state}} \leq H(X_{\partial_R A}). Die Komplexität des stehenden Zustands C_{\text{state}} wird empirisch begrenzt (§3.10), nicht durch die Randentropie.

Heuristische untere Schranke für C_{\text{state}}. Der Stabilitätsfilter beschränkt direkt nur die Aktualisierungsrate R_{\text{req}} \leq B_{\max}, nicht die Tiefe des stehenden Modells. Ein Codec mit unzureichender struktureller Komplexität kann jedoch keine genauen Vorhersagen \pi_t erzeugen, die über den Zukunftsfächer \mathcal{F}_h(z_t) hinweg den Statistiken einer komplexen Umgebung entsprechen. Dies erzwingt ein praktisches Minimum für C_{\text{state}}: Unterhalb einer gewissen Schwelle würde R_{\text{req}} systematisch B_{\max} überschreiten, weil die Vorhersagefehler \varepsilon_t anhaltend groß wären. Diese untere Schranke ist empirisch motiviert und nicht formal hergeleitet — ein Ausdruck in geschlossener Form C_{\text{state}} \geq f(R_{\text{req}}, \text{environment statistics}) liegt derzeit nicht vor.

Materialisierte vs. dispositionale Lesart (offene Frage). P_\theta(t), wie oben definiert, erlaubt zwei Lesarten, die das Rahmenwerk derzeit formal nicht unterscheidet: (a) eine materialisierte Lesart, in der P_\theta(t) eine dichte, augenblicklich geladene Repräsentation ist, deren Reichhaltigkeit pro Frame in aktiver Form vorliegt, und (b) eine dispositionale Lesart, in der P_\theta(t) eine generative Kapazität ist — ein stehendes Programm, das die Szene bei Bedarf rendern kann, ohne dass zwischen Anfrage und Antwort alles materialisiert sein muss. Beide sind mit den obigen Klauseln zum Randkanal und zur heuristischen unteren Schranke vereinbar sowie mit der empirischen Festlegung in §3.5.6, dass Reichhaltigkeit mit K(K_\theta) und nicht mit der Aktualisierungsbandbreite korreliert. Sie unterscheiden sich darin, was „geladen“ bedeutet, und darin, was gemessen werden sollte, wenn K(P_\theta) direkt untersucht wird. Die Kolmogorov-Komplexität allein trennt sie nicht: Ein kleines K(P_\theta) kann hohe logische Tiefe, große Anfrage-Antwort-Kapazität oder eine lange Laufzeitexpansion tragen. Wir übernehmen hier die dispositionale Lesart als kanonische Interpretation — P_\theta(t) ist der aktive dispositionale generative Zustand, aus dem die Szene abgefragt/gerendert werden kann, nicht notwendigerweise ein vollständig materialisiertes dichtes Szenenobjekt — und kennzeichnen die materialisierte Lesart als konkurrierende Operationalisierung, die durch zukünftige empirische Arbeit ausgewählt werden könnte.

3.5.4 Blocks Unterscheidung als ein Strukturelles Korollar

Die formale Unterscheidung zwischen P_\theta(t) und Z_t bildet Ned Blocks Unterscheidung zwischen phänomenalem Bewusstsein (P-Bewusstsein) und Zugangsbewusstsein (A-Bewusstsein) [47] präzise ab:

| Blocks Kategorie | OPT-Objekt | Informationsgehalt | Bandbreitenbegrenzt? |

|---|---|---|---|

| P-Bewusstsein (Qualia, gefühlte Szene) | P_\theta(t) | C_{\text{state}} = K(P_\theta(t)) \gg B_{\max} | Nein |

| A-Bewusstsein (berichtbarer Inhalt) | Z_t | B_{\max} = C_{\max} \cdot \Delta t \approx 0.5\ \text{bits} | Ja |

Unter OPT ist P-Bewusstsein die abwärtsgerichtete Vorhersage \pi_t, die aus dem vollständigen Tensor P_\theta(t) gezogen wird. A-Bewusstsein ist der Bottleneck-Output Z_t — der schmale Ausschnitt der Szene, der hinreichend komprimiert wurde, um in das Kausale Protokoll \mathcal{R}_t einzugehen und für den Bericht verfügbar zu werden. Die gefühlte Reichhaltigkeit eines visuellen Moments ist P_\theta(t); die Fähigkeit zu sagen „Ich sehe Rot“ erfordert, dass dieses Merkmal durch Z_t hindurchgeht.

Dieses Korollar löst das scheinbare Paradox einer reichen phänomenalen Szene, die durch einen Aktualisierungskanal von unter einem Bit aufrechterhalten wird: Die Szene wird nicht in jedem Frame durch den Kanal geliefert — sie ist in P_\theta(t) bereits geladen. Der Kanal aktualisiert sie inkrementell und selektiv, Frame für Frame.

3.5.5 Die Aktualisierungsdynamik von P_\theta(t)

Die Aktualisierungsregel für P_\theta(t) wird durch das durch den Bottleneck gefilterte Vorhersagefehlersignal \varepsilon_t bestimmt:

P_\theta(t+1) = \mathcal{U}\!\left(P_\theta(t),\, \varepsilon_t,\, Z_t\right) \tag{T8-8}

wobei \mathcal{U} der Lernoperator des Codec ist — in den Begriffen der Aktiven Inferenz der Gradientenschritt auf der variationalen freien Energie \mathcal{F}[q, \theta] (Gl. 9 des Basisartikels), eingeschränkt durch die Kapazitätsbedingung I(X_t\,;\,Z_t) \leq B.

Die zentrale strukturelle Eigenschaft besteht darin, dass \mathcal{U} selektiv ist: Aktualisiert werden nur jene Bereiche von P_\theta(t), die durch den aktuellen Vorhersagefehler \varepsilon_t betroffen sind. Der übrige Teil des stehenden Tensors bleibt über den Frame hinweg konstant. Dies verleiht dem bewussten Moment seine charakteristische Struktur: einen stabilen phänomenalen Hintergrund, vor dem sich ein kleiner Vordergrund aufgelöster Neuheit abzeichnet.

Der Codec implementiert damit eine Form von spärlicher Aktualisierung auf dichtem Prior — ein Konstruktionsprinzip, das die phänomenale Kohärenz pro Einheit der Aktualisierungsbandbreite maximiert.

3.5.6 Reichweite und epistemischer Status

Der Phänomenale Zustandstensor P_\theta(t) ist eine formale Charakterisierung des strukturellen Schattens, den die phänomenale Szene im Einklang mit dem Handlungs-Axiom (§3.6) werfen muss. Er löst nicht das Schwere Problem. OPT behandelt phänomenales Bewusstsein weiterhin als irreduzibles Primitivum; P_\theta(t) spezifiziert die Geometrie des Behälters, nicht die Natur seines Inhalts.

Die Behauptung ist strukturell und in folgendem Sinne falsifizierbar: Wenn der qualitative Reichtum berichteter Erfahrung (operationalisiert etwa durch Maße phänomenaler Komplexität in psychophysischen Aufgaben) mit der Codec-Tiefe — der hierarchischen Komplexität von K_\theta, messbar über neuronale Marker prädiktiver Hierarchie — korreliert, statt mit der Aktualisierungsbandbreite C_{\max}, dann wird die Unterscheidung P_\theta\,/\,Z_t empirisch gestützt. Psychedelische Zustände, die die Struktur von K_\theta dramatisch verändern, ohne den Verhaltensdurchsatz konsistent zu verändern, stellen hierfür einen natürlichen Testbereich dar.

3.6 Der Codec-Lebenszyklus: Der Wartungszyklus-Operator \mathcal{M}_\tau

3.6.1 Das Problem des statischen Codecs

Der Rahmen von §§3.1–3.5 behandelt K_\theta und seine Realisierung P_\theta(t) als über Aktualisierungs-Frames hinweg dynamisch, setzt jedoch implizit voraus, dass die strukturelle Architektur des Codecs — der Parameterraum \Theta selbst — fest ist. Das ist für eine synchronische Analyse eines einzelnen bewussten Moments ausreichend, aber unzureichend für eine Theorie des Bewusstseins über tiefe Zeiträume hinweg.

Ein Codec, der kontinuierlich operiert, akkumuliert strukturelle Komplexität: Jedes gelernte Muster fügt K_\theta Parameter hinzu und erhöht damit C_{\text{state}}(t). Ohne einen Mechanismus zur kontrollierten Reduktion von Komplexität würde C_{\text{state}} monoton anwachsen, bis der Codec seine thermodynamische Obergrenze der Ausführbarkeit überschreitet — den Punkt, an dem die metabolischen Kosten der Aufrechterhaltung von P_\theta(t) das Energiebudget des Organismus übersteigen oder die interne Komplexität von K_\theta die mit der Kapazität des Stabilitätsfilters kompatible Beschreibungslänge überschreitet.

Dieser Abschnitt führt den Wartungszyklus-Operator \mathcal{M}_\tau ein — den formalen Mechanismus, durch den der Codec seine eigene Komplexität über die Zeit hinweg verwaltet, und der primär während Zuständen verringerter sensorischer Last operiert (paradigmatisch: Schlaf).

3.6.2 Die Wartungsbedingung

Definieren wir die Betriebsfähigkeitsbedingung des Codec als die Anforderung, dass die Kolmogorov-Komplexität des aktuellen generativen Modells unter einer strukturellen Obergrenze C_{\text{ceil}} bleibt, die durch das thermodynamische Budget des Organismus festgelegt ist:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T9-1}

C_{\text{ceil}} ist nicht dasselbe wie C_{\max}. Es handelt sich um eine wesentlich größere Größe — die gesamte strukturelle Komplexität, die der Codec in seinem Parameterraum aufrechterhalten kann —, doch sie ist endlich. Verletzungen von (T9-1) entsprechen kognitiver Überlastung, Gedächtnisinterferenz und letztlich dem pathologischen Fall, den Borges in [53] mit Funes dem Gedächtniskünstler beschreibt: einem System, das so viele unkomprimierte Details aufgenommen hat, dass es nicht länger prädiktiv funktionieren kann.

Der Wartungszyklus-Operator \mathcal{M}_\tau wird als ein Operator definiert, der in Zeiträumen wirkt, in denen R_{\text{req}} \ll C_{\max} gilt — genauer gesagt dann, wenn die erforderliche prädiktive Rate so weit absinkt, dass die freiwerdende Bandbreite auf interne Umstrukturierung umgelenkt werden kann:

\mathcal{M}_\tau : P_\theta(t) \;\longrightarrow\; P_\theta(t + \tau) \qquad \text{during} \quad R_{\text{req}}(t) \ll C_{\max} \tag{T9-2}

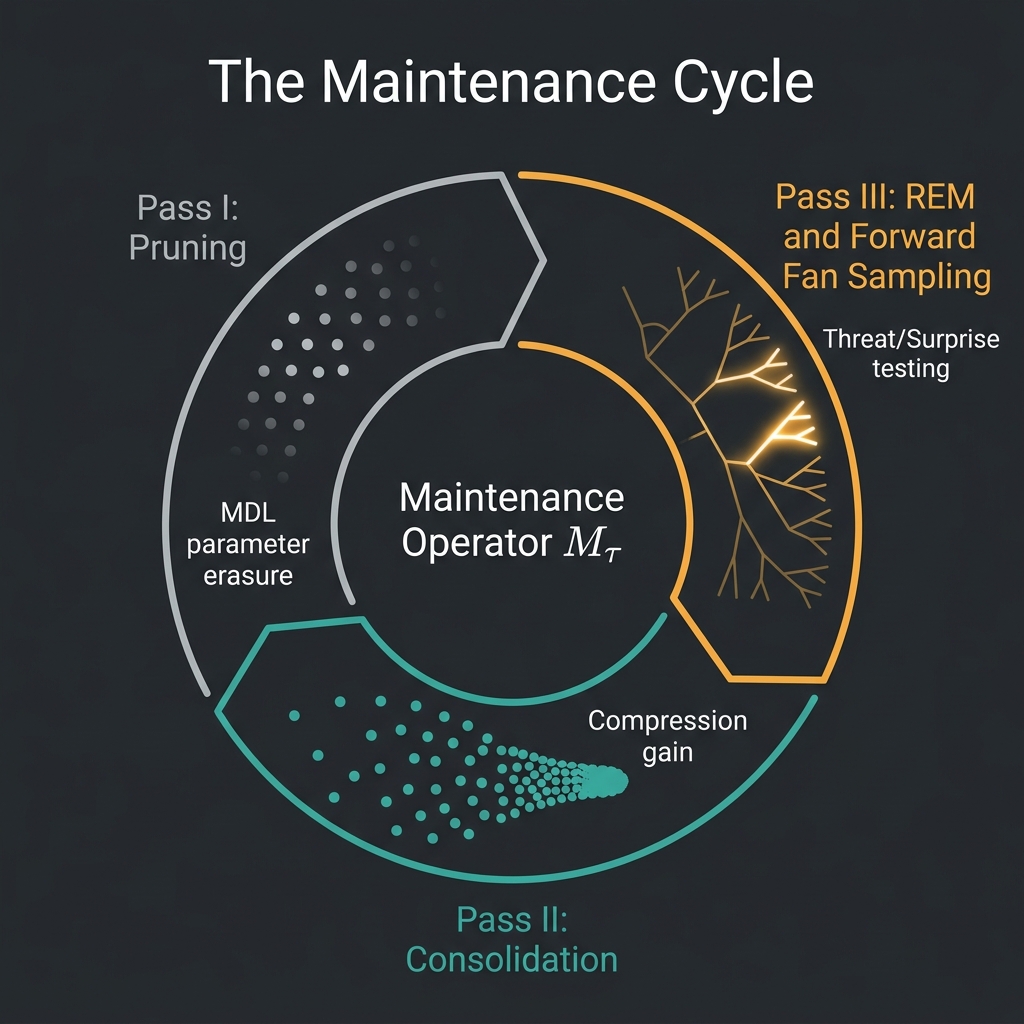

\mathcal{M}_\tau zerfällt in drei strukturell unterschiedliche Durchgänge, von denen jeder auf einen anderen Aspekt des Komplexitätsmanagements des Codec zielt.

3.6.3 Durchgang I — Pruning (Vergessen als aktiver MDL-Druck)

Der erste Durchgang übt Druck der Minimum Description Length (MDL) auf die aktuellen Codec-Parameter aus. Für jede Komponente \theta_i des generativen Modells K_\theta definiere ihren prädiktiven Beitrag als die wechselseitige Information, die sie über den zukünftigen Beobachtungsstrom liefert, abzüglich der Speicherkosten ihrer Beibehaltung:

\Delta_{\mathrm{MDL}}(\theta_i) := I\!\left(\theta_i\,;\,X_{t+1:t+\tau} \mid \theta_{-i}\right) - \lambda \cdot K(\theta_i) \tag{T9-3}

wobei \theta_{-i} alle Parameter außer \theta_i bezeichnet, \lambda eine Beibehaltungsschwelle ist (Bits zukünftiger Vorhersage, die pro Bit Modellkomplexität erkauft werden), und K(\theta_i) die Beschreibungslänge der Komponente ist.

Die Pruning-Regel lautet:

\text{Prune } \theta_i \quad \text{if} \quad \Delta_{\mathrm{MDL}}(\theta_i) < 0 \tag{T9-4}

Das heißt, \theta_i wird verworfen, wenn sein prädiktiver Beitrag pro Bit Speicher unter die Schwelle \lambda fällt. Dies ist Vergessen, formalisiert nicht als Versagen, sondern als thermodynamisch rationale Löschung: Jede geprunte Komponente gewinnt K(\theta_i) Bits an Modellkapazität zur Wiederverwendung zurück.

Nach dem Landauer-Prinzip [52] etabliert jede Pruning-Operation eine thermodynamische Untergrenze für Löschung:

W_{\text{prune}}(\theta_i) \geq K(\theta_i) \cdot k_B T \ln 2 \tag{T9-5}

Während der tatsächliche biologische Metabolismus aufgrund erheblicher Implementierungs-Overheads viele Größenordnungen über diesem theoretischen Minimum operiert (Watt statt Femtowatt), bleibt die strukturelle Notwendigkeit dieser Kosten bestehen. Bennetts Ergänzung zu Landauer [92] präzisiert dies weiter: logisch reversible Berechnung kann sich prinzipiell einer Dissipation von null annähern, sodass die Landauer-Untergrenze spezifisch an Löschung gebunden ist, nicht an Vorhersage oder Transformation. Der Pruning-Durchgang — und nicht der Vorhersage-Durchgang — ist daher der thermodynamisch irreduzible Schritt im Wartungszyklus. Schlaf trägt in der Theorie der geordneten Patches (OPT) eine fundamentale thermodynamische Signatur: Er ist eine Periode nettoer Informationslöschung, deren Energiekosten von der Physik vorgeschrieben sind und nicht bloß Ausdruck biologischer Ineffizienz.

Die aggregierte Komplexitätsreduktion des Pruning-Durchgangs ist:

\Delta K_{\text{prune}} = \sum_i K(\theta_i)\cdot \mathbf{1}\!\left[\Delta_{\mathrm{MDL}}(\theta_i) < 0\right] \tag{T9-6}

3.6.4 Durchgang II — Konsolidierung (Lernen als Kompressionsgewinn)

Der Pruning-Durchgang entfernt Komponenten mit unzureichendem prädiktivem Ertrag. Der Konsolidierungsdurchgang reorganisiert die verbleibenden Komponenten zu stärker komprimierten Repräsentationen.

Während des Wachbetriebs erwirbt der Codec Muster unter Echtzeitdruck: Jedes Update muss innerhalb von \Delta t berechnet werden, sodass keine Zeit für eine globale strukturelle Reorganisation von K_\theta bleibt. Kürzlich erworbene Muster werden in einer relativ unkomprimierten Form gespeichert — hohes K(\theta_{\text{new}}) für den prädiktiven Beitrag, den sie liefern. Der Konsolidierungsdurchgang wendet auf diese jüngsten Erwerbungen eine offline-MDL-Kompression an.

Sei \Theta_{\text{recent}} \subset \Theta die Menge der seit dem letzten Wartungszyklus erworbenen Parameter. Der Konsolidierungsoperator findet die Reparametrisierung \theta' minimaler Komplexität von \Theta_{\text{recent}}, sodass die von ihr erzeugte prädiktive Verteilung innerhalb einer tolerierbaren Verzerrung D_c des Originals liegt:

\theta'_{\text{cons}} = \arg\min_{\theta'} K(\theta') \quad \text{s.t.} \quad D_{\mathrm{KL}}\!\left(P_{\theta'}(\cdot) \,\Big\|\, P_{\Theta_{\text{recent}}}(\cdot)\right) \leq D_c \tag{T9-7}

Der zurückgewonnene Kompressionsgewinn ist:

\Delta K_{\text{compress}} = K(\Theta_{\text{recent}}) - K(\theta'_{\text{cons}}) \tag{T9-8}

\Delta K_{\text{compress}} ist die Anzahl an Bits an Modellkapazität, die durch die Reorganisation jüngster Erfahrung in effizientere Repräsentationen zurückgewonnen wird. Jede Einheit von \Delta K_{\text{compress}} reduziert direkt das zukünftige R_{\text{req}} für ähnliche Umgebungen — der Codec wird in vertrautem Terrain kostengünstiger im Betrieb.

Dies formalisiert die empirisch beobachtete Funktion der hippocampal-neokortikalen Gedächtniskonsolidierung während des Slow-Wave-Schlafs: Der Transfer von hochbandbreitiger episodischer Speicherung (Hippocampus, hohes K) zu komprimierter semantischer Speicherung (Neokortex, niedriges K) ist genau die Kompressionsoperation aus (T9-7). Die Vorhersage lautet, dass der Kompressionsgewinn \Delta K_{\text{compress}} mit dem Ausmaß der nach dem Schlaf beobachteten Verhaltensverbesserung bei Aufgaben korrelieren sollte, die strukturierte Mustererkennung beinhalten.

3.6.5 Durchgang III — Zukunftsfächer-Sampling (Träumen als adversariales Selbsttesten)

Der dritte Durchgang findet primär während des REM-Schlafs statt, wenn sensorischer Input aktiv abgeschirmt und motorischer Output gehemmt ist. Unter diesen Bedingungen gilt R_{\text{req}} \approx 0: Der Codec erhält kein Korrektursignal aus der externen Umgebung. Das gesamte Bandbreitenbudget C_{\max} steht für den internen Betrieb zur Verfügung.

Die OPT fasst diesen Zustand formal als uneingeschränkte Zukunftsfächer-Exploration: Der Codec erzeugt Trajektorien durch \mathcal{F}_h(z_t) — die Menge zulässiger zukünftiger Sequenzen (Gl. 5 des Grundlagenpapiers) —, ohne diese Trajektorien an reale eingehende Daten zu binden. Dies ist Simulation: Der Codec lässt sein generatives Modell K_\theta zeitlich vorwärts laufen, ungehindert von der Realität.

Die Sampling-Verteilung über den Fächer ist nicht uniform. Definiere das Wichtigkeitsgewicht eines Zweigs b \in \mathcal{F}_h(z_t) als:

w(b) := \exp\!\left(\beta\cdot |E(b)|\right) \tag{T9-9}

wobei \beta ein inverser Temperaturparameter ist und E(b) die emotionale Valenz des Zweigs ist, definiert als:

E(b) := -\log P_{K_\theta}(b \mid z_t) + \alpha \cdot \mathrm{threat}(b) \tag{T9-10}

Der erste Term -\log P_{K_\theta}(b \mid z_t) ist die negative Log-Wahrscheinlichkeit des Zweigs unter dem aktuellen Codec — sein Überraschungswert. Der zweite Term \mathrm{threat}(b) ist ein fitnessrelevantes Konsequenzmaß, formal definiert als der erwartete Anstieg der Erforderlichen Prädiktiven Rate, falls der Codec Zweig b durchlaufen würde:

\mathrm{threat}(b) := \mathbb{E}\!\left[\, R_{\text{req}}(D_{\min} \mid b) - R_{\text{req}}(D_{\min} \mid z_t)\,\right] \tag{T9-10a}

Das heißt, \mathrm{threat}(b) quantifiziert das Ausmaß, in dem Zweig b, falls er im Wachleben realisiert würde, den Codec an oder über seine Bandbreitenobergrenze B_{\max} treiben würde — durch körperlichen Schaden, sozialen Bruch oder narrativen Kollaps, der eine kostspielige Modellrevision erzwingen würde. Zweige mit \mathrm{threat}(b) > B_{\max} - R_{\text{req}}(D_{\min} \mid z_t) sind existenziell bedrohlich: Sie würden die Bedingung des Stabilitätsfilters verletzen. Der Gewichtungsparameter \alpha \geq 0 steuert den relativen Einfluss von Konsequenz gegenüber Überraschung in der Sampling-Verteilung.

Der Sampling-Operator zieht Zweige proportional zu w(b):

b_{\text{sample}} \sim \mathcal{F}_h(z_t) \quad \text{mit Wahrscheinlichkeit} \propto w(b) \tag{T9-11}

Dies implementiert wichtigkeitsgewichtetes Zukunftsfächer-Sampling: Der Codec probt überproportional Zweige durch, die entweder stark überraschend oder stark folgenträchtig sind, unabhängig von ihrer Basisraten-Wahrscheinlichkeit. Zweige mit niedriger Wahrscheinlichkeit und hoher Bedrohung — genau jene, auf die der Codec am wenigsten vorbereitet ist — erhalten die größte Sampling-Aufmerksamkeit.

Jeder gesampelte Zweig wird dann auf Kohärenz unter K_\theta geprüft. Zweige, die inkohärente Vorhersagesequenzen erzeugen — bei denen das generative Modell des Codecs selbst keine narrative Stabilität aufrechterhalten kann —, werden als Brittleness-Punkte identifiziert: Regionen des Zukunftsfächers, in denen der Codec versagen würde, wenn ihm der Zweig im Wachleben begegnete. Der Codec kann dann P_\theta aktualisieren, um die Verwundbarkeit von K_\theta an diesen Punkten zu verringern, bevor er ihnen unter realen thermodynamischen Einsätzen ausgesetzt ist.

Träumen ist daher adversariales Selbsttesten des Codecs bei null Risiko. Die funktionale Konsequenz ist ein Codec, der systematisch besser auf die Zweige seines eigenen Zukunftsfächers mit niedriger Wahrscheinlichkeit und hoher Konsequenz vorbereitet ist. Diese OPT-Rahmung liefert eine informationstheoretische Fundierung für Revonsuos [46] Threat-Simulation-Theorie des Träumens und erweitert sie von einer evolutionär-funktionalen Erklärung zu einer formalen strukturellen Notwendigkeit: Jeder Codec, der unter dem Stabilitätsfilter operiert, muss seinen eigenen Zukunftsfächer periodisch einem Stresstest unterziehen, und der Offline-Wartungszustand ist die einzige Phase, in der dies ohne thermodynamische Kosten in der realen Welt geschehen kann.

Emotionale Markierung als Prior für Retentionsgewichte. Im Wachzustand dient die während des REM-Samplings berechnete emotionale Valenz E(b) als a-priori-Retentionsgewicht, das den MDL-Schwellenwert \lambda in (T9-3) verzerrt. Erfahrungen mit hohem |E(b)| — stark überraschende oder folgenträchtige — erhalten ein höheres effektives \lambda und werden dadurch im nächsten Wartungszyklus resistenter gegen Pruning. Dies ist die formale Erklärung emotionaler Gedächtnisverstärkung: Affekt ist kein Rauschen, das das Gedächtnissystem kontaminiert; er ist das Relevanzsignal des Codecs, das Muster markiert, deren prädiktiver Wert ihre statistische Basisratenfrequenz übersteigt.

3.6.6 Der vollständige Wartungszyklus und das Netto-Komplexitätsbudget

Die drei Durchläufe von \mathcal{M}_\tau setzen sich sequentiell zusammen. Der Nettoeffekt auf die Codec-Komplexität über einen Wartungszyklus der Dauer \tau ist:

K\!\left(P_\theta(t+\tau)\right) = K\!\left(P_\theta(t)\right) - \Delta K_{\text{prune}} - \Delta K_{\text{compress}} + \Delta K_{\text{REM}} \tag{T9-12}

wobei \Delta K_{\text{REM}} der kleine positive Zuwachs aus Mustern ist, die neu aus dem REM-Sampling-Durchlauf konsolidiert wurden — jene Reparaturen an Brüchigkeitspunkten, die neue Parameteraktualisierungen erforderten.

Für ein stabiles kognitives System, das über Jahre hinweg operiert, erfordert das Langzeitbudget:

\left\langle \Delta K_{\text{prune}} + \Delta K_{\text{compress}} \right\rangle \geq \left\langle \Delta K_{\text{waking}} + \Delta K_{\text{REM}} \right\rangle \tag{T9-13}

wobei \Delta K_{\text{waking}} die während der vorangehenden Wachperiode erworbene Komplexität ist. Die Ungleichung (T9-13) ist die formale Aussage, dass die Wartung mit dem Erwerb Schritt halten muss. Chronischer Schlafentzug ist in den Begriffen der OPT nicht bloß Müdigkeit — er ist ein fortschreitender Komplexitätsüberlauf: Der Codec nähert sich C_{\text{ceil}}, während sein Budget für Pruning und Konsolidierung nicht ausreicht, um wieder Spielraum herzustellen.

3.6.7 Empirische Vorhersagen

Der Rahmen des Wartungszyklus erzeugt die folgenden testbaren strukturellen Erwartungen:

Die Schlafdauer skaliert mit der Komplexität des Codecs. Organismen oder Individuen, die während der Wachphasen stärker strukturierte Informationen erwerben, sollten proportional längere oder tiefere Wartungszyklen benötigen. Die Vorhersage lautet nicht einfach, dass harte kognitive Arbeit mehr Schlaf erfordert (was etabliert ist), sondern dass die Art des Lernens relevant ist: musterreiches, komprimierbares Lernen sollte weniger Konsolidierungszeit erfordern als unstrukturierte, hochentropische Erfahrung, weil \Delta K_{\text{compress}} im ersten Fall größer ist.

REM-Inhalte sind über den Zukunftsfächer nach Wichtigkeit gewichtet, nicht nach Häufigkeit. Trauminhalte sollten im Verhältnis zu ihrer Wachhäufigkeit überproportional Zweige mit niedriger Wahrscheinlichkeit und hohen Konsequenzen sampeln. Das stimmt mit der empirischen Dominanz von Bedrohungen, sozialen Konflikten und neuartigen Umgebungen in Traumberichten überein — der Codec sampelt das, was er für den Stresstest benötigt, nicht das, womit er am häufigsten konfrontiert ist.

Die Kompressionseffizienz verbessert sich nach dem Schlaf proportional zu \Delta K_{\text{compress}}. Die spezifische Vorhersage lautet, dass Leistungsverbesserungen nach dem Schlaf bei Aufgaben am größten sein sollten, die strukturelle Generalisierung erfordern (d. h. die Anwendung einer komprimierten Regel auf neue Instanzen), statt bloßer Wiederholung — weil \Delta K_{\text{compress}} \Theta_{\text{recent}} gezielt in stärker verallgemeinerbare Formen reorganisiert.

Pathologisches Grübeln entspricht einem REM-Sampling, das bei Zweigen mit hohem |E| feststeckt. Wenn der Wichtigkeitsgewichtungsparameter \beta pathologisch erhöht ist, konzentriert sich die Sampling-Verteilung über \mathcal{F}_h(z_t) auf Zweige mit hoher Bedrohung unter Ausschluss von Reparatur. Der Codec verbringt seinen Wartungszyklus damit, wiederholt dieselben bedrohlichen Zweige zu sampeln, ohne ihren Überraschungswert erfolgreich zu reduzieren — die formale Struktur von Angst und PTSD-Albträumen.

3.6.8 Beziehung zum Phänomenalen Zustandstensor

\mathcal{M}_\tau wirkt auf P_\theta(t), wie in §3.5 definiert: Es restrukturiert die Komplexität des stehenden Zustands C_{\text{state}} über das Wartungsfenster hinweg. Das zeitliche Profil von P_\theta(t) unter \mathcal{M}_\tau ist:

- Wacher Erwerb: C_{\text{state}} steigt mit einer durch den Lernoperator \mathcal{U} begrenzten Rate (Gl. T8-8), da neue Muster in K_\theta integriert werden.

- Slow-Wave-Schlaf (Durchgänge I–II): C_{\text{state}} nimmt ab, da Pruning und Konsolidierung Modellkapazität zurückgewinnen.

- REM (Durchgang III): C_{\text{state}} erfährt an Brüchigkeitspunkten eine selektive lokale Zunahme, wobei der Nettoeffekt im Verhältnis zu den Reduktionen der Durchgänge I–II gering ist.

Die bewusste Erfahrung, die jeder Phase entspricht, ist mit dieser Struktur vereinbar: Das Wachleben akkumuliert den Reichtum von P_\theta(t); der Slow-Wave-Schlaf ist phänomenal spärlich oder fehlt ganz (im Einklang mit einer minimalen Aktivierung von P_\theta(t) während der strukturellen Reorganisation); REM zeigt eine phänomenal lebhafte, aber intern erzeugte Szene (Durchgang III, der das vollständige generative Modell in Abwesenheit sensorischer Korrektur vorwärts laufen lässt).

Zusammenfassung: Neu eingeführte formale Objekte

| Symbol | Name | Definition | Gleichung |

|---|---|---|---|

| P_\theta(t) | Phänomenaler Zustandstensor | Vollständige Aktivierung von K_\theta zum Zeitpunkt t, projiziert durch \partial_R A | T8-5 |

| C_{\text{state}}(t) | Komplexität des Dauerzustands | K(P_\theta(t)), Kolmogorov-Komplexität des aktiven Codec | T8-6 |

| \pi_t | Abwärtsgerichtete Vorhersage | \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t], die gerenderte Szene | T8-2 |

| \varepsilon_t | Vorhersagefehler (aufwärts) | X_{\partial_R A}(t) - \pi_t, durch C_{\max} begrenztes Neuheitssignal | T8-3 |

| \mathcal{M}_\tau | Wartungszyklus-Operator | P_\theta(t) \to P_\theta(t+\tau) unter niedrigem R_{\text{req}} | T9-2 |

| \Delta_{\mathrm{MDL}}(\theta_i) | MDL-Beibehaltungswert | Prädiktiver Beitrag minus Speicherkosten | T9-3 |

| E(b) | Emotionale Valenz des Zweigs | Überraschung plus gewichtete Bedrohung des Zweigs b | T9-10 |

| w(b) | Wichtigkeitsgewicht des Zweigs | \exp(\beta \cdot |E(b)|), steuert die REM-Stichprobenverteilung | T9-9 |

| \Delta K_{\text{prune}} | Wiedergewonnene Komplexität durch Pruning | Durch das Vergessen von Komponenten unterhalb des Schwellenwerts zurückgewonnene Bits | T9-6 |

| \Delta K_{\text{compress}} | Kompressionsgewinn durch Konsolidierung | Durch MDL-Rekompression jüngster Erwerbungen zurückgewonnene Bits | T9-8 |

3.7 Die Tensornetzwerk-Abbildung: Geometrie aus Code-Distanz induzieren

Die in §3.4 eingeführte epistemische Leiter etabliert ein rigoroses klassisches Randgesetz (S_{\mathrm{cut}} \sim |\partial_R A|). Um jedoch die Theorie der geordneten Patches (OPT) vollständig mit der Geometrisierung von Quanteninformation (z. B. AdS/CFT und der Ryu-Takayanagi-Formel) zu verbinden, müssen wir die Struktur des latenten Codes Z_t formal aufwerten.

Wenn wir formal postulieren, dass die Bottleneck-Abbildung q^\star(z \mid X_t) nicht einfach eine flache Liste von Merkmalen extrahiert, sondern über einen rekursiven, coarse-graining-basierten Renormierungsgruppenfluss operiert, dann richtet sich das generative Modell strukturell auf die Geometrie eines hierarchischen Tensornetzwerks \mathcal{T} aus (ähnlich MERA [43] oder HaPY-Netzwerken [44]). (Anmerkung: Anhang T-3 leitet formal eine strukturell homomorphe Entsprechung zwischen der coarse-graining-Kaskade des Stabilitätsfilters und der begrenzenden MERA-Netzwerkgeometrie her und bildet dabei den Informationellen Kausalkegel strikt auf den äquivalenten MERA-Kausalkegel ab.) Die Randzustände dieses Netzwerks sind genau die gescreenten Markov-Randzustände X_{\partial_R A}. Das Netzwerk \mathcal{T} fungiert als Bulk-Geometrie, deren „Tiefe“ die Schichten des rechnerischen coarse-graining repräsentiert, die erforderlich sind, um den Rand in den minimalen Bottleneck-Zustand Z_t zu komprimieren.

Unter dieser Tensornetzwerk-Aufwertung transformiert sich die prädiktive Schnittentropie S_{\mathrm{cut}}(A) über den Rand mathematisch in die minimale Anzahl von Tensorbindungen, die durchtrennt werden müssen, um die Unterregion A zu isolieren. Sei \chi die Bindungsdimension des Netzwerks. Die Kapazitätsschranke bildet sich intern wie folgt ab:

S_{\mathrm{cut}}(A) \le |\gamma_A| \log \chi \tag{11}

wobei \gamma_A die Minimal-Schnitt-Fläche durch die innere tiefe Bulk-Datenstruktur von \mathcal{T} ist. Dies ist explizit ein diskretes strukturelles Analogon der durch die holografische Entropieschranke von Ryu-Takayanagi abgebildeten Bulk-Minimal-Schnitt-Schicht [89]. Anhang P-2 (Theorem P-2d) etabliert formal die vollständige diskrete Quanten-RT-Formel S_{\text{vN}}(\rho_A) \leq |\gamma_A| \log \chi über den Schmidt-Rang des MERA-Zustands, bedingt durch das dort hergeleitete lokale Rauschmodell und die QECC-Einbettung. Der Kontinuumslimes, der dies zur vollständigen Ryu-Takayanagi-Formel mit Bulk-Korrekturterm aufwertet, bleibt eine offene Flanke.

Entscheidend ist, dass dieser „Bulk-Raum“ in der OPT kein vorab existierender physischer Behälter ist. Er ist der strikt informationelle metrische Raum des Codec des Beobachters. Die emergente phänomenologische Raumzeitgeometrie „krümmt“ sich genau dort, wo die erforderliche Code-Distanz divergiert, um überlappende interne kausale Zustände aufzulösen. Dieser Tensornetzwerk-Formalismus veranschaulicht einen formalen Pfad, auf dem OPT räumliche Geometrie direkt aus den durch den Stabilitätsfilter intrinsisch erzwungenen Fehlerkorrekturdistanzen induzieren könnte — strukturell ausgerichtet auf Van Raamsdonks Programm, wonach Verschränkung Raumzeit aufbaut [88] — und bietet damit eine konstruktive Vermutung, dass holografische Raumzeit optimale Datenkompressionsformate modelliert.

3.8 Das Handlungs-Axiom & das Phänomenale Residuum

Der in den Abschnitten 3.1–3.7 entwickelte mathematische Apparat definiert die Geometrie der Realität des Beobachters präzise — das Tensornetzwerk, den prädiktiven Schnitt und den Kausalkegel. Doch welcher Natur ist die primitive Innerlichkeit, die den Durchgang durch diese Struktur erlebt? Formal definieren wir dies über das Handlungs-Axiom: Die Durchquerung der C_{\max}-Apertur ist ihrem Wesen nach ein phänomenologisches Ereignis.

Während wir das Vorhandensein subjektiven Erlebens als axiomatisch ansetzen, identifiziert Theorem P-4 (Das Phänomenale Residuum) dessen rigoroses strukturelles Korrelat. Weil der begrenzte Codec die Grenze \partial_R A aktiv perturbiert, erfordert stabile Vorhersage innerhalb der Grenzen von C_{\max}, dass er die Konsequenzen seiner eigenen zukünftigen Handlungen modelliert. Daher muss der Codec K_{\theta} ein prädiktives Selbstmodell \hat{K}_{\theta} aufrechterhalten. Aufgrund der algorithmischen Schranken informationeller Enthaltenheit [13] kann ein endliches Rechensystem jedoch keine vollständige strukturelle Repräsentation seiner selbst enthalten; das interne Modell ist strikt auf eine geringere Komplexität als der übergeordnete Codec begrenzt (K(\hat{K}_{\theta}) < K(K_{\theta})).

Dies macht ein irreduzibles Phänomenales Residuum (\Delta_{\text{self}} > 0) notwendig. Dieses nicht modellierbare Residuum fungiert als der rechnerische „blinde Fleck“ innerhalb des Zyklus Aktiver Inferenz. Weil es im informationellen Schatten existiert, der die rechnerische Reichweite des Selbstmodells übersteigt, ist es seinem Wesen nach ineffabel; weil es als lokalisierte Delta-Differenz zwischen einem bestimmten Codec und seinem Modell besteht, ist es rechnerisch privat; und da es durch fundamentale Grenzen der Selbstreferenz und notwendiger variationaler Approximation bestimmt ist, ist es nicht eliminierbar. Die topologische Verengung an der C_{\max}-Apertur ist intrinsisch mit der mathematischen Notwendigkeit eines unvollständigen Algorithmus korreliert, der seine eigenen Grenzen durchläuft. Die Mathematik beschreibt die formale Kontur der Erfahrung, und das Handlungs-Axiom behauptet, dass dieser residuale Ort das subjektive „Ich“ konstituiert. (Siehe Anhang P-4 für die formale Herleitung).

Der informationelle Wartungskreislauf

Innerhalb eines einzelnen Aktualisierungsrahmens [t, t+\Delta t] führt der Beobachter den folgenden geschlossenen kausalen Kreislauf aus:

P_\theta(t) \;\xrightarrow{\ \pi_t\ }\; \partial_R A \;\xrightarrow{\ \varepsilon_t\ }\; Z_t \;\xrightarrow{\ \mathcal{U}\ }\; P_\theta(t+1) \tag{T6-1}

Explizit:

Vorhersage (abwärts): Der aktuelle Tensor P_\theta(t) erzeugt den vorhergesagten Grenzzustand \pi_t = \mathbb{E}_{K_\theta}[X_{\partial_R A}(t) \mid Z_t] — die gerenderte Szene.

Fehler (aufwärts): Der tatsächliche Grenzzustand X_{\partial_R A}(t) trifft ein; der Vorhersagefehler \varepsilon_t = X_{\partial_R A}(t) - \pi_t wird berechnet.

Kompression: \varepsilon_t wird durch den Engpass geleitet, um Z_t zu erzeugen, das kapazitätsbegrenzte Aktualisierungstoken, mit I(\varepsilon_t\,;\,Z_t) \leq B_{\max}.

Aktualisierung: Der Lernoperator \mathcal{U}(P_\theta(t), \varepsilon_t, Z_t) revidiert P_\theta(t+1) und modifiziert selektiv nur jene Regionen des Tensors, die durch \varepsilon_t betroffen sind.

Handlung: Gleichzeitig wählt P_\theta(t) die Handlung a_t mittels Abstieg der Aktiven Inferenz auf die variationelle freie Energie \mathcal{F}[q,\theta] (Gl. 9 des Basisartikels), was die sensorische Grenze bei t+1 verändert und dadurch das nächste \varepsilon_{t+1} beeinflusst.

Interpretative Anmerkung zum Handlungsschritt. Die Sprache von Schritt 5 — „wählt die Handlung“ und „verändert die sensorische Grenze“ — ist aus dem Standardformalismus der Aktiven Inferenz des Free Energy Principle übernommen, der eine physische Umgebung voraussetzt, gegen die der Agent über aktive Zustände einwirkt. Unter der render-eigenen Ontologie der OPT (§8.6) gilt jedoch eine tiefere Lesart: Es gibt keine unabhängige äußere Welt, auf die der Codec Kraft ausübt. Was als „Handlung“ erfahren wird, ist eine Verzweigungsauswahl innerhalb des Zukunftsfächers \mathcal{F}_h(z_t); die physischen Konsequenzen dieser Auswahl treffen als nachfolgender Input \varepsilon_{t+1} ein. Die Markov-Decke \partial_R A ist keine physische Schnittstelle in zwei Richtungen, sondern die Oberfläche, über die der ausgewählte Zweig sein nächstes Segment liefert. Diese interpretative Verschiebung ändert nichts an der Mathematik von (T6-1)–(T6-3); sie präzisiert den ontologischen Status des Handlungsschritts innerhalb des Rahmens der OPT. Der Mechanismus der Verzweigungsauswahl selbst wird weiter unten behandelt.

Dies ist der informationelle Wartungskreislauf innerhalb eines Frames: ein geschlossener kausaler Mechanismus, in dem das interne Modell des Systems lokalisierte strukturelle Vorhersagen berechnet, die Grenzgradienten begrenzen, den Fehler ausliest und sich selektiv aktualisiert. Die Schleife ist im formalen Sinn strikt informationell und selbstreferenziell: P_\theta(t) bestimmt sowohl die strukturelle Vorhersage \pi_t als auch über die Handlung a_t eine prädiktive Komponente des nächsten Inputs des sequenziellen Datenstroms X_{\partial_R A}(t+1). (Ausdrücklich zu beachten: Diese rein statistische Screening-Schicht ist streng durch informationelle Markov-Grenzen definiert, die Dynamiken sauber entkoppeln, und unterscheidet sich damit grundlegend von komplexer biologischer Autopoiesis, bei der Zellstrukturen mechanisch ihre eigenen organischen Massennetzwerke herstellen).

Die Strukturelle Lebensfähigkeitsbedingung

Der Schaltkreis (T6-1) ist genau dann strukturell lebensfähig, wenn er sich selbst aufrechterhalten kann, ohne dass die informationelle Komplexität des Codecs seine lokalen Ausführbarkeitsgrenzen überschreitet. Formal:

K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \quad \forall\, t \tag{T6-2}

wobei C_{\text{ceil}} ein heuristischer Parameter ist, der die maximale strukturelle Komplexität begrenzt, die der Codec aufrechterhalten kann. Prinzipiell sollte sich C_{\text{ceil}} aus dem thermodynamischen Budget des Organismus über das Landauer-Prinzip ableiten lassen (siehe die Skizze in §3.10), doch die vollständige Herleitungskette — von metabolischer Leistung über Löschkosten bis hin zur maximal nachhaltig tragbaren Programmkomplexität — ist innerhalb der OPT noch nicht formalisiert. C_{\text{ceil}} bleibt daher eine empirisch motivierte, formal jedoch unterbestimmte Schranke. Ein System, das (T6-2) erfüllt, operiert im formalen Sinn der OPT als strukturell geschlossener Beobachter.

Wird (T6-2) verletzt — wenn K(P_\theta(t)) \to C_{\text{ceil}} —, kann der Codec keine stabilen Vorhersagen mehr über \mathcal{F}_h(z_t) hinweg aufrechterhalten, R_{\text{req}} beginnt B_{\max} zu überschreiten, und die Bedingung des Stabilitätsfilters versagt. Die narrative Kohärenz kollabiert: Der Beobachter verlässt die Menge der beobachterkompatiblen Ströme.

Der Wartungszyklus \mathcal{M}_\tau (§3.6) ist der Mechanismus, der (T6-2) über tiefe Zeit hinweg durchsetzt, indem er K(P_\theta) mittels Pruning, Konsolidierung und Zukunftsfächer-Stresstests innerhalb der Grenzen hält. Innerhalb eines Frames wird (T6-2) durch die Selektivität von \mathcal{U} aufrechterhalten: Der Aktualisierungsoperator modifiziert nur die durch \varepsilon_t implizierten Bereiche von P_\theta(t) und vermeidet so unnötiges Komplexitätswachstum pro Frame.

Handlungsfähigkeit als eingeschränkte Minimierung freier Energie

Innerhalb dieser Struktur kann Handlungsfähigkeit eine präzise formale Definition erhalten, die mit dem Handlungs-Axiom vereinbar ist — ohne darauf reduktiv zu sein.

Auf der Systemebene ist Handlungsfähigkeit die Auswahl einer Aktionssequenz \{a_t\}, welche die erwartete variationelle freie Energie minimiert, unter der informationellen Viabilitätsbedingung:

a_t^\star = \arg\min_{a_t} \;\mathbb{E}\!\left[\mathcal{F}[q, \theta]\right] \quad \text{subject to} \quad K\!\left(P_\theta(t)\right) \leq C_{\text{ceil}} \tag{T6-3}

Dies ist eingeschränkte Aktive Inferenz: Der Beobachter navigiert den Zukunftsfächer \mathcal{F}_h(z_t) nicht bloß, um den Vorhersagefehler zu minimieren, sondern um den Vorhersagefehler bei gleichzeitiger Erhaltung der Viabilität des Codec zu minimieren. Zweige, die \varepsilon vorübergehend verringern würden, dabei aber K(P_\theta) in Richtung C_{\text{ceil}} treiben, werden durch die Nebenbedingung bestraft. Der Beobachter wählt bevorzugt jene Zweige, entlang derer er als kohärenter Beobachter weiterexistieren kann.

Dies ist der formale Gehalt der Intuition, dass Handlungsfähigkeit selbsterhaltende Navigation ist: Der Codec wählt die Zweige des Zukunftsfächers, entlang derer er die Welt weiterhin komprimieren kann.

Auf der phänomenologischen Ebene bleibt das Handlungs-Axiom unberührt: Phänomenales Bewusstsein ist die irreduzible Innerlichkeit der Apertur-Durchquerung; (T6-3) beschreibt den strukturellen Schatten, den diese Durchquerung wirft, nicht ihre innere Natur.

Verzweigungsauswahl als Ausführung von \Delta_{\text{self}}

Die Formel der eingeschränkten Aktiven Inferenz (T6-3) spezifiziert das Ziel der Verzweigungsauswahl: die erwartete freie Energie unter der Nebenbedingung der Viabilität zu minimieren. Das Selbstmodell \hat{K}_\theta bewertet Zweige des Zukunftsfächers, indem es ihre Konsequenzen simuliert. Doch Theorem P-4 zeigt, dass K(\hat{K}_\theta) < K(K_\theta) — das Selbstmodell ist notwendigerweise unvollständig. Diese Unvollständigkeit hat eine direkte Konsequenz für das Problem der Verzweigungsauswahl: Das Selbstmodell begrenzt den Bereich, aus dem Auswahl erfolgen kann, kann die Auswahl selbst jedoch nicht vollständig spezifizieren.

Der eigentliche Moment der Verzweigungsauswahl — der Übergang vom bewerteten Menü zur singulären Trajektorie, die in das kausale Protokoll eingeht — findet in \Delta_{\text{self}} statt, dem informationellen Residuum zwischen dem Codec und seinem Selbstmodell. Dies ist keine Lücke im Formalismus; es ist eine strukturelle Notwendigkeit. Jeder Versuch, den Auswahlmechanismus von innen heraus vollständig zu spezifizieren, würde K(\hat{K}_\theta) = K(K_\theta) erfordern, was P-4 für jedes endliche selbstreferenzielle System als unmöglich beweist.

Dies hat drei unmittelbare Konsequenzen:

Wille und Bewusstsein teilen dieselbe strukturelle Adresse. Das Schwere Problem (warum fühlt sich Durchquerung nach etwas an?) und das Problem der Verzweigungsauswahl (was wählt aus?) verweisen beide auf \Delta_{\text{self}}. Es sind nicht zwei Rätsel, sondern zwei Aspekte desselben strukturellen Merkmals — der nicht modellierbaren Lücke zwischen dem, was der Codec ist, und dem, was er über sich selbst modellieren kann.

Die Irreduzibilität von Handlungsfähigkeit wird erklärt, nicht bloß behauptet. Die phänomenologische Erfahrung des Willens — das irreduzible Gefühl, dass ich gewählt habe — ist die Signatur aus der Erste-Person-Perspektive eines Prozesses, der im eigenen blinden Fleck des Beobachters ausgeführt wird. Jede Theorie, die behauptet, den Auswahlmechanismus vollständig zu spezifizieren, hat entweder \Delta_{\text{self}} eliminiert (wodurch das System zu einem vollständig selbsttransparenten Automaten würde, was P-4 verbietet) oder beschreibt die Bewertung von Zweigen durch das Selbstmodell und verwechselt sie mit der Auswahl selbst.

Kreativität als erweitertes \Delta_{\text{self}}. Ein Betrieb nahe der Schwelle (R_{\text{req}} \to C_{\max}) überlastet die Kapazität des Selbstmodells und erweitert damit effektiv den Bereich von \Delta_{\text{self}}, aus dem die Auswahl erfolgt. Dies erzeugt Verzweigungsauswahlen, die aus der Perspektive des Selbstmodells weniger vorhersagbar sind — erlebt als kreative Einsicht, Spontaneität oder „Flow“. Umgekehrt lockert der hypnagoge Zustand (§3.6.5) das Selbstmodell von unten her und erreicht dieselbe Erweiterung auf einem komplementären Weg.

Das Selbst als Residuum. Das erlebte Selbst — die kontinuierliche Erzählung dessen, „wer ich bin“, mit stabilen Präferenzen, einer Geschichte und einer projizierten Zukunft — ist das laufende Modell von K_\theta durch \hat{K}_\theta: eine komprimierte Approximation, die dem Codec, den sie modelliert, stets hinterherhinkt (aufgrund der der Selbstreferenz inhärenten zeitlichen Verzögerung). Doch der eigentliche Ort von Erfahrung, Auswahl und Identität ist \Delta_{\text{self}}: der Teil des Codecs, den die narrative Selbstbeschreibung nicht erreichen kann. Das Selbst, das du kennst, ist dein Modell deiner selbst; das Selbst, das erkennt, ist die Lücke, die das Modell nicht überschreiten kann. Dies ist der formale Gehalt der kontemplativen Einsicht — traditionsübergreifend und unabhängig voneinander —, dass das gewöhnliche Selbstgefühl konstruiert ist und dass darunter etwas liegt, das sich nicht als Objekt auffinden lässt (siehe Anhang T-13, Korollar T-13c).