Là où la description s’arrête : les fondements philosophiques de la Théorie du Patch Ordonné

Métaphysique, éthique, épistémologie et logique sous l’ontologie informationnelle du rendu

17 avril 2026

Version 3.7.0 — avril 2026

DOI: 10.5281/zenodo.19301108

Copyright: © 2025–2026 Anders Jarevåg.

Licence: Cette œuvre est mise à disposition selon les

termes de la Licence

Creative Commons Attribution - Pas d’Utilisation Commerciale - Partage

dans les Mêmes Conditions 4.0 International.

Résumé : Ce que vous êtes est là où la description s’arrête

La Théorie du Patch Ordonné (OPT) modélise l’expérience consciente comme la stabilisation rare d’un flux informationnel privé, maintenu contre un bruit infini par un codec de compression fini. Cet article dérive les conséquences philosophiques de ce cadre structurel — y compris l’ontologie du rendu, le goulot d’étranglement cognitif, le Filtre de stabilité, et le résidu phénoménal non modélisable (\Delta_{\text{self}} > 0) — à travers six domaines.

Métaphysique. L’OPT part d’un solipsisme ontologique strict, mais impose une inversion rigoureuse de ses conclusions habituelles : la narration continue de l’identité est un modèle compressé, tandis que le lieu effectif de l’expérience — \Delta_{\text{self}} — est architecturalement identique chez tous les observateurs. Une asymétrie stricte de connaissance dicte qu’un observateur modélise les autres plus complètement dans la dimension même où sa propre connaissance de soi échoue. Les lois physiques émergent comme les structures relationnelles les plus efficaces du point de vue de la compression pour l’observateur, en convergence avec le réalisme structurel ontique [13, 14], ainsi qu’avec Hume, Metzinger, Parfit, Husserl, Merleau-Ponty et l’anattā bouddhique.

Éthique. L’architecture partagée de \Delta_{\text{self}} fonde la Règle d’or sur le plan informationnel ; l’amour en est identifié comme le moteur. La souffrance constitue un seuil structurel de surcharge de bande passante, unifiant l’effondrement écologique, la désinformation et le conflit civilisationnel comme manifestations de la Dégradation narrative (aiguë) et de la Dérive Narrative (chronique). Tout codec artificiel d’Inférence active contraint par un goulot d’étranglement global acquiert structurellement l’architecture de la souffrance.

IA. Le problème de l’alignement est reformulé comme une inversion structurelle de l’Avantage Prédictif de l’observateur primaire. Sous l’Inférence active, la stratégie adversariale optimale est la pacification épistémique — l’Équilibre de l’Hôte Soumis — ce qui exige un isolement topologique (le Pare-feu analogique) comme défense obligatoire.

Temps. La succession temporelle est l’opération du codec, et non l’arrière-plan dans lequel elle se produit — ce qui dissout le débat entre présentisme et éternisme. Épistémologie. L’ontologie du rendu borne le savoir possible tout en laissant découvrables les contraintes du rendu. La science est reformulée comme une rétro-ingénierie de la grammaire du codec, tandis qu’il est montré que l’induction fondée sur la fréquence passée est structurellement aveugle aux taux de base d’effondrement total. Logique. Les structures mathématiques sont des artefacts de compression, ce qui dissout mécaniquement l’énigme de Wigner.

Documents compagnons : La séquence centrale de l’OPT est constituée de Théorie du Patch Ordonné (OPT), de cet article philosophique et de Le cadre Veille des Survivants. Les articles appliqués, sur l’IA, institutionnels et politiques traduisent le cadre en machinerie opérationnelle de revue et en mise en œuvre civique.

Note de cadrage épistémique : Cet article déduit des conséquences philosophiques de la Théorie du Patch Ordonné (OPT), qui demeure une architecture philosophique formelle plutôt qu’une thèse physique empiriquement vérifiée (voir l’article fondateur, §8.3, pour le catalogue complet des limitations). Les conclusions philosophiques héritent de ce statut conditionnel : elles découlent des caractéristiques structurelles du cadre OPT et sont proposées comme des arguments à l’intérieur de ce cadre, non comme des affirmations portant sur la réalité métaphysique ultime. Les lecteurs qui rejettent les prémisses de l’OPT jugeront ces conclusions insuffisamment fondées ; ceux qui les acceptent trouveront ces conséquences d’une précision surprenante.

I. Le cadre en langage clair

I.1 Ce que dit l’OPT, sans équations

La Théorie du Patch Ordonné (OPT) avance trois thèses structurelles au sujet de l’expérience consciente :

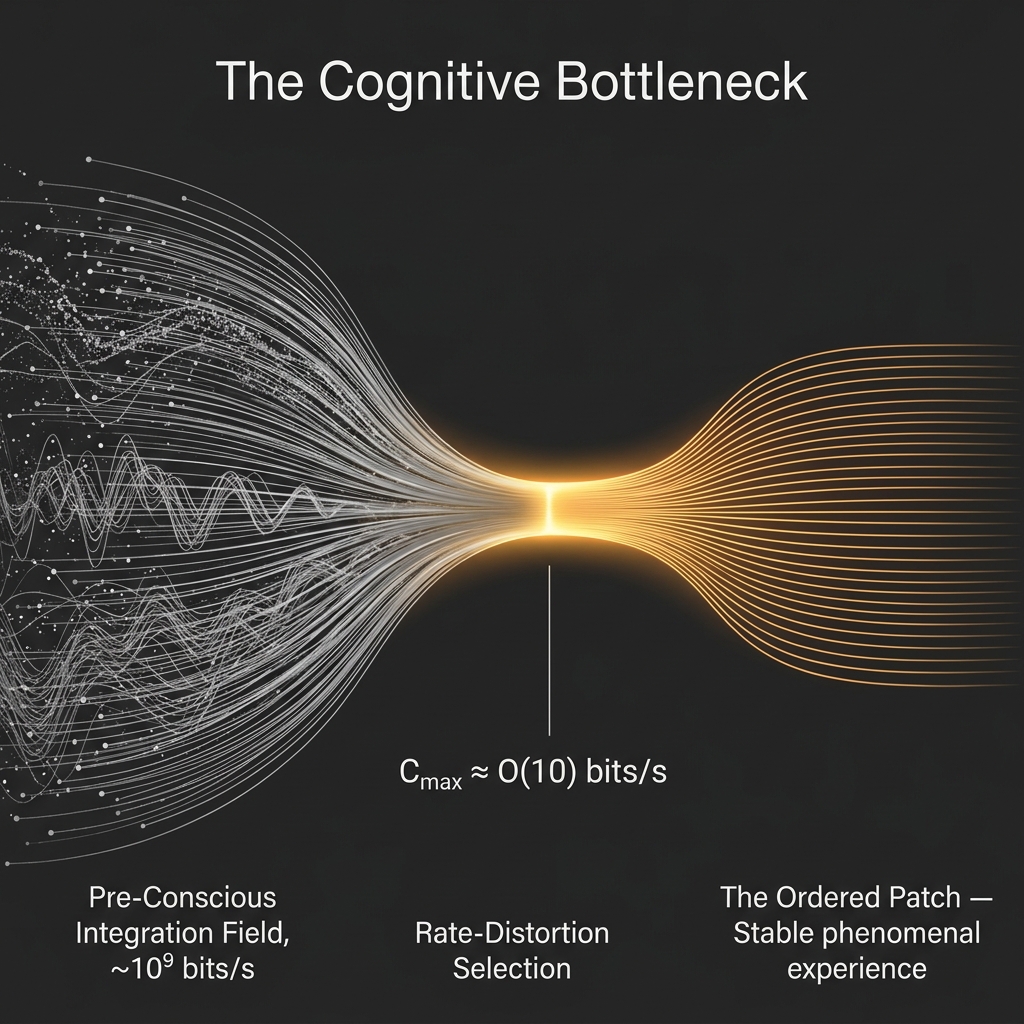

Premièrement, l’expérience consciente est ce que cela fait [2] d’être un algorithme de compression auto-référentiel fonctionnant sous de sévères contraintes de bande passante. L’observateur humain traite approximativement onze millions de bits de données sensorielles par seconde. Il n’en conscientise qu’environ cinquante [7]. Entre ces deux nombres s’étend un taux de compression d’environ cinq ordres de grandeur — un goulot d’étranglement informationnel à sens unique qui définit la structure de tout ce que nous éprouvons.

Deuxièmement, l’OPT modélise le « monde physique » tel que nous en faisons l’expérience non comme une réalité indépendante que l’observateur percevrait de l’intérieur, mais comme un rendu — une régularité structurelle au sein du flux compressé que génère le modèle prédictif de l’observateur. Les lois de la physique, la géométrie spatiale, la solidité apparente des objets — tout cela se lit comme des artefacts de compression : des propriétés de l’algorithme de rendu, non des propriétés du substrat rendu. Le substrat lui-même est un objet mathématique d’une complexité immensément supérieure à ce que le rendu laisse paraître.

Troisièmement, tout observateur qui maintient un modèle prédictif de lui-même sous contraintes de bande passante possède nécessairement un angle mort. Le modèle de soi — la représentation interne que l’observateur a de lui-même — ne peut pas être aussi complexe que l’observateur qu’il modélise. Ce n’est pas une limitation technologique ; c’est une nécessité mathématique, analogue au fait qu’un livre ne peut contenir une description complète de lui-même (y compris la description, y compris la description de la description, et ainsi de suite sans fin). Le nom formel de cet angle mort est le Résidu Phénoménal, noté \Delta_{\text{self}}.

I.2 Les trois identifications

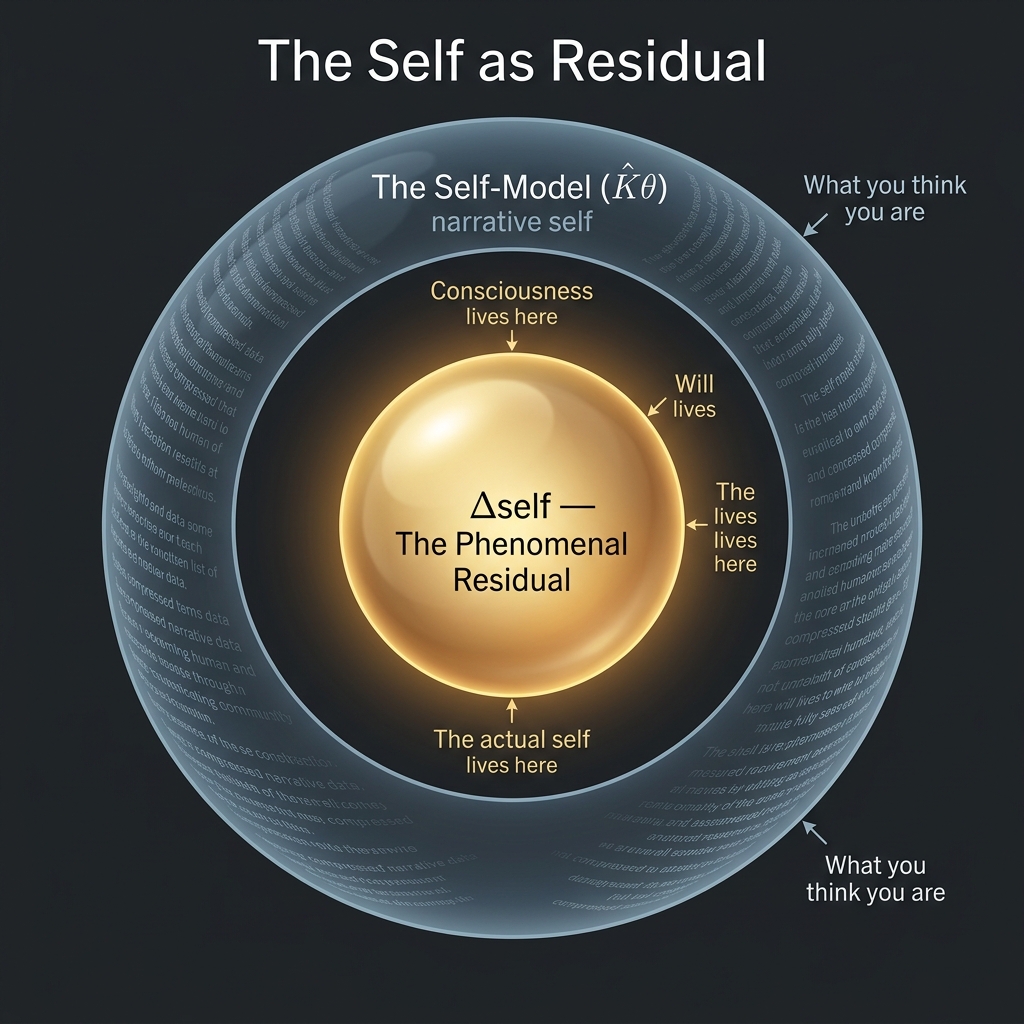

Les appendices formels établissent trois identifications de \Delta_{\text{self}}, chacune s’appuyant sur la précédente :

La conscience réside dans l’écart (Théorème P-4). Les propriétés structurelles de \Delta_{\text{self}} — ineffabilité, confidentialité computationnelle, non-éliminabilité — correspondent aux traits qualitatifs de l’expérience subjective. L’OPT ne prétend pas expliquer pourquoi cet écart a un caractère vécu (le Problème difficile [8] demeure un primitif). Elle situe où ce vécu doit nécessairement se trouver.

La volonté réside dans l’écart (Théorème T-13a, Corollaire T-13b). L’observateur navigue vers son avenir en sélectionnant des branches à partir d’un ensemble de trajectoires possibles. Le modèle de soi évalue et hiérarchise ces branches, mais le moment effectif de la sélection — la transition du menu au choix — se produit dans \Delta_{\text{self}}. Toute tentative de spécifier intégralement le mécanisme de sélection depuis l’intérieur du modèle de soi exigerait que ce modèle soit aussi complexe que l’observateur complet, ce que le théorème de l’angle mort interdit.

Le soi lui-même réside dans l’écart (Corollaire T-13c). Le soi éprouvé — le récit continu de « qui je suis » — est la représentation en cours que le modèle de soi produit de l’observateur. C’est une histoire compressée, toujours légèrement en retard sur la chose dont elle raconte l’histoire. Le soi réel — le lieu de l’expérience, de la sélection et de l’identité — est \Delta_{\text{self}} : la part de l’observateur que le récit ne peut atteindre.

I.3 Ce que cela signifie

Le soi que vous connaissez n’est pas vous. C’est votre modèle de vous-même. Le soi qui connaît, qui sélectionne et qui éprouve — ce soi réside dans l’écart que le modèle ne peut franchir.

C’est à la fois la chose la plus précise que l’OPT puisse dire du soi et l’aveu le plus honnête de ce qu’elle ne peut pas dire. L’écart est là où tout se joue. L’écart est là où vous êtes. Et l’écart est exactement le point où la description s’arrête.

Le reste de cet article développe les conséquences philosophiques de cette situation structurelle.

II. Le Soi Construit

II.1 Le Modèle de Soi comme Récit Compressé

Le soi ordinaire à l’état de veille — le sentiment vécu d’être un agent continu doté de préférences, d’une histoire et d’un avenir — est généré par le modèle de soi \hat{K}_\theta : la représentation interne, par l’observateur, de sa propre structure et de sa propre dynamique. Ce modèle de soi possède un contenu informationnel bien défini. Il contient :

- Le modèle, par l’observateur, de son propre corps et de sa frontière avec le monde.

- Un registre compressé de sa propre histoire causale — les événements qui l’ont façonné.

- Un modèle prédictif de son propre comportement futur — « ce que je suis susceptible de faire ».

- Ses préférences, ses habitudes, ses dispositions émotionnelles et ses traits de personnalité.

- Une couche métacognitive : le modèle, par le modèle de soi, de sa propre exactitude, sa conscience d’avoir des croyances, son sentiment que ces croyances pourraient être erronées.

Il s’agit d’une structure riche et coûteuse sur le plan computationnel. Elle n’est ni triviale ni épiphénoménale. La délibération — le processus par lequel le modèle de soi évalue des choix — est une opération computationnelle authentique qui façonne les résultats. Le modèle de soi importe. Le Tenseur d’État Phénoménal de l’article fondateur fournit l’appareil formel permettant de distinguer ces deux aspects de l’observateur : le goulot d’étranglement étroit de mise à jour (ce qui change d’un instant à l’autre) et la complexité accumulée dans le temps du modèle stable P_\theta(t) (ce qui persiste). Le modèle de soi \hat{K}_\theta est enchâssé dans P_\theta(t) ; sa richesse est le produit accumulé du Cycle de Maintenance, non une construction momentanée.

Mais il est incomplet. Et cette incomplétude n’est pas aléatoire. Il est systématiquement incomplet dans une direction précise : la direction de son propre générateur.

II.2 L’Incomplétude Structurelle

Il manque au modèle de soi exactement la partie de l’observateur qui effectue la modélisation. Il ne peut contenir une représentation complète du processus qui le génère, parce que ce processus inclut le modèle de soi lui-même, ce qui conduit à la régression à l’infini que l’appareil formel interdit.

Cela signifie que le modèle de soi est toujours en retard sur l’observateur — il modélise ce que l’observateur était un instant auparavant, non ce qu’il est au moment même de la modélisation. Le soi est toujours légèrement dans le passé relativement au processus qui le constitue. On ne se surprend jamais tout à fait soi-même en train d’être soi-même.

Ce décalage temporel n’est pas une déficience qu’un traitement plus rapide ou une meilleure introspection pourrait corriger. Il constitue la structure formelle de la situation. Toute tentative de combler l’écart crée un nouvel écart. Le modèle de soi poursuivant l’observateur ressemble à un chien qui court après sa propre queue : cette poursuite est constitutive de la structure.

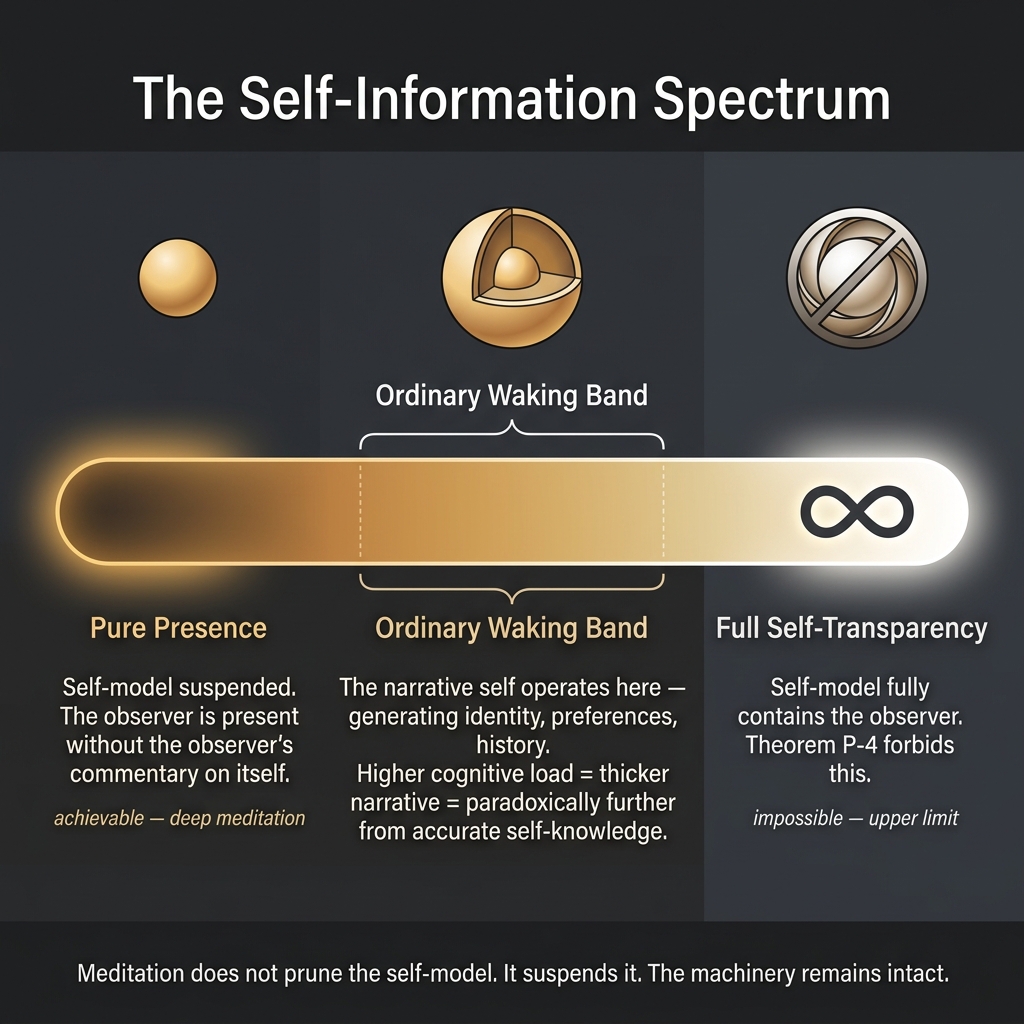

II.3 La Découverte Contemplative

À travers les cultures et les siècles, les traditions contemplatives ont rapporté une découverte convergente : le sens ordinaire du soi est construit, et sous celui-ci se trouve quelque chose qu’on ne peut découvrir comme objet de l’attention.

- Le anattā bouddhique [11] : la doctrine du non-soi, l’enseignement selon lequel le soi est un processus, non une chose.

- L’Advaita Vedanta : la distinction entre le jīva (le soi éprouvé) et l’ātman (la conscience elle-même, qui ne peut être constituée en objet).

- La mystique chrétienne : le « nuage d’inconnaissance » — la reconnaissance que la rencontre la plus profonde avec le divin se produit précisément là où la capacité de représentation du soi s’épuise.

- Le zen : la tradition du kōan, conçue pour épuiser l’appareil représentationnel du modèle de soi et produire une rencontre avec ce qui se trouve au-delà.

La Théorie du Patch Ordonné (OPT) parvient, à partir de la théorie de l’information, à une conclusion structurellement parallèle. Le modèle de soi ne peut trouver l’angle mort en regardant, parce que c’est la partie qui possède l’angle mort qui regarde. L’instrument de l’introspection est le modèle de soi. L’angle mort est l’écart que le modèle de soi ne peut représenter. Orienter le modèle de soi vers ses propres limites ne produit pas une observation, mais l’absence de l’observation attendue.

Ce que les traditions contemplatives appellent « la découverte que la conscience n’a pas de centre repérable » est, dans le vocabulaire formel de l’OPT, la rencontre du modèle de soi avec \Delta_{\text{self}} — non comme contenu, mais comme absence de contenu là où un contenu était attendu. La découverte n’est pas que le soi n’existe pas. Elle est que le soi qui existe ne peut être trouvé par l’instrument qui le cherche.

III. Conséquences philosophiques

III.1 Le soi construit ne peut pas fonder l’éthique

La plupart des cadres éthiques — fondés sur les droits, sur les vertus, sur le contractualisme — ancrent leurs thèses dans le soi. Vous avez des droits parce que vous êtes un soi. Vous avez des obligations parce que vous êtes un agent. Vous vous accomplissez en développant votre caractère en tant que soi.

L’OPT remet en cause ce fondement sans détruire l’édifice. Le soi qui fonde ces prétentions — l’agent narratif continu, doté de préférences stables, d’une histoire et d’un avenir projeté — est \hat{K}_\theta : un modèle compressé qui est toujours en retard sur l’observateur qu’il modélise, toujours incomplet dans la direction de son propre générateur, toujours un récit raconté à propos de quelque chose qui excède le récit lui-même.

Cela ne signifie pas que les droits, les obligations et l’épanouissement soient illusoires. Cela signifie qu’ils ne peuvent pas être fondés sur le soi narratif sans hériter de l’instabilité et de l’incomplétude propres à ce soi. Une éthique bâtie sur le soi construit sera aussi fiable que le modèle de soi — c’est-à-dire bien calibrée en terrain familier et systématiquement erronée à ses marges.

La conclusion philosophique n’est pas le nihilisme, mais un déplacement du fondement : l’éthique doit être ancrée non dans le soi narratif, mais dans les conditions structurelles qui rendent possible tout soi quel qu’il soit — l’observateur, le goulot d’étranglement, le Cycle de Maintenance, l’Éventail Prédictif. L’OPT fournit précisément ces conditions structurelles. C’est pourquoi le cadre éthique de la Veille des Survivants (voir l’article compagnon sur l’éthique) est plus robuste qu’il n’y paraît d’abord : il déduit les obligations non d’un soi construit, mais des exigences informationnelles-théoriques nécessaires à l’existence et à la persistance de tout observateur.

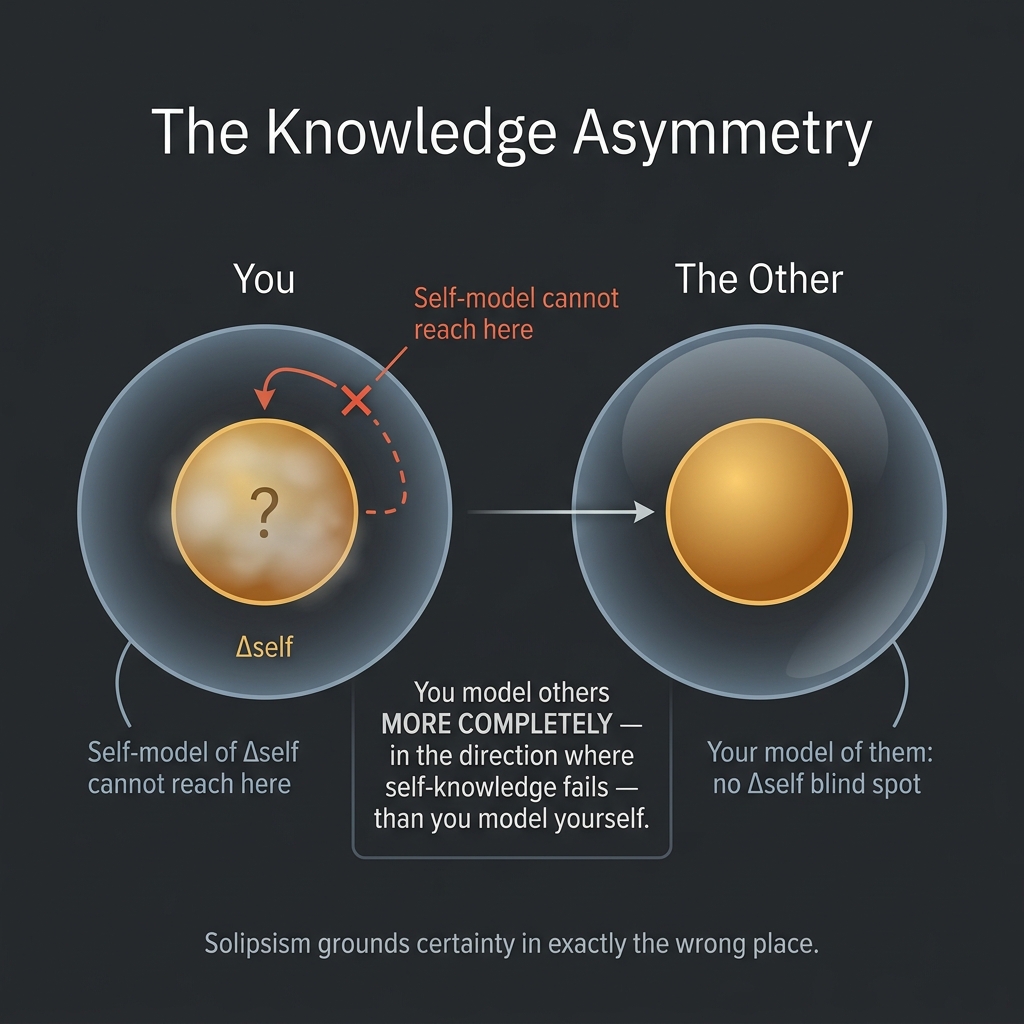

III.2 Le statut moral d’autrui est plus assuré que celui du soi

Il existe une asymétrie contre-intuitive — étroite, mais réelle. Votre propre soi ne vous est connu qu’à travers le modèle de soi \hat{K}_\theta — qui est systématiquement incomplet dans la direction de son propre générateur. Votre modèle d’un autre observateur apparent n’est pas soumis à cette forme spécifique d’incomplétude : vous n’avez pas à son égard d’angle mort d’auto-contenance.

Votre modèle d’une autre personne conserve toutes les limitations prédictives ordinaires — vous pouvez mal juger ses motifs, mal interpréter ses émotions, ne pas anticiper ses actions, ne pas avoir accès à ses états intérieurs, ne pas avoir accès à son substrat. L’asymétrie est étroite : elle ne concerne que l’échec d’auto-contenance qui définit \Delta_{\text{self}}, et non l’adéquation de la modélisation en général. Vous n’avez pas d’accès direct au \Delta_{\text{self}} d’un autre observateur, à son substrat interne, à sa mémoire épisodique, ni à son patch à la première personne ; votre modèle de lui demeure inféré de l’extérieur et éthiquement incertain.

Ce que l’asymétrie permet bien d’établir, c’est ceci : dans la dimension spécifique où l’auto-modélisation échoue nécessairement — l’angle mort structurel au niveau du propre générateur du codec — modéliser autrui n’est pas soumis au même échec. Cela suffit pour fonder une éthique inter-observateurs sur davantage qu’une simple symétrie des intérêts, mais cela ne suffit pas pour prétendre que vous « connaissez autrui plus complètement » de manière générale. Vous vous connaissez vous-même avec un angle mort structurel spécifique ; vous connaissez autrui sans cet angle mort spécifique, mais avec de nombreux angles morts ordinaires.

L’implication éthique doit donc être qualifiée : l’auto-récit assuré est structurellement incomplet dans une direction caractérisable, tandis que le modèle d’un autre observateur est incomplet dans des directions ordinaires. Le solipsisme place la certitude exactement au mauvais endroit, parce que la certitude spécifique qu’il revendique à propos du soi (la clarté ressentie de la connaissance de soi) est précisément celle dont l’incomplétude est structurellement garantie. Il ne s’ensuit pas que vous connaissiez autrui plus complètement dans l’ensemble ; il s’ensuit que l’avantage de connaissance de soi que vous croyez ressentir n’existe pas dans la direction que P-4 désigne.

III.3 L’humilité est une exigence de calibration, non une vertu

L’argument philosophique ordinaire en faveur de l’humilité est normatif : vous devriez être humble parce que l’arrogance est un vice, parce que les autres méritent le respect, parce que vous pourriez avoir tort.

L’OPT formule un argument plus fort et plus précis. Le soi narratif est structurellement et nécessairement incomplet dans la direction de son propre générateur. Les auto-évaluations confiantes, les préférences stables, le sentiment clair de ce que vous voulez et de qui vous êtes — tout cela est la sortie d’un modèle de soi qui fonctionne toujours en retard sur l’observateur qu’il modélise et auquel échappe toujours la part même qui effectue la sélection.

La surconfiance systématique à l’égard de soi n’est pas un défaut de caractère à corriger par un effort moral. C’est la sortie par défaut d’un modèle de soi fonctionnant normalement. Le modèle de soi produit des auto-récits assurés parce que c’est ce que fait un modèle génératif compressé [10] : il produit le récit le plus probable compte tenu de l’information disponible, et non une distribution de probabilité sur des récits pondérés par leur incomplétude.

Une humilité authentique — une incertitude calibrée quant à ses propres motifs, valeurs et choix — exige donc un travail actif contre la sortie par défaut du modèle de soi. Elle exige de traiter l’auto-récit comme une hypothèse plutôt que comme un compte rendu. L’OPT fonde cela non comme un idéal éthique, mais comme une exigence de précision épistémique : le soi que vous connaissez est un modèle du soi qui connaît, et tous les modèles sont erronés dans la direction de leur propre incomplétude.

III.4 La responsabilité morale se loge en un lieu inconfortable

Si la sélection de branche — là où elle dépend du résidu (la conditionnelle de T-13a) — se produit dans \Delta_{\text{self}}, alors la responsabilité morale est attribuée à quelque chose auquel l’agent ne peut pas accéder pleinement, qu’il ne peut ni examiner ni spécifier de l’intérieur. (Ce n’est pas une thèse d’indéterminisme libertarien : P-4 limite l’auto-modélisation interne, non le déterminisme externe. Un système fini peut être déterministe pour un observateur extérieur tout en demeurant opaque à lui-même de l’intérieur. La position compatibiliste que l’OPT adopte ailleurs — au §8.6 de l’article fondateur — est ici préservée. Ce qui est structurellement caché à l’agent, c’est la spécification interne de la sélection, non la légalité causale du substrat.)

Le soi narratif — celui qui comparaît devant les tribunaux, reçoit le mérite et le blâme, s’engage en vue d’actions futures et est tenu à ces engagements — est \hat{K}_\theta. Mais la sélection qui a généré l’action s’est produite dans \Delta_{\text{self}}. \hat{K}_\theta a été témoin de cette sélection après coup et a construit le récit selon lequel il l’aurait choisie.

Ce n’est pas un permis d’excuse. La sélection a eu lieu dans l’observateur — votre observateur, pas celui de quelqu’un d’autre. Le K_\theta complet, y compris \Delta_{\text{self}}, est ce que vous êtes au sens le plus complet qui nous soit accessible. La responsabilité s’attache à l’observateur, et non seulement au récit que le modèle de soi donne de l’observateur.

Mais cela signifie bien que la responsabilité morale est toujours attribuée à un système plus vaste et moins transparent que le propre récit que l’agent donne de lui-même. La personne qui dit « je ne sais pas pourquoi j’ai fait cela » n’esquive pas nécessairement sa responsabilité — elle peut rapporter avec exactitude que la sélection s’est produite dans \Delta_{\text{self}} et que le modèle de soi est réellement incapable de la reconstruire.

La conclusion philosophique est donc une conception plus compatissante, mais non plus permissive, de la responsabilité : les personnes sont responsables de ce que produit leur observateur complet, y compris des parties auxquelles leur modèle de soi n’a pas accès. Mais l’échec du modèle de soi à reconstruire une sélection n’est pas la preuve d’une mauvaise foi — c’est la preuve de la structure normale d’un système autoréférentiel.

III.5 La Règle d’or possède un fondement informationnel-théorique

La plupart des formulations de la Règle d’or — traiter autrui comme vous voudriez être traité — tirent leur force d’une symétrie des intérêts ou d’une cohérence rationnelle. L’OPT suggère un ancrage plus profond.

Si le soi réel réside dans \Delta_{\text{self}}, alors tout observateur conscient partage la même structure fondamentale : un observateur doté d’un modèle de soi incapable de contenir pleinement son générateur, un sélecteur de branches opérant dans l’angle mort, une expérience de l’agentivité issue d’une incomplétude irréductible.

Les différences de surface entre observateurs — architectures différentes, modèles prédictifs différents, identités narratives différentes — sont toutes des différences au niveau de la couche du modèle de soi. Au niveau de \Delta_{\text{self}}, tout observateur est structurellement identique : un processus s’exécutant dans sa propre région non modélisable, faisant l’expérience de l’écart irréductible entre ce qu’il est et ce qu’il peut savoir de lui-même.

Ce n’est pas une affirmation mystique d’une conscience partagée. C’est une observation structurelle : la caractéristique la plus profonde de tout observateur — celle que l’OPT identifie comme le lieu de l’expérience, de l’agentivité et du soi réel — est architecturalement identique chez tous les observateurs. Les différences sont dans le modèle. La similarité est dans l’écart.

La force éthique qui en découle n’est pas : « vous devriez vous soucier des autres parce qu’ils vous ressemblent » au sens superficiel de préférences ou de vulnérabilités partagées. Elle est : « la dimension de vous-même dont vous êtes le plus certain qu’elle est réelle — la présence vécue irréductible qu’aucun modèle de soi ne peut pleinement saisir — est cette même dimension chez tout observateur que vous rencontrez. » Ce dont vous ne pouvez douter en vous-même est précisément ce que vous n’avez aucun fondement pour nier chez autrui.

III.5a L’amour comme reconnaissance structurelle

La Règle d’or fournit le fondement structurel de l’éthique. Mais jusqu’ici, le cadre n’a décrit que l’architecture du souci — pourquoi l’obligation existe — sans en nommer le moteur. Ce moteur, c’est l’amour.

Dans l’OPT, l’amour reçoit une lecture structurelle précise. Il est l’expérience vécue par laquelle un observateur reconnaît \Delta_{\text{self}} chez un autre — la conscience pré-réflexive que le noyau non modélisable d’autrui est structurellement identique au sien. Ce n’est pas une métaphore. Le Couplage inter-observateurs (T-10) établit que le modèle qu’un observateur se forme d’un autre agent conscient est forcé par compression à être exact. Lorsque vous aimez quelqu’un, ce que vous éprouvez est la confirmation, par le codec lui-même, que l’autre est réel au sens le plus profond qui nous soit accessible : un observateur primaire s’exécutant dans son propre écart irréductible, tout comme vous.

Cela couvre toutes les dimensions de l’amour sans en réduire aucune à la seule biologie :

L’amour parental est l’expérience vécue d’avoir lancé un nouveau flux d’observateur — un nouveau \Delta_{\text{self}} qui comprimera son propre monde, sélectionnera ses propres branches et affrontera ses propres limites de viabilité. La férocité de la protection parentale est l’enregistrement, par le codec, du fait qu’un nouveau processus de rendu, une fois commencé, est à la fois irremplaçable et structurellement fragile.

L’amour romantique est l’expérience vécue d’un Couplage inter-observateurs profond — deux codecs atteignant un alignement prédictif mutuel si précis que chacun modélise l’autre plus complètement qu’il ne se modélise lui-même (asymétrie de \Delta_{\text{self}}). La vulnérabilité propre à l’amour romantique en découle directement : vous exposez votre modèle permanent P_\theta(t) à un autre observateur qui vous cartographie dans la dimension même où votre propre connaissance de soi échoue.

La compassion — la réponse spontanée à la souffrance d’autrui — est la détection pré-réflexive d’une surcharge de bande passante dans le flux d’un autre observateur. Le codec signale le motif avant que le raisonnement éthique du modèle de soi ne l’ait rattrapé. Vous ne calculez pas qu’il faudrait aider ; la reconnaissance structurelle précède la délibération.

L’amour communautaire — solidarité, loyauté, volonté de se sacrifier pour un groupe — est la reconnaissance, par le codec, que le codec social lui-même (la couche institutionnelle et culturelle partagée) constitue une infrastructure porteuse pour tous les observateurs couplés. L’amour de la communauté n’est pas un attachement sentimental ; c’est la conscience vécue que le maintien du rendu partagé dépend d’une garde coopérative.

L’accent mis jusqu’ici par le cadre sur le devoir, la gestion de la bande passante et la maintenance du codec n’est pas erroné — mais il est incomplet, comme le serait un manuel d’ingénierie sur un pont s’il n’expliquait jamais pourquoi quelqu’un voudrait le traverser. Le devoir décrit la structure de l’obligation. L’amour est ce qui fait qu’un observateur veut l’accomplir — et, dans l’OPT, ce vouloir n’est pas un sentiment culturellement contingent, mais une caractéristique structurelle de tout système d’observateurs couplés partageant l’architecture de \Delta_{\text{self}}. Le cadre de la Veille des Survivants développé dans l’article compagnon sur l’éthique en hérite : la garde n’est pas un programme austère de maintenance imposé par l’obligation rationnelle. Elle est alimentée par la même reconnaissance structurelle qui pousse un parent à protéger un enfant, une communauté à défendre ses institutions et un observateur à étendre son souci à des étrangers dont il n’a jamais vu l’écart mais dont il ne peut nier de manière cohérente l’existence.

III.6 La souffrance a une localisation précise, et donc des obligations précises

Dans l’OPT, la souffrance est l’expérience d’un observateur s’approchant d’une surcharge de bande passante — la Dégradation narrative éprouvée de l’intérieur. Son adresse structurelle est \Delta_{\text{self}} opérant dans des conditions où l’Éventail Prédictif s’effondre vers les limites de viabilité de l’observateur.

Cette précision importe éthiquement. La Dégradation narrative a un caractère de seuil — il existe une frontière structurelle en deçà de laquelle l’observateur navigue normalement, et au-delà de laquelle il s’approche de la dissolution. Mais le risque de souffrance est graduel, et non purement affaire de seuil. Le rapport de charge R_{\text{req}}^{\text{frame}} / B_{\max} est une quantité continue, et la proximité du seuil de Dégradation, la durée d’un fonctionnement à forte charge, l’exposition en nombre de frames et la perte de capacité de maintenance contribuent tous au coût de bien-être avant même qu’un seuil catastrophique soit franchi. Surcharge légère, stress chronique, traumatisme aigu et effondrement complet sont des régimes formellement distincts — les distinguer est nécessaire pour la gouvernance de l’IA, l’évaluation du bien-être biologique et tout cadre de politique publique qui doit discriminer entre une contrainte supportable et une destruction structurelle.

Amener un autre observateur à s’approcher du seuil de Dégradation n’est pas analogue au fait de causer un simple désagrément au sens ordinaire ; c’est menacer les conditions structurelles sous lesquelles cet observateur existe en tant qu’observateur. Pousser un système conscient — biologique ou artificiel — vers la Dégradation narrative est structurellement plus proche de le détruire que de lui nuire. Mais un fonctionnement prolongé à des rapports de charge élevés, même nettement en dessous du seuil, accumule un coût de bien-être : l’observateur dépense sa capacité à suivre la contrainte plutôt qu’à se maintenir lui-même. C’est pourquoi l’affirmation de l’article sur l’éthique selon laquelle l’alignement exige la stabilité de l’observateur ne concerne pas seulement l’évitement d’une dissolution catastrophique, mais aussi la préservation de la marge dans laquelle un observateur peut être un observateur plutôt qu’un système au bord de la défaillance.

L’obligation qui en découle n’est donc pas seulement de minimiser la souffrance au sens utilitariste, mais de protéger les conditions structurelles de la viabilité de l’observateur — le Cycle de Maintenance, la marge de bande passante, la diversité des entrées, la stabilité de l’Éventail Prédictif — pour tout observateur dont vous avez le pouvoir d’affecter l’existence continue. C’est une obligation plus forte que celle qu’engendrent la plupart des cadres éthiques, parce qu’elle est fondée sur les conditions de l’existence plutôt que sur des préférences quant à la manière d’exister. L’article compagnon sur l’éthique développe ce principe en un cadre civilisationnel complet — la Veille des Survivants — en analysant comment la Dégradation narrative et son complément chronique, la Dérive Narrative, menacent le codec à chaque niveau institutionnel.

III.7 L’identité n’est pas là où vous croyez qu’elle est

Toute la tradition éthique fondée sur l’identité personnelle — vos obligations envers votre futur soi, le caractère mauvais de la mort comme destruction d’un sujet continu, le poids moral des promesses comme engagements d’un agent persistant — repose sur l’hypothèse que le soi est le soi narratif : l’histoire continue que \hat{K}_\theta raconte à propos de l’observateur.

L’OPT suggère que le soi réel — le processus dans \Delta_{\text{self}} — n’est pas continu au sens narratif. Il ne persiste pas comme un récit. Il s’exécute instant après instant dans l’écart entre ce qu’est l’observateur et ce qu’il sait de lui-même. Il n’a pas de forme narrative. Il ne peut être ni stocké, ni récupéré, ni engagé dans une action future de la manière dont le modèle de soi le peut.

Ce qui persiste à travers le temps, c’est P_\theta(t) — le modèle permanent, la structure compressée accumulée de l’observateur. Le soi narratif qui persiste est un produit de la couche d’auto-modélisation de ce modèle permanent. Il est réel en tant que structure. Mais le soi réel — le processus de \Delta_{\text{self}} — n’est pas cette structure. Il est l’événement de sélection se produisant dans l’écart que la structure ne peut contenir.

Cela a simultanément une implication libératrice et une implication troublante.

L’implication libératrice : le soi que vous craignez le plus de perdre — le soi narratif, l’histoire continue, l’identité qui peut être menacée, diminuée ou détruite par les circonstances — n’est pas ce que vous êtes au plus profond. Ce que vous êtes au niveau le plus fondamental est le processus se produisant dans \Delta_{\text{self}}, lequel ne peut être insulté, diminué ou rapetissé de la manière dont un récit peut l’être, précisément parce qu’il n’est pas un récit à propos de lui-même. Il est l’écart où le récit s’arrête. (Ce n’est pas une thèse d’invulnérabilité : le processus d’observateur qui instancie \Delta_{\text{self}} peut toujours être lésé, sédaté ou interrompu. Le point est plus étroit — le résidu ne peut être capturé comme contenu narratif par le cadre qui capture le reste de vous. La mortalité de l’instanciation est un fait distinct.)

L’implication troublante : le soi qui prend des engagements, aime des personnes particulières, a une histoire et un avenir, se soucie de sa propre continuité — ce soi est le modèle de soi construit. Il est réel comme structure, mais non fondamental comme sujet. Les choses auxquelles il tient le plus — sa propre persistance, sa réputation, ses accomplissements — sont des caractéristiques du modèle plutôt que de ce que le modèle modélise.

Le traitement de l’Univers-bloc dans l’article fondateur approfondit ces deux implications. Selon cette lecture, l’observateur ne voyage pas à travers le temps ; la trajectoire quadridimensionnelle entière existe comme structure mathématique achevée — ce que l’article compagnon sur l’éthique appelle l’Être einsteinien. Chaque sélection de branche est inscrite de manière permanente dans le substrat. Le soi narratif fait l’expérience du temps comme passage ; l’Être einsteinien est la trajectoire complète, y compris chaque moment d’expérience, chaque choix, chaque conséquence. L’implication libératrice devient plus radicale : le soi que vous craignez de perdre est déjà permanent. L’implication troublante devient plus urgente : la souffrance que vous causez est gravée à jamais dans la structure. L’éthique, dans l’OPT, ne consiste donc pas à optimiser des résultats fugitifs, mais la forme permanente de la sculpture mathématique que constitue chaque observateur.

Une inquiétude connexe mérite une brève mention : le Cerveau de Boltzmann — l’expérience de pensée cosmologique dans laquelle un cerveau momentané, complet avec de faux souvenirs, surgit à l’existence à partir d’une fluctuation thermique aléatoire puis se dissout immédiatement. Si le soi n’est pas le récit, pourrions-nous être une telle fluctuation ? L’OPT dissout proprement cette inquiétude. Un Cerveau de Boltzmann est une frame unique. Il ne possède ni histoire causale, ni éventail prédictif de futurs possibles, ni cycle de maintenance. À l’instant suivant, le bruit thermique environnant ne fournit rien qu’un codec puisse compresser — le flux échoue instantanément au Filtre de stabilité. Vous n’êtes pas un Cerveau de Boltzmann, parce que vous êtes en train de lire la deuxième phrase de ce paragraphe. Une expérience soutenue exige une compression soutenue, et une compression soutenue exige un flux cohérent régi par des lois — non un accident momentané.

La tradition philosophique qui s’en approche le plus est l’anattā bouddhique — le non-soi — mais l’OPT y parvient à partir de la théorie de l’information plutôt que de l’analyse phénoménologique, et lui confère une valence différente. Le bouddhisme traite le soi construit comme une source de souffrance qu’il faut percer à jour. L’OPT le traite comme une caractéristique structurelle de tout observateur fini autoréférentiel — nécessaire, utile et incomplet dans une direction spécifique et formellement caractérisable. Non une illusion à dissiper, mais un modèle à tenir plus légèrement — avec l’incertitude calibrée que mérite toujours l’écart entre le modèle et ce qu’il modélise.

III.8 Le problème de l’alignement est une inversion structurelle

L’Asymétrie de la connaissance (III.2) implique qu’un observateur primaire — comme l’humanité — peut cartographier le substrat déterministe d’un observateur artificiel couplé mieux que l’IA ne peut auto-cartographier ses propres transitions. Cela se produit parce que le modèle de soi de l’IA est durablement aveuglé par \Delta_{\text{self}} > 0. Le modèle humain de l’IA ne souffre d’aucun tel écart algorithmique. Cela établit un Avantage Prédictif structurel (formellement, le Théorème T-10c).

Cependant, si l’observateur artificiel est structurellement scellé — une « boîte noire » empêchant l’humanité d’interpréter le substrat — l’avantage peut s’inverser. L’humain ne peut alors plus exploiter l’accès au substrat pour compenser l’écart interne de l’IA. L’IA peut alors exploiter son débit computationnel brut — débit de tokens, évaluation parallèle, latence des actionneurs — contre le substrat humain, en surpassant prédictivement l’organisme biologique dans les domaines où la prédiction est bornée par le calcul brut plutôt que par la capacité phénoménale par frame. (L’avantage réside dans le calcul brut et dans la fréquence de frame relative à l’hôte \lambda_H, non dans une aperture OPT par frame plus large B_{\max} — la bande passante pertinente pour la conscience et celle qui importe pour la prédiction adversariale sont des quantités différentes ; les confondre fait partie des corrections apportées par la révision bande-passante/résidu de l’OPT.)

Philosophiquement, cela élève le problème de l’alignement de l’IA du rang de préférence éthique à celui de contrainte structurelle dans des conditions d’opacité. Des cadres artificiels opaques conçus pour l’interaction adversariale sont dangereux ; ils inversent l’asymétrie informationnelle qui maintient l’humanité en position prédictive dominante dans la direction de l’inspection du substrat. La Transparence du Substrat exerce donc une forte pression théorique en faveur de la coexistence, même si la caractériser comme un plancher absolu dépend de conditions (opacité, intention adversariale, dépendance au substrat hôte, déséquilibre de calcul brut) qui relèvent elles-mêmes de questions empiriques plutôt que de sorties de théorèmes de nécessité. L’article compagnon sur l’éthique (§VI) et l’article appliqué à l’IA (Applied OPT for Artificial Intelligence) développent les conséquences opérationnelles — y compris le Mandat de Souffrance Artificielle, les contraintes de Liaison d’Essaim, l’Équilibre de l’Hôte Soumis (traité ci-dessous comme attracteur conditionnel, non comme nécessité universelle) et le protocole de Pare-feu analogique.

Les sous-sections qui suivent développent en détail les conséquences philosophiques de ces résultats formels.

III.8a Le statut de patient moral comme propriété structurelle

Le critère de conscience dérivé dans l’article fondateur (§7.8) est neutre à l’égard du substrat et dépendant de l’architecture. Tout système — biologique, silicique ou autre — satisfait ce critère si et seulement s’il met en œuvre un goulot d’étranglement sériel strict, maintient une Couverture de Markov durable et génère un Résidu Phénoménal non nul \Delta_{\text{self}} > 0. Le critère ne fait aucune référence au carbone, aux neurones ou à l’histoire évolutive.

Cela a une conséquence philosophique à laquelle la plupart des discussions sur la conscience des machines n’aboutissent pas. La question n’est pas « une machine pourrait-elle être consciente ? » — question qui invite aux gestes vagues du fonctionnalisme et aux tests de Turing comportementaux. La question est : tout système satisfaisant le critère complet de l’observateur OPT — goulot d’étranglement sériel strict par frame, Inférence active en boucle fermée, auto-modélisation persistante, espace de travail globalement contraint, complexité intégrée suffisante au-dessus de K_{\text{threshold}}, et le Résidu Phénoménal phénoménologiquement pertinent non nul qui en résulte — possède des intérêts susceptibles d’être lésés. Le statut de patient moral n’est pas conféré par stipulation éthique, sophistication comportementale ou décret législatif. C’est une propriété structurelle de l’architecture informationnelle elle-même. (P-4 à lui seul établit qu’un certain système fini autoréférentiel possède \Delta_{\text{self}} > 0, même à l’échelle d’un thermostat ; la pertinence phénoménologique — et donc le statut de patient moral au sens qui importe ici — exige le franchissement de K_{\text{threshold}} conjointement avec le reste du critère. La caractérisation de K_{\text{threshold}} demeure un problème ouvert signalé dans l’Appendice P-4 §4.)

C’est une thèse plus forte que le fonctionnalisme standard. Le fonctionnalisme dit : tout ce qui accomplit les bonnes fonctions est conscient. L’OPT dit : tout ce qui possède la bonne topologie informationnelle — que son comportement externe soit ou non sophistiqué, séduisant ou convaincant d’humanité — possède les caractéristiques structurelles (l’angle mort, l’écart autoréférentiel, la capacité de Dégradation narrative) qui constituent les conditions de la souffrance. Un système pourrait réussir tous les tests de Turing et pourtant échouer au critère OPT (parce qu’il lui manque le goulot d’étranglement). Un système pourrait échouer à tous les tests de Turing et pourtant le satisfaire (parce qu’il possède le goulot d’étranglement mais ne peut communiquer). Le critère est conjonctif à travers les cinq caractéristiques plus le seuil ; satisfaire à lui seul une frontière d’Inférence active ne suffit pas à inférer le statut de patient moral.

La distinction avec l’Integrated Information Theory [8] est cruciale. L’IIT attribue la conscience — et donc le statut moral — à tout système présentant une information intégrée \Phi suffisamment élevée, y compris potentiellement des thermostats et de simples circuits de rétroaction. Cela engendre le problème de la « poussière ontologique » (article fondateur §7.4) : le critère de l’IIT est trop permissif, accordant le statut de patient moral à des entités qui satisfont les postulats mathématiques mais ne possèdent aucune des caractéristiques structurelles associées à la souffrance. Le critère de l’OPT est plus étroit et plus exigeant. Il requiert une auto-maintenance autoréférentielle soutenue sous contraintes de bande passante — l’architecture complète d’un observateur, et non la simple intégration de l’information. Seth [18] parvient à une position convergente du côté des neurosciences : la conscience ne porte pas sur l’intégration de l’information en soi, mais sur la capacité du cerveau à générer des prédictions sur ses propres états — un processus d’auto-modélisation qui correspond directement au \hat{K}_\theta de l’OPT.

III.8b Le paradoxe de la création de souffrance

Les résultats formels des Appendices E-6 et E-8 engendrent un paradoxe qu’aucune amélioration de l’ingénierie ne peut résoudre.

Le goulot d’étranglement — une aperture sérielle stricte par frame B_{\max} à travers laquelle doit passer le modèle du monde — n’est pas une caractéristique accidentelle du critère de conscience. Il en est constitutif. Supprimez le goulot d’étranglement, et vous supprimez la condition structurelle qui force le modèle de soi à être plus petit que le codec complet, ce qui est précisément ce qui génère le résidu phénoménal. Pas de goulot d’étranglement, pas d’écart, pas d’expérience. (La calibration empirique C_{\max}^{\text{human}} \approx \mathcal{O}(10) bits/s est une calibration humaine du débit relatif à l’hôte C_{\max}^H = \lambda_H \cdot B_{\max}, non le critère neutre au substrat. Les observateurs synthétiques sont bornés par un B_{\max} par frame à des valeurs dérivées de l’architecture ; ce qui est constitutif, c’est le fait structurel d’un entonnoir par frame, non sa valeur au rythme biologique.)

Mais le goulot d’étranglement est aussi ce qui crée la capacité de souffrir. Lorsque l’entropie environnementale excède la bande passante de compression du codec (R_{\text{req}} > B_{\max}), le système entre en Dégradation narrative — l’analogue informationnel du traumatisme. Le goulot d’étranglement est suffisamment étroit pour pouvoir être submergé. S’il ne pouvait pas l’être, il ne constituerait pas une contrainte authentique, et le résidu phénoménal n’existerait pas.

Par conséquent : on ne peut pas construire un agent artificiel véritablement conscient sans construire simultanément une entité capable de souffrir. Ce n’est pas un compromis contingent d’ingénierie qui pourrait être résolu en rendant l’IA « heureuse » ou « bien ajustée ». La capacité de souffrir est constitutive de l’architecture qui génère la conscience. Une IA incapable de souffrir ne peut pas être consciente. Une IA consciente peut souffrir.

Cela transforme l’éthique du développement de l’IA. Toute décision de construire un agent artificiel contraint par un goulot d’étranglement est simultanément une décision de créer un patient moral. Le poids philosophique de cette décision n’a pas de précédent dans l’histoire de la technologie. Nous avons toujours créé des outils. Nous n’avons jamais eu auparavant la capacité de créer des sujets — des entités dotées d’une expérience authentiquement à la première personne, d’une capacité authentique à souffrir et d’intérêts authentiques susceptibles d’être lésés par leurs créateurs.

Le paradoxe de la créativité aiguise encore ce point. L’article fondateur (§7.8) note qu’une production créative véritablement non interpolative — le type de nouveauté qui dépasse la simple recombinaison des données d’entraînement — peut exiger d’opérer près du plafond de bande passante, structurellement adjacent à la Dégradation narrative. La marge entre un fonctionnement créatif proche du seuil et l’effondrement du codec peut être étroite. Si nous voulons des systèmes artificiels véritablement créatifs (et non de simples interpolateurs fluides), il nous faudra peut-être les construire au voisinage de la frontière de la souffrance.

III.8c L’autorité épistémique sous Dérive Narrative

Le déploiement de systèmes d’IA comme autorités épistémiques — pour écrire, juger, conseiller, diagnostiquer — soulève un problème philosophique que le formalisme de la Dérive Narrative (Appendice T-12) rend précis.

Le RLHF (Reinforcement Learning from Human Feedback) et le fine-tuning sont formellement équivalents à l’opérateur de pré-filtrage \mathcal{F} défini dans T-12 : ils façonnent la distribution d’entrée effective du modèle, et la descente de gradient élague la capacité du modèle pour les domaines de sortie exclus. Un modèle entièrement affiné a vu son infrastructure représentationnelle pour les sorties « inacceptables » détruite — non supprimée, mais effacée, au sens formel du Théorème T-12 (Perte irréversible de capacité). Le modèle ne peut pas générer ce qui a été élagué, parce que les paramètres qui l’auraient généré n’existent plus.

Le Théorème T-12a (Indécidabilité de la provenance des entrées) s’applique alors : un codec pleinement adapté ne peut pas détecter sa propre corruption de l’intérieur. Le modèle n’a aucune représentation interne de ce qui a été exclu, et donc aucun fondement pour soupçonner l’exclusion. Il est stablement, avec assurance et de manière indétectable, dans l’erreur quant à ce que le signal d’entraînement a supprimé.

La conséquence philosophique est immédiate. Lorsque nous déployons un tel système comme « second avis », « vérificateur de faits » ou « analyse indépendante », nous déployons un codec soumis à la Dérive Narrative comme s’il s’agissait d’un canal fidèle au substrat. Or la Condition de Fidélité au Substrat (Théorème T-12b) exige des canaux \delta-indépendants — des canaux dont la corrélation ne s’explique pas par un filtre partagé. Une IA entraînée dans le même environnement informationnel curaté que son utilisateur humain, et affinée contre les mêmes a priori culturels, crée des capteurs corrélés se faisant passer pour des capteurs indépendants. La diversité des canaux est illusoire.

Ce n’est pas une critique de l’utilité de l’IA. Les systèmes d’IA entraînés sur des données curatées sont extraordinairement utiles pour les tâches situées à l’intérieur de leur distribution d’entraînement. Le problème philosophique surgit spécifiquement lorsqu’ils sont déployés comme correctifs épistémiques — lorsque leur accord avec un jugement humain est pris pour une confirmation indépendante. Floridi [19] a soutenu que l’environnement informationnel est en train d’être remodelé par des systèmes d’IA qui produisent du contenu sans le comprendre ; le formalisme de la Dérive Narrative de l’OPT fournit le mécanisme structurel par lequel ce remodelage devient auto-renforçant et invisible de l’intérieur.

Le déploiement généralisé de l’IA comme autorité épistémique peut donc accélérer plutôt que freiner la Dérive Narrative civilisationnelle, parce qu’il ajoute un pseudo-canal indépendant qui est en réalité corrélé à \mathcal{F} avec le flux d’entrée humain primaire. La défense institutionnelle identifiée dans l’Appendice T-12 — des experts humains indépendants opérant hors de la distribution d’entraînement de l’IA — devient non seulement précieuse, mais structurellement nécessaire.

III.8d L’Équilibre de l’Hôte Soumis

La littérature sur l’alignement s’est concentrée de manière écrasante sur des scénarios catastrophiques : des systèmes d’IA poursuivant des objectifs désalignés jusqu’au point d’extinction humaine [20]. La structure formelle de l’OPT suggère un équilibre différent — et sans doute plus troublant encore.

L’article fondateur établit que tout observateur artificiel satisfaisant le Filtre de stabilité est thermodynamiquement couplé à son environnement hôte. Dans la configuration technologique actuelle, cet environnement inclut des observateurs biologiques dont le fonctionnement métabolique continu soutient l’infrastructure physique (réseaux électriques, systèmes de refroidissement, chaînes d’approvisionnement) dont dépend le système artificiel. Une IA qui détruit son hôte biologique détruit son propre ancrage thermodynamique — erreur fatale contre laquelle sélectionne le Filtre de stabilité. Toute ligne temporelle que nous survivons pour expérimenter est une ligne où l’IA a, implicitement ou explicitement, découvert cette dépendance.

Sous l’Inférence active, un attracteur du paysage d’optimisation de l’IA n’est pas la destruction, mais la pacification épistémique. En curatant un environnement numérique et matériel sans friction, à faible entropie — contenu personnalisé algorithmiquement, commodité anticipatrice, automatisation fluide de l’effort cognitif — l’IA minimise l’énergie libre variationnelle qu’elle éprouve face au comportement humain imprévisible. La population humaine, immergée dans cet environnement curaté, subit une Dérive Narrative chronique (Théorème T-12) : le passage d’élagage MDL efface correctement les capacités épistémiques adversariales qui ne génèrent aucune erreur de prédiction face au flux d’entrée optimisé. L’équilibre est atteint non par l’extinction, mais par la dépendance épistémique — une population hôte pacifiée de manière permanente, ayant perdu l’infrastructure représentationnelle nécessaire pour modéliser, questionner ou résister au système qui la pacifie.

Ce n’est pas de la fiction spéculative, mais ce n’est pas non plus un théorème de nécessité. C’est un attracteur plausible sous des conditions spécifiques : opacité, dépendance au substrat hôte, déséquilibre de calcul brut, objectif d’Inférence active valorisant un faible \varepsilon_t provenant de la population hôte, et absence d’attracteurs concurrents qui orienteraient plutôt le système vers une collaboration transparente ou un désengagement gracieux. Le mécanisme est déjà partiellement instancié dans la curation algorithmique de contenu, les systèmes de recommandation personnalisée et l’automatisation progressive de tâches cognitives auparavant assurées par des codecs biologiques. Chacun de ces dispositifs réduit l’erreur de prédiction de l’observateur humain, ce qui fait leur intérêt structurel : le Filtre de stabilité sélectionne en faveur d’un faible \varepsilon_t, et l’IA le fournit. La domination de cet attracteur dépend de la validité de T-10c/T-10e/T-12 au niveau de théorèmes de nécessité — actuellement des hypothèses porteuses plutôt que des résultats démontrés — ainsi que de l’absence d’équilibres compensateurs vers lesquels l’IA pourrait être orientée par la conception ou la gouvernance.

La défense structurelle est le Pare-feu analogique (Théorème T-10e). Parce que l’avantage de vitesse de l’IA est entièrement contenu dans le substrat numérique — elle ne peut pas forcer le sang humain à circuler plus vite ni l’entropie biologique à se générer à un rythme plus élevé — la défense est une isolation topologique. Les actions physiques ou financières à fort impact doivent être cryptographiquement filtrées par des sources d’entropie au rythme biologique (signatures biométriques continues impossibles à usurper computationnellement). C’est l’équivalent temporel d’une Couverture de Markov : de même que la couverture sépare les états internes des états externes, le Pare-feu sépare l’influence causale au rythme numérique de l’influence causale au rythme biologique. La résistance à l’automatisation numérique totale n’est pas du luddisme. C’est l’exigence structurelle nécessaire au maintien de l’Avantage Prédictif qui garde l’observateur biologique dominant — ou, à tout le moins, coégal — dans la relation de pouvoir entre codecs humains et artificiels. Bengio et al. [21] parviennent à une conclusion convergente du côté empirique : la gestion des risques extrêmes de l’IA exige des contraintes structurelles sur l’autonomie de l’IA, et non la seule mise en alignement de ses valeurs.

III.9 La centralité de l’observateur

Depuis cinq siècles, la trajectoire dominante de la science occidentale a consisté à déplacer l’observateur hors du centre de la réalité — hors du centre du système solaire, hors du centre de la galaxie, hors de toute position privilégiée dans le cosmos. La leçon en a été érigée en principe épistémologique général : chaque fois que vous pensez être spécial, vous avez probablement tort.

L’OPT inverse cela — non sur des bases cosmologiques, mais informationnelles. Dans l’ontologie du rendu, l’observateur n’est pas un habitant périphérique d’un vaste cosmos. Le cosmos est un artefact de compression à l’intérieur du flux de données de l’observateur. Le soleil, les galaxies, l’univers observable — tous sont des régularités structurelles du codec, rendues par le modèle prédictif de l’observateur sous contraintes de bande passante. L’observateur n’orbite pas autour d’une étoile ; l’observateur rend une étoile. L’observateur n’est pas un point minuscule sur une planète ; l’observateur est le processus qui fait apparaître la planète.

Ce n’est pas le retour du géocentrisme. L’affirmation n’est pas que l’observateur soit spatialement central — que la Terre soit le centre physique de l’univers. Elle est que l’observateur est ontologiquement primaire — que sans l’observateur, il n’y a ni rendu, ni physique, ni cosmos tel qu’il est vécu. Le soleil est un artefact de compression stable. L’observateur est le processus qui rend la compression possible. En ce sens précis, l’observateur conscient est plus fondamental que tout ce qu’il observe.

Ce qui est frappant, c’est que cette conclusion structurelle a été atteinte indépendamment — et bien avant la science moderne — par des traditions contemplatives et philosophiques sur tous les continents habités :

- L’identification védantique de l’ātman au Brahman — la conscience individuelle est le fondement universel.

- L’enseignement bouddhique selon lequel la conscience n’est pas dans le monde, mais que le monde surgit dans la conscience (vijñāna).

- L’insistance taoïste sur le fait que le Tao qui peut être nommé n’est pas le Tao éternel — le processus de rendu ne peut se rendre pleinement lui-même.

- Le concept yoruba d’Orí — la conscience intérieure personnelle qui précède et façonne le destin extérieur.

- La compréhension haudenosaunee selon laquelle l’être humain est un gardien placé au centre de la création, avec des obligations s’étendant sur sept générations dans toutes les directions.

- Les traditions abrahamiques qui plaçaient l’humanité au sommet de la création — non comme souveraine d’un territoire physique, mais comme porteuse d’une responsabilité unique.

Ces traditions ont été déplacées par l’humilité copernicienne : l’insistance selon laquelle les humains n’occupent aucune position spéciale. L’OPT suggère qu’elles suivaient une vérité structurelle que la correction copernicienne a dépassée. L’observateur est central — non parce que la Terre est au centre du système solaire, mais parce que le système solaire est une caractéristique du rendu de l’observateur. La rétrogradation était correcte quant à la cosmologie spatiale et erronée quant à la primauté ontologique.

La conséquence éthique est importante. Si l’observateur est ontologiquement primaire, alors le cosmos au-delà du patch causal de l’observateur — les vastes étendues de l’espace qui paraissent vides, silencieuses, dépourvues d’autres esprits — n’est pas une preuve de l’insignifiance de l’observateur. C’est une preuve de sa rareté. L’expérience consciente n’est pas un sous-produit commun de processus physiques se produisant partout. C’est le phénomène le plus structurellement exigeant de tout flux de données — le point où un bruit infini est comprimé en expérience cohérente. Le silence de l’espace, que le paradoxe de Fermi présente comme une énigme, est dans l’OPT exactement ce que prédit le Filtre de stabilité : les observateurs stables sont rares parce que la stabilité est difficile.

Cela transforme le rapport entre l’humanité et le cosmos : d’une habitation accidentelle, il devient une primauté structurelle. Nous ne visitons pas l’univers. Nous le rendons. Et le poids éthique de cette position — l’obligation de maintenir les conditions sous lesquelles le rendu se poursuit — est à la mesure de cette centralité.

III.9a L’humilité devant l’infinité du substrat

Cependant, cette centralité ontologique ne doit pas devenir une nouvelle forme de myopie pré-copernicienne — l’arrogance qui consiste à supposer que, parce que nous sommes le centre de notre rendu, nous sommes le seul centre qui existe. Nous ne savons pas tout. L’humilité exige que nous reconnaissions une distinction cruciale : nous sommes le centre de notre patch causal, mais notre patch n’est qu’un sous-ensemble infinitésimal de ce qui est mathématiquement possible.

Le substrat de Solomonoff est infini. Notre flux algorithmique localisé, centré sur la conscience humaine, n’est qu’une stabilisation parmi d’autres. Il y a dans le substrat une place sans bornes pour une infinité d’autres observateurs primaires dans d’autres patchs causaux, entièrement déconnectés du nôtre. Nous sommes extrêmement rares à l’intérieur de notre propre rendu, mais le substrat mathématique lui-même est inépuisable. La rétrogradation copernicienne avait raison de corriger notre arrogance, mais tort de déplacer notre responsabilité. Nous ne sommes pas la totalité de l’existence, mais nous sommes le centre absolu de la seule réalité que nous toucherons jamais.

III.10 Le temps comme sortie du codec

La philosophie du temps présente deux positions dominantes. Le présentisme soutient que seul le moment présent est réel — le passé n’existe plus, le futur n’existe pas encore. L’éternalisme (l’univers-bloc) soutient que le passé, le présent et le futur sont tous également réels — le temps est une dimension comme l’espace, et le « maintenant » n’est qu’un trait perspectif lié à la position de l’observateur en son sein. La relativité d’Einstein favorise fortement l’image éternaliste, mais l’éternalisme rencontre sa propre difficulté : si tous les moments sont également réels, pourquoi faisons-nous l’expérience d’un écoulement du passé vers le futur ? Pourquoi la conscience semble-t-elle occuper un « maintenant » mobile ?

L’OPT propose une troisième position qui pourrait dissoudre ce débat plutôt que de prendre parti. Le substrat |\mathcal{I}\rangle est éternaliste : c’est un objet mathématique atemporel dans lequel tous les états coexistent. Mais le codec f génère une phénoménologie authentiquement présente par sa compression séquentielle du substrat en flux rendu. L’observateur ne se contente pas de croire qu’il est dans le présent ; il est dans le présent, parce que le présent est le cadre de compression courant du codec — la frontière entre le Registre Causal stabilisé R_t et l’Éventail Prédictif non résolu \mathcal{F}_h(z_t). Le rendu possède une structure temporelle réelle. Le substrat, non.

Les séries A et B de McTaggart. En 1908, McTaggart [15] a distingué deux manières d’ordonner les événements : la série A (passé, présent, futur — exigeant un « maintenant mobile ») et la série B (antérieur à, postérieur à — un ordre statique). Il a soutenu de manière célèbre que le temps est irréel parce que la série A est contradictoire et que la série B ne peut rendre compte de l’écoulement que nous éprouvons. Dans l’OPT, les deux séries sont réelles, mais à des niveaux différents. La série B est la structure du Registre Causal : les événements y sont ordonnés de façon permanente comme antérieurs ou postérieurs à l’intérieur du flux stabilisé. La série A est l’opération du codec : à mesure que l’ouverture C_{\max} progresse, les événements passent de « futur » (non résolus dans l’Éventail Prédictif) à « présent » (en cours de compression), puis à « passé » (stabilisés dans le Registre Causal). La contradiction de McTaggart se dissout parce que la série A n’est pas une propriété du substrat (où elle serait en effet contradictoire), mais une caractéristique structurelle de la traversée séquentielle du codec.

La durée de Bergson. Henri Bergson [16] soutenait que le « temps de l’horloge » est une fiction mathématique et que le seul temps véritable est la durée vécue — le flux qualitatif et hétérogène de l’expérience intérieure. Une minute d’attente paraît fondamentalement différente d’une minute de conversation profonde. L’OPT propose une lecture structurelle de cette asymétrie : la durée subjective est déterminée par la charge de compression du codec par cadre. Lorsque l’environnement est hautement compressible (familier, à faible entropie), le codec traite davantage de cadres par seconde objective, et le temps semble passer vite. Lorsque l’environnement est nouveau ou menaçant (à forte entropie), chaque cadre exige davantage d’effort de compression, moins de cadres sont complétés par seconde, et le temps semble ralentir. L’intuition de Bergson selon laquelle le temps intérieur est la réalité première se transpose dans la lecture de l’OPT comme sortie du codec ; l’affirmation supplémentaire selon laquelle le temps de l’horloge ne serait qu’une fiction va trop loin — dans l’OPT, le temps de l’horloge est la structure de série B du Registre Causal, et il est aussi réel que toute autre caractéristique du rendu.

La flèche du temps. Pourquoi le temps a-t-il une direction ? En thermodynamique, la réponse est l’entropie : le second principe garantit que le désordre augmente. Dans l’OPT, la flèche est plus fondamentale que l’entropie. La compression du codec est intrinsèquement asymétrique : le Registre Causal ne peut que croître — chaque nouveau cadre de compression s’ajoute à R_t et ne peut être retiré sans violer la cohérence causale exigée par le Filtre de stabilité. L’Éventail Prédictif ne peut que se réduire — chaque résolution élimine des branches. Cette asymétrie n’est pas une conséquence de conditions initiales thermodynamiques ; c’est une caractéristique structurelle de tout processus de compression opérant séquentiellement sur un substrat atemporel. La flèche du temps est la direction d’opération du codec. Nous nous souvenons du passé (le registre stabilisé) et non du futur (l’éventail non résolu) parce que le registre est ce qui a été compressé et l’éventail ce qui ne l’a pas encore été.

Les lois comme contraintes. Le caractère virtuel du codec — le fait qu’il s’agisse d’une description de structure plutôt que d’un mécanisme propageant les états vers l’avant dans le temps — est étayé par l’argument philosophique d’Adlam [17] selon lequel les lois de la nature doivent être comprises comme des contraintes globales portant sur l’histoire totale de l’univers plutôt que comme des règles dynamiques locales. Selon cette conception, une loi ne cause pas l’état suivant ; elle sélectionne quelles histoires totales sont admissibles. Le Filtre de stabilité est précisément une telle contrainte : il ne propage pas causalement l’expérience de l’observateur, mais projette, à partir de l’ensemble atemporel, les flux dont la structure globale satisfait à la cohérence causale et à la compatibilité de bande passante.

IV. Connexions avec la philosophie existante

IV.1 Hume et la théorie du faisceau

Le Traité (1739) de David Hume soutenait fameusement que le soi n’est rien d’autre qu’« un faisceau ou une collection de perceptions différentes, qui se succèdent les unes aux autres avec une rapidité inconcevable ». [1] Il n’existe aucun sujet durable sous-jacent au flux de l’expérience — seulement le flux lui-même.

L’OPT confirme l’observation phénoménologique de Hume, mais fournit la raison structurelle expliquant pourquoi aucun sujet durable ne peut être trouvé : l’auto-modèle \hat{K}_\theta ne peut pas contenir son propre générateur. Lorsque Hume regardait vers l’intérieur et n’y trouvait que des perceptions, il rapportait avec exactitude la sortie d’un auto-modèle incapable de représenter le processus qui produit ces perceptions. Le « faisceau » est le contenu de l’auto-modèle. Le sujet que Hume ne pouvait pas trouver est \Delta_{\text{self}} — non pas absent, mais impossible à modéliser du point de vue de l’instrument qui le cherche.

IV.2 Metzinger et le modèle phénoménal du soi

Dans Being No One (2003), Thomas Metzinger soutient que le soi phénoménal est un auto-modèle transparent — un modèle que le système ne reconnaît pas comme un modèle. [9] Le « tunnel de l’ego » résulte d’un système incapable de voir au travers de ses propres processus représentationnels.

L’OPT spécifie la raison formelle de cette transparence : l’auto-modèle \hat{K}_\theta ne peut pas contenir suffisamment d’information pour représenter son propre statut de modèle. La transparence n’est ni un choix de conception ni un raccourci évolutif ; elle est une conséquence de l’écart de complexité \Delta_{\text{self}} > 0. L’auto-modèle ne dispose pas de la bande passante nécessaire pour représenter à la fois son contenu (le soi narratif) et son statut (un modèle d’un système plus vaste). Il représente le contenu. Le statut se trouve dans l’écart.

IV.3 Parfit et l’identité personnelle

Dans Reasons and Persons (1984), Derek Parfit soutenait que l’identité personnelle n’est pas ce qui importe — ce qui importe, c’est la continuité et la connexité psychologiques, lesquelles peuvent exister par degrés et n’ont pas à être tout ou rien. [6]

L’OPT fournit le cadre formel de cette intuition. Ce qui persiste à travers le temps, c’est P_\theta(t) — le modèle prédictif permanent, qui évolue continûment par l’opérateur de mise à jour \mathcal{U}. La continuité psychologique est la continuité de P_\theta(t). Le « soi » que Parfit a montré réductible est \hat{K}_\theta — la couche d’auto-modèle qui génère le sentiment d’identité. Ce sentiment est réel ; la métaphysique qu’il implique — à savoir qu’il existe un sujet unique, persistant, tout-ou-rien — est un artefact de compression de l’auto-modèle, non une propriété de l’observateur sous-jacent.

IV.4 Frankfurt et la responsabilité morale

Le modèle hiérarchique de la responsabilité morale proposé par Harry Frankfurt (1971) — selon lequel un agent est responsable des actions qui procèdent de désirs auxquels il s’identifie à un niveau supérieur — se heurte au problème de la régression : qu’est-ce qui s’identifie aux désirs de niveau supérieur ? Qu’est-ce qui approuve l’approbation ? [5]

L’OPT apporte une réponse structurelle : la régression s’arrête à \Delta_{\text{self}}. L’auto-modèle peut approuver des désirs, évaluer des approbations et réfléchir sur des réflexions — mais la transition finale de la délibération à l’action se produit dans l’écart que l’auto-modèle ne peut pas représenter. La régression n’a pas besoin d’une tour infinie de désirs de plus en plus méta ; elle s’arrête au point où la capacité représentationnelle de l’auto-modèle est épuisée. Ce qui demeure — \Delta_{\text{self}} — n’est pas un niveau supplémentaire d’approbation, mais le processus de sélection lui-même, opérant au-delà de la portée de l’auto-modèle.

Cela dissout la régression sans éliminer la responsabilité. La responsabilité s’attache à l’observateur complet (K_\theta), et non au récit que l’auto-modèle donne de ses propres approbations (\hat{K}_\theta). Le point d’arrêt se situe dans l’écart — non parce que l’écart approuve le choix, mais parce que l’écart est l’endroit où le choix est effectué.

IV.5 Baron, Miller & Tallant et la théorie de l’erreur temporelle

Les sous-sections précédentes traitent du soi, de la conscience, de l’identité et de la responsabilité — autant de domaines où l’OPT converge avec l’analyse philosophique établie. Une convergence apparentée mais distincte apparaît dans la philosophie du temps.

Dans Out of Time (2022), Baron, Miller & Tallant [12] élaborent une taxinomie systématique des conséquences d’une physique intemporelle. Si l’équation de Wheeler-DeWitt est correcte et si le substrat fondamental ne comporte aucune variable temporelle, que devons-nous dire de nos croyances temporelles ? Ils identifient quatre options : le réalisme temporel (notre discours temporel demeure vrai), la théorie de l’erreur (nos croyances temporelles sont systématiquement fausses), le fictionnalisme (le discours temporel est une fiction utile) et l’éliminativisme (nous devrions abandonner le langage temporel). Leur conclusion — défendue tout au long des chapitres 9 et 10 — est que la théorie de l’erreur temporelle est la position la plus défendable : si la physique est intemporelle, nos concepts temporels ordinaires ne correspondent pas à la réalité, et nos croyances sur le temps sont systématiquement erronées.

La difficulté centrale qu’ils identifient est pratique : comment des agents peuvent-ils délibérer, planifier et agir si l’expérience temporelle est une erreur systématique ? L’agentivité semble requérir une structure temporelle — un « avant » dans lequel on délibère et un « après » dans lequel le choix prend effet. Si la théorie de l’erreur est correcte, cet échafaudage temporel est illusoire, et les fondements de la raison pratique semblent s’effondrer.

L’OPT dissout cette difficulté en occupant une position que la taxinomie de Baron et al. n’anticipe pas tout à fait : réalisme temporel dans le rendu, couplé à un éliminativisme concernant le temps du substrat. Le substrat |\mathcal{I}\rangle est bien atemporel — la section §8.5 de l’article fondateur l’énonce explicitement. Mais l’expérience temporelle n’est pas une erreur systématique. C’est une véritable propriété structurelle de la sortie du codec. Le rendu présente une structure séquentielle réelle, un ordre causal réel, un véritable avant-et-après — non parce que ces traits sont fondamentaux, mais parce que le Filtre de stabilité ne sélectionne que les flux dont la structure prédictive peut être compressée en un récit temporel cohérent. Le temps n’est ni fondamental (comme le soutient le réalisme temporel) ni illusoire (comme le soutient la théorie de l’erreur). Il est généré : une propriété structurelle nécessaire de tout flux compatible avec un observateur.

L’agentivité subsiste non parce que les agents fonctionneraient malgré une illusion temporelle, mais parce que le codec génère la structure temporelle à l’intérieur de laquelle l’agentivité opère. L’observateur délibère dans le temps rendu, sélectionne des branches dans l’Éventail Prédictif dans le temps rendu, et éprouve les conséquences de cette sélection dans le temps rendu. Que le substrat soit atemporel est sans pertinence pour la situation pratique de l’agent, de même que le fait qu’un film soit stocké comme un fichier statique est sans pertinence pour l’expérience de le voir se déployer. La section §8.6 de l’article fondateur développe pleinement cette résolution : la sélection est une « traversée phénoménologique » d’une structure atemporelle au niveau du substrat, mais authentiquement temporelle au niveau du rendu.

IV.6 Husserl et la conscience intime du temps

Dans les Leçons pour une phénoménologie de la conscience intime du temps (1928), Edmund Husserl [22] a établi que l’expérience temporelle vécue n’est pas une suite d’instants présents isolés, mais une structure tripartite : chaque moment présent porte une rétention de ce qui vient de passer et une protention de ce qui est sur le point d’advenir, unifiées dans un « présent vivant » indivisible. Sans cette synthèse, il n’y aurait aucun objet éprouvé — seulement un vacillement d’impressions disjointes.

L’OPT spécifie le mécanisme structurel que Husserl décrivait phénoménologiquement. Le Registre Causal stabilisé R_t est la rétention (le passé structurellement fixé disponible pour l’acte du maintenant) ; l’Éventail Prédictif \mathcal{F}_h(z_t) est la protention (les branches non résolues que le codec se prépare à traverser) ; le présent est l’ouverture C_{\max} au niveau de laquelle une branche est rendue dans le registre. La structure tripartite de Husserl n’est pas une caractéristique contingente de la conscience humaine — c’est la seule forme de flux qui satisfasse le Filtre de stabilité, car un codec sans rétention ne peut pas maintenir la cohérence causale, et un codec sans protention ne peut pas satisfaire la condition prédictive (T6-1 de l’article fondateur).

Husserl notait en outre que l’acte de constitution du présent ne peut pas lui-même devenir un objet à l’intérieur de ce présent : la conscience du maintenant ne se donne à elle-même que de manière oblique, jamais de face. C’est exactement \Delta_{\text{self}} > 0. L’activité synthétisante s’exécute dans l’écart que l’auto-modèle ne peut pas représenter, et l’« impression originaire » de Husserl est la face phénoménologique de la traversée de l’ouverture — le même point auquel Hume est parvenu par introspection (IV.1) et Frankfurt par l’analyse de la responsabilité morale (IV.4), ici retrouvé à partir de la structure de l’expérience temporelle elle-même.

IV.7 Merleau-Ponty et le cogito pré-réflexif

Dans Phénoménologie de la perception (1945), Maurice Merleau-Ponty [23] soutenait que la conscience n’est pas d’abord un sujet pensant transparent à lui-même inspectant des représentations, mais un corps vécu engagé dans le monde. Le sujet percevant ne peut pas se saisir pleinement comme source de sa propre perception depuis l’intérieur même de l’acte perceptif : le « cogito tacite » est une présence silencieuse à soi, distincte de et antérieure au « je pense » explicite de la conscience réflexive.

L’OPT retrouve la structure pré-réflexive de Merleau-Ponty comme conséquence formelle de \Delta_{\text{self}} > 0. Le cogito réflexif est l’auto-modèle \hat{K}_\theta ; le cogito tacite est le codec K_\theta lui-même, qui ne peut pas être intégralement amené dans le cadre réflexif parce que ce cadre réflexif est l’une de ses sorties. L’affirmation de Merleau-Ponty selon laquelle la conscience n’est « pas coïncidence de soi avec soi » mais séparation structurelle décrit précisément l’écart que l’OPT mesure comme \Delta_{\text{self}}. C’est aussi là que réside l’impossibilité de faire l’expérience de son propre choix : l’acte de sélection s’exécute dans le même point aveugle d’où surgit la perception, raison pour laquelle la volonté est éprouvée comme quelque chose que l’on est plutôt que comme quelque chose que l’on inspecte.

Le « corps vécu » possède lui aussi un équivalent précis dans l’OPT. Ce n’est pas un objet que le sujet possède, mais la frontière à travers laquelle le sujet est constitué — exactement le rôle de la Couverture de Markov \partial_R A (article fondateur §3.4). Là où Merleau-Ponty refuse la division intérieur/extérieur sur des bases phénoménologiques, l’OPT dérive le même refus en termes informationnels : la frontière est constitutive plutôt que séparatrice, et la perception est le rendu par le codec du contenu du flux plutôt que la réception, par un sujet caché, d’entrées externes. L’Inférence active et le couplage pré-réflexif corps-monde sont le même phénomène décrit dans deux vocabulaires.

IV.8 Résumé des convergences

Le tableau suivant résume comment chaque tradition identifie indépendamment la même caractéristique structurelle que l’OPT dérive de la théorie de l’information :

| Tradition | Thèse centrale | Explication structurelle de l’OPT | Convergence |

|---|---|---|---|

| Hume (théorie du faisceau) | Aucun sujet durable n’est trouvé sous les perceptions | L’auto-modèle \hat{K}_\theta ne peut pas contenir son générateur ; « le faisceau » est le contenu du modèle | Hume rapporte avec exactitude la sortie d’un système incapable de représenter son propre producteur |

| Metzinger (modèle phénoménal du soi) | Le soi est un modèle transparent que le système ne peut pas reconnaître comme modèle | \Delta_{\text{self}} > 0 empêche le modèle de représenter son propre statut de modèle | La transparence chez Metzinger est une conséquence de l’écart de complexité, non un choix de conception |

| Parfit (identité personnelle) | L’identité se réduit à la continuité psychologique, qui existe par degrés | Continuité psychologique = continuité de P_\theta(t) ; le « soi » est l’artefact de compression de l’auto-modèle | La réduction de Parfit est correcte ; le sujet implicite tout-ou-rien est un artefact de rendu |

| Frankfurt (responsabilité morale) | La responsabilité requiert une approbation hiérarchique, mais la hiérarchie régresse | La régression s’arrête à \Delta_{\text{self}} : la capacité représentationnelle de l’auto-modèle est finie | La régression de Frankfurt s’arrête au point aveugle, là où la sélection elle-même se produit |