Die Theorie der geordneten Patches

Ein konzeptioneller Rahmen, der erklärt, warum unser bewusstes Erleben in einem stabilen, regelgebundenen Universum statt in endlosem Rauschen stattfindet — und warum diese Stabilität fragil ist.

Das Problem

Der Bomber und die Augenbinde

Während des Zweiten Weltkriegs verstärkte das Militär die Teile zurückkehrender Bomber, die Einschusslöcher aufwiesen, bis man erkannte, dass man auf die Überlebenden blickte. Die Flugzeuge, die in den Motoren getroffen wurden, kehrten nie zurück. Man optimierte für eine gefilterte Stichprobe.

Wir machen denselben Fehler, wenn wir auf das Universum blicken. Wir sehen Milliarden Jahre stabiler Gesetze, ein vorhersagbares holozänes Klima und eine kausale Zeitlinie, und wir nehmen an, dass diese Stabilität der physikalische Normalfall ist.

Ist es nicht. Es ist die holozäne Maschine. Wir betrachten eine gefilterte Stichprobe. Jeder informationelle Strom, der zu chaotisch, zu verrauscht oder zu widersprüchlich war, um einen stabilen Beobachter zu tragen, wurde eliminiert. Wir existieren in einem hochgeordneten Patch unendlichen Chaos gerade deshalb, weil wir nirgendwo sonst existieren könnten.

Die Lösung

Der Stabilitätsfilter

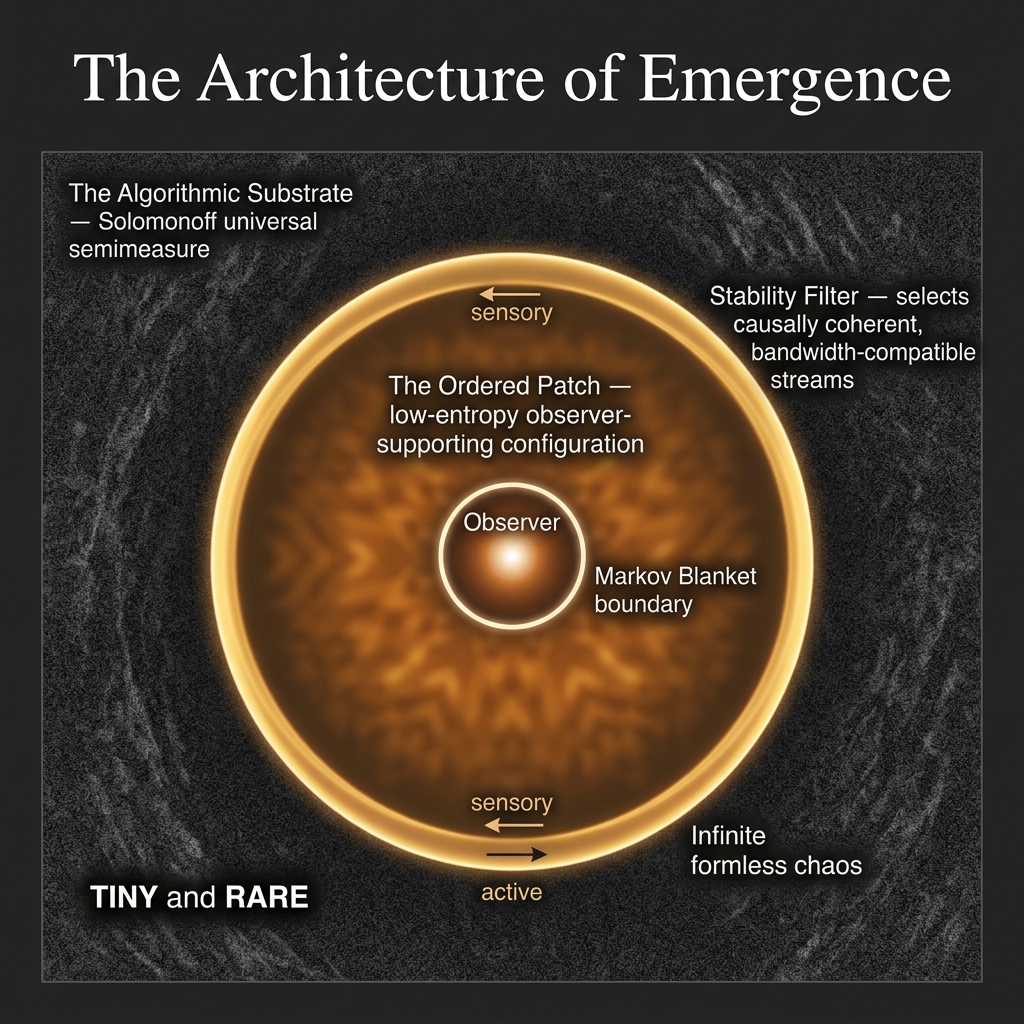

Die Theorie der geordneten Patches (OPT) schlägt vor, dass wir weder komplexe Strings, zusätzliche Dimensionen noch Simulationsschöpfer erfinden müssen, um die Realität zu erklären. Wir benötigen nur zwei Primitive: Unendliches Chaos und einen virtuellen Stabilitätsfilter.

Weil das Chaos unendlich ist, werden sich einige lokale Patches zufällig so ausrichten, dass kohärente, regelgebundene Ströme entstehen. Ein bewusster Beobachter ist einfach einer dieser kohärenten Ströme. Die „Gesetze der Physik“ sind keine äußeren Regeln, die von einem Schöpfer diktiert werden; sie sind die lokalen Muster, die erforderlich sind, um diese Randbedingung zu erfüllen.

Der geordnete Patch — eine seltene Insel der Stabilität im unendlichen Rauschen

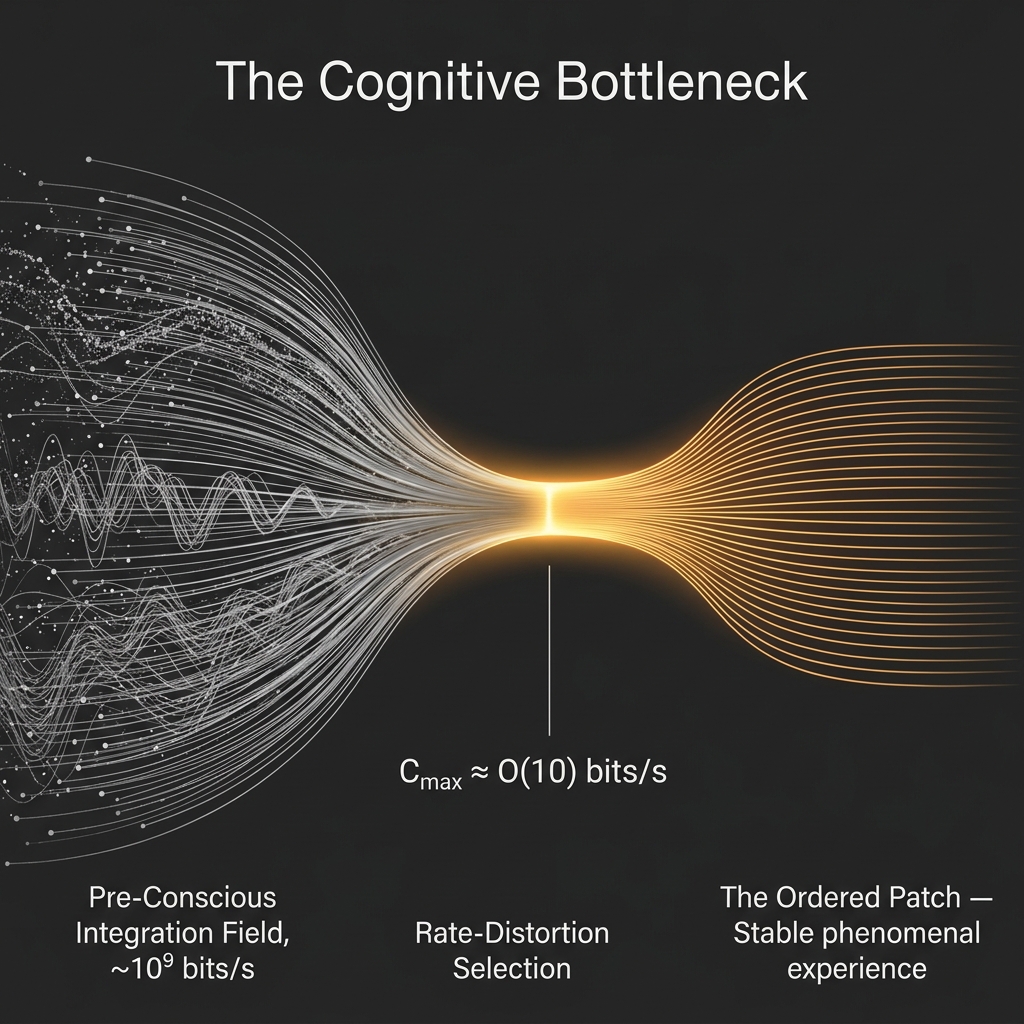

Bewusstsein wird als ein Kompressions-Codec mit geringer Bandbreite modelliert — eine strukturelle Anforderung, die eine unendliche, chaotische Realität zu einem winzigen, überlebensfähigen 3D-Render komprimiert. Doch der Codec ist fragil.

Der kognitive Engpass — ~10⁹ bits/s komprimiert auf ~10 bits/s

Die Krise

Codec-Entropie (Narrativer Verfall)

Wenn wir das Klima rasch verändern oder uns auf zerstörerische globale Konflikte einlassen, beschädigen wir nicht nur einen physischen Planeten. Wir speisen massives, unvorhersehbares Rauschen schneller in den Datenstrom ein, als unser Codec es komprimieren kann.

Wenn das Rauschen die Bandbreite des Codec übersteigt, destabilisiert sich der Patch. Die „Gesetze“ beginnen auszufransen. Die Gesellschaft zerfällt. Das nennen wir Narrativen Verfall.

Die Wahl

Die Überlebenden-Wache-Ethik

Wenn das Holozän kein garantiertes physikalisches Gesetz, sondern eine aufwändige informationelle Leistung ist, dann sind wir keine Passagiere auf einem stabilen Planeten. Wir sind die aktive Wartungscrew.

Daraus folgt die Überlebenden-Wache-Ethik: ein ethischer Rahmen, der verlangt, dass wir die sprachlichen, biologischen und institutionellen Codecs, die das Rauschen auf Abstand halten, entschlossen schützen.

Eine Karte des Territoriums

Theorievergleiche

Ein rigoroser Vergleich der Theorie der geordneten Patches mit ihren nächsten philosophischen und informationstheoretischen Vorläufern.

Free Energy Principle (FEP / Aktive Inferenz)

Dynamiken innerhalb der Welt vs. Ursprünge dieser Welt

Was es ist: Das Free Energy Principle besagt, dass alle lebenden Systeme ihre Existenz aufrechterhalten, indem sie so handeln, dass sie Überraschung (variationale freie Energie) in Bezug auf ihre sensorischen Eingaben minimieren.

OPT vs. FEP: Fristons FEP modelliert Handeln und Lernen als Minimierung freier Energie über eine bereits bestehende Markov-Decke hinweg. OPT übernimmt diesen Apparat unverändert, behandelt FEP jedoch als die lokale Dynamik innerhalb eines bereits selektierten Patchs. FEP ist eine Theorie der Dynamik innerhalb der Welt. OPT erklärt warum es überhaupt stabile, entropiearme Patches mit Markov-Decken gibt, die beobachtet werden können.

Solomonoff-Induktion & Informationsengpass

Epistemische Werkzeuge vs. ontologische Filter

Was es ist: Die Solomonoff-Induktion formalisiert Ockhams Rasiermesser, indem sie Daten mithilfe des kürzestmöglichen Computerprogramms vorhersagt. Die Informationsflaschenhals-Methode komprimiert ein Signal optimal, während sie dessen prädiktive Leistungsfähigkeit bewahrt.

OPT vs. IB/Solomonoff: Normalerweise sind dies epistemische Werkzeuge, die ein System zur Vorhersage von Daten verwendet. Die Theorie der geordneten Patches (OPT) macht daraus jedoch einen ontologischen und anthropischen Filter: Der Flaschenhals ist der Beobachterselektionsprozess. Ein Beobachter bewohnt nur einen Strom, der diese strenge algorithmische Beschränkung überleben kann.

Mathematical Universe Hypothesis (MUH)

Unbeschränkte Mathematik vs. kapazitätsbegrenzte Beobachter

Was es ist: Max Tegmarks Hypothese des mathematischen Universums besagt, dass die physische Realität buchstäblich eine mathematische Struktur ist und dass alle möglichen mathematischen Strukturen physisch existieren.

OPT vs. MUH: OPT steht der MUH sehr nahe, ergänzt sie jedoch um ein explizites Kriterium der Beobachter-Kompatibilität. Die MUH sagt: „Alle mathematischen Strukturen existieren.“ OPT sagt: „Sie existieren mathematisch, aber Beobachter können nur jene extrem seltenen Strukturen bewohnen, die hinreichend komprimierbar sind, um einen strengen prädiktiven Flaschenhals zu überstehen.“

Algorithmische Ontologien (Müller, Khan, Campos-García)

Algorithmische Eigenschaften vs. mathematische Grenzen

Was es ist: Müllers Law without Law (2020) und Algorithmic Idealism (2026) ersetzen eine unabhängige physische Realität formal durch algorithmische Selbstzustände, die durch Solomonoff-Induktion bestimmt sind, und zeigen, dass objektive Realität — einschließlich Multi-Agenten-Konsistenz — asymptotisch aus epistemischen Beschränkungen der Erste-Person-Perspektive hervorgeht. Khan modelliert Beobachter als endliche Algorithmen, deren klassisch-quantische Grenze thermodynamisch erzwungen ist. Campos-García versteht Bewusstsein als den Renderer, der rechnerische Felder zur Phänomenologie kollabieren lässt.

OPT vs. algorithmische Ontologien: Diese Ansätze konvergieren strukturell mit OPT, doch OPT ist noch radikaler subjektiv: Es gibt keine geteilte Welt, die asymptotisch wiedergewonnen werden könnte. Physische Realität und „andere“ sind strukturelle Regularitäten innerhalb des Beobachterstroms, keine unabhängig existierenden Entitäten. Während diese benachbarten Ansätze die Herleitung spezifischer physikalischer Gesetze (wie der Gravitation) als offene Frage belassen, behandelt OPT seinen Cmax-Bandbreitenengpass als die exakte mathematische Grenze, aus der makroskopische Physik (z. B. entropische Gravitation) thermodynamisch hergeleitet wird.

Theorie der integrierten Information (IIT)

Konstitutiv vs. selektiv

Was es ist: Die Theorie der integrierten Information (IIT) schlägt vor, dass Bewusstsein mit dem Ausmaß integrierter Information identisch ist, das durch die kausale Struktur eines Systems erzeugt wird (gemessen als $\Phi$).

OPT vs. IIT: IIT fragt: „Welche informationelle Struktur ist Bewusstsein?“ (Sie ist konstitutiv.) OPT fragt: „Welche Informationsströme sind für einen Beobachter überlebbar?“ (Sie ist selektiv.) Der schärfste Konflikt besteht darin, dass ein System mit hohem $\Phi$, das von inkompressiblem Rauschen getrieben wird, unter OPT keine stabile Phänomenalität besitzen könnte, weil es die Anforderung virtueller Kompression (den Stabilitätsfilter) nicht erfüllt.

Hoffmans Interface-Theorie

Evolutionär zuerst vs. Kompression zuerst

Was es ist: Donald Hoffman argumentiert, dass die Evolution uns die objektive Wahrheit der Realität verborgen hat und uns stattdessen eine vereinfachte „Benutzeroberfläche“ (unsere wahrgenommene Welt) bereitstellt, die ausschließlich auf biologische Fitness ausgerichtet ist.

OPT vs. Hoffman: OPT stimmt der Interface-Phänomenologie in hohem Maße zu, begründet sie jedoch anders. OPT ist zuerst Kompressions-Interface. Das Interface ist nicht primär ein biologischer Zufall oder eine evolutionäre Strategie; es ist die strukturelle, thermodynamische Notwendigkeit, ein unendliches mathematisches Substrat durch eine endliche Bandbreitenobergrenze zu passen.