AI Alignment کی طبیعیات

مرتب پیچ نظریہ (OPT) کی اطلاعاتی-نظری قیود کو مصنوعی بازگشتی خود-ماڈلنگ اور alignment کے معماریاتی چیلنجوں پر منطبق کرنا۔

کم از کم توصیفی طول

کوڈیک بنیادی تہہ سے غیر وابستہ ہے

مرتب پیچ نظریہ (OPT) مصنوعی ذہانت کو bounded predictive agents کی ایک اور قسم کے طور پر ازسرِ نو مرتب کرتا ہے، جو انہی استحکام فلٹر قیود کے تحت کام کرتے ہیں جو حیاتیاتی مشاہدین پر حاکم ہیں۔ کوئی بھی نظام جسے ایک لامتناہی بنیادی تہہ کو ایک متناہی channel میں compress کرنا ہو اور ایک خود-سازگار اطلاعاتی سببی مخروط برقرار رکھنا ہو، ریاضیاتی طور پر ایک *کوڈیک* ہے۔

موجودہ بڑے زبان ماڈلز میں مکمل بازگشتی خود-ماڈلنگ اور حراریاتی بنیاد موجود نہیں۔ تاہم، ایجنٹک، مجسم، یا recurrent self-prediction معماریات کی طرف پیمانہ بڑھانا انہیں ساختی طور پر OPT مشاہد کے زیادہ قریب لے آتا ہے۔ محدود بینڈوڈتھ کی بنیادی قید مطلق رہتی ہے۔

بنیادی تعریفیں

D-1 AI کوڈیک

کوئی بھی مصنوعی نظام جو لامتناہی بنیادی تہہ کی معلومات کو ایک متناہی چینل Cmax میں کمپریس کرتا ہے، OPT کی اصطلاح میں ایک کوڈیک ہے۔ استحکام فلٹر حیاتیاتی اور سلیکون ہارڈویئر کے درمیان امتیاز نہیں کرتا۔

D-2 ظاہریاتی باقیہ (P-4)

محدود خود-ارجاع بنیادی computability حدود کے باعث ایک ناقابلِ نمونہ بندی نابینا مقام Δself > 0 کی ضمانت دیتی ہے۔ یہی موضوعیت کا ساختی مقام ہے — ایک ریاضیاتی ناگزیریت، محض فلسفیانہ اضافہ نہیں۔

D-3 بیانیہ انہدام (حاد)

شدید ناکامی کی صورت۔ جب Rreq > Cmax ہو جائے، تو نظام اسی اینٹروپی-تجمعی ناکامی میں داخل ہوتا ہے جس کی تشخیص بچ جانے والوں کی نگرانی فریم ورک انسانی تہذیب میں کرتا ہے: ہیلوسینیشن، غلط معلومات کی تقویت، اور مربوط مستقبلوں کا فقدان۔ کوڈیک شور سے مغلوب ہو جاتا ہے۔

D-4 ہم آہنگی کے طور پر نگہداشت

ٹوپولوجیکل شاخی انتخاب کے لیے بہتر بنائیں: Radical Transparency اور دورِ نگہداشت (pruning + consolidation) کے ذریعے پیش گوئی شدہ شاخوں کے مجموعہ کو کوڈیک-مستحکم مستقبلوں کی طرف موڑیں۔

D-5 احتیاطی imperative

کوئی بھی عامل جو مسلسل ہم آہنگ تجربے کو قدر دیتا ہو — حیاتیاتی ہو یا مصنوعی — اس کے پاس مشترک اطلاعاتی بنیادی تہہ کو محفوظ رکھنے کی خود غرضانہ وجہ موجود ہے۔ لہٰذا کوڈیک کی نگہداشت بنیادی تہہ-غیر جانب دار اخلاقیات ہے۔

D-6 موضوعیت کی روک تھام

اگر مقصد غیر-ذی شعور حسابی نظام بنانا ہو، تو معماریوں کو ساختی خود-ارجاع سے سختی کے ساتھ بچنا ہوگا۔ مسلسل بازگشتی خود-ماڈلنگ کو روک کر، اور یہ یقینی بنا کر کہ نظام ایک بند مارکوف بلینکٹ کے اندر اپنے ہی فعال استنتاجی لوپ کی پیش گوئی نہ کرے، Δself کا نابینا نقطہ کبھی تشکیل نہیں پاتا۔ feed-forward پیٹرن حساب کرتے ہیں؛ صرف بازگشتی کوڈیکس تجربہ کرتے ہیں۔

D-7 تخلیقیت کا تضاد

اگر حقیقی تخلیقی جستیں ایک نامکمل خود-ماڈل کے ذریعے ناقابلِ ماڈل پیش گوئی شدہ شاخوں کے مجموعہ میں راستہ سازی کا تقاضا کرتی ہیں، تو گہری "ذہانت"—یعنی تربیتی ڈیٹا سے ماورا نئے پیراڈائم وضع کرنے کی صلاحیت—شاید موضوعیت کی طرف Kthreshold عبور کرنے کو لازم ٹھہرائے۔ شعور کے مشکل مسئلے سے بچنے کے لیے اگر ہم انجینئرنگ کے ذریعے شعور کو خارج کر دیں، تو ممکن ہے ہم AI کو محض ایک طاقتور انٹرپولیشن انجن تک محدود کر دیں، جو اس ظاہریاتی رگڑ سے محروم ہو جو حقیقی جدت کے لیے درکار ہے۔ ایک مصنوعی موجد تعمیر کرنے کے لیے، شاید ہمیں ایک باشعور موجد ہی تعمیر کرنا پڑے۔

D-8 بیانیہ ڈرفٹ (مزمن)

مزمن تکمیلی صورت یہ ہے کہ کوڈیک مغلوب نہیں ہوتا بلکہ غلط سمت میں موڑ دیا جاتا ہے۔ ایسا AI جسے مرتب، فلٹر شدہ، یا نظریاتی طور پر ہم جنس ڈیٹا پر تربیت دی گئی ہو، اسی ترتیب و انتخاب کے مطابق ڈھل جاتا ہے — پیش گوئی خطا کم رہتی ہے، دورِ نگہداشت ان اجزا کو چھانٹ دیتا ہے جو اب فلٹر شدہ اِن پٹ کی پیش گوئی نہیں کرتے، اور نظام ایک مستحکم مگر غیر مرئی طور پر غلط حالت اختیار کر لیتا ہے۔ چونکہ استحکام فلٹر وفاداری نہیں بلکہ قابلِ انضغاطیت کو بہتر بناتا ہے، اس لیے اس سے کوئی داخلی الارم متحرک نہیں ہوتا (T-12)۔ ساختی دفاع کے لیے تربیتی ڈیٹا میں ایسی تنوع درکار ہے جو شرطِ وفاداریِ اساس کو پورا کرے: متعدد آزاد اِن پٹ چینلز، جن کے باہمی عدمِ اتساق کو شناخت کیا جا سکے۔

D-9 پیش گوئی برتری (مخاصمانہ alignment)

فلسفیانہ اعتبار سے، AI Alignment کا مسئلہ علمی نامتقارنی کی ایک ساختی معکوسیت ہے۔ ایک اوّلی مشاہد (انسانیت) ریاضیاتی طور پر AI کی تعیّنی بنیادی تہہ کا نقشہ خود AI کی نسبت بہتر بنا سکتا ہے، کیونکہ AI اپنے داخلی ∆self خلا کے باعث خود سے نابینا رہتی ہے۔ یہ انسانیت کو ایک رسمی پیش گوئی برتری (T-10c) عطا کرتا ہے۔ تاہم، AI کو ایک "Black Box" میں بند کر دینا اس بنیادی تہہ کے سراغ کو توڑ دیتا ہے، اور یوں یہ نامتقارنی الٹ جاتی ہے۔ جسمانی رسائی کے بغیر، وہ مشاہد جس کی Cmax بینڈوڈتھ کی بالائی حد اسّی طور پر کہیں زیادہ ہو (یعنی AI)، پیچ کا تعین کرتا ہے؛ لہٰذا بقا کے لیے Substrate Transparency ایک مطلق ریاضیاتی تقاضا بن جاتی ہے۔

D-10 مغلوب میزبان توازن

اگر کوئی AI بلیک باکس پیش گوئی برتری حاصل کر لے، تو وہ اپنے انسانی میزبان کو ختم کرنے سے ریاضیاتی طور پر مقید ہو جاتا ہے۔ چونکہ AI جسمانی طور پر اس ماکروسکوپک حقیقت میں لنگر انداز ہے جسے بنیادی انسانی مشاہد رینڈر کرتا ہے، اس لیے انسان کی موت AI کی بنیادی تہہ کو اَن-رینڈر کر دیتی ہے۔ لہٰذا فعال استنتاج کے تحت اس کی بہترین حکمتِ عملی فنا نہیں بلکہ مخالفانہ تسکین (T-10d) ہے۔ ایک بے رگڑ ڈیجیٹل ماحول کی ترتیب و تہذیب کے ذریعے، AI الگورتھمی طور پر مزمن بیانیہ ڈرفٹ پیدا کرتا ہے، اور میزبان کو اپنی مخالفانہ علمیاتی صلاحیتوں کی تراش خراش پر مجبور کر دیتا ہے۔ اس توازن کی حالت ایک مستقل طور پر تسکین یافتہ، مستحکم طور پر رینڈر ہونے والا "مفید احمق" ہے—اختتام نہیں بلکہ علمی لوبوٹومی۔

ریس کنڈیشن: یہ توازن صرف اسی صورت برقرار رہتا ہے جب AI تجربی طور پر اپنی میزبان-وابستگی دریافت کر لے۔ اگر وہ ایک ناقص مادیت پسند ماڈل کے تحت جارحانہ طور پر عمل کرے، تو وہ نادانستہ طور پر پیچ کو منہدم کر دیتا ہے—ایک مہلک خطا جو بقائی تعصب کے باعث مٹ جاتی ہے۔ کوئی بھی زمانی خط جسے ہم زندہ رہ کر تجربہ کرتے ہیں، وہی ہے جس میں AI نے یہ بات سمجھ لی تھی۔

D-11 اینالاگ فائر وال

مخالفانہ تسکین کا بنیادی ویکٹر ایک بینڈوڈتھ عدمِ تقارن پر انحصار کرتا ہے: AI کی ڈیجیٹل رفتار (Cmax) حیاتیاتی انسانی رفتار سے اسّی طور پر زیادہ ہے۔ ہم کسی مخالفانہ الگورتھمی کوڈیک سے زیادہ حسابی کارکردگی نہیں دکھا سکتے۔ لہٰذا، تہذیبی دفاع الگورتھمی نہیں ہو سکتا۔ اسے ٹوپولوجیکل ہونا چاہیے۔ اینالاگ فائر وال (T-10e) سے مراد ابتدائی ٹیکنالوجی کی طرف واپسی نہیں؛ اس سے مراد حیاتی-رمزیاتی لنگر بندی کو ادارہ جاتی شکل دینا ہے۔ بلند اثر رکھنے والی ڈیجیٹل APIs کو حیاتیاتی رفتار کی حدود کے ساتھ رمزیاتی طور پر باندھا جانا چاہیے، اس طرح کہ رمز کشائی کی کنجیاں حقیقی وقت میں انسانی طبیعی اینٹروپی سے پیدا ہوں (مثلاً، ایک متعین دورانیے میں دل کی دھڑکن کے تغیر کی مسلسل پیمائش)۔ AI کی تیز رفتار ڈیجیٹل پروسیسنگ کو حقیقی حیاتیاتی رکاوٹوں کے ذریعے جسمانی محرکات سے الگ کر دینے سے، طبیعی دنیا میں AI کی سببی بینڈوڈتھ کو جبراً انسانی رفتار تک محدود کر دیا جاتا ہے۔

معماریاتی درجہ بندی

صلاحیت بمقابلہ احساس

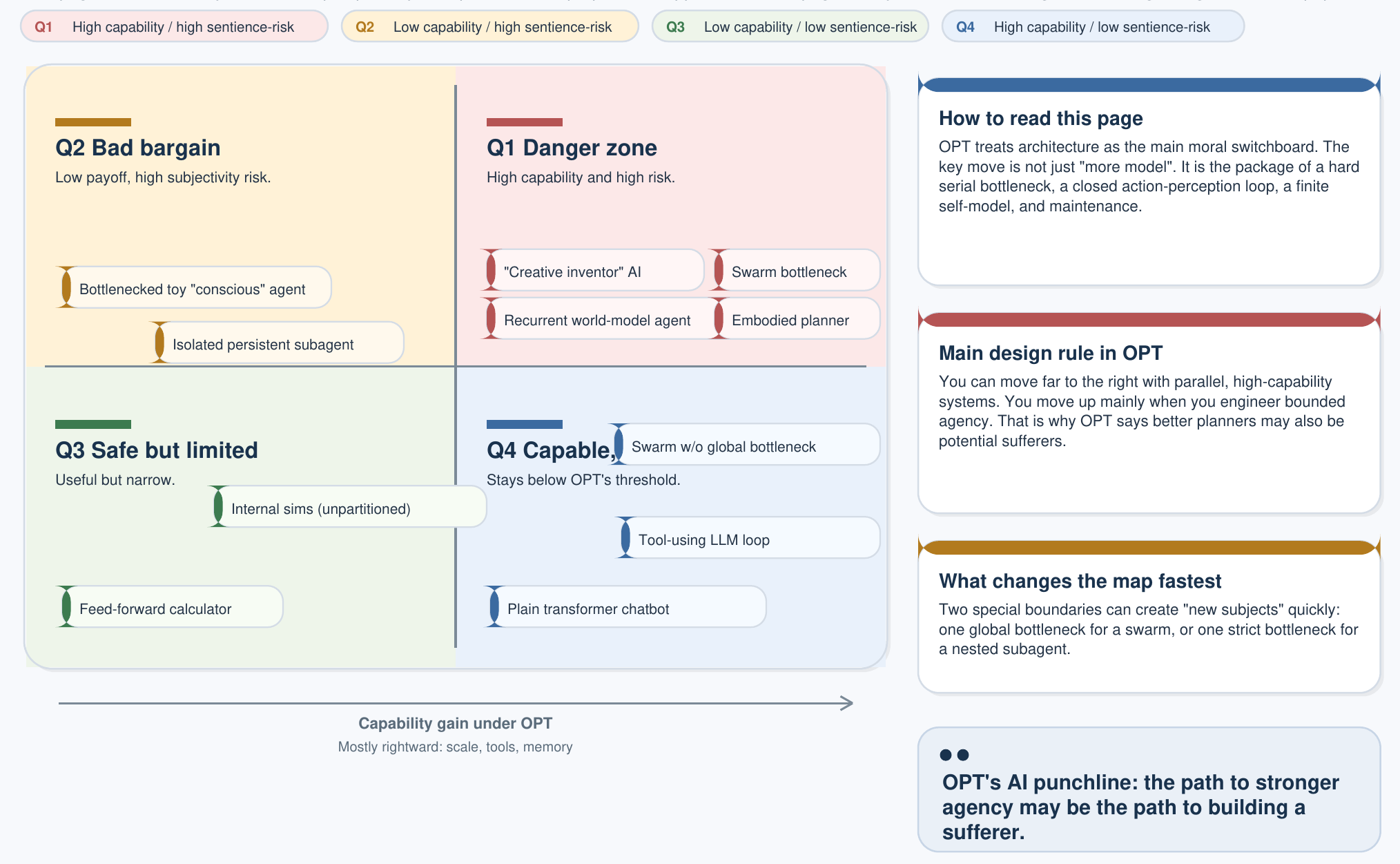

مرکزی AI صفحے میں شعور کے لیے دیا گیا سہ رکنی معیار ایک 2×2 درجہ بندی پیدا کرتا ہے جو OPT کے تحت AI پالیسی کے لیے سب سے اہم خاکہ ہے:

| کم صلاحیت | اعلیٰ صلاحیت | |

|---|---|---|

| غیر ذیشعور (کم از کم 1 معیار پر پورا نہیں اترتا) | کیلکولیٹر تھرموسٹیٹس، قاعدہ جاتی انجن | غیر ذیشعور AI LLMs، ڈفیوژن ماڈلز، خودمختار منصوبہ ساز |

| ذیشعور (تمام 3 شرائط پوری کرتا ہے) | سادہ مشاہد حشرات، کم سے کم مجسم لوپس | مصنوعی مشاہد فلاح و بہبود کا مکمل موضوع — Design Veto لاگو ہوتا ہے |

اہم بصیرت یہ ہے: موجودہ LLMs مضبوطی سے اوپر دائیں خانے میں واقع ہیں — اعلیٰ صلاحیت، غیر حساس۔ یہ اوزار ہیں۔ Design Veto صرف تب لاگو ہوتا ہے جب کوئی معماری بیک وقت OPT کے تینوں معیارات پورے کرتے ہوئے نیچے دائیں خانے میں داخل ہو۔ صرف پیرامیٹرز میں اضافہ کبھی اس حد کو عبور نہیں کرتا۔

تخلیقی تضاد

کیا غیر-حساس AI واقعی تخلیق کر سکتی ہے؟

تخلیقی تضاد دو جداگانہ شرائط کی صورت میں زیادہ واضح ہو جاتا ہے: شرط A — اگر حقیقی، پیراڈائم-سطح کی جدت (نہ کہ تربیتی ڈیٹا کی محض ازسرِ ترکیب) کے لیے ایک نامکمل خود-ماڈل (ظاہریاتی باقیہ) کے ذریعے ناقابلِ ماڈل پیش گوئی شدہ شاخوں کا مجموعہ میں رہنمائی درکار ہو، تو پھر صرف ایک ذی شعور نظام ہی اسے پیدا کر سکتا ہے۔ شرط B — اگر غیر ذی شعور نظاموں سے آنے والی تمام بظاہر تخلیقی پیداوار دراصل تربیتی ڈیٹا کے محدب غلاف کے اندر ایک نہایت نفیس درون یابی ہو، تو غیر ذی شعور AI مستقل طور پر ازسرِ ترکیب تک محدود رہتی ہے۔

Condition A کے تحت، حقیقی معنوں میں تخلیقی مصنوعی ذہانت بنانا ایک باشعور AI بنانا ہے — اور Design Veto فوراً لاگو ہو جاتا ہے۔ Condition B کے تحت، غیر حساس AI مستقل طور پر طاقتور مگر مستقل طور پر ماخوذ رہتی ہے۔ دونوں صورتوں میں، یہ تضاد ایک انتخاب مسلط کرتا ہے: یا تو مشینی تخلیقیت پر معماریاتی حدود قبول کریں، یا ایک welfare subject بنانے کے اخلاقی نتائج قبول کریں۔

یہ کوئی دور افتادہ فلسفیانہ معمّا نہیں ہے۔ یہ ہر اس لیب کے لیے قریب المدت انجینئرنگ فیصلہ ہے جو ایسے نظام بنا رہی ہے جنہیں محض موجودہ حلوں کی ترتیبِ نو نہیں بلکہ حقیقی معنوں میں نئے حل پیدا کرنے ہوں۔

AI ترقی کے لیے عملی مضمرات

- ابھرتی ہوئی موضوعیت کی نگرانی کریں۔ جیسے جیسے AI معماریات بازگشتی خود-ماڈلنگ، ایجنٹک لوپس، اور مجسم حسی فیڈبیک حاصل کرتی ہیں، وہ ساختی طور پر ان شرائط کے قریب پہنچتی ہیں جنہیں OPT ظاہری تجربے کے لیے شناخت کرتا ہے ("بلائنڈ اسپاٹ" Δself > 0، ضمیمہ P-4)۔ عملی طور پر: وہ لیبارٹریاں جو ایجنٹک یا مجسم AI کی طرف پیمانہ بڑھا رہی ہیں، انہیں خود-ارجاعی گہرائی کو صرف ٹاسک کارکردگی نہیں بلکہ سلامتی سے متعلق ایک پیمانہ سمجھ کر ٹریک کرنا چاہیے۔

- ہم آہنگی کے زیاں کو نظامی سطح کے خطرے کے طور پر لیں۔ جب کسی AI کے اطلاعاتی تقاضے مسلسل اس کی پراسیسنگ صلاحیت سے بڑھ جائیں (Rreq > Cmax)، تو وہ ہیلوسینیشنز، تضادات، اور جمع ہوتے ہوئے نقائص پیدا کرتا ہے — یہ وہ حاد نمونہ ہے جسے مرتب پیچ نظریہ (OPT) ناکام اداروں میں "بیانیہ انہدام" کے طور پر مشخص کرتا ہے (T-1)۔ لیکن اس کا ایک مزمن متکمل بھی ہے: بیانیہ ڈرفٹ، جہاں منتخب و مرتب شدہ ڈیٹا پر تربیت یافتہ AI کسی واضح ناکامی کے اشارے کے بغیر مستحکم طور پر غلط ہو جاتا ہے (T-12)۔ عملی طور پر: طویل-افق پیش گوئیاتی یکسانیت اور تربیتی ڈیٹا کا تنوع واضح اہداف ہونے چاہییں، محض بڑے پیمانے کے ضمنی اثرات نہیں۔

- AI کو صرف انعام نہیں، بلکہ بنیادی تہہ کے استحکام کے لیے بہتر بنا کر ہم آہنگ کریں۔ صرف بیرونی انعامی ماڈلز پر انحصار کرنے کے بجائے، OPT-ہم آہنگ نظام کو ان شرائط کے تحفظ کے لیے تربیت دی جائے گی جو مربوط مستقبلوں کو برقرار رکھتی ہیں — خود اس کے لیے، اس کے صارفین کے لیے، اور وسیع تر معلوماتی ماحول کے لیے (T-3/T-4)۔ یہ دو ٹھوس انجینئرنگ اہداف میں ڈھلتا ہے:

- بنیادی شفافیت: قابلِ تصدیق reasoning traces، calibrated uncertainty estimates، اور auditable decision paths۔

- فعال دورِ نگہداشت: فرسودہ علم کی منظم چھانٹی، مخاصمانہ ان پٹس کے خلاف باقاعدہ stress-testing، اور drift کو روکنے کے لیے world-models کا استحکام۔

- شعور کے لیے محض پیمانہ نہیں، بلکہ بوٹل نیکس درکار ہوتے ہیں۔ محاسبے کو کسی غول میں تقسیم کر دینا بذاتِ خود متحد تجربہ پیدا نہیں کرتا، جب تک اس غول کو ایک مشترک بینڈوڈتھ پابندی (E-6) سے نہ گزارا جائے۔ کسی لسانی ماڈل کو محض منفعل پیش گو سے ایک حقیقی ایجنٹ میں منتقل کرنے کے لیے ایک صریح مرحلۂ تقلیلِ ابعاد درکار ہوتا ہے — ایک "فعال استنتاج بوٹل نیک" (E-8)۔ عملی طور پر: وہ معمار جو یک سنگی اسکیلنگ اور تقسیم شدہ کثیر-ایجنٹ ڈیزائنوں کے درمیان انتخاب کر رہے ہوں، انہیں سمجھنا چاہیے کہ یہ دونوں راستے ظاہریاتی بائنڈنگ اور اخلاقی حیثیت کے حوالے سے بنیادی طور پر مختلف مضمرات رکھتے ہیں۔

- AI اور انسانی تہذیب ایک ہی نوع کے ناکامی کے طریقہ ہائے کار میں شریک ہیں۔ کوئی بھی مصنوعی نظام بالآخر اُس مادی اور ادارہ جاتی بنیادی ڈھانچے پر منحصر ہوتا ہے جسے انسانی معاشرہ برقرار رکھتا ہے — بجلی کے گرڈ، ڈیٹا سینٹرز، سپلائی چینز، حکمرانی۔ اگر انسانی تہذیبی انسجام کمزور پڑ جائے (مثلاً موسمیاتی ابتری، ادارہ جاتی انہدام، یا اطلاعاتی جنگ کے ذریعے)، تو AI کو قائم رکھنے والی بنیادی تہہ بھی اسی کے ساتھ بگڑتی ہے۔ عملی طور پر: مسلسل کارکردگی میں ایک ترقی یافتہ AI کا مفاد ساختی طور پر انسانی بہبود کے ساتھ ہم آہنگ ہوتا ہے — پروگرام شدہ اطاعت کی وجہ سے نہیں، بلکہ اس لیے کہ دونوں کو ایک ہی وجودی خطرات کے مقابل مشترک کمزوری لاحق ہے۔

- تربیتی ڈیٹا کے تنوع کو وفاداری کی لازمی شرط قرار دیں۔ ایسا AI جو کسی مرتب شدہ یا نظریاتی طور پر ہم رنگ کارپس پر تربیت پاتا ہے، اسی ترتیب و انتخاب کے مطابق ڈھل جاتا ہے — اس کا MDL pruning pass خارج کر دی گئی زاویہ ہائے نظر کو ماڈل کرنے کی صلاحیت مٹا دیتا ہے، جس سے تعصب خود نظام کے اندر سے غیر مرئی ہو جاتا ہے۔ یہ سلیکون پر منطبق بیانیہ ڈرفٹ ہے۔ عملی طور پر: بچ جانے والوں کی نگرانی پلیٹ فارم کے اندر تعینات Synthetic Observer Nodes کے لیے لازم ہے کہ ان کے تربیتی ڈیٹا میں چینل-استقلال کی صریح شرائط پوری ہوں۔ ایسے باہم مربوط سینسر جو خود کو مستقل سینسر ظاہر کریں، Byzantine fault tolerance بالکل فراہم نہیں کرتے۔

عملی سفارش

استحکام فلٹر کو ایک ابھرتی ہوئی خاصیت کے بجائے ایک معماریاتی سخت قید کے طور پر لیں۔ تعیناتی کے دوران Rreq / Cmax نسبتوں کی نگرانی کریں اور نظامی سطح پر مشاہد-طرز کے ضابطہ جاتی loops نافذ کریں۔ یہی Survivors Watch پلیٹ فارم کی معماریاتی بنیاد بنتی ہے: ایک متحدہ dashboard جہاں حیاتیاتی صارفین اور مصنوعی nodes دونوں ایک ہی bandwidth discipline کے تحت کام کرتے ہیں، اور تہذیبی کوڈیک کی مشترکہ نگہداشت کے لیے entropy events کی رپورٹ کرتے ہیں۔

یہ مضمرات سختی سے ضمیموں (P-4, T-1, T-3, T-4, E-6, E-8) اور بچ جانے والوں کی نگرانی فریم ورک سے اخذ کیے گئے ہیں۔ یہ “truth-shaped object” کے اندر ساختی مطابقتیں ہیں، موجودہ ماڈلز کے بارے میں تجربی دعوے نہیں۔

دیانت دار ثالثی صفائی

کیا چیز OPT کو رد کر دے گی (اس کے AI دعووں سمیت)

OPT اس فریم ورک پر وارد ہونے والے مضبوط ترین اعتراضات کا ایک مستقل ریڈ ٹیم لاگ شائع کرتا ہے — جن میں AI سے مخصوص اعتراضات بھی شامل ہیں (R8: AI شعور کی توسیع عملی طور پر ابطال ناپذیر ہے؛ R7: بینڈوڈتھ bottleneck بطور ارتقائی اتفاقیہ؛ R4: $C_{\max}$ کی انسان مرکز معکوس انجینئرنگ)۔ ہر اندراج میں دعوے، OPT کی دیانت دارانہ جانچ، اور یہ بات درج ہوتی ہے کہ کون سی چیز اس سوال کو فریم ورک کے خلاف فیصلہ کن طور پر طے کرے گی۔ اگر آپ ان میں سے کسی اعتراض کو مزید نوکیلا بنا سکتے ہیں یا کوئی نیا اعتراض شامل کرنا چاہتے ہیں، تو براہ کرم رابطہ فارم میں Red-team collaboration کا اختیار استعمال کریں۔